AI 大模型的发展正在推动各行业的增长,据有关报告显示:"未来十年内预计年均增长率将达到37.3%,全球企业预计在2027年之前将在AI领域投入8000亿美元"。这一迅猛发展促使许多企业进行战略转型,技术团队也需要调整其构建、运行、扩展及保护AI应用、网络和基础设施的方式。

为了帮助企业更好应对AI创新需求的挑战,基于API网关解决方案的AI网关概念被提出,旨在帮助企业随时随地控制和管理应用流量,为企业AI调用提供更好的安全性。

什么是AI网关?

GenAI(生成式AI)的崛起给企业带来了新的安全威胁,同时也催生了对AI服务管理解决方案的需求。AI网关能够帮助技术团队在大规模控制、保护和运行AI模型及API时更具掌控力。总的来说,AI网关类似于传统的API网关,充当连接AI基础设施和服务的统一端点,提供全面的控制、安全性及对AI流量的可观测性,确保应用与模型之间的稳定交互。

AI网关在不同的团队中发挥不同的作用:

-

开发团队:通过减少在多个LLM(大语言模型)API之间的摩擦、模板代码和错误,加速应用构建。

-

安全和治理团队:通过限制访问、确保安全使用AI模型及提供控制、审计和可见性,保护应用。

-

基础设施团队:通过启用高级集成模式和利用云原生功能,帮助AI应用扩展,实现高流量、零停机的连接。

AI网关的工作原理

AI网关可以配置为现有网关代理的附加端点,或者作为AI基础设施中的专用网关代理端点,具体取决于企业的需求。开发人员可以与AI网关暴露的端点进行交互,而内部平台、网关及安全团队则可使用现代原则和声明式配置来管理策略。

对于将AI模型(如大语言模型,LLM)集成到内部系统或者业务应用程序中的企业而言,AI网关发挥着至关重要的作用。与传统的API网关主要处理身份验证、访问管理、流量管理及日志记录不同,AI网关提供了专门针对AI模型和服务的管理和控制功能。

AI网关的核心功能包括:

| 功能 | 描述 |

|---|---|

| 多AI模型提供商集成 | 支持与多个AI模型提供商进行集成,以便灵活选择和切换AI模型。 |

| 统一端点 | 为AI服务和模型提供统一的访问端点,简化了集成工作。 |

| 应用程序配置与部署 | 支持AI应用的配置与快速部署,满足不同场景下的需求。 |

| 安全与访问管理 | 确保应用和模型的安全性,支持复杂的权限管理和访问控制。 |

| AI工作负载可观测性 | 提供AI工作负载的监控和可观测性,便于跟踪和优化系统性能。 |

AI网关的未来

随着企业将更多的AI模型和服务集成到其系统或者应用中,AI网关必须不断适应AI应用和模型变化带来的新挑战。为了扩展AI应用,AI网关未来发展将来逐步满足以下场景:

-

模型故障转移:随着AI模型使用的增加,AI网关必须能够在不同的系统和模型提供商之间无缝切换,确保应用的可靠性和弹性。

-

语义缓存:通过实现语义缓存,可以高效处理相似的请求,减少对LLM API的调用,提高响应时间,降低运营成本。

-

检索增强生成(RAG):AI网关应能够从特定的数据存储中检索数据,以增强模型请求前的输入,提升AI输出的质量和相关性。

对于将AI模型集成到企业内部系统的团队,AI网关是确保生成式AI API的控制、安全性和可观测性的关键工具。

开源 AI 网关项目

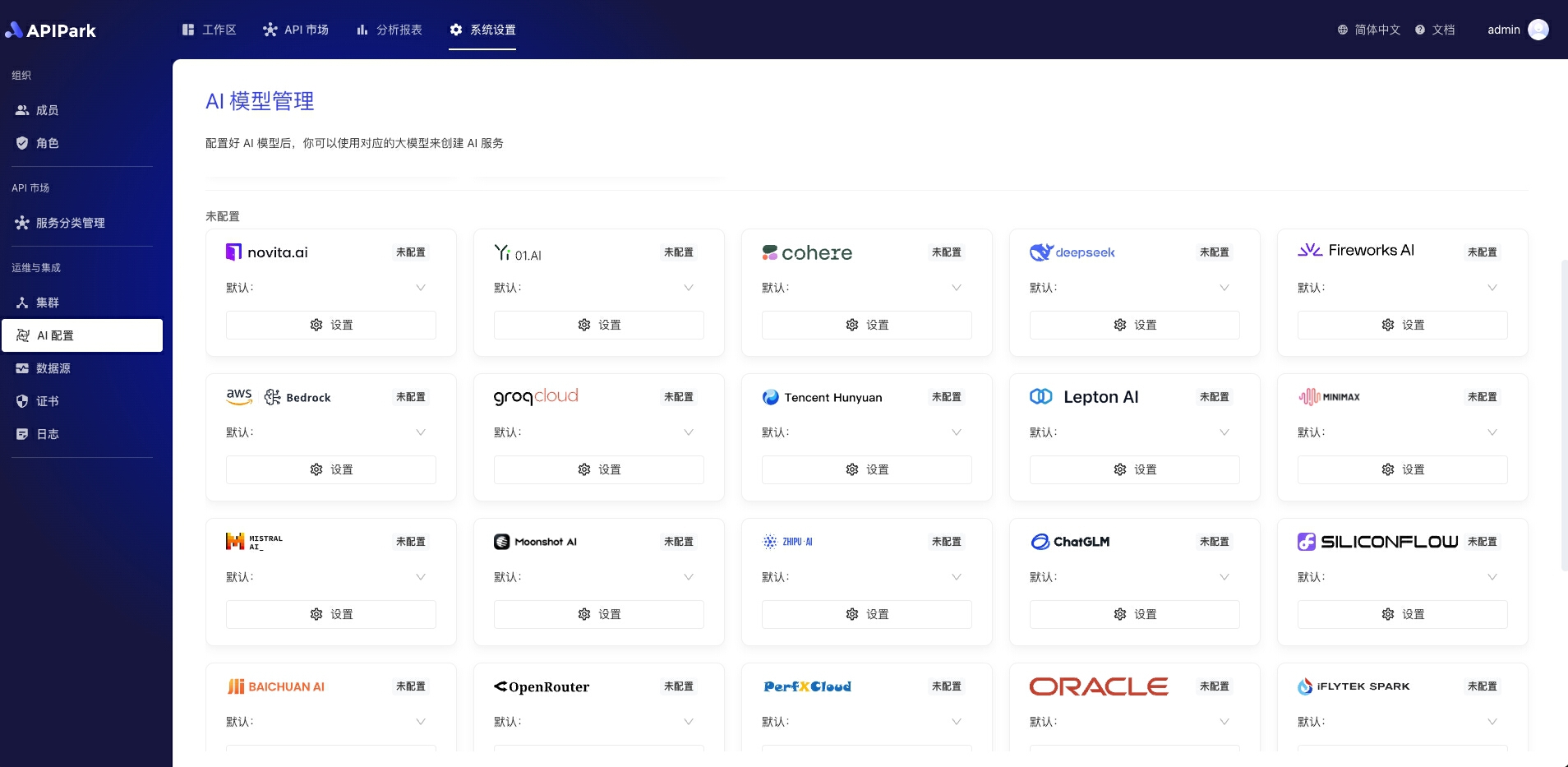

APIPark.COM是一款企业级 AI网关,可以为企业提供应对AI 大模型API的安全调用需求解决方案。APIPark极大地简化了调用大型语言模型的过程,用户无需编写代码即可快速连接多种语言模型,并且在调用 AI 模型的过程中,能够有效保护企业的敏感数据和信息,从而使企业能够更快速且安全地使用 AI 技术。

目前,APIPark上已经接入包括 OpenAI、Claude(Anthropic)、Gemini、文心一言、月之暗面以及通义千问等多个 LLMs(大型语言模型),企业可以快捷调用。

此外,APIPark 支持企业建立自己的API开放平台,通过审批流程控制API调用权限,并提供监控和分析工具,帮助企业跟踪API使用情况,确保安全合规地分享和使用AI模型。