一 k8s网络通信

1.1 k8s通信整体架构

- k8s通过CNI接口接入其他插件来实现网络通讯。目前比较流行的插件有flannel,calico等

- CNI插件存放位置:# cat /etc/cni/net.d/10-flannel.conflist

- 插件使用解决方案如下

- 虚拟网桥,虚拟网卡,多个容器共用一个虚拟网卡进行通信。

- 多路复用:MacVLAN,多个容器共用一个物理网卡进行通信。

- 硬件交换:SR-LOV,一个物理网卡可以虚拟出多个接口,这个性能最好。

- 容器间通信:

- 同一个pod内的多个容器间的通信,通过lo即可实现pod之间的通信

- 同一节点的pod之间通过cni网桥转发数据包。

- 不同节点的pod之间的通信需要网络插件支持

- pod和service通信: 通过iptables或ipvs实现通信,ipvs取代不了iptables,因为ipvs只能做负载均衡,而做不了nat转换

- pod和外网通信:iptables的MASQUERADE

- Service与集群外部客户端的通信;(ingress、nodeport、loadbalancer)

1.2 calico网络插件

官网:

https://docs.projectcalico.org/getting-started/kubernetes/self-managed-onprem/onpremises

1.2.1 calico简介:

- 纯三层的转发,中间没有任何的NAT和overlay,转发效率最好。

- Calico 仅依赖三层路由可达。Calico 较少的依赖性使它能适配所有 VM、Container、白盒或者混合环境场景。

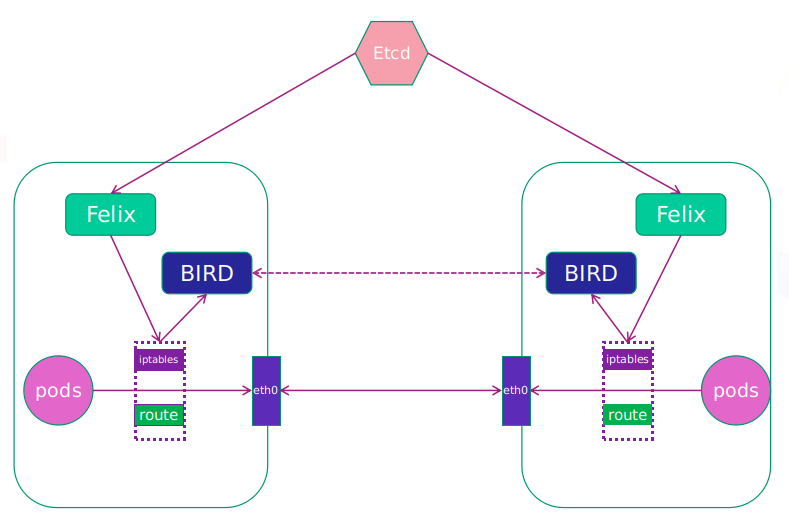

1.2.2 calico网络架构

- Felix:监听ECTD中心的存储获取事件,用户创建pod后,Felix负责将其网卡、IP、MAC都设置好,然后在内核的路由表里面写一条,注明这个IP应该到这张网卡。同样如果用户制定了隔离策略,Felix同样会将该策略创建到ACL中,以实现隔离。

- BIRD:一个标准的路由程序,它会从内核里面获取哪一些IP的路由发生了变化,然后通过标准BGP的路由协议扩散到整个其他的宿主机上,让外界都知道这个IP在这里,路由的时候到这里

1.2.3 部署calico

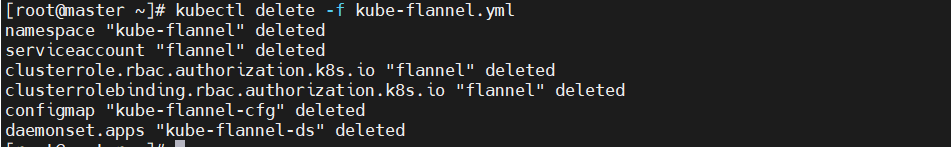

删除flannel插件

bash

[root@master ~]# kubectl delete -f kube-flannel.yml

删除所有节点上flannel配置文件,避免冲突

bash

[root@master ~]# rm -rf /etc/cni/net.d/10-flannel.conflist

[root@node1 ~]# rm -rf /etc/cni/net.d/10-flannel.conflist

[root@node2 ~]# rm -rf /etc/cni/net.d/10-flannel.conflist下载部署文件

bash

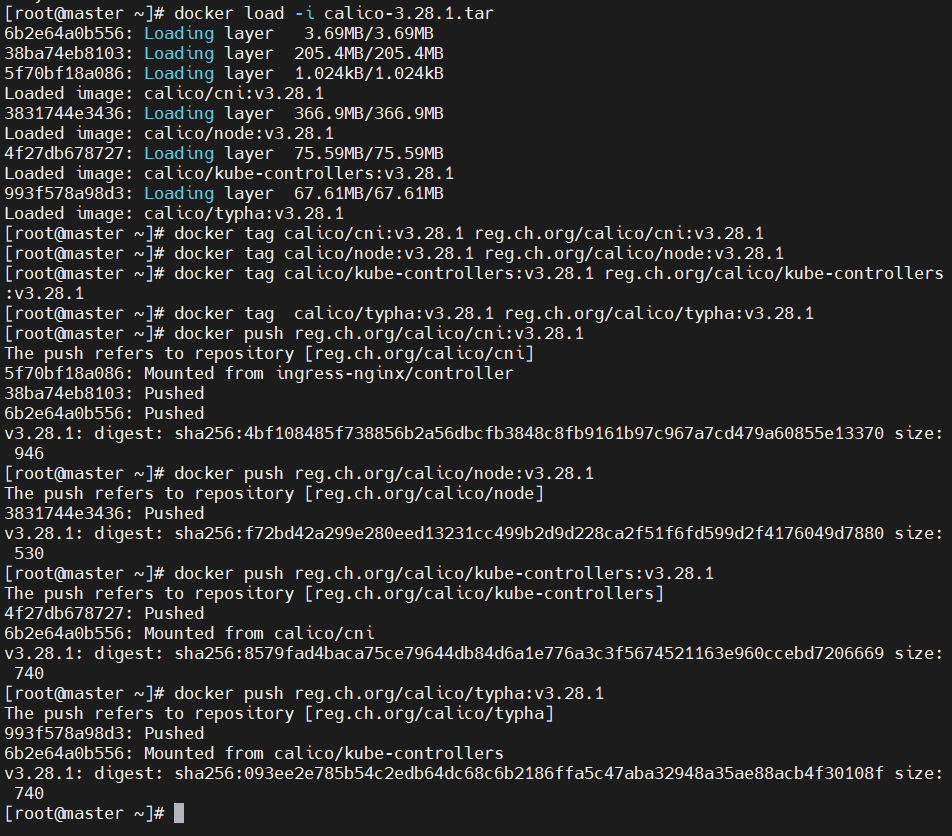

[root@master calico]# curl https://raw.githubusercontent.com/projectcalico/calico/v3.28.1/manifests/calico-typha.yaml -o calico.yaml下载镜像上传至仓库:

bash

[root@master ~]# docker pull docker.io/calico/cni:v3.28.1

[root@master ~]# docker pull docker.io/calico/node:v3.28.1

[root@master ~]# docker pull docker.io/calico/kube-controllers:v3.28.1

[root@master ~]# docker pull docker.io/calico/typha:v3.28.1

更改yml设置

bash

[root@master ~]# vim calico.yaml

4835 image: calico/cni:v3.28.1

4835 image: calico/cni:v3.28.1

4906 image: calico/node:v3.28.1

4932 image: calico/node:v3.28.1

5160 image: calico/kube-controllers:v3.28.1

5249 - image: calico/typha:v3.28.1

4970 - name: CALICO_IPV4POOL_IPIP

4971 value: "Never"

4999 - name: CALICO_IPV4POOL_CIDR

5000 value: "10.244.0.0/16"

5001 - name: CALICO_AUTODETECTION_METHOD

5002 value: "interface=eth0"

[root@master ~]# kubectl apply -f calico.yaml

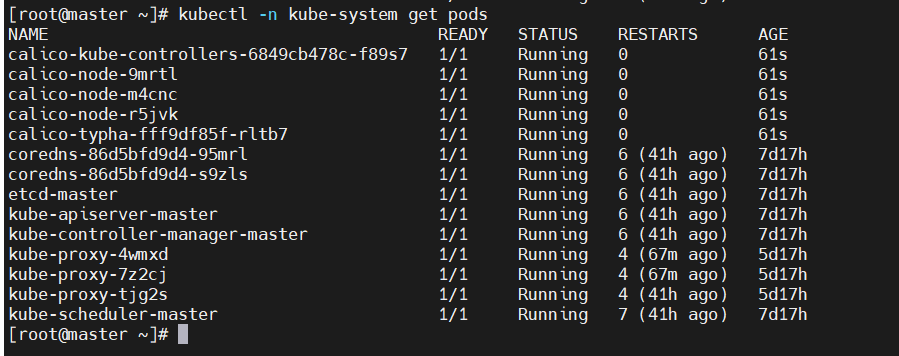

[root@master ~]# kubectl -n kube-system get pods

NAME READY STATUS RESTARTS AGE

calico-kube-controllers-6849cb478c-g5h5p 1/1 Running 0 75s

calico-node-dzzjp 1/1 Running 0 75s

calico-node-ltz7n 1/1 Running 0 75s

calico-node-wzdnq 1/1 Running 0 75s

calico-typha-fff9df85f-vm5ks 1/1 Running 0 75s

coredns-647dc95897-nchjr 1/1 Running 1 (139m ago) 4d7h

coredns-647dc95897-wjbg2 1/1 Running 1 (139m ago) 4d7h

etcd-master 1/1 Running 1 (139m ago) 4d7h

kube-apiserver-master 1/1 Running 1 (139m ago) 3d10h

kube-controller-manager-master 1/1 Running 3 (139m ago) 4d7h

kube-proxy-9g5z2 1/1 Running 1 (139m ago) 3d10h

kube-proxy-cd5wk 1/1 Running 1 (139m ago) 3d10h

kube-proxy-mvq4c 1/1 Running 1 (139m ago) 3d10h

kube-scheduler-master 1/1 Running 3 (139m ago) 4d7h

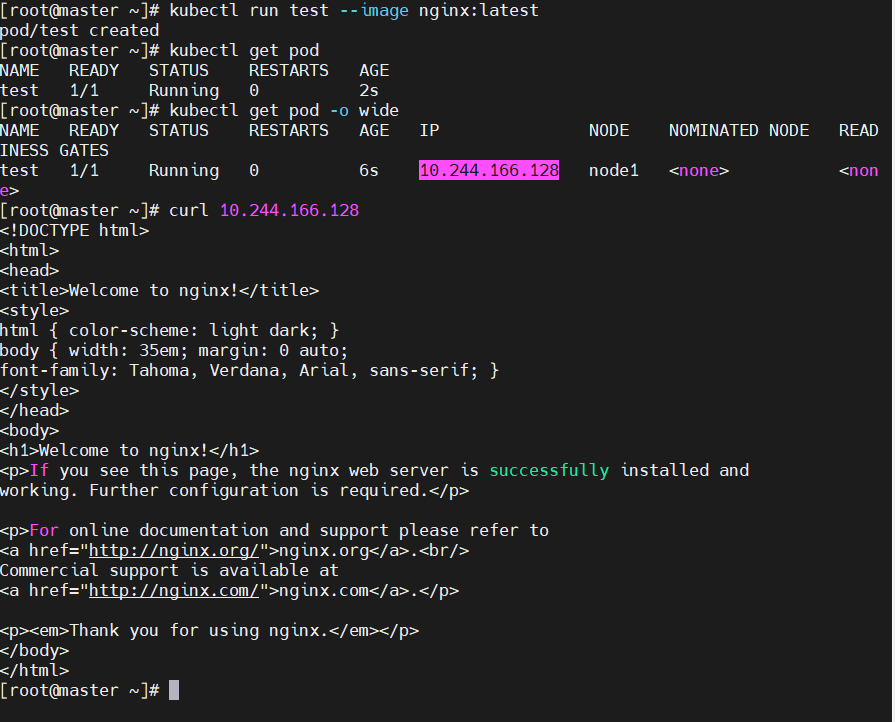

测试:

bash

[root@master calico]# kubectl run web --image myapp:v1

pod/web created

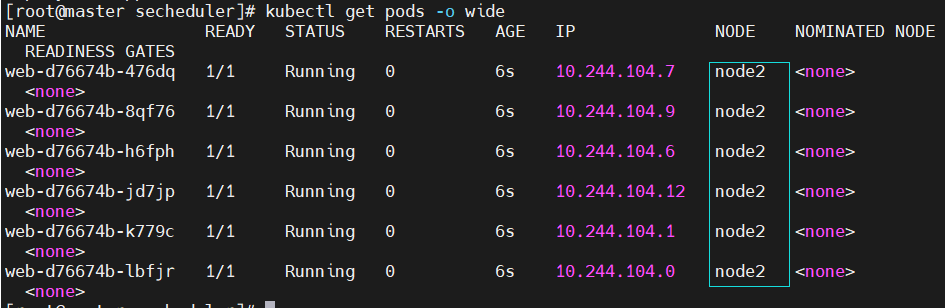

[root@master calico]# kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

web 1/1 Running 0 5s 10.244.169.129 k8s-node2 <none> <none>

[root@master calico]# curl 10.244.169.129

Hello MyApp | Version: v1 | <a href="hostname.html">Pod Name</a>

二 k8s调度(Scheduling)

2.1 调度在Kubernetes中的作用

- 调度是指将未调度的Pod自动分配到集群中的节点的过程

- 调度器通过 kubernetes 的 watch 机制来发现集群中新创建且尚未被调度到 Node 上的 Pod

- 调度器会将发现的每一个未调度的 Pod 调度到一个合适的 Node 上来运行

2.2 调度原理:

- 创建Pod

- 用户通过Kubernetes API创建Pod对象,并在其中指定Pod的资源需求、容器镜像等信息。

- 调度器监视Pod

- Kubernetes调度器监视集群中的未调度Pod对象,并为其选择最佳的节点。

- 选择节点

- 调度器通过算法选择最佳的节点,并将Pod绑定到该节点上。调度器选择节点的依据包括节点的资源使用情况、Pod的资源需求、亲和性和反亲和性等。

- 绑定Pod到节点

- 调度器将Pod和节点之间的绑定信息保存在etcd数据库中,以便节点可以获取Pod的调度信息。

- 节点启动Pod

- 节点定期检查etcd数据库中的Pod调度信息,并启动相应的Pod。如果节点故障或资源不足,调度器会重新调度Pod,并将其绑定到其他节点上运行。

2.3 调度器种类

- 默认调度器(Default Scheduler):

- 是Kubernetes中的默认调度器,负责对新创建的Pod进行调度,并将Pod调度到合适的节点上。

- 自定义调度器(Custom Scheduler):

- 是一种自定义的调度器实现,可以根据实际需求来定义调度策略和规则,以实现更灵活和多样化的调度功能。

- 扩展调度器(Extended Scheduler):

- 是一种支持调度器扩展器的调度器实现,可以通过调度器扩展器来添加自定义的调度规则和策略,以实现更灵活和多样化的调度功能。

- kube-scheduler是kubernetes中的默认调度器,在kubernetes运行后会自动在控制节点运行

2.4 常用调度方法

2.4.1 nodename

- nodeName 是节点选择约束的最简单方法,但一般不推荐

- 如果 nodeName 在 PodSpec 中指定了,则它优先于其他的节点选择方法

- 使用 nodeName 来选择节点的一些限制

- 如果指定的节点不存在。

- 如果指定的节点没有资源来容纳 pod,则pod 调度失败。

- 云环境中的节点名称并非总是可预测或稳定的

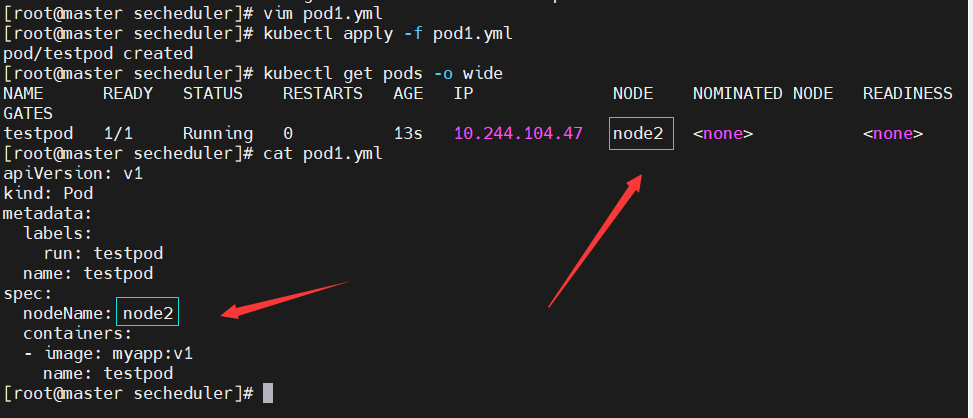

实例:

bash

#建立pod文件

[[root@master scheduler]# kubectl run testpod --image myapp:v1 --dry-run=client -o yaml > pod1.yml

#设置调度

[root@master scheduler]# vim pod1.yml

apiVersion: v1

kind: Pod

metadata:

labels:

run: testpod

name: testpod

spec:

nodeName: node2

containers:

- image: myapp:v1

name: testpod

#建立pod

[root@master scheduler]# kubectl apply -f pod1.yml

pod/testpod created

[root@master secheduler]# kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

testpod 1/1 Running 0 13s 10.244.104.47 node2 <none> <none>

!NOTE

nodeName: k8s3 #找不到节点pod会出现pending,优先级最高,其他调度方式无效

2.4.2 Nodeselector(通过标签控制节点)

-

nodeSelector 是节点选择约束的最简单推荐形式

-

给选择的节点添加标签:

kubectl label nodes k8s-node1 lab=lee -

可以给多个节点设定相同标签

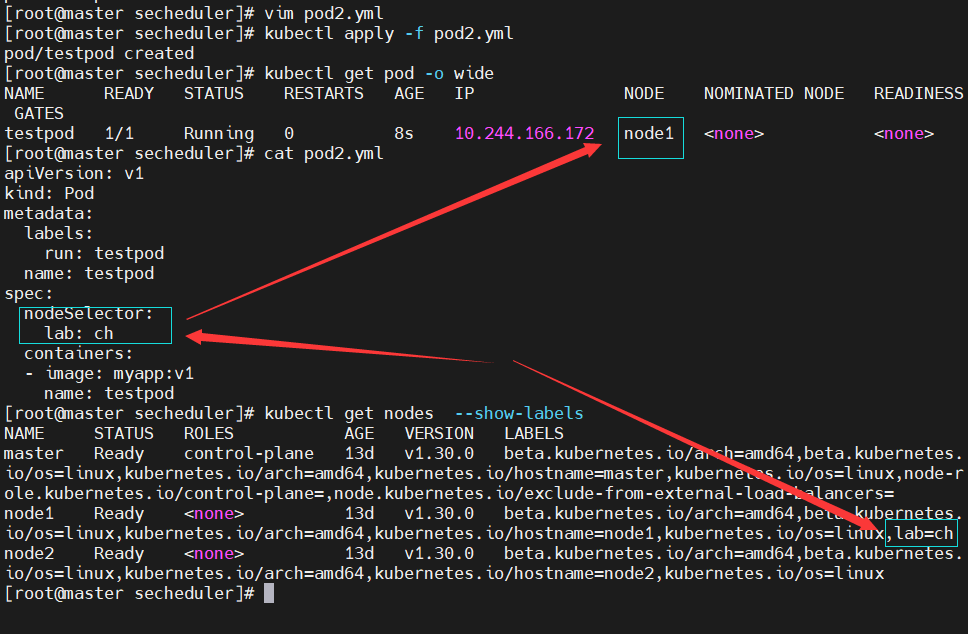

示例:

bash

#查看节点标签

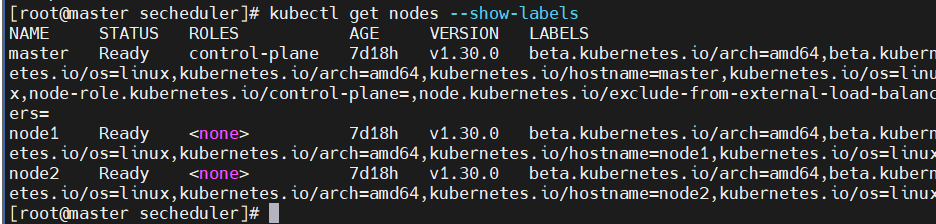

[root@master secheduler]# kubectl get no --show-labels

NAME STATUS ROLES AGE VERSION LABELS

master Ready control-plane 13d v1.30.0 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=master,kubernetes.io/os=linux,node-role.kubernetes.io/control-plane=,node.kubernetes.io/exclude-from-external-load-balancers=

node1 Ready <none> 13d v1.30.0 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=node1,kubernetes.io/os=linux

node2 Ready <none> 13d v1.30.0 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=node2,kubernetes.io/os=linux

#设定节点标签

[root@master scheduler]# kubectl label nodes node1 lab=ch

node/k8s-node1 labeled

[root@master secheduler]# kubectl get no node1 --show-labels

NAME STATUS ROLES AGE VERSION LABELS

node1 Ready <none> 13d v1.30.0 beta.kubernetes.io/arch=amd64,beta.kubernetes.io/os=linux,kubernetes.io/arch=amd64,kubernetes.io/hostname=node1,kubernetes.io/os=linux,lab=ch

#调度设置

[root@master scheduler]# vim pod2.yml

apiVersion: v1

kind: Pod

metadata:

labels:

run: testpod

name: testpod

spec:

nodeSelector:

lab: ch

containers:

- image: myapp:v1

name: testpod

[root@master scheduler]# kubectl apply -f pod2.yml

pod/testpod created

[root@master secheduler]# kubectl get pod -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

testpod 1/1 Running 0 8s 10.244.166.172 node1 <none> <none>!NOTE

节点标签可以给N个节点加

bash

#对于标签的管理

#查看标签

[root@master secheduler]# kubectl get nodes --show-labels

#添加标签lab='1'

[root@master secheduler]# kubectl label nodes node1 lab='1'

node/node1 labeled

#修改标签为lab='2'

[root@master secheduler]# kubectl label nodes node1 lab='2' --overwrite

node/node1 labeled

#删除标签lab='2'

[root@master secheduler]# kubectl label nodes node1 lab-

node/node1 unlabeled

2.5 affinity(亲和性)

官方文档 :

https://kubernetes.io/zh/docs/concepts/scheduling-eviction/assign-pod-node

2.5.1 亲和与反亲和

- nodeSelector 提供了一种非常简单的方法来将 pod 约束到具有特定标签的节点上。亲和/反亲和功能极大地扩展了你可以表达约束的类型。

- 使用节点上的 pod 的标签来约束,而不是使用节点本身的标签,来允许哪些 pod 可以或者不可以被放置在一起。

2.5.2 nodeAffinity节点亲和

- 那个节点服务指定条件就在那个节点运行

- requiredDuringSchedulingIgnoredDuringExecution 必须满足,但不会影响已经调度

- preferredDuringSchedulingIgnoredDuringExecution 倾向满足,在无法满足情况下也会调度pod

- IgnoreDuringExecution 表示如果在Pod运行期间Node的标签发生变化,导致亲和性策略不能满足,则继续运行当前的Pod。

- nodeaffinity还支持多种规则匹配条件的配置如

| 匹配规则 | 功能 |

|---|---|

| ln | label 的值在列表内 |

| Notln | label 的值不在列表内 |

| Gt | label 的值大于设置的值,不支持Pod亲和性 |

| Lt | label 的值小于设置的值,不支持pod亲和性 |

| Exists | 设置的label 存在 |

| DoesNotExist | 设置的 label 不存在 |

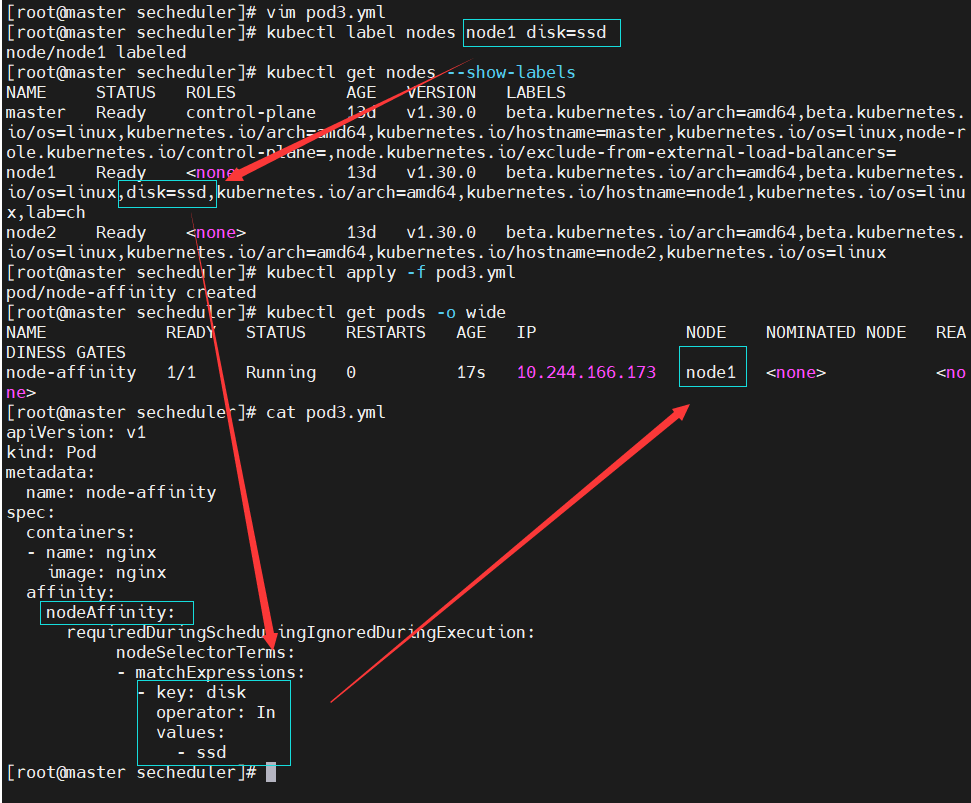

nodeAffinity示例

bash

#示例1

[root@master scheduler]# vim pod3.yml

apiVersion: v1

kind: Pod

metadata:

name: node-affinity

spec:

containers:

- name: nginx

image: nginx

affinity:

nodeAffinity:

requiredDuringSchedulingIgnoredDuringExecution:

nodeSelectorTerms:

- matchExpressions:

- key: disk

operator: In | NotIn #两个结果相反

values:

- ssd

2.5.3 Podaffinity(pod的亲和)

- 那个节点有符合条件的POD就在那个节点运行

- podAffinity 主要解决POD可以和哪些POD部署在同一个节点中的问题

- podAntiAffinity主要解决POD不能和哪些POD部署在同一个节点中的问题。它们处理的是Kubernetes集群内部POD和POD之间的关系。

- Pod 间亲和与反亲和在与更高级别的集合(例如 ReplicaSets,StatefulSets,Deployments 等)一起使用时,

- Pod 间亲和与反亲和需要大量的处理,这可能会显著减慢大规模集群中的调度。

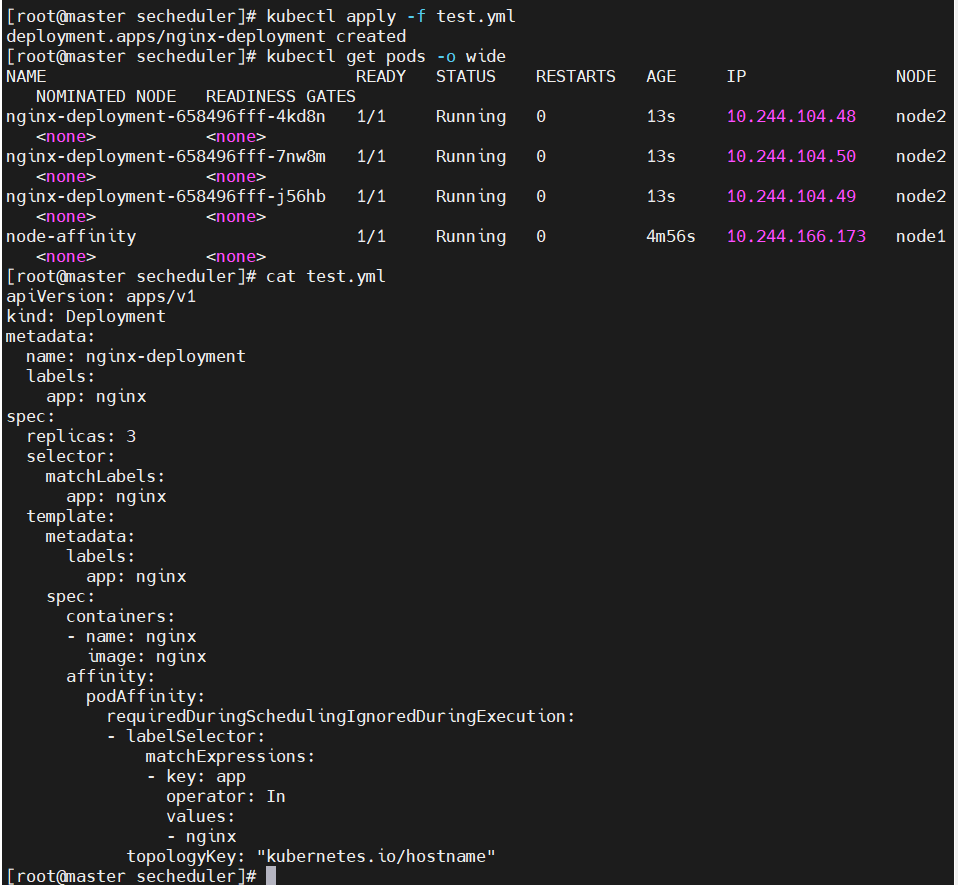

Podaffinity示例

bash

[root@master scheduler]# vim example4.yml

apiVersion: apps/v1

kind: Deployment

metadata:

name: nginx-deployment

labels:

app: nginx

spec:

replicas: 3

selector:

matchLabels:

app: nginx

template:

metadata:

labels:

app: nginx

spec:

containers:

- name: nginx

image: nginx

affinity:

podAffinity: # Pod亲和性:让当前Pod倾向于和某些特定Pod调度到一起

requiredDuringSchedulingIgnoredDuringExecution: # 调度时必须满足的规则(硬亲和性)

- labelSelector: # 匹配目标Pod的标签选择器

matchExpressions:

- key: app # 匹配标签的key为"app"

operator: In # 匹配规则:标签value在指定列表中

values:

- nginx # 标签value为"nginx"

topologyKey: "kubernetes.io/hostname" # 拓扑域:以"节点"为单位(同一主机视为一个拓扑域)

[root@master secheduler]# kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

nginx-deployment-658496fff-4kd8n 1/1 Running 0 13s 10.244.104.48 node2 <none> <none>

nginx-deployment-658496fff-7nw8m 1/1 Running 0 13s 10.244.104.50 node2 <none> <none>

nginx-deployment-658496fff-j56hb 1/1 Running 0 13s 10.244.104.49 node2 <none> <none>

node-affinity 1/1 Running 0 4m56s 10.244.166.173 node1 <none> <none>

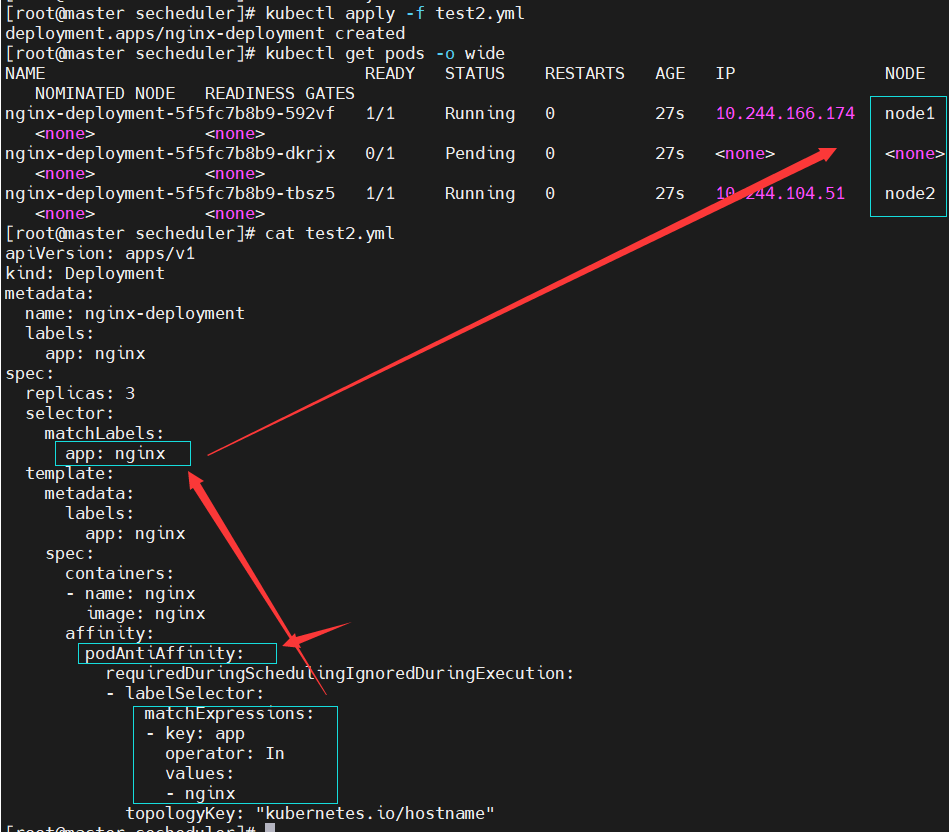

2.5.4 Podantiaffinity(pod反亲和)

Podantiaffinity示例

bash

[root@master secheduler]# vim test2.yml

apiVersion: apps/v1

kind: Deployment

metadata:

name: nginx-deployment

labels:

app: nginx

spec:

replicas: 3

selector:

matchLabels:

app: nginx

template:

metadata:

labels:

app: nginx

spec:

containers:

- name: nginx

image: nginx

affinity:

podAntiAffinity: #反亲和

requiredDuringSchedulingIgnoredDuringExecution:

- labelSelector:

matchExpressions:

- key: app

operator: In

values:

- nginx

topologyKey: "kubernetes.io/hostname"

[root@master secheduler]# kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

nginx-deployment-5f5fc7b8b9-592vf 1/1 Running 0 27s 10.244.166.174 node1 <none> <none>

nginx-deployment-5f5fc7b8b9-dkrjx 0/1 Pending 0 27s <none> <none> <none> <none>

nginx-deployment-5f5fc7b8b9-tbsz5 1/1 Running 0 27s 10.244.104.51 node2 <none> <none>

2.6 Taints(污点模式,禁止调度)

-

Taints(污点)是Node的一个属性,设置了Taints后,默认Kubernetes是不会将Pod调度到这个Node上

-

Kubernetes如果为Pod设置Tolerations(容忍),只要Pod能够容忍Node上的污点,那么Kubernetes就会忽略Node上的污点,就能够(不是必须)把Pod调度过去

-

可以使用命令 kubectl taint 给节点增加一个 taint:

kubectl taint nodes

key=string:effect #命令执行方法 kubectl taint nodes node1 key=value:NoSchedule #创建

kubectl describe nodes server1 | grep Taints #查询 kubectl taint nodes node1 key- #删除

其中[effect] 可取值:

| effect值 | 解释 |

|---|---|

| NoSchedule | POD 不会被调度到标记为 taints 节点 |

| PreferNoSchedule | NoSchedule 的软策略版本,尽量不调度到此节点 |

| NoExecute | 如该节点内正在运行的 POD 没有对应 Tolerate 设置,会直接被逐出 |

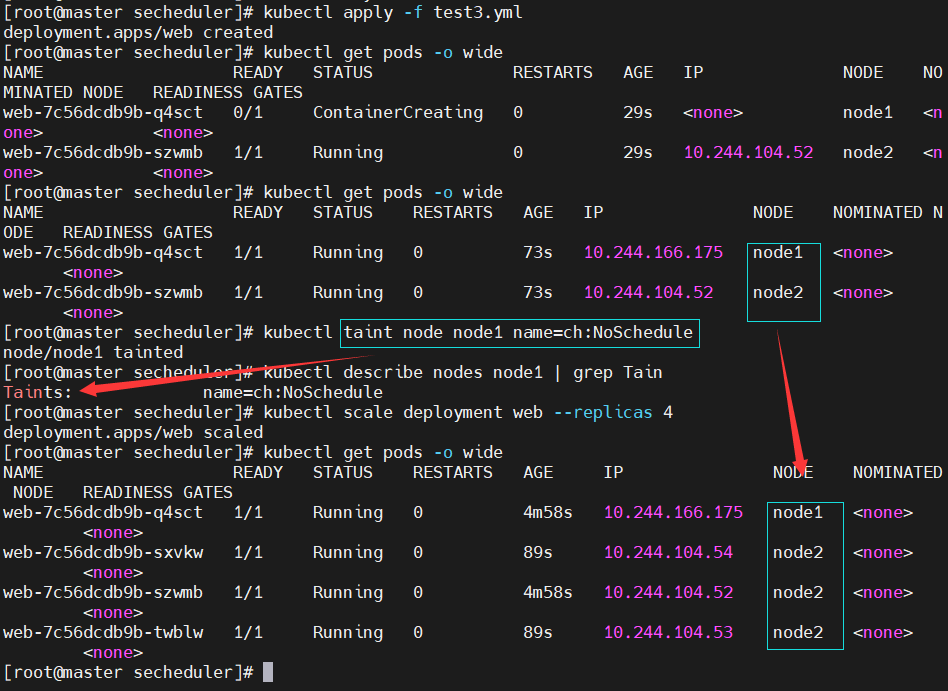

Taints示例

bash

#建立控制器并运行

[root@master secheduler]# vim test3.yml

apiVersion: apps/v1

kind: Deployment

metadata:

labels:

app: web

name: web

spec:

replicas: 2

selector:

matchLabels:

app: web

template:

metadata:

labels:

app: web

spec:

containers:

- image: nginx

name: nginx

[root@master scheduler]# kubectl apply -f test3.yml

deployment.apps/web created

[root@master secheduler]# kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

web-7c56dcdb9b-q4sct 1/1 Running 0 73s 10.244.166.175 node1 <none> <none>

web-7c56dcdb9b-szwmb 1/1 Running 0 73s 10.244.104.52 node2 <none> <none>

#设定污点为NoSchedule

[root@master secheduler]# kubectl taint node node1 name=ch:NoSchedule

node/node1 tainted

[root@master secheduler]# kubectl describe nodes node1 | grep Tain

Taints: name=ch:NoSchedule

#控制器增加pod

[root@master secheduler]# kubectl scale deployment web --replicas 4

deployment.apps/web scaled

#查看

[root@master secheduler]# kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

web-7c56dcdb9b-q4sct 1/1 Running 0 4m58s 10.244.166.175 node1 <none> <none>

web-7c56dcdb9b-sxvkw 1/1 Running 0 89s 10.244.104.54 node2 <none> <none>

web-7c56dcdb9b-szwmb 1/1 Running 0 4m58s 10.244.104.52 node2 <none> <none>

web-7c56dcdb9b-twblw 1/1 Running 0 89s 10.244.104.53 node2 <none> <none>

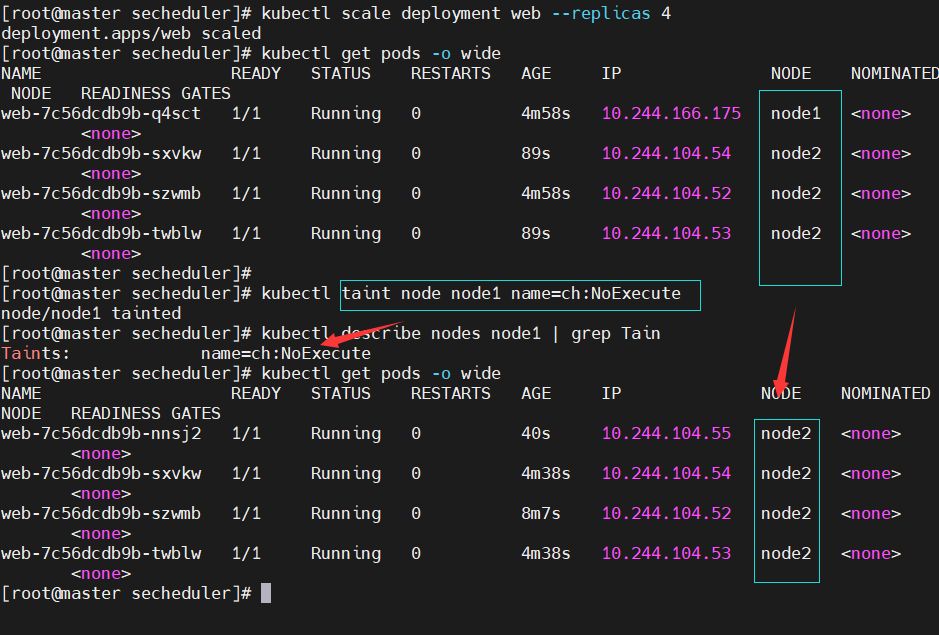

bash

#设定污点为NoExecute

[root@master scheduler]# kubectl taint node node1 name=ch:NoExecute

node/node1 tainted

[root@master secheduler]# kubectl describe nodes node1 | grep Tain

Taints: name=ch:NoExecute

[root@master secheduler]# kubectl get pods -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

web-7c56dcdb9b-nnsj2 1/1 Running 0 40s 10.244.104.55 node2 <none> <none>

web-7c56dcdb9b-sxvkw 1/1 Running 0 4m38s 10.244.104.54 node2 <none> <none>

web-7c56dcdb9b-szwmb 1/1 Running 0 8m7s 10.244.104.52 node2 <none> <none>

web-7c56dcdb9b-twblw 1/1 Running 0 4m38s 10.244.104.53 node2 <none> <none>

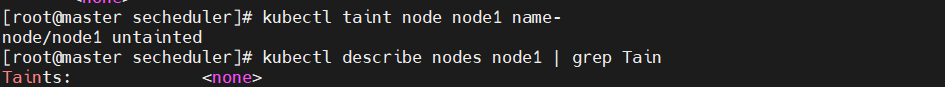

#删除污点

[root@master secheduler]# kubectl taint node node1 name-

node/node1 untainted

[root@master secheduler]# kubectl describe nodes node1 | grep Tain

Taints: <none>

tolerations(污点容忍)

- tolerations中定义的key、value、effect,要与node上设置的taint保持一直:

- 如果 operator 是 Equal ,则key与value之间的关系必须相等。

- 如果 operator 是 Exists ,value可以省略

- 如果不指定operator属性,则默认值为Equal。

- 还有两个特殊值:

- 当不指定key,再配合Exists 就能匹配所有的key与value ,可以容忍所有污点。

- 当不指定effect ,则匹配所有的effect

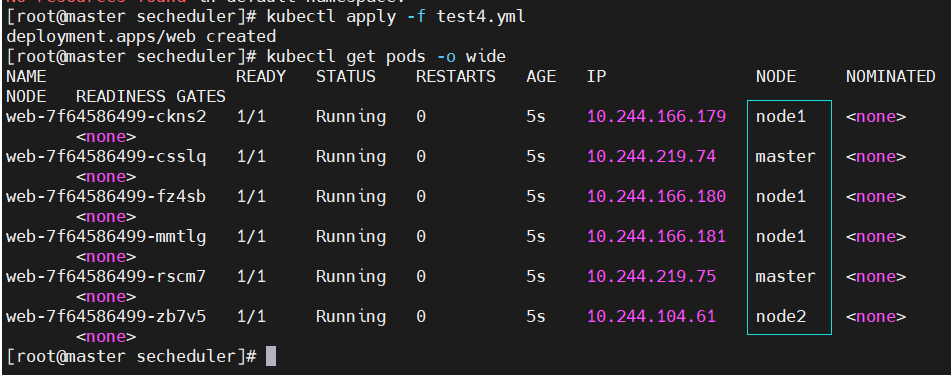

污点容忍示例:

bash

#设定节点污点

[root@master scheduler]# kubectl taint node node1 name=ch:NoExecute

node/node1 tainted

[root@master scheduler]# kubectl taint node node2 nodetype=bad:NoSchedule

node/node2 tainted

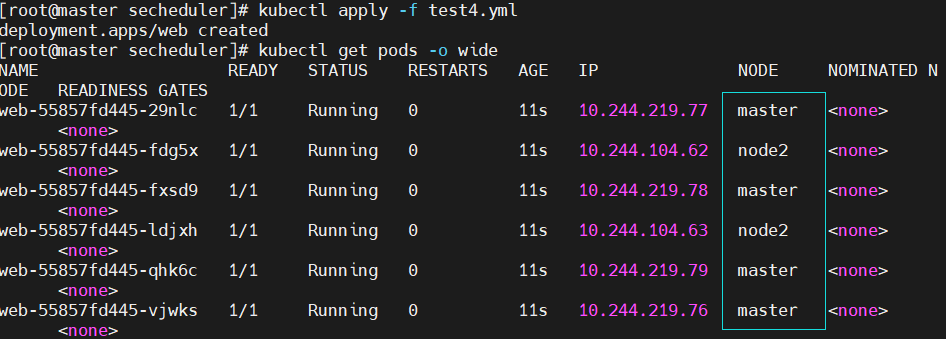

[root@master scheduler]# vim test4.yml

apiVersion: apps/v1

kind: Deployment

metadata:

labels:

app: web

name: web

spec:

replicas: 6

selector:

matchLabels:

app: web

template:

metadata:

labels:

app: web

spec:

containers:

- image: nginx

name: nginx

tolerations: #容忍所有污点

- operator: Exists

tolerations: #容忍effect为Noschedule的污点

- operator: Exists

effect: NoSchedule

tolerations: #容忍指定kv的NoSchedule污点

- key: nodetype

value: bad

effect: NoSchedule!NOTE

三种容忍方式每次测试写一个即可

容忍所有污点

bash

tolerations:

- operator: Exists

容忍effect为Noschedule的污点

bash

tolerations:

- operator: Exists

effect: NoSchedule

容忍指定key-value的NoSchedule污点

bash

tolerations:

- key: nodetype

value: bad

effect: NoSchedule