背景意义

研究背景与意义

随着城市化进程的加快,建筑结构的安全性和耐久性日益受到关注。建筑物在使用过程中,由于环境因素、材料老化及人为因素等,可能会出现各种损伤,如腐蚀、裂缝和剥落等。这些损伤不仅影响建筑物的美观,更可能对其结构安全造成严重威胁。因此,及时、准确地检测和评估建筑结构的损伤状况,对于保障公共安全、延长建筑物的使用寿命具有重要意义。

传统的建筑结构损伤检测方法多依赖人工检查,这种方法不仅耗时耗力,而且容易受到主观因素的影响,导致漏检或误判。近年来,随着计算机视觉技术的迅猛发展,基于深度学习的自动化检测方法逐渐成为研究热点。YOLO(You Only Look Once)系列模型因其高效的实时检测能力,广泛应用于目标检测领域。特别是YOLOv11的出现,进一步提升了检测精度和速度,为建筑结构损伤检测提供了新的技术手段。

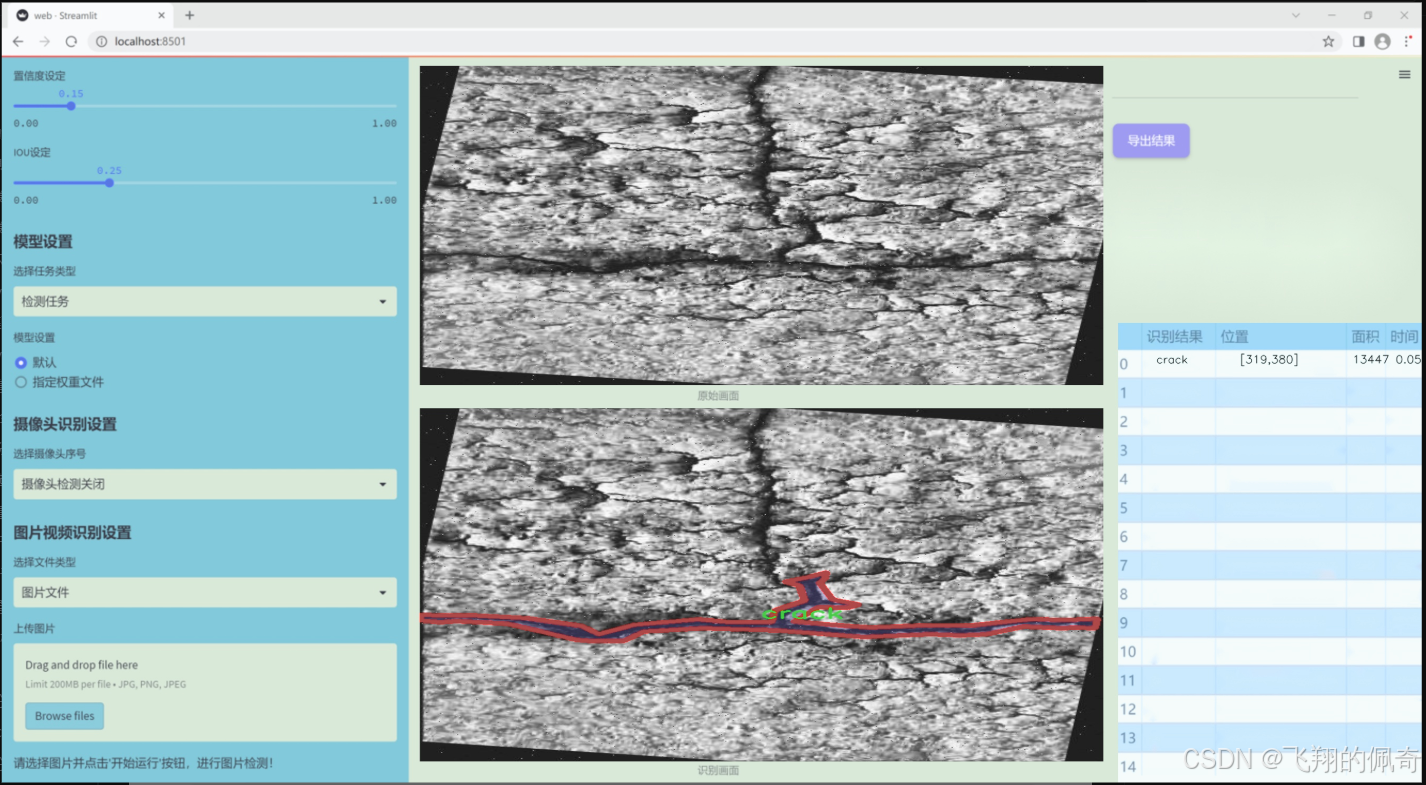

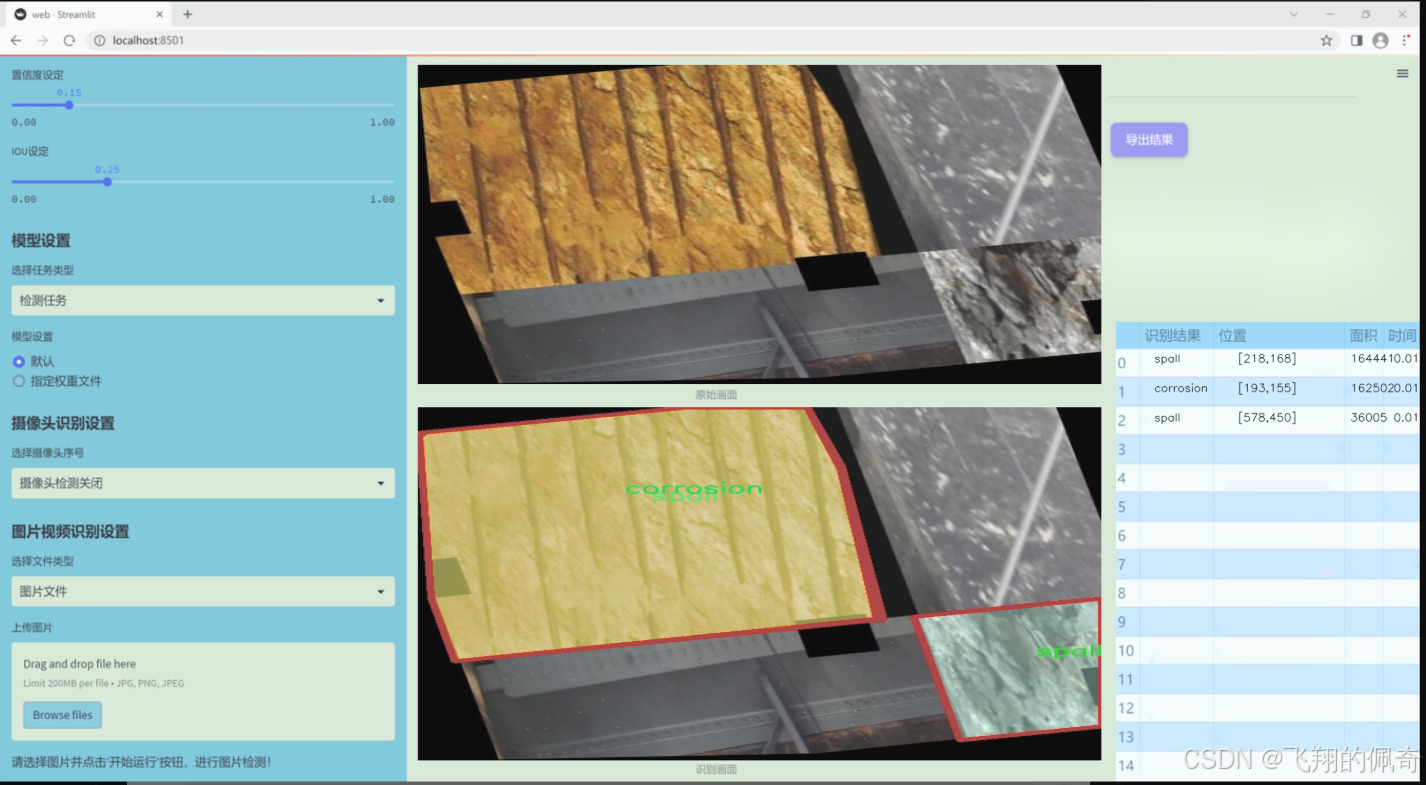

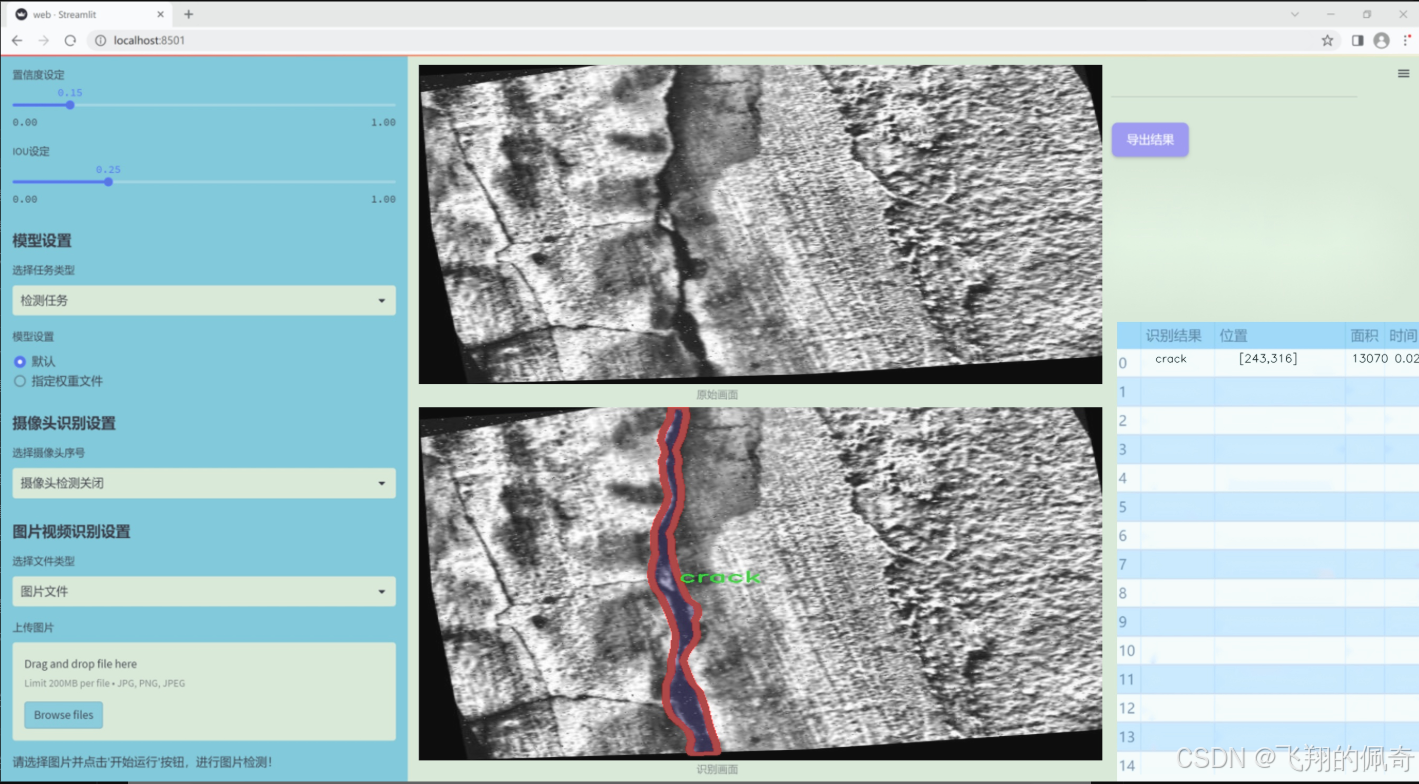

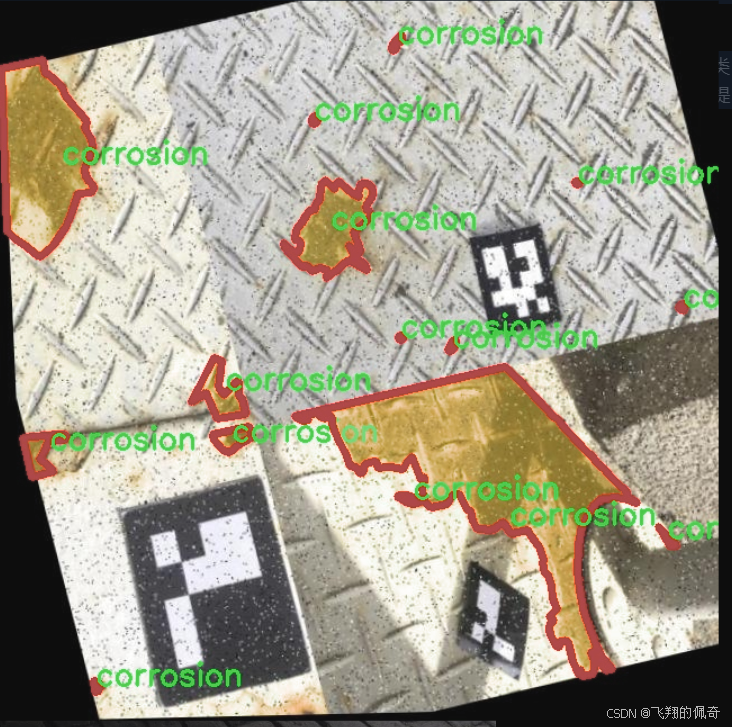

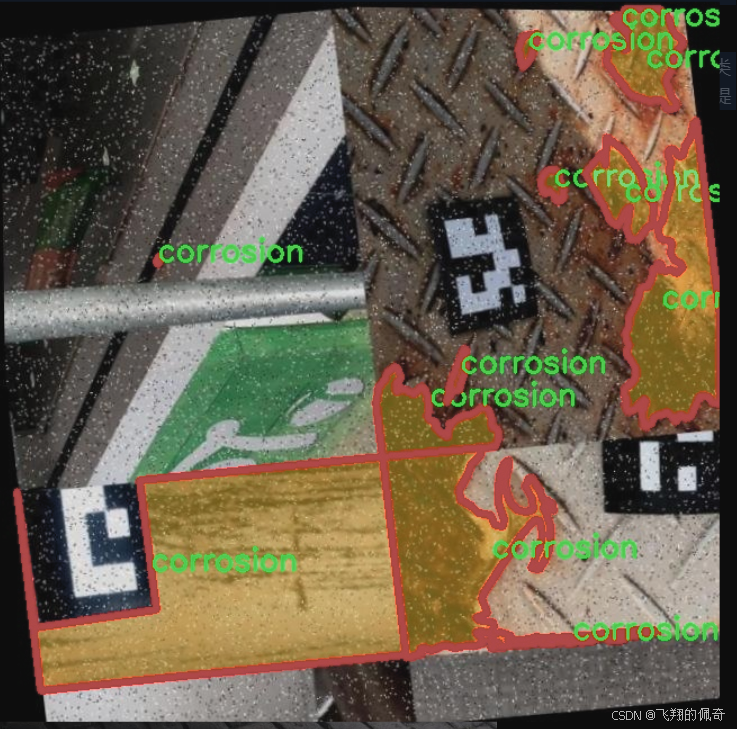

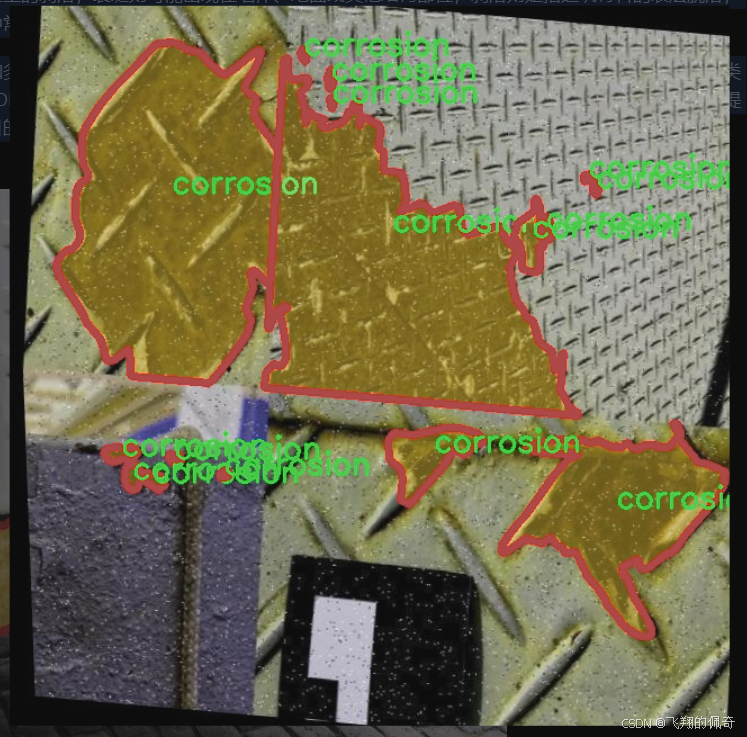

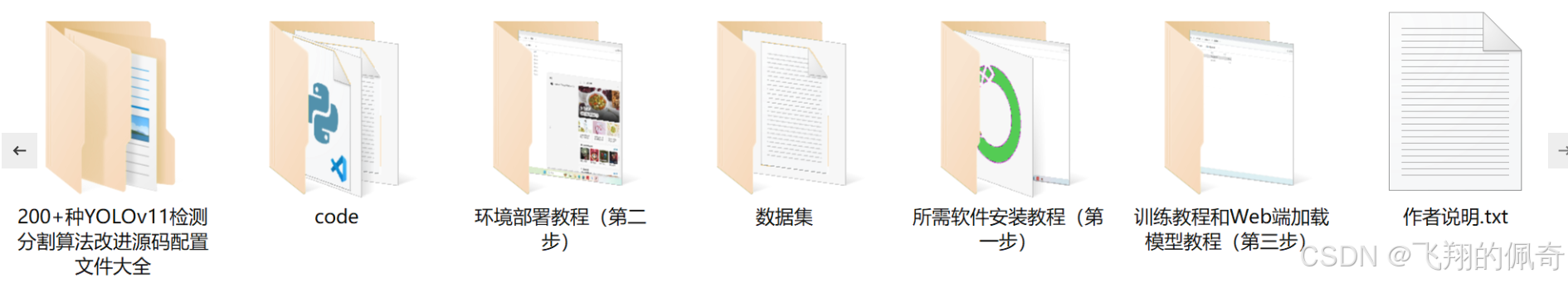

本研究旨在基于改进的YOLOv11模型,构建一个高效的建筑结构损伤检测系统。我们将利用一个包含1800张图像的损伤数据集,该数据集涵盖了腐蚀、裂缝和剥落三种主要损伤类型。通过对数据集的深入分析和模型的优化,我们期望能够提高损伤检测的准确性和效率。此外,借助实例分割技术,我们将实现对损伤区域的精确定位,为后续的结构评估和修复提供数据支持。

综上所述,本研究不仅具有重要的理论意义,也为实际工程应用提供了可行的解决方案,推动了建筑结构健康监测技术的发展。通过实现智能化的损伤检测系统,我们希望能够为建筑行业的安全管理提供更为可靠的技术保障。

图片效果

数据集信息

本项目数据集信息介绍

本项目所使用的数据集专注于建筑结构损伤的检测,旨在改进YOLOv11模型的性能,以实现更高效、准确的损伤识别。数据集的主题围绕"Damages",涵盖了建筑物在使用过程中可能出现的三种主要损伤类型,分别为腐蚀(corrosion)、裂缝(crack)和剥落(spall)。这些损伤不仅影响建筑物的美观,更重要的是直接关系到其安全性和使用寿命,因此,及时、准确地检测和评估这些损伤至关重要。

在数据集的构建过程中,我们收集了大量的高质量图像,这些图像来自于不同类型的建筑结构,包括住宅、商业建筑及基础设施等。每一类损伤都经过精心标注,以确保模型在训练过程中能够学习到不同损伤特征的细微差别。腐蚀损伤通常表现为金属表面的锈蚀或混凝土的剥落,裂缝则可能出现在墙体、地面或其他结构部位,剥落则是指建筑材料的表层脱落,这些损伤类型在实际应用中常常相互交织,给检测带来了挑战。

数据集中包含的图像数量和多样性使得模型能够在各种环境和条件下进行训练,从而提高其泛化能力。通过对这些损伤类型的深入学习,改进后的YOLOv11模型将能够更快速、更准确地识别建筑结构中的潜在问题,进而为后续的维护和修复提供科学依据。总之,本项目的数据集不仅为建筑结构损伤检测提供了坚实的基础,也为未来的研究和应用开辟了新的方向。

核心代码

以下是保留的核心代码部分,并添加了详细的中文注释:

import torch

import torch.nn as nn

定义 MobileNetV4 的不同模型规格

MODEL_SPECS = {

"MobileNetV4ConvSmall": MNV4ConvSmall_BLOCK_SPECS,

"MobileNetV4ConvMedium": MNV4ConvMedium_BLOCK_SPECS,

"MobileNetV4ConvLarge": MNV4ConvLarge_BLOCK_SPECS,

"MobileNetV4HybridMedium": MNV4HybridConvMedium_BLOCK_SPECS,

"MobileNetV4HybridLarge": MNV4HybridConvLarge_BLOCK_SPECS,

}

def conv_2d(inp, oup, kernel_size=3, stride=1, groups=1, bias=False, norm=True, act=True):

"""

创建一个2D卷积层,包含卷积、批归一化和激活函数(ReLU6)。

Args:

inp: 输入通道数

oup: 输出通道数

kernel_size: 卷积核大小

stride: 步幅

groups: 分组卷积的组数

bias: 是否使用偏置

norm: 是否使用批归一化

act: 是否使用激活函数

Returns:

nn.Sequential: 包含卷积层、批归一化和激活函数的序列

"""

conv = nn.Sequential()

padding = (kernel_size - 1) // 2 # 计算填充

conv.add_module('conv', nn.Conv2d(inp, oup, kernel_size, stride, padding, bias=bias, groups=groups))

if norm:

conv.add_module('BatchNorm2d', nn.BatchNorm2d(oup)) # 添加批归一化

if act:

conv.add_module('Activation', nn.ReLU6()) # 添加激活函数

return convclass InvertedResidual(nn.Module):

"""

反向残差块,用于 MobileNetV4 的构建。

"""

def init (self, inp, oup, stride, expand_ratio, act=False):

super(InvertedResidual, self).init ()

self.stride = stride

assert stride in 1, 2 # 步幅只能是1或2

hidden_dim = int(round(inp * expand_ratio)) # 计算隐藏层维度

self.block = nn.Sequential()

if expand_ratio != 1:

self.block.add_module('exp_1x1', conv_2d(inp, hidden_dim, kernel_size=1, stride=1)) # 扩展卷积

self.block.add_module('conv_3x3', conv_2d(hidden_dim, hidden_dim, kernel_size=3, stride=stride, groups=hidden_dim)) # 深度卷积

self.block.add_module('red_1x1', conv_2d(hidden_dim, oup, kernel_size=1, stride=1, act=act)) # 投影卷积

self.use_res_connect = self.stride == 1 and inp == oup # 判断是否使用残差连接

def forward(self, x):

if self.use_res_connect:

return x + self.block(x) # 使用残差连接

else:

return self.block(x)class MobileNetV4(nn.Module):

"""

MobileNetV4 模型的主类。

"""

def init (self, model):

super().init ()

assert model in MODEL_SPECS.keys() # 确保模型在支持的规格中

self.model = model

self.spec = MODEL_SPECSself.model

# 根据模型规格构建各个层

self.conv0 = build_blocks(self.spec['conv0'])

self.layer1 = build_blocks(self.spec['layer1'])

self.layer2 = build_blocks(self.spec['layer2'])

self.layer3 = build_blocks(self.spec['layer3'])

self.layer4 = build_blocks(self.spec['layer4'])

self.layer5 = build_blocks(self.spec['layer5'])

self.features = nn.ModuleList([self.conv0, self.layer1, self.layer2, self.layer3, self.layer4, self.layer5])

def forward(self, x):

"""

前向传播,返回特征图。

Args:

x: 输入张量

Returns:

features: 特征图列表

"""

input_size = x.size(2)

scale = [4, 8, 16, 32] # 特征图的缩放比例

features = [None, None, None, None]

for f in self.features:

x = f(x) # 通过每一层

if input_size // x.size(2) in scale:

features[scale.index(input_size // x.size(2))] = x # 保存特征图

return features创建不同规格的 MobileNetV4 模型的函数

def MobileNetV4ConvSmall():

return MobileNetV4('MobileNetV4ConvSmall')

def MobileNetV4ConvMedium():

return MobileNetV4('MobileNetV4ConvMedium')

def MobileNetV4ConvLarge():

return MobileNetV4('MobileNetV4ConvLarge')

def MobileNetV4HybridMedium():

return MobileNetV4('MobileNetV4HybridMedium')

def MobileNetV4HybridLarge():

return MobileNetV4('MobileNetV4HybridLarge')

if name == 'main ':

model = MobileNetV4ConvSmall() # 创建 MobileNetV4ConvSmall 模型

inputs = torch.randn((1, 3, 640, 640)) # 随机输入

res = model(inputs) # 前向传播

for i in res:

print(i.size()) # 打印输出特征图的尺寸

代码核心部分说明:

模型规格定义:通过 MODEL_SPECS 字典定义不同 MobileNetV4 模型的规格。

卷积层构建:conv_2d 函数用于创建包含卷积、批归一化和激活函数的层。

反向残差块:InvertedResidual 类实现了 MobileNetV4 中的反向残差块。

MobileNetV4 主类:MobileNetV4 类构建整个模型,包含多个层,并实现前向传播。

模型实例化:提供了多个函数以便创建不同规格的 MobileNetV4 模型。

这个程序文件实现了MobileNetV4模型的结构,主要用于计算机视觉任务中的图像分类和特征提取。文件中定义了不同规模的MobileNetV4模型,包括小型、中型和大型版本,以及混合型版本。程序首先导入了必要的库,包括PyTorch和其神经网络模块。

文件中定义了多个字典,这些字典描述了不同模型的层结构和参数配置。例如,MNV4ConvSmall_BLOCK_SPECS字典定义了MobileNetV4小型模型的各个层的具体配置,包括卷积层的数量、输入输出通道数、卷积核大小和步幅等。这些字典为后续构建模型提供了详细的参数。

接下来,定义了一个make_divisible函数,用于确保每一层的通道数都是8的倍数,以满足模型的设计要求。这个函数接受原始值、除数、最小值和一个布尔值参数,返回调整后的整数值。

conv_2d函数用于构建一个2D卷积层,包含卷积操作、批归一化和激活函数(ReLU6)。InvertedResidual类实现了反向残差块的结构,包含了扩展卷积、深度卷积和投影卷积,支持残差连接。UniversalInvertedBottleneckBlock类则实现了通用的反向瓶颈块,支持不同的卷积核配置。

build_blocks函数根据层的规格构建相应的层,支持三种类型的块:convbn、uib和fused_ib。MobileNetV4类是模型的主类,它根据指定的模型类型构建整个网络结构,包括各个层的组合。

在MobileNetV4类的构造函数中,首先验证模型类型是否有效,然后根据模型规格构建各个层,并将它们存储在一个模块列表中。forward方法定义了前向传播的过程,输入图像经过各个层后,返回特定尺度的特征图。

最后,程序提供了五个函数,用于实例化不同类型的MobileNetV4模型。if name == 'main':部分用于测试模型,生成随机输入并打印输出特征图的尺寸,以验证模型的构建是否正确。

整体而言,这个程序文件通过模块化的设计和清晰的结构,方便用户根据需求构建和使用不同版本的MobileNetV4模型。

10.4 attention.py

以下是保留的核心代码部分,并附上详细的中文注释:

import torch

from torch import nn

class EMA(nn.Module):

"""

Exponential Moving Average (EMA) 模块

该模块用于计算输入特征图的加权平均,主要用于增强特征表示。

"""

def init (self, channels, factor=8):

super(EMA, self).init ()

self.groups = factor # 将通道分为多个组

assert channels // self.groups > 0 # 确保每组至少有一个通道

self.softmax = nn.Softmax(-1) # 用于计算权重的softmax

self.agp = nn.AdaptiveAvgPool2d((1, 1)) # 自适应平均池化

self.pool_h = nn.AdaptiveAvgPool2d((None, 1)) # 对高度进行池化

self.pool_w = nn.AdaptiveAvgPool2d((1, None)) # 对宽度进行池化

self.gn = nn.GroupNorm(channels // self.groups, channels // self.groups) # 组归一化

self.conv1x1 = nn.Conv2d(channels // self.groups, channels // self.groups, kernel_size=1) # 1x1卷积

self.conv3x3 = nn.Conv2d(channels // self.groups, channels // self.groups, kernel_size=3, padding=1) # 3x3卷积

def forward(self, x):

b, c, h, w = x.size() # 获取输入的batch size, 通道数, 高度, 宽度

group_x = x.reshape(b * self.groups, -1, h, w) # 将输入重塑为分组形式

x_h = self.pool_h(group_x) # 对每组进行高度池化

x_w = self.pool_w(group_x).permute(0, 1, 3, 2) # 对每组进行宽度池化并转置

hw = self.conv1x1(torch.cat([x_h, x_w], dim=2)) # 将高度和宽度特征拼接后通过1x1卷积

x_h, x_w = torch.split(hw, [h, w], dim=2) # 将结果分为高度和宽度特征

x1 = self.gn(group_x * x_h.sigmoid() * x_w.permute(0, 1, 3, 2).sigmoid()) # 通过sigmoid激活函数和组归一化

x2 = self.conv3x3(group_x) # 通过3x3卷积处理原始特征

x11 = self.softmax(self.agp(x1).reshape(b * self.groups, -1, 1).permute(0, 2, 1)) # 计算x1的权重

x12 = x2.reshape(b * self.groups, c // self.groups, -1) # 重塑x2

x21 = self.softmax(self.agp(x2).reshape(b * self.groups, -1, 1).permute(0, 2, 1)) # 计算x2的权重

x22 = x1.reshape(b * self.groups, c // self.groups, -1) # 重塑x1

weights = (torch.matmul(x11, x12) + torch.matmul(x21, x22)).reshape(b * self.groups, 1, h, w) # 计算最终权重

return (group_x * weights.sigmoid()).reshape(b, c, h, w) # 返回加权后的特征图class SimAM(nn.Module):

"""

SimAM (Similarity Attention Module) 模块

该模块通过计算特征图的相似性来增强特征表示。

"""

def init (self, e_lambda=1e-4):

super(SimAM, self).init ()

self.activaton = nn.Sigmoid() # Sigmoid激活函数

self.e_lambda = e_lambda # 正则化参数

def forward(self, x):

b, c, h, w = x.size() # 获取输入的batch size, 通道数, 高度, 宽度

n = w * h - 1 # 计算特征图的总元素数

x_minus_mu_square = (x - x.mean(dim=[2, 3], keepdim=True)).pow(2) # 计算每个元素与均值的平方差

y = x_minus_mu_square / (4 * (x_minus_mu_square.sum(dim=[2, 3], keepdim=True) / n + self.e_lambda)) + 0.5 # 计算相似性

return x * self.activaton(y) # 返回加权后的特征图class SpatialGroupEnhance(nn.Module):

"""

Spatial Group Enhance 模块

该模块通过对空间特征进行增强来提高特征表示能力。

"""

def init (self, groups=8):

super().init ()

self.groups = groups # 组数

self.avg_pool = nn.AdaptiveAvgPool2d(1) # 自适应平均池化

self.weight = nn.Parameter(torch.zeros(1, groups, 1, 1)) # 权重参数

self.bias = nn.Parameter(torch.zeros(1, groups, 1, 1)) # 偏置参数

self.sig = nn.Sigmoid() # Sigmoid激活函数

self.init_weights() # 初始化权重

def init_weights(self):

for m in self.modules():

if isinstance(m, nn.Conv2d):

nn.init.kaiming_normal_(m.weight, mode='fan_out') # Kaiming初始化

if m.bias is not None:

nn.init.constant_(m.bias, 0) # 偏置初始化为0

elif isinstance(m, nn.BatchNorm2d):

nn.init.constant_(m.weight, 1) # 批归一化权重初始化为1

nn.init.constant_(m.bias, 0) # 偏置初始化为0

elif isinstance(m, nn.Linear):

nn.init.normal_(m.weight, std=0.001) # 线性层权重初始化

if m.bias is not None:

nn.init.constant_(m.bias, 0) # 偏置初始化为0

def forward(self, x):

b, c, h, w = x.shape # 获取输入的batch size, 通道数, 高度, 宽度

x = x.view(b * self.groups, -1, h, w) # 将输入重塑为分组形式

xn = x * self.avg_pool(x) # 计算每组的平均值

xn = xn.sum(dim=1, keepdim=True) # 对每组求和

t = xn.view(b * self.groups, -1) # 重塑

t = t - t.mean(dim=1, keepdim=True) # 减去均值

std = t.std(dim=1, keepdim=True) + 1e-5 # 计算标准差

t = t / std # 归一化

t = t.view(b, self.groups, h, w) # 重塑

t = t * self.weight + self.bias # 加权和偏置

t = t.view(b * self.groups, 1, h, w) # 重塑

x = x * self.sig(t) # 通过sigmoid激活进行加权

x = x.view(b, c, h, w) # 返回原始形状

return x以上代码是对输入特征图进行增强的核心模块,包括了EMA、SimAM和SpatialGroupEnhance模块。每个模块都通过不同的方式增强特征表示能力,以提高模型的性能。

这个程序文件 attention.py 实现了一系列用于深度学习中注意力机制的模块,主要是基于 PyTorch 框架。以下是对文件中各个部分的详细说明。

首先,文件导入了必要的库,包括 PyTorch 的核心模块 torch 和 torch.nn,以及一些用于高效计算的库,如 torchvision 和 efficientnet_pytorch。同时,还导入了一些工具函数和自定义模块,如 Conv 和 autopad。

文件的主要内容是定义了一系列注意力机制的类,这些类可以被用在各种深度学习模型中,尤其是在计算机视觉任务中。以下是一些关键类的介绍:

EMA (Exponential Moving Average):该类实现了一种基于通道的加权平均机制,利用了自适应平均池化和卷积操作来计算加权特征。

SimAM (Similarity Attention Module):这是一个基于相似度的注意力模块,通过计算输入特征的均值和方差来生成注意力权重。

SpatialGroupEnhance:该模块通过对输入特征进行分组处理和加权来增强空间特征,使用了自适应平均池化和卷积操作。

TopkRouting:实现了一种可微分的 Top-k 路由机制,用于选择最重要的特征。

KVGather:用于根据路由索引选择键值对 (key-value) 特征,支持不同的加权方式。

QKVLinear:用于将输入特征映射到查询 (query)、键 (key) 和值 (value) 的线性变换。

BiLevelRoutingAttention:实现了一种双层路由注意力机制,结合了全局和局部注意力。

LocalWindowAttention:实现了一种局部窗口注意力机制,通过对输入特征进行窗口划分来计算注意力。

CoordAtt、TripletAttention、BAMBlock、EfficientAttention 等其他模块实现了不同类型的注意力机制,旨在提高模型的表达能力和性能。

DeformConv 和 deformable_LKA:实现了可变形卷积,能够自适应地调整卷积核的位置,以更好地捕捉特征。

EffectiveSEModule、CPCA、MPCA 等模块则实现了通道注意力机制,增强了特征通道的表示能力。

FocusedLinearAttention 和 MLCA:这些模块结合了线性注意力和多路径注意力,旨在提高计算效率和特征融合能力。

文件的最后部分定义了一些辅助类和函数,如 img2windows 和 windows2img,用于处理图像的窗口划分和重组。

总体而言,attention.py 文件提供了一系列灵活且高效的注意力机制实现,可以用于构建各种深度学习模型,特别是在计算机视觉领域的应用。每个模块都经过精心设计,以便在不同的上下文中使用,提升模型的性能和效率。

源码文件

源码获取

欢迎大家点赞、收藏、关注、评论 啦 、查看👇🏻获取联系方式👇🏻