随着大模型推理、视觉分析和边缘智能应用的增长,算力需求正从云端向边缘及端侧延伸。如何把高性能AI算力融入已有的计算设施,又如何让算力下沉到生产线、机器人内部,是整个产业都在探索的方向。在昇腾生态中,神州鲲泰与迅龙软件正尝试用一种"入端"的方式给出回答------让算力像电流一样流进旧服务器,也流进物理世界的躯体。

双方合作推出的产品有两款:OrangePi AI Duo算力卡 和OrangePi AI Station具身智能盒子 ,均基于昇腾310P处理器,但指向完全不同的部署形态。

合作基础:底座与行走机构的互补

神州鲲泰是华为"鲲鹏+昇腾"双生态的核心参与者,拥有昇腾全栈智算底座、品牌渠道和服务能力。迅龙软件则在嵌入式硬件设计、开源软件开发、ARM架构底层调优及端侧设备量产交付上积累了二十多年经验。如果把昇腾310P比作一台动力充沛的发动机,那么神州鲲泰打造的是整车的底盘和电气架构,而迅龙软件设计的则是能适应数据中心"高速路"和工厂车间"碎石路"的轮子和悬挂。正是这种分工,让昇腾算力既能在标准服务器中即插即用,也能塞进工控机大小的盒子里执行实时任务。

OrangePi AI Duo:存量服务器的算力注入

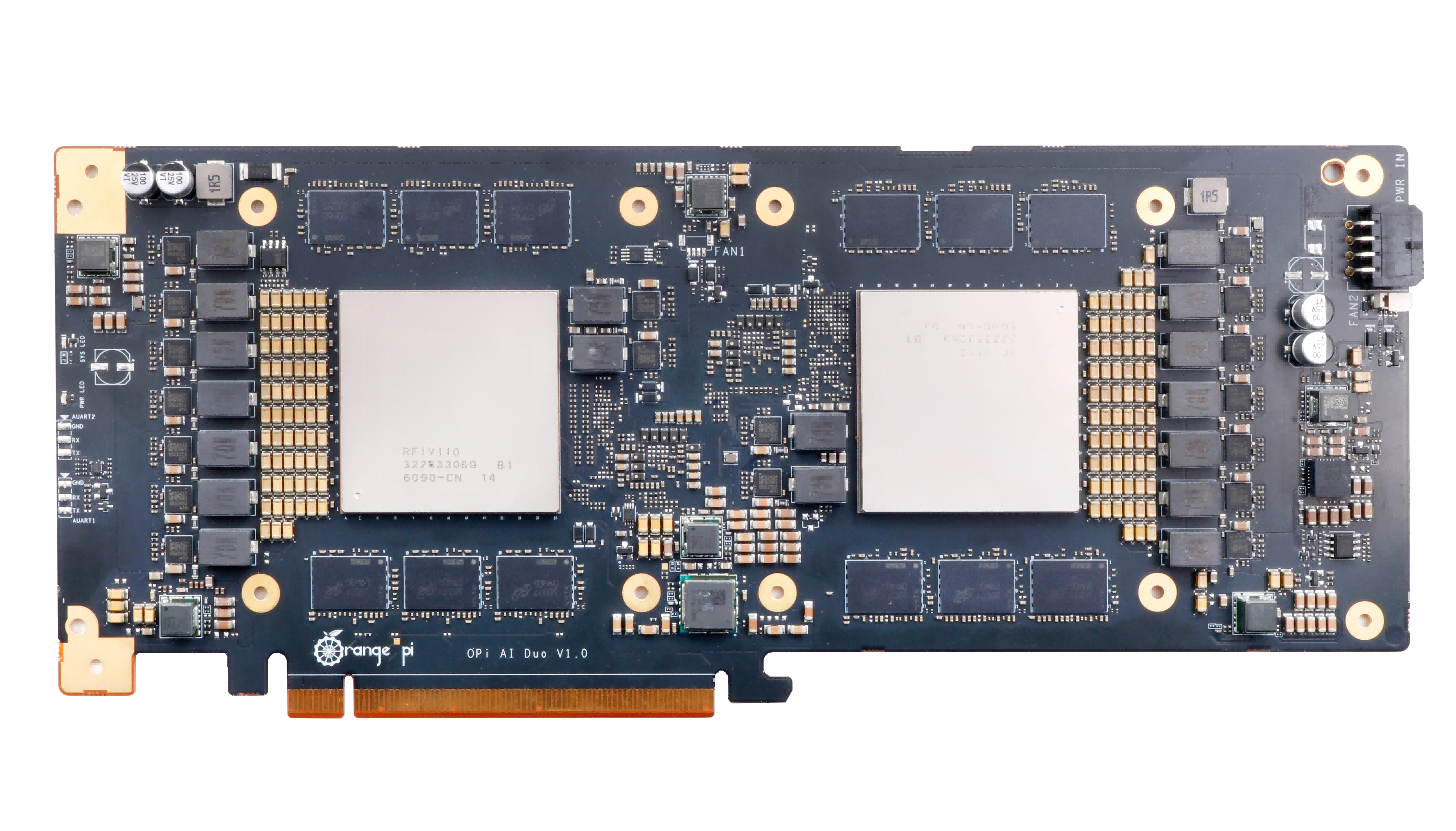

AI Duo是一张标准PCIe 4.0 x16加速卡,搭载双昇腾310P,INT8算力为352 TOPS。内存部分采用了LPDDR5,速率5500Mbps,相比同算力级别的LPDDR4X方案,带宽提升约30%。在大模型推理的解码阶段,更高的内存带宽有助于降低延迟、提高并发吞吐量。

从产品形态看,该卡为单槽位设计,采用8pin显卡供电,可直接插入现有x86服务器或工作站的空闲PCIe插槽,无需更换整机或调整机房结构。对于当前算力紧张但仍可继续使用的x86服务器群,这种方式实现了一种"即插即用"的利旧升级:一台2U服务器如插满4张AI Duo,理论算力可扩展到1400 TOPS以上。在搜索推荐、内容审核、OCR识别等对并发要求较高的场景中,这种扩容方式能够以较小的改动成本补充AI推理能力。

OrangePi AI Station:面向物理世界的具身智能盒子

如果说OrangePi AI Duo是把算力带入机柜,那么OrangePi AI Station则是将算力直接部署到被控对象的身边。它搭载单颗昇腾310P,INT8算力176 TOPS,最高可选配96GB内存和M.2 NVMe固态硬盘。除了常规的HDMI、USB 3.0与千兆以太网口,它还提供40Pin GPIO扩展接口。正是这组GPIO,让盒子可以直接连接继电器、传感器和工业相机,成为一个端侧"感知-决策-执行"的节点。

在实际应用中,OrangePi AI Station已被尝试部署于多个方向。在具身智能机器人领域,某新能源汽车企业将其用于运行Pi 0.5等大模型,作为机器人的主控模块,处理摄像头画面、自然语言交互以及各类舵机控制。工业视觉检测是另一个落地场景:设备固定在生产流水线一侧,通过工业相机采集PCB板图像,运行轻量化检测模型,并通过GPIO联动报警灯,一旦发现瑕疵立即触发停线,检测延迟被压缩到毫秒级。此外,一些设计师和渲染师将它作为私有AI工作站,在本地运行文生图模型、文生视频等模型,避免设计原稿上传至云端,同时省去排队等待云GPU的时间。

协同价值:让算力流到需要的地方

从产业落地的角度看,这两种产品代表同一种思路:让算力按照使用场景的实际需求流动。OrangePi AI Duo帮助用户利用现有服务器资产扩充AI推理能力,在一些互联网企业的排序召回模型、高校的大模型实训平台上已经得到验证。OrangePi AI Station则把算力密度和物理接口结合在一起,为工业质检、具身智能、本地渲染等场景提供低时延、数据不离场的方案。

通过"一卡一盒"的组合,昇腾算力得以从数据中心进入边缘现场,从服务器插槽进入机器人的躯干,完成了从基础设施到具身终端的跨越。这种流动,让存量资产重新产生价值,也为端侧应用带来了更低的接入门槛。

你是否已经或正在计划基于昇腾、香橙派硬件做开发?对于这类算力卡的SDK、驱动及工具链,你有哪些期待或建议?欢迎交流你的技术体验。