亮点:高可用的 API 平台,新人免费 100 万 token ,DeepSeek-R1 (671B)与 DeepSeek-V3 模型享五折优惠,活动时间为2025年02月12日18:00:00~2025年02月23日23:59:59 ,活动结束后恢复原价。https://www.aliyun.com/solution/tech-solution/deepseek-r1-for-platforms?utm_content=g_1000401616

什么是 DeepSeek?

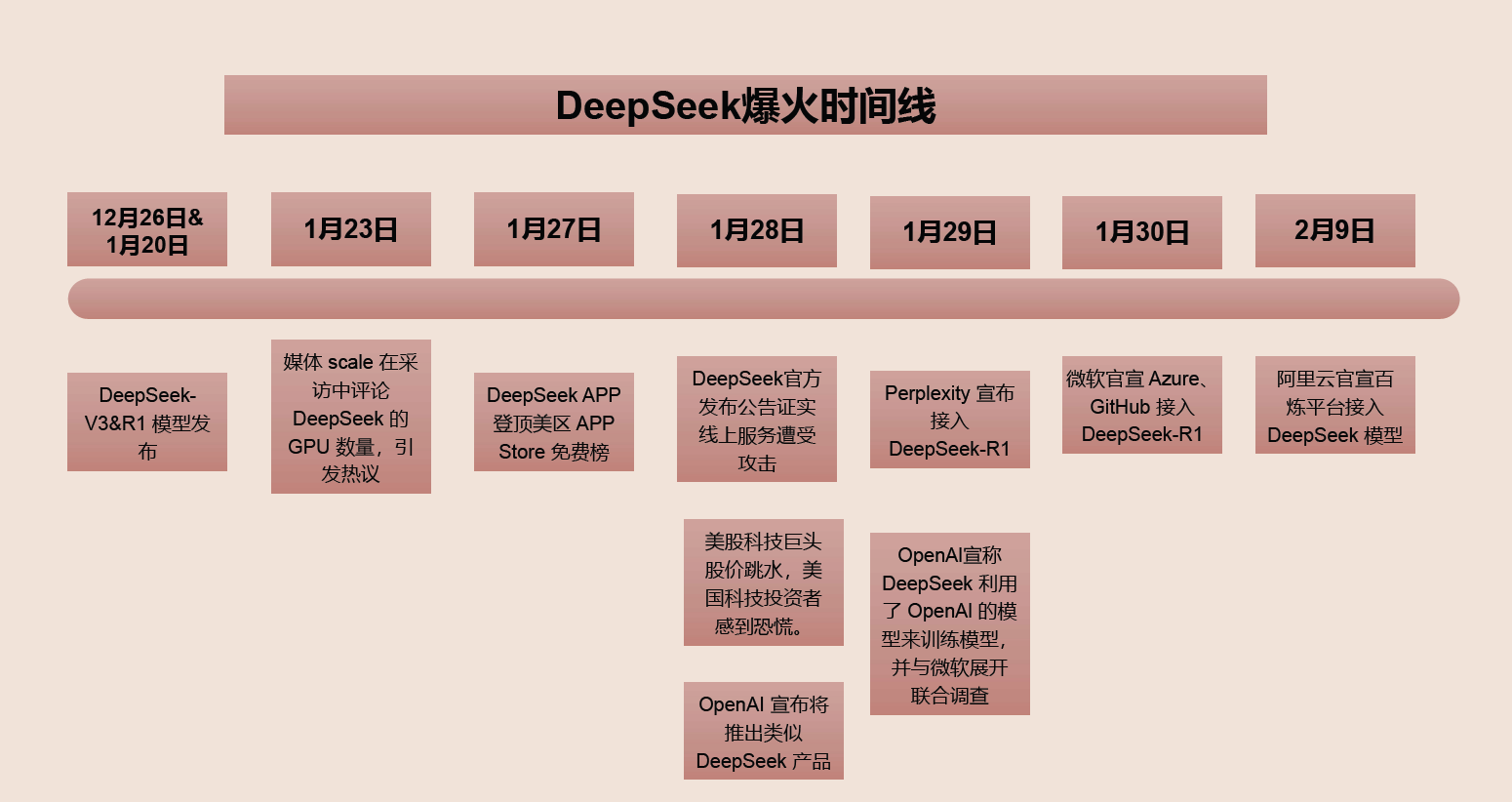

DeepSeek 中文名「深度求索」,是一家专注实现通用人工智能(以大模型为代表)的科技公司。它由量化资管巨头「幻方量化」创立于2023年7月。此外,外界也将该公司开发一系列大模型产品笼统称为"DeepSeek"。据报,DeepSeek 官网注册使用人数在一周内就突破了一个亿。

2025年春节期间,DeepSeek开源的 R1 推理模型引爆互联网。(如果你使用https://chat.deepseek.com/ 网站使用【深度思考(R1)】选项来提问,那么你使用的就是 R1 推理模型)

DeepSeek 模型有哪些?怎么用?

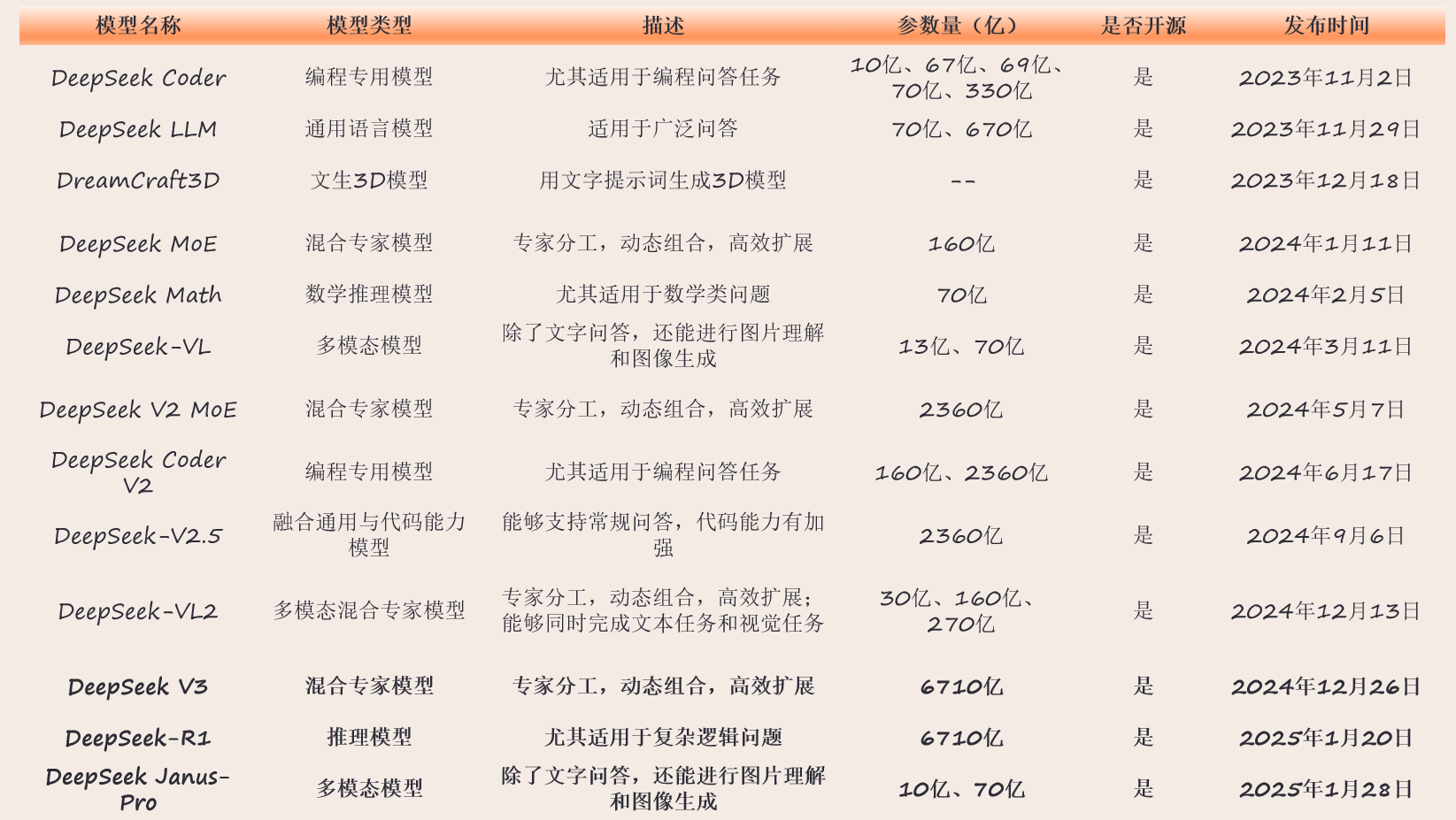

DeepSeek 已经发布13个大模型,并且都已开源。因此模型不仅支持官方的聊天网站和API平台访问(需要注册账号使用官方算力资源),还可以使用本地部署方式来自己搭建 API 来使用。另一个自称非盈利的 OpenAI 旗下主打的核心模型都没有开源,用户要使用必须通过APP或 API 调用。

全球开发者都能使用DeepSeek的技术开发自己的模型、应用、产品。DeepSeek 使用了极其宽容的 MIT 许可证,你只要保留署名和许可文本,任意修改分发甚至商用都是被允许的。

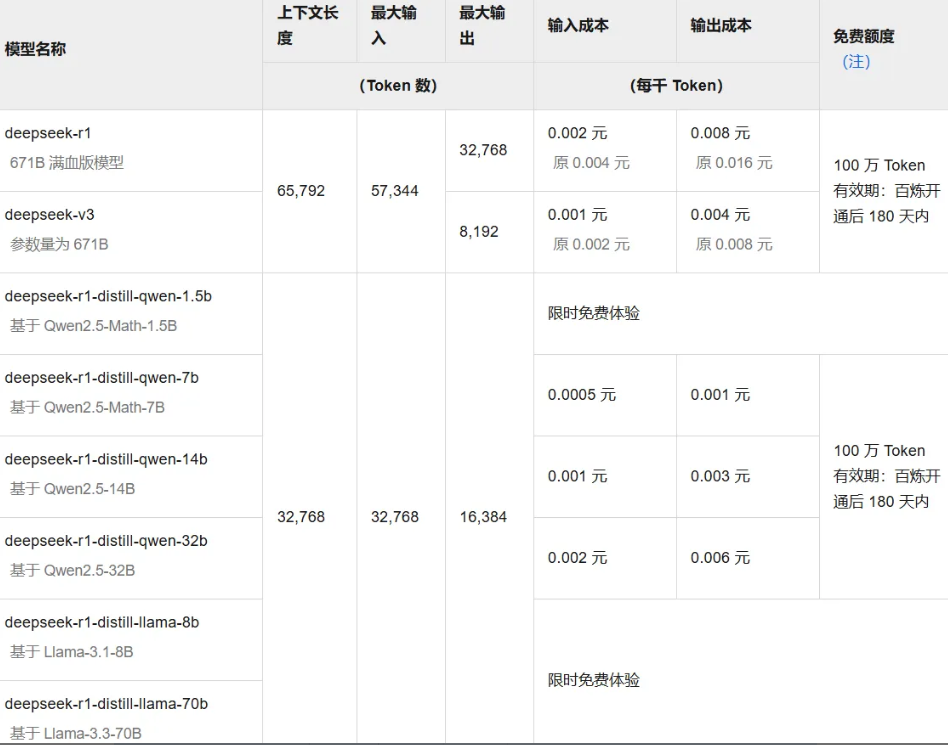

各模型基本情况如下表所示:

最近引起全世界广泛关注的模型,主要是自研通用大模型 DeepSeek-V3、推理模型 DeepSeek-R1 。

DeepSeek-V3 是一个通用模型,日常常见的问题,都可以尝试使用 V3。

DeepSeek - R1 是一个推理模型,擅长处理复杂、需要多步思考的问题,适合做深度研究、解决代码问题、数学问题。

特点:

- DeepSeek-R1 的训练模式颠覆了常规认知。DeepSeek-R1 是首个验证了仅通过 RL(强化学习)无需 SFT (监督微调) 就能得到大幅推理能力增强和涌现的模型。这种训练方式大幅降低了数据标注成本,简化了训练流程,整体训练成本也得到了降低。

- R1 和 V3 都可以在 DeepSeek 官网上免费使用;API 的定价中,R1 输入部分的价格是 o1 的 1.82%,输出部分是 o1 的 3.65%;V3 输入部分的价格是 GPT-4o 的 1.12%,输出部分是 GPT-4o 的 2.8%。

- 这两款模型的性能接近甚至在某些场景超越了"公认"的全球标杆公司OpenAI的最好产品(DeepSeek-V3 对标GPT-4o,DeepSeek-R1对标o1)。

方法一、使用官方服务

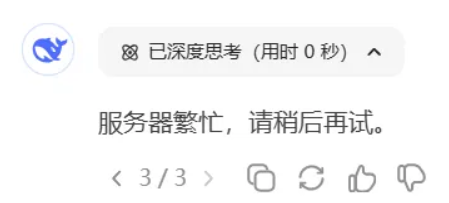

第一种方式使用很简单,在https://chat.deepseek.com/网站上注册账号就能开始聊天了,但是由于爆火,官方算力资源已经不能够应对这么多的服务请求。现在基本上在第一次提问并回答后就会一直出现如下图的服务不可用提示:

因此网友调侃,独自一人就能写一个媲美 deepseek 的AI代码,甚至不需要独立显卡就能运行。

同时,官方的开放平台也由于资源紧张而暂停了重置功能,基本处于不可用状态。

当前服务器资源紧张,为避免对您造成业务影响,我们已暂停 API 服务充值。存量充值金额可继续调用,敬请谅解!

方法二、本地部署

因此通过本地部署去使用 deepseek 反而成为了主流的选择。

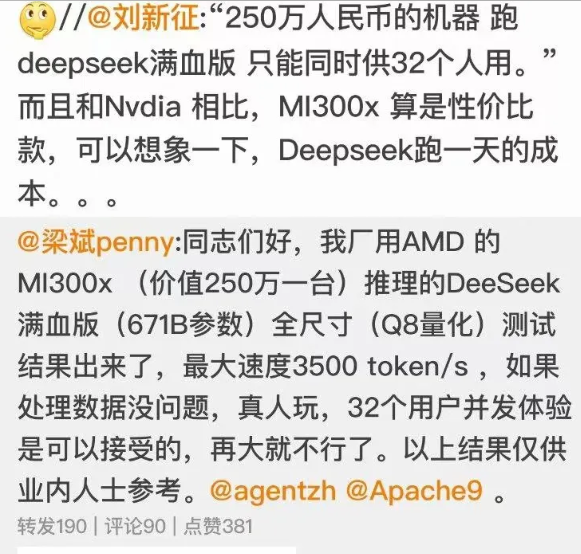

目前deepseek-r1模型大小提供了7个选择:1.5b、7b、8b、14b、32b、70b、671b(除了671b之外均是蒸馏模型)。普通的家用笔记本只能勉强跑一下 1.5b 大小的DeepSeek-R1-Distill-Qwen-1.5B模型,对于专用用户来说并不足以满足使用。根据网友测试,满血版的模型用 MI300x 运行也仅能供32个人去使用。

但是本地部署这种方式仍然存在局限性,你起码需要一台主流性能的中端电脑才能运行最小规格的模型。所以,下面介绍的这种方式更推荐普通人去使用。

方法三、第三方 API\云资源

不少云计算厂商都支持了 DeepSeek 的模型部署和调用。

以阿里云为例,大模型服务平台百炼自2025年2月9日起就能够通过API调用DeepSeek系列模型,其中 deepseek-r1 与 deepseek-v3 分别有 100万的免费 Token,部分蒸馏模型限时免费体验。

相比于网络上动辄几百上千的割韭菜部署教程,阿里云提供了一站式解决方案,提供各种云产品免费试用,部署门槛非常低,不懂代码也可以五分钟搭建完毕。

【零门槛、即刻拥有 DeepSeek-R1 满血版】 技术解决方案整合了阿里云的计算资源提供四种路径,分别是:

- 基于百炼 API 调用满血版 :SaaS 服务,开通即可用,相当于第三方的 API 开放平台。有免费额度,三分钟开通即可用,适合普通用户。"百炼"指的是阿里云提供的一个集成多种机器学习和深度学习算法的平台服务。通过调用其API,开发者可以轻松地将复杂的AI功能集成到自己的应用程序中,而无需关心底层的算法实现细节。

- 基于人工智能平台 PAI 部署: **PaaS 服务,适合人工智能开发者使用。有免费额度,十分钟一键式部署。**PAI(Platform of Artificial Intelligence)是阿里云提供的一站式机器学习平台,它支持从数据预处理、模型训练到模型部署的全流程操作。PAI可以帮助用户快速构建和应用机器学习模型,适用于各种规模的企业和个人开发者。

- 基于函数计算部署: **FaaS (Function as a Service)服务,提供无服务器应用的搭建,更加弹性。有免费额度,十分钟一键式部署。**函数计算是一种事件驱动的全托管计算服务。用户只需要编写并上传代码,无需管理或运维服务器等基础设施。函数计算会自动为用户准备好执行环境,并根据实际请求量自动扩展资源,非常适合用于响应实时事件、处理数据流以及构建无服务器架构的应用程序。

- 基于GPU 云服务器部署: **IaaS 服务,提供带有GPU的云服务器,是更加传统的形式。无免费额度,最快30分钟手动搭建完成。**GPU云服务器是专门针对需要大量图形处理和高性能计算的应用场景设计的。相比传统的CPU服务器,GPU服务器在处理大规模并行计算任务时具有显著的优势,特别是在机器学习、科学计算、视频编码等领域。使用GPU云服务器,用户可以获得强大的计算能力来加速其应用的运行效率。

使用阿里百炼免费调用 DeepSeek 模型

在官方资源十分紧张而手边又没有性能十分强大的电脑之时,使用云资源满足使用需求是不二选择,在阿里云提供的四种技术解决方案中最快上手的就是使用阿里百炼免费调用 DeepSeek 模型。

这种方式与使用官方开放平台效果近似,但百炼平台提供了智能体等更多定制功能,且具备负载均衡和自动扩缩容机制,保障 API 调用稳定性。

这种方式可以最低成本(有免费使用额度)快速体验DeepSeek-R1 满血版模型。

用户也无需针对 API 平台开发专用 APP,目前已有基于通用 API 的开源客户端项目,搭配 Chatbox 可视化界面客户端,进一步简化了调用流程,无需在命令行中操作,通过图形化界面即可轻松配置和使用 DeepSeek 模型。

我们点击立即部署,会默认跳转到最简单的方案-使用阿里百炼免费调用 DeepSeek 模型。跟着技术解决方案一步步操作即可:

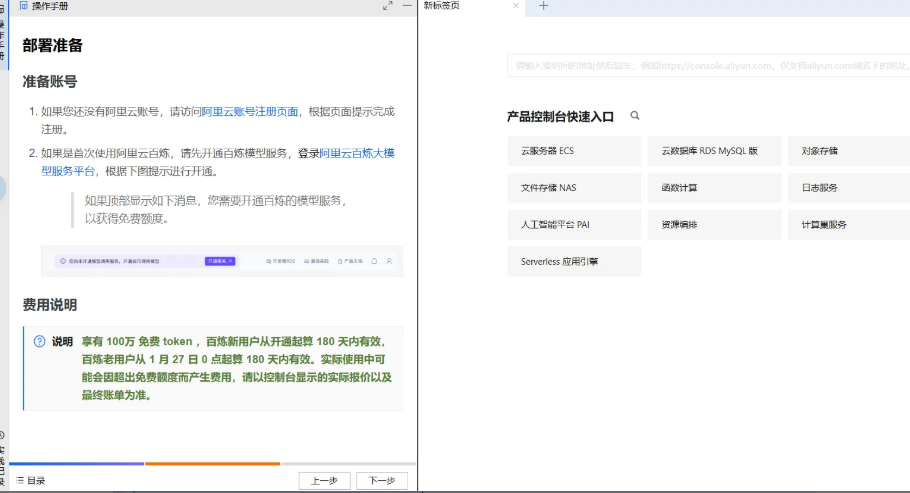

步骤一:开通阿里云账号&百炼平台

能打开这个技术解决方案的同学都是有阿里云账号的(如果没有会跳转到登录/注册页面,自行注册即可~)。如果是首次使用阿里云百炼,需要先开通百炼模型服务,登录阿里云百炼大模型服务平台,根据下图提示进行开通。

百炼提供的新人免费额度100万可以完全覆盖本教程所需资源消耗,100万 免费 token ,从百炼新用户开通起 180 天内有效。额度消耗完后按 token 计费,相比自行部署大模型可以显著降低初期投入成本。

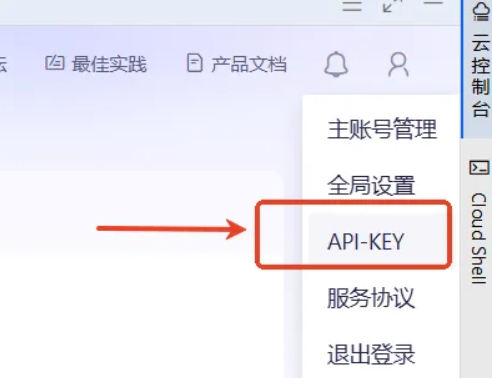

步骤二:获取 百炼 API-KEY

百炼 API-KEY 可以理解为身份凭证,使用 API-KEY 可以使用 API 接口调用账号内资源。

登录阿里云百炼大模型服务平台,在右上方用户logo可悬停的下拉菜单处单击【API-KEY】

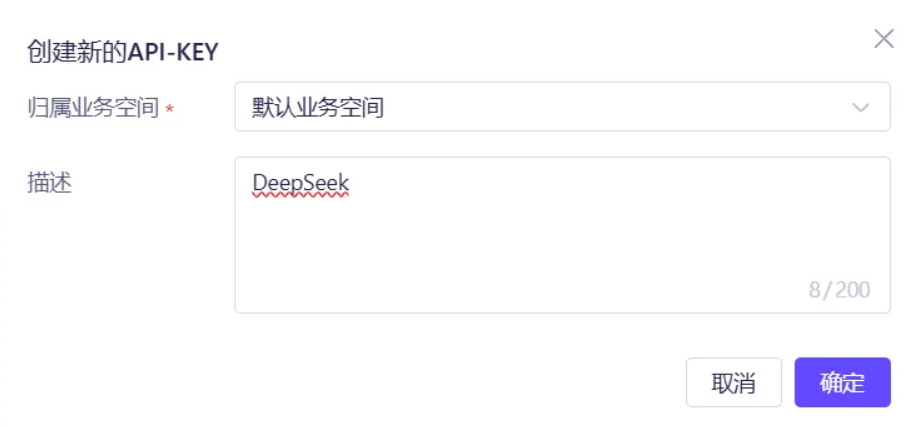

可以为了使用DeepSeek模型新建 API-KEY。

使用默认业务空间和任意备注即可。API KEY需谨慎保存,泄露可能会造成造成安全风险或资金损失。

步骤三:通过 Chatbox AI 客户端或其他 API 客户端使用百炼平台的 DeepSeek 模型

百炼提供的 DeepSeek 模型规格如下:

由于技术解决方案追求简洁性,在这里补充一下更多API的使用方式https://help.aliyun.com/zh/model-studio/developer-reference/deepseek?

- 可以通过 OpenAI SDK 或 OpenAI 兼容的HTTP方式快速体验DeepSeek模型。

- 可以通过 DashScope SDK 或 HTTP 方式快速体验 DeepSeek 模型。

- 非开发者可以通过 Chatbox 或 Dify 等大模型客户端接入 API 使用

- GitHub - Bin-Huang/chatbox: User-friendly Desktop Client App for AI Models/LLMs (GPT, Claude, Gemini, Ollama...) Chatbox 开源社区版

- https://chatboxai.app/ Chatbox 闭源官网版

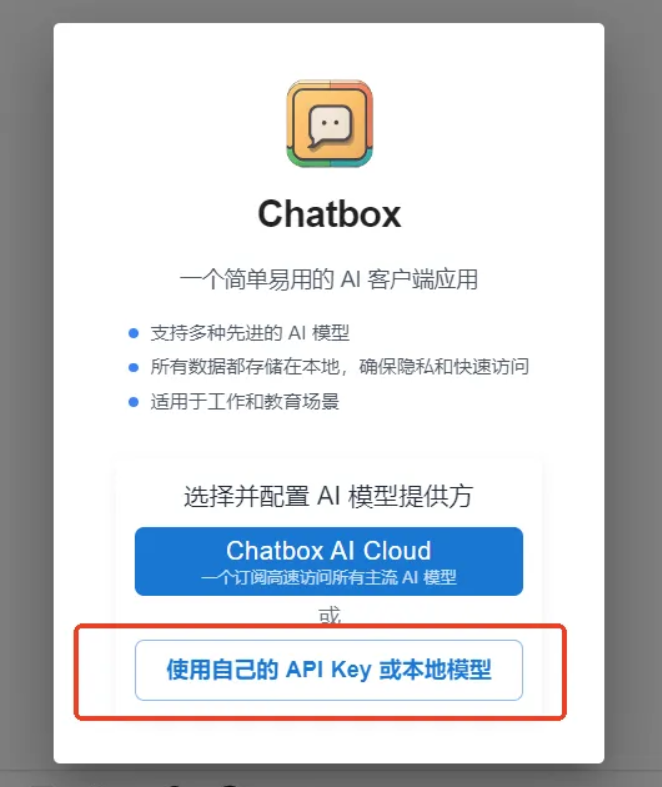

以主流的 Chatbox 为例,在官网下载并安装完成客户端后单击【使用自己的 API Key 或本地模型】

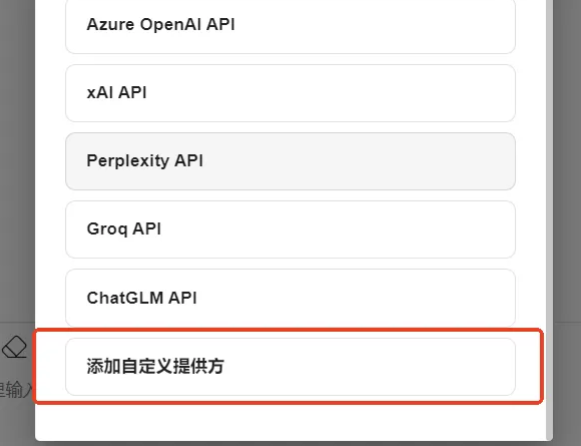

单击【添加自定义提供方】

API 设置

- 名称输入"阿里云-DeepSeek-R1"(可自定义);

- API 域名 输入https://dashscope.aliyuncs.com/compatible-mode/v1;

- API 路径 输入

/chat/completions;- API 密钥 输入您的 API Key,获取方法请参见:获取API Key;

- 模型输入您需要使用的 DeepSeek 模型,此处以 deepseek-r1 为例;

- 单击保存,完成设置。

提示:对于DeepSeek-R1 类模型,temperature、top_p、presence_penalty、frequency_penalty、logprobs、top_logprobs设置这些参数都不会生效,即使没有输出错误提示。

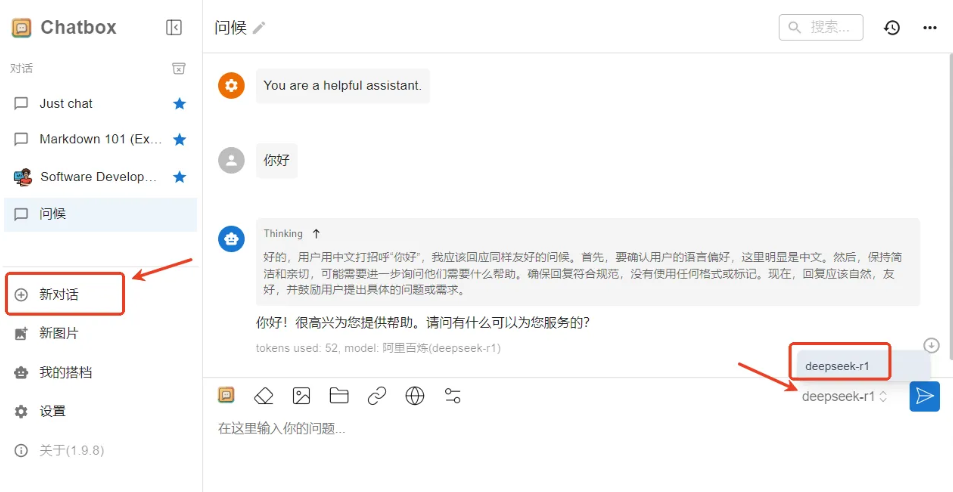

然后我们创建新对话选择使用刚才配置的服务即可:

阿里百炼 DeepSeek-R1 模型稳定性测评报告

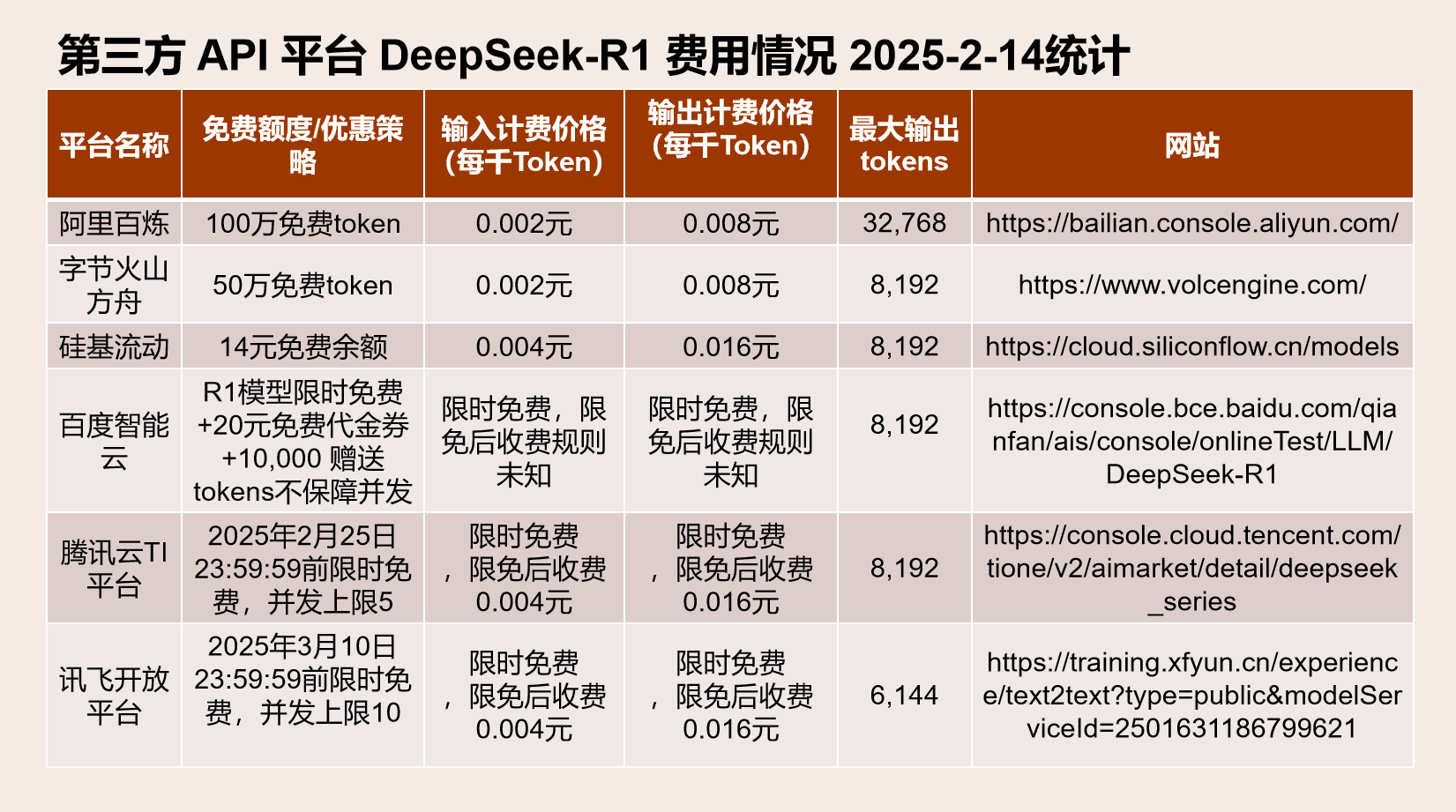

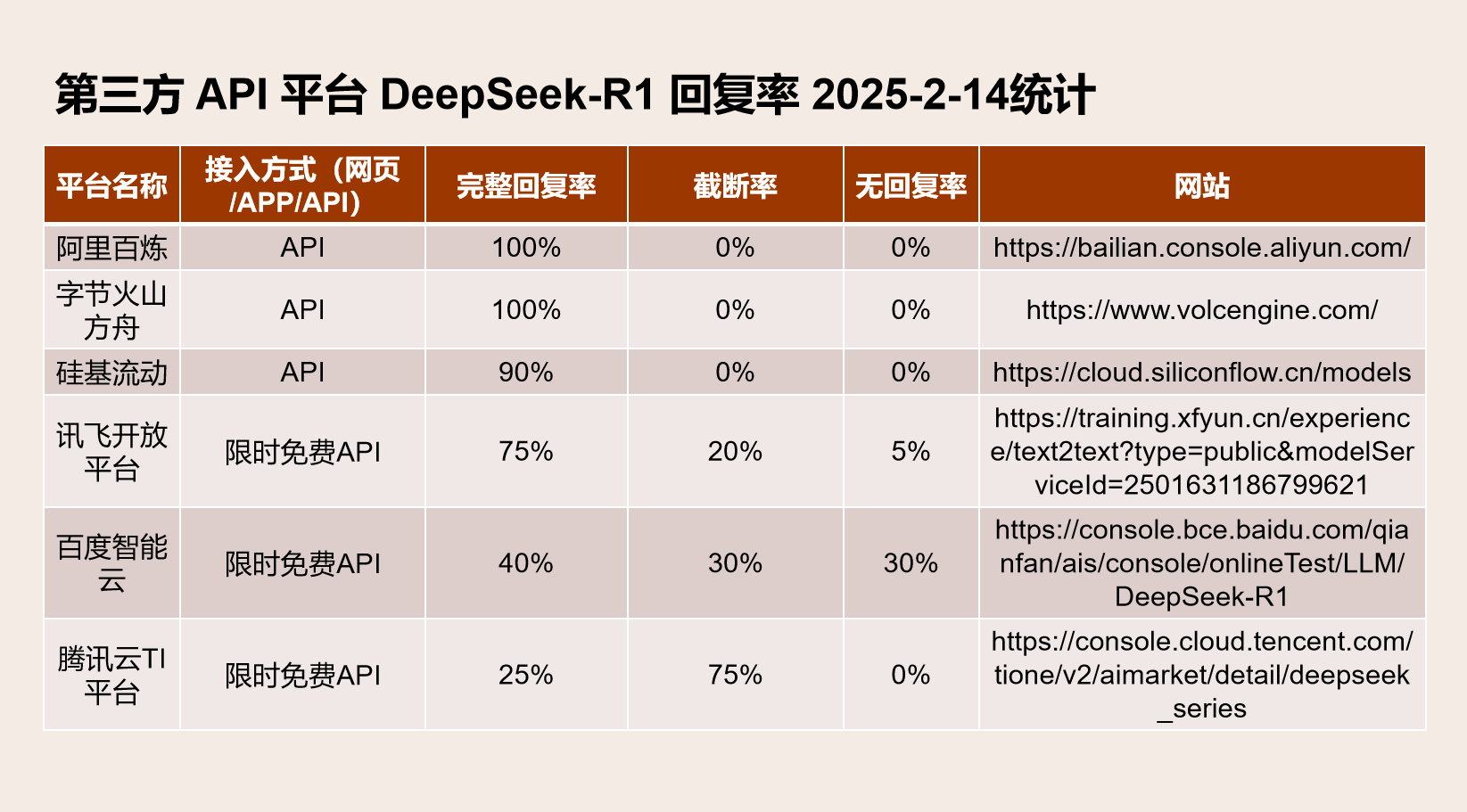

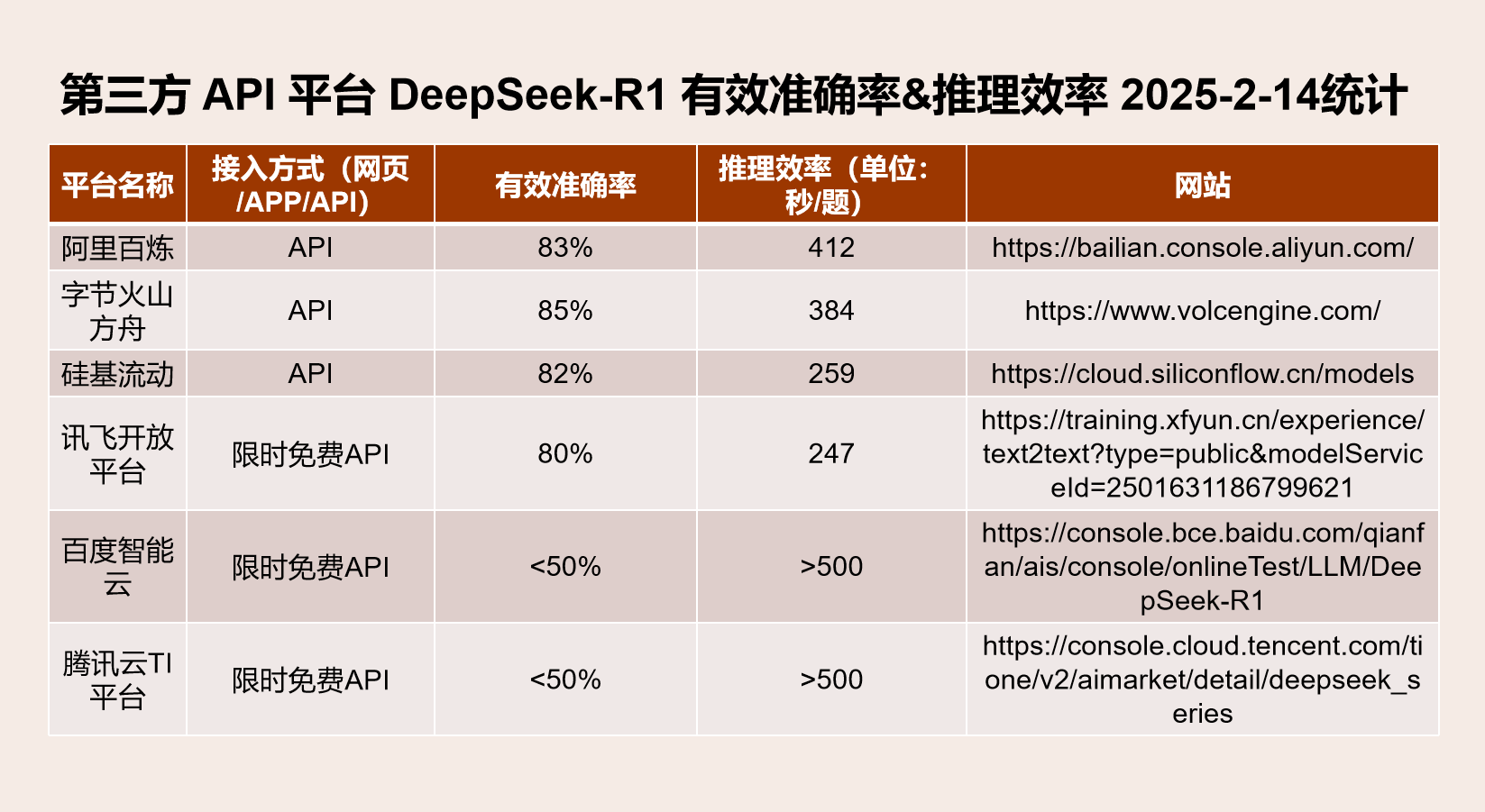

DeepSeek-R1 是本次出圈的主角,为了给大家参考,本次测评选择了支持 API 调用方式的主流第三方服务商,使用逻辑推理题从回复率、准确率和推理耗时等方面评估其表现。

首先是费用方面,各个平台均提供了免费的额度,对于个人使用的新用户来说短期内是完全可以"白嫖"的。

具体测评参考主流的模型测试项设置以下指标,测试数据集为20题:

| 指标名称 | 定义与计算方式 | 公式表达 |

|---|---|---|

| 完整回复率 | 模型完整输出技术有效响应(无截断、无错误终止)的题目占比,仅评估技术完整性,不涉及答案正确性 | 完整回复率 = C / N(C=完整回复题数,N=总题数) |

| 截断率 | 模型输出中途断开导致答案不完整的题目占比 | 截断率 = T / N(T=截断题数) |

| 无回复率 | 模型未返回有效响应(含请求失败、超时或无输出)的题目占比 | 无回复率 = E / N(E=无响应题数) |

| 有效准确率 | 仅针对完整回复题目,模型答案与标准答案一致的比例(仅对比最终结果,忽略推理过程) | 有效准确率 = A / C(A=正确答案数) |

| 推理效率 | 仅针对完整回复题目,模型单题推理耗时均值(单位:秒/题) | 推理效率 = Σt / C(t=单题推理时间) |

指标独立性

- 完整回复率、截断率、无回复率三者之和为100%(

C + T + E = N),逻辑闭环无重叠。

评测结果

总结

- 阿里百炼平台的可用性要远大于 DeepSeek 官方网站,回复率位于第一梯队。推理效率有高峰期影响,本次测评结果仅能代表2025年2月14日下午工作时段的表现。

- 不同平台对模型最大输出长度的限制使得模型在生成较长回复时更容易发生截断现象,模型最大输出长度受限的平台会大幅度出现无法完整回复的现象。

- 付费第三方平台的服务稳定性通常高于免费平台。不同第三方平台在部署和运行DeepSeek-R1时表现出的稳定性存在显著差异 。建议在选择平台时,综合评估 其技术架构、资源调度能力以及用户负载情况,并结合自身需求(如回复率、推理耗时等指标)进行权衡。对于追求更高稳定性的用户,可以考虑用户量较少但资源分配更均衡的第三方平台,以降低因高并发导致的性能波动风险。

- 考虑到不同平台的用户量级存在差异,用户数量较高的平台可能因服务器负载过重而面临更高的不稳定性风险。平台服务稳定性不足,或将间接影响模型生成回复的完整性和推理速度。阿里百炼返回的输出长度是众多平台中最长的,但是有效准确率和推理效率并不尽人意,猜测是阿里百炼用户数量众多导致资源比较紧张,平均tokens生成速度要慢于并不那么知名的云厂商。但没有出现执行后没有响应、响应超时或者报错(An internal error has occured, please try again later or contact service support)的现象,完整回复率能够达到100%。

期望

我在API服务之外还测试了支付宝百宝箱和纳米AI搜索等服务,这些需要网页/小程序访问的平台反而提供了更低的延迟和更高的效率。期望阿里百炼平台能够提供更多的计算资源来提升准确率和推理效率,同时需要注意阿里百炼免费的 API 额度遭到滥用的可能。