现阶段,在本地部署ollama非常简单,准备好一个有GPU的电脑,十分钟轻松部署qwen3:14b。实现本地的大模型部署。

我这里为了方便起见,直接使用windows电脑下载一个ollama。

访问ollama GIthub地址:ollama开源地址

直接下载安装包:

双击安装;

安装完毕后,我们在windows终端中输入:ollama --version

出现版本号就安装成功了:

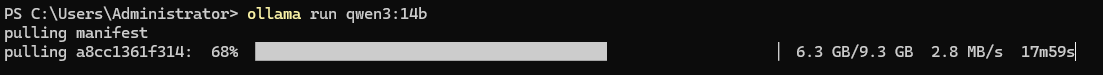

然后,我们用ollama在本地拉取一个qwen3:14b下来:

ollama run qwen3:14b我们等待完成

运行成功就可以对话了:

我们用nvidia-smi查看一下显存:

14B(int4量化)占用了11.5G的显存。

我们可以测试一下API是否能够正常调用:

我们请求本地接口:http://localhost:11434/v1/chat/completions

选择POST方法

请求体输入:

{

"model": "qwen3:14b",

"messages": [{

"role": "user",

"content": "你现在是一个翻译,我发你一段文字,你翻译成日语。"

},

{

"role": "assistant",

"content": "好的"

},

{

"role": "user",

"content": "今天天气怎样?"

}],

"stream": false

}可以看到本地大模型已经通了。

如果需要流式输出,将stream字段修改为true即可。

现在我们已经准备好本地的大模型环境了,后续我们将基于本地的大模型搭建一个小型RAG应用,实现自己个人知识库的问答。