IPM图像投影拼接技术详解

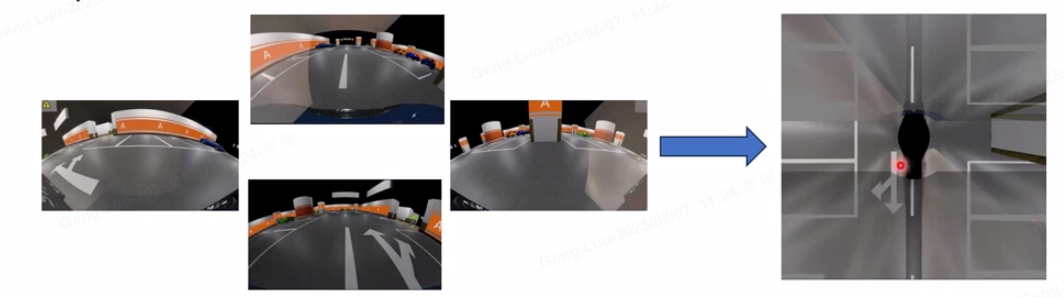

IPM(逆透视映射)图像投影拼接技术是一种在计算机视觉中广泛应用的图像处理方法,主要用于将多个透视视图的图像转换为鸟瞰视图并拼接成一个无缝的大场景图像。该技术特别适用于自动驾驶、机器人导航和监控系统等领域,因为它能消除透视畸变,提供更直观的环境表示。下面我将逐步详细解释其原理、数学基础、实现步骤和相关应用。

1. 技术概述

- IPM(逆透视映射):这是一种将透视图像(如从相机拍摄的视图)转换为鸟瞰视图(俯视图)的过程。透视图像中的物体因距离而显得大小不一,IPM通过数学模型校正这种畸变,使图像看起来像从正上方拍摄。

- 图像拼接:这是将多个重叠图像对齐并融合成一个宽视角图像的技术。拼接过程涉及特征匹配、图像变换和融合。

- 结合IPM与拼接:首先,对每个输入图像应用IPM转换为鸟瞰视图;然后,将转换后的图像拼接成一个完整的鸟瞰图。这能有效处理透视变化,提升拼接精度。

2. 核心原理

-

IPM原理:透视图像由相机模型产生,其中3D点投影到2D图像平面。IPM通过逆变换将2D图像点映射回3D世界坐标(假设地面平坦)。关键是用单应矩阵(homography matrix)描述变换。

- 透视投影公式:给定一个3D点P=(X,Y,Z)P = (X, Y, Z)P=(X,Y,Z),其投影到图像平面点p=(x,y)p = (x, y)p=(x,y)可表示为:

p=KRtP p = K \begin{bmatrix} R & t \end{bmatrix} P p=KRtP

其中,KKK是相机内参矩阵,RRR和ttt是旋转和平移矩阵。 - IPM逆变换:假设地面为Z=0Z=0Z=0平面,则IPM将图像点ppp映射到鸟瞰点u=(u,v)u = (u, v)u=(u,v):

u=H−1p u = H^{-1} p u=H−1p

这里,HHH是单应矩阵,H−1H^{-1}H−1是其逆矩阵。单应矩阵HHH可通过相机标定或特征点估计。

- 透视投影公式:给定一个3D点P=(X,Y,Z)P = (X, Y, Z)P=(X,Y,Z),其投影到图像平面点p=(x,y)p = (x, y)p=(x,y)可表示为:

-

拼接原理:拼接涉及多个IPM转换后的图像。使用特征检测(如SIFT或ORB)找到图像间的匹配点,然后估计变换矩阵对齐图像。最后,通过融合算法(如加权平均或泊松融合)消除接缝。

3. 数学基础

-

单应矩阵估计 :单应矩阵HHH是一个3×3矩阵,表示两个平面间的投影变换。给定匹配点对(pi,ui)(p_i, u_i)(pi,ui),其中pip_ipi是原始图像点,uiu_iui是鸟瞰点,HHH可通过最小二乘法求解:

ui=Hpi u_i = H p_i ui=Hpi写成齐次坐标形式:

uivi1=Hxiyi1 \begin{bmatrix} u_i \\ v_i \\ 1 \end{bmatrix} = H \begin{bmatrix} x_i \\ y_i \\ 1 \end{bmatrix} uivi1 =H xiyi1求解HHH需至少4对匹配点,使用SVD分解优化。

-

IPM变换公式 :对于图像中的每个点p=(x,y)p = (x, y)p=(x,y),IPM映射为:

u=H11x+H12y+H13H31x+H32y+H33,v=H21x+H22y+H23H31x+H32y+H33 u = \frac{H_{11}x + H_{12}y + H_{13}}{H_{31}x + H_{32}y + H_{33}}, \quad v = \frac{H_{21}x + H_{22}y + H_{23}}{H_{31}x + H_{32}y + H_{33}} u=H31x+H32y+H33H11x+H12y+H13,v=H31x+H32y+H33H21x+H22y+H23这里,HijH_{ij}Hij是单应矩阵HHH的元素。

-

拼接变换 :拼接时,使用仿射或投影变换对齐图像。例如,对两幅图像I1I_1I1和I2I_2I2,估计变换矩阵TTT:

I2′=TI2 I_2' = T I_2 I2′=TI2其中TTT由匹配点计算。融合后,输出图像IstitchedI_{\text{stitched}}Istitched通过像素加权实现无缝过渡。

4. 实现步骤

IPM图像投影拼接的算法流程如下(以两个图像拼接为例):

- 输入处理:获取多个重叠的透视图像(如车载相机序列)。

- IPM转换 :

- 估计单应矩阵HHH:使用相机内参或手动标定地面点。

- 应用IPM:对每个图像执行逆透视映射,生成鸟瞰视图图像。

- 特征匹配 :

- 检测特征点:使用SIFT或ORB算法提取关键点和描述符。

- 匹配点对:通过距离度量(如欧氏距离)找到图像间的对应点。

- 图像对齐 :

- 估计变换矩阵TTT:基于匹配点,求解变换矩阵(如使用RANSAC算法去除误匹配)。

- 变换图像:将第二幅图像变换到第一幅图像的坐标系。

- 融合与输出 :

- 融合图像:使用加权平均或高级融合技术(如拉普拉斯金字塔)拼接图像,消除边界。

- 输出:生成最终的鸟瞰拼接图。

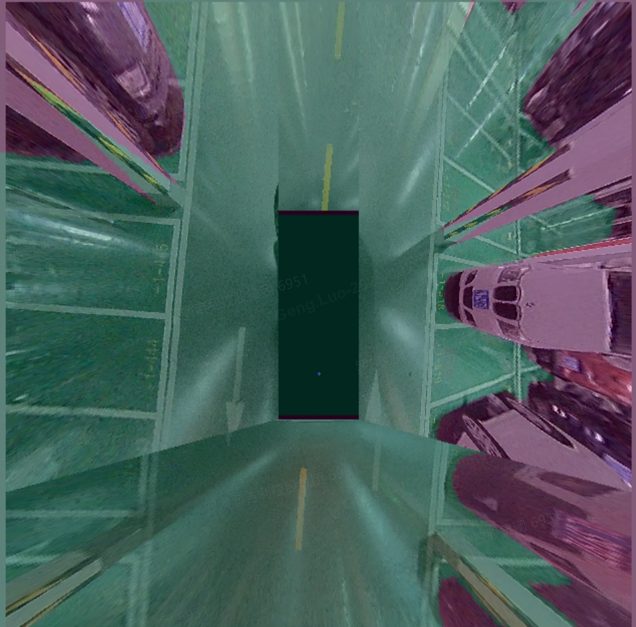

如果拼接不好(如上图)会严重影响自驾效果;加油学习吧;

5. 代码示例(简化Python实现)

以下是一个使用OpenCV库的简化代码示例,展示IPM和拼接的基本过程。假设相机参数已知。

python

import cv2

import numpy as np

# 步骤1: 定义单应矩阵H(示例值,需实际标定)

H = np.array([[1.5, 0, 100], [0, 1.5, 50], [0, 0, 1]], dtype=np.float32) # 单应矩阵

# 步骤2: 应用IPM到图像

def apply_ipm(image, H):

height, width = image.shape[:2]

# 计算逆单应矩阵

H_inv = np.linalg.inv(H)

# 执行IPM变换

ipm_image = cv2.warpPerspective(image, H_inv, (width, height), flags=cv2.INTER_LINEAR)

return ipm_image

# 步骤3: 图像拼接

def stitch_images(ipm_image1, ipm_image2):

# 初始化拼接器

stitcher = cv2.Stitcher_create(cv2.Stitcher_PANORAMA)

# 拼接图像

status, stitched_image = stitcher.stitch([ipm_image1, ipm_image2])

if status == cv2.Stitcher_OK:

return stitched_image

else:

raise Exception("拼接失败")

# 主程序

if __name__ == "__main__":

# 加载输入图像(假设image1和image2是透视图像)

image1 = cv2.imread('image1.jpg')

image2 = cv2.imread('image2.jpg')

# 应用IPM

ipm_image1 = apply_ipm(image1, H)

ipm_image2 = apply_ipm(image2, H)

# 拼接图像

stitched_image = stitch_images(ipm_image1, ipm_image2)

# 保存结果

cv2.imwrite('stitched_output.jpg', stitched_image)6. 应用与挑战

- 应用场景 :

- 自动驾驶:创建车辆周围环境的实时鸟瞰图。

- 监控系统:拼接多个摄像头视图,实现广角监控。

- 机器人导航:提供环境地图。

- 优势 :

- 消除透视畸变,提升图像几何一致性。

- 增强场景理解,便于后续处理(如目标检测)。

- 挑战与限制 :

- 依赖相机标定精度:如果HHH估计不准,会导致映射失真。

- 计算开销大:IPM和拼接算法需要较高计算资源。

- 动态场景处理:移动物体可能导致拼接伪影。

7. 总结

IPM图像投影拼接技术通过逆透视映射校正图像畸变,再结合拼接算法创建无缝鸟瞰视图。它在多个领域有重要价值,但需精确的数学模型和优化实现。核心在于单应矩阵估计和特征匹配,数学公式如u=H−1pu = H^{-1} pu=H−1p是基础。实际应用中,建议使用OpenCV等库简化开发,并针对场景调整参数。