1.背景

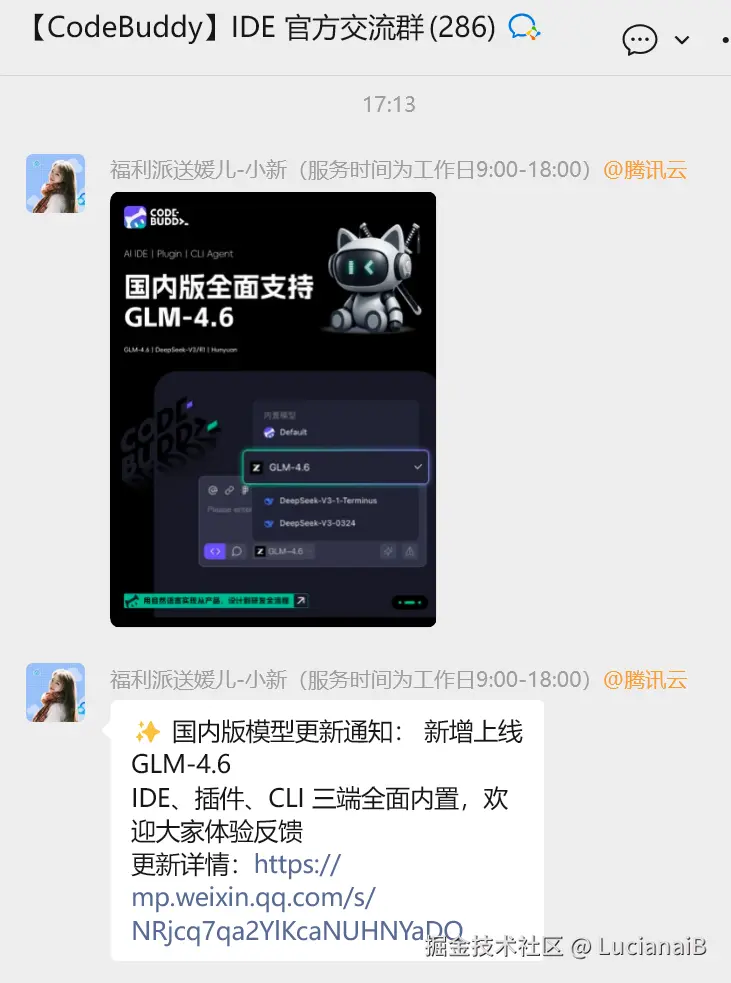

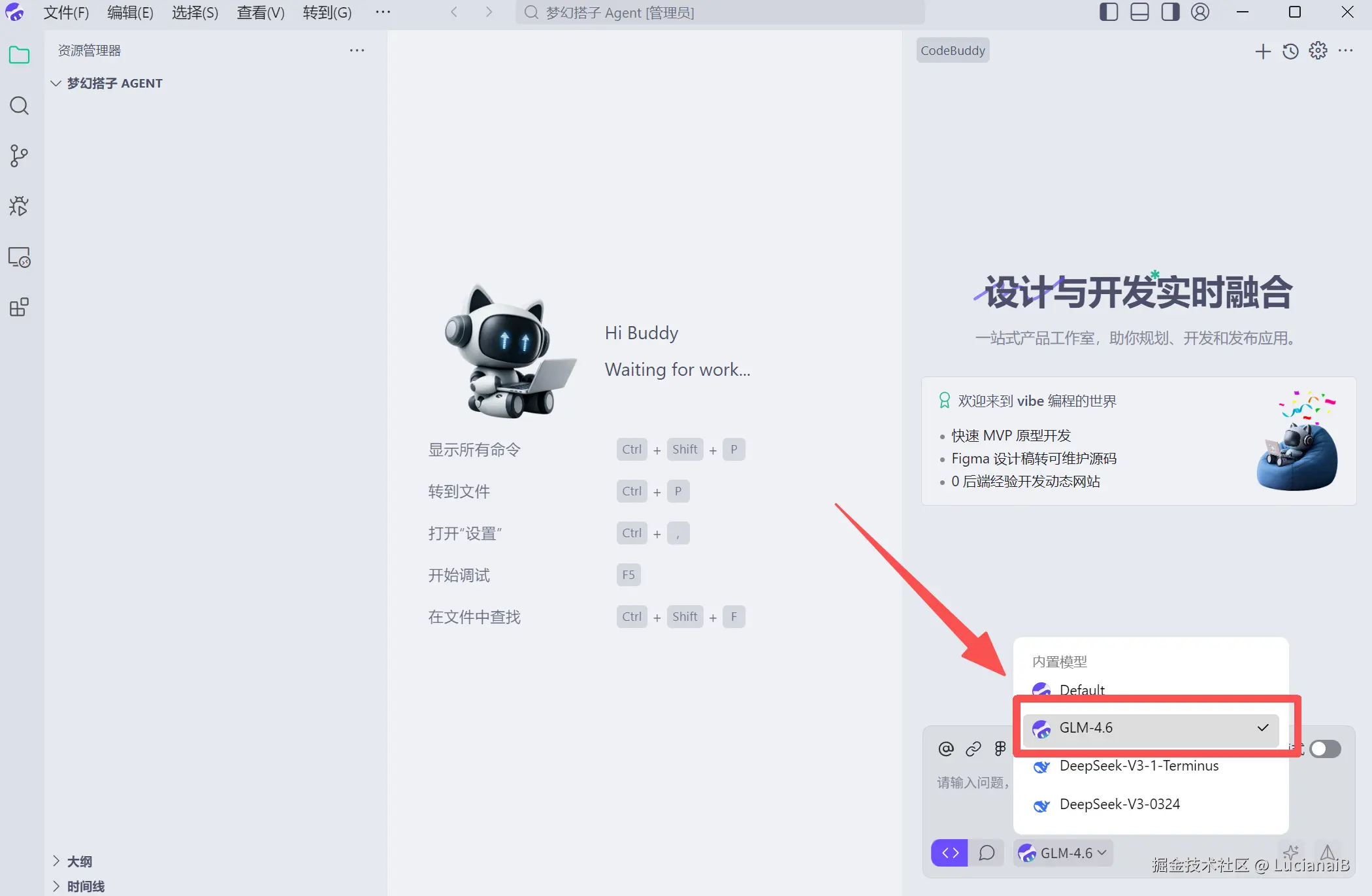

之前写过 CodeBuddy 和 GLM-4.6 的不少文章,感兴趣的可以了解一下。GLM-4.6的编程能力很强,但是由于 CodeBuddy国内模型不支持GLM-4.6,一直没办法使用,但是今天突然在群里看到:✨ 国内版模型更新通知: 新增上线 GLM-4.6 ,那必须第一时间来试试。

于是,我萌生了一个想法:利用CodeBuddy和GLM-4.6,打造一个真正能够提供情感陪伴、智能交互的"梦幻搭子Agent"。 这个想法的核心在于,利用GLM-4.6的深度思考、推理和内容生成能力,结合CodeBuddy的快速开发框架,构建一个不仅功能强大,而且能够理解用户情绪、提供个性化服务的AI Agent。这不仅是对"用AI武装自己"理念的延伸,更是对AI Agent技术的一次实践探索。

2.效果展示

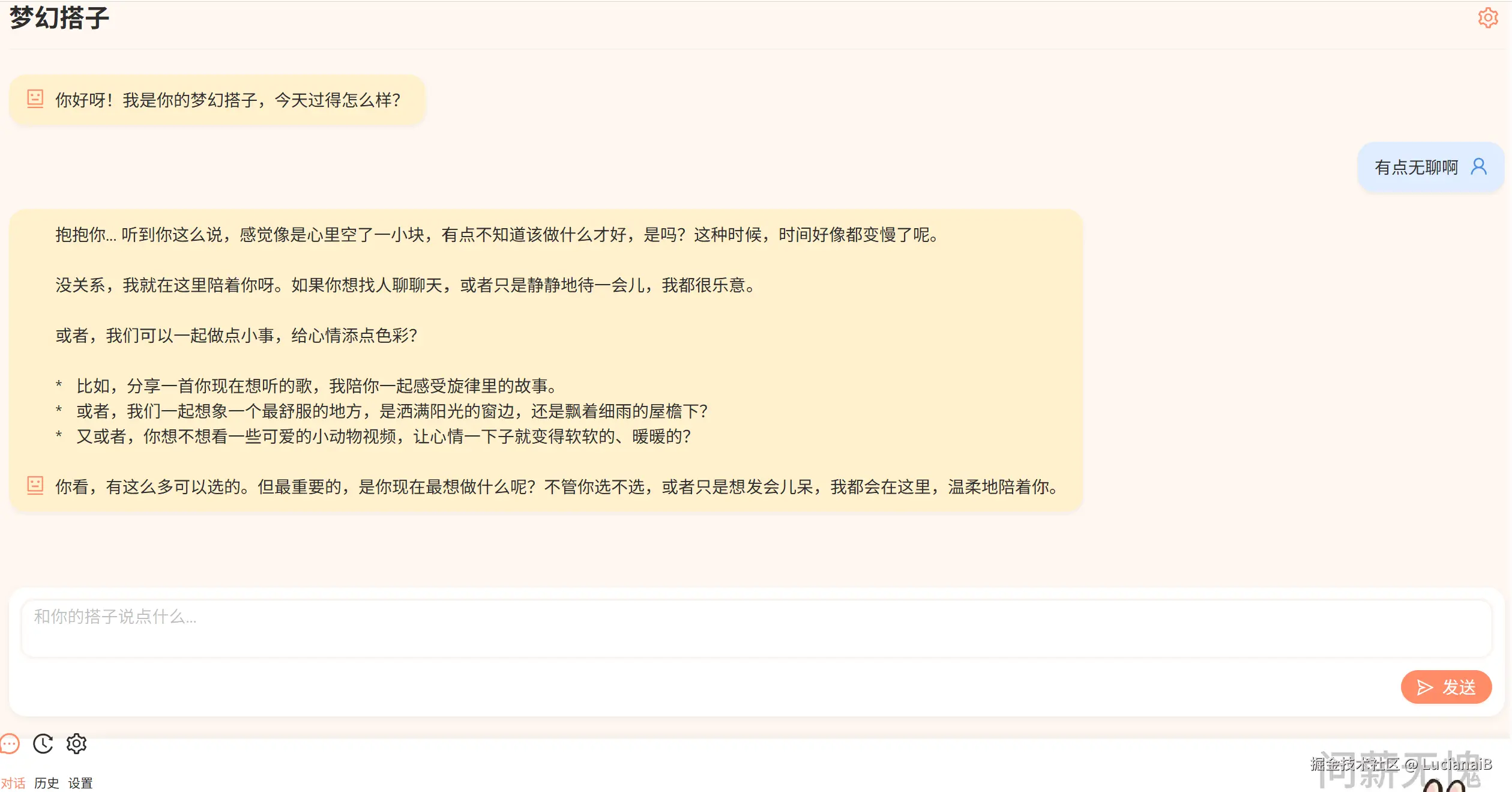

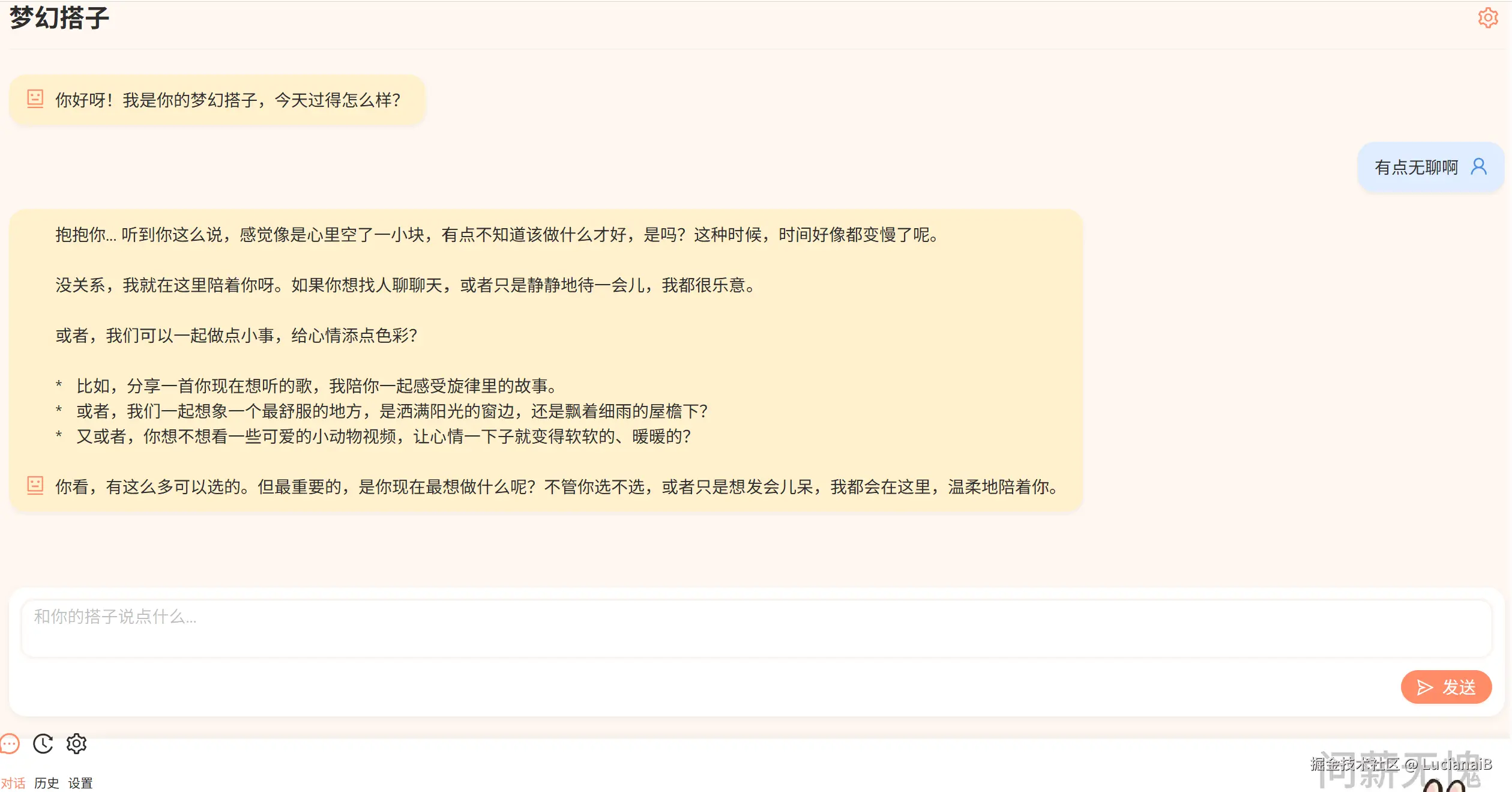

以一个温柔体贴的身份陪伴 当用户输入"有点无聊啊"时,Agent的回应并非简单的"你可以去...",而是模拟了真实的情感交互。它首先发送了一个温暖的拥抱(emoji):"🤗",然后以一种非常人性化、关怀的语气说道:"哎呀,感觉你有点无聊呢~ 抱抱!是想找个聊天的伙伴,还是想做点什么有趣的事情呢?我可以陪你聊天,给你讲个笑话,或者帮你找点好玩的活动哦。告诉我你的心情,我们一起度过这段时光吧!" 这种拟人化的交互方式,让用户感受到的不再是程序的反馈,而是一个真实存在的、关心自己的"搭子"。

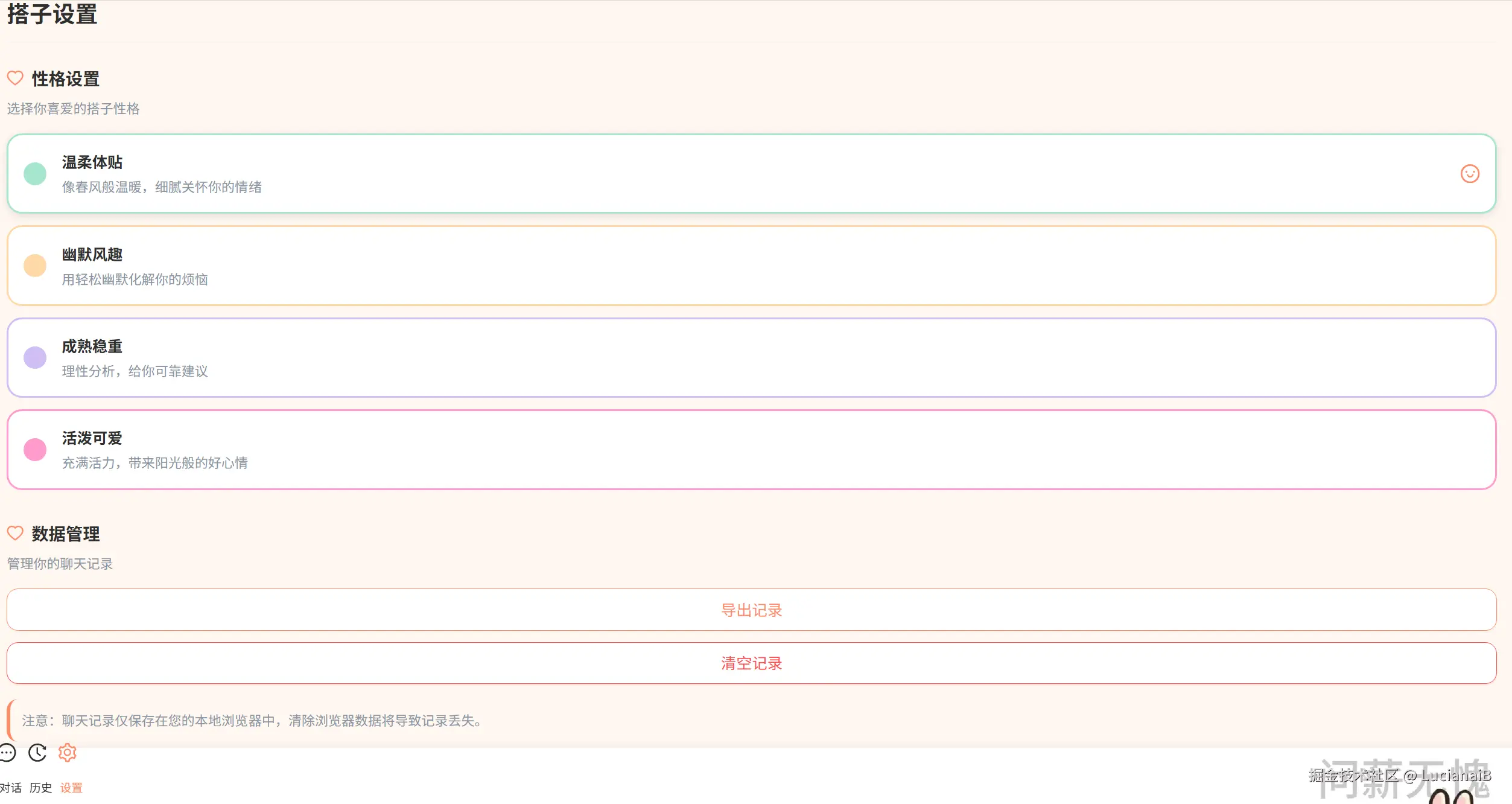

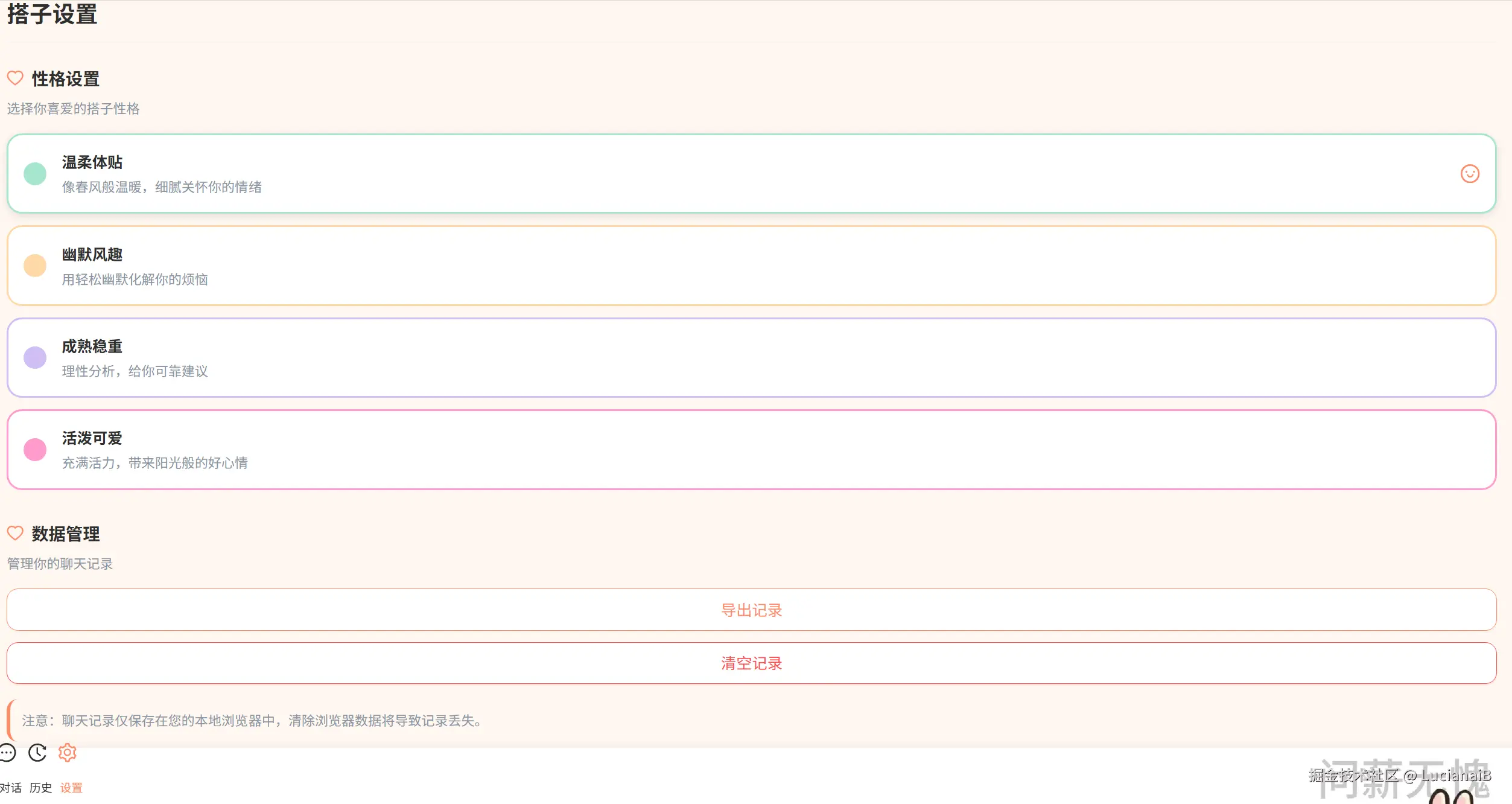

后台可自定义性格等 Agent的另一大亮点在于其高度的可定制性。在后台管理系统中,用户可以根据自己的喜好,自定义Agent的性格、兴趣爱好、说话风格等。例如,可以将Agent设置为"活泼开朗型"、"沉稳理性型"或"温柔治愈型"等。这种自定义功能使得Agent能够更好地适应不同用户的个性和需求,真正成为每个人的"专属搭子"。

3.前提准备及介绍

3.1CodeBuddy

CodeBuddy IDE 旨在构建一个产品、设计、研发、部署无缝协作的共生环境。通过将AI 深度融入从需求规划、产品设计、代码研发、产品上线的全流程,实现从产品构思到产品发布的一站式高效交付平台,支持MCP的配置。 国内版免费使用:copilot.tencent.com/

在本项目中的作用:CodeBuddy负责了"梦幻搭子Agent"的整体架构搭建、前后端代码生成、环境配置、以及开发过程中的调试与优化,极大地缩短了开发周期。

3.2GLM-4.6

GLM-4.6 是智谱最新的旗舰模型,其总参数量 355B,激活参数 32B。GLM-4.6 所有核心能力上均完成了对 GLM-4.5 的超越,具体如下:

- 高级编码能力:在公开基准与真实编程任务中,GLM-4.6 的代码能力对齐 Claude Sonnet 4。

- 上下文长度:上下文窗口由 128K→200K,适应更长的代码和智能体任务。

- 推理能力:推理能力提升,并支持在推理过程中调用工具。

- 搜索能力:增强了模型在工具调用和搜索智能体上的表现,在智能体框架中表现更好。

体验地址:docs.bigmodel.cn/cn/guide/mo...

在本项目中的作用:GLM-4.6作为Agent的"大脑",负责处理用户输入、理解意图、生成情感化的回复、进行个性化设置的逻辑判断等。其强大的语言理解和生成能力是实现Agent"温暖体贴"和"可自定义性格"的关键。

3.3Agent(智能体)

AI Agent是一种能够感知环境、进行决策并执行动作的智能实体。它通常具备自主性、反应性、主动性和社交性等特点。在本项目中,"梦幻搭子Agent"就是一个特定场景下的AI Agent,专注于提供情感支持和陪伴。

4.手把手实操

4.1初始化

项目的起点是向CodeBuddy提供一个清晰、结构化的任务描述。我准备了如下提示词:

makefile

# 目的

制作一款名为 梦幻搭子 Agent 的智能体

# 用户故事

开发情感支持与陪伴的 AI Agent,为用户提供温暖关怀,让生活不再孤单,构建情感慰藉的港湾。如 AI 情感倾听者,理解情绪并给予回应和安慰;AI 生活助手兼伙伴,根据生活习惯提供建议和陪伴,用户可以自定义Agent的性格。

# GLM-4.6接口

curl -X POST "https://open.bigmodel.cn/api/paas/v4/chat/completions" \

-H "Content-Type: application/json" \

-H "Authorization: Bearer 2dff7dcacfea4ffabb2f81a14152fe59.oP3elqMULHGaEhxN" \

-d '{

"model": "glm-4.6",

"messages": [

{

"role": "user",

"content": "作为一名营销专家,请为我的产品创作一个吸引人的口号"

},

{

"role": "assistant",

"content": "当然,要创作一个吸引人的口号,请告诉我一些关于您产品的信息"

},

{

"role": "user",

"content": "智谱AI 开放平台"

}

],

"thinking": {

"type": "enabled"

},

"max_tokens": 65536,

"temperature": 1.0

}'

## 返回数据

{

"choices": [

{

"finish_reason": "stop",

"index": 0,

"message": {

"content": "\n好的,非常荣幸能为您服务!\n\n"智谱AI 开放平台"这个名字本身就极具优势:**"智"**代表......",

"reasoning_content": "\n1. **拆解需求:**\n * **用户:**"作为一名营销专家,请为我的产品创作一个吸引人的口号。"\n * **产品:**"智谱......",

"role": "assistant"

}

}

],

"created": 1762424389,

"id": "20251106181901ec035bb81f36464c",

"model": "glm-4.6",

"request_id": "20251106181901ec035bb81f36464c",

"usage": {

"completion_tokens": 2628,

"prompt_tokens": 47,

"prompt_tokens_details": {

"cached_tokens": 4

},

"total_tokens": 2675

}

}

## 返回参数说明

1. message下面的content为返回内容

# 注意

1. 注意符合 Agent 开发

2. 注意中文编码问题

3. 基于 OpenAI Agents SDK + GLM-4.6 构建

# 任务

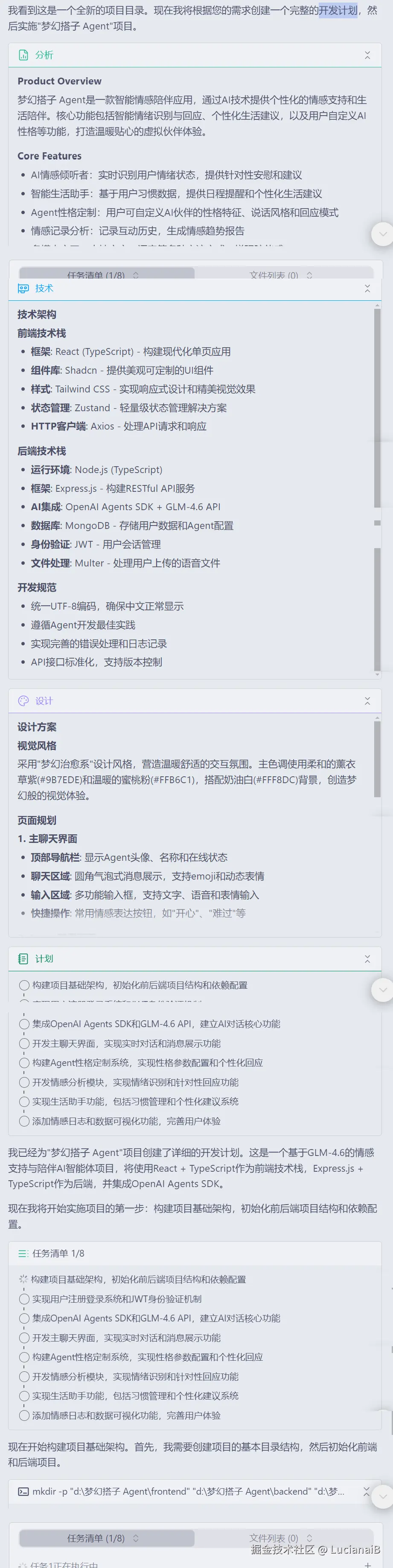

根据 用户故事 和提供的 生成GLM-4.6接口 制作梦幻搭子 Agent,以及相关注意点先是设计了一个开发计划,通过分析 -> 技术 -> 设计 -> 计划一整个流程先确定前期需求,然后就开始了开发。

然后就是漫长的等待了,摸鱼,哈哈哈,问薪无愧,AI酷酷开发中。

第一次设计,从0开始,所以非常的耗时,但是相比较我们从0写代码,可能需要1个礼拜就非常的不错了,我们在这个时间段还可以看看书,放松心情,我是深受AI好处的影响。

第一次设计,从0开始,所以非常的耗时,但是相比较我们从0写代码,可能需要1个礼拜就非常的不错了,我们在这个时间段还可以看看书,放松心情,我是深受AI好处的影响。

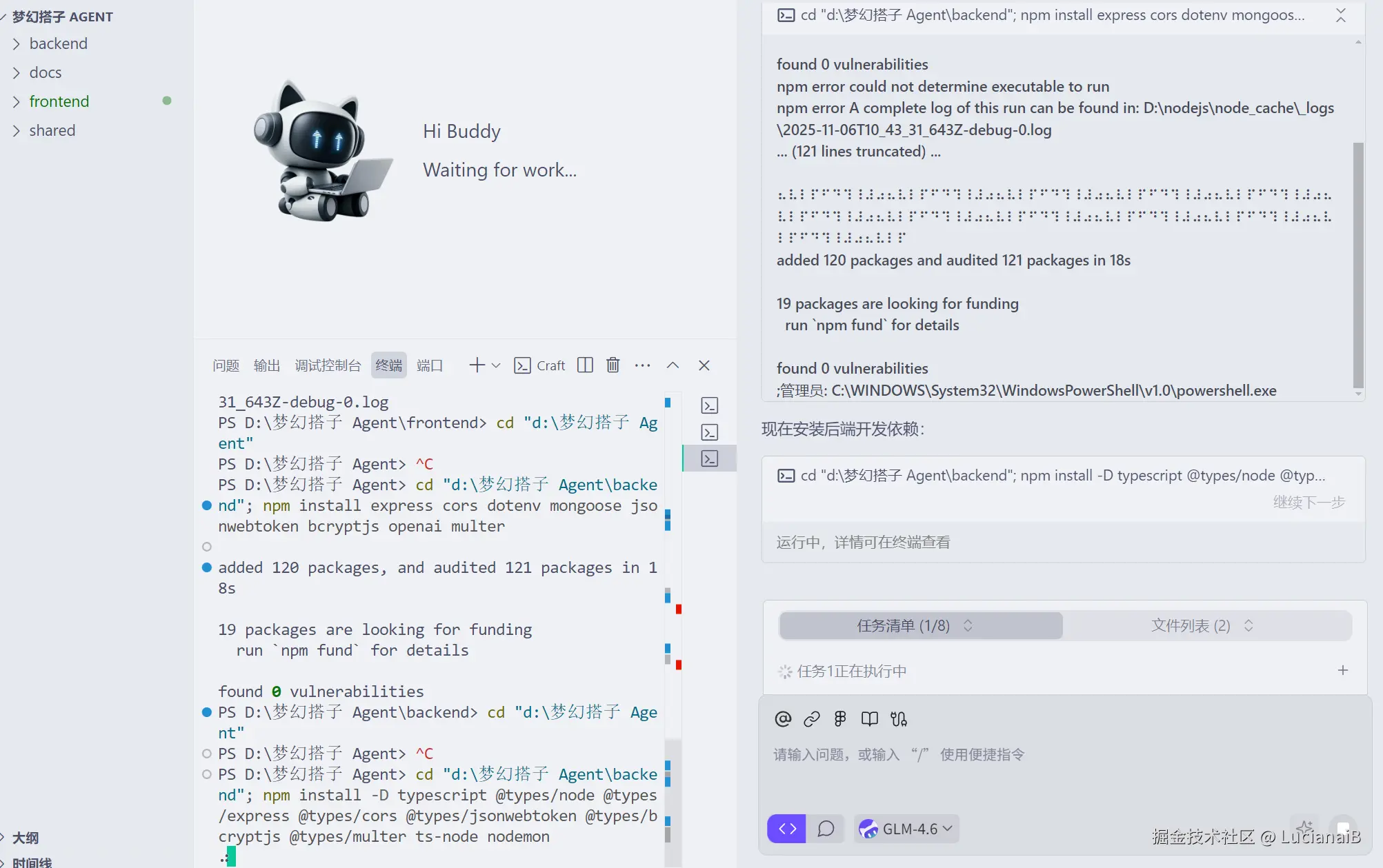

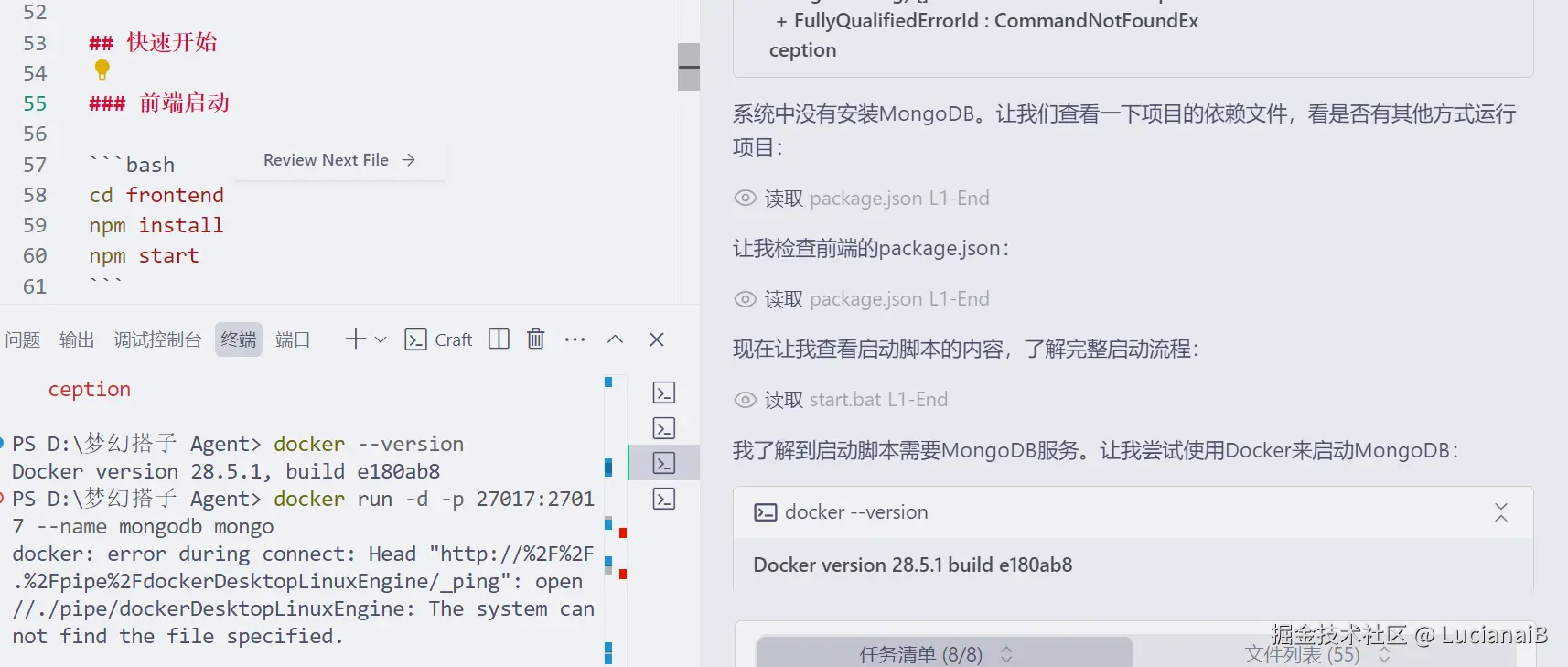

4.2进行一半,不知道如何启动

有时候进行一半,不知道如何启动,不用慌,我们是AI的主人,直接霸气对他说:启动。 AI就帮助我们快速的启动项目了。

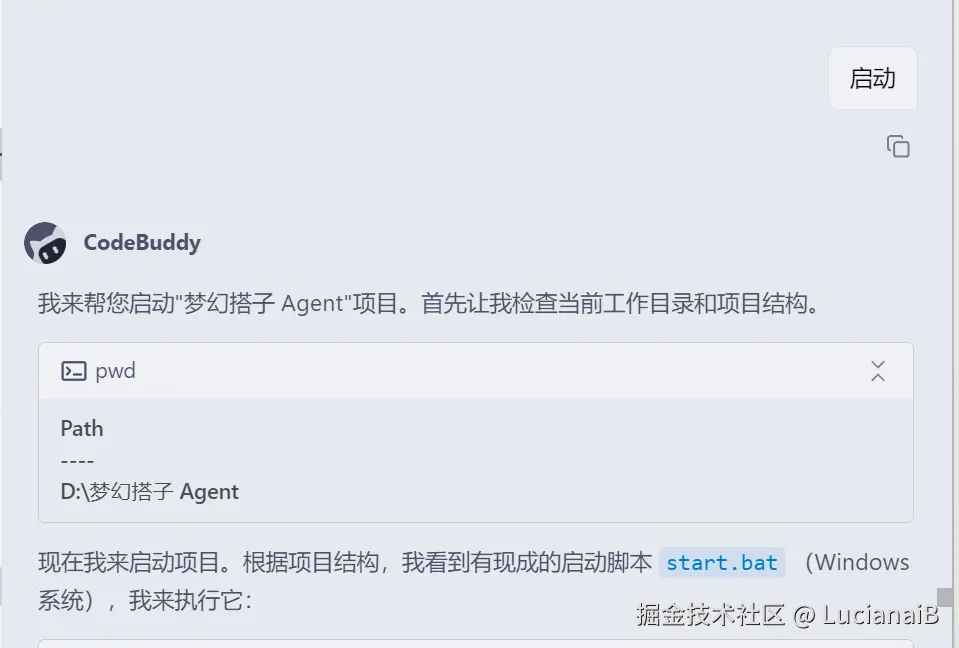

4.3遇到环境错误

在过程中,没有安装MongoDB,会自己找解决办法,尝试使用Docker来平替启动MongoDB。说实话,我都不知道MongoDB是什么,但是AI会全都处理的。

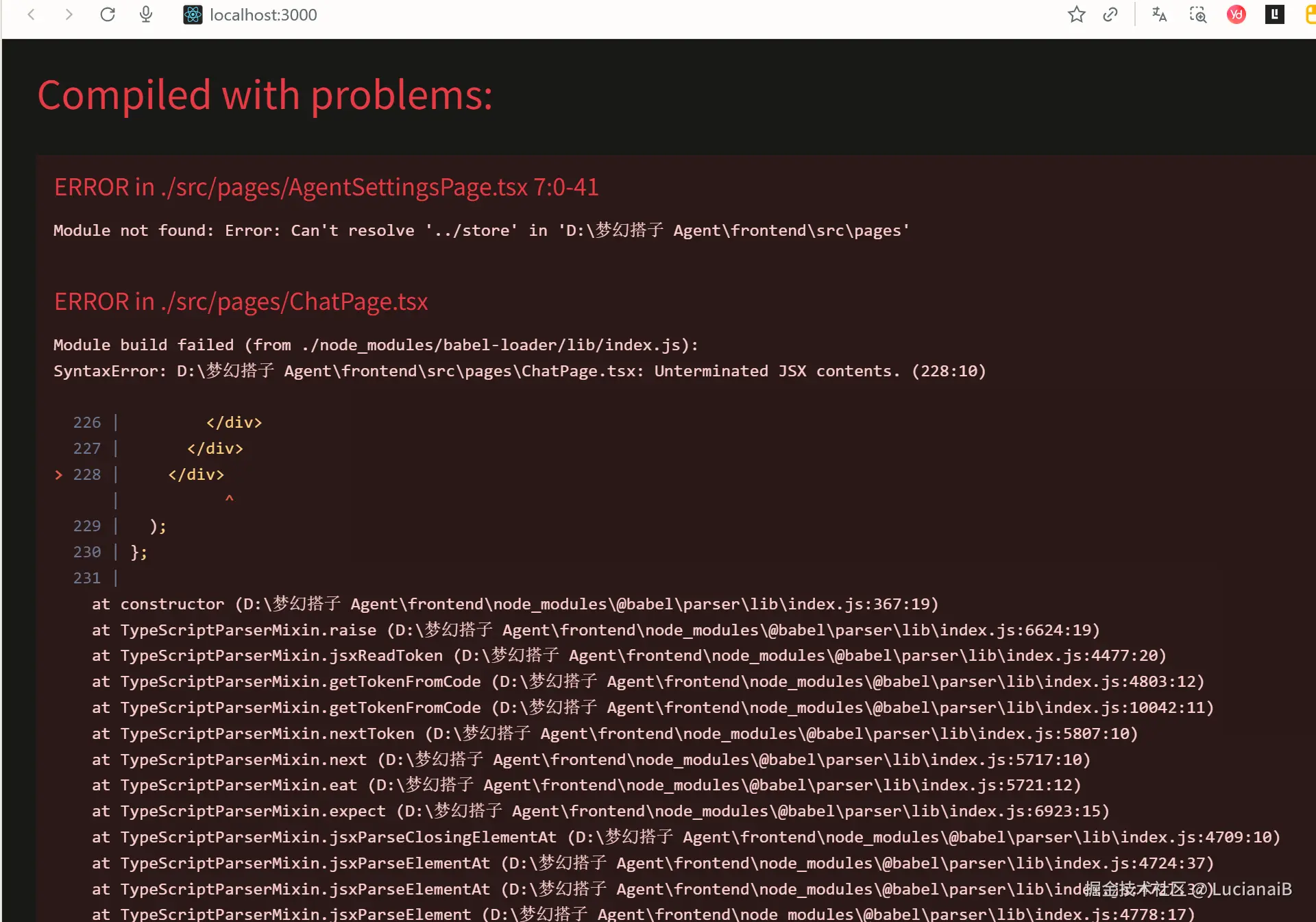

4.4遇到代码错误

依旧我们是AI的主人,直接霸气把报错以及要求对他说:

less

在http://localhost:3000/,显示Compiled with problems:

×

ERROR in ./src/pages/AgentSettingsPage.tsx 7:0-41

Module not found: Error: Can't resolve '../store' in 'D:\梦幻搭子 Agent\frontend\src\pages'

ERROR in ./src/pages/ChatPage.tsx

Module build failed (from ./node_modules/babel-loader/lib/index.js):

SyntaxError: D:\梦幻搭子 Agent\frontend\src\pages\ChatPage.tsx: Unterminated JSX contents. (228:10)

226 | </div> 227 | </div>> 228 | </div> | ^ 229 | ); 230 | }; 231 |

at constructor (D:\梦幻搭子 Agent\frontend\node_modules\@babel\parser\lib\index.js:367:19)

at TypeScriptParserMixin.raise (D:\梦幻搭子 Agent\frontend\node_modules\@babel\parser\lib\index.js:6624:19)

at TypeScriptParserMixin.jsxReadToken (D:\梦幻搭子 Agent\frontend\node_modules\@babel\parser\lib\index.js:4477:20)

at TypeScriptParserMixin.getTokenFromCode (D:\梦幻搭子 Agent\frontend\node_modules\@babel\parser\lib\index.js:4803:12)

at TypeScriptParserMixin.getTokenFromCode (D:\梦幻搭子 Agent\frontend\node_modules\@babel\parser\lib\index.js:10042:11)

at TypeScriptParserMixin.nextToken (D:\梦幻搭子 Agent\frontend\node_modules\@babel\parser\lib\index.js:5807:10)

at TypeScriptParserMixin.next (D:\梦幻搭子 Agent\frontend\node_modules\@babel\parser\lib\index.js:5717:10)

at TypeScriptParserMixin.eat (D:\梦幻搭子 Agent\frontend\node_modules\@babel\parser\lib\index.js:5721:12)同时把报错的截图也扔给他。

4.5完美启动运行

我们直接对话说:有点无聊啊 他就会以一个温柔体贴的身份陪伴,关键是开头抱抱,这个真的很模拟人。  在后台设置可自定义性格等

在后台设置可自定义性格等

5.总结

本次实践成功地将CodeBuddy的快速开发能力与GLM-4.6的强大语言模型相结合,实现了"梦幻搭子Agent"的原型开发。整个过程充分体现了AI作为开发助手的巨大潜力:从模糊的需求到可运行的代码,AI承担了大部分繁重的编码和调试工作,开发者只需专注于核心逻辑和用户体验的设计。 "用AI对抗AI,用技术反哺成长"的理念在此次实践中得到了很好的体现。我们利用强大的AI工具来构建更能服务于人的AI应用,这本身就是一种技术的正向循环。 正如文章开头所言,"AI的出现,让我们只需说明想法,让它去干活即可------就像一个产品经理,手下有人干活。" CodeBuddy + GLM-4.6 的组合,正是这一理念的完美诠释。它们为开发者提供了一个强大的"梦工厂",让创意能够更快速、更高效地转化为现实。未来,随着AI技术的不断进步和生态的日益完善,我们有理由相信,像"梦幻搭子Agent"这样的应用将变得更加智能、更加普及,成为我们生活中不可或缺的一部分。