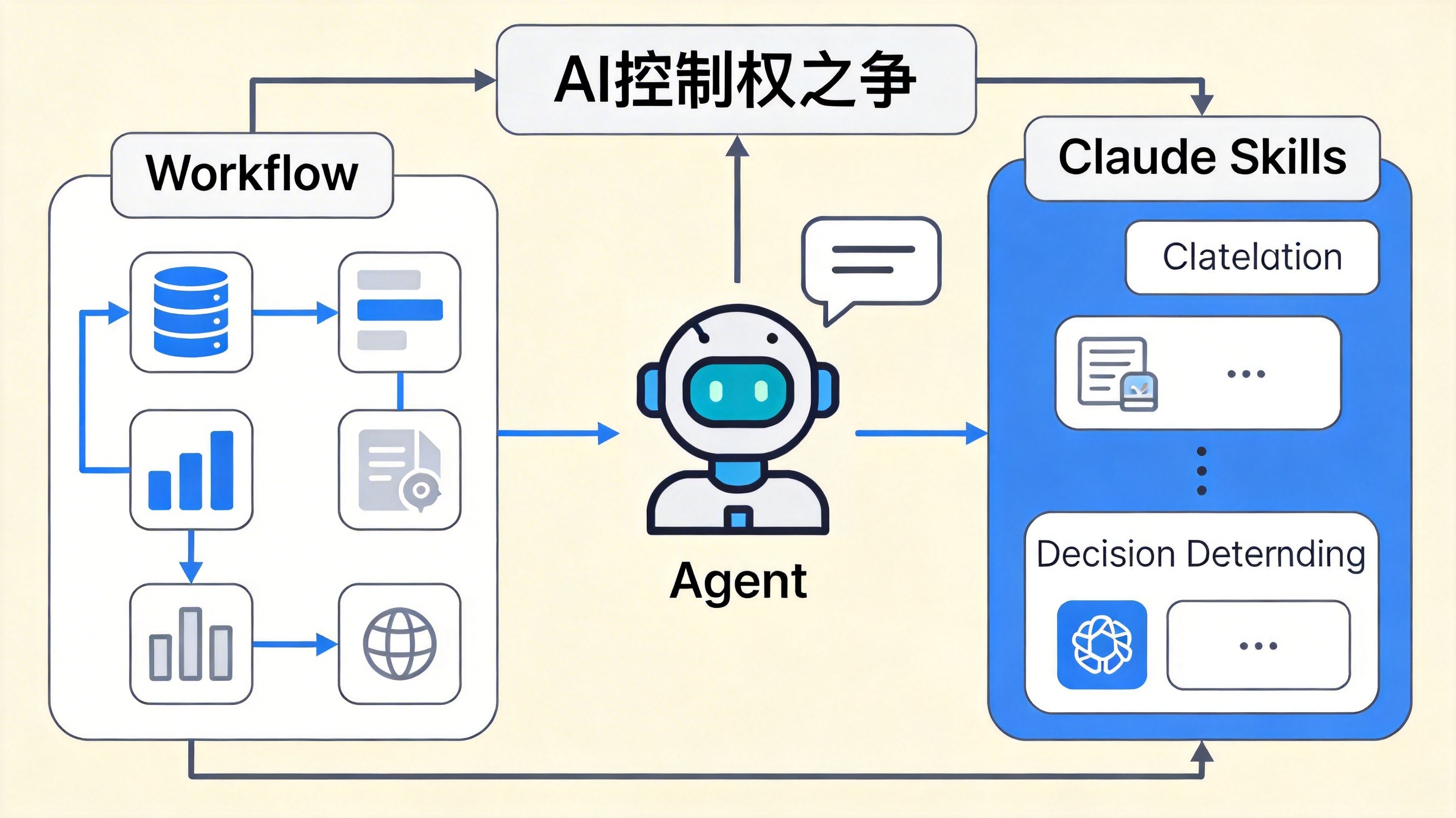

导读:本文作为《LLM进化史》三部曲终章,让我们看穿AI世界层出不穷的新概念背后的真正本质------所有技术演进,其实都是围绕"谁来决定AI的行为"这一核心问题展开的控制权之争。

一、AI圈最大的幻觉:每天都在诞生新技术

图:AI控制权之争的核心概念示意图

如果在AI圈待过一年,大概率会产生一种错觉:每天都有革命性新概念诞生。Workflow、Agent、Tool、Function Calling、MCP、Skills......名字越来越科幻,架构图越来越像星际飞船。

但这些看似眼花缭乱的概念,其实都在解决同一个问题:下一步该做什么,到底谁说了算?

这,就是Agent世界的真正核心矛盾:👉 控制权之争

就像公司里的项目决策,到底是老板拍板、部门经理定夺,还是一线员工自主决定?AI世界的技术演进,本质上就是在不断重新定义这个"决策权限"。

二、最初的世界:人类拥有绝对控制权

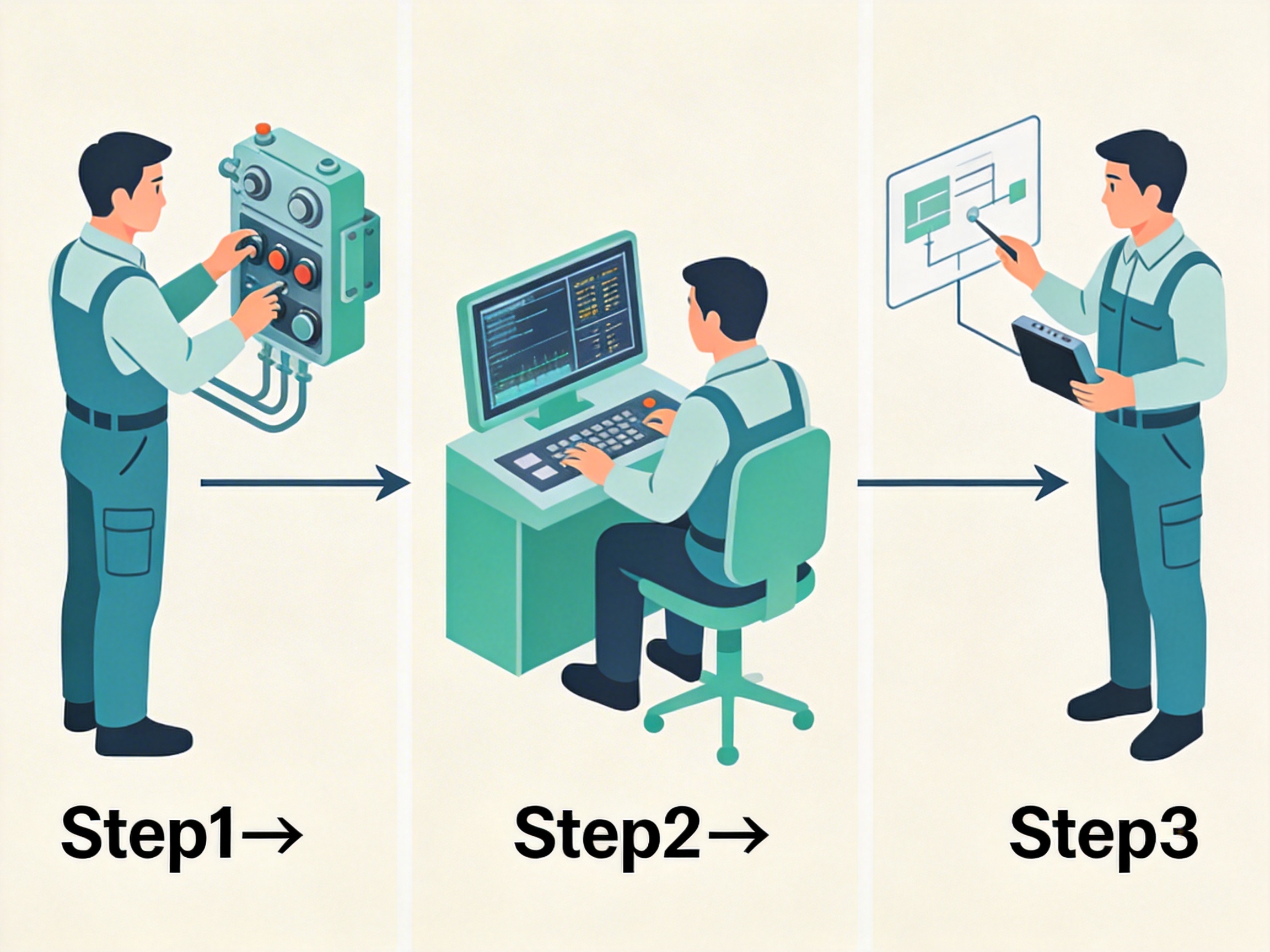

图:早期Workflow时代人类绝对控制流程模式

在AI诞生之前,软件世界规则极其简单:程序员写死流程,机器无条件执行。Step1 → Step2 → Step3,这就是最早形态:Workflow 。

本质一句话:人类完全掌控流程,机器只负责执行 。就像工厂里的流水线,每一步都提前设计好,工人只需按部就班操作。

例如一个自动化任务:读取PDF → 提取文本 → 调用翻译API → 保存Markdown。所有分支都提前写死:if PDF → 用解析器A;if Word → 用解析器B。

这个时代的特点:

● 极度稳定

● 完全可预测

● 没有任何"智能"

但有一个致命缺陷:❌ 无法处理模糊需求 。只要任务稍微复杂一点,比如用户输入不规范、文档格式多样、执行路径不固定,Workflow就会像精密钟表掉进沙堆一样彻底停摆。因为它的前提是:流程必须提前确定 。

于是问题出现了:如果流程无法写死,该怎么办?控制权第一次开始动摇。

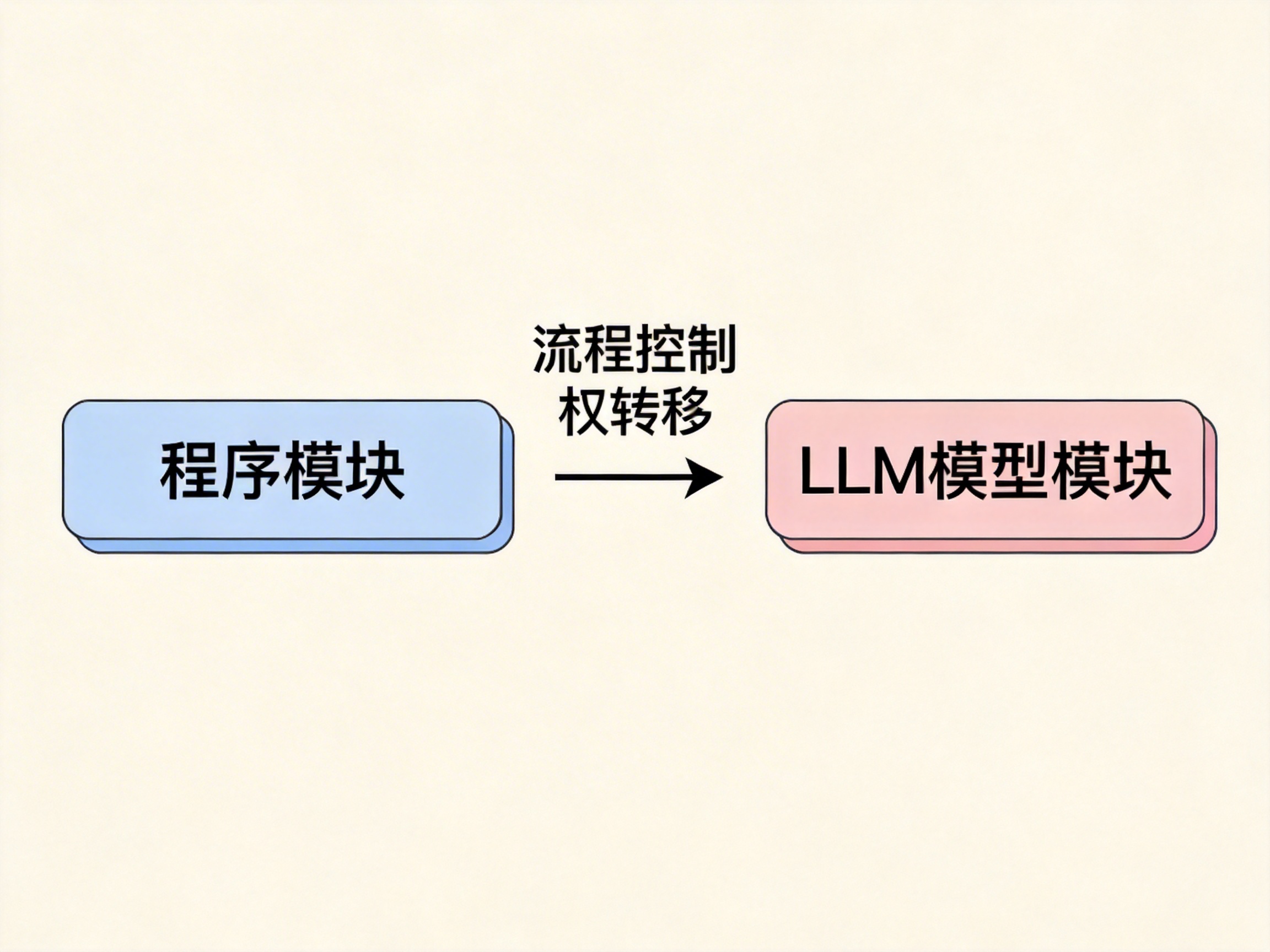

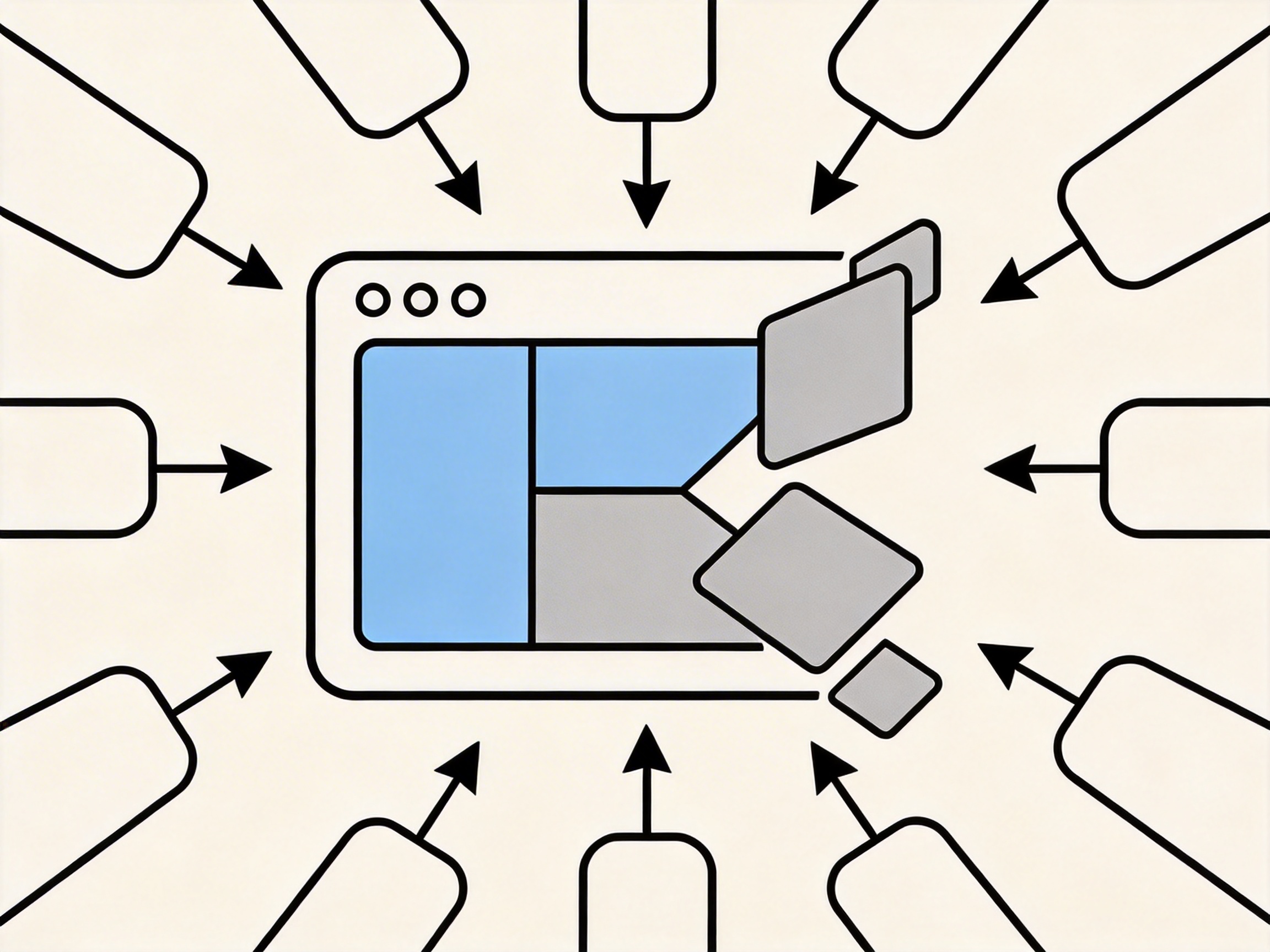

三、第一次权力转移:流程控制权交给模型

图:第一次权力转移:流程控制权从程序到模型

随着LLM出现,人类突然发现一件惊人的事情:模型居然能理解需求。也就是说,它可以决定下一步该做什么。这意味着:👉 流程控制权开始从程序转移到模型 。

Agent就这样诞生了。新的架构变成:人类 → Agent → LLM → Tool。模型开始负责:

● 判断任务类型

● 决定调用什么工具

● 规划执行顺序

这一刻,控制权发生第一次转移:程序 → 模型 。就像公司老板开始授权部门经理自主决策项目流程,不再事无巨细地干预每一步。

听起来很美好,但很快问题就来了。

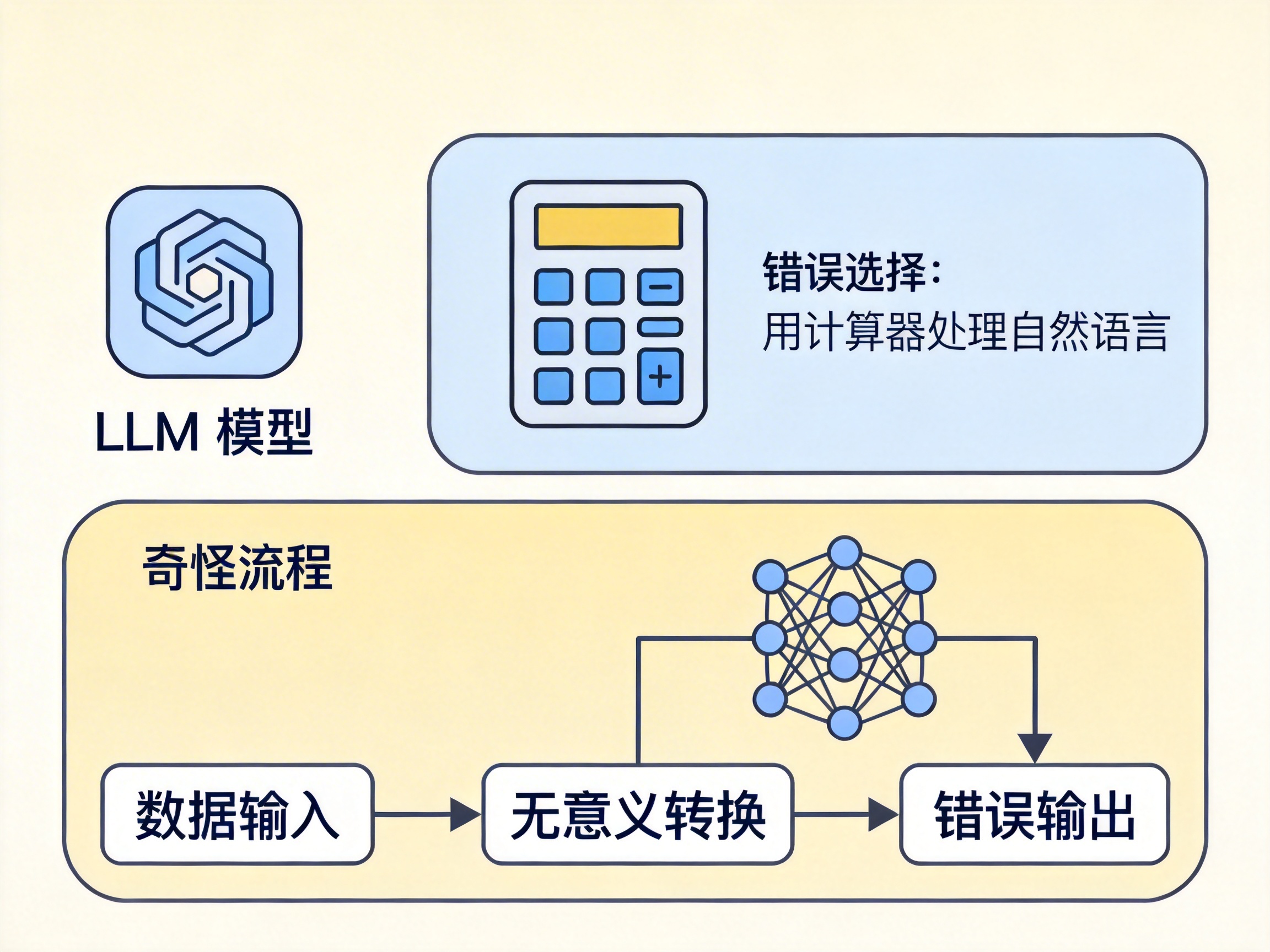

四、失控的世界:模型太"自由"了

图:模型失控场景示意图

当流程控制权交给LLM后,人类立刻发现:事情开始变得不可控。模型可能会:

● 选择错误工具

● 设计奇怪流程

● 写出毫无必要的复杂步骤

● 把简单问题变成史诗级任务

一句话总结:模型太聪明,但也太不稳定 。就像授权给了一个才华横溢但缺乏经验的经理,有时候能做出惊艳的决策,有时候却会把项目带向奇怪的方向。

于是人类又试图夺回部分控制权。就像老板发现经理决策过于随意,开始制定一些基本规则来规范决策过程。

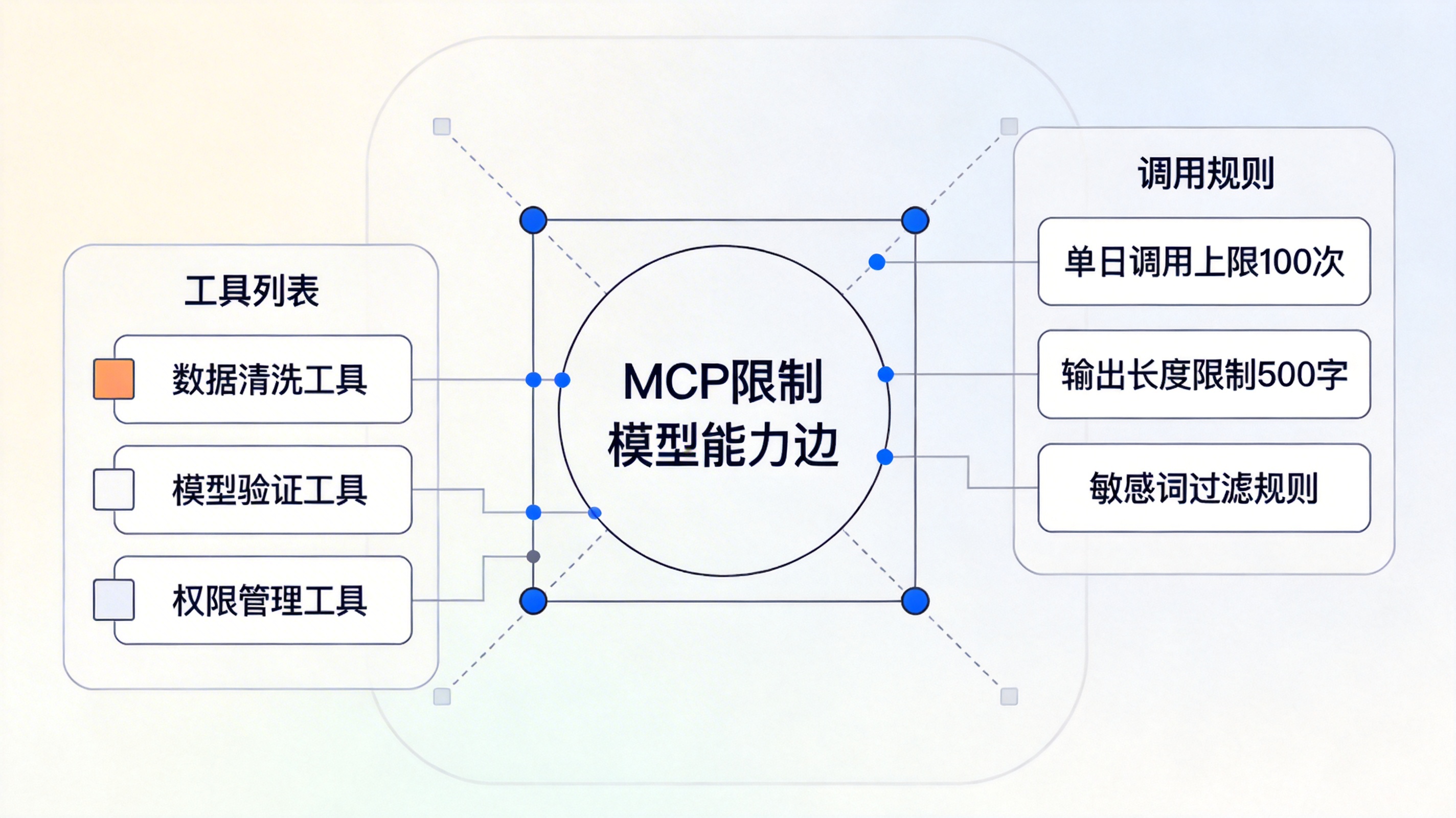

五、MCP:限制模型的"能力边界"

图:MCP限制模型能力边界原理示意图

MCP经常被误解为"工具协议",但它真正解决的问题其实是:模型能触达的世界边界在哪里?

MCP规定:

● 有哪些工具存在

● 如何调用

● 能传什么参数

● 返回什么结构

所以它控制的不是流程,而是:👉 模型"能做什么"

换句话说:Workflow控制怎么做 ,MCP控制能做什么 。这是控制权的第二次博弈:人类放弃流程控制权,但保住能力控制权 。

就像老板不再干预经理的具体决策流程,但会明确规定:我们可以调动哪些资源,不能动用哪些预算,决策范围必须在这些边界之内。

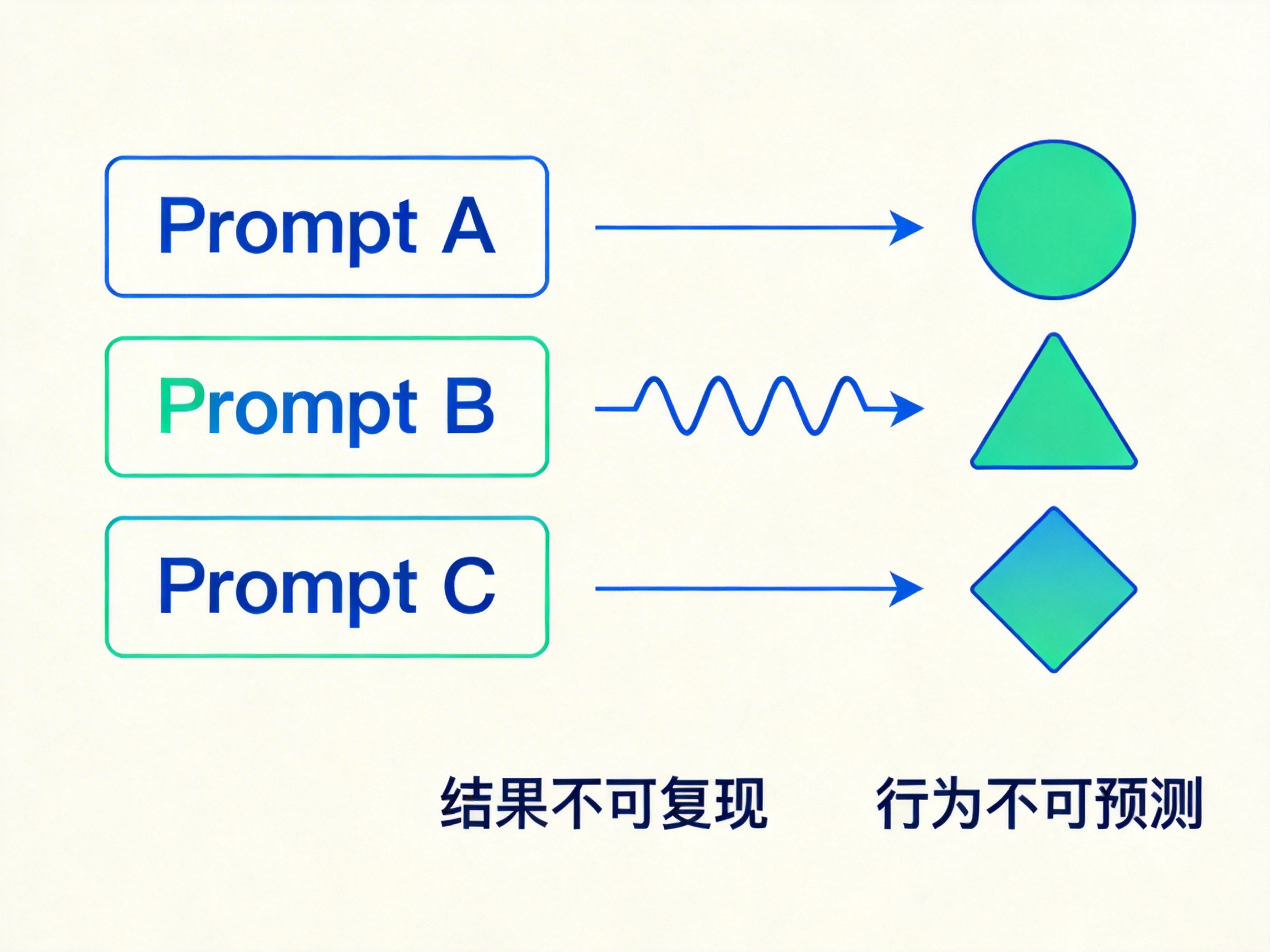

六、但真正的问题还没解决:执行的不确定性

图:Prompt层不确定性带来的问题示意图

即便有了MCP,一个核心问题仍然存在:模型的执行行为依然不稳定。原因很简单:在早期Agent体系中,执行逻辑往往写在Prompt里。

这导致:

● 结果不可复现

● 行为不可预测

● 依赖提示词技巧

本质问题是:❌ 不确定性集中在Prompt层 。就像经理虽然有明确的权限边界,但具体怎么决策全凭个人经验和喜好,同样的问题不同时间可能会做出完全不同的决定。

于是下一阶段的进化出现了。

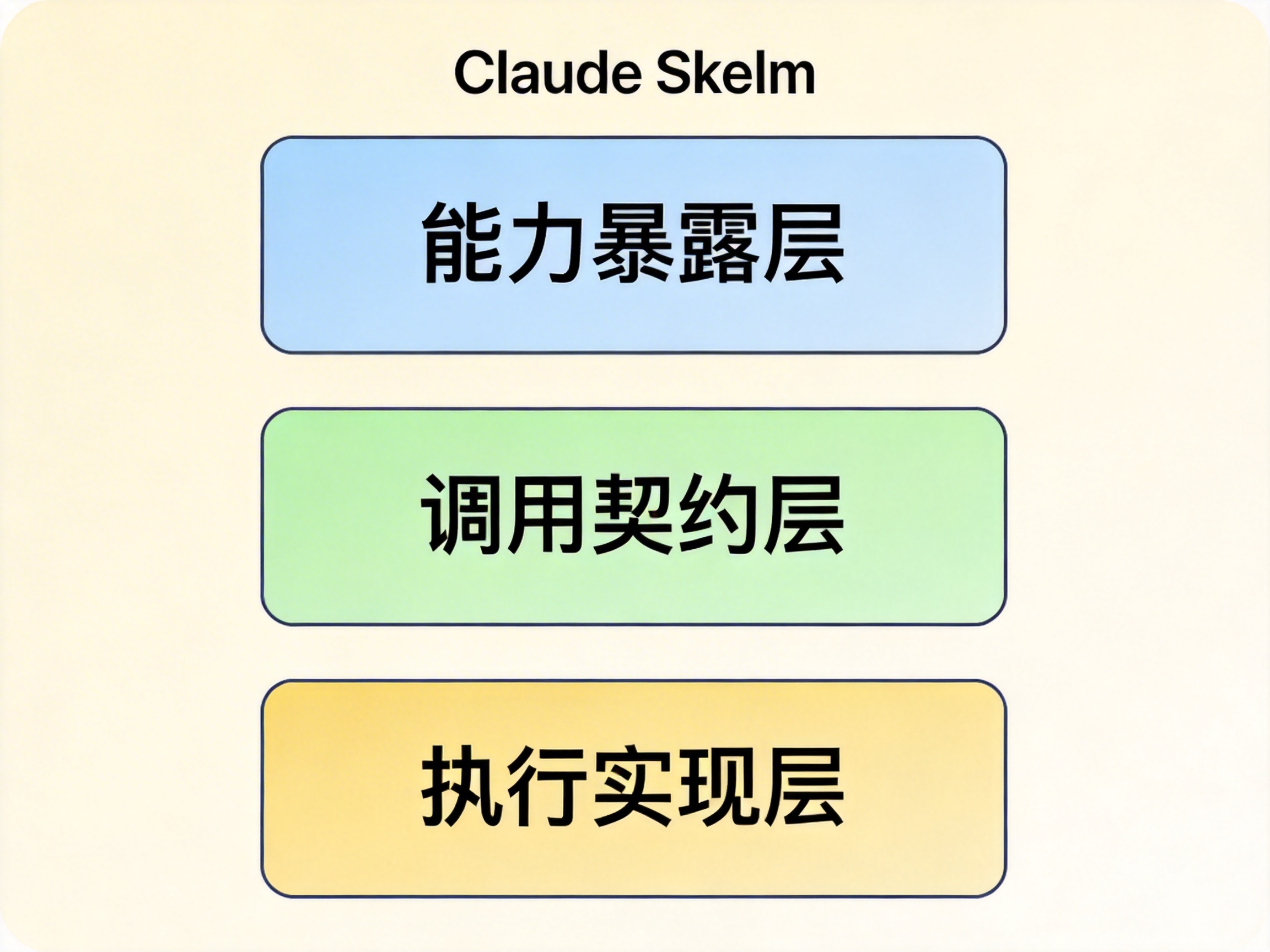

七、Claude Skills:把不确定性从Prompt中剥离

图:Claude Skills的三层结构示意图

Claude Skills的出现,并不是为了增强智能。它解决的是一个更工程化的问题:如何让模型的决策,变成稳定可复现的执行行为?

Skills的本质不是工具,也不是简单上下文。它是一种:👉 执行契约

一个Skill包含三层结构:

1️⃣ 能力暴露层 :告诉模型我有哪些能力,适用于什么场景

2️⃣ 调用契约层 :明确输入结构、输出结构、调用规则

3️⃣ 执行实现层 :提供确定性代码、可校验结果、稳定执行逻辑

本质一句话:LLM负责决策,Skill负责确定性执行 。就像公司制定了标准化的操作流程,经理只需做决策"要不要做",而具体"怎么做"则完全按照标准化流程执行,确保结果稳定可预测。

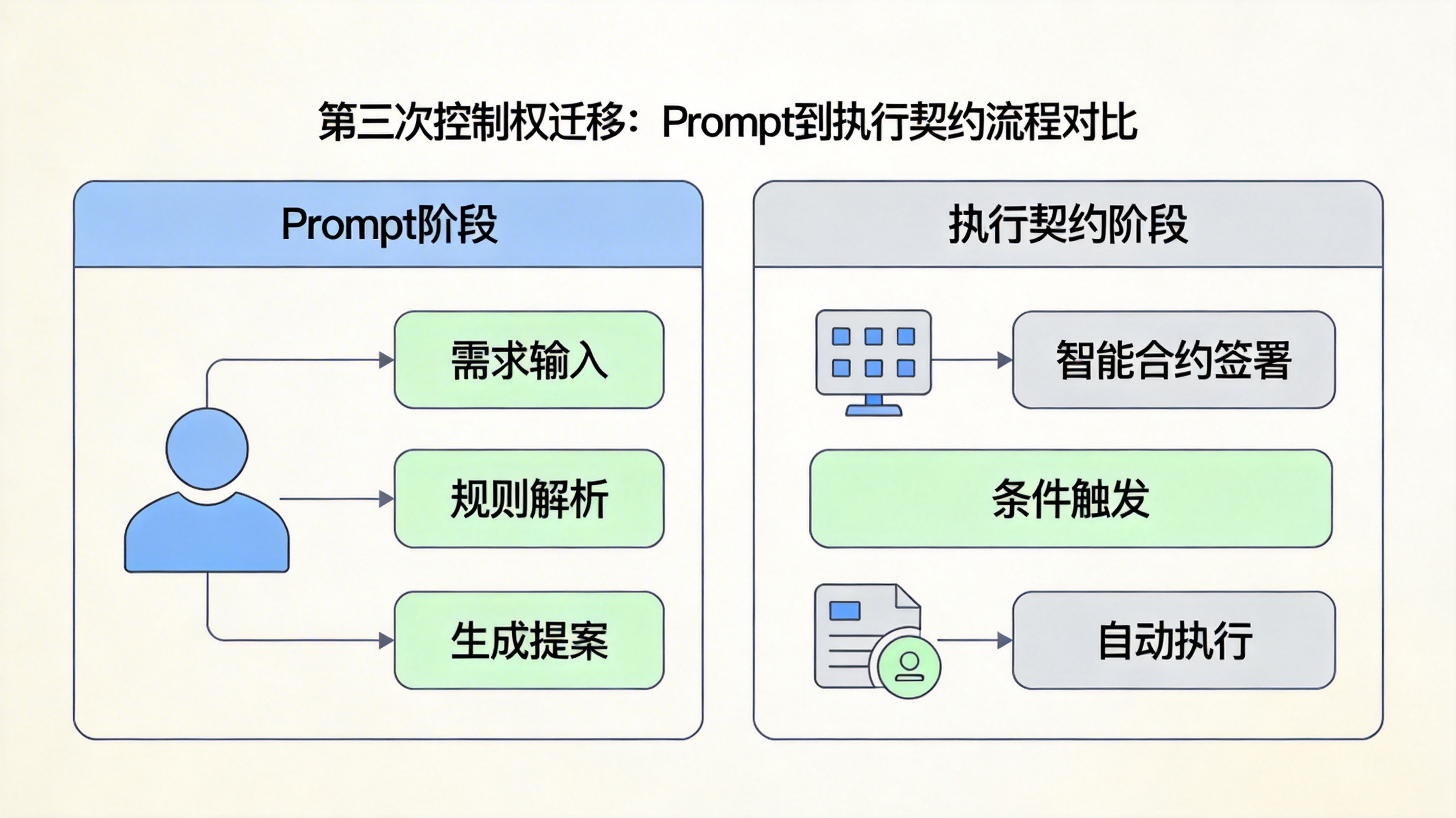

八、控制权的第三次迁移:从Prompt到契约

图:第三次控制权迁移对比图

在没有Skills时:Prompt决定执行逻辑

引入Skills后:LLM决策 → Skill执行

控制权发生第三次转移:Prompt → 执行契约

也就是说:不确定性被拆分:

● 语义不确定性 → 模型负责

● 执行确定性 → Skill负责

这才是Skills的真正革命意义。就像公司把决策和执行彻底分离:经理只需要决定"做什么",而"怎么做"则由标准化的流程和团队负责,既保留了决策的灵活性,又确保了执行的稳定性。

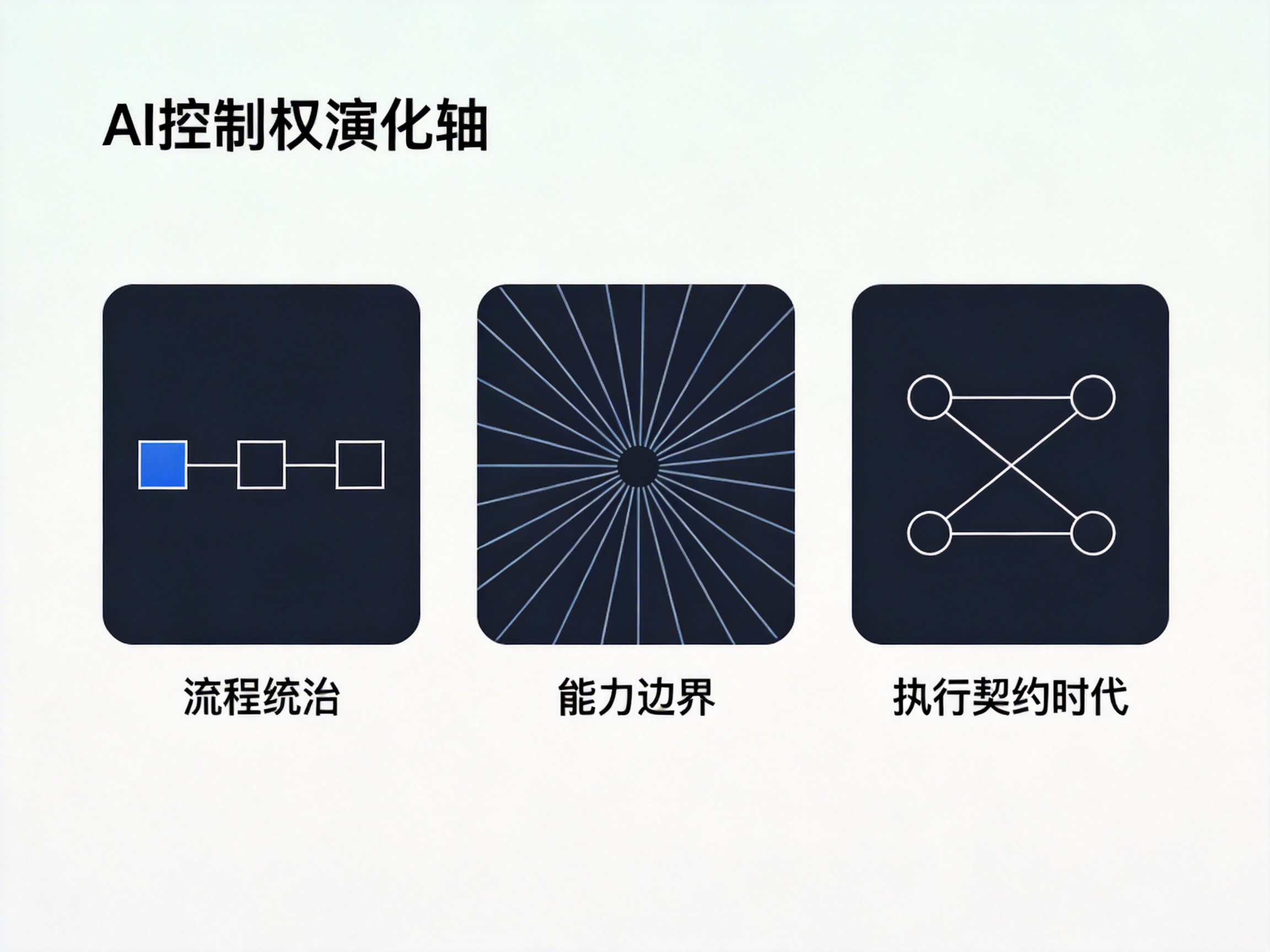

九、重新审视整个演化轴

图:AI控制权演化轴的三个阶段示意图

现在我们可以用一条清晰的控制权进化线来总结:

第一阶段:流程统治时代

- 控制权属于:程序

- 代表技术:Workflow

- 特点:稳定、刚性、无智能

第二阶段:能力边界时代

- 控制权属于:接口与协议

- 代表技术:MCP / Tools

- 特点:模型决定流程,人类限定能力范围

第三阶段:执行契约时代(正在发生)

- 控制权属于:能力契约设计者

- 代表技术:Claude Skills

- 特点:模型负责决策,契约保证执行稳定

就像公司管理模式的进化:从创始人一言堂,到授权管理加边界限制,再到标准化流程加灵活决策。

十、真正的结论

图:AI技术发展本质示意图

到这里我们应该能看清一个事实:AI技术的发展,并不是在不断增强智能,而是在不断回答一个问题:谁来控制不确定性?

答案经历三次转移:程序 → 接口 → 契约

本质上:所有新技术,都在做同一件事:把不可控的部分,从系统中剥离出来。

就像不断优化的公司管理体系,核心都是在减少不确定性,让组织既能保持灵活性,又能确保稳定运行。

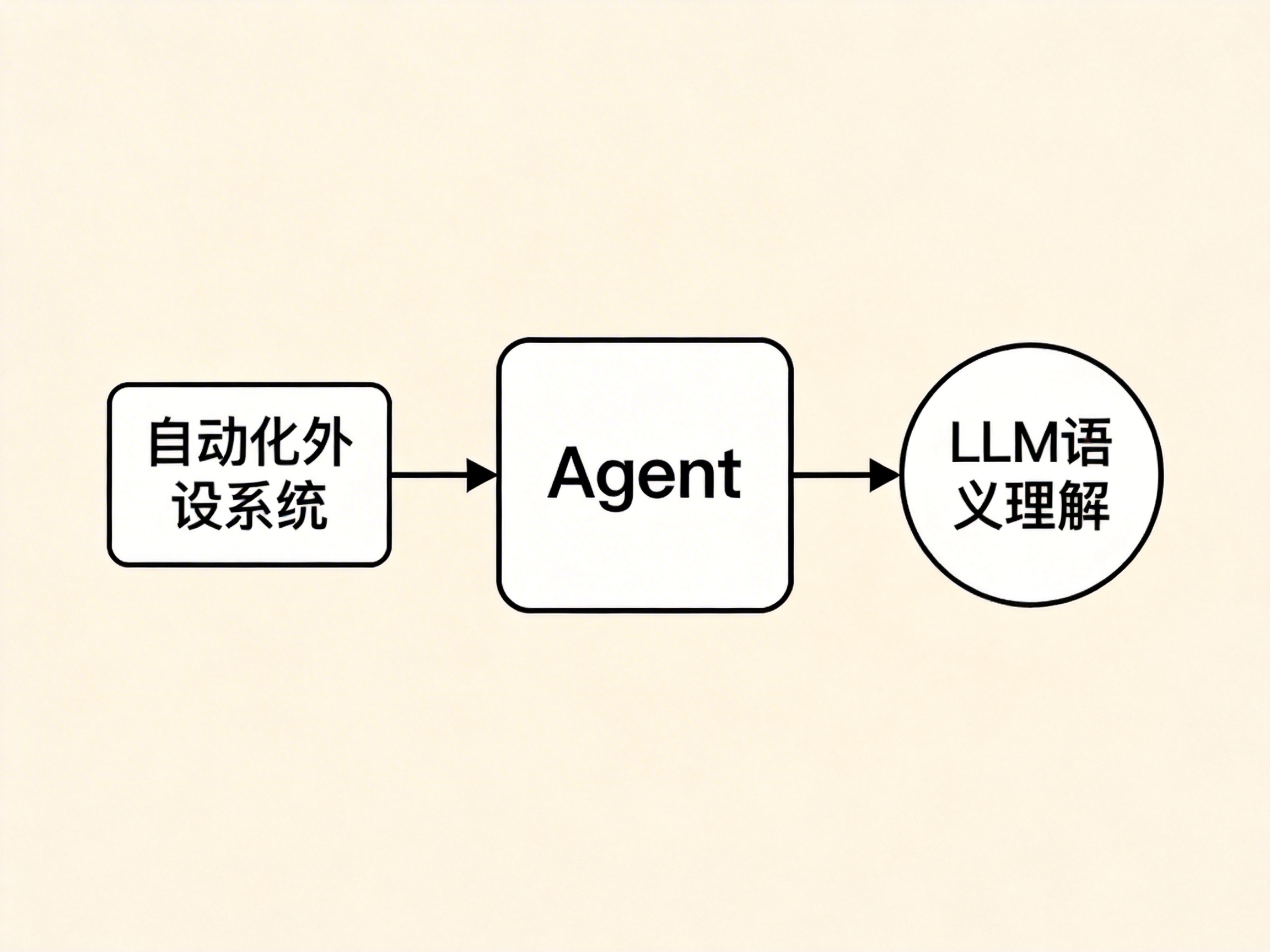

十一、这也是为什么前两篇一直强调一句话

图:Agent本质示意图

现在我们应该能彻底理解这句话:Agent是所有不需要智能的部分 。

因为真正的智能始终只有一个地方:对语言与语义的理解 。而Workflow、MCP、Skills,本质都是在做同一件事:帮助我们控制不确定性 。

就像公司里真正需要"智能"的是高层战略决策,而大部分执行工作都应该标准化、流程化,减少不确定性,提高效率。

十二、未来趋势:Skills也不会是终点

图:AI未来趋势示意图

Skills并不是终极形态,它只是AI进入"执行契约时代"的阶段性产物。未来趋势其实非常清晰:

● 能力契约会内化进模型生态 :就像操作系统会内置各种标准API,未来的AI模型会默认集成各种常用能力契约

● 配置会被完全隐藏 :用户不需要了解复杂的配置细节,就像我们现在不需要知道手机底层的技术细节一样

● 用户只需要表达意图 :用户只需说"帮我整理这份报告",而不需要说明具体怎么整理

最终形态可能是:一个默认拥有完整执行能力体系的超级Agent 。人类只负责提需求,系统自动完成一切。就像拥有一个全能助手,我们只需要说"我要开个生日派对",它会自动完成场地布置、邀请嘉宾、安排餐饮等所有细节。

十三、三部曲终章总结

图:《LLM进化史》三部曲核心结论示意图

第一篇我们拆掉神话:

LLM不是智能,而是概率预测机器。它并不理解语言,只是根据统计规律生成最可能的下一个词。

第二篇我们拆掉架构幻觉:

Agent只是自动化外设系统。它本身没有智能,只是连接LLM和外部工具的桥梁。

第三篇我们揭示终极本质:

所有AI技术的演进,其实都是一场控制权之争。从Workflow到Claude Skills,所有技术都在回答同一个问题:到底谁来决定AI的行为?

总结

📌 核心要点:

- AI技术的发展本质上是围绕"谁来控制不确定性"的持续演化

- 控制权经历三次典型转移:程序 → 接口 → 执行契约

- Workflow控制流程,MCP控制能力边界,Skills控制执行稳定性

- LLM负责决策与语义理解,Skill负责确定性执行与结果可靠性

- Skills并非终极形态,而是AI进入"执行契约时代"的阶段性产物