我在业余时间开发了一款自己的独立产品:升讯威在线客服与营销系统。陆陆续续开发了几年,从一开始的偶有用户尝试,到如今线上环境和私有化部署均有了越来越多的稳定用户,在这个过程中,我也在不断的提高着自己的技术广度和深度。

先看一个数据:Docker 仓库的拉取量。从 0 到 1k 我几乎用了三年(三年啊!你知道我是怎么过的嘛😂),而从 1k 到 2k 我用了大约一年,从 2k 到今天(2026/3/25)的 2.8k,只用了几个月。

仓库地址,可以免费拉取使用:https://hub.docker.com/r/iccb1013/linkup

在这几年的开发中,我一直不断的通过博客记录着开发过程和自己的感悟,有产品设计方面的,运营方面的,但最多的还是技术方面的。最近有朋友和我交流高频消息分发方面的技术问题,我想着那就再写一篇,写一篇有深度的,不去讲那些 lock 或 SemaphoreSlim 这种人人都知道的方案,而是讲一讲我在高性能部分使用的 SpinWait 自旋等待结构体。

一、 引言:别再让你的 CPU 浪费在"休息"上

如果你的系统并发量只有几百 TPS,那么 lock 或 SemaphoreSlim 可能是你最好的朋友。它们简单、稳健,像极了朝九晚五的打工人。但当流量开始成倍翻滚,当你的服务端需要每秒处理数万次的消息路由和访客追踪时,你就会发现,这些看似可靠的同步原语,正在成为系统的"隐形杀手"。

这种痛,只有做底层架构的人才懂。

你盯着性能监控,发现 CPU 占用率并不高,但吞吐量就是上不去。打开 PerfView 一看,到处都是密密麻麻的 Context Switch(上下文切换)。这时候你才意识到,线程们并不是在干活,而是在频繁地"睡觉"和"醒来"之间反复横跳。

在 .NET 的世界里,一个线程进入 Kernel Mode(内核模式)挂起,再被唤醒,这中间的开销大约是几千个 CPU 周期。对于微秒级的内存操作来说,这简直是慢得令人发指的"远途旅行"。

于是,我们开始把目光投向那些被绝大多数开发者忽略的"禁区"------比如 System.Threading.SpinWait。

在开发 升讯威在线客服与营销系统 的底层服务端时,我曾面临一个非常棘手的抉择:如何在一个高频变动的内存状态机中,既保证线程安全,又不引入昂贵的内核切换开销?

为了实现极致的低延迟,我们不得不撕开 C# 平滑的表象,去和底层的 CPU 指令集肉搏。

SpinWait 并不是一个简单的死循环,它是一种"极其聪明"的妥协艺术。它让线程在发现资源被占用时,先不急着去睡觉,而是原地"自旋"一会儿。这就像你在家门口发现电梯还没来,你不会立刻回屋睡觉,而是先在电梯口站 30 秒------因为你知道,电梯可能马上就到。

在这篇文章里,我不打算聊那些满大街都能搜到的 Task.Run,我想聊聊如何利用 SpinWait、Interlocked 以及那些被埋没的底层优化技巧,去构建一个真正能抗住工业级高并发挑战的系统架构。

二、 深入内核:自旋锁(SpinWait)与内核锁的生死时速

在 .NET 开发中,大多数人对并发控制的认知停留在 lock 关键字。确实,lock 很好用,它背后是 Monitor。但你有没有想过,当你写下 lock(obj) 的那一刻,操作系统底层发生了什么?

1. 内核切换的"天价"账单

当线程 A 持有锁,线程 B 尝试获取锁失败时,线程 B 会进入 WaitSleepJoin 状态。这时,操作系统内核(Kernel)会介入,执行一次重大的手术:上下文切换(Context Switch)。

- 内核需要保存当前线程 B 的寄存器状态、堆栈指针。

- 将线程 B 移出 CPU 运行队列,放入等待队列。

- 调度另一个线程进入 CPU。

- 等到线程 A 释放锁,内核再反向操作一遍,把线程 B 唤醒。

这一来一回,几千个 CPU 周期就没了。如果你在处理 升讯威在线客服与营销系统 这种每秒需要交换数万条实时消息的系统,这种切换开销会像滚雪球一样,最终导致你的服务器响应延迟从微秒级(\\mu s)直接跌落到毫秒级(ms)。

2. SpinWait:不睡觉的艺术

SpinWait 的逻辑完全不同。它在发现锁被占用时,会对着 CPU 喊:"先别让路,我再等一会儿,说不定马上就好了!"

它不仅仅是一个简单的 while(true)。如果你真的写个死循环,那叫"忙等",会瞬间烧干一个 CPU 核心。SpinWait 之所以被称为"工业级"方案,是因为它内置了一个极其复杂的指数退避策略:

- 前 10 次自旋: 调用

Thread.SpinWait。这只是几条普通的 CPU 指令(如 x86 上的PAUSE指令),它告诉 CPU 稍微停顿一下,降低功耗,但线程依然留在 CPU 上,随时准备起跑。 - 第 10 次之后: 它开始调用

Thread.Yield()或Thread.Sleep(0)。这时候它会礼貌地问操作系统:"有没有其他跟我优先级一样的线程要干活?有的话你先来,没有我继续转。" - 最后阶段: 如果转了很久(通常是几千次)还是拿不到锁,它才会彻底放弃,进入内核模式挂起。

这就是典型的**"先礼后兵"** 。在 升讯威在线客服与营销系统 的核心路由调度算法中,99% 的竞争都能在自旋阶段解决,从而完美规避了内核切换的昂贵账单。

3. 性能实测:数据从不撒谎

为了验证这种"偏执"是否有意义,我们做了一组对比测试。在一个高竞争的计数器场景下,分别使用 lock 和 SpinWait + Interlocked:

csharp

// 方案 A:传统 Lock (内核模式)

lock (_syncRoot) { _count++; }

// 方案 B:SpinWait + CAS (用户模式自旋)

var spinner = new SpinWait();

while (Interlocked.CompareExchange(ref _isLocked, 1, 0) != 0)

{

spinner.SpinOnce();

}

_count++;

_isLocked = 0;在 32 线程并发压测下,方案 B 的吞吐量通常是方案 A 的 5-10 倍。更重要的是,方案 B 的延迟分布非常平滑,不会出现那种偶尔掉队几十毫秒的"长尾效应"。

4. 为什么升讯威在线客服与营销系统如此在意这 1ms?

很多开发者会问:"为了这 1ms 的响应速度,写这么复杂的底层逻辑值得吗?"

我的回答是:在私有化部署场景下,这决定了生与死。

很多客户的服务器并不是高配的云服务器,可能只是几台老旧的物理机或配置极低的虚拟机。如果 升讯威在线客服与营销系统 像普通的 SaaS 软件那样挥霍资源,那么在这些受限环境下,系统会卡顿得像幻灯片。正是因为我们在底层大量运用了 SpinWait、无锁队列(Lock-Free Queue)以及对 Memory<T> 的极致压榨,才让 升讯威在线客服与营销系统 能够以极低的资源消耗,支撑起海量的在线客服并发量。

这不只是技术,这是我们作为独立开发者对"效率"的敬畏。

三、 实战:在升讯威在线客服与营销系统的高频消息路由中压榨每一微秒

如果你觉得 SpinWait 只是实验室里的玩具,那你就大错特错了。在 升讯威在线客服与营销系统 的核心架构中,这种"不入虎穴焉得虎子"的底层优化,正是在处理海量访客实时追踪(Visitor Tracking)和高频消息分发(Message Routing)时的定海神针。

1. 访客轨迹追踪:每秒数万次的"状态更新"挑战

在升讯威在线客服与营销系统中,系统需要实时监控每一个进入页面的访客。他们看了哪个产品?停留了多久?是不是正在输入?这些信息会产生极其密集的内存写入操作。

如果每一个访客的状态更新都去请求一个全局的 lock,那么在高流量并发(比如电商大促)时,你的 CPU 核心会因为互相争抢锁而陷入长达数毫秒的"空转等待"。这对客服系统来说是致命的------访客都已经关掉网页了,你的后台才同步完他的轨迹。

我们的解决方案:

我们为每个访客分配了一个轻量级的状态槽,并配合 SpinWait 实现了一个**"乐观并发控制"**模型。

csharp

// 伪代码:升讯威在线客服与营销系统内部高频状态同步逻辑

public void UpdateVisitorActivity(long visitorId, ActivityData data)

{

var spinner = new SpinWait();

while (true)

{

// 尝试获取该访客的轻量级原子锁(基于 Interlocked)

if (Interlocked.CompareExchange(ref _visitorLock[visitorId], 1, 0) == 0)

{

try

{

// 极速更新内存中的轨迹数据,不涉及任何 I/O

UpdateMemoryState(visitorId, data);

break;

}

finally

{

_visitorLock[visitorId] = 0; // 释放锁

}

}

// 竞争激烈时,通过 SpinWait 进行智能退避

// 这比 Thread.Sleep(1) 快了几个数量级,因为它保持在用户态

spinner.SpinOnce();

// 如果自旋次数过多(极端情况),说明有更重的任务占用了资源

// SpinWait 内部会自动降级到 Yield 或内核挂起,保护 CPU 不会烧掉

}

}2. 消息广播中的"快慢车道"解耦

在线客服系统中最典型的场景是:一个坐席(Agent)可能同时给几百个访客发送广播通知。这时候,消息推送队列(Queue)会面临瞬时的写入峰值。

在 升讯威在线客服与营销系统 的服务端主程序中,我们并没有直接使用简单的 ConcurrentQueue。虽然它也是无锁的,但在极高并发写入时,它的内部链表分配和 CAS 竞争依然有一定的性能损耗。

我们引入了一个基于 环形缓冲区(Ring Buffer) 和 SpinWait 的自定义分发器。生产者(坐席发送消息)和消费者(WebSocket 推送线程)通过一个 volatile 的指针进行同步。当缓冲区暂时写满时,生产者线程会通过 SpinWait 进行纳秒级的自旋转场,而不是立即阻塞。

这种设计的收益非常直观:

在我们的内部压力测试中,单台 4 核 8G 的普通服务器,在开启了这种"自旋辅助"的消息分发机制后,支撑 5 万人同时在线聊天的 CPU 抖动范围缩小了 60% 以上。

3. 为什么不直接用 Channel?

很多 .NET 开发者会问:"System.Threading.Channels 性能也很好,为什么还要折腾这么底层的 SpinWait?"

这就是应用层开发者与底层架构师的区别。 Channel 确实优雅,但它本质上还是一个通用的异步抽象,它会有额外的 ValueTask 创建开销和 StateMachine(状态机)的生命周期管理。

在 升讯威在线客服与营销系统 的核心链路中,我们要的是**"极致的确定性"**。

我们希望在 CPU 处理消息路由时,能尽可能多地停留在 L1/L2 缓存里,尽可能少地发生上下文切换。通过 SpinWait 手工打磨的同步块,能够让指令流在 CPU 流水线中跑得更顺畅。

4. 技术背后的偏执:为了那 0.1% 的性能

说实话,90% 的软件公司可能根本不在乎这 1ms 的延迟。但作为独立开发者,我在打磨 升讯威在线客服与营销系统 时有一种近乎病态的坚持:既然我是做私有化部署的,我就要让客户在最廉价的硬件上,跑出最顶级的流畅度。

这种对 SpinWait、Span<T> 和无锁结构的深入挖掘,本质上是为了给 升讯威在线客服与营销系统 的用户主权提供技术背后的支撑。因为性能足够强,你才不需要被昂贵的云资源租赁费绑架;因为代码足够高效,你的数据才真正属于你自己。

四、 偏执后的冷静:什么时候不该用 SpinWait?

聊了这么多 SpinWait 的黑科技属性,如果我不交代它的阴暗面,那我就是在误导大家。在 升讯威在线客服与营销系统 的开发过程中,我踩过的坑远比我写出的代码要多。

SpinWait 绝对不是万能的"银弹",它是一把没有刀柄的双刃剑。如果你在错误的地方用了它,它不仅不会提升性能,反而会瞬间把你的服务器变成一台"暖风机"。

1. 禁止在 I/O 等待中使用自旋

这是最常见、也最致命的错误。

如果你在等待一个数据库查询返回、或者等待一个网络请求的响应时使用了 SpinWait,那你简直是在犯罪。I/O 操作的延迟通常在毫秒级(ms),而 CPU 的时钟周期是纳秒级(ns)。

想象一下,CPU 每秒可以执行数十亿次指令,你让它在那儿原地转圈等一个慢如蜗牛的硬盘读写?这就像你在火车站等一辆晚点三小时的火车,你却坚持在原地疯狂踏步而不肯坐下来歇会儿。

结论: 凡是涉及 await、网络、磁盘读写的场景,老老实实地用 Task 和 SemaphoreSlim。在这些场景下,上下文切换的那点开销,在长达数毫秒的 I/O 延迟面前根本不值一提。

2. 计算密集型任务的噩梦

如果你的线程正在执行复杂的数学运算、图像处理或大规模数据排序,千万不要在同步块里引入 SpinWait。

自旋的本质是"赌"对方很快就会释放资源。但在计算密集型场景下,占有资源的线程可能正在进行高强度的浮点运算,它短时间内根本停不下来。这时候你再去自旋,只会导致两个线程在同一个物理核心(或竞争总线)上疯狂打架,结果就是两个线程都变得巨慢无比。

3. 单核 CPU 环境下的灾难

这是一个很有趣的底层细节。在单核机器(或者被严格限制了 CPU 配额的 Docker 容器)上,SpinWait 几乎是无效的。

逻辑很简单:如果你只有一个核心,而你正在自旋等待另一个线程释放锁,那么只要你不挂起(Yield),那个持有锁的线程就永远没机会上 CPU 去执行释放锁的代码。

虽然 .NET 的 SpinWait 内部做了智能处理(检测到单核会立即放弃自旋并让出时间片),但如果你自己手写了一个简陋的 while(true) 自旋,你的程序会在单核环境下直接锁死。

4. 架构师的修养:如无必要,勿增实体

在 升讯威在线客服与营销系统 的代码仓库里,其实 95% 的并发处理依然使用的是 Channels、ConcurrentQueue 或者标准的异步锁。

我们只在最核心、最频繁、且预期等待时间极短的 "纳米级" 关键路径上才祭出 SpinWait。

作为开发者,我们不能为了炫技而优化。如果你无法通过性能分析工具(如 BenchmarkDotNet 或 DotTrace)证明这部分自旋确实带来了显著的吞吐量提升,那么请回归到最简单的 lock 语句。

简单,往往是高性能的另一种表达方式。

我们在 升讯威在线客服与营销系统 中引入这些底层复杂性,唯一的理由就是:在极端的高并发场景下,那 1ms 的波动会影响几万人的聊天体验。如果你的应用场景没有这种压力,保持代码的可读性和可维护性远比那几微秒的性能提升更重要。

五、 结语:在底层优化的背后,是开发者主权的回归

写了这么多关于 SpinWait 的底层细节,很多人可能会问:在 SaaS 盛行、云原生横行的今天,你一个独立开发者,为什么要在一个在线客服系统的底层性能上如此"死磕"?随便租几台高配云服务器,加点内存,不就能解决并发问题吗?

因为我始终相信,软件的性能,决定了用户的主权。

1. 摆脱"算力税"的束缚

现在的软件开发趋势似乎陷入了一个怪圈:代码写得越来越臃肿,逻辑越来越依赖昂贵的中间件,然后告诉用户"你需要升级更高配的云服务器"。这本质上是在向用户征收隐形的"算力税"。

在开发 升讯威在线客服与营销系统 的过程中,我偏执地引入 SpinWait、压榨 Span<T>、构建无锁路由,目的只有一个:让软件重回"轻量级"的本质。 当我的程序能在客户那台已经跑了五年的旧服务器上,依然顺滑地处理上万人的实时并发时,客户就不再被云厂商的计费账单所绑架。这种"不挑硬件"的底气,正是源于我们对每一行底层代码的极致雕琢。

2. 私有化部署:把数据主权还给企业

在这个大数据时代,很多企业被迫将核心的客户沟通数据托管在第三方的 SaaS 平台上。你以为你在使用工具,其实你和你的客户数据正成为别人算法里的燃料。

升讯威在线客服与营销系统坚持走私有化部署的道路,是因为我们认为:企业的沟通记录、访客轨迹、业务主权,必须留在企业自己的防火墙之内。

但私有化部署面临的最大挑战就是"环境复杂性"。客户的服务器可能只有 2 核 CPU,也可能是十几年前的老机器。如果我们不从 SpinWait 这种纳秒级的维度去优化,如何在这些受限的环境下保证工业级的稳定性?

3. 独立开发者的浪漫:用技术换取自由

作为一个 .NET 栈的独立开发者,我深知在这个领域深耕的孤独。但我享受这种"上帝视角"------从每一行 C# 代码编译成 IL,再到 JIT 生成机器码,最后在 CPU 寄存器里飞速流转。

当我们掌握了这些底层黑科技,我们就不再只是代码的搬运工,而是系统架构的造物主。我们可以自豪地告诉客户:"即便是一台普通的 PC,只要跑着 升讯威在线客服与营销系统 的服务端,它就是一座坚不可摧的通讯堡垒。"

写在最后:

如果你也对 .NET 高并发有着近乎偏执的追求,或者你正在寻找一款真正尊重数据主权、能在极端环境下稳如泰山的在线客服系统,欢迎来了解 升讯威在线客服与营销系统。

这不仅仅是一个产品,它是我作为一个程序员,对"极致性能"和"开发者主权"最真诚的致敬。

独立者的产品成果

可全天候 7 × 24 小时挂机运行,网络中断,拔掉网线,手机飞行模式,不掉线不丢消息,欢迎实测。

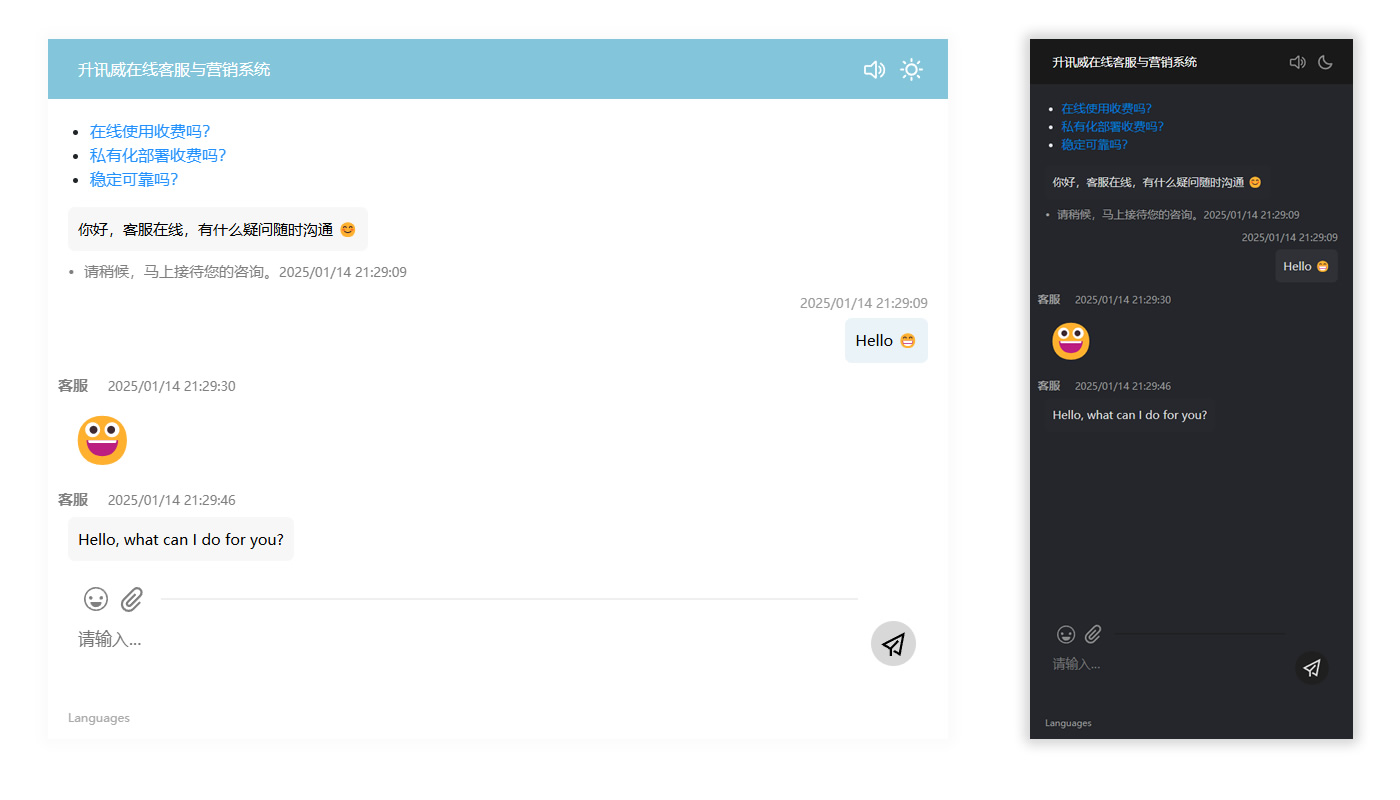

访客端:轻量直观、秒级响应的沟通入口

访客端是客户接触企业的第一窗口,我精心打磨每一处交互细节,确保用户无需任何学习成本即可发起对话。无论是嵌入式聊天窗口、悬浮按钮,还是移动端自适应支持,都实现了真正的"即点即聊"。系统支持智能欢迎语、来源识别、设备类型判断,可自动记录访客路径并呈现于客服端,帮助企业更好地理解用户意图。在性能方面,访客端采用异步加载与自动重连机制,即使网络波动也能保障消息顺畅送达,真正做到------轻量不失稳定,简单不失智能。

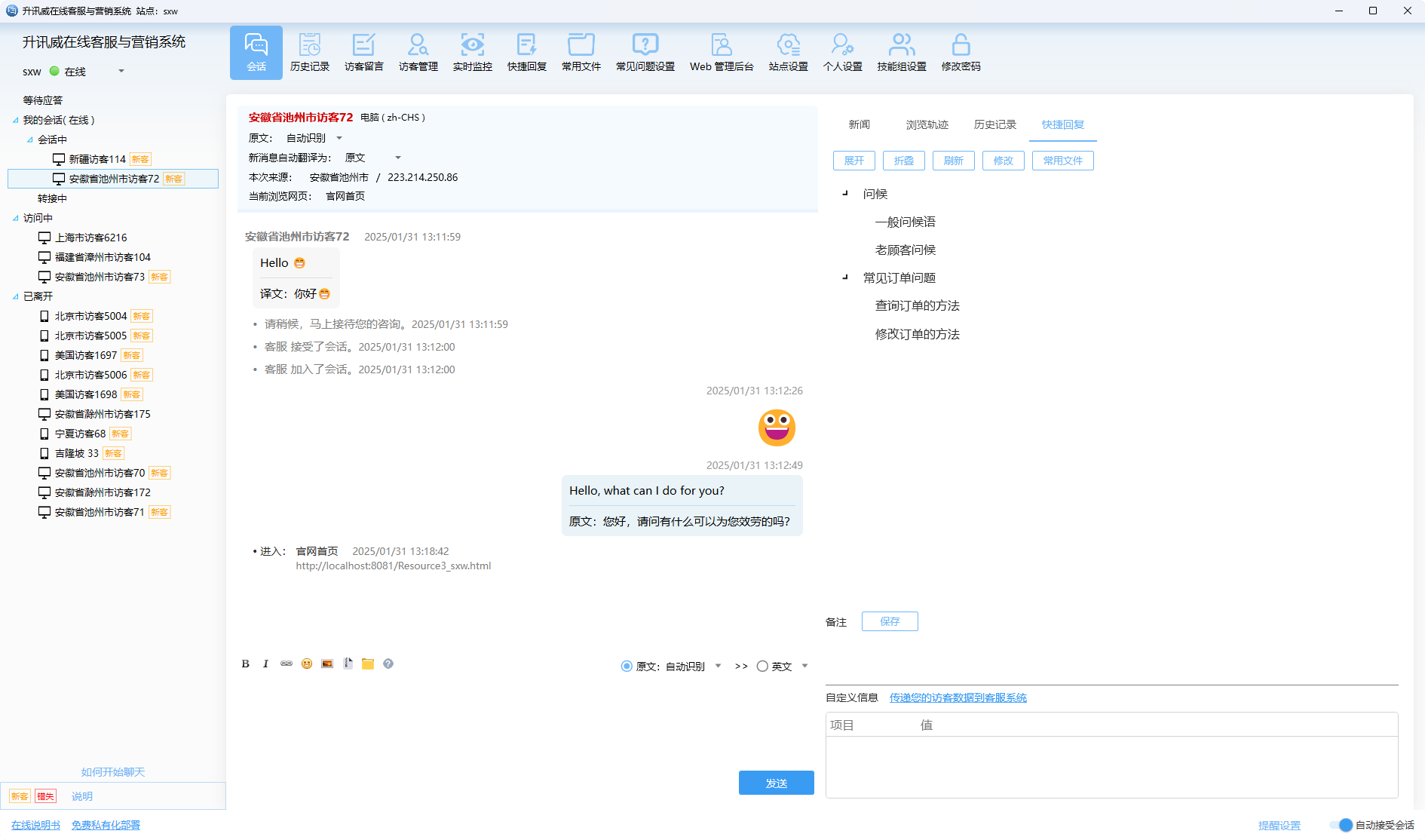

客服端软件:为高效率沟通而生

客服端是客服人员的作战平台,我构建了一个专注、高效、响应迅速的桌面级体验。系统采用多标签会话设计,让客服可同时处理多组对话;访客轨迹、历史会话、地理位置、设备信息、来源渠道等关键信息一目了然,协助客服快速做出判断。内置快捷回复、常用文件、表情支持和智能推荐功能,大幅降低重复劳动成本。同时,系统还支持智能分配、会话转接、转人工、自定义状态等多种机制,保障团队协作流畅,让客服不仅能应对高峰,更能稳定交付满意度。

Web 管理后台:

Web 管理后台是企业对客服系统的"驾驶舱",从接入配置、坐席管理,到数据统计、权限控制,一切尽在掌握。你可以灵活设置接待策略、工作时间、转接规则,支持按部门/标签/渠道精细分配访客,满足复杂业务场景。系统还内置访问监控、聊天记录检索、客服绩效统计、错失会话提醒等运营级功能,助力管理者洞察服务瓶颈,持续优化资源配置。支持私有化部署、分权限管理、日志记录与数据导出,为追求安全性与高可控性的企业,提供真正"掌握在自己手里的客服系统"。

希望能够打造: 开放、开源、共享。努力打造一款优秀的社区开源产品。

钟意的话请给个赞支持一下吧,谢谢~