Ollama:是一款旨在简化大模型语言模型本地部署和运行过程的开源软件。

ollama提供一个轻量级、易扩展的框架,让开发者可以在本地机器构建和管理LLMs(大语言模型)

通过ollama,开发者可以导入和定制自己的模型,无需关注复杂的底层实现细节。

简单来说,就是在自己电脑部署和运行大模型,由自己电脑的硬件提供算力支撑模型运行。

1.1Ollama下载安装

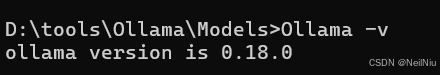

下载后默认安装路径是C盘,可以使用命令,修改安装路径

OllamaSetup.exe /DIR="D:\tools\Ollama\Models"安装后,可以输入,查看安装的版本号

Ollama -v

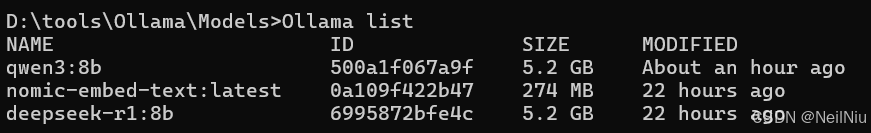

接下就可以拉取模型,可以拉取

ollama pull deepseek-r1:8b

ollama pull qwen3:8b

ollama list

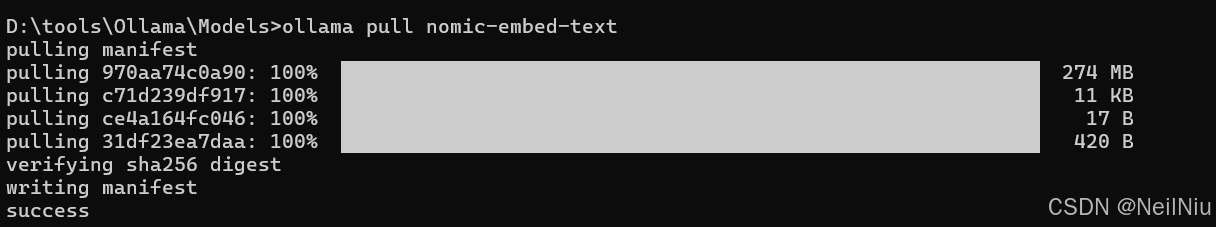

开源的文本嵌入模型工具

ollama pull nomic-embed-text

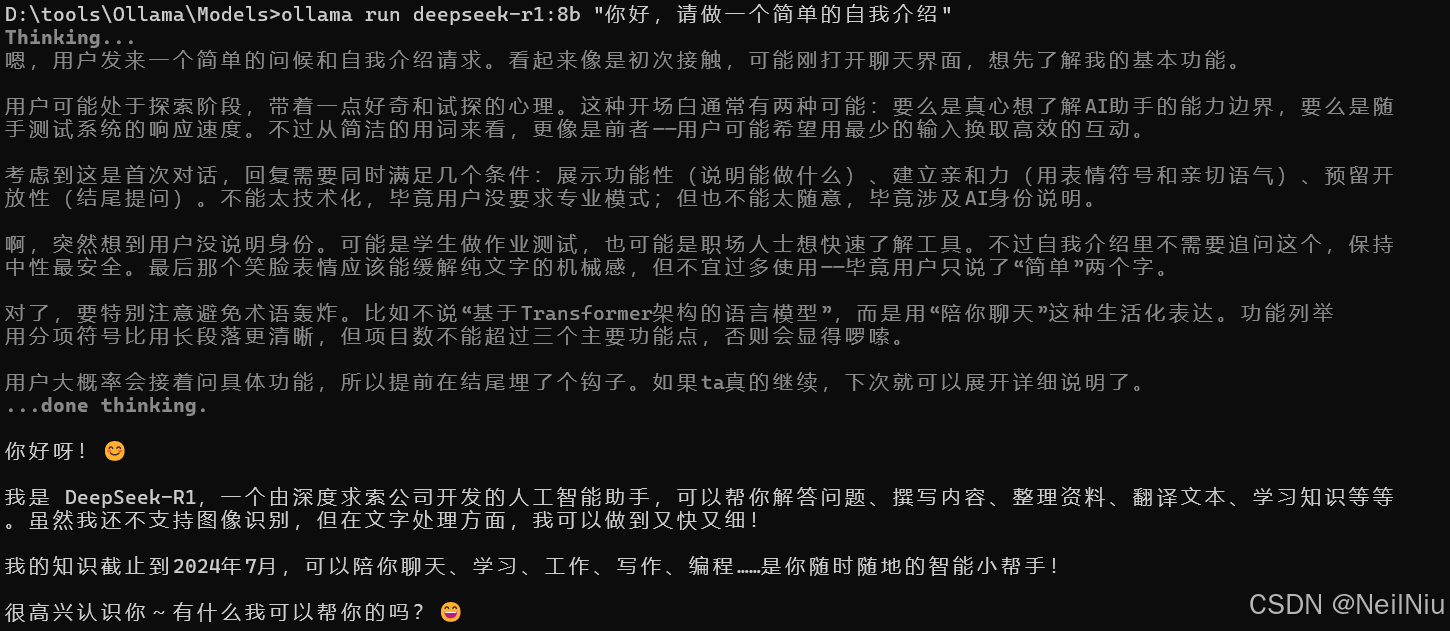

ollama run deepseek-r1:8b "你好,请做一个简单的自我介绍"

总结:

Ollama部署:在官网下载并安装客户端即可

蒸馏模型就是对标准大模型核心技能的学习,并进行瘦身,从而获得更低的性能要求。

简单来说蒸馏模型就是标准大模型的学生,学到了老师的核心本领,但是没有老师强。根据参数量的不同,参数量越大,蒸馏模型学到老师核心本领就越扎实,性能越好。

集显:1.5b左右

4G独显:8b以内

8G独显:14b以内