在生物信息学的漫漫长河中,数据可视化一直是一块难啃的骨头。以往,我们习惯了"提交任务 -> 喝杯咖啡 -> 查看结果"的异步模式。虽然这种模式保证了系统的稳定性,但对于需要反复调试参数、探索性分析的研究员来说,这种"时延"无疑是灵感的杀手。

今天,WhatCell 带来了里程碑式的更新:AIGene 智能体正式打通了与 Shiny 的实时交互通道。

这意味着,我们终于告别了纯异步的任务投递时代,迎来了 "所见即所得"的实时绘图新纪元。

一、痛点回顾:被"异步"锁住的灵活性

在此次升级之前,WhatCell 的 AIGene(艾吉恩) 智能体虽然强大,但其交互逻辑主要基于异步任务队列。

- 流程:用户输入指令(如"画个PCA") -> AIGene 接收指令 -> 投递任务到后台 -> 后台计算完成 -> 返回静态图片。

- 局限:如果我想调整一下PCA图的点的大小,或者想动态筛选某个基因的表达阈值,我必须重新提交一次任务。这种"一锤子买卖"式的交互,无法满足动态探索的需求。

二、核心突破:AIGene 与 Shiny 的"握手"成功

本次更新的核心,在于我们让 AIGene 智能体具备了 "动态渲染" 的能力。AIGene 不再仅仅是一个任务分发器,它现在是 Shiny 应用的智能启动器和参数注入器。

技术架构简述

AIGene 智能体在识别到用户指令中包含"交互式绘图"意图时,会执行以下动作:

- 意图识别:判断用户需要的是静态图还是交互式 Shiny App。

- 参数解析:从自然语言中提取绘图参数(如基因名、分组信息、绘图类型)。

- 会话建立:基于提取的参数,动态启动或连接一个专属的 Shiny 实例

三、功能体验:从"看图"到"玩图"

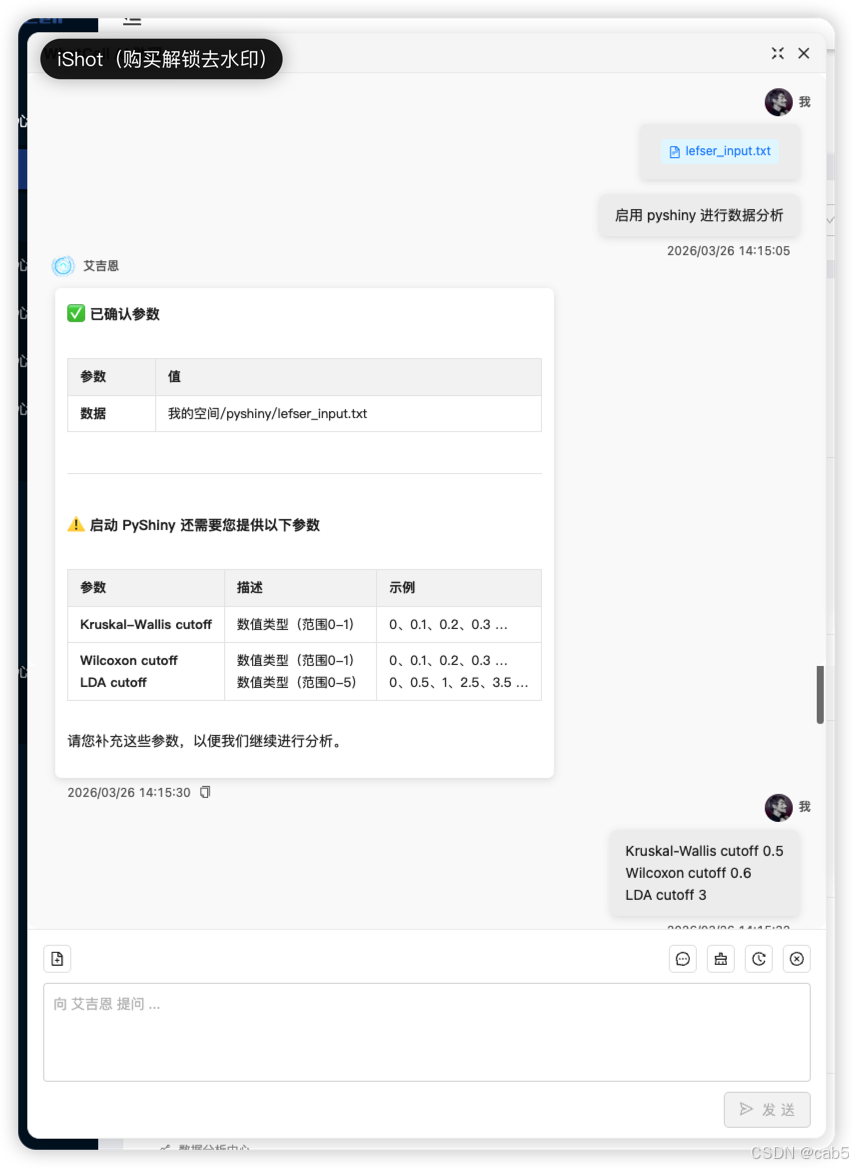

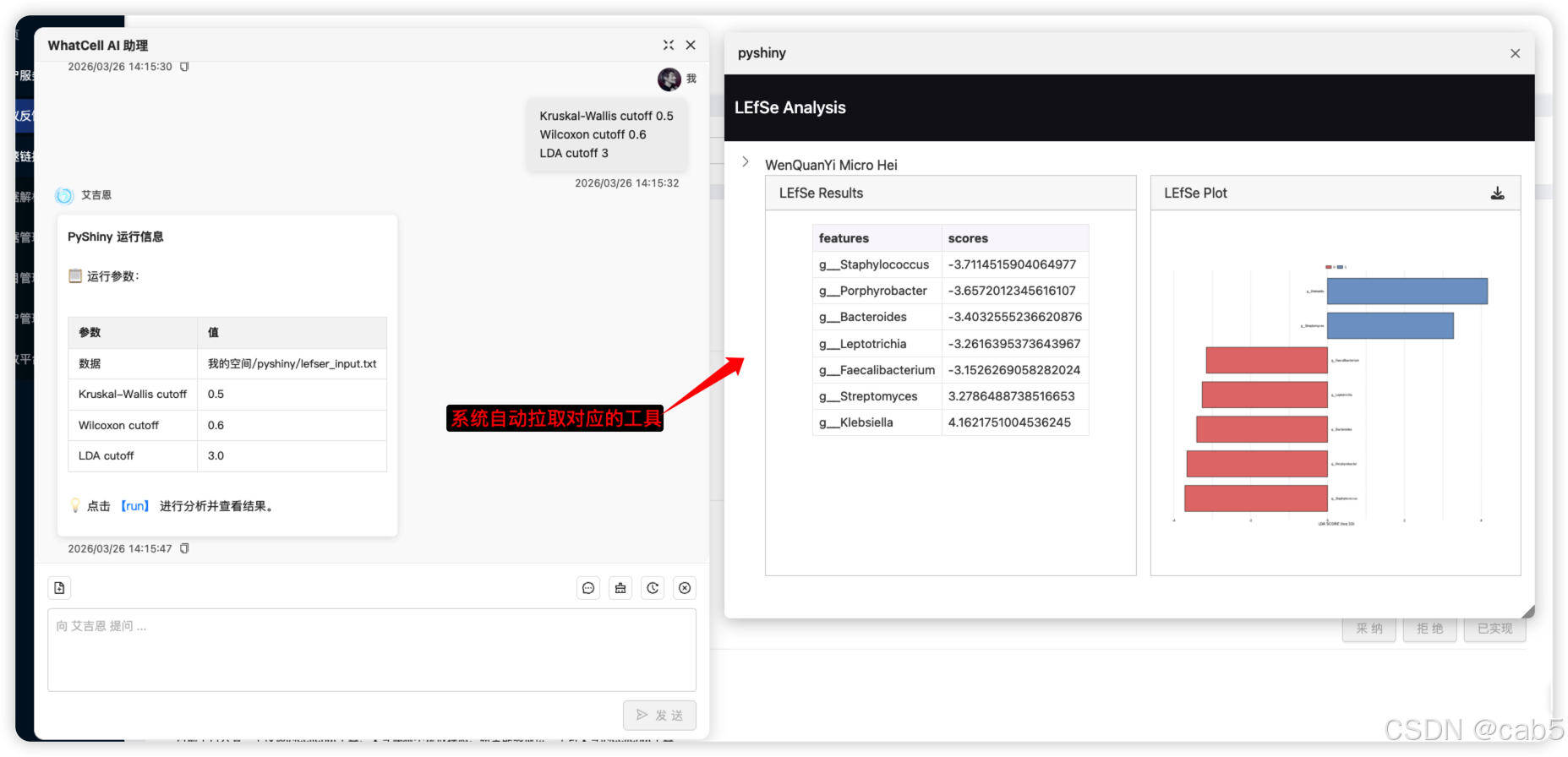

让我们通过一个具体的场景,来看看这次升级带来了怎样的体验飞跃,如下图:

这不仅仅是打开一个页面,而是一场精准的"空投"。系统会自动拉起工具,并将你提供的参数"弹药"一并送达,瞬间生成初步分析结果。更酷的是,你无需刷新或重启,只需动动嘴皮子(通过对话),就能修改参数,指挥工具进行新一轮的"地毯式轰炸"分析,真正实现"所想即所得"的交互体验。

四、总结与展望

WhatCell 中 AIGene 智能体打通 Shiny 实时交互,不仅仅是一个功能的叠加,更是一种分析范式的转变。

我们从 "批处理" 走向了 "流处理" ,从 "结果导向" 进化到了 "过程导向" 。研究员不再需要预设所有的参数,而是可以在绘图的过程中,随着图形的展现,实时调整自己的分析思路。