自动驾驶数据治理:PB级路测与模型训练的存储架构

随着新能源汽车智能化进程的加速,高级别辅助驾驶(ADAS)与自动驾驶算法的研发成为了车企的核心技术护城河。自动驾驶算法的成熟度,建立在对海量真实路测数据与仿真数据的深度学习之上。

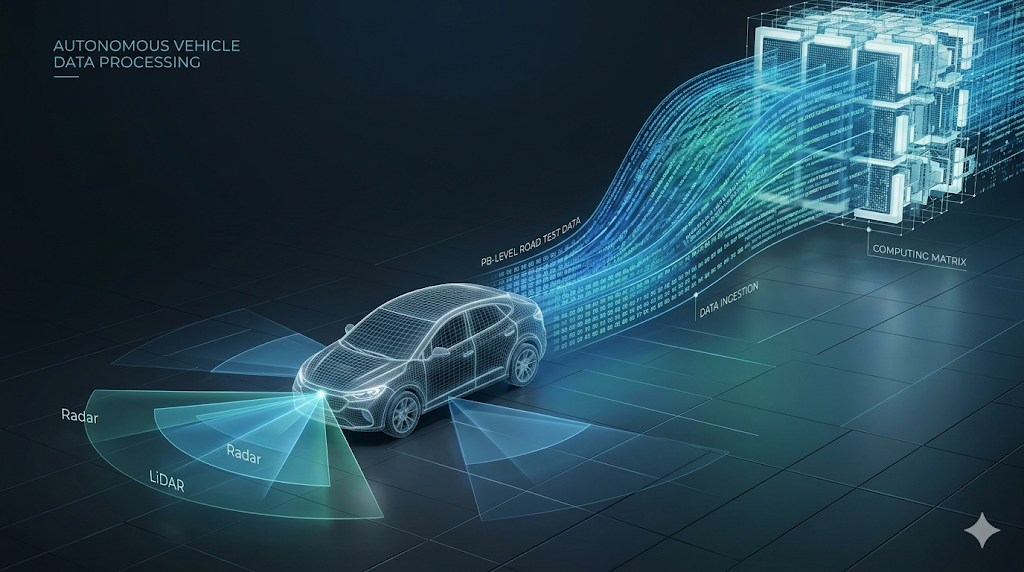

一辆配备激光雷达(LiDAR)、毫米波雷达与多路 8K 高清摄像头的测试车,每天产生的数据量通常在 2TB 至 10TB 之间。当车队规模扩大,研发中心需要摄取、清洗并存储的数据量会迅速突破 PB 级大关。在这种数据密集型的研发环境中,IT 基础架构的性能瓶颈往往不再是前端的 GPU 算力,而是后端的存储吞吐能力。

一、 自动驾驶模型训练面临的存储 I/O 挑战

在自动驾驶的研发工作流(数据采集、清洗、标注、模型训练、仿真回测)中,通用存储架构通常会面临以下技术阻碍:

-

GPU 算力集群的"数据饥饿":在模型训练阶段,深度学习框架(如 PyTorch、TensorFlow)需要向存储系统发起高频的并发读取请求,以提取海量的切片图像与点云数据(典型的小文件随机读取场景)。传统机械硬盘阵列的高寻道延迟会导致 I/O 队列拥堵,使得前端昂贵的 GPU 计算集群因等待数据加载而处于闲置状态,降低了算力投资的回报率。

-

PB 级容量的平滑扩展压力:算法的回归测试需要依赖历史路测数据的不断累积,这些数据涵盖了各种罕见的极端路况(Corner Cases)。PB 级的数据堆积要求存储系统具备平滑的横向(Scale-Out)或纵向(Scale-Up)扩展能力,以避免频繁的设备替换与复杂的数据迁移工程。

-

混合数据类型的读写特征冲突:自动驾驶研发既包含对海量小文件(标注图片、JSON 配置)的高频随机读写,也包含对大文件(长段路测视频、ROSbag 数据包)的连续顺序读写。传统单一架构的存储设备难以同时优化这两种截然不同的 I/O 模型。

二、 威联通企业级架构:匹配算力集群的数据底座

为了填补算力与存储之间的鸿沟,车企与自动驾驶初创企业需要审视并重构底层数据链路。威联通(QNAP)通过整合全闪存架构、分层缓存机制以及高密度扩展方案,为自动驾驶研发提供了一套匹配其业务流转的数据底座。

1. U.2 NVMe 全闪存:消除 GPU 集群的 I/O 等待

针对深度学习训练阶段对吞吐量与低延迟的苛刻要求,企业可部署搭载 PCIe Gen 4 总线与 U.2 NVMe 接口的威联通全闪存阵列(如 TDS-h2489FU 等机型)。 NVMe 协议绕过了传统 SAS/SATA 控制器的排队机制,结合系统内部的双路或高频处理器算力,能够提供数以百万计的并发 IOPS。这种全闪存架构可作为热数据池(Hot Tier),直接对接 GPU 计算节点,确保训练素材源源不断地输送至显存,显著缩短算法的迭代周期。

2. ARC 与 L2ARC 多层级缓存:优化混合 I/O 效能

面对复杂的数据读写模型,QuTS hero 操作系统(基于 ZFS 架构)内置了动态多层级缓存调度。 系统将大容量物理内存作为一级读取缓存(ARC),用于驻留高频访问的元数据与目录树,加速模型验证时的文件查找速度。同时,利用固态硬盘构建二级读取缓存(L2ARC),将常用的点云数据集预加载至低延迟介质中。这种机制使得存储系统能够在处理连续大型视频流的同时,依然保持对小文件随机读取的良好响应。

3. 纵向与横向的高密度扩展:构建海量温冷数据湖

随着路测周期的拉长,大量完成训练的数据会降级为需要长期归档的"温冷数据"。 在容量演进路径上,企业可以通过 SAS 宽带总线纵向级联高密度 JBOD 扩展柜,在单一命名空间下将容量扩展至数 PB;或者利用网络存储资源池化技术,将冷数据平滑迁移至大容量机械硬盘节点中。这种冷热数据分层与弹性的扩容机制,帮助研发中心在不中断现有训练任务的前提下,有效控制了 PB 级数据的长期存储成本。

三、 总结

自动驾驶的研发效率,在很大程度上取决于底层数据流转的顺畅度。面对传感器产生的数据洪流与 GPU 集群的吞吐需求,传统的存储阵列已显现出架构局限。威联通通过引入 NVMe 全闪存的极速摄取、ZFS 智能缓存调度以及灵活的海量扩展架构,打通了从路测数据上传、模型训练到长期仿真归档的数据链路。这为车企提供了一个兼具性能深度与容量广度的 IT 基础设施,为其在高级别智能驾驶赛道上的技术演进提供了客观支撑。