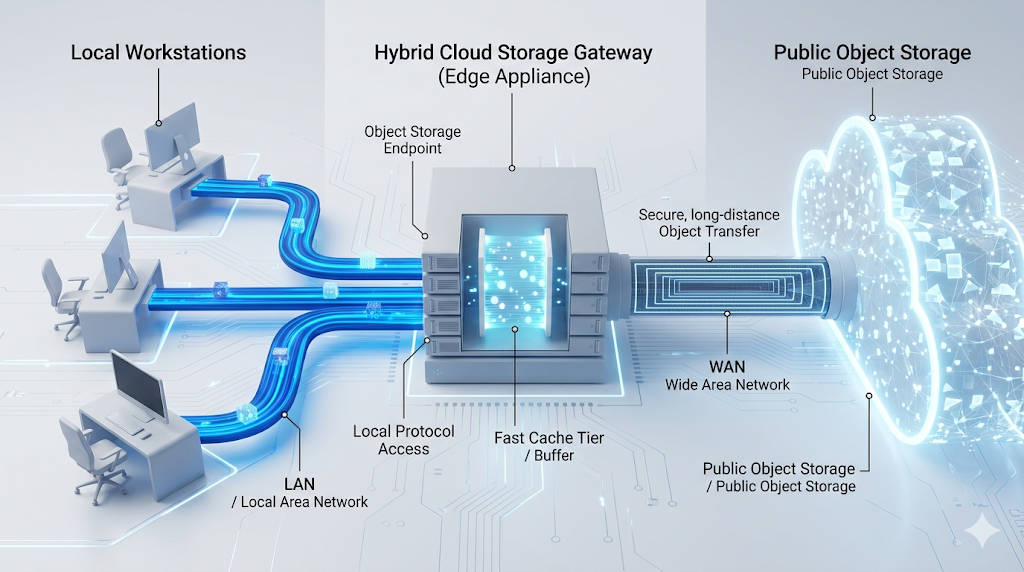

混合云存储底座:云网关与边缘快取架构解析

在纯粹的公有云架构中,计算实例(如 EC2)与对象存储(如 S3)同处于一个高带宽、低延迟的数据中心骨干网内,数据调用极为顺畅。然而,当数据的调用方变成位于企业本地机房的物理工作站时,广域网的物理距离(数十至数百毫秒延迟)打破了这种流畅性。

此外,传统的桌面操作系统(Windows/macOS)与老旧的业务系统(如 ERP/非编软件)强依赖于基于 POSIX 语义的文件系统或 SMB/NFS 协议,无法直接读写云端的对象存储桶(Bucket)。为了化解协议语义与物理延迟的双重摩擦,威联通(QNAP)引入了云存储网关架构,将 NAS 设备转化为横跨本地与云端的 I/O 缓冲中枢。

一、 语义转换:SMB/NFS 到 RESTful API 的底层重构

让不具备云原生能力的老旧系统直接访问云存储,首要任务是在底层实现网络协议的抽象与翻译。

-

网关层截获:当用户在 Windows 资源管理器中通过 SMB 协议挂载威联通 NAS,并尝试写入一个 Word 文档时,HybridMount 引擎会在文件系统内核层截获这一 I/O 请求。

-

实时协议封装:网关在后台将标准的 SMB 数据流,实时翻译、封装为目标公有云的 RESTful API 请求(如 HTTP PUT 指令)。对于前端用户与业务软件而言,位于远端公有云上的存储桶,在逻辑上表现为一个普通的本地共享文件夹,彻底免除了企业重构既有业务代码的工程成本。

二、 局部性原理:边缘快取(Cache)与延迟掩盖

解决了协议连通性,接下来必须克服广域网的物理延迟。云网关的核心工程机制建立在计算机科学经典的"局部性原理(Principle of Locality)"之上。

-

读写命中的物理截断:企业可在威联通 NAS 上分配一块由 SSD 或 HDD 组成的本地存储空间,作为该云网关的专属快取区(Local Cache)。当本地客户端请求读取一个云端文件时,HybridMount 首先检查本地快取。如果命中(Cache Hit),数据直接以局域网全速(如万兆)返回给客户端,物理延迟<1毫秒,完全掩盖了公有云的存在。

-

LRU 淘汰算法 :由于本地快取容量有限(例如 2TB 快取对应 50TB 云端空间),系统底层采用了 LRU(最近最少使用,Least Recently Used) 算法。随着新数据的不断载入,系统会自动甄别并淘汰快取中那些长期未被访问的"冷区块",释放空间给新的"热区块"。这种动态流转确保了有限的边缘物理空间始终被最高频的业务数据占据。

三、 API 节流与经济学博弈:I/O 聚合机制

在评估公有云对象存储的总体拥有成本(TCO)时,企业往往忽略了除了"容量费"之外的"API 请求费(PUT/GET 次数)"。如果允许本地数百台工作站直接向公有云发起高频的小文件读写,每个微小的 I/O 都会产生计费,最终引发账单失控。

-

I/O 聚合(I/O Aggregation):威联通云网关在数据向云端上卷(Upload)的过程中充当了"缓冲池"。前端高频、零碎的写入动作会被先吸纳在本地快取中。网关底层会将这些微小的操作聚合成大块的数据流,在后台异步批量地执行 HTTP PUT 动作。

-

读写合并:如果一个文件在短时间内被反复修改 100 次,网关并不会向云端发送 100 次更新 API,而是仅在最终定稿或到达设定的同步周期时,向云端执行一次覆写。这种底层的流量整形与 I/O 收敛,结构性地压低了公有云 API 的调用频次,确立了混合云架构的经济可行性。

四、 块设备映射:VJBOD Cloud 的 LUN 穿透

除了非结构化的文件(File),企业有时还需要将结构化的数据库(如 SQL Server)或虚拟机(VM)镜像备份至云端,这要求存储底座提供块级(Block-level)接口。

-

iSCSI 到 S3 的映射 :威联通 VJBOD Cloud 引擎提供了基于区块的云存储网关服务。它在本地将一个公有云存储桶抽象为一个标准的 iSCSI LUN(逻辑单元号),供前端的虚拟化集群挂载。

-

异步区块同步:数据库在写入 LUN 时,数据会优先落入威联通本地的固态快取池,保证数据库事务不发生高延迟等待。随后,VJBOD Cloud 引擎会在后台以区块(Block)为单位,追踪发生变动的底层扇区,并将其同步至云端。一旦本地机房发生毁灭性灾难,IT 架构师可以迅速在异地部署一台新的威联通节点,挂载该云端存储桶,并瞬间拉起灾备数据,实现基于公有云的容灾脱机。

五、 总结

公有云解决了数据存放的容量上限,而边缘网关解决了数据调用的物理阻力。威联通通过 HybridMount 与 VJBOD Cloud 引擎,利用底层的协议翻译、LRU 边缘快取算法以及 API 聚合收敛机制,在本地局域网与广域网云端之间建立了一个智能的 I/O 缓冲带。这套架构允许企业在保持本地万兆极速访问体验、且不修改任何既有业务代码的前提下,透明地接入几乎无上限的公有云存储资源池,是构建弹性混合云基础设施的典型工程解法。