写在前面

写代码这件事,正在经历一场静默而深刻的变革。几年前提起AI编程助手,人们想到的大概是Copilot在编辑器里自动补全几行代码。如今,这个画面已经显得有些过时了。新的AI编程工具不再满足于"猜你想写什么",而是直接接管终端、读代码库、改文件、跑命令、执行测试,把一串开发任务当作代办清单去执行。

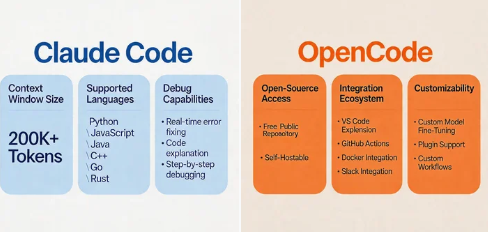

在这股浪潮中,两个名字频繁出现在开发者的讨论里:Anthropic推出的官方产品Claude Code,以及由SST团队打造的开源替代品OpenCode。这两个工具常常被放在一起比较,但它们的底色和走向,其实大不相同。

Claude Code:Anthropic的旗舰之作

先来认识一下Claude Code。它是Anthropic公司开发的一款终端原生编码代理(terminal-native coding agent),发布于2024年。所谓"终端原生",简单说就是它直接跑在命令行里,拥有访问用户shell、文件系统以及各种开发工具的权限。

给Claude Code一个目标,比如"给/API/chat接口加上基于Redis的限流,写好测试,确保CI通过",它会自己读代码库、找对文件、实现改动、跑测试、修bug,最后提交结果。整个过程不需要开发者手动复制粘贴,也不需要在不同窗口之间来回切换。

Claude Code的成长速度相当惊人。据SemiAnalysis的数据,它在约九个月内实现了25亿美元的年化收入,在2026年1月1日之后的六周内,企业订阅量翻了两番。更夸张的是,它现在占据了所有公开GitHub提交量的约4%,每天约13.5万次提交。

关键能力一览

计算机使用能力。 2026年3月,Anthropic给Claude Code上线了一个被开发者戏称为"长出双手"的功能------计算机使用能力。Claude不再只是躲在对话框里聊天,而是可以直接接管Mac电脑,操控浏览器、鼠标、键盘和屏幕。从写代码、编译、启动应用到自动点选测试,再到发现bug、修复代码、再次验证,整条链路它自己就能跑完。

远程控制。 开发者可以从手机或任何浏览器访问正在运行的Claude Code会话。手机界面就像一个窗口,能看到本地机器上真实的文件、MCP服务器和工具环境。还有一种更简单的玩法:手机直接启动电脑上的Claude Code会话,在手机屏幕上实时看AI的运行状态。

Routines定时任务。 2026年4月上线的Routines功能,把提示词、代码仓库、连接器打成一个包存下来,Claude就能按时间表、API调用或GitHub事件自己跑起来,全程在Anthropic的云上执行,本地电脑可以直接关机。比如,可以设置每晚凌晨2点从Linear拉一个优先级最高的bug,尝试修复,然后开一个draft PR,第二天上班直接review就行。

Agent Teams多代理协作。 Claude Code可以同时协调多个子代理来执行大型开发任务,支持200K token的上下文窗口,Opus 4.6还提供了100万token的测试版。在SWE-bench Verified基准测试上,Claude Code拿到了80.8%的分数。

定价方面。 采用订阅制,Pro和Max方案每月20到200美元,也有按API用量计费的方式。不过最近用户普遍反映额度消耗很快,甚至有人在社交媒体上吐槽周一还没过完额度就用光了。

OpenCode:开源的挑战者

OpenCode是SST团队(后更名为Anomaly)在2024年7月推出的终端AI编码助手。它和Claude Code最大的不同在于:不绑定任何AI供应商。

简单来说,OpenCode是一个开箱即用的终端AI助手,支持超过75家大型语言模型提供商,从Anthropic的Claude、OpenAI的GPT系列,到Google的Gemini,再到本地部署的Ollama模型,统统都能接入。

OpenCode的增长轨迹令人侧目。2025年6月上线,5个月达到65万月活,2026年1月两周内暴涨18,000个GitHub星标,最终突破10万星标,成为全球增长最快的开源AI编码工具。截至目前,OpenCode在GitHub上拥有约11.2万星标、779位贡献者,每月活跃开发者约250万。

关键能力一览

多模型支持。 支持超过75家模型提供商,用户可以在不同AI模型之间自由切换,比如用Claude写代码,用GPT做审查。对于希望控制成本或不想被单一供应商锁定的开发者来说,这个功能相当有吸引力。

终端用户界面(TUI)。 OpenCode采用Bubble Tea框架构建交互式终端界面,支持Vim风格的快捷键,无需切换窗口就能完成从代码提问到修改的全流程。提供Plan(规划)和Build(构建)两种工作模式,Plan模式只分析不修改,适合代码审查和性能分析。

Client/Server架构。 从第一天起就采用服务端-客户端分离的设计,可以连接到任何前端------终端、桌面应用、网页或移动设备。这个设计让远程控制和会话持久化成为可能,甚至在Docker容器里跑远程会话也不在话下。

工具链整合。 OpenCode的AI可以直接执行命令、搜索文件、修改代码,形成闭环开发流程。支持文件操作(ls、glob、view、write)、代码分析(grep文本搜索、诊断信息获取)、系统交互(bash命令执行)等工具。

定价模式。 工具本身完全免费(MIT开源协议),用户只需支付所使用的AI模型API费用。此外还提供Zen和Black两种付费网关方案,Zen是按量付费的入口,每月20/100/200美元三档。

隐私保护。 支持"隔离模式",确保零数据离开本地电脑,对安全性要求高的开发者来说是个重要加分项。

一张表看懂两者的核心差异

| 对比维度 | Claude Code | OpenCode |

|---|---|---|

| 源代码 | 闭源,Anthropic专有 | 开源,MIT协议 |

| 模型支持 | 仅限Anthropic Claude系列 | 75+家提供商 + 本地Ollama |

| GitHub星标 | 约7.15万 | 约11.28万 |

| 月活开发者 | 未公开(约占4% GitHub提交量) | 约250万 |

| 许可证 | 专有软件 | MIT开源协议 |

| 定价 | $20-200/月 或 按API计费 | 工具免费 + AI提供商费用 |

| 桌面/网页客户端 | 研究预览版 | 测试版桌面应用 |

| IDE插件 | VS Code、JetBrains | VS Code |

| 本地模型 | 不支持(社区变通方案存在) | 原生支持Ollama |

| 架构 | CLI工具 | Client/Server + HTTP API |

| 核心优势 | 深度整合、自动化、开箱即用 | 开放灵活、模型自由、成本可控 |

数据来源。

一个意味深长的转折:封锁事件

2026年1月,Anthropic悄然封禁了OpenCode通过消费者OAuth令牌使用Claude模型的途径。OpenCode被迫从代码库中移除了Claude Pro/Max支持,理由是"Anthropic法律要求"。

这个消息在Hacker News上引发了激烈的讨论。开发者对供应商锁定行为的反感被彻底点燃。OpenCode迅速作出反应,推出了Black企业级API网关和Zen按量付费方案。有意思的是,OpenAI公开表示欢迎第三方工具接入自己的模型,被外界解读为在借机与Anthropic划清立场。

这场风波之后,两个工具的用户群体分化得更加清晰:看重供应商自由度的开发者涌向OpenCode,追求最紧密模型集成和精致体验的开发者继续留在Claude Code。共存的时代,大概已经过去了。

代码质量的两种哲学

一个有趣的角度来自OpenCode联合创始人Dax Raad。他在一次播客访谈中提到,Claude Code团队有一个非常激进的做法:Claude Code的100%代码都要由Claude Code自己写。这种自举式的开发方式听起来很酷,但也带来了问题------当底层模型本身就是非确定性的,产品代码又在高速迭代中快速堆叠出来,系统很容易变得不稳定。各种崩溃、诡异报错、bug增多、速度变慢,渐渐成了常态。

OpenCode采取了完全不同的策略。团队比以往更强调代码库的一致性和约束,确保没有任何文件偏离既定规范,大量采用约束更强的工具和框架,坚定践行领域驱动设计。他们的逻辑是:在大模型参与开发的情况下,代码库一旦变"脏",后果会被放大------大语言模型无法区分旧模式和新模式,会把旧写法当成正确示范继续生成不合规范的代码。

结果有些反直觉:OpenCode的代码库反而比以前任何时候都更干净,"甚至可能是我们写过的质量最高的一批代码"。

该怎么选?

没有标准答案,但可以按场景来想。

如果追求的是开箱即用的精致体验,不想自己折腾配置,愿意为深度整合付费,且主要使用Claude模型,那么Claude Code是一个很省心的选择。它的自动化能力和生态整合度确实走在了前面,Agent Teams和多代理协作在大型项目中能发挥明显优势。

如果希望保留选择模型的自由,想要在本地运行模型,或者单纯不想被任何供应商锁定,OpenCode显然是更对胃口的那个。开源意味着可以自己审查代码、自行修改、部署在自己的基础设施上。对于关注数据隐私、预算敏感、或者单纯喜欢折腾的开发者来说,这个选择很难拒绝。

还有一个角度值得留意:OpenCode创始团队只有六个人,却做出了一款月活250万的工具。Claude Code有Anthropic整个公司的资源支撑,创造了惊人的商业成绩。这两个故事放在一起看,本身就很说明问题了------AI编程工具这个赛道,容得下两种完全不同的成功范式。