文章目录

- DeepSeek-TUI

-

- 一、项目概述

- 二、核心功能

-

- [2.1 百万级上下文 + 智能压缩](#2.1 百万级上下文 + 智能压缩)

- [2.2 思维链实时可见](#2.2 思维链实时可见)

- [2.3 三种交互模式](#2.3 三种交互模式)

- [2.4 RLM 递归语言模型------把 Flash 子模型当并行 Worker](#2.4 RLM 递归语言模型——把 Flash 子模型当并行 Worker)

- [2.5 子代理多角色协作](#2.5 子代理多角色协作)

- [2.6 工作区回滚(side-git 快照)](#2.6 工作区回滚(side-git 快照))

- [2.7 完整工具链](#2.7 完整工具链)

- [2.8 LSP 实时反馈闭环](#2.8 LSP 实时反馈闭环)

- [2.9 MCP 双向集成](#2.9 MCP 双向集成)

- [2.10 跨工具 Skills 兼容](#2.10 跨工具 Skills 兼容)

- [2.11 多提供商统一接入](#2.11 多提供商统一接入)

- [2.12 会话持久化与成本追踪](#2.12 会话持久化与成本追踪)

- 三、竞品对比

- 四、成本分析

- 五、适用与不适用场景

- 六、中文平台评价索引

DeepSeek-TUI

一、项目概述

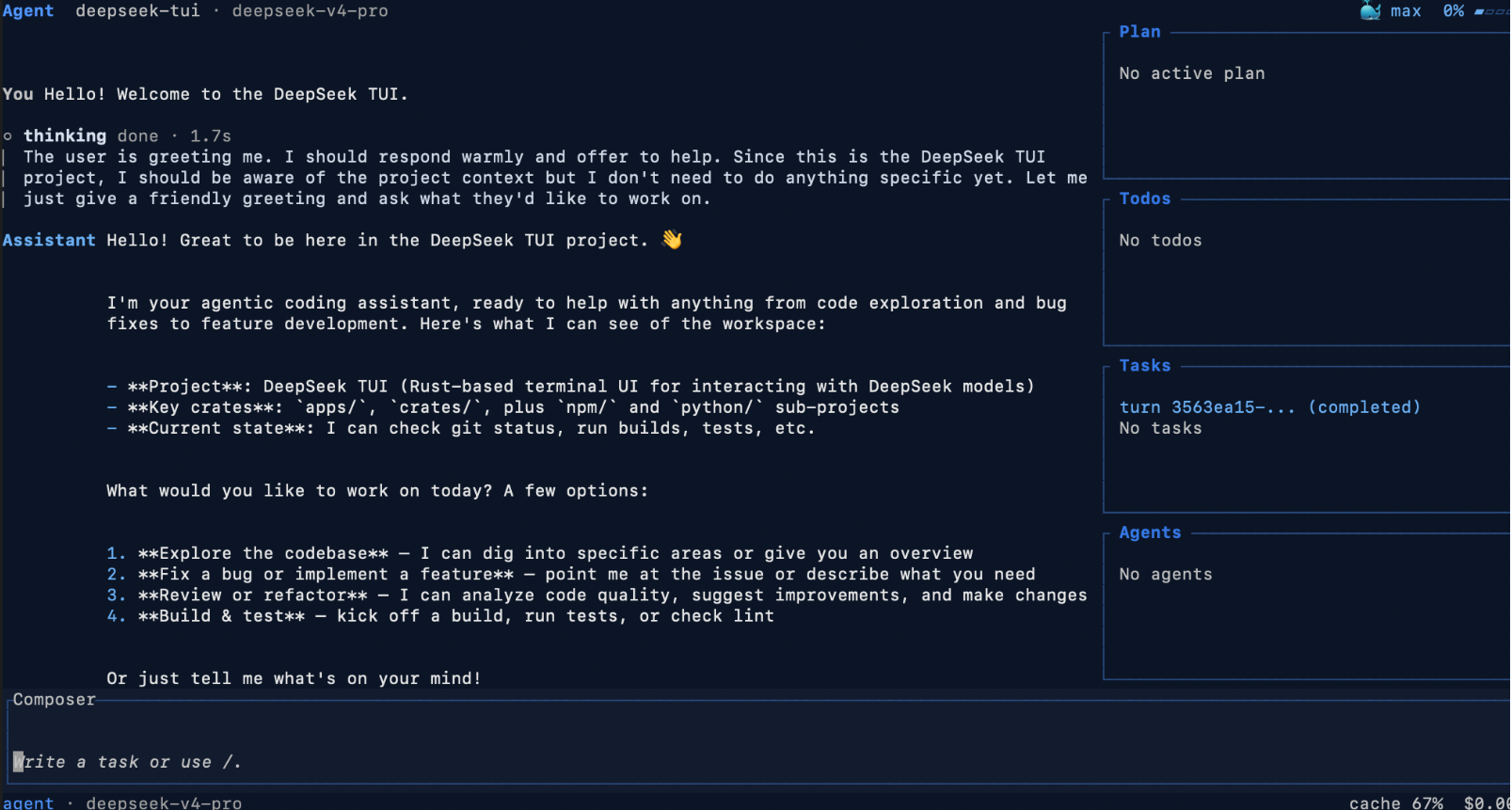

DeepSeek-TUI 是一个运行在终端里的 AI 编程智能体(Coding Agent) ,专为 DeepSeek V4 模型设计。它不是简单的聊天壳子,而是能让 AI 直接读写你的项目文件、执行命令、管理 Git、编排子任务的完整开发平台。DeepSeek-TUI 不是 DeepSeek 官方产品,是独立开发者 Hayden Brown 维护的社区项目(MIT 协议)。中文社区有误传为"DeepSeek 官方 CLI",请甄别。

核心定位:解决的是模型成本问题

正如博客中指出------《DeepSeek 也有 TUI 了:一份认真的工具调研》:"它解决的不是 UI 问题,而是模型成本问题。"

DeepSeek V4 系列有两个硬优势------1M tokens 上下文 和Cache Hit/Miss 双轨计费------DeepSeek-TUI 把它们做成原生工作流。V4 Flash 输入 0.14/MTok,Claude Sonnet 4.6 输入约 3/MTok,定价差几十倍直接落到长循环 Agent 的月度账单上。

社区热度

项目在 GitHub 单日涨过 500+ 颗星。作者用 DeepSeek 润色的中文主动连接中文社区,被电子工程专辑报道------《美国佬用 DeepSeek 打进中国开源圈?》------"语言可以交给 AI 润色,但诚意不能外包"。

二、核心功能

2.1 百万级上下文 + 智能压缩

- DeepSeek V4 两档模型(Pro/Flash)均支持 100 万 token 上下文窗口

- 代码库再大也能一次性装进去,上下文接近上限时自动智能压缩

- 压缩阈值根据模型和推理强度动态调整,也可

/compact手动触发

2.2 思维链实时可见

- DeepSeek V4 默认启用思考模式,TUI 将推理过程实时流式渲染在终端中

- 你能看到 AI 一步步拆解问题、推演逻辑,而非等它"想完再说"

- 推理强度用

Shift+Tab在 off → high → max 三档切换,复杂问题用 max,简单任务用 off - 这是区别于 Cursor、GitHub Copilot 等 IDE 插件的显著优势------祖普科技:"思维链实时可见,开发者可以及时发现模型推理中的偏差并介入纠正"

2.3 三种交互模式

| 模式 | 行为 | 适用场景 |

|---|---|---|

| Plan | 只读探索,不执行任何工具 | 让模型先给出步骤再决定是否执行 |

| Agent | 可执行工具,每步需用户审批 | 日常开发,人机协作 |

| YOLO | 自动批准所有工具调用 | 可信工作区、高重复性批量任务 |

配合沙箱系统(macOS Seatbelt / Linux Landlock)和执行策略引擎,形成完整安全边界。

2.4 RLM 递归语言模型------把 Flash 子模型当并行 Worker

这是最值得单独讲的能力。主模型遇到适合并行处理的任务时,可以一次性扇出 1~16 个 deepseek-v4-flash 子模型并行跑,结果回到主对话。

袁慎建博客:"读一个 200 文件的 monorepo,给每个文件打'是否涉及鉴权逻辑'的标签------Claude Code 通常会顺序读、顺序判断;DeepSeek-TUI 用 RLM 一次发 16 个 flash 实例并行打标。把会消耗大量 Pro token 的扇形子任务分流到 Flash,就是直接的钱省下来。"

RLM 不同于子代理(子代理用 Implementer + Verifier 做"做+验"),RLM 更像"批量分类、并行决策、扇出采样"的轻量原语。

2.5 子代理多角色协作

agent_spawn异步生成子代理,立即返回,父代理继续工作不阻塞- 7 种预定义角色:探索(只读)、计划、审查、实现、验证、通用、自定义

- 子代理间可通过邮箱系统跨代理通信

- 运行中可

agent_send_input动态干预子代理 - 子代理在 UI 中以鲸鱼种类命名(蓝鲸、座头鲸、虎鲸等),支持中英双语

2.6 工作区回滚(side-git 快照)

每次写入操作前,变更写到独立的 side-git 快照(不污染仓库的 .git),失败或主动 /rollback 时直接回滚。

袁慎建博客:"Claude Code 和 Codex 都没有内建这种'独立于 Git 的变更账本',靠

git checkout .经常救不回新增文件。side-git 快照像一个独立的事务日志,让'撤销最后一次 Agent 行为'变成一个原子操作。"

2.7 完整工具链

| 工具类别 | 能力 |

|---|---|

| 文件操作 | 读写编辑文件、应用统一 Diff 补丁 |

| Shell 执行 | 运行终端命令,支持流式 I/O、后台任务、超时 |

| Git 管理 | status/diff/log + 历史分析 |

| GitHub 集成 | 通过 gh CLI 操作 Issue/PR |

| 网页能力 | 搜索、浏览、获取 URL 内容 |

| 代码审查 | 自动 code review |

| 子代理 | 8 个操作(spawn/wait/result/cancel/list/send_input/resume/assign) |

| MCP 服务器 | 连接外部工具生态 |

| 其他 | 计划工具、检查清单、持久化任务、定时自动化、用户记忆、数据验证、金融计算、测试执行 |

2.8 LSP 实时反馈闭环

文件编辑后自动触发 LSP 诊断(rust-analyzer、pyright、gopls、clangd 等),诊断错误注入下一轮 API 请求,形成"编辑→诊断→修复"的自动闭环。

2.9 MCP 双向集成

- 客户端:连接 MCP 服务器扩展工具生态,自动工具发现

- 服务器 :

deepseek mcp-server将自身作为 MCP stdio server 暴露给上游 - HTTP/SSE 运行时 API:

deepseek serve --http供外部程序非交互调用

2.10 跨工具 Skills 兼容

Skills 系统直接读取 Claude Code 和 OpenCode 的 skills 目录,发现路径:.agents/skills → ./skills → .opencode/skills → .claude/skills → ~/.deepseek/skills。

袁慎建博客:"这个决定比'自定义一套 skills 协议'重要得多。AI 编码工具最大的迁移成本是积累的工作流,跨工具兼容降低了切换门槛------也是 DeepSeek-TUI 作为后来者唯一现实的策略。"

2.11 多提供商统一接入

通过统一接口支持 7 个提供商:DeepSeek 官方、DeepseekCN(中国端点)、NVIDIA NIM、OpenRouter、Novita、Fireworks、SGLang(自托管)。不会被锁在一个供应商上。

2.12 会话持久化与成本追踪

- 会话保存/恢复/分叉,支持崩溃检查点

- Cache Hit/Miss 双轨自动计费,底栏实时显示当前会话总成本

- 跨会话用户记忆功能

- 中英双语 i18n,

/config中可一键切换zh-Hans

三、竞品对比

| 维度 | Claude Code | Codex CLI | DeepSeek-TUI |

|---|---|---|---|

| 默认模型 | Claude Sonnet/Opus | OpenAI GPT-5.5 | DeepSeek V4 Pro/Flash |

| 上下文窗口 | 1M | 200K-1M | 1M(两档统一) |

| 思考流 | 可开关 | 六档 | Shift+Tab 三档 |

| 沙箱 | 无内建 | 三级 | Plan/Agent/YOLO |

| 工作区回滚 | 无 | 无 | side-git 快照 |

| 并行子模型 | sub-agent | sub-agent | RLM + sub-agent |

| Skills 兼容 | 自有 | AGENTS.md | 兼容 Claude/OpenCode |

| MCP | 客户端 | 客户端 | 客户端 + 可作 server |

| 多 provider | 仅 Anthropic | 仅 OpenAI | 5+ 种 |

| 分发 | Node CLI | Rust CLI | Rust 单二进制 |

| 维度 | DeepSeek-TUI | Cursor | GitHub Copilot |

|---|---|---|---|

| 运行环境 | 终端/CLI | IDE 插件 | IDE 插件 |

| 上下文窗口 | 100 万 token | ~10 万 | ~10 万 |

| 思维链可见 | 流式实时可见 | 不可见 | 不可见 |

| 并行子任务 | Native RLM | 无 | 无 |

| 工作区回滚 | side-git | 无 | 无 |

| MCP | 有 | 无 | 无 |

四、成本分析

Cache Hit/Miss 双轨计费

API 返回的 cache hit/miss 字段被自动识别,分别按不同价格计入会话累计,底栏实时显示。

定价

| 模型 | 上下文 | 输入(缓存命中) | 输入(缓存未命中) | 输出 |

|---|---|---|---|---|

deepseek-v4-pro |

1M | $0.003625/MTok* | $0.435/MTok* | $0.87/MTok* |

deepseek-v4-flash |

1M | $0.0028/MTok | $0.14/MTok | $0.28/MTok |

*Pro 限时 75% 折扣,到期后 TUI 自动回退基础费率。

实测

不到万行代码的小项目 review,DeepSeek V4 Pro 折扣价大概是 Claude Sonnet 4.6 的 1/8 到 1/12。单点测试,仅供数量级参考。

五、适用与不适用场景

适合

- 大规模代码库理解修改:100 万 token 可一次性装下整个项目

- 长循环 Agent 任务:对 token 账单敏感,V4 定价优势显著

- 批量分类/扇形子任务:RLM 并行原语天然适配

- 需要观察 AI 推理过程:思维链实时可见,可及时纠正偏差

- 远程服务器开发:SSH 连上即用,无需图形界面

- 企业内部署:多 provider 支持,可连私有 SGLang

不适合

- 多模态需求:V4 仅文本,无图像/音频/视频

- 对知识准确性极敏感:V4 知识测试落后前沿模型 3-6 个月

- 对供应链合规要求严格:DeepSeek 曾被指控蒸馏,政府客户需合规评估

- 重度依赖官方背书:个人维护项目,无 SLA

- 不熟悉终端操作:纯键盘驱动界面有门槛

六、中文平台评价索引

| 来源 | 链接 | 核心观点 |

|---|---|---|

| 袁慎建博客 | 链接 | "按 Claude Code/Codex 的工程标准重新封装了一遍" |

| 祖普科技 | 链接 | "核心竞争力:超大上下文、可观察思维链、完整工具链、灵活交互模式" |

| veyvin.com | 链接 | "不做你工作流的打断者,而是成为你指尖的自然延伸" |

| CSDN 猫头虎 | 链接 | "终端原生编程智能体,100 万 token 上下文、思考模式推理流" |

| 电子工程专辑 | 链接 | "这不是一张只会讲中文梗的空头支票" |

| aidb.live | 链接 | "可直接调用 DeepSeek V4 模型进行代码编写和项目管理" |