关于低代码平台,之前汇总过:

- 低代码平台简介:JeecgBoot、AppSmith、ToolJet、Refine、Budibase、Kestra、Node-RED、amis、APIJSON、Tango、Frappe Builder

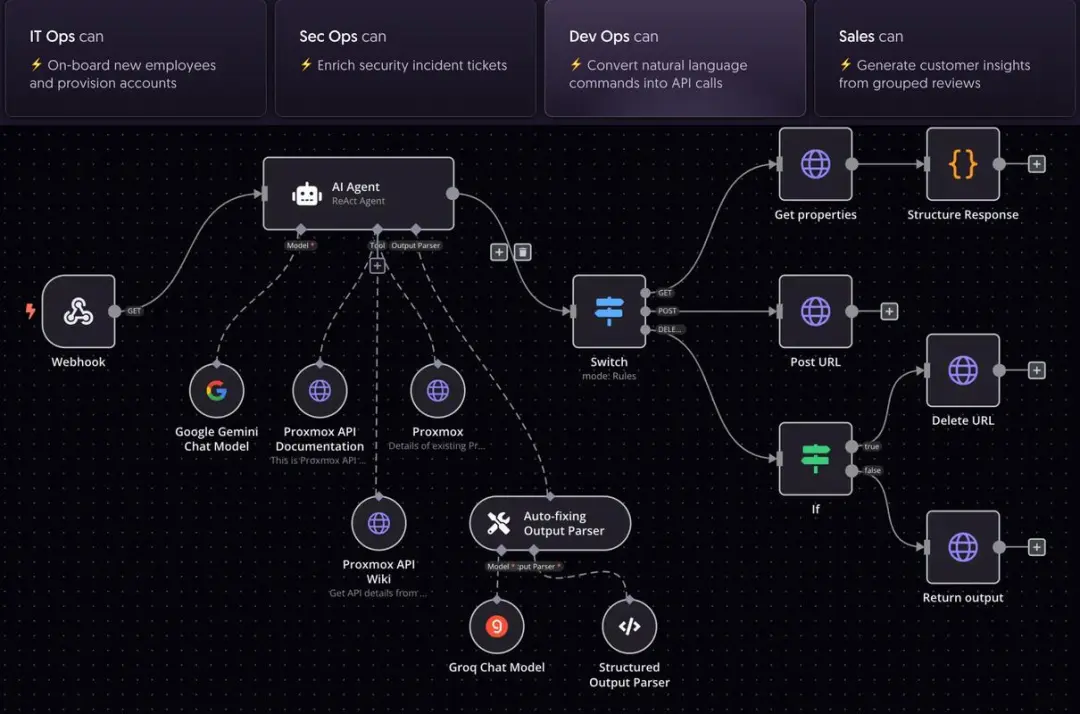

Flowise

官网,开源(GitHub,52.5K Star,24.3K Fork)低代码工具,专为开发定制化的LLM应用而设计。允许开发者通过简单直观的拖拽式界面,通过连接不同的节点,从而构建复杂的LLM流程和AI代理,加速从原型到生产的开发过程。官方文档。

特点

- 快速迭代:支持低代码方法,使从测试到生产的迭代更快;

- 拖放界面:简化LLM应用的创建过程,支持使用内置模板和逻辑;

- 多模态集成:支持连接到多种数据源和API,如数据库和云服务;

- 节点库丰富:覆盖从数据加载、文档处理到各种LLM模型(如OpenAI、HuggingFace)、向量数据库、数据加载器、工具(如搜索引擎、计算器)的数百个节点,满足各种复杂场景需求;

- 无代码/低代码开发:通过拖拽和连接节点,即可构建复杂的AI应用,大大降低开发门槛;

- 强大AI集成:内置AI节点,包括但不限于各种主流LLM(OpenAI, Anthropic, Google Gemini等)、文本嵌入模型、检索器、记忆模块、复杂代理(Agents)以及与其他服务(如数据库、消息队列)的集成,支持多模态Agent,实现高级AI功能;

- 模块化与可扩展性:每个节点都是可插拔的模块,用户可以根据需求自由组合。同时,它支持自定义组件和集成第三方服务,让你的AI应用拥有无限可能;

- 集成方案灵活:支持通过API、嵌入式Web组件或Langchain代码片段等多种方式,将构建好的AI应用集成到现有应用或系统中;

- 导入导出:支持导出和导入工作流模板,方便团队协作和社区分享;

- 多种部署方式:支持Docker、npm、Railway等多种部署方案,灵活适应不同环境需求;

- 活跃的社区生态:拥有庞大的用户社区和丰富的模板库,方便新手快速上手,老手高效复用。

使用场景:适合于需要快速开发和部署AI驱动的交互应用的企业,如客户服务自动化、智能数据分析和多语言支持系统。

实战

官方提供多种部署方式:

npx:npx install flowise@latest- Docker、Docker Compose

- 云平台:一键部署支持,Vercel、Railway、Render等

基于Docker部署:

bash

docker run -d -p 3000:3000 chang/flowise案例一:智能文档问答系统

- 数据加载:使用

PDF Loader节点加载文档。 - 文本分割:通过

Text Splitter节点将长文本分割成小块。 - 向量化:将文本块送入

OpenAI Embeddings或Google Gemini Embeddings节点,生成向量。 - 存储与检索:将向量存储到

Chroma DB或Pinecone等向量数据库中。 - LLM问答:用户提问时,将问题与检索到的相关文档片段一起喂给

ChatGPT或Gemini Pro等LLM节点,生成答案。

案例二:AI驱动的内容自动化生成

- 构思与关键词:通过输入关键词或主题,利用一个

Prompt Template节点生成内容大纲。 - 内容生成:将大纲发送给

Google Gemini Pro或GPT-4等LLM,生成初稿文本。 - 风格审核与润色:添加一个

Few-shot Prompt节点,让LLM根据预设风格对文本进行修订。 - 多语言翻译:若需要多语言内容,可接入

Google Translate API等外部服务。 - 发布:最终生成的内容可以发布到博客、社交媒体或其他平台。

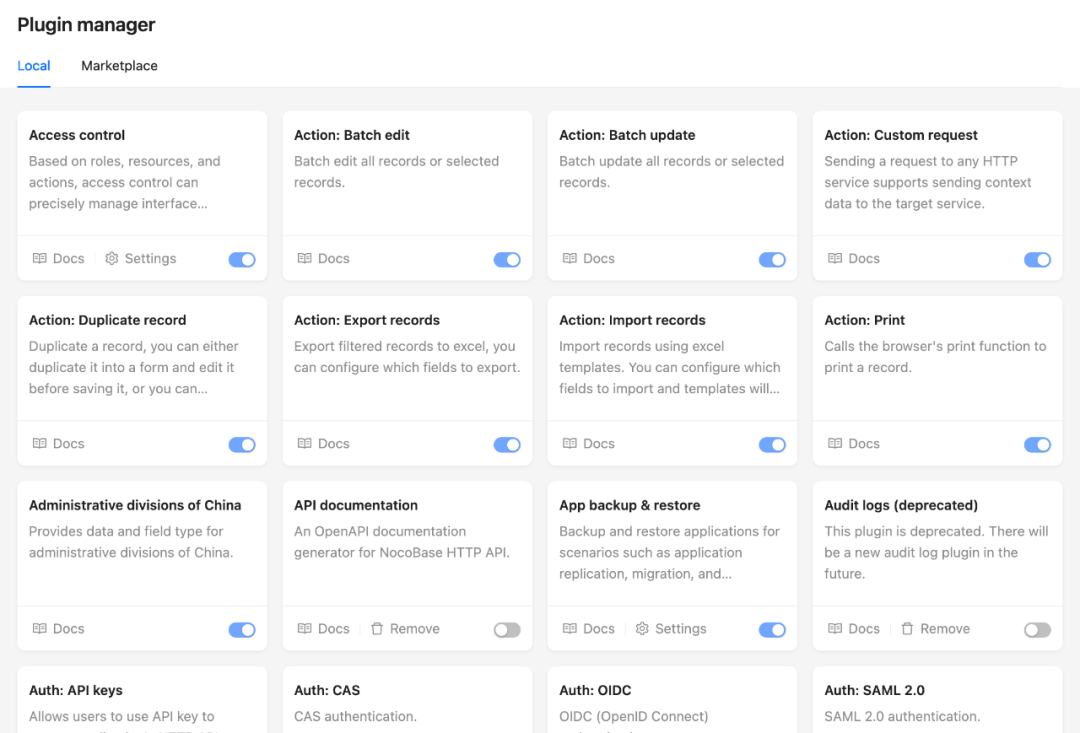

NocoBase

官网,开源(GitHub,22.3K Star,2.6K Fork)企业级低代码开发平台,采用微内核+插件化架构,数据模型与UI解耦。技术栈为React+Node.js,支持Docker部署,适合企业内部系统开发。Monorepo工程化实践,不是简单的表单拖拽工具,而是通过数据模型驱动和插件化架构,让开发者能快速搭建内部管理系统、CRM、项目协作工具等应用。官方文档。

核心特点:

- 数据模型与UI解耦,一个数据源可生成多种界面

- 微内核+插件化设计,功能按需加载

- 支持私有化部署,数据安全可控

适用场景:企业内部系统、客户管理、项目协作、数据看板。

设计模式:

- 策略模式:适配不同数据源

- 工厂模式:动态创建UI区块

- 观察者模式:数据变化自动更新界面

| 特性 | NocoBase | Airtable/Retool/氚云 | 传统定制开发 |

|---|---|---|---|

| 定位 | 开源、可自托管的开发平台 | 云端SaaS或低代码工具 | 完全定制的软件项目 |

| 数据主权 | 完全私有,可自托管 | 在厂商云端,数据导出受限 | 完全私有,可自托管 |

| 扩展性 | 极高,插件化架构,面向开发者 | 有限,受限于平台提供的扩展能力 | 理论上无限,但成本高、周期长 |

| 成本模式 | 开源免费+商业插件/服务 | 按订阅付费,用户数和功能模块受限 | 前期投入高,后期维护成本高 |

| 适用场景 | 需要私有化、可扩展、复杂业务系统的团队 | 快速搭建轻量级应用、内部工具 | 预算充足、有强大研发团队的大型企业 |

技术架构

采用微内核(Microkernel Pattern)+插件化模式,核心代码只负责数据模型、路由、权限等基础功能,其他能力全部通过插件扩展:

- 核心层:数据模型、路由、权限

- 插件层:页面、区块、操作、数据源

- 业务层:CRM、项目管理、审批流程

数据模型驱动开发

传统低代码平台的问题是UI和数据耦合在一起,即表单/表格驱动,即先设计表单,再生成数据表;修改一个表单需要重新配置。灵活度有限,一旦业务复杂,修改成本极高。

NocoBase做法:

- 先定义数据模型(类似数据库表结构):在后台定义好数据集合(Collection)和字段(Field),包括字段类型、关联关系(一对一、一对多等)。

- 系统自动生成对应的数据库表、RESTful API、表格、表单、看板等多种UI

- 同一个数据源可在不同页面以不同形式展示

好处:

- 界面与数据彻底解耦:同一张表,可以根据不同角色和需求,创建任意数量、任意形态的页面(如看板、日历、甘特图等)。

- 支持多数据源:除了主数据库,还能将外部数据库、第三方 API 作为数据源,轻松整合遗留系统。

类似于MVC模式的变体,Model层完全独立,View层可以灵活切换。

- Monorepo工程管理:使用Lerna管理Monorepo,将核心、插件、前端、后端统一管理。

实战

基于Docker部署:

bash

docker run -d --name nocobase \

-p 13000:80 \

nocobase/nocobase浏览器访问http://localhost:13000即可体验。

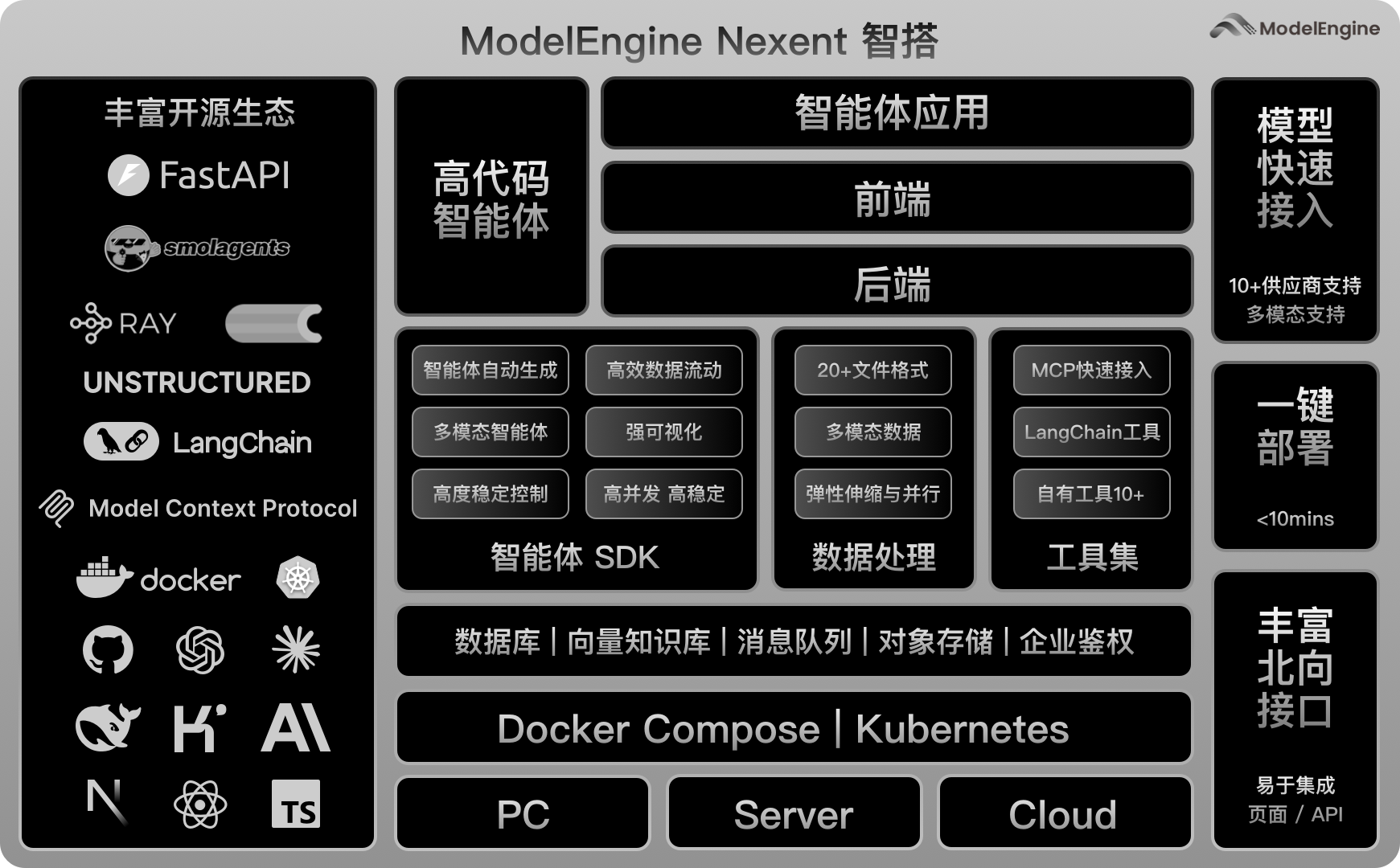

Nexent

官网,开源(GitHub,4.4K Star,582 Fork)基于Harness Engineering原则打造零代码智能体自动生成平台,无需编排,无需复杂的拖拉拽操作,使用纯语言开发想要的任何智能体。集统一工具、技能、记忆和编排能力于一体,内置约束机制、反馈循环和控制平面。

基于MCP生态,具备丰富的工具集成,同时提供多种自带智能体,满足工作、旅行、生活等不同场景的智能服务需要。还提供强大的智能体运行控制、多智能体协作、数据处理和知识溯源、多模态对话、批量扩展能力。

特性

- 智能体提示词自动生成:将自然语言转化为可被Agent执行的提示词。可根据你的需要自动选择正确的工具并为每个请求规划最佳执行路径。

- 可扩展数据处理引擎:支持20+数据格式的快速OCR和表格结构提取,从单进程到大规模批处理管道都能平滑扩展。

- 个人级知识库:实时导入文件,自动总结,让智能体能够即时访问个人和全局知识,并了解每个知识库能提供什么。

- 互联网知识搜索:连接5+个网络搜索提供商,让智能体能够将最新的互联网信息与您的私有数据结合。

- 知识级可追溯性:提供来自网络和知识库来源的精确引用,使每个事实都可验证。

- 多模态理解与对话:说话、打字、文件或展示图片。理解语音、文本和图片,甚至可以根据需求生成新图像。

- MCP工具生态系统:插入或构建符合MCP规范的Python插件;无需修改核心代码即可更换模型、工具和链。

技术栈:

- 后端:Python

- 前端:TypeScript

实战

基于源码部署:

bash

git clone https://github.com/ModelEngine-Group/nexent.git

cd nexent/docker

cp .env.example .env

vim .env

bash deploy.sh浏览器中打开http://localhost:3000,并按照设置向导操作。

Oinone Pamirs

传统企业软件开发领域,不可能三角困境:交付速度、产品质量与成本控制三者难以兼得。

官网,以AI驱动、低代码与无代码深度融合、工程化理念贯穿始终的开源(Gitee,3.4K Star,155 Fork)企业级产品化引擎。核心使命:帮助软件公司实现从"项目制"向"产品化"的跃迁,通过标准化研发支撑规模化交付,并在AI时代保障输出质量的稳定性与可控性。另外,代码也同步在GitCode、GitHub。

定位:开源+企业级+产品化引擎+低代码/无代码一体化+信创兼容+AI增强。

灵感部分源于Odoo的模块化工程思想,将ERP、CRM等复杂系统拆解为数百个标准模块,通过组合满足不同场景。更进一步:

- 强化无代码能力:不仅支持专业开发者编码,更允许业务人员通过配置完成80%以上常规需求;

- 引入元数据驱动:所有模型、视图、权限、流程均由统一元数据描述,确保一致性;

- 内置AI质量守门机制:防止无代码配置导致逻辑冲突或安全漏洞。

结果是:一次核心研发,百次场景复用;一次质量验证,全域交付可靠。软件公司不再卖"人天",而是卖"产品+服务",真正实现从劳动密集型向知识密集型转型。

多模块

pamirs-k2:元数据驱动的核心引擎。负责动态解析数据模型(Entity)、视图定义(View)、权限策略(ACL)等,是整个系统的"大脑"。所有无代码操作最终都转化为K2元数据,由运行时引擎解释执行。pamirs-framework:后端业务框架层。提供标准CRUD、事务管理、缓存、日志、审计等通用能力,避免重复造轮子。pamirs-spi:Service Provider Interface插件机制。允许第三方通过接口扩展功能(如集成钉钉、企业微信、自定义审批引擎),实现"开箱即用+按需增强"。pamirs-boot:Spring Boot启动器。封装自动配置、健康检查、指标监控等,简化部署。pamirs-middleware:中间件适配层。抽象数据库、消息队列、缓存等依赖,支持一键切换国产组件(如达梦替代MySQL,RocketMQ替代Kafka)。

分层架构三大优势:

- 高内聚、低耦合:模块可独立测试、升级,不影响整体系统;

- 信创友好:通过中间件抽象层,轻松适配国产软硬件生态;

- AI可嵌入性强:在元数据层、服务层、UI层均可注入AI能力,如智能建模、自然语言查询、异常检测等。

双模开发理念,兼顾两类角色:

| 角色 | 能力边界 | Oinone支持方式 |

|---|---|---|

| 专业开发者 | 编写Java/SQL/JS,设计核心模块 | 使用标准SpringBoot开发pamirs-module-*模块,通过SPI注册服务,参与元数据扩展 |

| 公民开发者(业务分析师、产品经理) | 无代码配置业务规则 | 通过Web界面定义数据模型、工作流、报表、权限,所有操作实时反映到元数据层 |

关键创新在于:两者共享同一套元数据体系。专业开发者构建"能力底座"(如通用审批引擎、文件存储服务),公民开发者在其上"组装应用"(如HR招聘流程、设备报修系统)。所有变更最终都转化为一致的JSON/YAML元数据,由K2引擎统一调度。

解决传统低代码平台的致命缺陷------前端配置与后端逻辑脱节,导致系统难以维护、性能低下、安全风险高。在Oinone中,无代码不是不开发,而是更高层次的开发。

将AI定位为"全流程质量守门人",覆盖需求、设计、开发、测试、运维全生命周期:

- AI辅助需求建模:用户输入自然语言描述(如"我们需要一个项目管理系统,包含任务分配、进度跟踪、文档共享"),AI自动解析并生成初步的数据模型(Project、Task、Member、Document)及关联关系。

- AI验证业务逻辑:当公民开发者配置审批流程时,AI实时分析是否存在死循环、权限冲突或状态不一致,并给出修正建议。

- AI生成测试用例:基于元数据模型,AI自动生成边界值测试、异常路径测试、并发压力测试脚本,大幅提升测试覆盖率。

- AI驱动智能运维:在生产环境中,AI分析日志与指标,预测潜在性能瓶颈(如慢SQL、内存泄漏),甚至自动触发扩容或告警。

所有AI输出均运行在Oinone的标准化框架内,结果可审计、可回溯、可人工干预。有效规避大模型幻觉带来的交付风险,确保AI成为"增强智能"而非"不可控变量"。

信创友好

- 操作系统:全面支持麒麟、统信UOS等国产Linux发行版;

- CPU架构:适配鲲鹏、飞腾、龙芯等ARM/x86国产芯片;

- 数据库:兼容达梦、人大金仓、OceanBase、TiDB等,通过

pamirs-middleware抽象层实现无缝切换; - 中间件:支持东方通TongWeb、金蝶Apusic、RocketMQ等国产替代方案。

使用方式:

- 在线体验:U/P使用

admin/admin - Docker或Docker Compose:依赖系统预装Docker Desktop

- 源码:依赖预装JDK、Maven、Git等

bash

docker run -d --name oinone -p 8080:8080 oinone/oinone-full:latest访问http://localhost:8080,使用默认账号admin/admin登录。

bash

git clone https://gitee.com/oinone/oinone-pamirs.git

cd oinone-pamirs/pamirs-boot

mvn spring-boot:run -P devLynx AI

开源(Gitee,215 Star,106 Fork)面向生产环境、集成当前主流AI工程化最佳实践,企业级AI智能体管理平台。定位:低代码/零代码的AI应用编排与管理基座。

核心功能

- 数据大屏

- 智能体对话

- AI数据分析

- 智能体管理

- RAG

- 工作流编排

- 智慧大厅

- 数据源

- Token统计

技术栈

- 后端:Spring Boot 3.x + Java 17+LangChain4j+MySQL+Redis+ES 8.*

- 前端:Vue 3+Vite+Element Plus+Vue Flow

四层安全防护:

- 从意图识别阶段就过滤掉任何修改、删除类的操作;

- 通过Prompt严格约束AI只能生成查询语句;

- 对生成的语句进行正则校验,杜绝DML/DDL操作;

- 最后,数据库连接本身也采用只读账号。