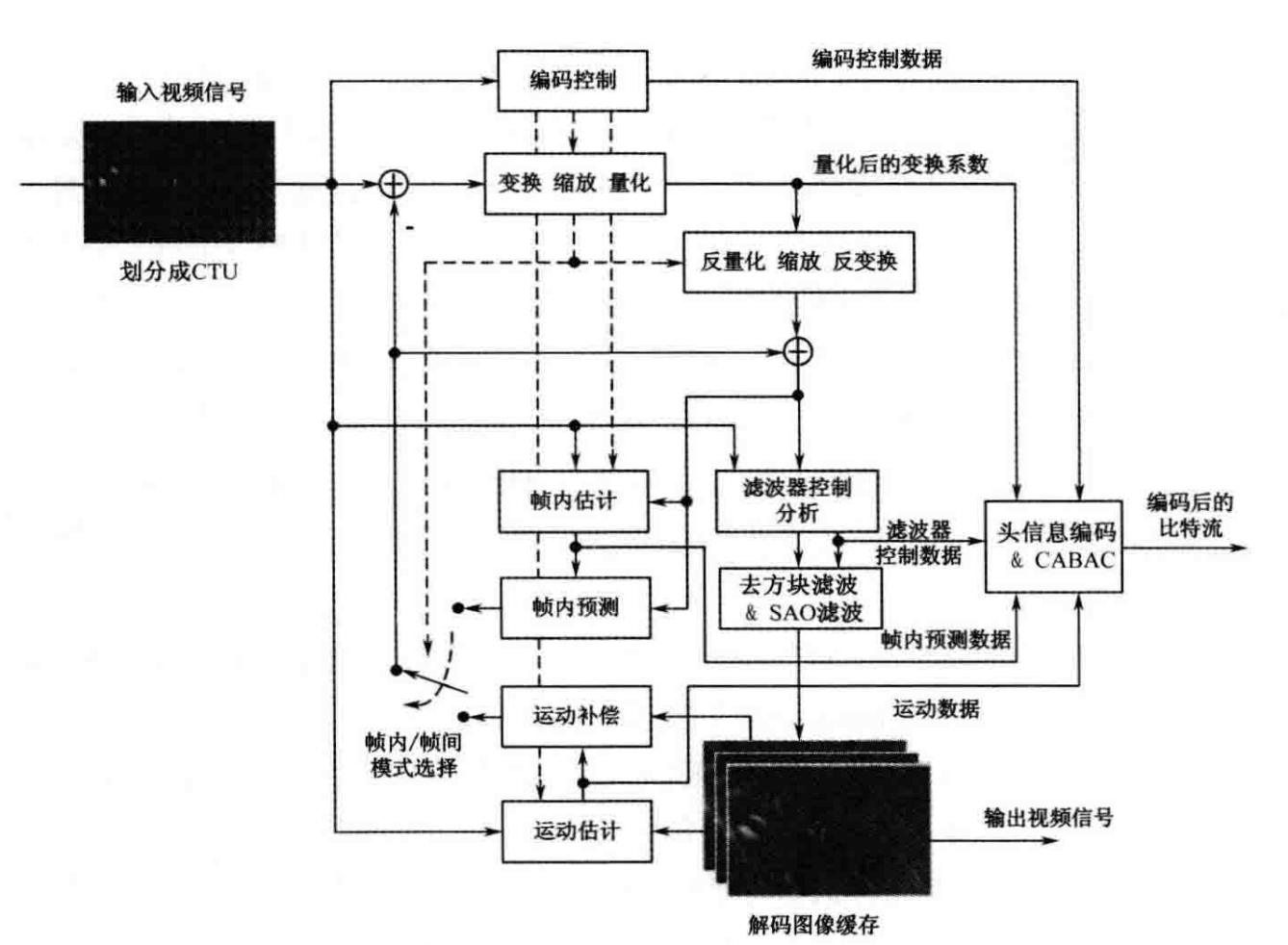

一、编码框架:

H.265/HEVC采用混合编码框架,包括变换、量化、熵编码、帧内预测、帧预测以及环路滤波等模块。但是,H.265/HEVC几乎在每个模块都引入了新的编码技术。

1、帧内预测:

该模块主要用于去除图像的空间相关性。通过编码后的重构块信息来预测当前像素块以去除空间冗余信息,提高图像的压缩效率。与以往的标准相比,H.265/HEVC支持更多的帧内预测模式。

2、帧间预测:

该模块主要用于去除图像的时间相关性。帧间预测通过将已编码的图像作为当前帧的参考图像,来获取各个块的运动信息,从而去除时间冗余,提高压缩效率。在H.265/HEVC中,帧间预测可采用单向和双向的参考图像来进行预测,包括类似H.264/AVC中分层B帧的预测结构。

3、变换量化:

该模块通过对残差数据进行变换量化以去除频域相关性,对数据进行有损压缩。变换编码将图像从时域信号变换至频域,将能量集中至低频区域。量化模块可以减小图像编码的动态范围。变换编码和量化模块从原理上属于两个相互独立的过程,但是在H.265/HEVC中,两个过程相互结合,减少了计算复杂度。

4、去方块滤波:

在基于块的视频编码中,形成的重构图像会出现方块效应,采用去方块滤波可达到削弱甚至消除方块效应的目的,提高图像的主观质量和压缩效率。H.265/HEVC仍然是基于块的视频编码,因此延续了环内去方块滤波的思路。

5、样点自适应补偿:

样点自适应补偿(SampleAdaptive Ofset,SAO)滤波处于去方块滤波之后,通过解析去方块滤波后的像素的统计特性,为像素添加相应的偏移值,可以在一定程度上削弱振铃效应,提高图像的主观质量和压缩效率。这是 H.265/HEVC新增的一项编码方式。

6、熵编码:

该模块将编码控制数据、量化变换系数、帧内预测数据以及运动数据等编码为二进制流进行存储或传输。熵编码模块的输出数据即原始视频压缩后的码流。H.265/HEVC中采用先进的基于上下文的自适应二进制算术编码(CABAC)进行编码,引入了并行处理架构,在速度、压缩率和内存占用等方面均得到了大幅改善。

二、特色编码技术:

相比于以往的视频编码标准,H.265/HEVC的编码性能有了很大的提升,这源于新编码工具的使用以及自身具有特色的核心技术。H.265/HEVC中新的编码技术有很多,例如基于四又树的灵活块分割结构、不同角度的帧内预测模式、自适应的运动矢量预测 AMVP、合并技术Merge、可变尺寸的离散余弦变换、模式依赖的离散正弦变换、性能更好的CABACB4,以及新的样点自适应补偿滤波器等。

1、编码单元:

H.264/AVC标准中的核心编码单元是宏块,包含一个16x16的亮度块采样,对于一般的视频信源(如YUV 4:2:0)而言,会伴随两个8x8的色度块采样。由于高分辨率视频业务的自身特性,基于传统宏块的编码方式具有很大的局限性。因此,H.265/HEVC采用了编码树单元(CodingTree Unit,CTU)和编码树块(CodingTree Block,CTB)。H.265/HEVC中CTU的概念类似于传统的宏块,但它的大小是可以由编码器设定的,并且可以超越16x16。一个CTU由一个亮度CTB、两个色度CTB和一些关联的语法元素组成。

为更灵活有效地表示视频内容,H.265/HEVC为图像的划分定义了一套全新的分割模式,包括编码单元(CodingUnit,CU)、预测单元(Prediction Unit,PU)和变换单元(Transform Unit,TU)。这种特性有助于编码器根据视频内容特性、视频应用和终端的特性来自适应地选择编码模式。

CTU中的四叉树确定了亮度和色度CB的大小和位置,四又树的根节点与CTU关联。亮度CB最大可以支持到亮度CTB的大。把CTU划分成亮度CB和色度CB的过程是一体的。一个亮度CB、两个色度CB和关联的语法元素构成一个CU。一个CTB可以只包含一个CU,也可以包含几个 CU,每一个 CU 都有一个分区关联的 PU 和一个 TU。

预测单元PU是帧内预测、帧间预测的基本单元,PU的划分包括4种对称结构:2Nx2N,2NxN,Nx2N以及xN。另外,还有4种非对称结构:2NxnU,2NxnD,nLx2N以及nRx2N。

变换单元 TU 可采用 4x4~32x32 大小的离散余弦变换,此外还支持4x4的离散正弦变换。大尺寸离散余弦变换是H.265/HEVC视频编码标准中提升编码效率的重要技术之一,在H.264/AVC中仅采用了4x4/8x8的DCT 变换,而在H.265/HEVC标准中DCT变换的最大尺寸为32x32,这种大尺寸变换单元的选择可以使编码器在处理高分辨率画面中经常出现平坦区域时能够更好地提高压缩率。

2、改进的帧内预测技术:

在 H.264/AVC 中,基于4x4大小的编码块采用9种预测模式,基于16x16大小的编码块采用4种预测模式。考虑高清视频纹理的多样性,只采用 H.264/AVC 中提供的几种帧内预测模式是远远不够的。为了更准确地反映纹理特性,降低预测误差,H.265/HEVC提出了更为精确的帧内预测技术。对于亮度信号,H.265/HEVC共提供了35种帧内预测模式,包括33种角度预测以及 DC预测模式和Planar 预测模式。增加的预测模式可以更好地匹配视频中复杂的纹理,得到更好的预测效果,更加有效地去除空间几余。

3、先进的帧间预测技术:

为了提升帧间预测性能,在H.265/HEVC 中引入了新的帧间预测技术,包括运动信息融合技术(Merge)、先进的运动矢量预测技术(AdvancedMotion Vector Predictor, AMVP)以及基于 Merge 的 Skip 模式。Merge技术利用空域相关性和时域相关性来减少相邻块之间的运动参数几余,具体来说,就是取其相邻PU的运动参数作为当前PU的运动参数。AMVP技术的作用与Merge技术类似,也是利用空域相关性和时域相关性来减少运动参数的冗余。AMVP技术得到的运动天量一方面为运动估计提供搜索起点,另一方面作为预测运动矢量使用。

4、RQT 技术:

ROT(Residual Quad-tree Transform)技术是一种基于四叉树结构的自适应变换技术,它为最优TU模式选择提供了很高的灵活性。大块的TU模式能够将能量更好地集中,小块的TU模式能够保存更多的图像细节。根据当前CU内残差特性,自适应选择变换块大小,可以在能量集中和细节保留两者做最优的折中。与传统的固定块大小变换相比,RQT对编码效率贡献更大。

5、ACS 技术:

ACS(Adaptive Coefcient Scanning)包括三类:对角扫描、水平扫描和垂直扫描。ACS 技术是基于4x4块单元进行的,将一个 TU 划分为多个4x4 块单元,每个4x4块单元内部以及各个4x4块单元之间都按照相同的扫描顺序进行扫描。对于帧内预测区域的4x4和8x8尺寸的TU,其根据所采用的帧内预测方向来选择扫描方法:当预测方向接近水平方向时就选用垂直扫描,当预测方向接近垂直方向时就选用水平扫描,对于其他预测方向使用对角扫描。对于帧间预测区域,无论TU尺寸多大都使用对角扫描方式。

6、SAO 技术:

图像经过编码后,重构图像的失真不仅存在方块效应,还存在振铃效应。H.265/HEVC引入了一种新的滤波方法:像素自适应补偿技术(SAO)。SAO位于去块效率滤波器之后,用于补偿重构像素值,达到减少振铃效应失真目的。SAO分为边缘补偿(EO)和带状补偿(BO)两种方式。

7、IBDI技术:

IBDI(InternalBitDepthIncrease)技术是指在编码器的输入端将未压缩图像像素深度由P比特增加到比特(O>P),在解码器的输出端又将解压缩图像像素深度从口比特恢复到P比特。IBDI技术提高了编码器的编码精度,降低了帧内/帧间预测误差。但由于要建立参考队列,像素深度为只比特的重构图像须占较大的内存空间。此外,在进行帧间运动估计和补偿时,需要较多的内存访问带宽,这样会给内存受限的系统带来不便。解决的办法是引入参考帧压缩算法,来减小重构图像的数据量。

三、数字视频:

数字视频作为视频编码器的输入和解码器的输出,具有时间分辨率空间分辨率、颜色空间等多个参数,不同格式的视频具有不同的特性,也应采用不同的处理方式。

视频由许多幅按时间排列的连续图像组成,每幅完整图像称为一帧(Frame)。图像是视频信号的基本单位,每一幅图像的内容不同,整个图像序列按时间顺序播放看起来就是活动的图像。由于视觉暂留机理,当连续播放图像每秒超过 24以上时,人眼无法辨别单幅的静态画面,图像序列看上去是平滑连续的视觉效果,这样连续的画面叫作视频。

视频技术最早是从基于光电管及阴极射线管电视系统的创建而发展起来的,随后新的显示技术和数字电路的发展使视频技术包括了更大的范畴。基于电视的应用和基于计算机的应用从两个不同的方面促进了视频技术发展,随着计算机性能的提升以及数字电视的普及,这两个领域又有了新的交叉和集中。视频技术泛指将一系列的图像以电信号方式加以捕捉、纪录、处理、存储、传送与重现的各种技术。数字视频就是以数字形式记录的视频,数字视频由一幅幅数字图像组成,每幅图像由行、每行M个像素组成,每个像素由数字化的数值表示。

数字视频有时间分辨率、空间分辨率、色彩空间、量化深度等参数,这些参数的组合称为视频格式。时间分辨率的单位为每秒图像的帧数(Frame perSecond),即帧率。一般来说,帧率越高,视频的流畅性越好但是人眼对于帧率的分辨率是有限的,当帧率高达一定程度时(例如普通分辨率视频30fps以上,高清视频60fps以上),人们已经基本不能看出帧率的变化,所以不必一味追求增加帧率。空间分辨率由图像的像素行数及每行的像素数表示,空间分辨率越高,图像的细节越清晰。色彩空间描述像素颜色的形式,一个彩色像素通常由三种分量描述。像素每一分量的数值对应的量化等级为量化深度,量化深度越大,像素值可以越精确。一个视频序列可以定义为:

其中,k为帧数,(m,n)为空间坐标,(X,Y,Z)为色彩空间,(m,n,k)为第k帧在坐标点(m,n)处X分量的幅度。对于视频信号的亮度和色度分量而言,时间和空间分辨率可以不同。

1、颜色空间:

颜色空间也称彩色模型,其目的是使用某些标准方式对彩色加以说明。本质上,彩色模型是坐标系统和子空间的阐述,位于系统的每种颜色都由单个点表示。颜色空间从提出到现在已经有上百种,大部分只是局部改变或专用于某一领域,常用颜色空间有 RGB、YCbCr、HIS等,这里只介绍视频压缩中常用的 RGB、YUV、YCbCr 色彩空间。

视觉色彩感知:

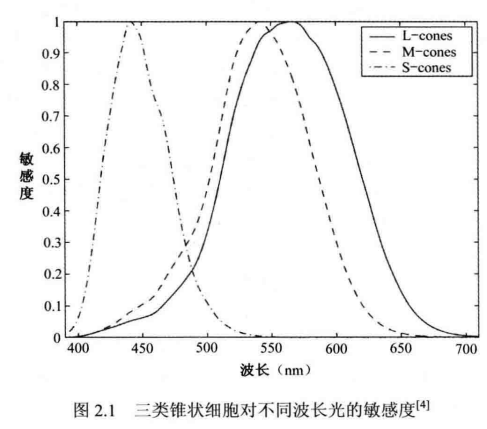

人类对五彩斑斓世界的感知始于视网膜内的感光细胞,这里的光感受器由光敏感化学物质构成的神经细胞组成,它将光信号转换为大脑可理解的信号。光感受器由两类细胞组成:杆状细胞(Rods)和锥状细胞(Cones)。杆状细胞是很敏感的光探测细胞,可接收到仅由一个光子发出的微弱信号,其代价是牺牲了分辨率,杆状细胞并不能分辨细节内容,它只在光线较弱时起作用。

根据化学成分和对不同波长光的敏感性差异,锥状细胞可再分为三类:L锥状细胞、M 锥状细胞和S锥状细胞。下图给出了这三类细胞对不同波长光的敏感程度,从图中可以看出,这三种锥状细胞感光能力的峰值波长分别为440nm(蓝色)、540nm(绿色)、570nm(红色)。这三类锥状细胞在可见光谱上具有重叠的通带,不同入射光对三类锥状细胞产生不同强度的激励响应,不同的激励响应组合被感知成不同的色彩。

入射光源可以分为照明光源和反射光源,照明光源的感知色彩直接取决于光源的光谱。反射光源是指能够反射入射光的光源,如当一束光照射到物体上时,某个波长范围内的能量被吸收,其他波长的能量被反射。因此,非光源体的感知色彩取决于入射光的光谱成分和物体吸收光谱的物理特性。虽然同一物体在不同照射光源下产生不同的反射光谱,然而人眼在不同入射光照条件下对物体颜色的感知趋于稳定,即人眼可以分辨这种由光源变化导致的物体表面反射谱的变化,这称为色彩恒定。需要注意的是,数字相机感光色彩只与入射光的光谱相关,因此需要采用后处理方式调整拍摄图像以达到色彩恒定。

三基色原理:

三类锥状感光细胞的不同响应组合形成了视觉色彩感知,这意味着感知色彩只依赖于三类锥状细胞的响应强度,这称为彩色视觉的三感光细胞原理。虽然自然界中的光往往包含丰富的频谱分量,但其视觉感知仍然来自三类锥状细胞对其的响应强度。如果使用少量单波长入射光组合使这三类锥状细胞的响应强度与自然光引起的响应强度相同,那么其视觉感知亦相同。

实验表明自然界中的绝大部分彩色,都可以由三种基色按一定比例混合得到;反之,任意一种彩色均可被分解为三种基色。如大多数单色光也可以分解成红绿蓝三种色光,这是色度学的最基本原理,即三基色原理。三种基色是相互独立的,任何一种基色都不能由其他两种颜色合成。红绿蓝是三基色,这三种颜色合成的颜色范围最为广泛,红绿蓝三基色按照不同的比例相加合成混色称为相加混色。

RGB颜色空间:

RGB(红绿蓝)是依据人眼识别的颜色定义出的空间,可表示大部分颜色。RGB 颜色空间是图像处理中最基本、最常用、面向硬件的颜色空间。我们采集得到的彩色图像,一般是被分成R、G、B的成分加以保存的,彩色监视器的显示系统也基于该颜色空间。采用RGB颜色空间表示视频时,其每个像素用三个分量表示,即R、G、B三个色度值。需要注意的是,RGB颜色空间的分量与亮度密切相关,即只要亮度改变,3个分量都会随之相应地改变,并不适用于图像处理。

YUV颜色空间:

YUV颜色空间主要用于优化彩色视频信号的传输,并使其向后兼容老式黑白电视。其中Y表示明亮度,也就是灰阶值;而U和V表示的是色度,用于指定像素的颜色。亮度Y是通过RGB输入信号来建立的,方法是将RGB信号按特定比例叠加到一起。色度U反映的是RGB输入信号蓝色部分与信号亮度值之间的差异,色度V反映了RGB输入信号红色部分与信号亮度值之间的差异。YUV色彩空间的重要特征是它的亮度信号Y和色度信号U、V是分离的。如果只有Y信号分量而没有U、V分量,那么这样表示的图像就是黑白灰度图像。彩色电视采用YUV 空间正是为了用亮度信号Y解决彩色电视机与黑白电视机的兼容问题,使黑白电视机也能接收彩色电视信号。Y'UV也是经常使用的颜色空间,其原理与 YUV 相同,其中Y'为Y经过伽马校正后的值。

YCbCr颜色空间:

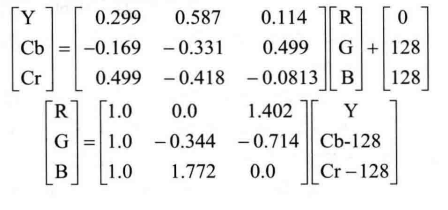

YCbCr 颜色空间与 YUV 颜色空间类似,其中Y表示明亮度,Cb表示RGB输入信号蓝色部分与信号亮度值之间的差异,Cr表示RGB输入信号红色部分与信号亮度值之间的差异。YUV颜色空间过去用于表示电视系统中向后兼容的模拟彩色信息,而YCbCr颜色空间则主要应用于图像、视频压缩的数字彩色信息表示,是YUV压缩和偏移的版本。然而,目前YUV颜色空间也常用于数字彩色信息的表示,此时其与 YCbCr 相同。

YCbCr颜色空间是数字视频压缩源的主要表示形式。YCbCr与RGB(8比特量化深度)相互转换的公式为:

2、量化深度:

数字视频中像素的幅度值需要被量化,量化深度为像素值可以对应的量化等级。如传统的图像每个颜色空间分量用8比特来表示像素值,仅有256个灰度等级,这主要是因为常用成像设备动态范围较小,拍摄图像只能记录有限的动态范围。数字成像系统的动态范围是指采集到的一帧图像中最大像素值与最小像素值的比,成像设备过小的动态范围会导致场景中的很多信息无法被捕获,因为大多数实际场景的动态范围都远超这一范围。

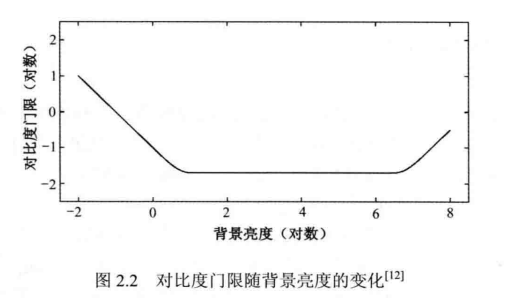

现实世界中的场景,特别是户外场景往往包含很大的动态范围,如一些自然条件下的光照强度:阳光(10cd/m),室内光线(10cd/m),星光(10cd/m)。视网膜上的光敏感细胞以及视神经元都有自动适应光强的能力,人眼具有很高的动态范围。下图给出了对比度门限随背景亮度变化的曲线,对比度门限是指人眼能观察到的最小亮度变化的对比度。可以看到由于人眼的自适应能力,在人眼可感知的光强范围内,对比度门限几乎维持为常数,即人眼在很高的动态范围内维持着很高的细节分辨能力。为了更好地捕获高动态范围的自然场景,目前高动态范围成像技术已经成为一研究热点,高动态范围图像在表示时每个通道的比特数应多于8个。

3、空间分辨率:

视网膜中锥状细胞的分布密度差别很大,视网膜的小凹处圆锥细胞的密度最大,它们紧凑地排列成规则的六边形。因此,小凹区域对物体的分辨能力最高。光感受器的结构决定了视觉系统的最大分辨率,假设屈光度为60,则此时眼睛的焦距约为17mm,使用简单的正切变换,可将视网膜上的成像范围用可视角表示,整个小凹覆盖的可视角是2°。小凹上乚和M 细胞之间的距离是 2.5μm,即可见角为2arctan(2.5/2x17)~30"因此可获得的最大分辨率约为3600/(30x2)=60cpd,这个分辨率几乎可捕捉物体所有的空间变化。而S细胞之间的距离为50mm,转换成可视角为10',即分辨率仅为3cpd,因此眼睛对短波长色光的接收能力较差。

数字图像由排列整齐的像素组成,通常表示为矩形像素阵,矩阵内的元素对应图像中的像素。像素矩阵的行列数被用来表示图像的空间分辨率,如高清视频的空间分辨率为1920x1080,表示每幅图像的像素矩阵有1920列、1080行。可见图像的空间分辨率越高,图像包含的细节越多,高空间分辨率也是数字视频追求的目标。另外,像素宽高比也是影响图像显示比例的关键因素,像素宽高比是指像素的宽度和高度的比值。图像空间分辨率结合像素宽高比就可以确定图像的显示宽高比例,如空间分辨率为352x288且像素宽高比为12:11时,图像的显示比例为传统的电视荧幕长宽比(4:3)。

4、时间分辨率:

视频的时间分辨率是指每秒包含的图像帧数,也称帧率。视频的帧率越高,视频的时域流畅性越好。每秒24帧的电影看起来也许还行,但事实上每一帧都会有视觉模糊,尤其是在快速运动的镜头中。高帧率也是数字视频追求的目标。

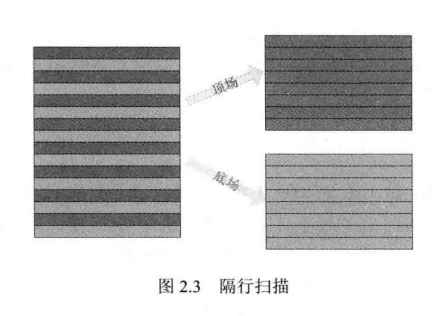

在早期的视频处理技术中,隔行扫描技术通过牺牲空间分辨率来获得更好的时域流畅性。隔行扫描就是每一帧图像被分割为两场(Field),每一场只包含一帧中所有的奇数扫描行或者偶数扫描行,通常是先扫描奇数行得到顶场,然后扫描偶数行得到底场。

类似地,对于逐行扫描的图像,每幅图像上所有的扫描线在一起也叫作一帧。如果隔行扫描图像要和逐行扫描图像保持同样的帧率,采集时隔行扫描每秒采集的次数需要是逐行扫描的两倍。如果观察隔行扫描视频的静止图像的话,很容易发现一些由于两场不同时采集造成的锯齿效应。

四、数字视频格式:

在数字视频采集的过程中,可以采用两种采样方法:一种是使用相同的空间采样频率对图像的亮度信号和色度信号进行采样,另一种是对亮度信号和色度信号分别采用不同的空间采样频率进行采样。如果对色度信号使用的空间采样频率比对亮度信号使用的空间采样频率低,这种采样就称为色度亚采样。

1、色度亚采样:

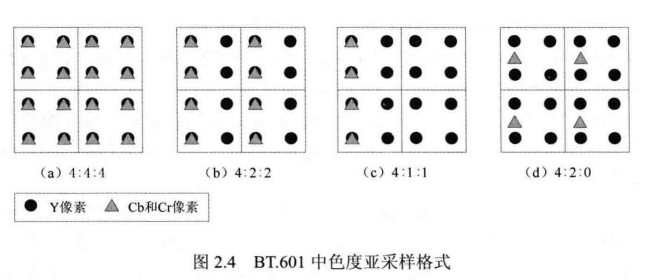

色度亚采样在数字图像压缩技术中得到了广泛的应用,其基本依据是人眼对色度信号的敏感程度比亮度信号低,利用该特性可以把图像中表达颜色的信息去掉一些而不被人察觉。意味着对色度信号的采样率可以比亮度信号低,即相邻几个像素点可以共用相同的色度值。色度亚采样就利用人类视觉的这一特性来达到数据压缩的目的,从而衍生出多种YCbCr采样格式,如4:4:4、4:2:2、4:1:1和4:2:0。

4:4:4的 YCbCr 格式:

图2.4(a)给出了ITU-RBT.601中4:4:4采样格式的位置示意。在每个像素位置,都有Y、Cb和Cr分量,即不论水平还是垂直方向,每4个亮度样本都对应有4个Cb和4个C色度样本。在这种格式中,色度分量和亮度分量具有相同的空间分辨率,这种格式适用于视频源设备和高质量视频信号处理。

4:2:2的 YCbCr格式:

图2.4(b)给出了BT.601中定义的4:2:2采样格式的位置示意。在水平方向上,每两个Y样本有1个Cb和1个Cr样本。显示图像时,对于没有Cb和Cr的样本,使用前后相邻的Cb和Cr 样本进行计算得到。在这种格式中,色度分量和亮度分量具有同样的垂直分辨率,但前者的水平分辨率仅为后者的一半。在BT.601中,这是彩色电视的标准格式。

4:1:1的 YCbCr 格式:

图2.4(c)给出了BT.601中定义的4:1:1采样格式的位置示意。在水平方向上对色度分量进行4:1抽样,即每4个Y样本有1个Cb样本和1个Cr样本。显示图像时,对于没有Cb和Cr的样本,使用前后相邻的Cb和Cr样本进行计算得到。在这种格式中,色度分量和亮度分量具有同样的垂直分辨率,但色度分量的水平分辨率是亮度分量的1/4。这是数字电视盒式磁带(DigitalVideoCassette,DVC)上使用的格式。

4:2:0的 YCbCr 格式:

图2.4(d)给出了BT.601中定义的4:2:0采样格式的位置示意,这是MPEG-2编码标准中使用的视频格式,在水平和垂直方向上对色度分量都进行了2:1的抽样,即每4个Y样本对应1个Cb样本和1个Cr样本,但是和4:1:1中色度样本的位置不同。在这种格式中,色度分量在水平方向和垂直方向的分辨率均是亮度分量的1/2。对于4:2:0采样格式还有一种是H.261、H.263和MPEG-1中使用的格式,Cb和Cr样本位于4个对应的Y样本的中心。

2、数字视频格式的规范标准:

近年来,数字电视、数字视频技术在通信、广播电视等领域得到了广泛的应用,并且逐渐成熟。随着市场对于数字图像和视频质量要求的逐渐提高,高清晰度的图像和视频越来越被人们所关注,甚至出现多种超高清晰度的图像和视频格式。因此,国际标准化组织对各种不同需求的视频格式进行了统一的规定,其中包括BT601标清视频格式(41BT.709高清视频格式45]及BT.1201超高清视频格式。

BT.601标准:

1982年国际无线电咨询委员会(InternationalRadioConsultativeCommittee,CCIR)制定了彩色电视图像数字化标准,称为CCIR601标准,现改为ITU-RBT.601标准。该标准规定了彩色电视图像转换成数字图像时使用的采样频率,RGB和YCbCr两个彩色空间之间的转换关系等。

为了便于节目交换、消除数字设备之间的制式差别,以及625行电视系统与525行电视系统之间兼容,向着数字电视广播系统参数统一化、标准化迈出,BT601强调以分量形式进行数字化,即以亮度分量Y和两个色度分量 R-Y、B-Y为基础分别进行采样、量化和编码。该标准对彩色电视图像转换成的数字图像分辨率、帧率、色彩空间和量化深度都进行了比较详细的规定。

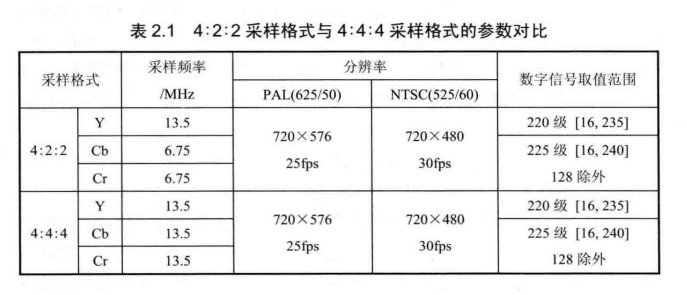

目前,按BT.601标准规定,对于625行/50场的PAL制式而言,数字图像的有效分辨率通常是720x576,视频图像的帧率是25fps;对于525行/60 场的 NTSC 制式而言,数字图像的有效分辨率是720x480,视频图像的帧率是30fps。这样,不论625行/50场或525行/60场,数字图像每一行有效亮度样本数是720,4:2:2格式的色度信号样点数均是360,这样便于制式之间的转换。

除了图像分辨率外,BT601标准还定义了一个数字色彩空间YCbCr,并规定了亮度分量Y和色度分量Cr、Cb样点之间的比例是4:2:2,如图2.4(b)所示,不管是PAL制式,还是NTSC制式电视,这三个分量的采样频率分别为 13.5MHz、6.75MHz、6.75MHz。除此之外,BT601还规定了色度采样频率更低的4:1:1和4:2:0采样格式,还有为适合更高图像质量要求而对色度分量使用和亮度分量相同采样频率的4:4:4格式如图 2.4所示。因为 BT.601规定的数字图像均是隔行扫描信号,所以,图2.4所示四种格式中两个相邻的行属于两个不同的场。

对抽样后的亮度信号和两个色度信号进行线性PCM编码,每个样本采用8bit或10bit量化。同时,规定编码信号是经过y预校正的Y、Cb、Cr信号,为亮度信号分配220个量化级,即Y的范围为16,235;为色度信号分配 225个量化级,即色度分量Cb、Cr取值范围为16,240,色度信号的零电平128除外。表2.1给出了ITU-RBT601推荐的4:2:2采样格式和4:4:4采样格式的参数对比。

BT.709 标准

BT.601格式是适用于数字电视(Digitaltelevision,DTV)的标准图像格式。为了进一步提高视频质量,BT.709在两种标准扫描方式1125/60/2:1和1250/50/2:1基础上,提出了两种高清晰度电视演播室参数方案,一种是传统的隔行扫描数字高清晰度电视(HighDefinitionTelevision,HDTV)视频格式,可以向下兼容普通清晰度电视;另一种是方形像素通用数字高清晰度电视视频格式,这种格式和多媒体计算机等多种应用之间具有互操作性的优点。

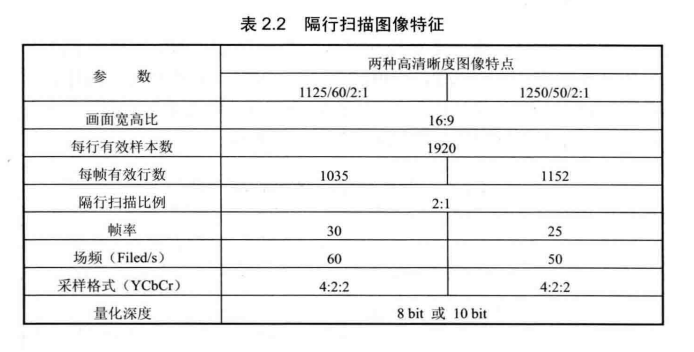

ITU-R BT.709传统的隔行扫描图像特征见表2.2,规定每行有效样点数为1920,每帧有效扫描行数为1035或1152,画面宽高比为16:9,垂直扫描类型为逐行或2:1隔行扫描。亮度取样频率为74.25MHz,色度取样频率为37.125MHz,即4:2:2格式,采用8bit或10bit量化。

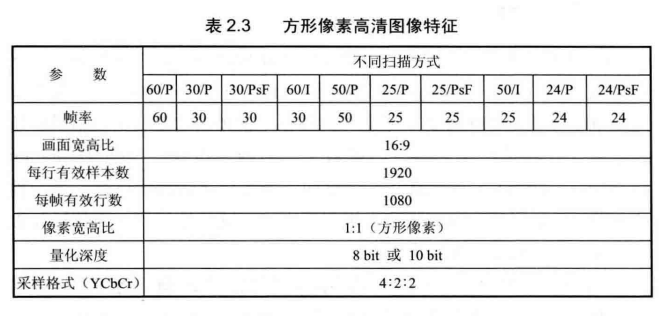

HDTV方形像素通用图像格式见表2.3,规定每行有效样点数为1920,每帧有效扫描行数为1080,画面宽高比为16:9,采用方形像素的正交取样结构、逐行和隔行扫描形式。每个像素采用8bit或10bit量化。

其中,P表示逐行扫描和传输;1表示隔行扫描和传输;PsF表示逐行扫描,分段传输。

BT.1201标准

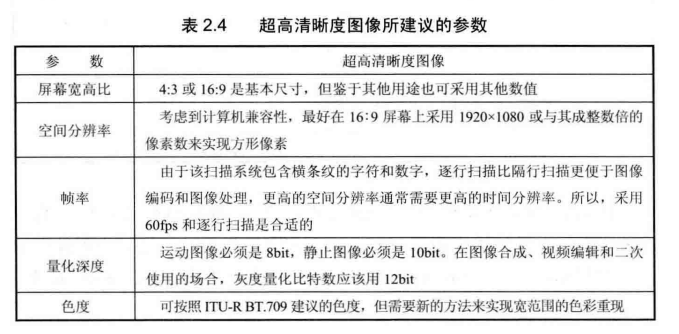

在规定了高清晰度电视视频格式的规范之后,国际电联又提出了超高清晰度图像(HighResolutionImage,HRI)格式和规范的建议书ITU-R BT.1201。该建议认为空间和时间分辨率及图像宽高比应该足够灵活,以适合于各种不同应用场合的需要(表 2.4)。

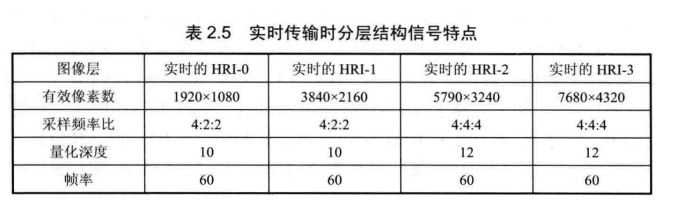

BT.1201在空间分辨率上提出了等级模型,图像的最小分辨率为1920x1080,HRI分为四个等级。层级结构基于16:9的屏幕宽高比,HRI空间分辨率等级结构的定义是基于时间轴上的图像是固定的(或者非实时的)这一假设,在实时情况下,要视具体的帧率而定。高清晰度图像的实时传输可以通过卫星、光纤信道进行。BT.1201给出了实时传输时不同空间分辨率等级下的信号特点,见表2.5。

其他常用格式:

除了BT.601、BT.709和BT.1201中所定义的视频格式,国际标准化组织还定义了其他的标准数字格式,表2.6概括了这些视频格式以及它们的主要应用和压缩方法。国际电信联盟电信部门(ITUTelecommunicationStandardization Sector, ITU-T)规定的 CF(Common Intermediate Format)在水平和垂直方向上的分辨率都比BT.601小了约一半,它是为了视频会议应用而开发的,在水平和垂直方向上具有CIF一半分辨率的QCF用于可视电话及类似的应用场合。它们都是逐行扫描的,YCbCr采样格式为4:2:0。ITU-TH.261编码标准的推出是为了以这些格式将视频信号压缩到px64kbit/s,以便在只允许传输速率是64kbits整数倍的ISDN(Integrated Services Digital Network)线路上传输。随后出现的 H.263 标准在H.261的基础上发展而来,除了支持QCIF和CIF外,还支持Sub-QCIF、4CIF和16CF。Sub-QCIF 相当于1/4的OCIF 分辨率,4CIF和16CIF的分辨率分别为CF的4倍和16倍。后来ITU-TH.263+标准在原来5种视频源格式的基础上,允许更大范围的图像输入格式,自定义图像的尺寸,从而拓宽了标准使用的范围,可以处理基于视窗的计算机图像、更高帧频的图像序列及宽屏图像。H.264/AVC是由ISO/IEC与ITU-T组成的联合视频组(Joint Video Team,JVT)制定的新一代视频压缩编码标准,H.264支持逐行或隔行扫描的标清和高清的视频源格式。

与此同时,ISO的MPEG也规定了一系列数字视频标准。MPEG-1视频编码部分对活动图像处理的格式没有规定,可处理SIF(StandardInterchange Format或Source Input Format)视频数据,这种格式的目标定位于中等质量的视频应用。类似BT601,有两种SF格式:一种的率是30Hz,行数是240,另一种的帧率是25Hz,行数是288,它们都是352像素/行。MPEG-1算法能够把一个源码率为30Mbit/s的典型的SIF视频信号压缩到大约1.1Mbit/s,质量类似于在家用录像系统(VideoHomeSystem,VHS)、盒式磁带录像机(Video Cassette Recorder,VCR)上看到的分辨率,低于广播电视的质量。在此基础上,ISO的活动图像专家组和ITU-T的15研究组于1994年共同制定了MPEG-2标准,MPEG-2适用于隔行或逐行扫描系统,可用于4:2:0、4:2:2、4:4:4等色度采样格式。

五、H.265/HEVC编码视频格式:

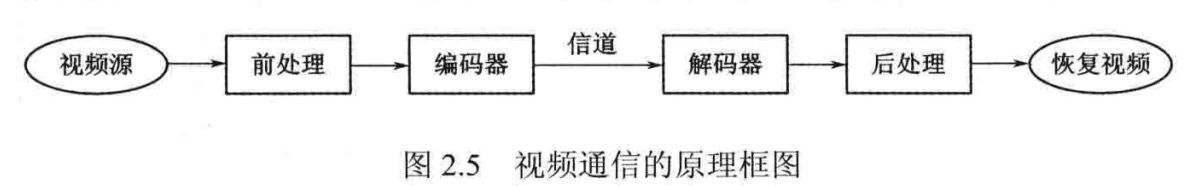

图 2.5 给出了一种视频通信的原理框图,不同格式的视频源经过前处理模块转换成统一的数据格式,编解码器只需要应对少量几种统一的视频数据格式,解码后的视频再经过后处理模块转换成与视频源格式一致的恢复视频。H.265/HEVC 视频编码标准采用了这种思路,在保持编解码算法简洁的同时,可以支持不同的视频源以及更广泛的视频应用。

这里称编码器输入视频为编码视频,H.265/HEVC 中编码视频只允许少量的格式,不同格式的编码视频采用较统一的数据结构。解码器输出视频被称为解码视频,其具有的格式信息被称为解码视频格式。后处理模块恢复视频源的过程中需要解码视频的格式信息,如色度空间、显示比例等,这些解码视频的格式信息都不影响编解码过程,可以通过附加信息传送,H.265/HEVC 标准已经定义了传递这些信息的语法语义。

1.图像编码格式:

H.265/HEVC 中,编码视频采用统一的多级数据结构:

- 编码视频为按顺序排列的图像 (Picture) 序列;

- 图像为一个或多个长方形采样矩阵,每个矩阵对应亮度或色度分量;

- 像素对应矩阵的元素,元素值为像素的取值,元素的行列坐标表示像素空间位置。

H.265/HEVC 中,图像可以是逐行扫描模式的视频帧、隔行扫描模式下的一场或多场,这里统一称为图像。

编码视频格式主要包括编码图像格式,编码图像格式主要包括矩阵数量及空间关系、图像空间分辨率、像素量化深度等。承载编码图像格式的语法元素属于序列参数集(Sequence Parameter Set,SPS),由于 SPS 表征一组图像 CVS(Coded VideoSequence)的共有参数,一个 CVS 内的所有图像应具有相同的格式。

2.H.265/HEVC中四类图像编码格式:

H.265/HEVC 仅规定了四类编码图像格式,每类对应不同的矩阵数量及相应的色度分量:

- 仅有一个采样矩阵Y,对应单色图像中的亮度分量 (Luma)。

- 一个亮度分量的采样矩阵和两个色度分量的采样矩阵 (YCbCr或 YCgCo),该格式对应所有亮度分量和两个色度分量的情况,具体对应的颜色空间为解码图像格式信息。

- 三个色度采样矩阵,分别为绿、蓝、红分量 (GBR)。

- 其他未指定的单色(Momochrome) 或三激励彩色空间采样矩阵(如 YZX)。

SPS中语法元素分析:

SPS色度格式分析:

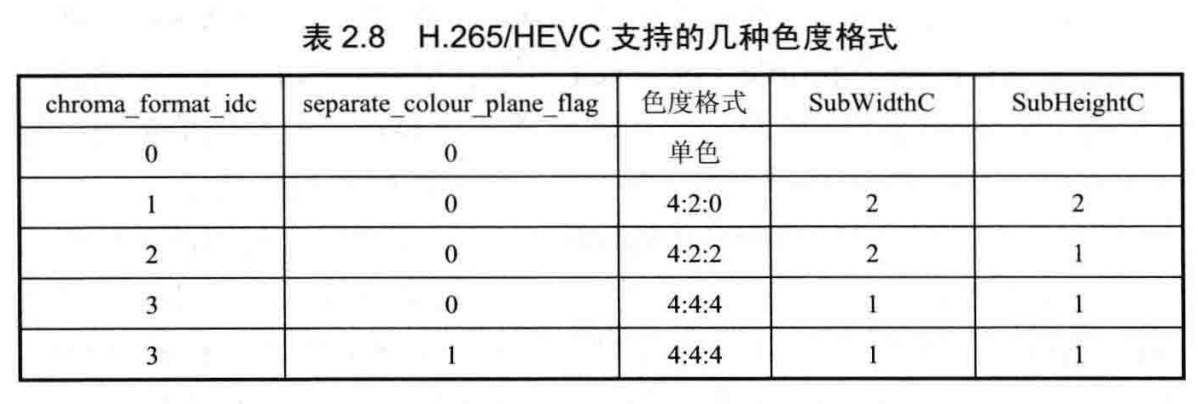

针对具有一个亮度分量和两个色度分量的图像格式,还允许亮度分量矩阵和色度分量矩阵有不同的空间对应关系。下表的色度格式主要是描述亮度矩阵与色度矩阵的空间对应关系:

chroma format idc 和 separate colour plane flag 为 SPS中的语法元素,SubWidthC 表示亮度矩阵宽度(每行像素个数) 与色度知阵宽度的比值,SubHeightC 表示亮度矩阵高度(每列像素个数)与色度知阵高度的比值。当 chroma format idc 为 3 且 separate colour plane flag 为1 时,图像为三个独立的色度分量矩阵,编码时作为 3 个独立的单色分量处理。

SPS中的conformance window flag分析:

如果 SPS 语法元素 conformance window flag 值为 1,解码后图像应按裁剪窗口进行裁减后输出。具体的裁减窗口由语法元素conf_win_left_offset, conf_win_right_offset, conf_win_top_offset 和 conf_winbottom_offset 确定,解码图像矩阵的裁减窗口为矩形,4 个顶点坐标为:

SubWidthC * conf_win_left_offset、 pic_width_in_luma_samples -( SubWidthCconf win right offset + 1 ) 、 SubHeightC * conf_win_top_offset 和pic_height_in_luma_samples - ( SubHeightC * conf_win_bottom_offset + 1 ).裁剪过程只作用于解码输出图像时,这组参数不影响编解码过程。

4.解码图像编码格式:

解码图像格式除编码图像携带的格式信息,还包括扫描类型、图像类型、色彩空间等格式信息。其中,扫描类型和图像类型为每幅图像必需的格式信息,用于确定图像是逐行模式的一帧、隔行模式的顶场、隔行模式的底场、隔行模式的多场等。

与解码图像格式相关的主要 3 段语法如下 :

- 属于 SPS 的语法元素集 profile tier level( )包含了解码图像的格式信息,是视频流中必须存在的语法元素,其作用于一个 CVS 中的所有图像。 profile_tier_level( )中与图像格式相关的三个语法元素。需要注意的是,虽然这三个语法元素肯定存在,但解码器解码过程会忽略这三个语法元素,语法元素的值不影响解码器输出结果;

- VUI (Video Usability Information) 参数主要包含解码图像的格式信息,如采样横纵比、光电转换特性、颜色空间等。vui parameters()语法元素集中的主要相关语法元素,VUI 参数属于 SPS也作用于一个 CVS 中的所有图像。但 VUI 参数属于可选参数,vui parameters( 语法元素集在视频压缩码流中不一定存在,VUI 参数同样也不影响视频的解码过程。

- SEI ( Supplemental Enhancement Information ) 语法元素集pic_timing()也可能包含解码图像的格式信息,如扫描类型、图像类型等, pic_timing( )语法元素集中的主要相关语法元素,这些语法元素只作用于一幅图像。SEI 语法元素属于可选语法元素,pic_timing()语法元素集在视频压缩码流中不一定存在,同样也不影响视频的解码过程。这些语法元素的取值应与 SPS 中的语法元素取值保持一致性。

扫描类型:

扫描类型是指图像是逐行扫描还是隔行扫描,H.265/HEVC 中的 SEI语法元素source_scan_type 表明每幅图像的扫描类型。图像的语法元素source_scan_type 为 0表明该图像为隔行扫描,为 1表明该图像为逐行扫描;为 2 表明该图像的扫描类型未知;为 3 表明预留未来使用,该标准版本中不应使用该预留值,对于 source_scan_type 为3 时,遵循该版本的

解码器将按source_scan_type为 2 处理。

由于 source_scan_type是可选语法元素,当SEI 中 source_scan_type存在时,其应该与 SPS 语法元素 general_progressive_source_flag 和general_interlaced_source_flag 的取值一致;当 SEI 中 source_scan_type不存在时,其应根据 SPS 语法元素 general_progressive_source_flag 和general_interlaced_source_flag 推断得到。

图像类型:

图像类型是指图像中像素的空间结构,如图像为逐行扫描模式的帧、隔行扫描模式的顶场等。H.265/HEVC 中的 SEI语法元素 pic_struct表明每幅图像的图像类型,不同的图像类型对应不同的像素空间结构,H.265/HEVC 标准详细给出了逐行扫描模式视频喷通常的像素空间结构,以及隔行扫描模式顶场和底场通常的像素空间结构。根据所有图像的图像类型就可以得出整个视频序列应如何应用,如隔行扫描模式下的顶场和配对的底场组合到一起在逐行扫描模式的显示器上显示。另外,VUI 语法元素 chroma_sampleloc_type_top_field 和chroma_sample_loc_type_bottom_field不同的取值还可以提供更多的像素空间结构。

采样宽高比:

采样宽高比 (PixelAspect Ratio,PAR)表示像素的宽度与高度的比值,结合图像的空间分辨率就可以得到图像显示时的宽高比。图像的采样宽高比由 VUI 语法元素 aspect_ratio_idc 标识,当 VUI语法元素 aspect_ratio_idc不存在时,图像的aspect_ratio_idc应设定为 0当 aspect_ratio_idc 取值为 EXTENDED SAR 时,aspect_ratio_idc 应设定为 sar_width 与 sar_height 的比值。

过扫描:

过扫描(Overscan) 是指显示器输入图像的边缘附近部分像素在显示屏上不可见,这是 CRT (Cathode Ray Tube) 显示技术的主要特征。VUI语法元素 overscan_appropriate_flag 为 1 时表示裁剪后的解码图像适合用过扫描,可用于娱乐电视节目等应用。

overscan_appropriate_flag为 0 时表示裁剪后的解码图像不适合用过扫描,可用于计算机屏幕获取等应用。

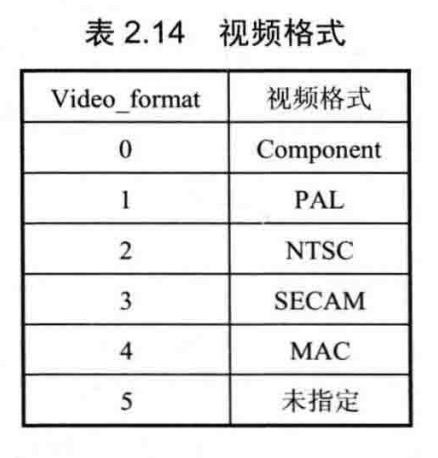

视频格式:

VUI 语法元素 video format 表明了视频的格式,表 2.14 给出了 video format 取值与视频格式的对应关系。当VUI 语法元素 video format不存在时,其值设置为 5。

像素特征:

颜色是由亮度和色度共同表示的,而色度(Chromaticity) 则是不包括亮度在内的颜色的性质,它反映的是颜色的色调和饱和度。VUI 语法元素colour_primaries 表明视频的 RGB 空间中 RGB 分量对应的色度标Chromaticity_coordinates)。VUI 语法元素 matrix_coeffs 表明亮度和色度信号与 RGB 信号的转换关系矩阵,结合 VUI语法元素 video_full_range_flag可以确定解码器输出像素值对应的 RGB 空间的像素值。VUI 语法元素transfer_characteristics 表明像素信息的光电转换关系,结合 RGB 空间像素值可以确定像素位置的光强度。

参考资料:

《新一代高效视频编码 H.265/HEVC 原理、标准与实现》------万帅 杨付正 编著