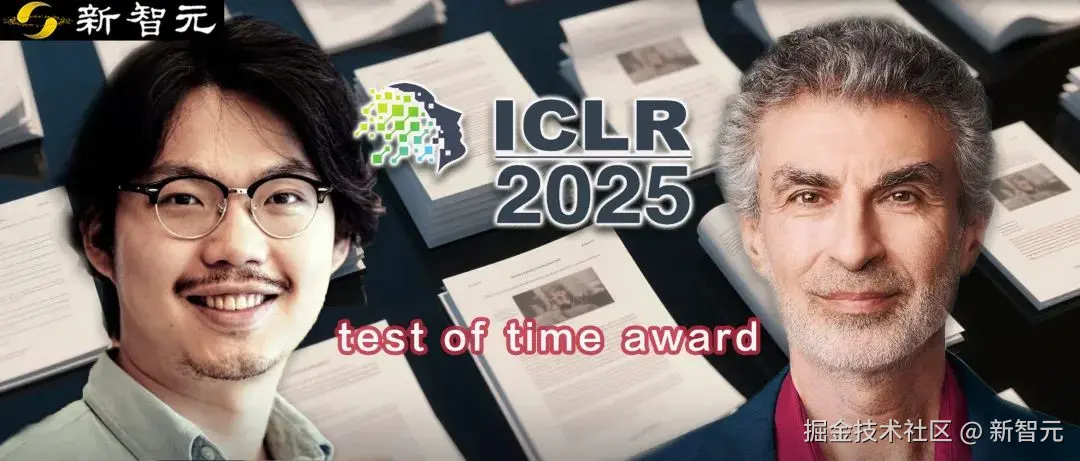

【新智元导读】ICLR 2025 时间检验奖重磅揭晓!Yoshua Bengio 与华人科学家 Jimmy Ba 分别领衔的两篇十年前论文摘得冠军与亚军。一个是 Adam 优化器,另一个注意力机制,彻底重塑深度学习的未来。

刚刚,ICLR 2025 时间检验奖公布!

斩获大奖的是,xAI 工程师、Hinton 高徒 Jimmy Ba 发表的 Adam 优化器。

获得亚军的是,Yoshua Bengio 团队提出的「注意力机制」,为 Transformer 和大模型奠定了基础。

每年,ICLR 时间检验奖都会颁给 10 年前发表,且对领域产生持久影响的论文。

滑铁卢大学 CS 助理教授 Gautam Kamath 做了一个总结:

-

OpenAI 联创 Diederik P. Kingma 已连续第二次拿下 ICLR ToT 大奖,去年因 VAEs 论文获奖

-

今年 ToT 冠军 / 亚军,全都授予加拿大高校的学者

-

2024 年和 2025 年亚军来自 NYU 团队

时间检验奖

ICLR 2025 时间检验奖公布,再次让所有人见证了深度学习领域的「黄金十年」。

Adam 优化器让大模型训练更快更稳,注意力机制更是赋予了 AI 超强理解力,成为深度学习领域的重要里程碑。

Adam 优化器:深度学习「加速引擎」

标题:Adam: A Method for Stochastic Optimization

作者:Diederik P. Kingma, Jimmy Ba

机构:阿姆斯特丹大学 / OpenAI、多伦多大学

如果说深度学习是一辆飞驰列车,那么 Adam 优化器就是它的「超级引擎」。

2015 年,由 Diederik P. Kingma 和 Jimmy Ba 提出的 Adam 算法,彻底改变了神经网络训练的方式。

Adam 全称是 Adaptive Moment Estimation,通过结合梯度算法的一阶矩和二阶矩,自动调整学习率,不仅加速了模型收敛,还提升了训练的稳定性。

它之所以成为深度学习领域,重要的算法之一,其魅力在于不同领域和神经架构中的通用性与高效性。

无论是 CV、NLP、还是 RL,Adam 几乎成为所有深度学习模型的默认优化器,成为无数顶尖模型的基石。

注意力机制:Transformer 前世今生

标题:Neural Machine Translation by Jointly Learning to Align and Translate)

作者:Dzmitry Bahdanau, Kyunghyun Cho, Yoshua Bengio

机构:康斯特大学、蒙特利尔大学

由 Yoshua Bengio 带队这篇论文,首次引入了注意力机制(Attention Mechanism),为现代深度学习架构奠定了基础。

它从根本上改变了序列到序列模型处理信息的方式。

在此之前,编码器 - 解码器架构通常将整个输入序列,压缩成固定长度向量,面对较长序列往往捉襟见肘。

Bengio 团队的突破在于,让模型能够「动态关注」输入序列相关部分,极大地提升了翻译任务的性能。

要知道,这篇论文的影响力远远超出了机器翻译领域。

2017 年,Attention is All You Need 开山之作出世,注意力机制成为了 Transformer 模型的核心,催生了 BERT、GPT 系等大模型的繁荣。

如今,几乎所有顶尖的 AI 模型都离不开注意力机制的加持。

正因如此,这篇论文也被业界誉为「现代深度学习的基石」。

深度学习巨擘领衔

这两篇 2015 年里程碑式论文荣登榜首,分别是由图灵奖得主 Yoshua Bengio,以及 Jimmy Ba 领衔。

正如 Gautam Kamath 所指出那样,加拿大在深度学习领域的领先地位。

Jimmy Ba

作为 Adam 论文共同作者,Jimmy Ba 的学术轨迹堪称耀眼。

他分别于 2011 年和 2014 年获得了多伦多大学本科与硕士学位,分别师从 Brendan Frey 和 Ruslan Salakhutdinov 教授。

博士期间,他又在多伦多大学跟着 Geoffrey Hinton 学习。

Jimmy Ba 的长期研究目标致力于解决一个核心计算问题:如何构建具备类人效率和适应性的通用问题求解机器?

具体而言,他的研究聚焦于为深度神经网络开发高效的学习算法。

他的研究成果频频亮相 NeurIPS、ICLR 和 ICML 顶会,2016 年更是摘得 Facebook 机器学习方向研究生奖学金(Facebook Graduate Fellowship)。

目前,Google Scholar 主页显示,Adam 这篇论文被引超 20 万。

Yoshua Bengio

提到 Yoshua Bengio,AI 界无人不晓。

作为深度学习三巨头之一,他的每项研究都在改写 AI 的历史。

Yoshua Bengio,生于 1964 年 3 月 5 日是一位加拿大 - 法国籍计算机科学家,也是人工神经网络和深度学习领域的先驱。他是蒙特利尔大学的教授,也是 AI 研究所 MILA 的科学总监。

他在麦吉尔大学获得了理学学士学位(电气工程)、理学硕士学位(计算机科学)和博士学位(计算机科学)。

获得博士学位后,Bengio 曾在 MIT(导师是 Michael I. Jordan)和 AT&T 贝尔实验室担任博士后研究员。

自 1993 年以来,他一直是蒙特利尔大学的教员,领导着 MILA,并且是加拿大高等研究院(CIFAR)「机器与大脑学习」项目的联合主任。

2017 年,Bengio 被授予加拿大勋章。同年,他被提名为加拿大皇家学会会士,并获得了 Marie-Victorin Quebec 奖。

2018 年,他与 Geoffrey Hinton 和 Yann LeCun 因其在深度学习领域的基础性工作,共同获得了计算领域的「诺贝尔奖」------ACM 图灵奖。

2020 年,他当选为英国皇家学会会士。2022 年,他与 Geoffrey Hinton、Yann LeCun 和 Demis Hassabis 共同获得了「科学研究」类别的阿斯图里亚斯女亲王奖。

2023 年,Bengio 被授予法国最高荣誉勋章------荣誉军团骑士勋章。同年,被评为 ACM Fellow。

2025 年,Bengio 与 Bill Dally、Geoffrey E. Hinton、John Hopfield、Yann LeCun、黄仁勋和李飞飞共同获得了伊丽莎白女王工程奖。

Google Scholar 个人主页中,Bengio 总被引数破 90 万,其中被引量最高的论文便是与 LeCun 和 Hinton 共同撰写的「深度学习」的论文。

有趣的是,他的兄弟 Samy Bengio 也是一位在神经网络领域很有影响力的计算机科学家,目前担任苹果 AI 和机器学习研究高级总监。

参考资料: