一、首先打开我们的虚拟机

二、通过finalshell连接虚拟机,连接成功后打开/opt/software,将我们的压缩文件拉到这个目录下

三、通过tar -zxvf spark-3.3.1-bin-hadoop3.tgz -C /opt/module/这个命令将spark安装文件到/opt/module下。

四、重命名

通过mv spark-3.3.1-bin-hadoop3 spark-local这个命令将解压后的文件夹改成spark-local(重命名是为了后续我们还会使用其他的配置方式,所以这里先重命名一次。

五、配置环境变量

1.打开目录/etc/profile.d/my_env.sh,在最后一行输入

#配置spark 环境变量

export SPARK_HOME=/opt/module/spark-local

export PATH=PATH:SPARK_HOME/bin:$SPARK_HOME/sbin

2.然后保存,使用source /etc/profile这个命令让环境变量生效。

3.在控制台输入

spark-submit --class org.apache.spark.examples.SparkPi --master local2 /opt/module/spark-local/examples/jars/spark-examples_2.12-3.1.1.jar 10

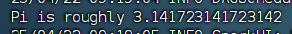

4.然后我们就会得人到下面这个结果

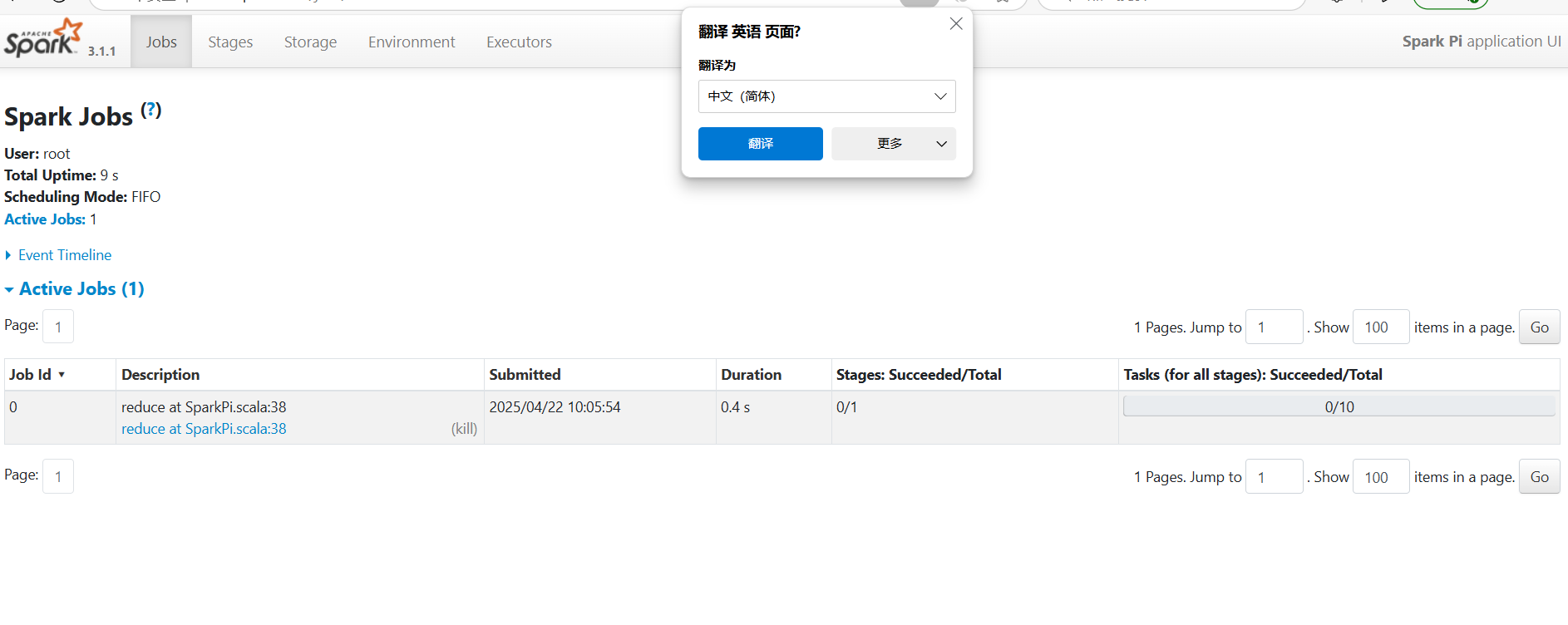

六、查看运行结果详情