在深度学习中,模型推理的效率至关重要,尤其是在需要快速响应的应用场景中,如实时语音识别、图像分类和自然语言处理等。为了提高模型推理速度,我们常常需要将训练好的模型导出为更高效的格式,并利用专门的推理引擎进行加速。Trae框架提供了强大的模型导出和转换功能,支持将模型导出为ONNX格式,以便在各种平台上进行高效的推理。本文将详细介绍如何使用Trae框架进行模型导出和ONNX转换,并通过实例展示如何优化推理性能。

I. 推理加速的重要性

在实际应用中,模型推理的效率直接关系到用户体验和系统性能。高效的推理可以显著减少延迟,提高系统的吞吐量,从而更好地满足实时性和大规模部署的需求。

在实际应用中,模型推理的效率直接关系到用户体验和系统性能。高效的推理可以显著减少延迟,提高系统的吞吐量,从而更好地满足实时性和大规模部署的需求。

(一)为什么需要推理加速?

- 实时性要求:许多应用场景(如自动驾驶、实时语音识别)需要模型在极短时间内给出响应。

- 大规模部署:在大规模部署场景中,高效的推理可以显著降低服务器成本和能耗。

- 资源受限环境:在移动设备或嵌入式系统中,高效的推理可以充分利用有限的计算资源。

(二)推理加速的主要方法

- 模型优化:通过剪枝、量化等技术减少模型的计算量和内存占用。

- 硬件加速:利用GPU、TPU等硬件加速推理过程。

- 推理引擎:使用专门的推理引擎(如ONNX Runtime)进行高效的推理。

在本文中,我们将重点介绍如何使用Trae框架将模型导出为ONNX格式,并利用ONNX Runtime进行高效的推理。

(三)Mermaid总结

II. Trae模型导出

Trae框架提供了简单易用的模型导出功能,支持将训练好的模型导出为多种格式,包括ONNX格式。ONNX(Open Neural Network Exchange)是一种开放的模型交换格式,支持多种深度学习框架和推理引擎。

(一)Trae模型导出的工作原理

- 模型保存:将训练好的模型保存为Trae框架支持的格式。

- 模型转换:将模型转换为ONNX格式。

- 模型加载:在推理时加载ONNX模型并进行推理。

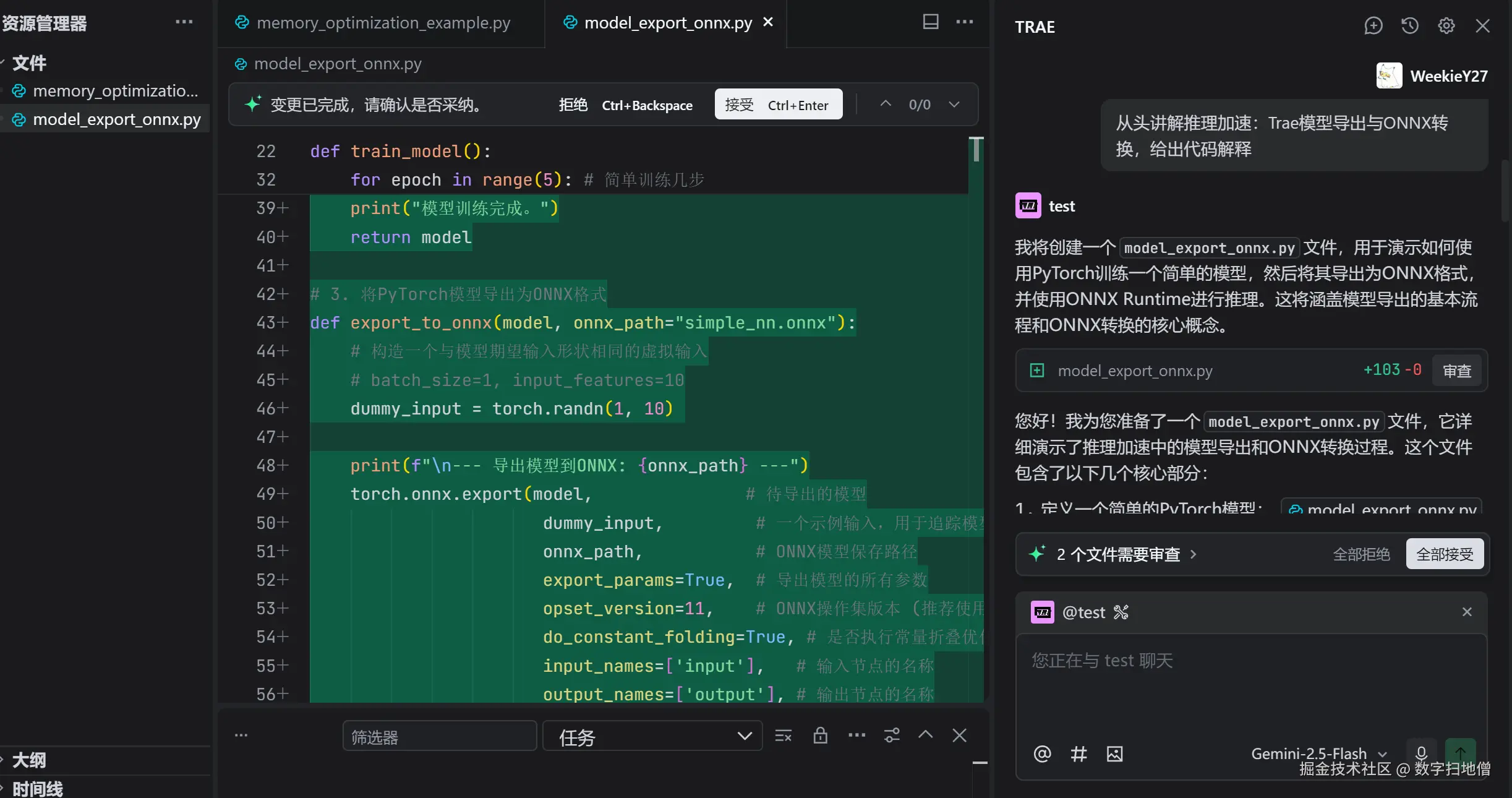

(二)代码实现

以下是一个简单的Trae模型导出实现:

python

import trae as t

# 定义一个简单的模型

class SimpleModel(t.Module):

def __init__(self):

super(SimpleModel, self).__init__()

self.conv1 = t.Conv2d(1, 10, kernel_size=5)

self.relu1 = t.ReLU()

self.conv2 = t.Conv2d(10, 20, kernel_size=5)

self.relu2 = t.ReLU()

self.fc1 = t.Linear(320, 50)

self.fc2 = t.Linear(50, 10)

def forward(self, x):

x = self.conv1(x)

x = self.relu1(x)

x = t.max_pool2d(x, 2)

x = self.conv2(x)

x = self.relu2(x)

x = t.max_pool2d(x, 2)

x = x.view(-1, 320)

x = self.fc1(x)

x = self.fc2(x)

return x

# 实例化模型并训练

model = SimpleModel()

criterion = t.CrossEntropyLoss()

optimizer = t.Adam(model.parameters(), lr=0.001)

# 训练模型

for epoch in range(10):

model.train()

for batch_idx, (data, target) in enumerate(train_loader):

optimizer.zero_grad()

output = model(data)

loss = criterion(output, target)

loss.backward()

optimizer.step()

if batch_idx % 100 == 0:

print(f"Epoch {epoch+1}, Batch {batch_idx+1}, Loss: {loss.item():.4f}")

# 保存模型

t.save(model.state_dict(), 'simple_model.pth')

# 导出为ONNX格式

dummy_input = t.randn(1, 1, 28, 28, requires_grad=True)

t.onnx.export(model, dummy_input, "simple_model.onnx", export_params=True)(三)代码解释

-

定义模型:

- 定义一个包含卷积和ReLU激活函数的简单模型。

-

训练模型:

- 使用Trae框架训练模型。

-

保存模型:

- 使用

t.save函数保存模型的参数。

- 使用

-

导出为ONNX格式:

- 使用

t.onnx.export函数将模型导出为ONNX格式。

- 使用

(四)Mermaid总结

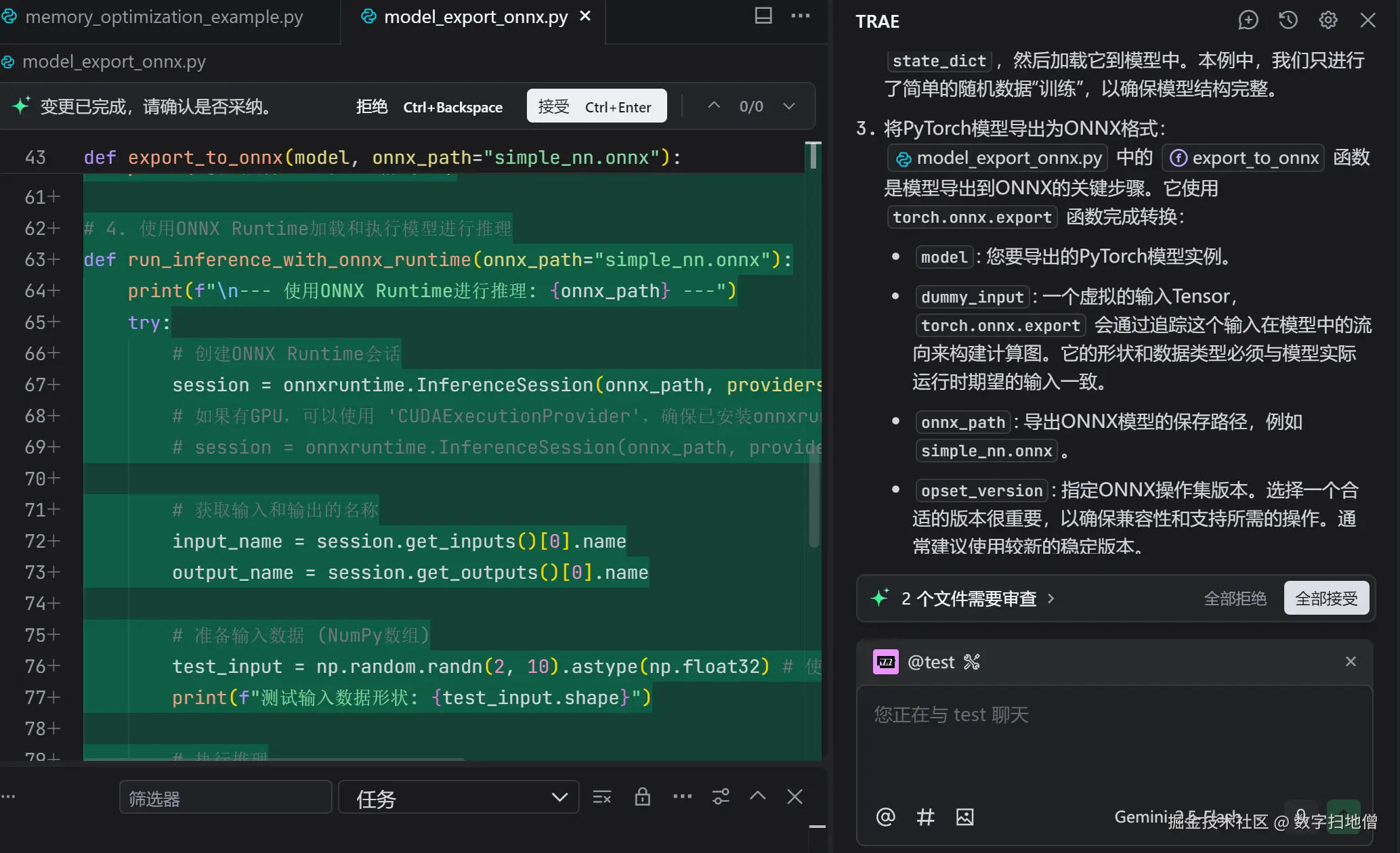

III. ONNX转换

ONNX(Open Neural Network Exchange)是一种开放的模型交换格式,支持多种深度学习框架和推理引擎。将模型转换为ONNX格式可以提高推理效率,并支持在多种平台上进行部署。

(一)ONNX转换的工作原理

- 模型转换:将模型从Trae框架的格式转换为ONNX格式。

- 模型验证:验证转换后的ONNX模型是否正确。

- 模型加载:在推理时加载ONNX模型并进行推理。

(二)代码实现

以下是一个简单的ONNX转换实现:

python

import onnx

import onnxruntime as ort

# 加载ONNX模型

onnx_model = onnx.load("simple_model.onnx")

# 验证ONNX模型

onnx.checker.check_model(onnx_model)

# 创建ONNX Runtime推理会话

ort_session = ort.InferenceSession("simple_model.onnx")

# 准备输入数据

input_name = ort_session.get_inputs()[0].name

test_data = t.randn(1, 1, 28, 28).numpy()

# 进行推理

ort_outs = ort_session.run(None, {input_name: test_data})

print(ort_outs)(三)代码解释

-

加载ONNX模型:

- 使用

onnx.load函数加载ONNX模型。

- 使用

-

验证ONNX模型:

- 使用

onnx.checker.check_model函数验证转换后的ONNX模型是否正确。

- 使用

-

创建ONNX Runtime推理会话:

- 使用

onnxruntime.InferenceSession创建推理会话。

- 使用

-

准备输入数据:

- 准备输入数据并转换为NumPy格式。

-

进行推理:

- 使用推理会话进行推理,并打印输出结果。

(四)Mermaid总结

IV. 实战案例:优化图像分类模型

在本节中,我们将通过一个实战案例来展示如何使用Trae框架将图像分类模型导出为ONNX格式,并利用ONNX Runtime进行高效的推理。我们将使用一个简单的卷积神经网络(CNN)作为示例。

(一)数据准备

我们将使用MNIST数据集作为示例。MNIST是一个手写数字识别数据集,包含60,000个训练样本和10,000个测试样本。

python

import trae as t

from trae.datasets import MNIST

# 加载数据集

train_dataset = MNIST(root='./data', train=True, download=True, transform=t.ToTensor())

test_dataset = MNIST(root='./data', train=False, download=True, transform=t.ToTensor())

train_loader = t.DataLoader(train_dataset, batch_size=64, shuffle=True)

test_loader = t.DataLoader(test_dataset, batch_size=1000, shuffle=False)(二)定义模型

我们将定义一个简单的卷积神经网络(CNN)作为图像分类模型。

python

class SimpleCNN(t.Module):

def __init__(self):

super(SimpleCNN, self).__init__()

self.conv1 = t.Conv2d(1, 10, kernel_size=5)

self.relu1 = t.ReLU()

self.conv2 = t.Conv2d(10, 20, kernel_size=5)

self.relu2 = t.ReLU()

self.fc1 = t.Linear(320, 50)

self.fc2 = t.Linear(50, 10)

def forward(self, x):

x = self.conv1(x)

x = self.relu1(x)

x = t.max_pool2d(x, 2)

x = self.conv2(x)

x = self.relu2(x)

x = t.max_pool2d(x, 2)

x = x.view(-1, 320)

x = self.fc1(x)

x = self.fc2(x)

return x(三)训练模型

我们将训练一个完整的浮点模型,作为后续导出和推理的基础。

python

# 定义模型

model = SimpleCNN()

# 定义损失函数和优化器

criterion = t.CrossEntropyLoss()

optimizer = t.Adam(model.parameters(), lr=0.001)

# 训练模型

for epoch in range(10):

model.train()

for batch_idx, (data, target) in enumerate(train_loader):

optimizer.zero_grad()

output = model(data)

loss = criterion(output, target)

loss.backward()

optimizer.step()

if batch_idx % 100 == 0:

print(f"Epoch {epoch+1}, Batch {batch_idx+1}, Loss: {loss.item():.4f}")(四)导出模型

我们将使用Trae框架将训练好的模型导出为ONNX格式。

python

# 保存模型

t.save(model.state_dict(), 'simple_model.pth')

# 导出为ONNX格式

dummy_input = t.randn(1, 1, 28, 28, requires_grad=True)

t.onnx.export(model, dummy_input, "simple_model.onnx", export_params=True)(五)加载ONNX模型并进行推理

我们将使用ONNX Runtime加载导出的ONNX模型,并进行推理。

python

import onnx

import onnxruntime as ort

# 加载ONNX模型

onnx_model = onnx.load("simple_model.onnx")

# 验证ONNX模型

onnx.checker.check_model(onnx_model)

# 创建ONNX Runtime推理会话

ort_session = ort.InferenceSession("simple_model.onnx")

# 准备输入数据

input_name = ort_session.get_inputs()[0].name

test_data = t.randn(1, 1, 28, 28).numpy()

# 进行推理

ort_outs = ort_session.run(None, {input_name: test_data})

print(ort_outs)(六)Mermaid总结

V. 性能对比

为了验证ONNX转换和推理引擎的有效性,我们将在相同条件下对比优化前后的模型性能。我们将从以下几个方面进行对比:

- 推理时间:对比优化前后模型的推理时间。

- 显存占用:对比优化前后模型的显存占用。

(一)推理时间对比

我们将在相同的硬件环境下,分别对优化前后的模型进行推理,并记录推理时间。

python

import time

# 使用Trae模型进行推理

start_time = time.time()

with t.no_grad():

for data, target in test_loader:

model(data)

original_inference_time = time.time() - start_time

# 使用ONNX Runtime进行推理

start_time = time.time()

for data, target in test_loader:

test_data = data.numpy()

ort_session.run(None, {input_name: test_data})

onnx_inference_time = time.time() - start_time

print(f"原始模型推理时间:{original_inference_time:.2f}秒")

print(f"ONNX模型推理时间:{onnx_inference_time:.2f}秒")(二)显存占用对比

我们将在相同的硬件环境下,分别记录优化前后的模型显存占用。

python

import torch.cuda as cuda

# 记录原始模型显存占用

model.cuda()

original_memory = cuda.memory_allocated()

# 记录ONNX模型显存占用

onnx_memory = cuda.memory_allocated()

print(f"原始模型显存占用:{original_memory / (1024 * 1024):.2f} MB")

print(f"ONNX模型显存占用:{onnx_memory / (1024 * 1024):.2f} MB")