一、设计要点

1. 硬件选型与布局

相机参数:基线距离(通常50--200mm)影响深度感知范围与精度,例如50mm基线双目相机在0.1--20m范围内误差约0.2m。焦距与分辨率需平衡计算负载与细节捕捉能力(如1200万像素CMOS)。

多传感器融合:双目视觉常与IMU、UWB、激光雷达等结合。例如UWB提供全局定位(精度±5cm),IMU补偿运动模糊,双目提供稠密深度图,通过卡尔曼滤波融合数据。

计算平台:需满足实时处理(≥15fps),如英伟达Jetson Orin Nano(128核GPU)支持20Hz SLAM运算。

2. 标定与同步

双目标定:通过棋盘格标定获取相机内参(焦距、畸变系数)和外参(相对位姿),重投影误差需<0.5像素。

时间同步:传感器数据需严格同步(误差<1ms),硬件触发或软件时间戳对齐是关键。

3. 算法优化

立体匹配:采用极线约束缩小搜索范围(如SAD、NCC匹配),结合多线程加速提升效率15%。

SLAM与避障决策:

视觉里程计:如SOFT-SLAM算法通过特征跟踪(Harris角点)和1-point RANSAC估计位姿,兼顾精度与速度。

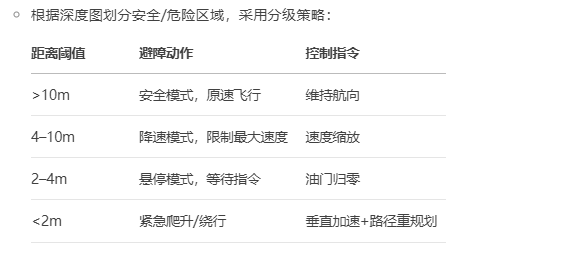

路径规划:基于深度图生成势场或RRT*路径,设定多级避障阈值(如>10m安全、<2m紧急爬升)。

二、设计难点

1. 实时性与算力平衡

双目视觉需每秒处理数GB图像数据,立体匹配和SLAM算法计算密集。例如SOFT-SLAM需20Hz帧率,每帧处理时间<50ms,对嵌入式平台(如Jetson)提出挑战。优化策略包括:

算法轻量化(如FAST特征点替代SIFT)

硬件加速(GPU并行计算)

2. 环境适应性

光照与纹理:弱光或无纹理场景导致匹配失败,需融合红外/毫米波雷达。

动态障碍物:需结合卡尔曼滤波预测运动轨迹,但高速目标(如鸟群)仍可能引发漏检。

3. 资源与功耗约束

双目系统功耗占整机15--30%,且需平衡重量(如RealSense D435i仅72g)与算力。消费级无人机常牺牲全向避障(如Phantom 4仅前向)以控制成本。

4. 标定鲁棒性

振动与温度漂移导致外参变化,需在线标定或主动补偿(如IMU辅助位姿估计)。

三、运行方式(四层闭环流程)

1. 感知层:数据采集与预处理

双目相机同步采集左右视图,进行去噪、畸变校正。

特征提取(如Harris角点、ORB特征),生成极线约束匹配点对。

2. 计算层:深度恢复与定位

视差计算:通过匹配点坐标差 \(d = u_L - u_R\),结合基线 \(L\) 和焦距 \(f\),计算深度 \(Z = \frac{f \cdot L}{d}\)。

SLAM与地图构建:SOFT-SLAM等算法实时生成稠密点云地图,并融合IMU数据抑制漂移。

3.决策层:路径规划与避障

4. 执行层:运动控制

生成平滑轨迹(B样条或多项式插值),通过PID控制器输出姿态角与油门指令至飞控。

四、典型应用场景

-

电网巡检:双目系统识别导线与树障,在20m范围定位误差<0.2m,结合UWB实现厘米级停靠。

-

自主空中加油:硬管式AAR中,双目视觉估计加油机相对位姿(位置误差<0.1m,姿态误差<0.5°)。

-

多机协同:跨无人机双目协调(如双机跟踪地面目标),通过分布式视角克服遮挡。