大家好,我是小米,一个31岁还依旧爱折腾技术、热衷分享的程序员。今天咱们聊点有意思的------SpringAI + Mistral AI 聊天功能。

前几天,我在公司做一个小实验:领导希望我们的客服系统能引入一个"聪明点"的聊天助手,但要求不走 OpenAI,最好找点开源或者可替代方案。于是,我盯上了 Mistral AI。它不仅能本地部署,还能在 SpringAI 框架里直接跑通,兼容 OpenAI API,最重要的是,咱还能继续用熟悉的 Spring Boot 风格去写代码,爽到飞起。

那这篇文章呢,我就带大家用一个故事化的学习路径 ,从前提条件一路写到运行时选项、函数调用、多模态,甚至连自动配置和手动配置都给你安排上。学完你就能把 SpringAI + Mistral AI 聊天系统撸出来,轻松接入到你自己的应用里。

前提条件:登场之前的准备

俗话说,磨刀不误砍柴工。要想把 Mistral AI 玩转在 SpringAI 里,我们需要先准备好几个条件:

- Java 环境:推荐 17+,别太老。

- Spring Boot:最好 3.x 版本。

- 依赖管理工具:Maven 或 Gradle 都行。

- 一个 Mistral API Key :可以去Mistral.ai 官网申请。

- SpringAI:这是主角,Spring 家族新成员,专门对接 LLM(大语言模型)的。

准备完这些,咱就可以开工了。

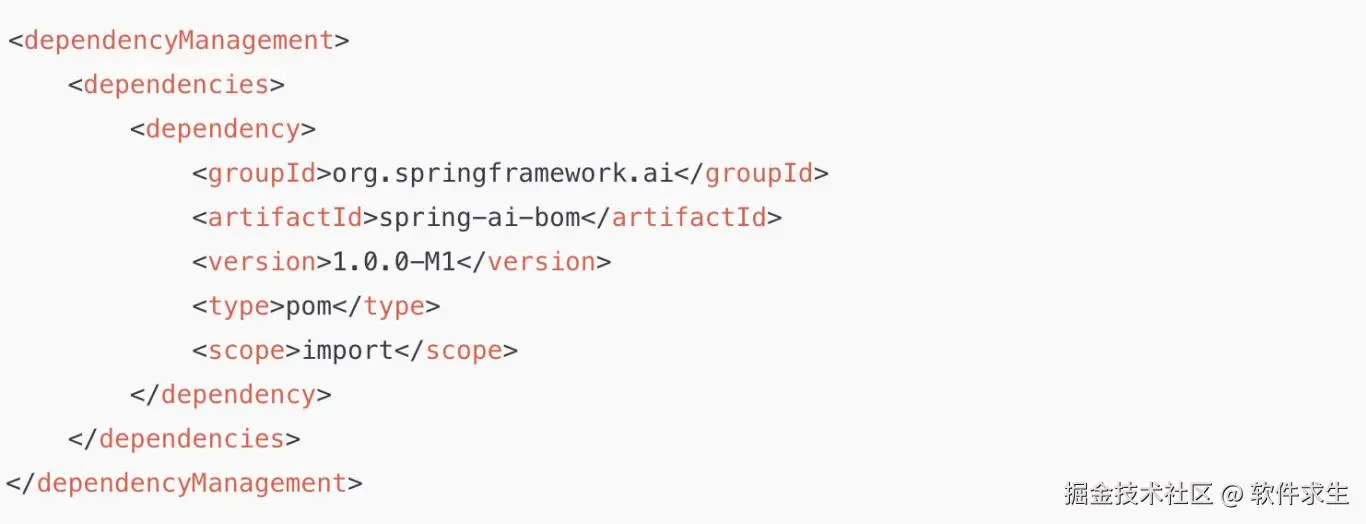

添加仓库和 BOM:万事开头难

在 Maven 里配置仓库和 BOM 是第一步。

你需要在 pom.xml 里加上 SpringAI 的 BOM,这样可以保证依赖版本对齐,不会出现"今天跑了,明天又炸"的尴尬情况。

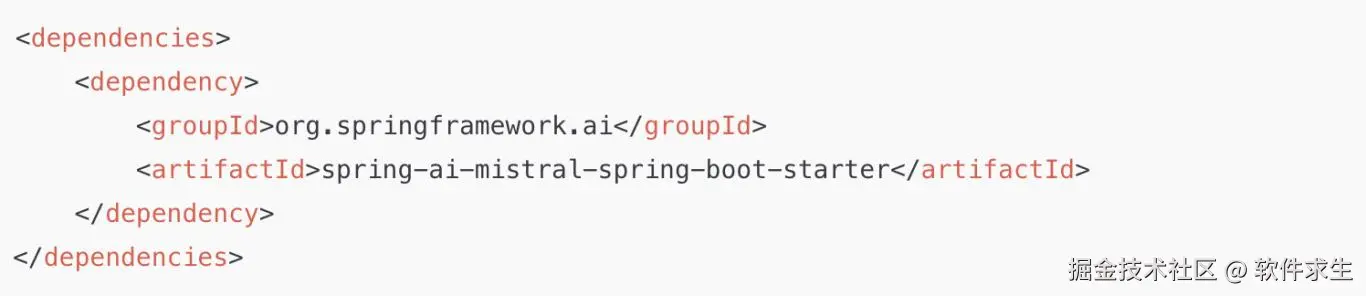

然后加上 Mistral 的 starter:

是不是很眼熟?没错,Spring Boot 一贯的套路。

自动配置:Spring 的魔法

Spring Boot 的最大魅力之一就是自动配置。在你引入 starter 之后,Mistral 相关的 ChatClient、MistralAiApi 等 Bean 就会自动注册到容器里。

换句话说,你啥也不用干,只要在 application.yml 里写好配置,Spring 就帮你把底层的 HTTP 调用、认证逻辑全搞定了。

这也是我喜欢 SpringAI 的原因,和裸调 API 相比,优雅得多。

聊天属性:给 AI 聊天加点料

要让 AI 真正跑起来,光有自动配置还不够,还得调属性。SpringAI 给我们准备了丰富的配置项。

1. 重试属性

有时候,调用 API 会超时或者失败。别慌,SpringAI 内置了重试机制。比如你可以设置最大重试次数、重试间隔,避免因为一次网络抖动就直接 GG。

2. 连接属性

调用 Mistral 本质上是走 HTTP,所以连接超时、读取超时也要配。

3. 配置属性

当然,最重要的是 API Key 和模型。

这样,Mistral 聊天就算是正式接入了。

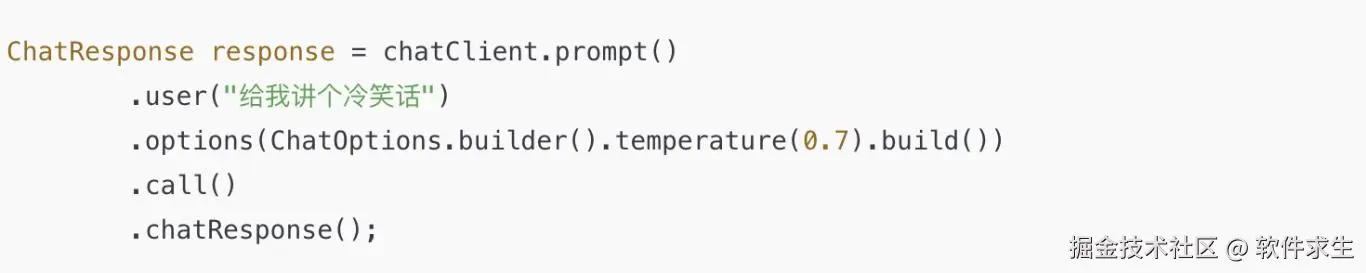

运行时选项:灵活多变的小技巧

运行时我们可以动态设置一些参数,比如温度(随机性)、最大 Token、TopP 等。

这些选项可以通过 ChatClient 调用时临时传入,保证灵活性。举个例子:

这样就不用死板地写死在配置文件里了。

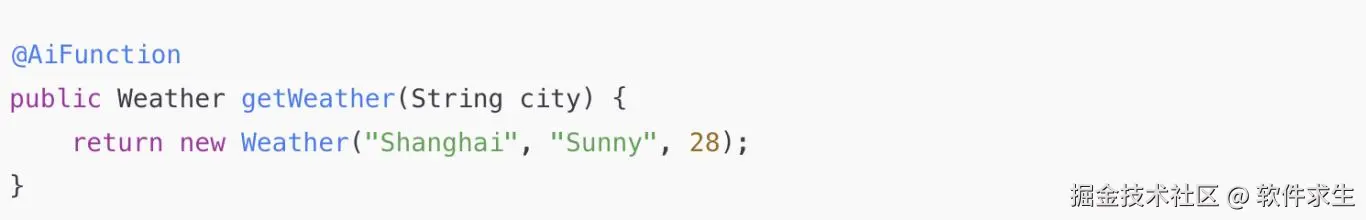

函数调用:AI 不止能聊天

Mistral 支持函数调用(Function Calling)。比如你可以定义一个天气查询函数,AI 根据上下文决定是否调用。

然后在对话里,AI 就能智能调用这个方法,返回结果融入回答。

是不是有点像 ChatGPT 的 Function Call?没错,Mistral 兼容 OpenAI API,所以套路一模一样。

多模态:文字 + 图片 = 更强大

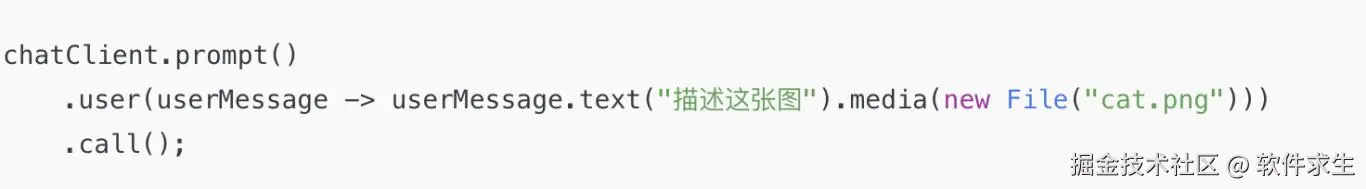

Mistral 不光能处理文本,还能搞多模态,比如接收图片输入。SpringAI 里调用的时候只要传 Media 就行。

比如你传一张图片,让模型帮你写描述,或者做 OCR。

这意味着以后你的应用不只是文字聊天,还能图文并茂,AI 助手就更智能了。

OpenAI API 兼容性:一石二鸟

Mistral 最大的优势之一,就是兼容 OpenAI API。

这意味着,你现有的 ChatGPT 接口代码,稍微改下 URL 和 Key,就能直接跑在 Mistral 上。

对于想降低成本或避免过度依赖 OpenAI 的团队,这点简直太友好了。

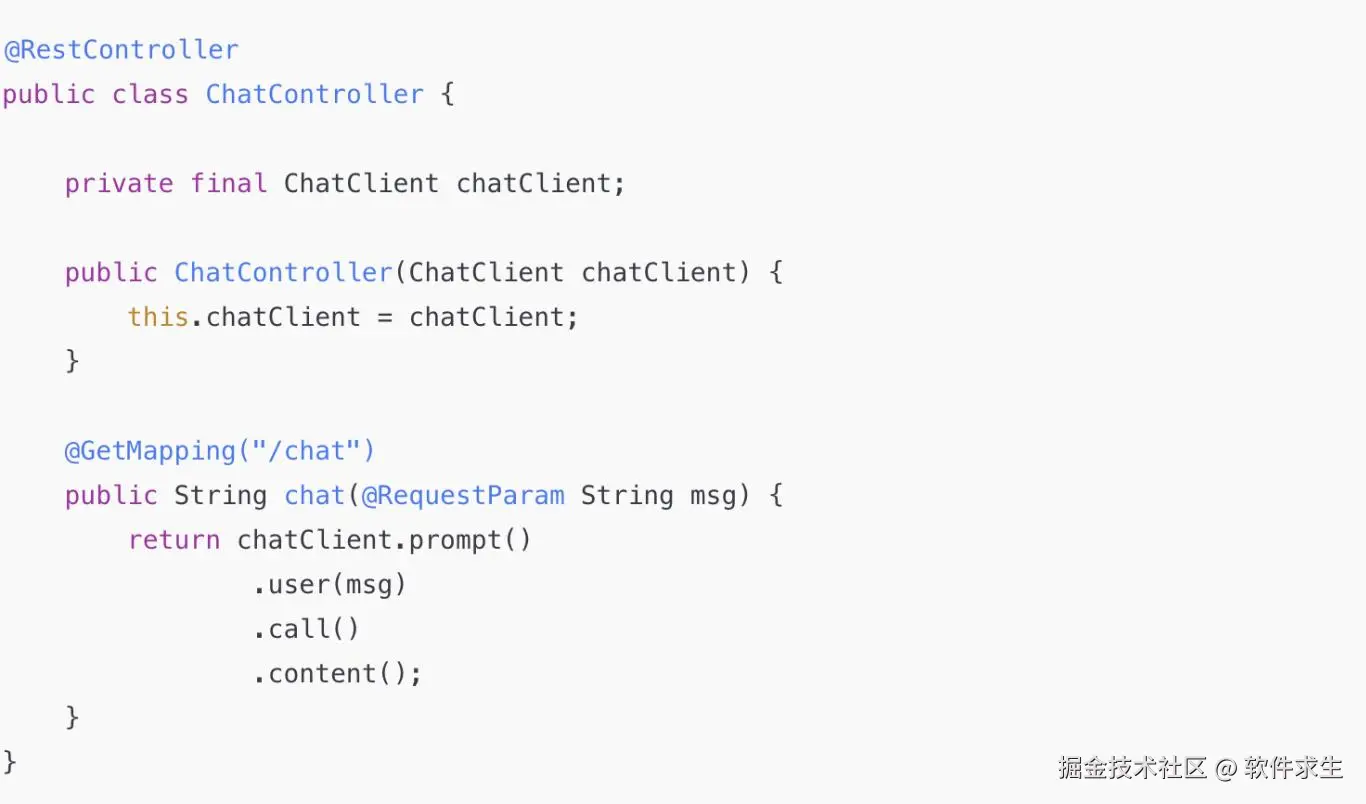

示例控制器(自动配置):一行代码跑起来

有了自动配置之后,写个控制器就能跑通聊天接口:

启动项目,访问 /chat?msg=你好,AI 马上就能回你话。

手动配置:自己掌握主动权

当然,如果你不想用自动配置,也可以自己手动声明 Bean。

这种方式更灵活,比如你要接多个模型,或者做一些自定义的拦截逻辑,就很方便。

低级 MistralAiApi 客户端:底层玩家的最爱

如果你喜欢"操控底层",SpringAI 也给了你 MistralAiApi 这种低级客户端,直接发请求拿 JSON。

这种方式虽然没有 ChatClient 那么优雅,但胜在可控性强,适合那些要深度定制的场景。

总结:从小实验到生产实践

回到开头的故事。我们最初只是想给客服系统加个 AI 助手,但一番研究下来,发现 SpringAI + Mistral AI 不仅能轻松跑起来,还能灵活扩展到函数调用、多模态。更关键的是,它兼容 OpenAI API,未来迁移成本极低。

这让我想起一句话: "工具选得对,事半功倍。"

所以,如果你也想在项目里玩 AI,不妨试试 SpringAI 搭配 Mistral,保准让你又快又爽。

END

写到这儿,我差不多也兴奋得要去写点 demo 了。那你呢?要不要也试试看?

我是小米,一个喜欢分享技术的31岁程序员。如果你喜欢我的文章,欢迎关注我的微信公众号"软件求生",获取更多技术干货!