从液态时间常数网络(Liquid Time-Constant Networks, LTC)到其闭式解版本------闭式连续时间网络(Closed-form Continuous-time Networks, CfC) 的推导过程,可以分为以下几个关键步骤。我们将基于你提供的两篇论文(2020年LTC和2022年CfC)进行梳理:

一、LTC 的原始微分方程形式

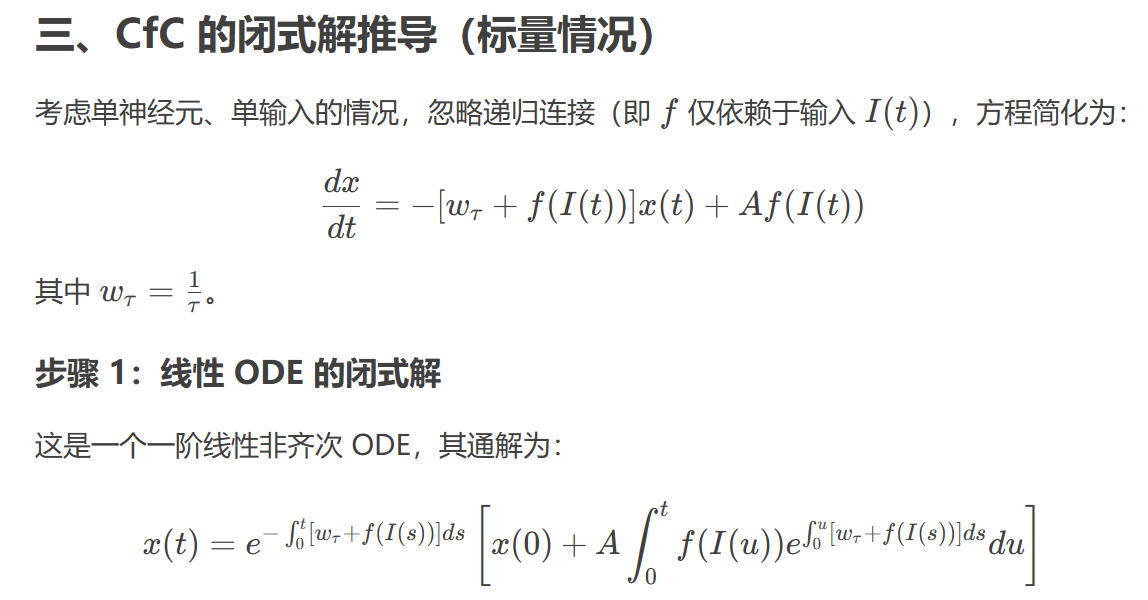

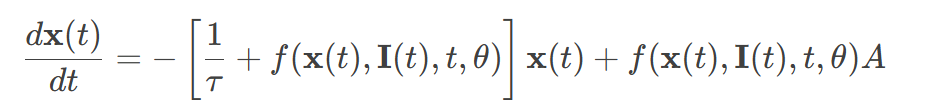

LTC 的隐藏状态 x(t)x(t) 由以下非线性常微分方程(ODE)描述:

二、动机:从数值求解到闭式近似

LTC 依赖于数值 ODE 求解器(如 Euler、Runge-Kutta),计算成本高且存在数值误差。

目标 :找到一个闭式近似解,避免数值积分,提升计算效率。