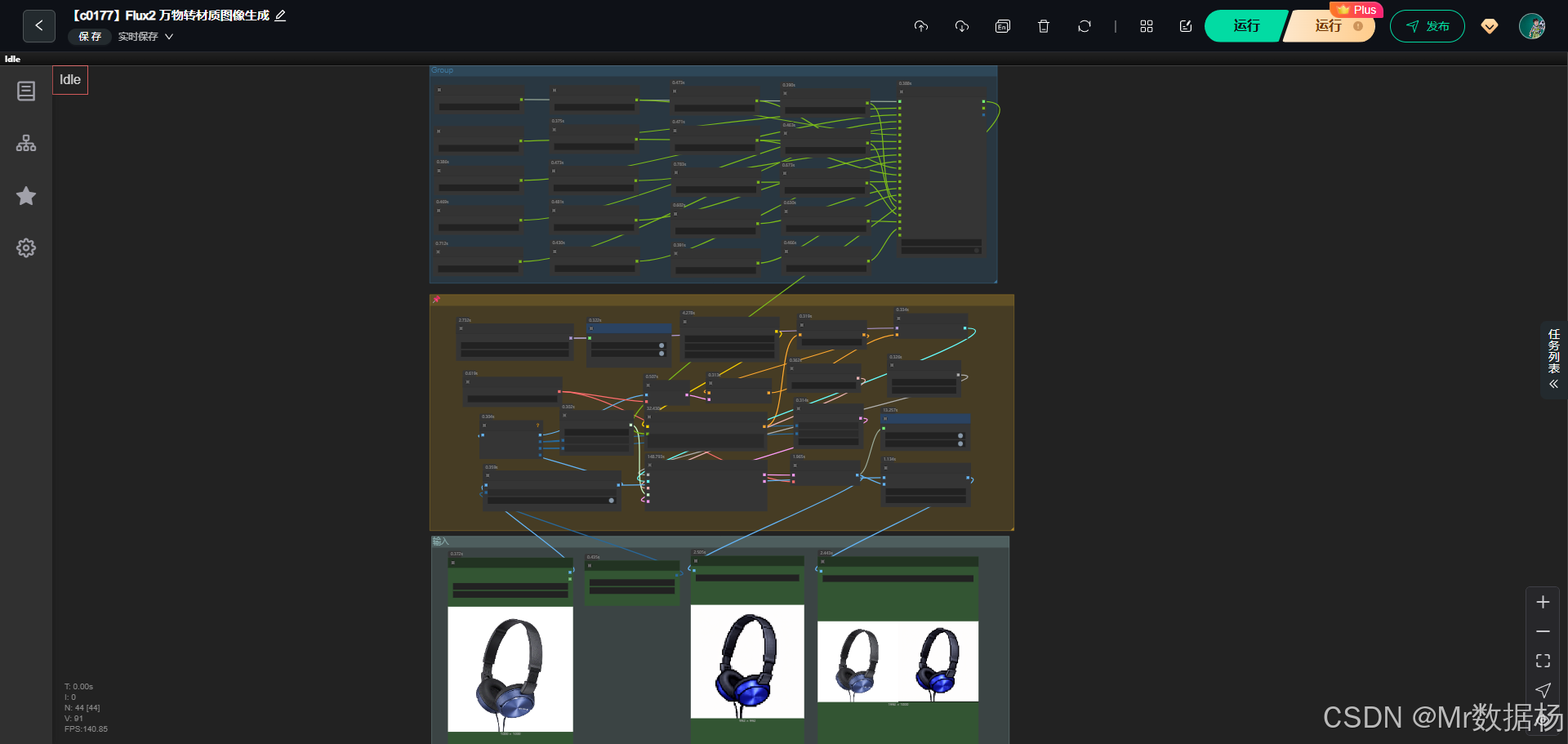

今天给大家演示一个基于 Flux2 的万物转材质 ComfyUI 工作流。它的核心目标是把任意输入角色或图像转换成多种可控材质,比如毛线、果冻、树脂、金属、陶瓷、像素风甚至赛博能量质感。

通过载入基础图像、依靠 Flux2 的强大生成能力和多个材质文本模块,再配合调度器、采样器和自定义引导方式,这个工作流可以稳定输出风格统一、细节自然的材质重塑效果,让读者能直观理解整个流程的工作方式。

文章目录

- 工作流介绍

- 工作流程

- 大模型应用

-

- [CLIPTextEncode 材质语义解析与风格控制](#CLIPTextEncode 材质语义解析与风格控制)

- [DF_Text 材质主题 Prompt 生成器](#DF_Text 材质主题 Prompt 生成器)

- 使用方法

- 应用场景

- 开发与应用

工作流介绍

这个工作流围绕"材质替换"主题展开。它先从输入图像提取尺寸信息,再经 VAE 编码生成潜空间数据,搭配 CLIP 文本编码器加载不同材质描述,通过 FluxGuidance 和 ReferenceLatent 将内容引导与原图结构结合,最后由 Flux2 UNet 主模型与自定义 Scheduler、Sampler 完成材质生成。整个过程保持结构稳定,同时让材质替换自然落在原始角色上。模型、节点和调度体系彼此配合,在可控范围内完成材质风格替换的任务。

核心模型

这个工作流依托 Flux2 系列模型作为核心生成引擎,包括主 UNet、配套 VAE 以及 Mistral Flux2 的 CLIP 文本编码器。三者共同负责图像结构保持、材质生成、文本理解,为材质转换的质量和一致性提供基础支持。

| 模型名称 | 说明 | |

|---|---|---|

| flux2_dev_fp8mixed.safetensors | 主 UNet 模型,负责材质生成与图像结构的推理处理 | |

| flux2-vae.safetensors | VAE 模型,用于图像潜空间编码和解码 | |

| mistral_3_small_flux2_fp8.safetensors | CLIP 文本模型,用于解析材质文本描述并为生成提供语义引导 |

Node节点

整个流程由多个关键节点组成。它们从图像读取、尺寸处理、材质描述选择,到潜空间引导、噪声生成、采样推理再到输出保存,共同构成材质替换的完整链路。节点相互间的连接保证了材质转换过程中既保留角色结构,又能让材质表现集中且自然。

| 节点名称 | 说明 | |

|---|---|---|

| LoadImage | 载入输入图像,用于后续尺寸分析和编码 | |

| GetImageSizeAndCount | 获取图像尺寸并用于后续潜空间初始化和 Scheduler 参数计算 | |

| VAEEncode / VAEDecode | 负责图像在潜空间的编码和解码 | |

| CLIPTextEncode | 将材质描述转化为 Conditioning,用于引导模型生成 | |

| Flux2Scheduler | 生成针对 Flux2 结构的采样调度序列 | |

| KSamplerSelect / SamplerCustomAdvanced | 控制采样方式和最终生成推理 | |

| ReferenceLatent | 将材质引导与原图潜空间结合,确保结构保留 | |

| BasicGuider / FluxGuidance | 负责引导权重控制,使材质替换更稳定 | |

| ImageScaleDownToSize | 控制最大分辨率,保证显存可控 | |

| Image Stitch | 将原图与生成图进行对比拼接 | |

| SaveImage | 保存最终材质替换后的成品图像 |

工作流程

整个工作流程围绕"输入图像 → 潜空间编码 → 材质文本选择 → Flux2 生成 → 拼接与输出"的顺序展开。系统先读取图像并分析尺寸,再进入潜空间准备阶段,随后由材质文本选择器 ImpactSwitch 输出目标材质描述,让 CLIPTextEncode 将其转为可用于引导的语义信息。ReferenceLatent 把这种语义与原图潜空间绑定,FluxGuidance 调整生成方向,最后通过 Scheduler 和 Sampler 的联合推理完成材质替换。最终图像会在解码后与原图拼接展示,再保存输出,让用户能清晰对比材质变化。

| 流程序号 | 流程阶段 | 工作描述 | 使用节点 | |

|---|---|---|---|---|

| 01 | 输入与尺寸分析 | 导入原始图像并检测宽高,为潜空间与调度器提供精确基础参数 | LoadImage、GetImageSizeAndCount | |

| 02 | 潜空间准备 | 通过 VAE 编码原图,搭建结构基底,同时初始化空潜空间用于后续替换 | VAEEncode、EmptyFlux2LatentImage | |

| 03 | 材质文本选择 | 选择用户想要的材质描述,并转成模型可理解的语义特征 | ImpactSwitch、CLIPTextEncode | |

| 04 | 引导构建 | 将材质语义与原图潜空间结合,通过指导权重调节生成方向 | ReferenceLatent、FluxGuidance、BasicGuider | |

| 05 | 采样调度与生成 | 设置采样器、噪声、步数和 Scheduler 后,由 UNet 完成材质重塑 | Flux2Scheduler、KSamplerSelect、SamplerCustomAdvanced、RandomNoise | |

| 06 | 解码与输出 | 将生成潜空间解码,还原为图像,并与原图进行拼接对比再保存 | VAEDecode、Image Stitch、SaveImage |

大模型应用

CLIPTextEncode 材质语义解析与风格控制

CLIPTextEncode 负责把材质 Prompt 转换成可被模型理解的语义特征。它专注处理文字描述,不参与图像结构,也不负责生成,只承担"语义解释"与"风格注入"的任务。用户输入的 Prompt 会直接影响材质风格、细节密度、材质光感、柔软硬度等效果,因此它在整个材质替换流程中承担核心的风格驱动作用。

| 节点名称 | Prompt 信息 | 说明 |

|---|---|---|

| CLIPTextEncode | 把图片角色变成毛线羊毛材质 | 将 Prompt 编码为 Conditioning,用于控制材质方向、风格质量与细节倾向 |

DF_Text 材质主题 Prompt 生成器

DF_Text 系列节点是工作流中的 Prompt 文本模板库,每个节点只负责提供一种材质主题的英文 Prompt,它们不处理图像,也不参与生成,只输出可被 CLIPTextEncode 使用的语义文字。用户选择哪一种材质,本质就是选择某个 DF_Text 的 Prompt。不同材质的 Prompt 决定最终风格,例如"毛线""果冻""树脂""金属"等,Prompt 越具体,材质越统一。

部分 DF_Text 节点说明(按工作流实际存在内容节选)

毛线羊毛材质 1

| 节点名称 | Prompt 信息 | 说明 |

|---|---|---|

| 毛线羊毛材质 1 | Transform the character into a wool yarn texture, keeping the original style and color consistency. | 输出"毛线材质"语义,用于让角色呈现线团、编织感等风格特征 |

棉花糖软绵材质 2

| 节点名称 | Prompt 信息 | 说明 |

|---|---|---|

| 棉花糖软绵材质 2 | Transform the character into a marshmallow soft texture, keeping the original style and color consistency. | 输出"棉花糖软绵质感",使角色呈现柔软蓬松的半固体风格 |

果冻透明材质 3

| 节点名称 | Prompt 信息 | 说明 |

|---|---|---|

| 果冻透明材质 3 | Transform the character into a translucent jelly texture, keeping the original style and color consistency. | 输出"果冻质感",让角色呈现半透明果冻光泽 |

软糖Q弹材质 4

| 节点名称 | Prompt 信息 | 说明 |

|---|---|---|

| 软糖Q弹材质 4 | Transform the character into a gummy candy texture, keeping the original style and color consistency. | 输出"软糖弹性材质",形成黏弹和亮面效果 |

黏土手捏风 5

| 节点名称 | Prompt 信息 | 说明 |

|---|---|---|

| 黏土手捏风 5 | Transform the character into a resin figurine texture, keeping the original style and color consistency. | 输出"树脂 / 黏土捏造质感",让角色表现为手捏玩偶风格 |

(其余 DF_Text 材质节点如:树脂、塑料、陶瓷、金属、液态金属、玻璃雕刻、翡翠、冰块、火山岩、翻糖蛋糕、像素 8bit、漫画网点、赛博光能、海绵颗粒等均依照相同结构完成材质 Prompt 提供任务)

使用方法

整个工作流的运行逻辑是:用户导入一张角色图后,系统会自动读取图像尺寸并编码成潜空间。用户只需选择一种材质主题 Prompt,工作流会自动将该 Prompt 送入 CLIPTextEncode,生成对应的材质语义。模型接着会以原图潜空间作为结构基础,通过 Flux 的生成能力,让角色外观转为所选材质风格。最后系统自动解码、拼接、输出成图。

当用户替换新角色图或选择新的材质 Prompt 后,系统会自动重新编码图像,重新执行全部节点,并输出新的材质风格结果,无需额外操作。

| 注意点 | 说明 |

|---|---|

| Prompt 决定材质风格 | 语义越明确,材质越统一,例如"translucent jelly texture"能明确控制透明度与颜色表现 |

| 输入图尽量清晰 | 模糊图像会影响潜空间结构,使材质附着不稳定 |

| 角色应保持完整露脸 | 不完整的主体会导致材质映射不均匀 |

| 尺寸过大可能导致显存不足 | 可通过 ImageScaleDownToSize 自动调整到安全范围 |

| 材质选择应一次选择一个 | 同时输出多个材质可能导致语义冲突 |

| 不建议添加过长 Prompt | 主材质关键词应突出,避免稀释主题 |

| 生成失败时可更换随机种子 | 不同噪声会让材质分布更自然 |

应用场景

这个材质替换工作流适合在角色转换、商业包装、周边开发、创意改造、艺术再加工等领域使用。它的优势在于能保持原角色外形不变,只替换外观材质,且材质类型可从毛线、果冻、陶瓷到赛博光效等几十种任选,让创作者能快速得到风格一致的系列化视觉内容。无论是为手办设计材质提案,还是为游戏角色制作主题皮肤,甚至为品牌塑造视觉 IP,都能通过此流程得到稳定且可控的材质重塑效果。

| 应用场景 | 使用目标 | 典型用户 | 展示内容 | 实现效果 |

|---|---|---|---|---|

| 角色材质替换 | 将现有角色快速改成指定材质样式 | 插画师、模型师、视觉设计师 | 原图与材质替换后的成品图 | 保留角色结构,让材质替换自然且统一 |

| IP 视觉衍生 | 为同一角色生成多材质主题系列 | 品牌方、IP 团队 | 系列材质风格产物 | 统一风格的多款衍生设计 |

| 商品包装创意 | 生成产品吉祥物或图标的材质变体 | 电商、包装设计公司 | 材质变形后的角色形象 | 提升包装创意表现力 |

| 游戏美术开发 | 角色皮肤、特殊材质状态效果设计 | 游戏美术、UI/UX 团队 | 不同材质版本的角色皮肤草图 | 快速验证材质风格方向 |

| 艺术再创作 | 将原始照片或角色转为艺术材料质感 | 艺术创作者、自媒体 | 材质重塑后的艺术风格图像 | 营造独特艺术氛围并生成系列风格内容 |

开发与应用

更多 AIGC 与 ComfyUI工作流 相关研究学习内容请查阅:

更多内容桌面应用开发和学习文档请查阅:

AIGC工具平台Tauri+Django环境开发,支持局域网使用

AIGC工具平台Tauri+Django常见错误与解决办法

AIGC工具平台Tauri+Django内容生产介绍和使用

AIGC工具平台Tauri+Django开源ComfyUI项目介绍和使用

AIGC工具平台Tauri+Django开源git项目介绍和使用