近期Mamba与注意力机制 的融合方向持续升温,众多科研团队聚焦这一热门赛道,成功研发出SegMAN、MAVE、MambaNet等一系列创新融合模型。一举打破单一架构在长序列建模、局部细节捕捉上的局限,在语义分割、语音编辑、信道估计等多个主流应用场景中刷新SOTA成绩,更成功跻身CVPR、NeurIPS等行列!Mamba与注意力机制的融合路径,必将成为未来序列建模、多模态处理领域的核心发展方向。

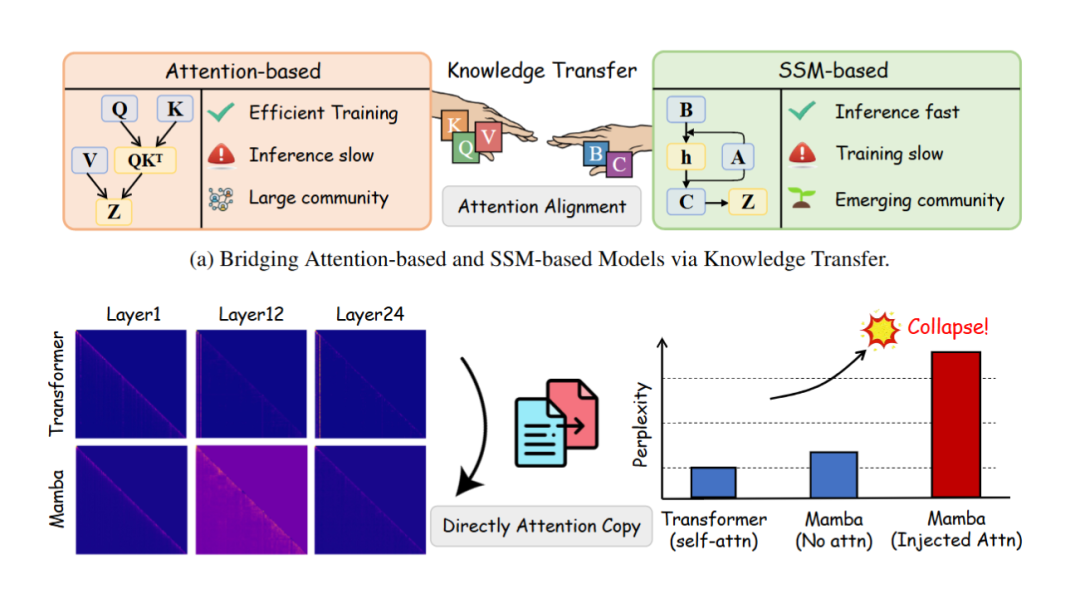

其背后的核心逻辑十分清晰:Mamba凭借选择性状态空间模型的独特特性,以线性复杂度实现超长序列的高效建模,轻松化解传统架构存在的计算量大、内存负担重等痛点;而注意力机制则擅长精准捕捉关键位置的细粒度交互关系,恰好弥补了Mamba在局部细节挖掘、跨序列关联建模上的短板。二者双向互补,**既实现了长程序列的高效建模,又达成了局部信息的精准聚焦,**整体性能较单一Mamba模型或纯注意力架构实现了跨越式提升。

对于计划深耕该领域、想发论文的伙伴而言,可重点布局这些研究方向:深度优化融合架构、适配多场景应用、推进模型轻量化落地、实现多模态协同建模等。 为了帮大家省去检索麻烦、我已整理好相关顶会论文 及复现代码( 部分 ), 想快速上手的同学工种号 沃的顶会 扫码回复 "曼巴注意力" 领取。

XLSR-MamBo: Scaling the Hybrid Mamba-Attention Backbone for Audio Deepfake Detection

文章解析

本文针对音频深度伪造检测(ADD)中纯状态空间模型(SSM)难以有效捕获全局频域伪造痕迹、而Transformer又存在二次计算复杂度的问题,提出XLSR-MamBo框架:以XLSR为前端特征提取器,结合Mamba与Attention协同建模的混合后端。通过系统评估Mamba2、Gated DeltaNet和原生双向Hydra等先进SSM变体,发现Hydra因其准可分矩阵参数化设计,可在O(N)复杂度下实现真正的双向建模,显著优于手工设计的双分支策略;同时验证了增大主干深度可有效缓解浅层模型的性能波动与推理不稳定性。该框架在ASVspoof 2021 LA/DF/In-the-Wild及DFADD基准上均达到具有竞争力的SOTA性能,并展现出对扩散模型与流匹配合成方法的强泛化能力。

创新点

首次将原生双向、线性复杂度的Hydra架构引入音频深度伪造检测,替代启发式双分支设计,实现高效非因果依赖建模。

提出XLSR-MamBo模块化混合框架,显式融合SSM(信息压缩与时序递归)与Attention(内容驱动的全局频域关联)的互补归纳偏置。

系统验证主干网络深度扩展对缓解ADD模型性能方差与推理不稳定性的关键作用。

在DFADD数据集上实证验证模型对新兴扩散模型与流匹配合成技术的跨范式泛化能力。

研究方法

采用XLSR作为自监督预训练前端,提取鲁棒语音表征。

构建四种拓扑结构的混合Mamba-Attention后端,集成Mamba、Mamba2、Hydra和Gated DeltaNet等先进SSM变体。

重点采用Hydra作为序列混洗器(sequence mixer),利用其准可分矩阵形式实现无冗余的原生双向建模。

在ASVspoof 2021 LA、DF、In-the-Wild及DFADD四大基准上进行统一评测,涵盖传统TTS/VC与前沿生成式语音合成方法。

通过控制变量实验分析主干深度缩放对性能稳定性的影响。

研究结论

Hydra的原生双向建模能力使其在捕捉整体时间依赖与频谱不一致性方面显著优于传统单向Mamba及双分支变体。

混合Mamba-Attention架构能协同捕获伪造语音中的局部高频细微痕迹(SSM优势)与全局频域异常(Attention优势)。

增大后端主干深度可系统性降低模型在不同伪造类型与信道条件下的性能波动,提升鲁棒性。

XLSR-MamBo在多个权威ADD基准上达到SOTA或竞争性水平,且代码开源,具备良好复现性与工程落地潜力。

MPCM-Net: Multi-scale network integrates partial attention convolution with Mamba for ground-based cloud image segmentation

文章解析

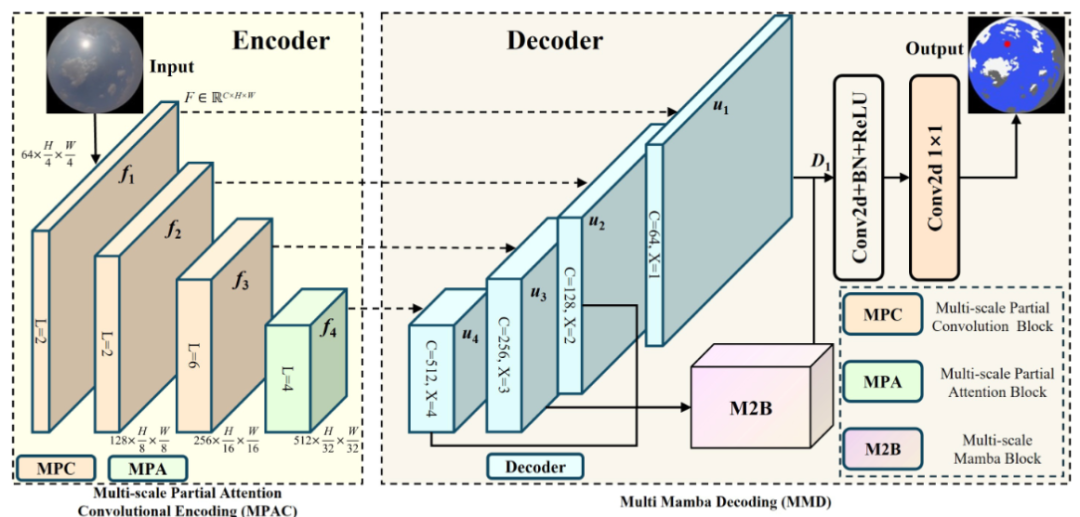

本文针对地面云图像分割在光伏功率预测中的关键需求,指出当前方法存在三大缺陷:(1)基于空洞卷积的多尺度建模忽视通道与空间特征的部分有效性及跨通道互操作性;(2)注意力机制未兼顾精度与吞吐量平衡;(3)解码器缺乏对层级局部特征间全局依赖的建模,导致上下文丢失与推理低效。为此,提出MPCM-Net:编码器引入多尺度部分注意力卷积(MPAC),含多尺度部分卷积块(MPC)与多尺度部分注意力块(MPA),实现高效全局空间交互与判别性特征提取;解码器采用多尺度Mamba模块(M2B),通过空间-语义混合域(SSHD)在线性复杂度下聚合跨空间与跨尺度深层特征;同时发布首个面向辐射源、颜色属性与尺度复杂性的细粒度标注数据集CSRC。

创新点

首次将Partial Convolution与Partial Attention协同嵌入多尺度卷积架构(MPAC),兼顾局部稀疏性建模与全局上下文感知。

提出空间-语义混合域(SSHD)作为Mamba在解码器中的新应用范式,实现线性复杂度下的跨尺度、跨层级全局依赖建模。

构建并开源CSRC数据集------首个支持辐射特性、颜色属性与多尺度变化的细粒度地面云图像分割基准。

在保持实时推理能力前提下,同步提升云边界细节分割精度与多尺度形态表征能力。

研究方法

编码器采用多尺度部分注意力卷积(MPAC),包含带部分通道模块(ParCM)和部分空间模块(ParSM)的MPC块,以及融合部分注意力模块(ParAM)与ParSM的MPA块。

解码器引入多尺度Mamba模块(M2B),在空间-语义混合域(SSHD)中执行状态空间建模,实现深特征跨尺度聚合。

设计端到端训练框架,在自建CSRC数据集上联合优化分割性能与推理延迟。

通过消融实验系统验证MPAC各组件、M2B结构及SSHD设计的有效性。

研究结论

MPCM-Net在CSRC数据集上显著超越现有SOTA方法,在mIoU等精度指标与FPS等效率指标间取得最优平衡。

MPAC有效缓解了传统空洞卷积在多尺度云形态建模中的局部性局限,提升特征交互效率与判别力。

M2B结合SSHD在解码阶段显著抑制上下文丢失,尤其增强云边缘与薄云等细粒度结构的重建能力。

CSRC数据集填补了面向光伏预测的物理可解释性细粒度云分割基准空白,推动领域向辐射建模与光学属性感知方向演。