前言:大家好,本人非厂公程序猿,分享OpenClaw本地化踩坑实战,主打免费、详实、无专业知识,新手也能跟着做。

day1: 聚焦Windows 系统下 OpenClaw 的安装、Ollama 本地模型配置及二者的对接调试.

一、核心环境说明

- 系统:Windows 10/11(需管理员权限)

- 工具:OpenClaw(beta 版,2026.2.24)、Ollama(本地大模型引擎)

- 模型:qwen2.5:7b(定制 32k 上下文,纯本地运行,无独显也可适配轻量版)

- 终端:PowerShell(管理员模式运行,全程核心操作终端)

二、Step1:安装 OpenClaw(beta 版)

OpenClaw 的 Windows 安装支持一键脚本,无需手动配置环境,步骤如下:

- 以管理员身份打开 PowerShell,直接执行安装命令:

less

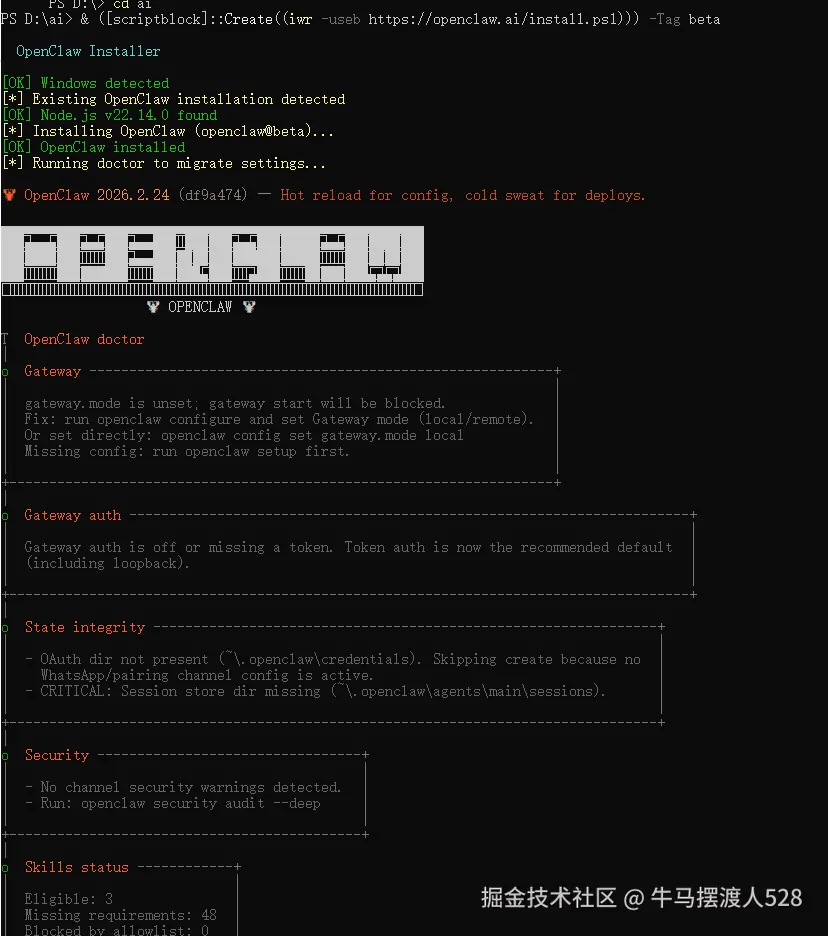

& ([scriptblock]::Create((iwr -useb https://openclaw.ai/install.ps1))) -Tag beta

-

等待安装完成,出现绿字提示 即代表安装成功(过程中会自动检测 Node.js,无需手动安装)。

-

验证安装版本,执行命令查看当前 OpenClaw 版本:

powershell

css

openclaw --version成功会返回2026.2.24(当前 beta 版最新版)。

三、Step2:安装 Ollama 本地大模型引擎

OpenClaw 自身不携带大模型,需单独安装 Ollama 作为本地模型引擎,全程免费,支持一键下载模型,步骤如下:

下载并安装 Ollama

- 官网下载:ollama.com/download/wi...(Windows 安装包约 1.2GB,支持 Win10 及以上)

- 一键安装:双击安装包,全程下一步,自动配置系统环境变量,无需手动操作。

- 验证安装:PowerShell 执行命令,显示版本号即成功:

css

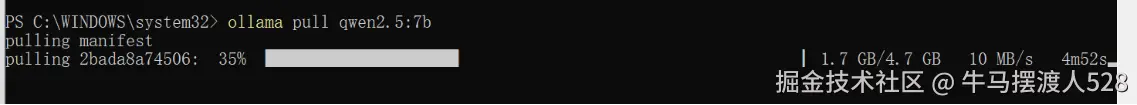

ollama --version2. 下载本地大模型(避坑版)

Ollama 支持云模型和本地模型,云模型需要账号,本地模型无需账号,纯离线运行 ,推荐根据硬件配置选择,避坑点:轻量模型 qwen:0.5b 不支持工具调用,需替换为 qwen2.5:7b。

硬件适配模型推荐

| 显卡显存 | 推荐模型 | 下载命令 | 特点 |

|---|---|---|---|

| 20GB+ | glm-4.7-flash | ollama pull glm-4.7-flash |

性能强劲,支持多工具调用 |

| 8GB-16GB | qwen2.5:7b | ollama pull qwen2.5:7b |

平衡性能与体积,支持工具调用 |

| 无独显(纯 CPU) | qwen2.5:0.5b | ollama pull qwen2.5:0.5b |

超轻量,运行流畅,基础对话可用 |

国内加速下载(必做,解决下载慢)

执行下载命令前,先配置国内镜像,避免下载超时:

bash

export OLLAMA_HOST=https://mirror.csdn.net/ollama

# 再执行模型下载命令

ollama pull qwen2.5:7b

3. 验证 Ollama 模型运行

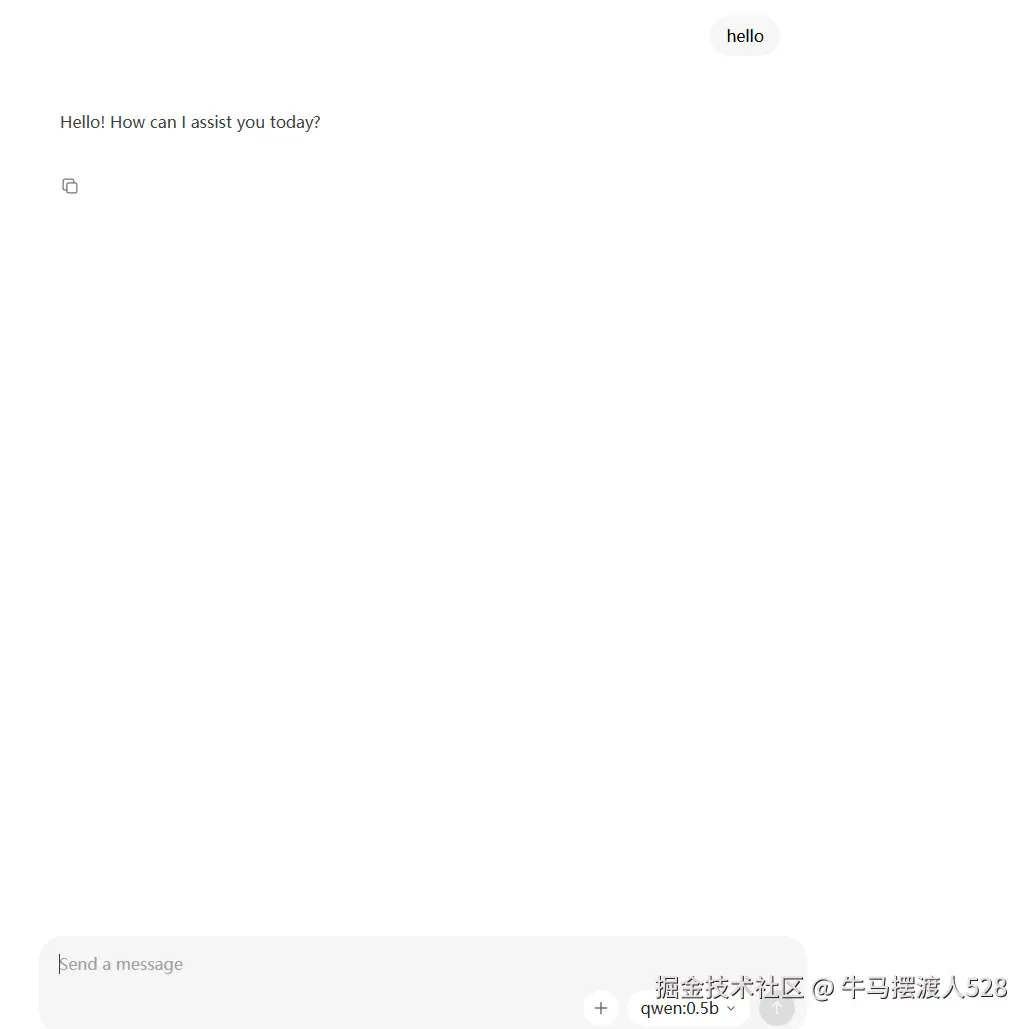

下载完成后,直接在 PowerShell 执行ollama run qwen2.5:7b,输入hello,模型能正常回复即代表本地模型运行成功。

四、Step3:定制 Ollama 模型(扩展上下文至 32k,核心避坑)

核心坑点:OpenClaw 要求模型上下文窗口≥16000 tokens,而 Ollama 默认下载的 qwen2.5:7b 上下文仅 4096 tokens,直接对接会报错,需手动定制模型扩展至 32768 tokens(兼顾推理速度与上下文长度)。

定制步骤(全程在用户目录执行,避免权限问题)

- 切换到当前用户目录(替换

<你的用户名>为实际 Windows 用户名,如我的是zxj:

bash

cd C:\Users<你的用户名>- 创建 Modelfile 配置文件,定义基础模型和上下文参数:

arduino

@"FROM qwen2.5:7b

PARAMETER num_ctx 32768"@ | Out-File -Encoding ascii Modelfile- 验证配置文件,执行命令查看内容,显示以下信息即成功:

bash

Get-Content Modelfile

# 正确输出:

# FROM qwen2.5:7b

# PARAMETER num_ctx 32768- 基于配置文件创建自定义 32k 上下文模型(命名为 qwen2.5:7b-32k,便于识别):

lua

ollama create qwen2.5:7b-32k -f Modelfile- 验证自定义模型,执行以下命令,能看到 qwen2.5:7b-32k 即成功:

bash

# 查看本地所有模型

ollama list

# 查看自定义模型配置(确认包含32k上下文)

ollama show qwen2.5:7b-32k --modelfile五、Step4:OpenClaw 对接本地 Ollama 模型(交互式配置,核心)

完成 Ollama 模型定制后,通过 OpenClaw 的交互式配置向导,实现二者的对接,步骤如下:

-

启动 OpenClaw 配置向导:

openclaw onboard

-

首次启动会出现安全提示 ,阅读后输入

Yes继续(OpenClaw 为 beta 版,需注意本地安全,不建议暴露到公网)。 -

选择

QuickStart(快速配置),进入Model/auth provider选择界面。 -

由于 Ollama 是自定义本地模型,选择Custom Provider(自定义提供商),按向导配置:

- API Base URL:

http://127.0.0.1:11434/v1(必加 /v1,核心避坑点) - API Key:可随意填写(如

ollama-local,Ollama 本地运行无需真实密钥) - Model ID:

qwen2.5:7b-32k(填写自定义的 32k 上下文模型名)

- API Base URL:

-

配置完成后,显示Verification successful即代表对接成功!

-

对接成功后,控制台会显示OpenClaw Web UI 地址 (

http://127.0.0.1:18789)和管理员 Token ,务必记录 Token(后续登录 Web UI 需要)。

对接失败排查(核心避坑)

若提示Verification failed,按以下步骤排查:

- 验证 Ollama 服务是否运行:执行

ollama list,能看到模型即正常;若未运行,执行ollama serve手动启动。 - 检查 API Base URL:必须以 /v1 结尾 ,正确为

http://127.0.0.1:11434/v1。 - 检查 Model ID:必须与自定义模型名完全一致(qwen2.5:7b-32k)

六、Step5:解决核心报错(模型上下文窗口过小)

首次启动 OpenClaw 大概率会出现报错:Model context window too small (4096 tokens). Minimum is 16000,原因是 OpenClaw 缓存了模型原始 4096 tokens 参数,未识别到定制的 32k,需手动修改配置文件。

修改步骤

-

找到 OpenClaw 的两个核心 JSON 配置文件(路径固定):

- 主配置文件:

C:\Users<你的用户名>.openclaw\openclaw.json - 模型配置文件:

C:\Users<你的用户名>.openclaw\agents\main\agent\models.json

- 主配置文件:

-

用记事本 / VS Code 打开两个文件,分别找到

models.providers.custom-127-0-0-1-11434.models数组中id 为 qwen2.5:7b-32k的对象。 -

将对象中的

contextWindow和maxTokens值从4096 修改为32768,修改后示例:

json

json

{"id":"qwen2.5:7b-32k","contextWindow":32768,"maxTokens":32768,"name":"qwen2.5:7b-32k","providerId":"custom-127-0-0-1-11434"}- 保存两个配置文件,完全退出所有 OpenClaw 相关窗口(按 Ctrl+C 终止终端进程),重新启动即可解决报错。

七、Step6:启动 OpenClaw,验证本地智能体运行

完成所有配置和报错修复后,启动 OpenClaw,验证核心功能,支持终端 TUI (推荐)和Web UI两种方式,任选其一即可。

方式 1:启动 TUI 终端交互界面(推荐,轻量流畅)

TUI 是 OpenClaw 的核心交互方式,无界面卡顿,适合日常使用,启动命令:

powershell

openclaw tui启动后直接输入问题,即可与本地 qwen2.5:7b-32k 模型对话,全程本地运行,无网络请求。

方式 2:访问 Web UI 可视化界面(备选,操作直观)

支持图形化操作、技能管理、配置修改,步骤如下:

- 确保 OpenClaw 服务运行(启动 TUI 或执行

openclaw gateway start启动网关)。 - 打开浏览器(Chrome/Edge/ 火狐),输入地址(含管理员 Token,无需手动输入):

plaintext

perl

http://127.0.0.1:18789/#token=你的管理员Token- 直接进入中文 Web 控制台,在「对话测试」模块输入指令,验证 AI 对话功能,与 TUI 效果一致。