引言:从"抽卡"到"导演"的视觉革命

2024年2月,当OpenAI发布Sora模型并展示其从文本生成60秒连续视频的能力时,整个AI界为之震动。这一事件被普遍视为AI视频领域的"ChatGPT时刻"------它让所有人意识到,视频制作的门槛正在被技术重新定义。从简单的文字描述到流畅的动态画面,AI视频生成技术在过去几年中经历了从概念验证到商业应用的跨越式发展,正在重塑内容创作的游戏规则。

传统视频制作至少需要三类专业能力:内容策划(写脚本)、视觉表达(拍摄或绘制画面)和后期合成(剪辑、调色、配音)。这三项能力分别对应编剧、摄影师和剪辑师三个专业角色。AI的介入,本质上是在逐步替代或降低这三项能力的获取门槛。大语言模型可以辅助写脚本,AI绘图工具可以生成画面,AI视频模型可以让静态图片动起来。当这些工具被串联成一条完整的工作流,一个人就能完成过去需要一个团队才能做的事情。

截至2026年初,全球AI视频生成市场的竞争已经白热化。Runway发布了Gen-4.5,在文生视频基准测试中登顶;快手可灵推出3.0版本,主打"All-in-One"多模态输入输出;字节跳动的即梦AI接入Seedance 2.0模型,被业界称为"地表最强AI视频模型"。这些工具的迭代速度之快,意味着今天的"不可能"很可能在半年后变成"一键完成"。

一、技术发展历程:从GAN到DiT的演进之路

1.1 早期探索阶段(2016年前)

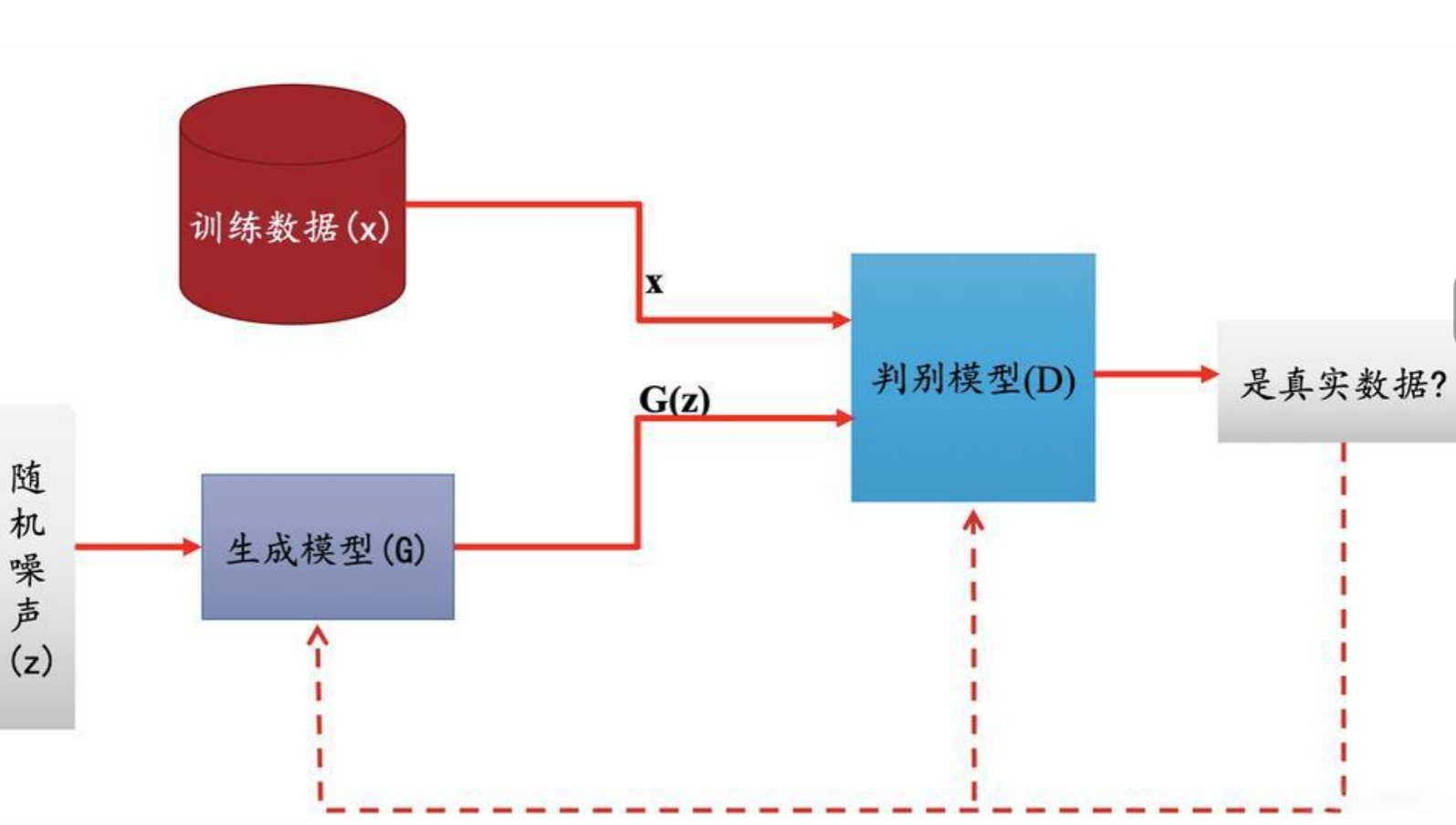

AI视频生成技术最早可追溯至20世纪90年代的图像序列拼接方法,开启了将静态帧合成为动态视频的早期尝试。但真正的AI模型化探索始于2014年生成对抗网络(GAN)理论的提出。这一阶段确立了"视频可被端到端生成"的技术方向,是后续技术跃迁的理论起点。

1.2 GAN/VAE主导期(2016-2020年)

2016-2020年是GAN主导的探索期,这一阶段实现了像素级生成与操控,出现了Deepfake技术,可完成短视频风格迁移。GAN能够生成更高质量的数据,但也伴随着稳定性较差、生成图像缺乏多样性等问题,导致应用范围有限,行业发展速度缓慢。

1.3 扩散模型突破期(2020-2024年)

2020年后,扩散模型在图像生成领域取得显著成效,研究界开始尝试将该技术用于视频生成。2020-2024年是扩散模型突破与商业化探索的关键时期,Runway Gen-2、Pika等工具出现,文本驱动视频生成技术大幅提升,达到初步商用标准。

这一时期的代表性工作包括:

-

Video Diffusion Models (VDM):最早将扩散模型应用于视频生成的开创性工作

-

Make-A-Video:通过在预训练的文本到图像扩散模型基础上添加时序组件,实现高质量的文本到视频生成

-

Imagen Video:Google AI团队提出的大规模视频生成模型,采用级联扩散模型架构,能生成高分辨率、长时间的视频

1.4 产品化与应用加速期(2024年至今)

2024年成为视频生成技术的突破年。2月OpenAI发布的Sora模型将视频生成时长从几秒钟大幅提升到一分钟,且在分辨率、画面真实度、时序一致性等方面都有显著提升。Sora采用DiT(Diffusion Transformer)架构,奠定了从静态"画"到动态"演"的底层叙事。

此后,行业进入爆发期,各大厂商纷纷推出自己的视频生成模型:

-

2024年6月:Runway发布Gen-3 Alpha和Gen-3 Alpha Turbo

-

2024年6月:Luma AI发布Dream Machine

-

2024年6月:快手发布可灵AI

-

2024年7月:字节跳动发布PixelDance和Seaweed

-

2024年10月:字节跳动发布即梦AI

二、核心技术原理:从像素到时空的建模革命

2.1 扩散模型:视频生成的"发动机"

扩散模型是当前文本到视频生成领域的主流架构,被广泛应用于OpenAI Sora、Stable Video Diffusion等系统中。其工作原理类似一个"去噪"的学习过程:AI首先学习如何将清晰的视频逐步添加噪声,直到变成完全随机的噪点;然后,它再反向学习如何从一堆噪点中,一步步"去噪"并重建出符合文本描述的清晰画面。

在数学上,扩散过程可以描述为:假设x0是从真实数据分布中采样的数据点,我们逐步向其引入少量的高斯噪声,形成一系列x0的噪声变量x1,...,xT,随着t的增长,噪声量逐渐增大,直至最终形成纯高斯噪声。训练扩散模型的目标是学习逆过程,即训练pθ(xt−1∣xt)。通过沿着这个过程链向后遍历,可以生成新的数据。

2.2 时空建模:从2D+1D到3D统一表示

早期的视频生成模型(如AnimateDiff)采用"2D空间+1D时间"的解耦架构,无法真正理解三维世界的深度与遮挡。这种架构假设时间只是一个附加的"播放轴",但真实世界不是这样的。当一辆车驶过一棵树的背后时(物理遮挡),在二维画面上,车的像素"消失"了。如果AI只懂得2D+1D的推演,当车再次从树后开出来时,AI往往会"忘掉"这辆车原本的样子,画出一辆完全不同颜色或型号的车。

Sora及其同类模型带来了架构上的大一统:它们将视频视为一个完整的三维数据块(3D Volume),并将其切割为时空补丁(Spacetime Patches)。X轴是宽度,Y轴是高度,T轴是时间。在这个"冰块"视角下,视频的生成不再是线性的流水线,而是一个整体的雕刻过程。

2.3 视觉分词器:视频的"Tokenizer"

与大型语言模型使用文本token类似,Sora使用视觉块(visual patches)作为视频的基本表示单元。Sora首先需要将视频数据转换为适合Transformer处理的token序列,这通过视觉分词器实现。具体来说,Sora将视频压缩到一个低维的潜变量空间,然后将其拆解为时空碎片(Spacetime Latent Patches)。

时空碎片是时空建模的关键,统一了时空分割的"语言"。有了时空碎片这一统一的语言,Sora自然解锁了多种技能:自然语言理解、图像视频作为prompts等。无论是一张静态的高清图片,还是一段低分辨率的长视频,又或是一段高帧率的短视频,在被切成"时空补丁"后,对于Transformer大脑来说,它们都变成了完全一样的东西------一长串Token序列。

2.4 Diffusion Transformer(DiT):统一架构的力量

Sora是一个基于扩散模型的Transformer(Diffusion Transformer,DiT),这来自伯克利学者的工作"Scalable diffusion models with transformers"。DiT架构融合了扩散模型和Transformer的优势:扩散模型提供了高质量生成的能力,而Transformer则提供了强大的序列建模和长距离依赖捕捉能力。

在DiT架构中,输入潜变量被分解成几个patch并由几个DiT块处理。DiT块对标准Transformer进行了变体实验,这些变体通过自适应层归一化、交叉注意力和额外的输入token做调节。自适应层归一化效果最好。

三、关键技术突破:推动视频生成质变的核心创新

3.1 时空注意力机制:理解动态世界的钥匙

Sora 2.0通过多尺度时空注意力机制实现根本性突破:采用"帧内-帧间-镜头间"三级注意力网络,在128×128×64的特征立方体中,对物体运动轨迹进行动态追踪。底层注意力负责单帧像素级细节,中层处理5秒内的动作连贯性,顶层则管理跨镜头的环境一致性(如阳光角度、阴影长度)。

传统的卷积神经网络(CNN)只能看到相邻的像素,但Transformer的自注意力机制(Self-Attention)可以无视距离,同时计算所有Token之间的关系。在Sora生成视频的去噪过程中:位于T=1秒的"车头补丁",可以直接和T=5秒的"车尾补丁"进行信息交互;位于画面左上角的"光源补丁",可以直接影响画面右下角的"水面倒影补丁"。

3.2 物理引擎融合:从"像素统计"到"世界模拟"

OpenAI与NVIDIA的深度合作在Sora 2.0中展现决定性价值------Omniverse物理模拟模块的原生整合,使模型首次具备"物理常识"。模型摒弃传统生成模型的"乐观偏差"(如篮球必进筐),通过GPU加速的粒子动力学引擎,精准模拟流体、刚体、布料的物理交互。

当OpenAI用千万小时级别的真实世界视频去喂养这个庞然大物时,奇迹发生了:涌现(Emergence)。Sora内部没有编写任何类似虚幻引擎(Unreal Engine)的3D光线追踪代码或重力公式。但为了在生成时拿到最高的分数(最小的Loss),神经网络在它那包含了几百亿参数的权重矩阵中,强行拟合出了物理世界的运转规律。它"死记硬背"出了:三维一致性(镜头旋转时物体的侧面和背面应该长什么样)、长期遮挡(人走过柱子后衣服的颜色不能变)、环境互动(画笔在画布上画过一定会留下颜料的痕迹)。

3.3 多模态理解:从"文本匹配"到"语义共情"

升级后的CLIP-Vision 2.0模型实现三重突破:口型驱动技术结合Wav2Lip 3D模型,支持8种语言的实时口型生成,在"多语言切换演讲"测试中,口型与语音的时间差小于20ms。环境音生成基于视频场景动态创建音效,如"森林漫步"视频中,脚步声会随地面材质(草地/石板)变化,鸟鸣方位与画面中鸟类位置精准匹配。

新一代模型能精准解析文本中的情绪倾向并匹配相应视觉风格,例如将"温馨的家庭晚餐"转化为暖色调画面并自动生成舒缓背景音乐。上海交大等机构在CVPR 2025发表的《ByTheWay》论文揭示,通过优化时间注意力图的能量分布,可显著改善视频的运动幅度和时间一致性问题,使生成内容从"静态图像序列"真正升级为"动态视频叙事"。

3.4 分层生成架构:解决高分辨率长视频的显存瓶颈

Wan、Sora、HunyuanVideo等顶级模型都采用了分层生成(Hierarchical Generation)策略来解决高分辨率视频的显存瓶颈:

-

Base Model:生成低分辨率、低帧率的基础latent(如480p@16fps)

-

Temporal Super-Resolution:提升时间分辨率(如16fps→48fps)

-

Spatial Super-Resolution:提升空间分辨率(如480p→1080p)

Imagen Video构建在一系列扩散模型的级联之上,以提升视频生成质量,并升级至输出1280x768分辨率、每秒24帧的视频。Imagen Video的架构由以下部分构成,共包含7个扩散模型:一个冻结的T5文本编码器,提供文本嵌入作为条件输入;一个基础视频扩散模型;一个由空间和时间超分辨率扩散模型交错组成的级联,包括3个TSR(时间超分辨率)和3个SSR(空间超分辨率)组件。

四、主流模型与技术对比

4.1 国际领先模型

OpenAI Sora:2024年2月首次展示60秒演示视频,12月正式发布;对物理世界理解深刻,支持复杂场景、多角度镜头生成,已集成进ChatGPT,可生成20秒视频。Sora 2.0于2025年10月发布,通过多尺度时空注意力机制实现从"片段生成"到"叙事连贯"的跨越,120秒长视频的穿帮率从1.0版本的41.2%降至0.3%。

Runway Gen系列:Runway是这个领域的先行者,其Gen-3和Gen-4系列模型在商业制作中应用最广,生成速度快(30到90秒出片),对复杂镜头调度的理解能力强。2025年底发布的Gen-4.5在基准测试中超越了Google Veo3,登顶文生视频榜首。

Google Lumiere:采用Space-Time U-Net一次性生成整段视频,支持最长5秒的1080p视频生成。Luma AI推出的RAY2模型通过亚马逊云科技Bedrock平台开放服务,计算能力较前代提升10倍,能生成逻辑严谨的事件序列。

4.2 国内主流模型

快手可灵AI:支持2分钟、1080p、30fps视频生成;采用DiT架构,迭代迅速,2025年9月推出的Kling 2.5 Turbo成本降低30%,全球用户超4500万。可灵以物理效果的真实感见长,人物运动自然流畅,2026年2月发布的可灵3.0支持最长15秒连续高清视频生成,最高4K分辨率60fps,并内置口型同步功能。

字节跳动即梦AI:画面审美、光影质感及中文语义理解出色;背靠抖音与剪映生态,打通"生成-剪辑-发布"全链路,月活5400万。即梦AI接入Seedance 2.0模型,被业界称为"地表最强AI视频模型"。

腾讯混元HunyuanVideo:凭借13亿参数规模的开源模型架构和领先的视频生成能力,正在重塑文本到视频的创作范式。该系统采用基于扩散变换器(Diffusion Transformer,DiT)的架构,通过13亿参数的深度神经网络实现复杂视觉内容的生成。其独特的"双流到单流"混合模型结构具有显著优势:使用Decoder-Only结构的多模态大语言模型作为文本编码器,不仅强化了图像-文本对齐精度,还大幅提升了对复杂指令的理解能力。

阿里巴巴Wan 2.1:2025年2月开源的Wan 2.1模型以9.5分的综合评分领跑开源领域,其14B参数规模支撑起720P高清视频输出,尤其在人物动作流畅性测试中表现最为自然,能精准还原"女孩旋转时裙摆自然飘动"这类精细动态场景。

4.3 技术架构对比

| 模型 | 主干架构 | 文本编码器 | 层级生成 | 核心特征 | 中文支持 |

|---|---|---|---|---|---|

| Stable Video Diffusion | 3D UNet | CLIP | ✗ | 基于SD扩展 | 弱 |

| VideoCrafter | DiT | T5-XXL | ✗ | 可控生成 | 一般 |

| HunyuanVideo | Video DiT | Qwen | ✓ | 多阶段 | 强 |

| Wan(阿里) | Video DiT | Qwen 2.5 | ✓ | 高分辨率+语义一致 | 原生支持 |

Wan的核心优势在于:中文原生支持(使用Qwen系列,中文prompt理解力远超CLIP)、多阶段架构(可生成1080p以上的高分辨率视频)、工业级优化(显存效率高,支持消费级显卡推理)。

五、技术挑战与瓶颈

5.1 结构合理性问题

现有模型生成的视频常出现物理上不可能的场景,如"漂浮的桌椅"、"突然变形的人物肢体"等,这些违背现实规律的内容严重影响观感。Sora并不是真的"懂"物理,它只是一个"极其优秀的模仿者"。它的本质依然是基于概率分布的统计学模型。只要是概率模型,一旦遇到训练集里极少出现(长尾)的复杂物理交互,它的"物理梦境"就会瞬间破碎。

典型的翻车现场(物理幻觉)包括:刚体动力学失效(玻璃杯掉在地上,Sora可能会让杯子像液体一样融化穿过地板,而不是碎裂)、因果倒置(一个人咬了一口饼干,但饼干上却没有缺口;或者人还没吹蜡烛,火苗就先灭了)、空间错乱(画面里的人在跑步机上跑着跑着,方向突然反了,或者腿部变成了三条腿交替)。

5.2 时间一致性缺失

时间一致性缺失表现为帧间闪烁、物体突然出现或消失等问题,尤其在10秒以上视频中更为明显。当前主流的AI视频模型(无论是Runway、可灵还是Pika),单次生成的视频时长通常在4到15秒之间。这意味着,一段1分钟的视频至少需要4到15个独立生成的片段拼接而成。

长视频的连贯性,是目前悬在所有AI视频大厂头顶的达摩克利斯之剑。虽然Sora 2.0将120秒长视频的穿帮率从1.0版本的41.2%降至0.3%,但在"雨天咖啡馆"多镜头测试中,窗外雨滴轨迹、桌上咖啡渍形态保持全程一致仍是一个挑战。

5.3 运动幅度不足

运动幅度不足是另一个普遍痛点。许多生成视频仍存在"伪静态"问题,人物动作僵硬如木偶,液体流动缺乏自然韵律。研究发现这与模型时间注意力图的能量分布直接相关------能量越低,视频运动越匮乏。虽然《ByTheWay》论文提出了优化方案,但在复杂场景下的效果仍不稳定。

5.4 计算资源门槛

顶级模型如Wan 2.1和SkyReels V1仍需A100/H100等高端GPU才能发挥最佳性能,普通创作者难以负担。Sora 2.0的训练所需算力达1.2×10²³ FLOPs(百亿亿次浮点运算),训练集群总计动用12.8万台H200 GPU,按单卡3万美元计算,硬件投入达38.4亿美元。训练过程持续6个月,总耗电量约2.4亿度,相当于2万户家庭年用电量。

5.5 版权与伦理问题

版权归属的模糊性引发行业担忧,训练数据中包含的海量视频片段可能涉及知识产权争议,尽管2025年相关法规已逐步完善,但技术解决方案仍待突破。Sora 2.0的"客串"功能基于神经辐射场(NeRF)的全维度数字人重建,用户上传10秒多角度音视频后,模型在3分钟内生成1024×1024分辨率的3D数字分身,包含200+个面部控制点和120+个人体关节参数。这引发了深度伪造和隐私保护的伦理担忧。

六、应用场景与产业影响

6.1 内容创作:成本与效率的颠覆式重构

AI视频生成技术正在重塑多个行业的内容生产流程。在电商领域,商家只需输入产品描述和促销亮点,AI就能自动生成包含场景展示、功能演示的产品视频,将传统需要数天的制作周期缩短至小时级。教育机构则利用该技术将教学大纲快速转化为动画课程,通过"太阳系行星运行"等动态可视化内容提升学习效率。

预计2026年全球短视频制作成本将下降67%,美妆品牌Glossier已用Sora生成多语种带货视频,单条成本从2000美元降至340美元。一部由迪士尼、皮克斯出品的顶级动画电影,其每分钟制作成本高达200万美元,而AI模型生成的相似画面,目前已可将单位成本压缩至每分钟300美元左右。

6.2 广告营销:创意生产的效率革命

广告行业成为技术应用的先锋阵地。Luma RAY2模型在亚马逊云平台的案例显示,品牌方通过文本指令可生成多种镜头角度的广告片段,快速测试不同创意方向的效果。SkyReels V1模型凭借顶级的人脸表情生成能力,支持33种表情和400+动作组合,成为虚拟主播和数字人广告的理想工具,使"虚拟代言人"的视频内容生产成本降低60%以上。

Sora 2.0打通"创作-种草-购买"链路,重构内容电商逻辑:基于Stripe的嵌入式支付接口,用户在视频播放页即可完成商品购买,支付成功率达98.6%(传统电商平均82%)。当视频出现商品(如运动鞋),系统自动识别并弹出购买链接,支持尺寸推荐、搭配建议等智能交互。

6.3 影视制作:从预可视化到全流程变革

影视行业的预可视化流程将彻底改变,导演可实时生成多个镜头方案进行筛选。《斯蒂芬·科尔伯特晚间秀》的视频图形团队成员使用Runway的技术,为传统的数字视频添加特效,将编辑时间从数小时缩短到数分钟。美国电影制作人泰勒·佩里在观看Sora的预览后,暂停了他计划的制片厂扩建,他认为不出几年,AI视频可能会使传统制片厂倒闭。

Runway将视频生成更多定位为"创意效率工具",而非低门槛生产工具。它的核心功能主要有中间帧控制、AI角色的表情与动作复刻、视频扩展等,在实现效率的同时,核心的创意输出依然由人类自身所掌控。

6.4 游戏与虚拟现实:沉浸式体验的新引擎

游戏开发者利用AI视频生成技术生成动态场景素材,提升游戏世界的沉浸感。AI视频生成将与3D建模、VR/AR技术结合,支持"文本→3D场景→动态视频"的全流程自动化。想象一下,输入"未来城市的交通系统",AI不仅生成视频,还能提供可交互的3D模型供创作者调整镜头角度和光线效果。

6.5 新闻与教育:实时化与可视化转型

新闻机构利用技术将突发新闻文字报道实时转化为视频新闻,显著提升了报道时效性。教育机构通过生成交互式教学视频,使抽象概念可视化呈现。这些应用共同指向一个核心价值:将创意构想转化为视觉内容的"摩擦力"正急剧降低。

七、未来发展趋势

7.1 技术优化方向

短期来看,技术优化将聚焦于三个方向:分辨率向4K普及,视频时长突破30秒限制,以及物理引擎的深度集成以解决合理性问题。预计到2026年,消费级GPU将能运行高清视频生成模型,硬件门槛的降低将催生更多创意应用。

开源社区的模块化设计将加速这一进程,使开发者能像搭积木一样组合不同功能组件。腾讯混元HunyuanVideo的开源策略为AI视频技术的普及奠定了重要基础,腾讯已在Gitcode和Hugging Face平台完整开放模型代码、预训练权重和技术文档,遵循Apache 2.0开源协议允许商业使用。

7.2 多模态深度融合

中期发展将实现多模态创作的深度融合。文本生成视频将与3D建模、VR/AR技术结合,支持"文本→3D场景→动态视频"的全流程自动化。扣子coze这类AI应用开发平台的出现,为突破技术瓶颈提供了新的思路。它本身并非一个专精的视频生成模型,而是一个强大的智能体工作流调度中枢。

在视频生成这一复杂链条上,扣子coze的核心价值在于整合与编排------它可以调用文生图、图生图模块完成关键帧设计,衔接文生视频或图生视频引擎完成动态化,甚至集成语音合成、背景音乐生成与剪辑逻辑,将原本割裂的多模态AI能力串联成一个端到端的自动化视频生产线。

7.3 创作范式重构

长期而言,这项技术将重构内容创作的范式。当AI能理解复杂叙事结构并生成符合电影语言的视频片段时,"提示词工程师"将成为新兴职业,他们擅长用精准文字描述引导AI创作。更深远的影响在于创意民主化------任何人都能将脑海中的故事转化为生动视频,人类的创造力将被彻底解放。

未来的视频生成智能体,可能不仅仅是被动地执行用户的逐条指令,而是能够基于一个简单梗概,自主进行情节推演、分场设计、镜头语言规划,并协调调用不同生成模块去执行。它更像一个不知疲倦、知识渊博的"执行导演",将人类从繁琐的技术实现中解放出来,聚焦于最顶层的创意与审美把控。

7.4 产业格局演变

2025年,AI视频生成的战场已经从跑分竞赛转向了商业逻辑的兑现。与大语言模型(LLM)已形成寡头格局不同,视频生成模型仍处于"诸侯割据"的早期阶段,技术、市场、生态均未定型。据POE榜单显示,快手可灵、MiniMax海螺长期市场份额位于前列。而字节即梦由于新版本上线时间较晚(2025年6月),在5月榜单中尚未露面。

背靠内容平台的分发资源和用户流量,字节、快手等内容大厂在国内C端用户占据上更具优势,已开始构建起"模型生成---内容创作---平台分发"的闭环生态,将AI能力直接注入短视频作者链条中,实现用户对视频模型的自然渗透。相比之下,诸多创业公司如爱诗科技PixVerse、MiniMax海螺等,则将目标用户对准了海外市场。

八、结语:从工具到创作伙伴的进化

AI视频生成技术的发展不仅是工具的进化,更是人类表达能力的延伸。从目前的技术断点到未来的创作自由,这条道路虽充满挑战,但已清晰可见。当技术足够成熟时,我们或许不再需要"拍"视频,而是直接"写"出视频。

在这场创意革命中,真正的赢家将是那些学会与AI协作,将技术可能性转化为艺术表现力的创作者们。技术进步并不意味着创作变得简单。恰恰相反,理解AI视频生成的底层逻辑和完整流程,比盲目追逐工具更重要。

站在2025年岁末回望,AI视频技术已越过从无到有的奇点,正跋涉在从有到优、从优到稳的漫长征途。工具会迭代,平台会演进,但不变的核心诉求始终是:如何让创造,更高效、更普惠。这场由技术驱动的内容生产革命,其下半场的剧本,将由更精密的整合与更深刻的自动化来书写。

随着AI视频生成技术的持续成熟,HunyuanVideo引擎展现出从工具属性向创作生态演进的明确趋势。腾讯通过开源策略构建的技术社区,正在汇聚全球开发者的创新力量,推动视频生成技术向更高分辨率、更长时长、更强交互性方向发展。未来,随着多模态交互技术的深化和边缘计算能力的提升,我们有理由相信,文本到视频的创作流程将更加自然直观,AI将真正成为创作者的创意伙伴而非简单的生产工具,为数字内容产业带来更具颠覆性的变革。