最近在跑本地大模型,下载了ollama,想跑下deepseek-r1,发现跑推理时候没有使用到我的GPU,只有CPU狠狠拉满

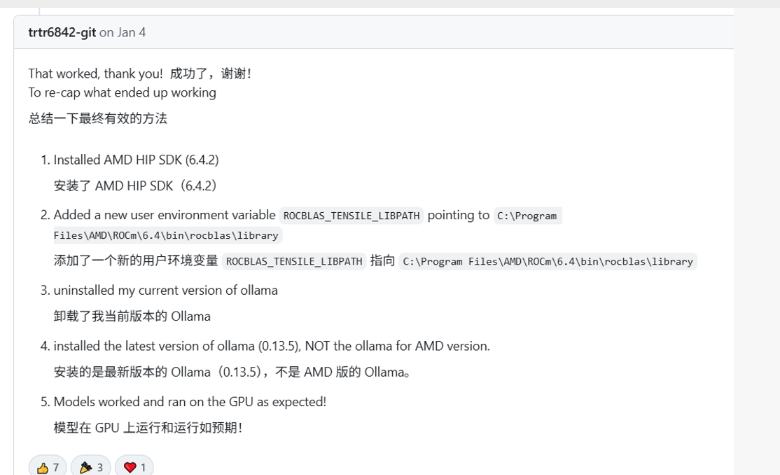

后续在github查issue时候发现有人和我遇到相同问题,下面贴一下

按照他的步骤和我理解,重新梳理得出如下步骤

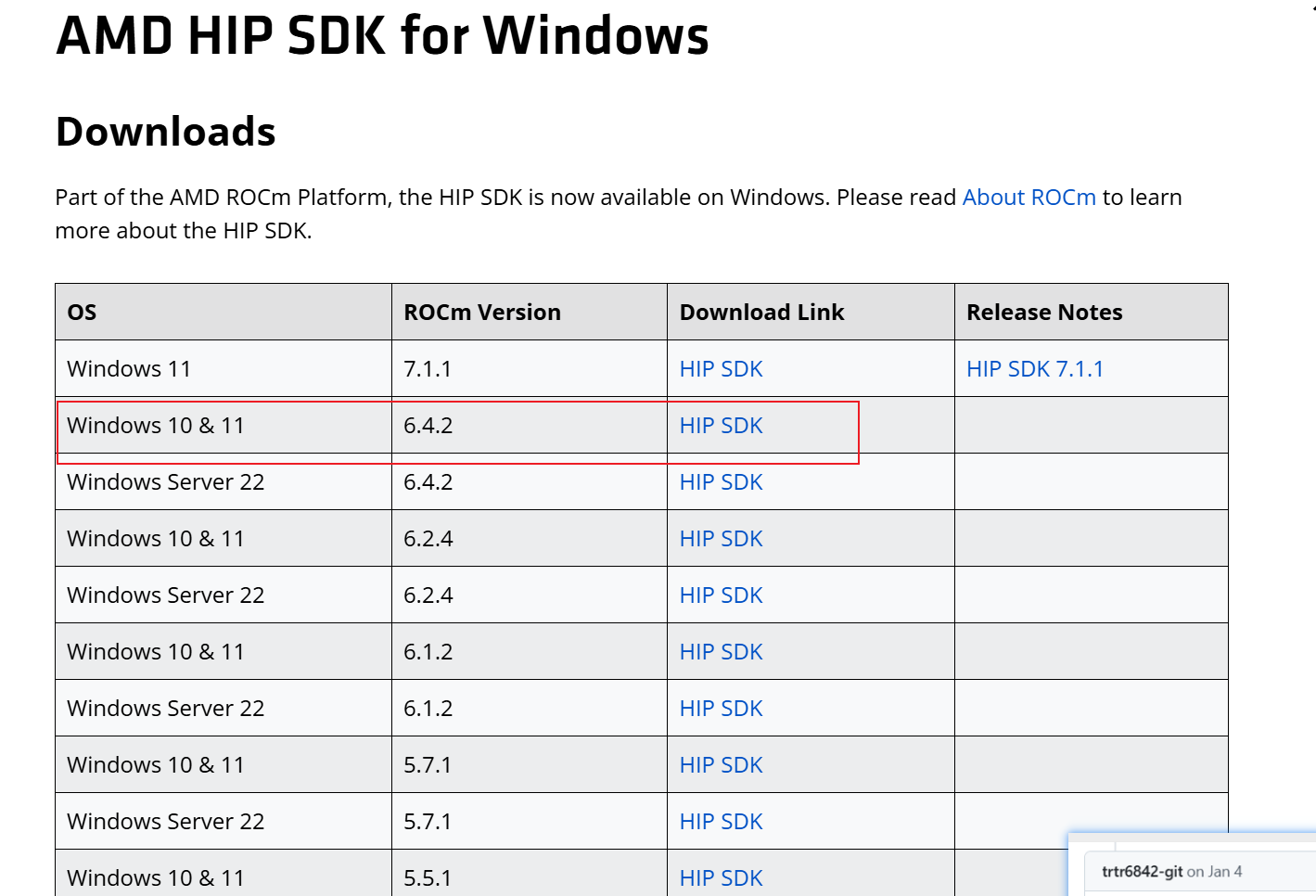

第一步 安装HIP AMD HIP SDK for Windows

我的是9070xt,选择红框部分更新

第二步,添加环境变量

ROCBLAS_TENSILE_LIBPATH 建议两个都新增一下

ROCBLAS_TENSILE_LIBPATH 值为C:\Program Files\AMD\ROCm\6.4\bin\rocblas\library

系统变量添加

OLLAMA_VULKAN 值为1

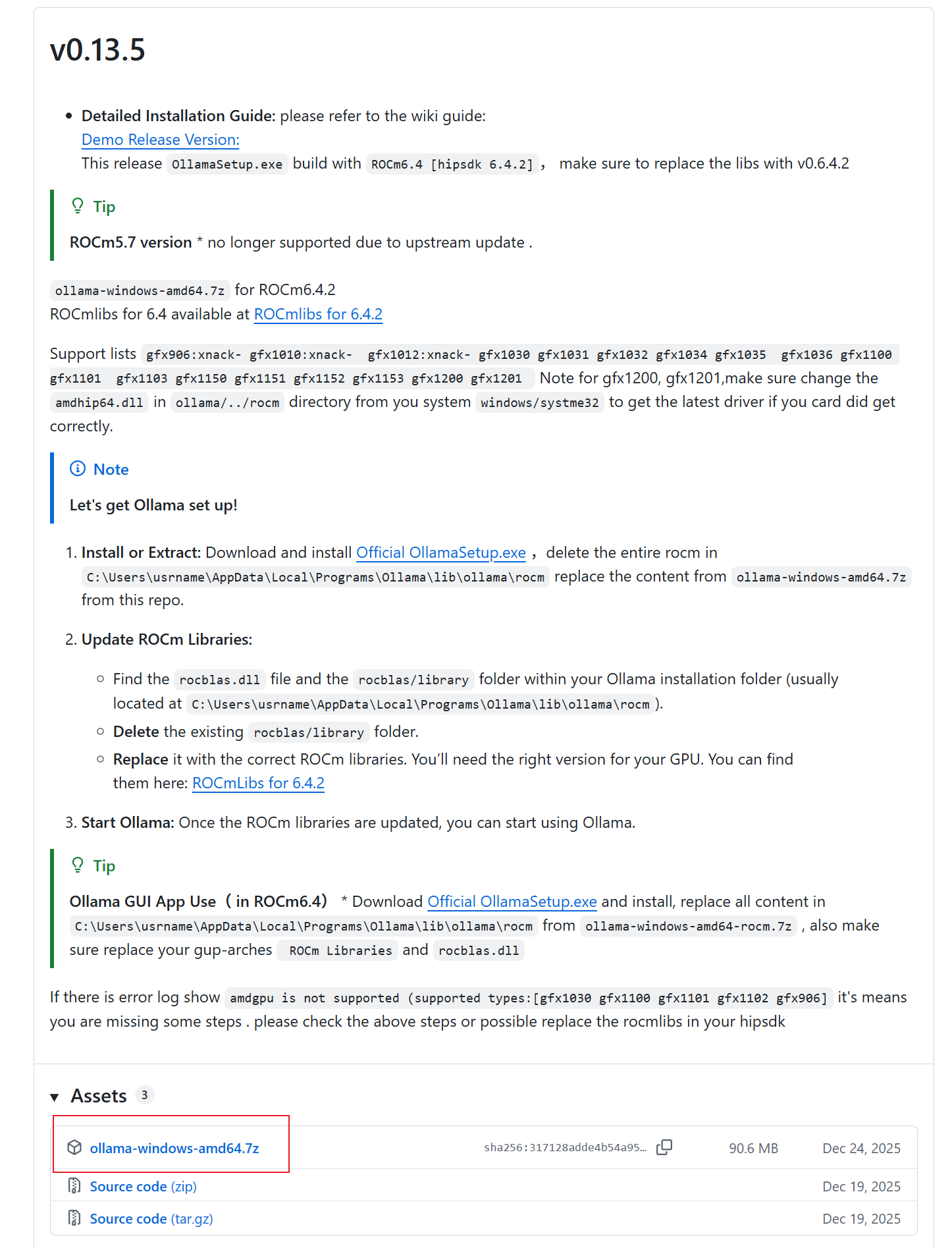

第三步 下载ollama相关配置

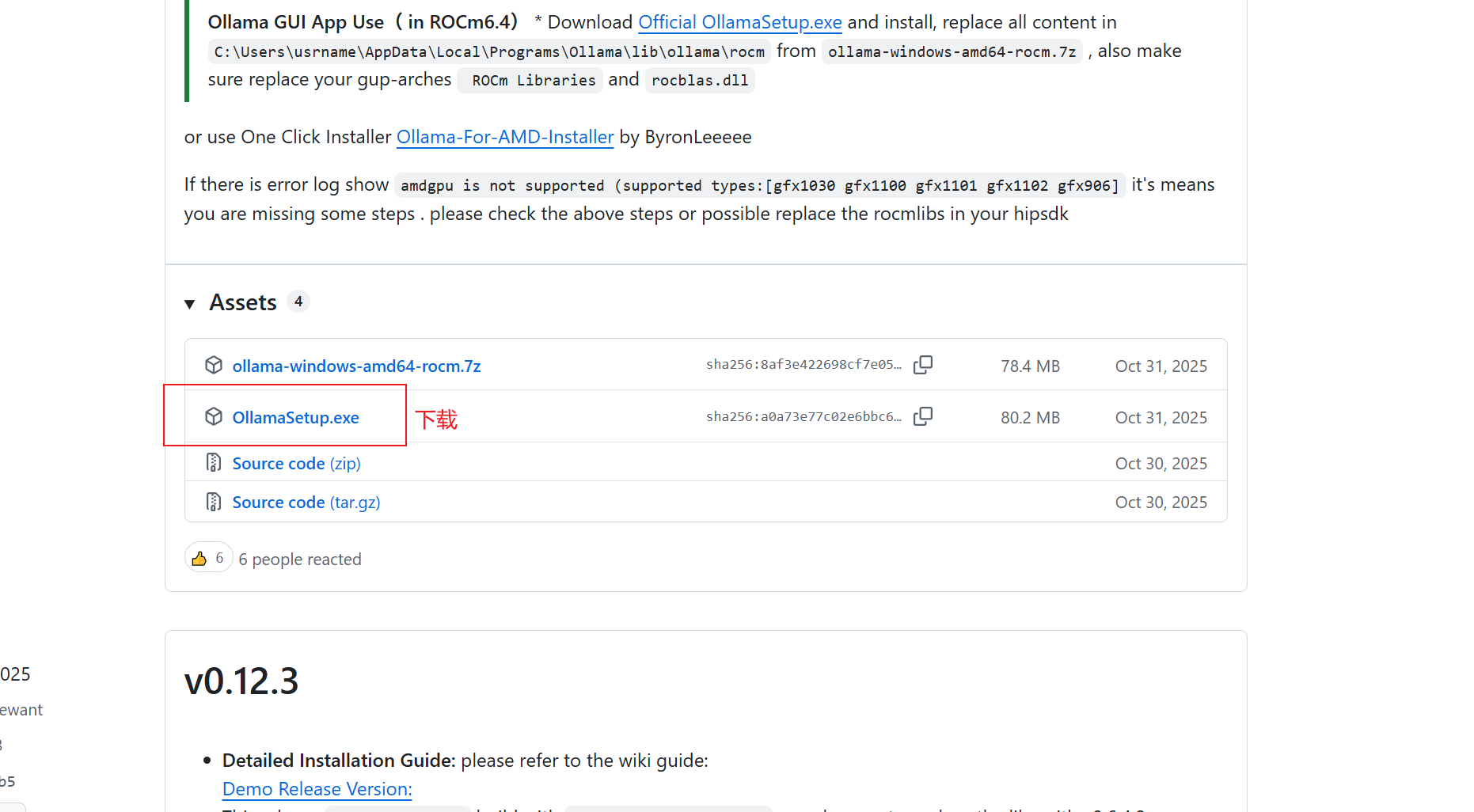

1.我这边下载0.13.5 的压缩包

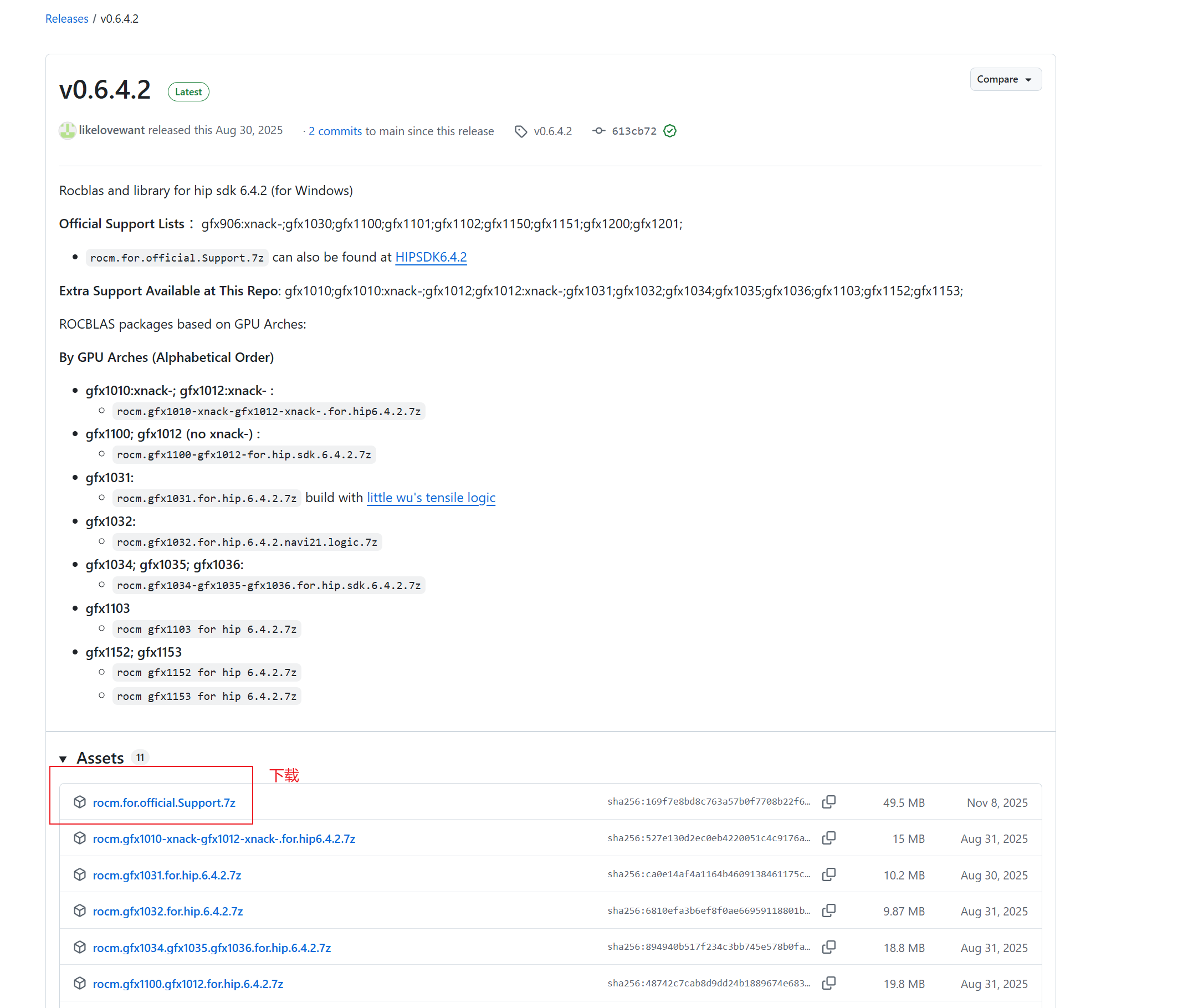

2.下载hip sdk 0.6.4.2

3.然后随便找个版本的ollama.exe 启动器

下载工作准备完成后,放到同一个文件夹

开始安装ollama

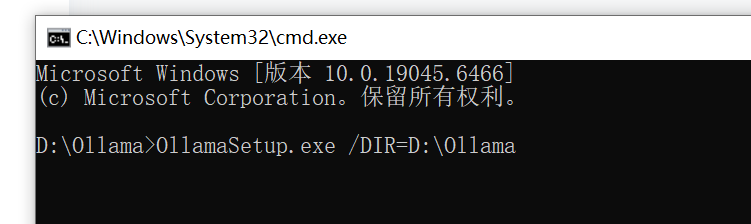

如果直接点击exe文件会直接安装到C盘,这里我想安装到D盘,操作如下

在当前文件夹启动终端cmd,输入OllamaSetup.exe /DIR=D:\Ollama,就可以安装到D盘了

安装完后需要替换文件

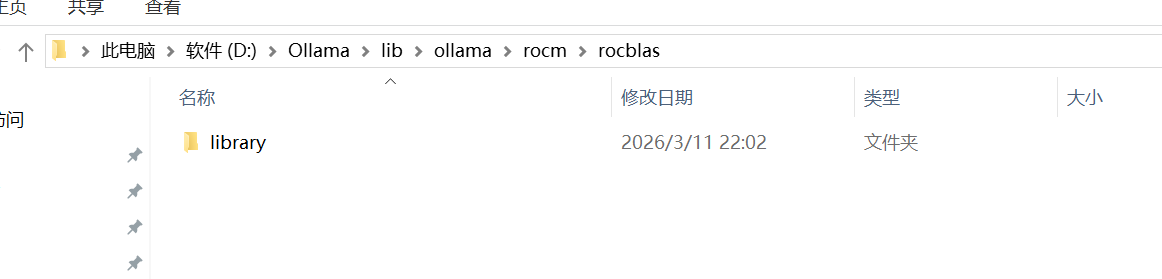

上面我们解压rocm.for.official.Support得到两个东西,一个文件夹一个配置文件

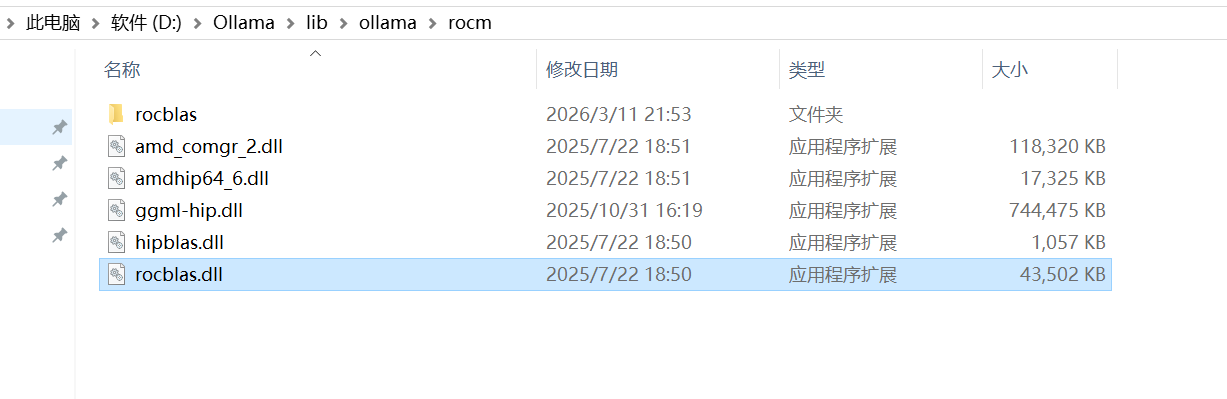

将解压的文件夹替换原来安装ollama时候生成的新lib文件里面的library文件夹,我的路径是D:\Ollama\lib\ollama\rocm\rocblas

将解压的配置文件替换原来安装ollama时候生成的新lib文件里面的library文件夹,我的路径是D:\Ollama\lib\ollama\rocm 里面的rocblas.dll文件

将解压的配置文件替换原来安装ollama时候生成的新lib文件里面的library文件夹,我的路径是D:\Ollama\lib\ollama\rocm 里面的rocblas.dll文件

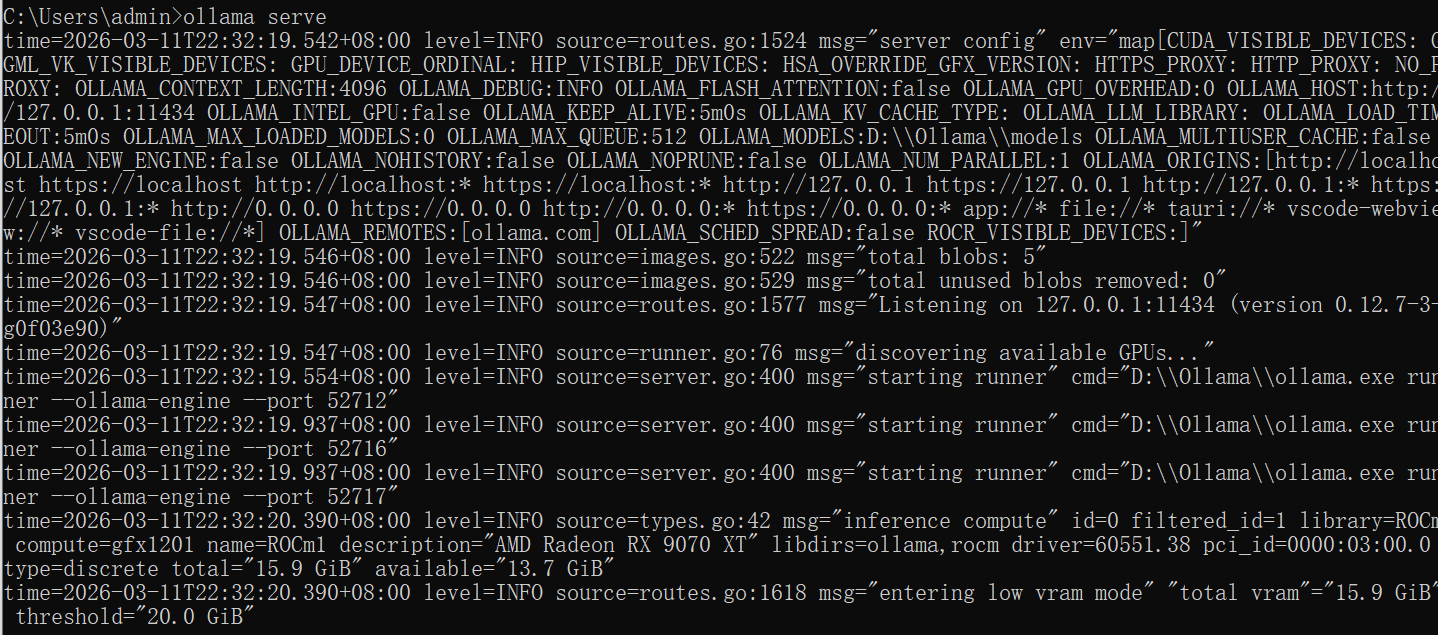

替换重新启动访问,可以识别到显卡,并且使用显卡进行推理了