作为机器人领域的经典难题,接触密集型操作的核心瓶颈始终在于力的精准感知与控制 ------ 尤其是处理易碎、可变形物体时,一丝施力偏差就可能导致操作失败。传统模仿学习方法因无法有效耦合触觉数据与力信号,始终难以解决 "力不可控" 问题,而 TU Darmstadt 团队最新提出的 FARM 框架,为这一问题提供了全新的全链路解决方案。本文将从技术核心、硬件选型、流程闭环、实验验证四个维度,深度解析 FARM 框架的设计思路与技术优势。

GelSight赋能触觉扩散策略,实现动态力适配精准操控

一、技术核心:触觉条件化扩散策略,打造力控闭环

FARM(Force-Aware Robotic Manipulation)的核心设计,在于将高维触觉数据与扩散策略深度结合,构建触觉条件化的力基动作空间。

与传统方法将视触觉反馈作为 "附加观测" 不同,FARM 框架通过 FEATS 网络,从 GelSight Mini 采集的高分辨率触觉图像中,提取物理标定的剪切 + 法向力分布,将触觉数据转化为可量化的力信号;再基于触觉条件化扩散策略,将力信号作为核心输入,实现机器人位姿、夹爪宽度、抓取力的联合预测。

这一设计的关键价值,在于让机器人从 "按指令动" 升级为 "摸着力动",通过触觉感知实时调整施力大小,打造真正的力控闭环,彻底解决了传统模仿学习中施力为 "无控衍生结果" 的痛点。

二、硬件选型:科研复现 / 工业落地的优选组合

FARM 框架的落地,依托于一套经过精心设计的硬件组合,各组件各司其职、高效配合,也是科研人员复现、工业客户扩展的优选配置,核心硬件及功能如下:

1. GelSight Mini 视觉触觉传感器

作为整个系统的 "触觉核心",GelSight Mini 能够捕捉高分辨率的接触变形图像,这是力分布推断的基础。其优势在于可直接集成于夹爪,实现原位触觉感知,搭配 FEATS 网络后,能精准提取剪切力和法向力分布,为扩散策略提供可靠的力信号输入。

- 2. UMI 夹爪(手持版 + 驱动版)

UMI 夹爪是连接人类演示与机器人执行的核心载体:

- 手持版:集成 GelSight Mini+RGB+ArUco,可精准采集人类完成精细操作时的触觉、视觉、轨迹数据,实现高质量的示教数据采集;

- 驱动版:与手持版几何结构 1:1 匹配,无需重定向即可部署训练好的策略,搭配双模控制器,可实现机器人端的实时力闭环控制。

这种 "手持演示 - 驱动执行" 的硬件设计,让人类的精细操作经验能够无缝转移到机器人端,大幅降低了示教与部署的成本。

3. 光学动捕 / 视觉辅助系统

为数据采集和机器人执行提供高精度的轨迹捕捉与手内视觉感知,弥补单一触觉感知的不足,实现多模态数据融合,进一步提升操作的精准度。

三、流程闭环:从人类示教到机器人执行的无衔接设计

FARM 框架打造了一套从数据采集→力信号推断→模型训练→策略部署的完整流程闭环,全程无额外适配成本,适配科研快速验证和工业规模化落地:

- 人类示教采集:操作人员通过集成 GelSight Mini 的 UMI 手持版夹爪,完成易碎物抓取、精密插入等精细操作,同步采集触觉、视觉、轨迹多模态数据;

- 力信号推断:FEATS 网络对 GelSight Mini 采集的触觉图像进行处理,提取物理标定的剪切 + 法向力分布;

- 模型训练:以触觉图像和推断的力信号为输入,训练触觉条件化扩散策略,实现位姿、夹爪宽度、抓取力的联合预测;

- 机器人执行:将训练好的策略部署到 UMI 驱动版夹爪,机器人基于实时触觉感知,自主调整施力大小,完成精准操作。

整套流程的核心优势在于 "无缝转移"------ 从人类演示到机器人执行,无需对数据或模型进行额外的重定向处理,大幅提升了技术的落地效率。

四、实验验证:三大任务验证,各维度性能均显著优于基线模型

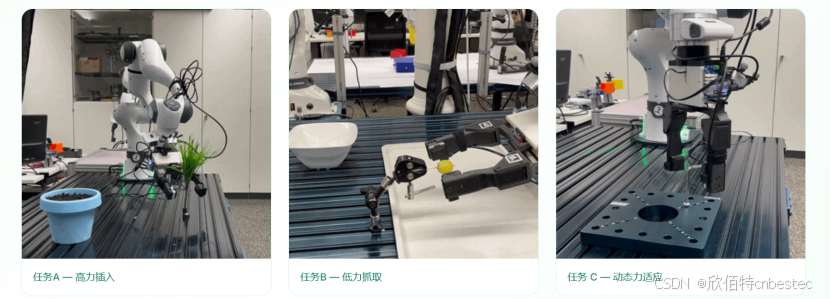

为验证 FARM 框架的性能,研究团队设计了高力插入、低力拾取、动态力适配三类具有典型力控需求的任务,与传统基线模型进行对比:

- 高力插入:要求机器人施加稳定的高力,完成部件的精准插入,考验力的稳定性;

- 低力拾取:要求机器人施加极小的抓握力,抓取鸡蛋等易碎物,考验力的精细度;

- 动态力适配:要求机器人根据接触状态实时调整施力大小,考验力的自适应能力。

实验结果显示,FARM 框架在三类任务中的操作成功率、力控精度、执行效率均大幅领先基线模型,充分验证了其两大核心设计的优势:一是对基于力标定的高维触觉观测信息的有效挖掘,二是基于力的控制空间的构建与应用。

五、开源资源与应用前景

目前,FARM 框架的代码 base 和硬件设计文件已全面开源,科研人员可基于上述核心硬件组合,快速复现实验结果并进行扩展研究;工业层面,该框架可直接应用于易碎物抓取、精密工业装配、医疗柔性操作、食品加工等对施力精度要求极高的场景,为协作机器人、工业机器人的智能化升级提供了全新的技术思路。

未来,随着触觉传感器和力控算法的进一步融合,机器人的 "触觉感知 - 力控执行" 能力将持续提升,有望在更多精细化操作场景中替代人工,推动智能制造的进一步发展。

相关资源

- 核心硬件:GelSight Mini 视觉触觉传感器、UMI 夹爪(手持版 / 驱动版)、光学动捕系统

欢迎关注 "欣佰特科技 " ,持续为大家带来 "具身智能领域 "前沿技术及应用!详情可邮件咨询++++sales@cnbestec.com++++