一、方案概述

本方案针对Windows系统,完成 OpenClaw+ Ollama+ 飞书/QQ的完整安装、配置与联动,适配你的硬件配置(16G内存推荐运行Ollama 7B轻量模型,符合日常使用需求),全程附带操作截图提示、常见问题解决及注意事项,确保新手可顺利完成部署,最终实现"通过飞书/QQ发送指令,由OpenClaw调度Ollama本地模型完成响应"的核心功能。

核心架构逻辑:飞书/QQ(用户交互入口)→ OpenClaw(AI智能体,负责消息路由、技能调度)→ Ollama(本地运行大模型,提供推理能力)→ OpenClaw → 飞书/QQ(返回响应结果),全程本地运行。

二、前置准备

2.1 硬件检查(适配你Windows)

如下的性能以一台浦东电脑为例。如i5 8代 CPU,16G内存等。

-

CPU:i5 8代(满足OpenClaw、Ollama运行需求,7B模型推理无压力,13B模型不推荐,会导致内存占用过高、卡顿);

-

内存:16G(符合Ollama 7B模型最低内存要求,建议关闭其他占用内存的软件,如浏览器、办公软件,避免安装和运行时卡顿);

-

磁盘:预留至少10G空闲空间(Ollama模型约4-6G,OpenClaw及依赖约1-2G,飞书/QQ约1-2G,建议安装在D盘,避免占用C盘系统空间);

-

网络:稳定宽带(用于下载安装包、依赖及Ollama模型,建议全程联网;OpenClaw安装需临时科学上网,否则会出现依赖下载失败);

-

系统:Windows 10(64位)及以上(目前一般默认预装Windows 10/11,若系统版本过低,需先升级,避免兼容性问题)。

2.2 系统环境准备

-

关闭杀毒软件(360、腾讯电脑管家等):部分杀毒软件会误判OpenClaw、Ollama安装包为病毒,导致安装失败,安装完成后再重新开启;

-

确认电脑登录名为全英文:若登录名为中文名(如"张三"),需新建英文用户(控制面板→用户账户→管理账户→新建账户),否则OpenClaw安装会出现路径错误;

-

开启PowerShell管理员权限:右键开始菜单→选择"Windows PowerShell (管理员)",后续OpenClaw安装需使用此权限;

-

上网配置:提前准备上网工具,确保可正常访问Internet。

-

补充说明(针对Chocolatey提示):若安装过程中弹出Chocolatey相关提示,分两种情况处理,均不影响本方案所有软件的安装与联动(本方案无需依赖python、visualstudio2022-workload-vctools这两个升级包): 1. 若提示"'choco' was found... An existing Chocolatey installation was detected":说明电脑已安装Chocolatey,脚本不会重复安装,属于正常现象,无需操作;若需升级Chocolatey本身,可输入命令

choco upgrade chocolatey,无需卸载现有版本。 2. 若提示"Chocolatey upgraded 0/2 packages":说明系统已安装python、visualstudio2022-workload-vctools最新版本,或该包与本方案无关,直接按ENTER退出即可,无需额外处理。 补充:若现有Chocolatey安装异常(无法正常运行),可按提示备份相关文件夹(C:\ProgramData\chocolatey),手动删除该文件夹后重新安装,再继续本方案操作。

2.3 工具下载

所有安装包优先从官方渠道下载,避免第三方捆绑软件,下载后保存至桌面或D盘"安装包"文件夹,方便查找:

|----------|-------------------------------------|-----------------------------------------------------|

| 软件名称 | 官方下载地址 | 备注 |

| OpenClaw | 无需提前下载,通过npm命令安装 | 需先安装Node.js依赖 |

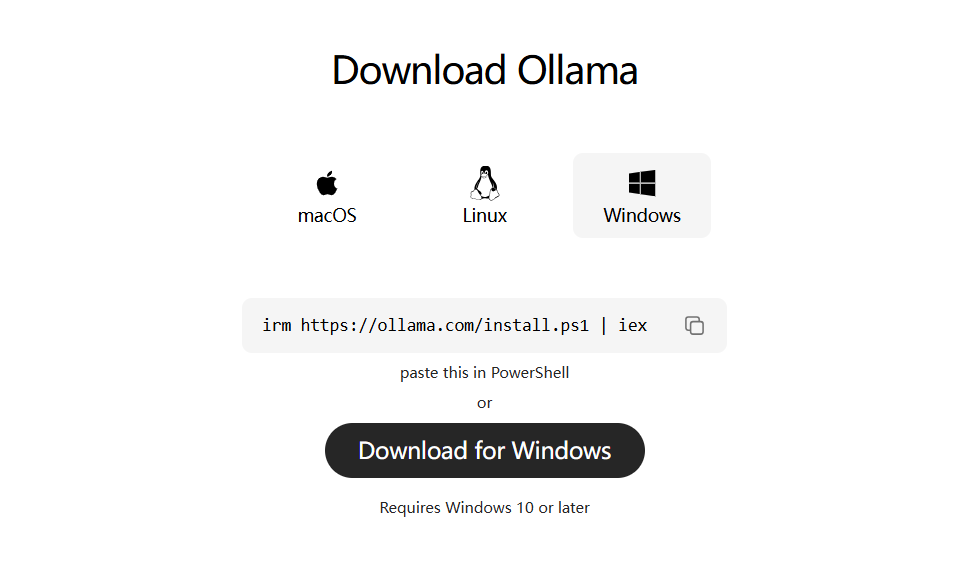

| Ollama | https://ollama.com/download | 下载Windows版本(OllamaSetup.exe) |

| Node.js | https://nodejs.org/en/download | 下载Windows Installer(64位),版本≥22.x(OpenClaw核心依赖) |

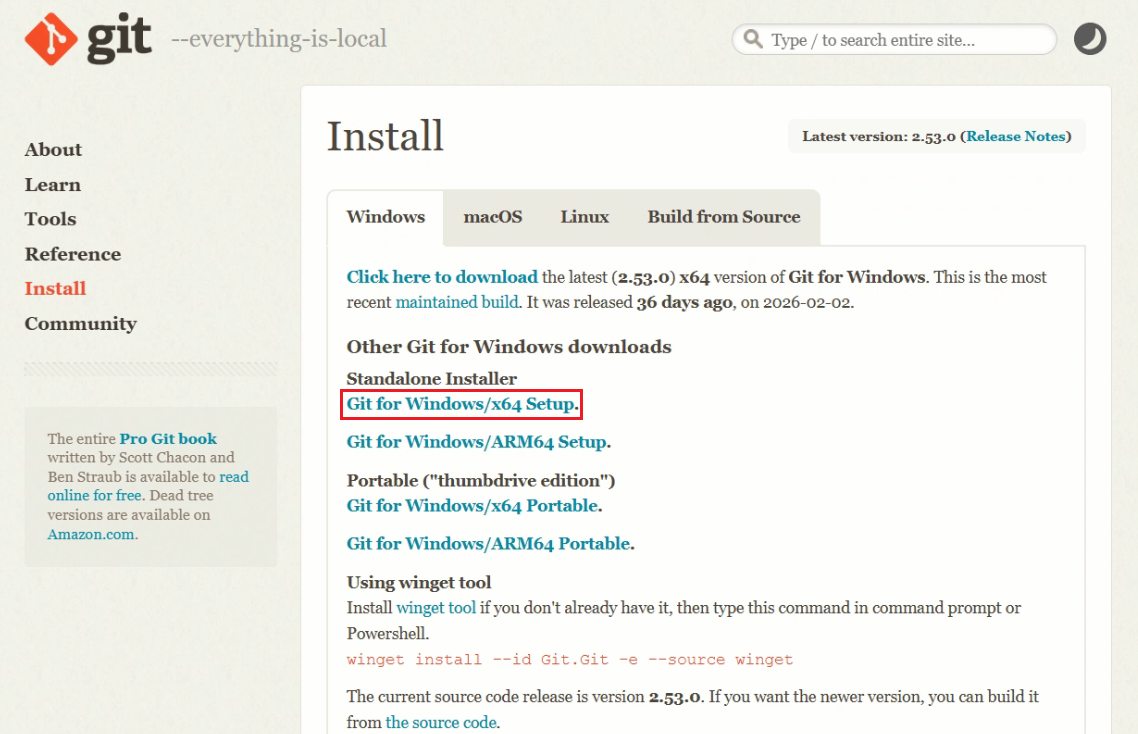

| Git | https://git-scm.com/install/windows | 下载64位版本(Git for Windows/x64 Setup),OpenClaw安装需依赖Git |

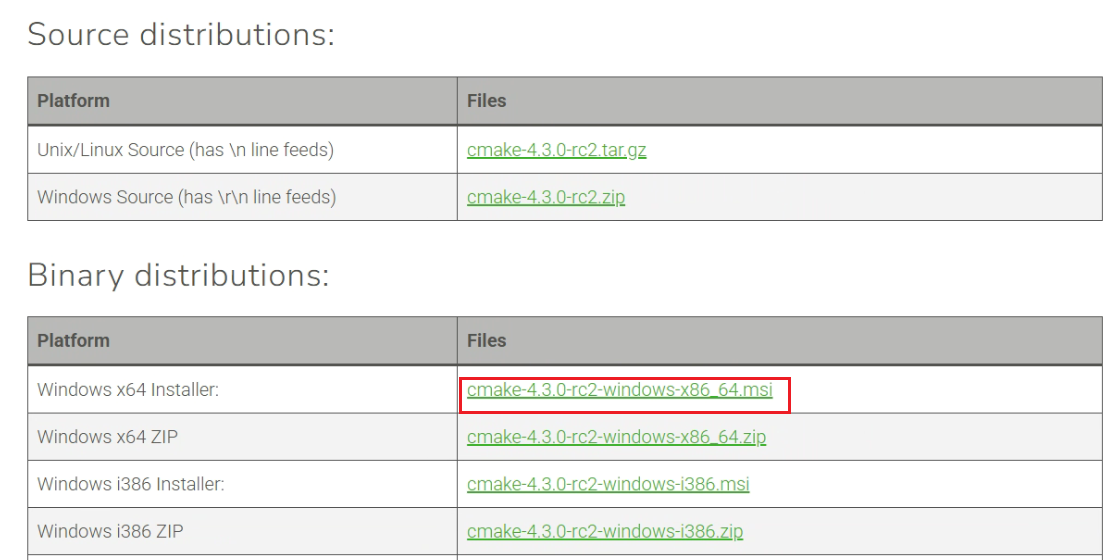

| CMake | https://cmake.org/download/ | 下载Windows 64位安装包,OpenClaw编译需依赖 |

| 飞书 | https://www.feishu.cn/download | 下载Windows版本,用于交互入口 |

| QQ | https://im.qq.com/download/ | 下载Windows版本,备选交互入口(二选一即可) |

如下截图展示下载的文件:

1.Ollama

2.Node.js

3.Git

4.Cmake

三、逐软件安装与配置(按顺序操作)

3.1 第一步:安装依赖包

如下的安装包按照你下载的来,这里只做示例展示。

3.1.1 安装Node.js(版本≥22.x)

-

双击下载的Node.js安装包(如node-v22.0.0-x64.msi),弹出安装向导,点击"Next";

-

勾选"我接受许可协议",点击"Next";

-

选择安装路径(建议D:\Program Files\nodejs,避免C盘),点击"Next";

-

关键步骤:勾选"Automatically install the necessary tools for native modules"(自动安装原生模块所需工具),点击"Next",后续会自动弹出PowerShell窗口安装配套工具,无需操作,等待其自动完成即可;

-

点击"Install",开始安装,等待5-10分钟(视网络速度而定);

-

安装完成后,点击"Finish",关闭安装向导;

-

验证安装:打开新的PowerShell(管理员),输入命令

node -v和npm -v,若分别显示版本号(如v22.0.0、10.5.0),则安装成功。

3.1.2 安装Git

-

双击下载的Git安装包(如Git-2.45.0-64-bit.exe),点击"Next";

-

选择安装路径(建议D:\Program Files\Git),点击"Next";

-

后续步骤全部默认,一路点击"Next",最后点击"Install",等待安装完成;

-

验证安装:打开PowerShell(管理员),输入命令

git --version,显示版本号(如git version 2.45.0.windows.1),则安装成功。

3.1.3 安装CMake

-

双击下载的CMake安装包(如cmake-3.29.0-windows-x86_64.msi),点击"Next";

-

勾选"我接受许可协议",点击"Next";

-

选择安装路径(建议D:\Program Files\CMake),点击"Next";

-

勾选"Add CMake to the system PATH for all users"(将CMake添加到系统环境变量),点击"Next";

-

点击"Install",等待安装完成,点击"Finish";

-

验证安装:打开PowerShell(管理员),输入命令

cmake --version,显示版本号(如cmake version 3.29.0),则安装成功。

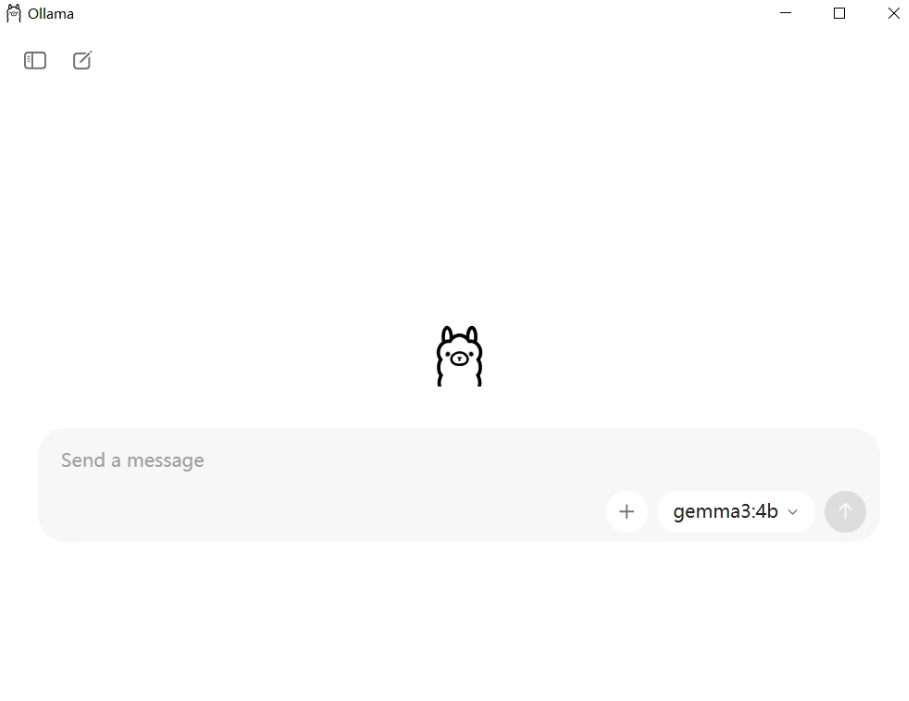

3.2 第二步:安装Ollama

Ollama支持在本地运行Llama 3、Qwen2.5等上百款大模型,结合你的16G内存,推荐安装7B轻量模型,兼顾性能与体验。

-

双击下载的OllamaSetup.exe安装包,弹出安装窗口,点击"Install";

-

关键步骤:安装过程中,务必勾选"Add to PATH"(将Ollama添加到系统环境变量),否则后续无法通过命令行调用;

-

等待安装完成(约1-2分钟),安装成功后,系统托盘会出现Ollama图标(若未出现,手动打开Ollama应用);

-

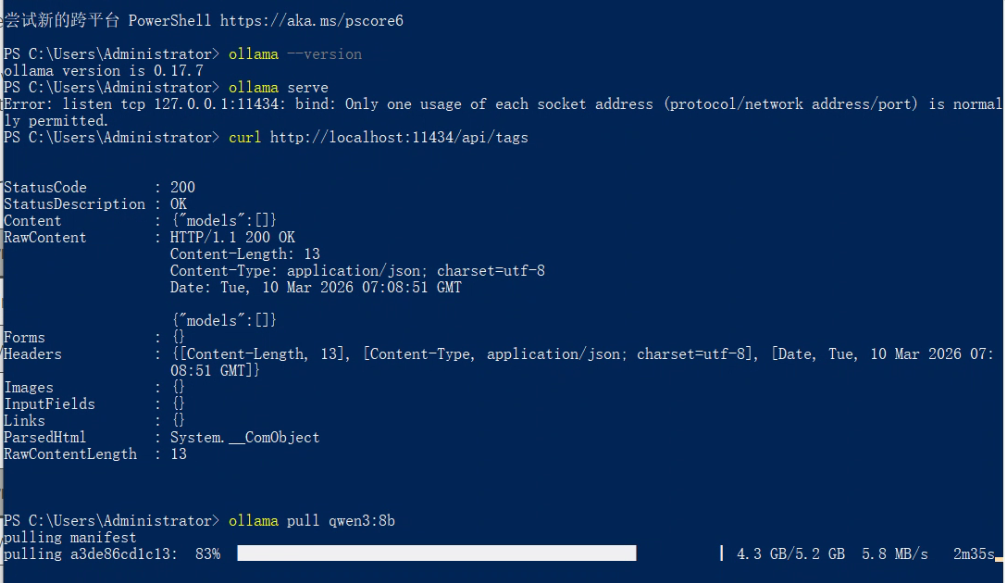

验证安装:打开PowerShell(管理员),输入命令

ollama --version,显示版本号(如ollama version is 0.12.0),则安装成功; -

启动Ollama服务;

-

方法一:在PowerShell中输入命令

ollama serve,保持该终端窗口运行(不要关闭),后续下载模型、联动OpenClaw需依赖该服务; -

方法二:直接打开Ollama应用(系统托盘点击图标),会自动后台启动服务,可通过命令

curl http://localhost:11434/api/tags验证服务是否正常运行(返回模型列表即正常)。 -

配置国内镜像(必做,解决模型下载慢问题):

-

临时配置(仅当前终端有效):在PowerShell中输入

$env:OLLAMA_MODEL_SERVER="https://mirror.ollama.com"; -

永久配置(推荐):右键"此电脑"→"属性"→"高级系统设置"→"环境变量"→在"用户变量"中点击"新建",变量名填写

OLLAMA_MODEL_SERVER,变量值填写https://mirror.ollama.com,点击"确定"保存,重启PowerShell生效。 -

下载大模型(推荐Qwen2.5:7B),按需选择你的模型:

-

确保Ollama服务已启动(终端运行

ollama serve或Ollama应用已打开); -

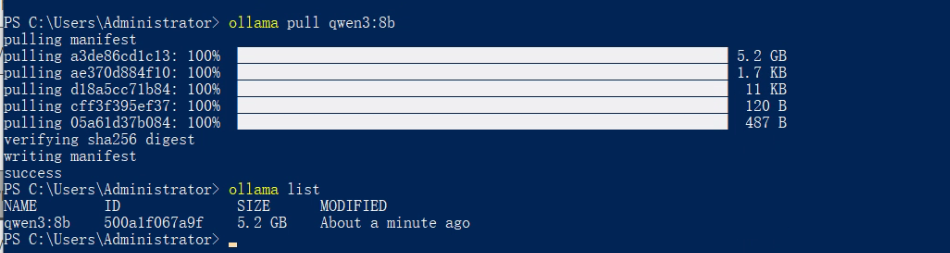

新开一个PowerShell窗口,输入命令

ollama pull qwen2.5:7b,开始下载模型(约4-6G,视网络速度而定,下载过程中不要关闭终端); -

下载完成后,输入命令

ollama list,若显示"qwen2.5:7b",则模型下载成功;

-

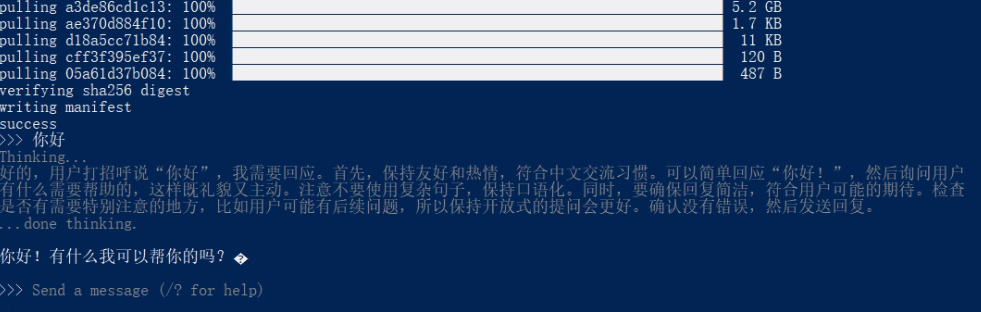

测试模型:输入命令

ollama run qwen2.5:7b,输入任意问题(如"你好"),模型能正常回复,说明Ollama运行正常。

-

安全配置(可选,提升安全性):

-

设置API密钥:输入命令

$env:OLLAMA_API_KEY="你的密码"(替换为自定义强密码),防止未授权访问; -

限制本地访问:输入命令

$env:OLLAMA_HOST="127.0.0.1:11434",仅允许本地访问,避免暴露到公网。

3.3 第三步:安装OpenClaw

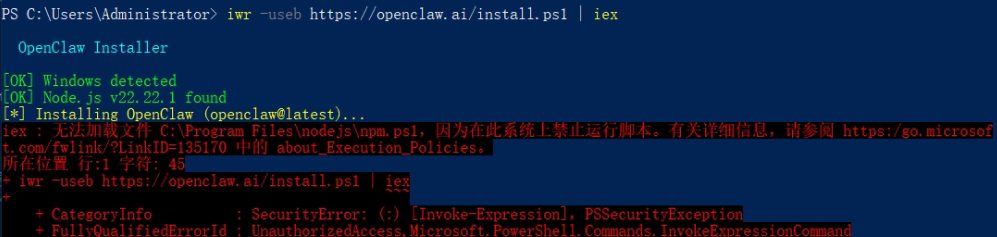

OpenClaw(原Clawdbot)是连接聊天平台(飞书/QQ)与大模型(Ollama)的核心网关,负责消息路由、技能调度,需通过npm命令安装,全程使用管理员权限PowerShell操作。

1.打开管理员权限PowerShell,尝试通过如下目录安装。

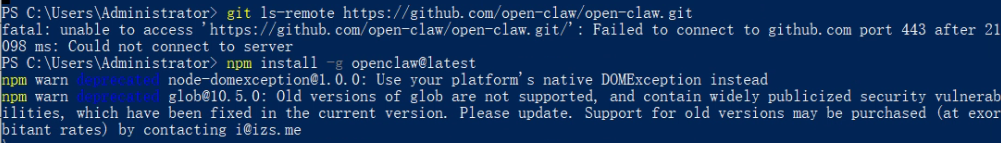

iwr -useb https://openclaw.ai/install.ps1 | iex 但是安装过程中出现如下的报错。

这里可以尝试在powershell中输入如下命令解决------"修改执行策略"。

Set-ExecutionPolicy -ExecutionPolicy RemoteSigned -Scope CurrentUser如果还是报错,可以通过如下目录手动安装(也可以输入命令npm install -g openclaw@latest --verbose --prefer-offline,开始安装(约5-10分钟,终端会滚动显示安装日志,耐心等待);):

npm install -g openclaw@latest

2.安装完成验证

PS C:\Users\Administrator> openclaw --version

OpenClaw 2026.3.8 (3caab92)后续的步骤:

-

输入命令

openclaw onboard --install-daemon,启动配置向导并安装后台守护进程(实现开机自启); -

步骤1:风险提示,用方向键←选择"YES",回车确认(知晓安全风险);

-

步骤2:配置模式,直接回车选择"QuickStart"(快速配置模式,适合新手);

-

步骤3:选择大模型提供商,用方向键选择"Ollama"(本地模型,无需API Key),回车;

-

步骤4:设置Ollama模型,选择已下载的"qwen2.5:7b",回车(若未显示,确认Ollama服务已启动、模型已下载成功);

-

步骤5:工作目录设置,默认路径为"~/clawd"(用于存储配置、记忆文件),直接回车保留默认;

-

步骤6:安装交互渠道插件(选择飞书/QQ,二选一即可):

-

若选择飞书:回车选择"安装飞书插件",后续配置飞书参数;

-

若选择QQ:回车选择"安装QQ插件",后续配置QQ参数;

-

插件安装完成后,回车选择默认下载方式,继续配置。

-

步骤7:跳过额外KEY设置,后续6个KEY配置均直接回车跳过;

-

步骤8:Hooks配置,按空格键选择默认选项,回车确认;

-

配置完成后,系统会自动启动OpenClaw守护进程,终端显示"配置成功",则OpenClaw与Ollama联动完成。

-

验证OpenClaw与Ollama联动:输入命令

openclaw test llm,若显示"Ollama模型连接成功",且能正常返回模型响应,说明联动正常。

3.4 第四步:安装飞书

3.4.1 飞书安装与配置(推荐,联动OpenClaw更稳定)

-

双击下载的飞书安装包(如Feishu-Win-x64.exe),点击"自定义安装";

-

选择安装路径(建议D:\Program Files\Feishu),取消勾选"开机自动启动"(节省内存),点击"立即安装";

-

安装完成后,打开飞书,用手机飞书扫码登录(或账号密码登录);

-

飞书机器人配置(联动OpenClaw,核心步骤):

-

点击"创建应用"→选择"企业自建应用",填写应用名称(如OpenClaw-AI)、描述(AI代理,联动所选模型供应商),点击"创建";

-

进入应用详情页,点击左侧"凭证与基础信息",记录"App ID"和"App Secret"(后续配置需使用);

-

权限配置(必做,否则无法收发消息):点击左侧"权限管理"→"添加权限",添加以下必选权限(权限范围选择"全部员工"):

-

contact:user.base:readonly(获取员工基础信息);

-

im:message(收发消息基础权限);

-

im:message.p2p_msg:readonly(读取机器人私信消息);

-

im:message.group_at_msg:readonly(接收群内@机器人消息);

-

im:message:send_as_bot(以机器人身份发送消息);

-

im:resource(上传/下载媒体资源)。

-

-

事件回调配置:点击左侧"事件与回调"→"回调配置",订阅方式选择"使用长连接接收回调",勾选确认并保存(无需公网域名,OpenClaw插件会通过长连接通信);

-

OpenClaw配置飞书参数:打开管理员PowerShell,输入命令

openclaw config set feishu.appId 你的App ID和openclaw config set feishu.appSecret 你的App Secret(替换为步骤184记录的凭证); -

重启OpenClaw服务:输入命令

openclaw restart,使飞书配置生效; -

测试联动:在飞书内搜索创建的机器人(OpenClaw-AI),发送消息(如"你好,用所选模型回答我"),机器人能正常返回所选模型供应商的响应,说明飞书与OpenClaw、模型供应商联动成功。

四、架构联动测试

4.1 整体联动测试步骤

-

确认所有服务已启动:

-

若选择本地模型(Qwen):Ollama服务需启动(系统托盘有Ollama图标,或PowerShell运行

ollama serve); -

OpenClaw服务:输入命令

openclaw status,显示"running"; -

飞书/QQ:已登录,机器人配置完成;

-

若选择公网模型(MiniMax等):确保网络正常,无需额外启动模型服务。

-

-

测试指令:在飞书/QQ中给机器人发送指令,如"帮我写一段50字的工作问候语""解释一下什么是AI模型";

-

验证结果:机器人应在10-30秒内返回响应(视模型推理速度而定),响应内容由所选模型供应商生成(公网模型需联网,本地模型无需联网);

-

异常处理:若未收到响应,参考"第五部分 常见故障排查"逐步排查。

4.2 核心功能测试

-

多轮对话:连续发送指令(如"上一段问候语修改得更正式"),机器人应能记住上下文,生成连贯响应;

-

模型供应商切换:输入命令

openclaw config set llm.provider 新供应商名称(如openclaw config set llm.provider MiniMax),补充对应API Key(公网模型),重启服务后,测试切换是否正常; -

技能调用:输入指令"帮我列出D盘下的文件",OpenClaw会调用本地技能,结合所选模型生成结果(需提前安装文件操作技能)。