一、AI是什么

AI(人工智能)的本质是让机器模拟人类智能 。它最根本解决的是**"不确定性"和"效率"**问题。

1、AI 最本质是什么?

抛开复杂的算法,AI 的底层逻辑其实非常纯粹:

-

数学本质 :通过统计和概率,从海量数据中找出规律和模式 。它不是在"创造",而是在计算"最可能的答案"。

-

能力本质 :感知 → 推理 → 决策。它试图复现人类"看、想、做"的闭环,但目前的 AI 极度擅长"感知",而在"推理"和"决策"上仍依赖人类把关。

2、它到底解决什么问题?

AI 不解决"存在主义"问题,它主要攻克的是人类认知和体力的边界:

-

信息过载:人类无法读完互联网,但 AI 可以瞬间消化并提炼关键点。

-

重复与规模:7x24 小时处理千篇一律的流程(如审核、客服),且边际成本极低。

-

复杂预测:在医疗、金融等领域,通过多维数据发现人眼看不到的关联。

3、是生产力还是工具,关键在于谁在主导。

生产力 vs. 生产工具:身份取决于使用者,这是一个视角问题,AI 既是工具,也是新的生产力要素。

| 维度 | 作为生产工具 (How) | 作为生产力 (What) |

|---|---|---|

| 角色 | 放大器 | 新劳动力 |

| 类比 | 程序员用 IDE 写代码 | AI 直接生成可运行的代码 |

| 特征 | 需要人类驱动(你下指令) | 具备一定自主性(Agent) |

| 经济属性 | 资本品(Capital Goods) | 数字劳动力(Digital Labor) |

核心区别:

-

如果你把 AI 当作 Photoshop 或 Excel 来用,它是工具。

-

如果 AI 能独立完成你原本需要雇人才能做的事(如写周报、做设计初稿),它就是生产力。

4、当下的现实定位

在 2026 年的技术阶段,AI 的定位非常清晰:

-

它是高级副驾,不是司机:拥有极强的辅助能力,但无法完全替代人类对结果的责任。

-

它是脑力杠杆:将人类从低效的"搜索-整理-复述"循环中解放出来,让我们专注于真正的创造和判断。

一句话总结 :AI 的本质是基于数据的概率机器 ,它解决的是效率瓶颈,当你命令它时它是工具,当它自主产出价值时它就是生产力。

二、AI大模型是什么

AI大模型是通过深度学习算法和人工神经网络训练出的具有庞大规模参数的人工智能模型。'

这些模型使用大量的多媒体数据资源作为输入,并通过复杂的数学运算和优化算法来完成大规模的训练,以学习和理解到输入数据的模式和特征。这些模式和特征最终通过大模型中庞大的参数进行表征,以获得与输入数据和模型设计相匹配的能力,最终来实现更复杂、更广泛的任务,如语音识别、自然语言处理、计算机视觉等。

大模型的训练过程是根据大量的输入数据,通过算法调整模型中庞大的参数来优化模型性能。在训练过程中,模型会根据输入数据进行反向传播和优化,以最小化损失函数并更新参数,在训练收敛时,参数会趋于稳定,这意味着模型已经学习到了最佳的参数设置,模型也就具备了相应的能力。这意味着模型在给定的输入下,将会产生一致的输出。这种确定性是基于训练数据的特征和模型结构所决定的,即决定模型训练能力的因素主要有输入的数据和模型算法参数的设计。 因此,模型的性能和功能不仅取决于模型参数的确定,还取决于训练数据的质量、模型架构的选择等。为了获得更好的性能和功能,需要综合考虑这些因素,并进行合适的调整和优化。

根据以上定义和理解不难推断出AI大模型的特点:

**大量的参数:**大模型通常具有庞大的参数规模,拥有数以亿计的参数,这些参数可以存储模型的知识和经验,更多的参数意味着模型具有更强大的学习能力和表示能力,能够更好地捕捉数据中的复杂模式和特征,以便进行推理和预测。AI大模型的目标是通过增加模型的参数数量来提高模型的表现能力。相比之下,传统的浅层神经网络或机器学习模型可能无法捕捉到更复杂的关系和模式。

上下文理解和生成:大模型能够理解和生成更具上下文和语义的内容,通过注意力机制、上下文编码器等关键技术来学习和训练大量的语言、图像等输入数据,可以从复杂的真实场景中提取有用的信息。

强大的泛化能力:大模型通过在大规模数据上进行训练,具有强大的泛化能力。它们从大量的数据中学习到广泛的特征和模式,并且能够在未学习过、未见过的数据上也同样表现良好。对未学知识的泛化能力也是评估大模型的重要指标。

迁移学习能力:大模型在一个或多个领域上进行预训练,并能够将学到的知识迁移到新任务或新领域中。这种迁移学习能力使得模型在新任务上的学习速度更快,同时也提高了模型在未知领域中的性能。

预训练与微调:大模型可以采用预训练和微调两阶段策略。在预训练阶段,模型通过大规模无标签数据进行学习,学习到一种通用表示。在微调阶段,模型使用有标签数据对模型进行细化训练,以适应具体的任务和领域。这种在大规模数据上进行预训练,再在具体任务上进行微调,能够让大模型适应不同的应用场景。

多领域应用:大模型应用领域广泛,可应用于多个领域,并解决多种任务,如自然语言处理、计算机视觉、语音识别等。大模型不仅在单一模态领域中有很强的表现,更能够进行跨模态的任务处理。

三、AI发展历程:

符号主义时代(1950s-1980s):主要是靠规则来运行的专家系统,所有规则都需要人手动写好。

机器学习时代(1990s-2000s):可以从数据里自己学习规律,不再那么依赖人工写规则。

深度学习时代(2010s-2020s):用大规模神经网络,在语音、图像、自然语言处理等领域广泛应用。

大模型时代(2020s 至今):超大规模预训练模型、生成式模型大量出现,朝着通用智能的方向发展。

从"手写规则"到"数据驱动",再到如今的"涌现能力",本质上是一场从确定性逻辑 向概率性感知的彻底转向。

AI 进化史:从"逻辑符号"到"通用智能"

| 时代 | 核心逻辑 | 代表作 | 关键突破 | 致命短板 |

|---|---|---|---|---|

| 符号主义 (1950s-80s) | 人脑写规则 (If-Then) | DENDRAL(化学分析) MYCIN(医疗诊断) | 逻辑透明、结果可解释 | 脆弱 规则无法覆盖现实复杂度 |

| 机器学习 (1990s-00s) | 数据找规律 (统计学习) | SVM、随机森林 推荐系统(亚马逊) | 摆脱了人工规则编写 | 依赖特征工程 仍需人类告诉它"看什么" |

| 深度学习 (2010s-20s) | 端到端学习 (神经网络) | AlexNet、AlphaGo | 自动提取特征 处理非结构化数据(图/文) | "黑盒"不可控 且极度依赖算力和数据量 |

| 大模型时代 (2020s-) | 预训练+生成 (Scaling Law) | GPT、Claude、Llama | 涌现能力 (Emergence) "理解"上下文、多模态 | 幻觉问题 对齐难题、能耗巨大 |

除了时间线,理解三个底层逻辑的转变,看透 AI 发展的本质:

1、从"确定性"到"概率性"

- 过去 :专家系统是

if 发烧 then 感染,非 0 即 1。 - 现在:大模型是"概率的暴政",它输出的是基于海量数据计算出的"最像人话的下一个词"

2、从"工具"到"伙伴"

- 过去 :AI 是专用工具(如人脸识别门禁),用完即走。

- 现在 :大模型是交互式伙伴,它通过对话理解意图,具备泛化能力,不再局限于单一任务。

3、从"理解"到"生成"

-

过去 :AI 主要做判别式任务(这张图是不是猫?)。

-

现在 :核心是生成式(给我画一只正在写代码的猫),这是生产力质变的开始。

未来趋势:下一站是什么?

基于当前的轨迹,接下来的 5-10 年,我们大概率会看到:

-

Agent(智能体)化:AI 从"回答问题的聊天框"进化为"能主动执行复杂任务的操作系统"。

-

多模态融合:文字、图像、声音、视频的边界彻底打破,AI 将建立统一的"世界模型"。

-

价值对齐(Alignment):技术重点将从"提升能力"转向"控制风险",解决"幻觉"和伦理问题。

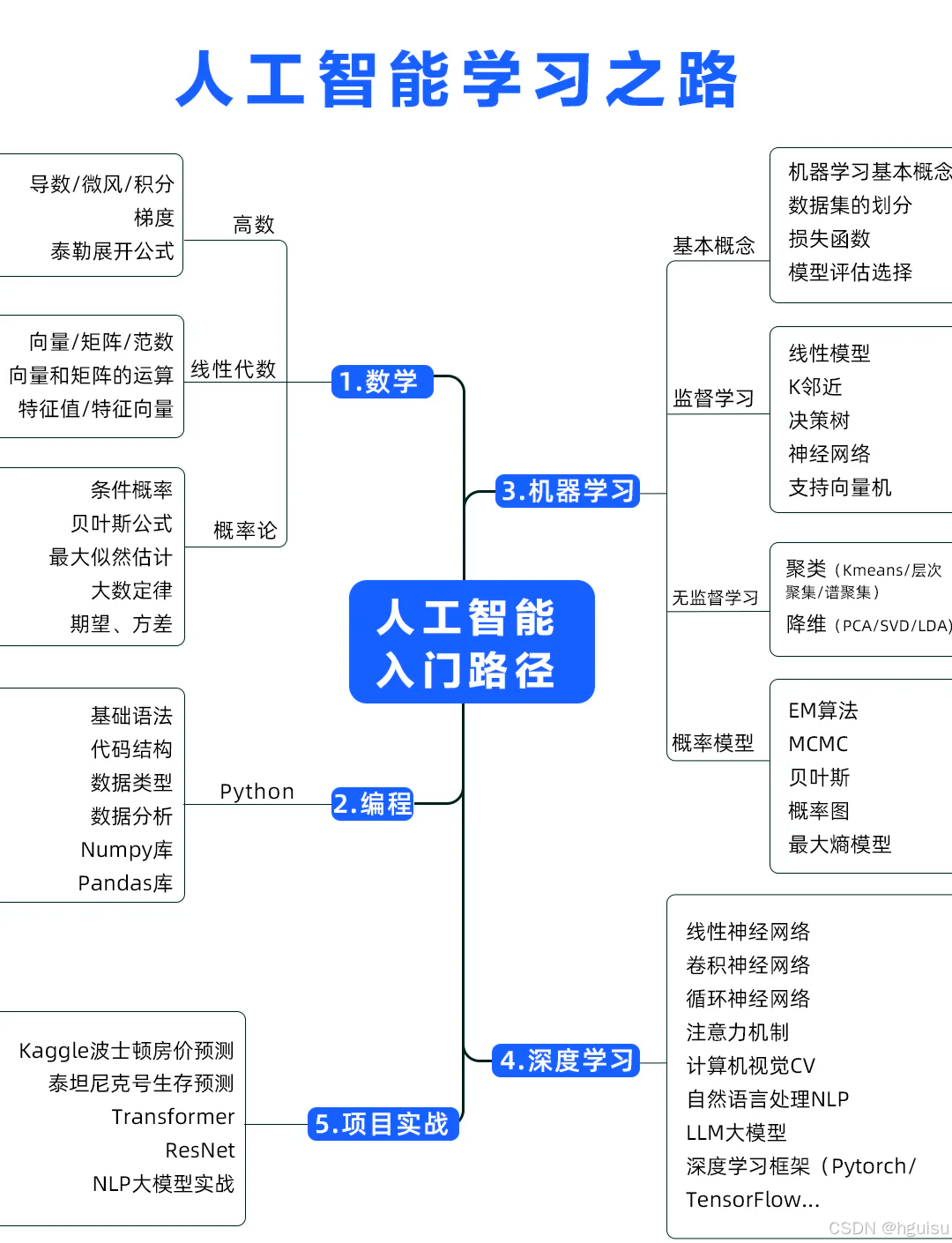

四、人工智能AI知识框架

如果要真正的学习AI:

如果要真正的学习AI: