风控之道:从战场到架构

风控是一个充满博弈的领域。每一次攻防对抗,都是智力与技术的较量。

作为在风控一线摸爬滚打多年的从业者,我见过太多系统从简陋到复杂,从脆弱到健壮的演进过程。也见过太多"过度设计"和"设计不足"的教训。

这个系列,我想做一些不一样的事情:基于风控架构实战场景,提炼设计思想,结合行业最佳实践与AI时代的前沿思考,系统性地阐述现代风控系统的架构设计。

这不是教科书,而是实战经验的总结与反思。

一、风控的本质

1.1 风控是什么?

很多新手会认为:风控就是拦截坏人。

这个理解不够准确。更精确的定义是:

风控是在业务价值与风险损失之间寻找最优解的持续博弈过程。

这里有几个关键词:

业务价值:风控不是独立存在的,它服务于业务。过度风控会伤害用户体验,影响业务增长;风控不足则会导致资损,威胁平台生存。

风险损失:包括直接损失(欺诈导致的资金损失)和间接损失(品牌声誉、用户流失、监管处罚)。

最优解:不存在完美的风控,只有"当前条件下最优"的决策。这是一个动态优化的过程,而非静态目标。

持续博弈:风控是矛与盾的对抗。你升级防御,黑产就升级攻击;你修补漏洞,黑产就寻找新的漏洞。这是一场没有终点的战争。

1.2 风控的核心公式

用数学语言表达风控的目标函数:

makefile

maximize: 业务价值 - 风险损失 - 风控成本

subject to: - 用户体验约束 - 监管合规约束 - 技术资源约束 - 时间响应约束这个公式揭示了风控设计的核心矛盾:

| 矛盾对 | 业务诉求 | 风控诉求 | 平衡点 |

|---|---|---|---|

| 体验 vs 安全 | 极简流程、无感知 | 充分验证、多重核身 | 分层处置、动态挑战 |

| 效率 vs 准确 | 毫秒级响应 | 复杂计算、多源查询 | 预计算、缓存、异步 |

| 覆盖 vs 精准 | 不误杀好人 | 不漏过坏人 | 置信度分层、人工兜底 |

| 成本 vs 效果 | 最小化投入 | 全覆盖防御 | ROI导向、重点投入 |

1.3 风控的三个层次

从系统视角看,风控分为三个层次:

go

┌─────────────────────────────────────────┐│ 感知层(Perception) ││ 设备指纹 | 生物探针 | 行为采集 | 情报 │├─────────────────────────────────────────┤│ 决策层(Decision) ││ 规则引擎 | 模型推理 | 策略编排 | 图谱 │├─────────────────────────────────────────┤│ 处置层(Action) ││ 验证挑战 | 限制拦截 | 人工审核 | 教育 │└─────────────────────────────────────────┘感知层:解决"看见什么"的问题。采集各类风险信号,转化为可计算的数据。

决策层:解决"怎么判断"的问题。基于感知数据,通过规则、模型、图谱等手段,输出风险决策。

处置层:解决"做什么"的问题。根据决策结果,执行相应的处置动作。

二、风控战场全景

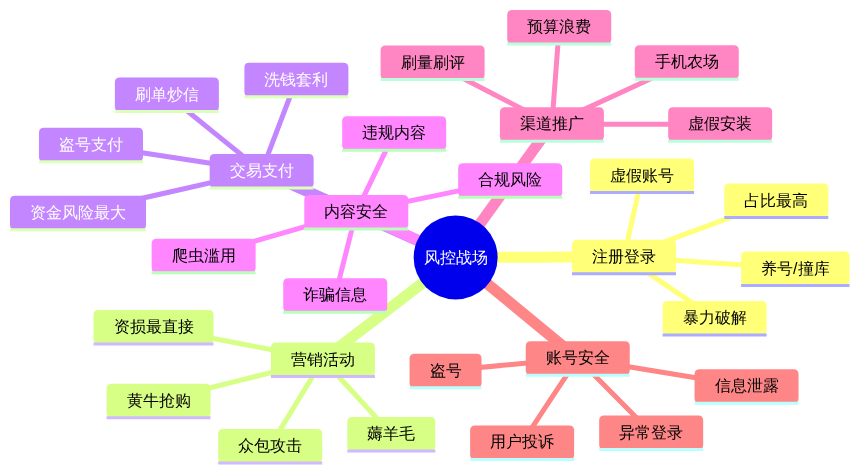

2.1 六大战场

风控的战场遍布业务的每一个环节:

2.2 黑产产业链

理解风控,必须理解对手。黑产已经形成了完整的产业链:

go

┌─────────────────────────────────────────────────────────┐│ 黑产产业链 │├─────────────────────────────────────────────────────────┤│ ││ 【上游:资源提供】 ││ ┌─────────┐ ┌─────────┐ ┌─────────┐ ┌─────────┐ ││ │ 手机卡商│ │ 银行卡商│ │ 身份信息│ │ 代理IP │ ││ └────┬────┘ └────┬────┘ └────┬────┘ └────┬────┘ ││ │ │ │ │ ││ └────────────┴────────────┴────────────┘ ││ ↓ ││ 【中游:工具平台】 ││ ┌─────────┐ ┌─────────┐ ┌─────────┐ ┌─────────┐ ││ │ 接码平台│ │ 打码平台│ │ 群控工具│ │ 改机工具│ ││ └────┬────┘ └────┬────┘ └────┬────┘ └────┬────┘ ││ │ │ │ │ ││ └────────────┴────────────┴────────────┘ ││ ↓ ││ 【下游:执行攻击】 ││ ┌─────────┐ ┌─────────┐ ┌─────────┐ ││ │ 羊毛党 │ │ 账号商 │ │ 洗钱团伙│ ││ └────┬────┘ └────┬────┘ └────┬────┘ ││ │ │ │ ││ └────────────┴────────────┘ ││ ↓ ││ 【目标:业务平台】 ││ │└─────────────────────────────────────────────────────────┘关键洞察 :黑产的分工极为细致,已经形成了有组织、有规模、有分工的职业团体。这意味着风控也必须具备系统化的对抗能力。

2.3 攻防博弈的本质

黑产有两个核心特点:

特点一:利益驱动

黑产的一切行为都围绕利益展开。这给我们一个重要的检测思路:追踪利益链条。

go

谁受益?→ 怎么受益?→ 受益多少?→ 是否异常?特点二:对抗进化

黑产会不断研究绕过风控的方法。这要求风控系统必须具备持续迭代的能力。

go

黑产攻击 → 风控识别 → 黑产绕过 → 风控升级 → 黑产再绕过...核心认知:风控没有"银弹",只有持续进化。关键不是"完美防御",而是:

-

检测速度 > 攻击速度

-

防御成本 < 攻击成本

-

演进能力 > 绕过能力

三、架构演进史

3.1 第一代:单点规则

时代背景:业务初期,风险简单,资源有限。

架构特点:

-

规则硬编码在业务代码中

-

单机部署,无分布式

-

人工配置,无自动化

典型实现:

kotlin

// 伪代码,示意if (user.orderCount > 10 && user.registerDays < 7) { return "REJECT";}优点:简单直接,开发成本低。

缺点:

-

规则变更需要发版

-

无法应对复杂场景

-

缺乏可观测性

-

无法横向扩展

3.2 第二代:规则引擎

时代背景:业务增长,风险场景增多,需要灵活配置。

架构特点:

-

引入规则引擎(如Drools)

-

规则配置化,支持热更新

-

专门的风控服务,与业务解耦

架构示意:

go

┌─────────────┐ ┌─────────────┐ ┌─────────────┐│ 业务系统 │────→│ 风控服务 │────→│ 规则引擎 │└─────────────┘ └─────────────┘ └─────────────┘ │ │ ↓ ↓ ┌─────────────┐ ┌─────────────┐ │ 名单库 │ │ 规则配置 │ └─────────────┘ └─────────────┘优点:

-

规则可配置、可热更新

-

风控与业务解耦

-

支持复杂规则逻辑

缺点:

-

单点瓶颈

-

实时性受限于规则复杂度

-

缺乏模型能力

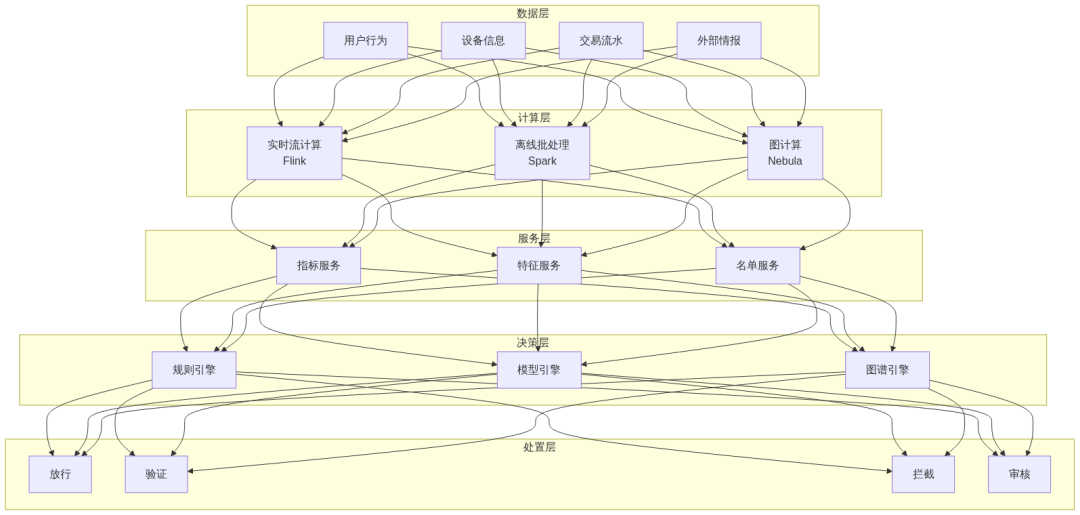

3.3 第三代:智能风控

时代背景:黑产对抗升级,需要更强的识别能力和更快的响应速度。

架构特点:

-

规则 + 模型双引擎

-

实时流计算

-

多维度数据融合

-

知识图谱关联分析

架构示意:

优点:

-

多维度感知

-

实时决策

-

模型加持,识别更精准

-

知识图谱,发现团伙

缺点:

-

架构复杂,运维成本高

-

模型迭代需要数据积累

-

对工程能力要求高

3.4 第四代:AI原生风控

时代背景:大模型时代,AI能力突破,风控进入智能化阶段。

架构特点:

-

智能策略Agent

-

大模型 + 规则引擎融合

-

端边云协同

-

自适应对抗学习

核心创新:

go

传统:人写规则 → 规则引擎执行 → 人工优化AI原生:Agent生成策略 → 规则+模型执行 → 自动迭代优化这将是本系列最后一章重点探讨的内容。

四、现代风控架构设计哲学

4.1 分层防御原则

核心理念:不要试图在单一层面解决所有问题。

go

┌─────────────────────────────────────────────────────────┐│ 分层防御模型 │├─────────────────────────────────────────────────────────┤│ ││ ┌─────────┐ ││ │ 端侧防御 │ ← 第一道防线:设备指纹、环境检测 ││ └────┬────┘ ││ ↓ ││ ┌─────────┐ ││ │ 边缘防御 │ ← 第二道防线:实时指标、名单过滤 ││ └────┬────┘ ││ ↓ ││ ┌─────────┐ ││ │ 云端防御 │ ← 第三道防线:策略引擎、模型推理 ││ └────┬────┘ ││ ↓ ││ ┌─────────┐ ││ │ 人工兜底 │ ← 最后防线:审核确认、案例沉淀 ││ └─────────┘ ││ │└─────────────────────────────────────────────────────────┘设计要点:

-

每一层都有明确的职责边界

-

外层快速过滤,内层深度分析

-

单层失效不影响整体防御

-

成本与效果逐层递进

4.2 数据驱动原则

核心理念:风控决策必须建立在数据之上,而非经验猜测。

数据层次:

| 层次 | 数据类型 | 时效性 | 典型应用 |

|---|---|---|---|

| L1 | 原始事件 | 毫秒级 | 实时风控 |

| L2 | 实时指标 | 秒级 | 行为异常检测 |

| L3 | 近线特征 | 分钟级 | 模型推理 |

| L4 | 离线画像 | 天级 | 用户风险评级 |

| L5 | 图谱关系 | 天级 | 团伙挖掘 |

数据治理:

-

数据质量监控:缺失率、异常率、延迟监控

-

数据血缘追踪:从源头到决策的全链路可追溯

-

数据安全合规:脱敏、加密、访问控制

4.3 可观测性原则

核心理念:看不见的系统无法优化。

三个维度:

go

可观测性 = 指标(Metrics) + 日志(Logs) + 追踪(Traces)风控特有的可观测性需求:

| 观测对象 | 关键指标 | 告警阈值 |

|---|---|---|

| 规则效果 | 命中率、准确率、召回率 | 命中率突降/突增 |

| 模型效果 | AUC、KS、PSI | PSI > 0.2 |

| 系统性能 | RT、QPS、错误率 | RT > 阈值 |

| 业务影响 | 拦截率、误杀率、投诉率 | 投诉率突增 |

效果归因:

-

每个决策都能追溯到触发原因

-

支持案例回放和复盘

-

支持A/B测试和灰度发布

4.4 演进式架构原则

核心理念:架构要能随业务和威胁共同演进。

演进维度:

go

┌─────────────────────────────────────────────────────────┐│ 架构演进矩阵 │├──────────────┬──────────────┬──────────────┬───────────┤│ 维度 │ 初期 │ 成长期 │ 成熟期 │├──────────────┼──────────────┼──────────────┼───────────┤│ 规则复杂度 │ 简单规则 │ 复杂规则引擎 │ 智能Agent ││ 数据维度 │ 单维度 │ 多维度 │ 全维度 ││ 响应速度 │ 秒级 │ 毫秒级 │ 实时 ││ 自动化程度 │ 人工为主 │ 半自动 │ 自适应 ││ 可扩展性 │ 单机 │ 分布式 │ 弹性伸缩 │└──────────────┴──────────────┴──────────────┴───────────┘演进策略:

-

不要过度设计:满足当前需求 + 20% 余量

-

预留扩展点:接口抽象、插件机制

-

技术债务管理:定期重构、渐进优化

4.5 架构演进性能对比数据

数据来源:基于行业公开资料整理

| 评估维度 | 第一代 单点规则 | 第二代 规则引擎 | 第三代 智能风控 | 第四代 AI原生 |

|---|---|---|---|---|

| 核心逻辑 | 硬编码逻辑,强耦合 | 规则与代码解耦,可配置 | 数据驱动,模型为主,规则为辅 | 感知-决策-执行一体化,具备自主优化能力 |

| 平均响应时间 | 毫秒至几百毫秒 (推断:逻辑简单但无优化) | 百毫秒级 (推断:服务化但计算多串行) | 20-50毫秒 (通过并行、缓存等深度优化达成) | 毫秒级,追求效果最优 (通过智能路由等技术平衡效果与延迟) |

| 峰值QPS | 万级以下 (推断:单机或简单集群) | 万级至十万级 (推断:初步分布式) | 十万级至百万级 (公开可见:弹性微服务架构支撑) | 百万级以上,弹性更强 (云原生架构,支持极致弹性) |

| 策略迭代效率 | ❌ 需发版(天/周级) | ✓ 热更新(秒/分钟级) | ✓ 毫秒级生效 (行业对实时性的普遍要求) | ✓ 实时自适应 (模型与策略可在线学习与调整) |

| 决策智能水平 | ❌ 无,纯人工经验规则 | ❌ 弱,基于布尔规则与统计 | ✓ 多模型协同 (机器学习/深度学习广泛运用) | ✓ 大模型/智能体加持 (理解复杂模式,处理非结构化信息) |

| 拦截效果趋势 | 高误报、高漏报 | 误报率中等,依赖专家调优 | 误报率显著降低 (模型精度提升,如误报率可达0.1%以下) | 持续优化,对抗性更强 (在动态对抗中自主演进,追求精准) |

| 系统复杂度与运维 | 低(单体应用) | 中(服务化,配置管理) | 高(需运维数据、特征、模型等多系统) | 中高(智能化运维) (系统复杂,但通过AIOps降低人力成本) |

演进核心洞察:

-

从"功能实现"到"智能卓越":演进的核心驱动力从解决"有无"问题(第一、二代),转变为追求"精准与效率"(第三代),最终迈向"自主智能与自适应"(第四代)。

-

性能提升的关键工程实践 :从第二代到第三代,响应时间实现1-2个数量级的提升,主要依赖于四大核心优化:

-

计算前置与缓存:高频特征预计算,实时请求直接读取。

-

异步与并行化:将特征计算等耗时操作并行处理。

-

短路与快速失败:对极高风险请求快速拦截,避免后续计算。

-

端边云协同:在靠近用户的边缘节点完成简单决策,降低网络延迟。

-

第四代的核心优势是"效能",而非单纯"性能":第四代系统(AI原生)在引入大模型等复杂计算后,其单次请求的耗时可能增加。其先进性体现在:

-

-

智能调度 :通过轻量模型或规则进行初筛,仅对可疑流量路由至复杂模型,实现总体计算资源的最优分配。

-

效果跃迁 :处理复杂关联欺诈、挖掘潜在风险的能力质变,带来整体风控效果的提升。

-

运营效率:通过自动特征工程、在线学习等,大幅降低策略维护与模型迭代的人力成本。

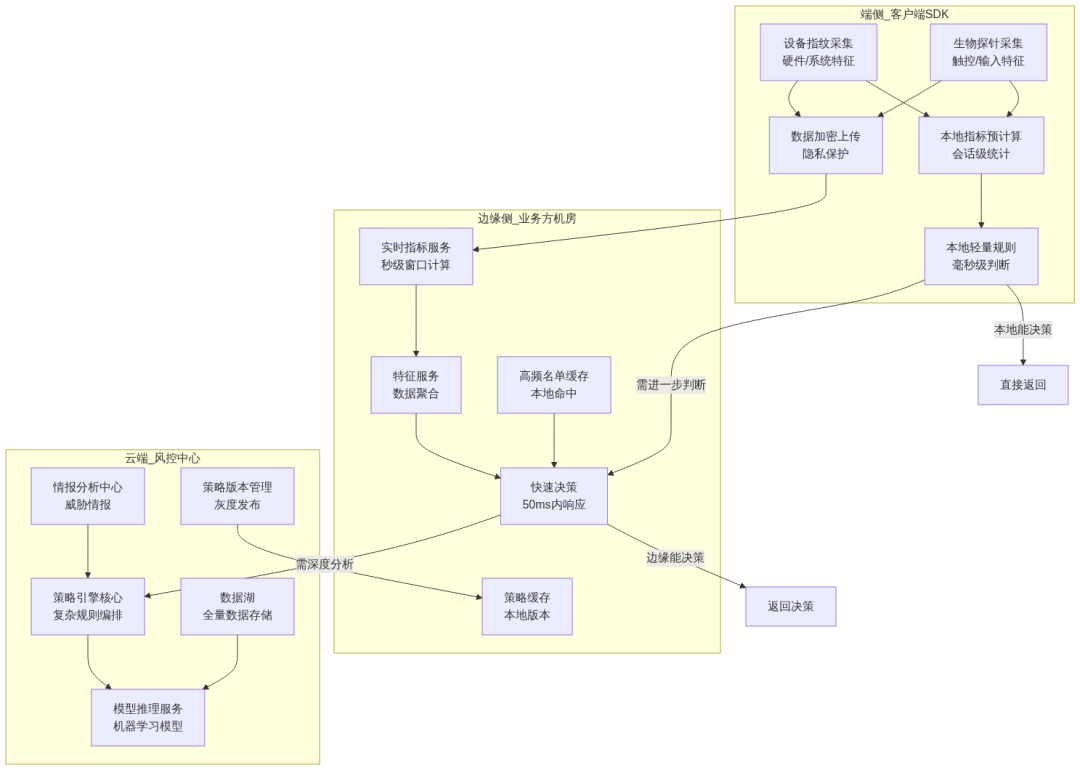

五、端边云协同架构

5.1 为什么需要端边云协同?

传统云端集中式架构面临三大挑战:

挑战一:延迟瓶颈

go请求 → 网络传输 → 云端计算 → 网络返回 → 响应 ↑ 20-100ms ↑ 50-200ms ↑ 20-100ms 总延迟:100-400ms,无法满足实时业务需求挑战二:带宽成本

bash所有请求都打到云端,带宽和计算成本线性增长每秒10万请求 × 每请求1KB = 100MB/s带宽挑战三:单点风险

go云端故障 → 全链路不可用无降级方案 → 业务完全瘫痪5.2 端边云协同架构设计理念

核心思想:让计算更靠近数据,让决策更靠近用户,实现"感知-决策-执行"的本地化闭环。

go传统架构:所有计算集中在云端,端侧只负责数据采集 端边云架构:端侧:采集 + 本地预处理 + 本地规则边缘:实时计算 + 快速决策 + 名单缓存云端:复杂策略 + 模型推理 + 情报分析 + 策略管理5.3 三层架构详解

5.4 各层职责详解

端侧能力设计

设计洞察:端侧是风控的第一道防线,承担数据采集和初步判断的职责。

markdown端侧SDK核心能力: 1. 数据采集 - 设备指纹:设备硬件特征、系统配置、环境参数 - 生物探针:触控轨迹、输入模式、加速度数据 - 行为采集:操作序列、页面停留、点击热图 2. 本地预处理 - 数据压缩:减少传输量 - 特征提取:计算基础特征 - 异常检测:识别明显的伪造痕迹 3. 本地规则执行 - 高频操作限制:本地直接限流 - 明显异常拦截:设备异常、环境异常 - 快速放行:白名单用户 4. 指标预计算 - 当前会话操作次数 - 当前页面停留时间 - 当前输入字数 端侧决策逻辑:if (本地规则命中高风险) { 直接拦截,不上报云端} else if (本地规则命中中风险) { 上报边缘节点,请求验证} else { 上报边缘节点,执行完整策略}边缘节点能力设计

设计洞察:边缘节点部署在业务方机房,实现"靠近业务、快速响应"。

markdown边缘节点核心能力: 1. 实时指标服务 - 秒级滑动窗口指标 - 分钟级聚合指标 - 本地Redis存储 2. 特征服务 - 基础特征计算 - 数据聚合 - 多源数据融合 3. 名单缓存 - 高频黑名单本地缓存 - 定期同步云端名单 - 支持增量更新 4. 快速决策 - 前置规则执行 - 简单策略执行 - 复杂策略转发云端 5. 策略缓存 - 本地策略版本缓存 - 支持离线运行 - 定期同步云端 边缘节点决策逻辑:if (命中本地黑名单) { 直接拦截} else if (命中前置规则) { 执行对应决策} else if (需要复杂模型) { 转发云端} else { 执行本地策略}云端能力设计

设计洞察:云端是风控的大脑,承担复杂决策和全局管理的职责。

markdown云端核心能力: 1. 策略引擎核心 - 复杂规则编排 - 策略树执行 - 多策略协同 - 灰度发布管理 2. 模型推理服务 - 机器学习模型在线推理 - 模型版本管理 - A/B测试支持 3. 情报分析中心 - 威胁情报采集 - 攻击模式分析 - 新型风险预警 4. 策略版本管理 - 策略配置管理 - 版本控制 - 灰度发布 - 回滚机制 5. 数据湖 - 全量数据存储 - 离线分析 - 模型训练数据 云端决策逻辑:- 接收边缘节点转发请求- 执行完整策略编排- 调用模型推理服务- 返回决策结果- 下发策略更新5.5 数据流转设计

端侧 → 边缘:

diff传输内容:- 预处理后的特征数据(加密)- 本地计算结果- 原始采集数据(必要时) 传输协议:- gRPC(低延迟)- 数据压缩(gzip)- 批量上传(减少请求数)边缘 → 云端:

diff传输内容:- 需要复杂判断的请求- 边缘无法处理的场景- 风险事件上报 传输时机:- 实时:高风险事件- 准实时:普通事件- 批量:统计数据云端 → 边缘:

diff下发内容:- 策略更新- 名单更新- 模型更新 更新机制:- 推送:紧急更新- 拉取:定期同步- 增量:减少传输量5.6 降级与容灾设计

diff降级策略: 端侧故障:- 降级为仅采集,不做本地判断- 直接上报边缘节点 边缘节点故障:- 端侧直接上报云端- 云端承担全部计算- 响应时间会增加 云端故障:- 边缘节点使用本地缓存策略- 支持离线运行一段时间- 定期尝试重连 全链路故障:- 紧急放行模式- 记录日志供后续分析- 保障业务可用性5.7 端边云协同的价值

维度 传统架构 端边云架构 响应延迟 100-400ms 10-50ms(边缘命中时) 带宽成本 全量上传 压缩+预处理 可用性 单点风险 多层兜底 隐私保护 数据全量上传 敏感数据本地处理 扩展性 云端扩容 边缘分担压力 5.8 端边云协同实战分析

定性描述:基于行业公开技术分享整理,数据为典型场景的代表性数值,不代表特定公司

业务背景:

-

业务规模:如大型电商平台,日均订单量级达百万至千万级别

-

问题痛点:高峰期风控响应延迟较长,影响用户下单体验

-

黑产威胁:薅羊毛、黄牛抢购、虚假账号注册等

部署方案:

层级 部署位置 核心能力 设计目标 端侧SDK 用户终端 本地规则 + 设备指纹采集 + 行为探针 毫秒级本地判断 边缘节点 业务方机房(多区域) 实时指标 + 名单缓存 + 快速决策 降低云端往返延迟 云端中心 风控中心机房 复杂策略 + 模型推理 + 情报分析 深度风险分析 设计要点:

- 分层决策策略:

-

高风险场景:端侧/边缘快速拦截

-

中风险场景:边缘节点执行前置规则

-

低风险场景:快速放行

-

复杂场景:转发云端深度分析

-

-

边缘降级策略:

-

-

云端不可用时,边缘使用本地缓存策略继续服务

-

支持一定时间的离线运行

-

定期尝试重连云端

-

-

端侧预过滤:

-

-

本地高频操作限制

-

设备异常检测(模拟器、改机工具)

-

VIP用户白名单快速放行

效果定性分析:

-

边缘节点命中时,响应延迟显著降低(减少云端往返时间)

-

大部分常见风险场景可在边缘侧快速处理

-

仅复杂场景需转发云端深度分析

-

本地缓存策略是性能提升的关键因素

实战经验总结:

-

本地缓存命中率直接影响整体延迟

-

端侧SDK更新策略需谨慎,避免频繁更新影响用户体验

-

灰度发布机制必不可少,策略更新需逐步推进

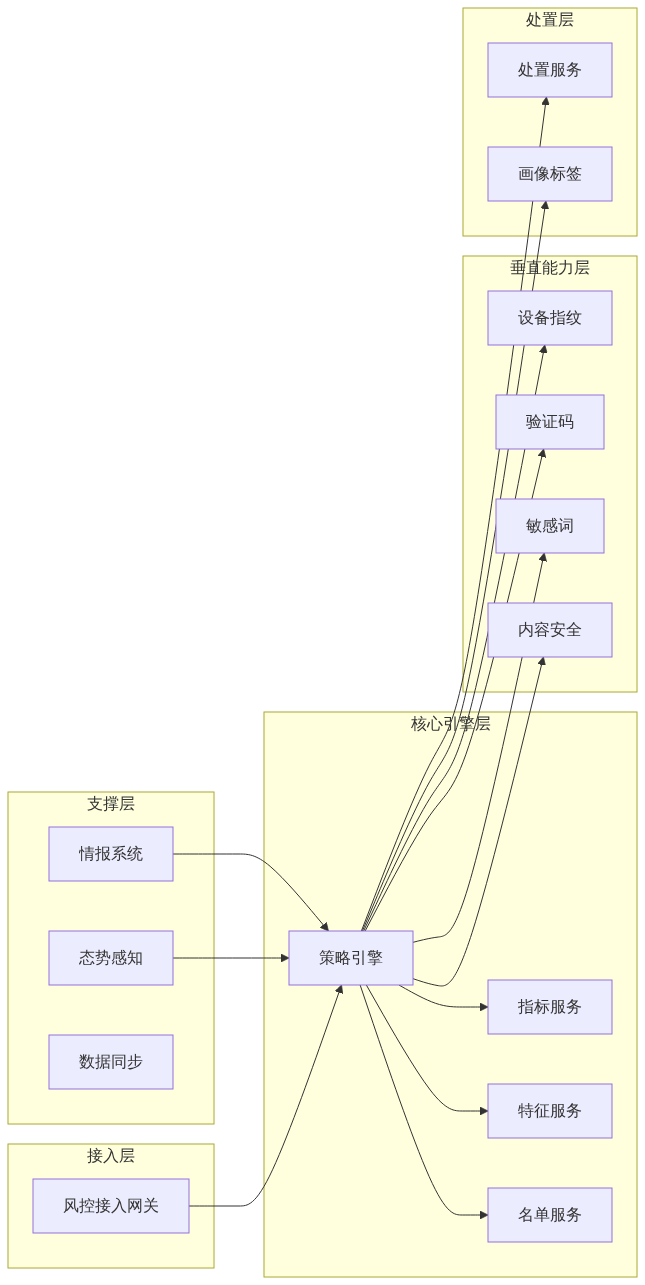

六、微服务架构设计

6.1 服务拆分原则

风控系统可拆分为以下核心服务:

6.2 核心服务说明

模块 职责 核心能力 策略引擎 策略执行与决策编排 DSL解析、规则执行、策略流编排 指标服务 风险指标计算 离线/近线/实时指标计算与供给 特征服务 特征加工与供给 特征计算、数据聚合、管道化执行 名单服务 风险名单管理 名单的存储、匹配查询与生命周期管理 处置服务 风险处置执行 处置动作管理、执行与反馈 验证码 人机识别与挑战 验证码生成、校验与策略适配 设备指纹 设备识别与追踪 终端指纹生成、设备唯一性识别 情报系统 威胁情报分析 情报采集、聚合、挖掘与图谱分析 6.3 技术栈选型考量

Go vs Java的选择:

维度 Go Java 性能 更高(原生并发) 较高(JVM优化) 开发效率 中等 较高(生态丰富) 部署 单二进制 需要JVM 适合场景 高并发服务 复杂业务逻辑

七、技术栈选型参考

7.1 存储选型参考

存储类型 适用场景 选型建议 Redis 高频读写、实时计数 主选:Redis Cluster MySQL 关系数据、事务 主选:MySQL 8.0 MongoDB 文档数据、灵活Schema 行为日志、设备数据 Elasticsearch 全文检索、日志分析 案件检索、日志分析 StarRocks OLAP分析 指标计算、报表 Nebula Graph 图数据库 关联分析、团伙挖掘 7.2 计算选型参考

计算类型 适用场景 例子 实时流计算 实时指标 Flink 离线批处理 离线画像 Spark 图计算 团伙挖掘 GraphX / Flink Gelly 在线推理 模型服务 TF Serving / ONNX 大模型推理 LLM推理服务。 vLLM / TGI / 云厂商托管服务 7.3 消息队列选型

场景 选型 理由 事件驱动 Kafka 高吞吐、持久化 实时告警 RocketMQ 延迟低、可靠性高 异步任务 RabbitMQ 功能丰富、易用

八、架构设计原则总结

8.1 SOLID原则在风控中的应用

S - 单一职责:

-

每个服务只做一件事

-

指标服务只负责指标计算

-

名单服务只负责名单匹配

O - 开闭原则:

-

对扩展开放:新规则、新模型可插拔

-

对修改关闭:核心逻辑稳定

L - 里氏替换:

-

不同数据源实现同一接口

-

可替换不同存储引擎

I - 接口隔离:

-

客户端不应依赖不需要的接口

-

细粒度API设计

D - 依赖倒置:

-

依赖抽象而非具体实现

-

便于测试和替换

8.2 风控特有的设计原则

8.2 风控特有的设计原则

原则一:短路优先

go高风险 → 快速拦截(不浪费计算资源)低风险 → 快速放行(不增加用户负担)中风险 → 深度分析原则二:降级兜底

diff核心服务故障时:- 指标服务故障 → 使用缓存指标- 模型服务故障 → 降级到规则- 全链路故障 → 紧急放行(避免业务不可用)原则三:灰度可控

diff新策略上线:- 先在测试环境验证- 小流量灰度(1% → 10% → 50% → 100%)- 随时可回滚

九、写在最后

风控是一个没有终点的战场。今天的防御,明天可能就会被绕过;今天的架构,明天可能就需要升级。

但有些东西是不变的:

对业务的理解:风控服务于业务,不理解业务就无法做好风控。

对对手的理解:知己知彼,百战不殆。理解黑产的运作方式,才能有效对抗。

对系统的敬畏:每一行代码都可能影响用户的体验,每一次决策都可能造成资损或误杀。

-