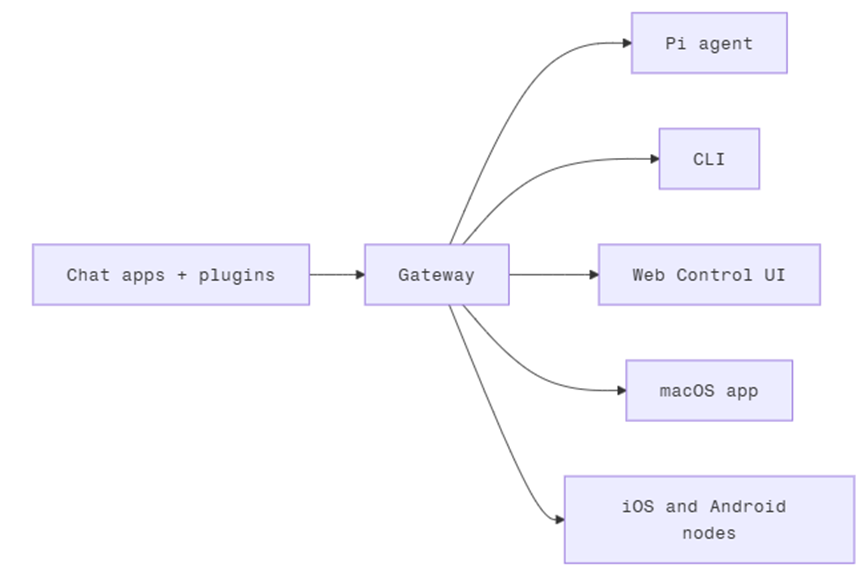

OpenClaw是开源的AI Agents集成服务器端,其使用本地服务器网关对接前端应用与后端AI Agents,聊天应用的网关网络协议集成图:

|---------------------------------------------------------------------------------------------------------|

| Chat apps + plugins OpenClaw使用聊天插件集成聊天应用,不同的聊天应用厂商提供对应的插件,在OpenClaw服务器端中安装对应的聊天应用插件,即可对接本地应用或者远程应用。 |

| Gateway 本地服务器端网关,支持不同网络协议的网络通道,代理对接AI Agents与内部外部应用。 |

| Pi Agent OpenClaw内部默认安装Pi Agent运行时环境,使用本地网关网络协议连接外部的Pi Agent,实现Agent与Agent之间的对接。 |

| CLI 支持对接不同操作系统的客户端应用,例如,命令行控制台或者其他界面应用。 |

| Web Control UI 支持对接浏览器提供的web用户界面。 |

| macOS app 支持对接macOS操作系统的应用。 |

| iOS and Android nodes 支持对接iOS或者安卓类型移动操作系统的应用。 |

核心功能与特性:

|---------------------------------------------------------------------|

| Multi-channel gateway 多通道网关,一个网关实例对应多个聊天应用的网络通道。 |

| Plugin channels 插件通道,聊天应用以插件的形式安装,以网络通道的方式对接网关通道,对外提供服务。 |

| Multi-agent routing 集成的AI Agents的会话对话、本地工作空间、相关的组件实例以及路由路径相互独立。 |

| Media support 支持收发图像、语音以及文档类型的多媒体内容。 |

| Web Control UI 提供本地浏览器形式的web管理控制台的用户界面,提供聊天、配置、会话以及节点的管理功能。 |

| Mobile nodes 支持对接移动端设备的节点,提供画布、相机以及语音信息交互的会话对话。 |

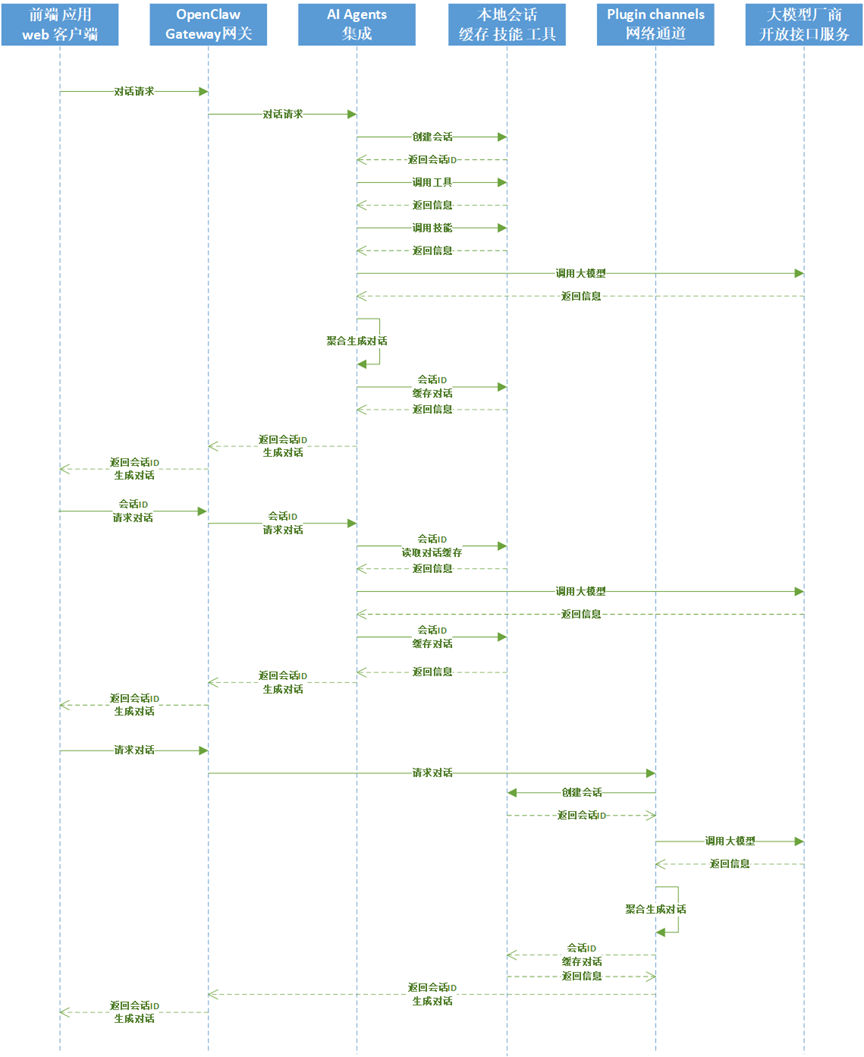

核心业务流程:

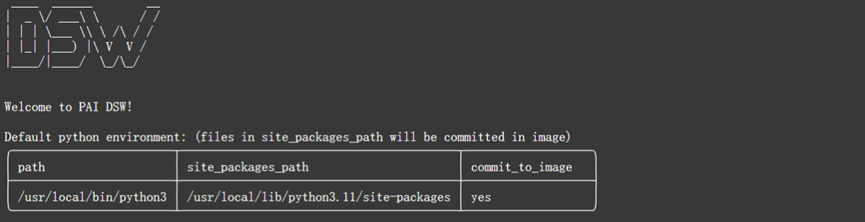

阿里云大模型平台安装部署千问大模型服务

登录阿里云大模型部署平台:

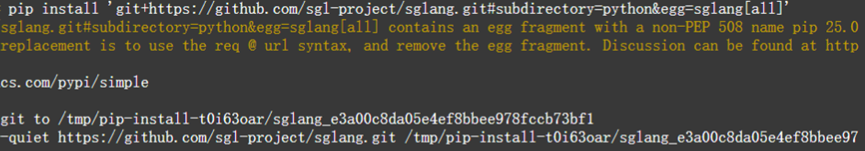

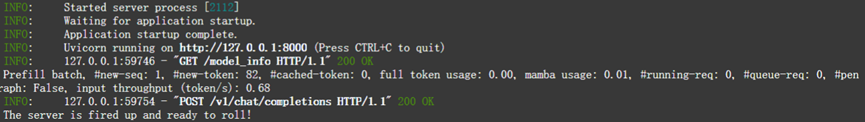

安装运行大模型的支撑工具:

|----------------------------------------------------------------------------------------------------|

| pip install 'git+https://github.com/sgl-project/sglang.git#subdirectory=python&egg=sglangall' |

使用支撑工具运行大模型服务:

|------------------------------------------------------------------------------------------------------------------------------------------------------------------|

| SGLANG_USE_MODELSCOPE=true python -m sglang.launch_server --model-path Qwen/Qwen3.5-2B --port 8000 --tp-size 1 --mem-fraction-static 0.8 --context-length 262144 |

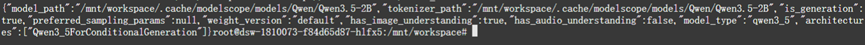

测试大模型接口服务:

|---------------------------------------|

| curl http://127.0.0.1:8000/model_info |

测试大模型接口服务:

|---------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------|

| curl http://127.0.0.1:8000/v1/chat/completions \ -H "Content-Type: application/json" \ -d '{ "model": "Qwen/Qwen3.5-2B", "messages": {"role": "system", "content": "You are a helpful assistant."}, {"role": "user", "content": "请简要介绍一下量子计算。"} , "temperature": 0.7, "max_tokens": 512 }' |

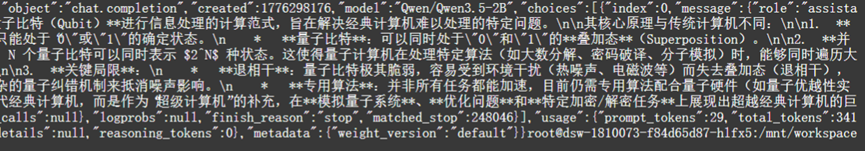

在阿里云大模型部署平台中创建API Key,用于OpenClaw远程调用:

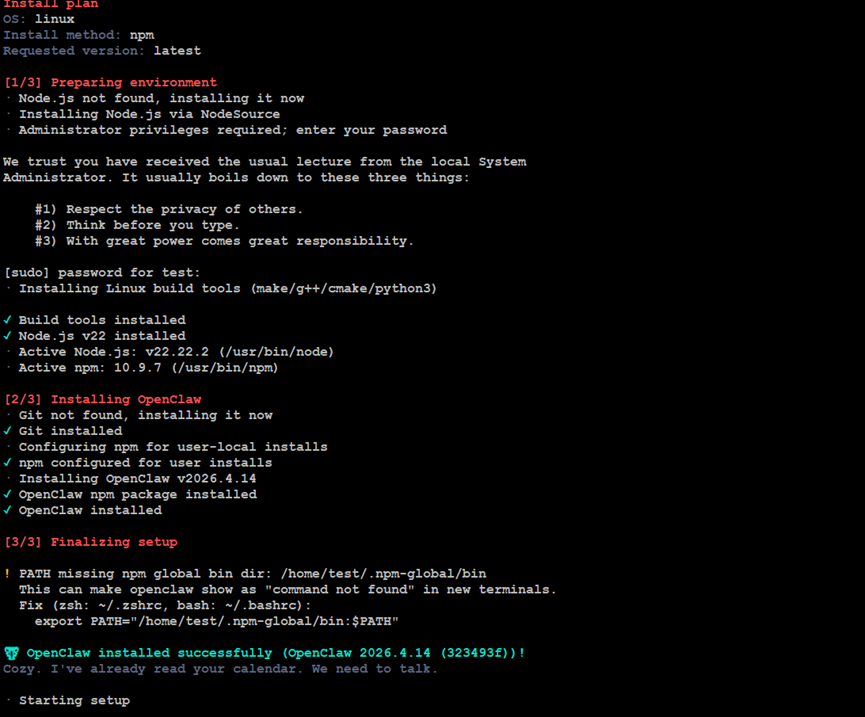

CentOS操作系统安装OpenClaw

登录本地CentOS操作系统安装OpenClaw:

|---------------------------------------------------|

| curl -fsSL https://openclaw.ai/install.sh | bash |

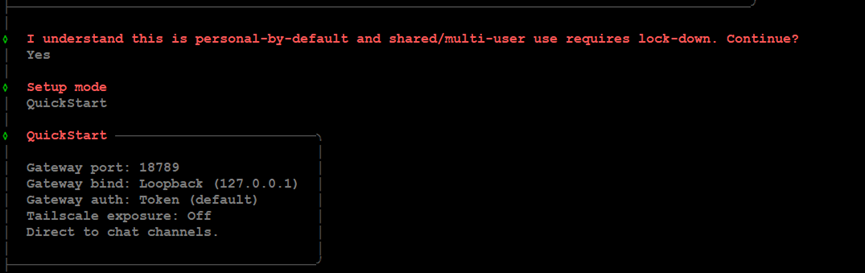

快速启动OpenClaw运行环境配置:

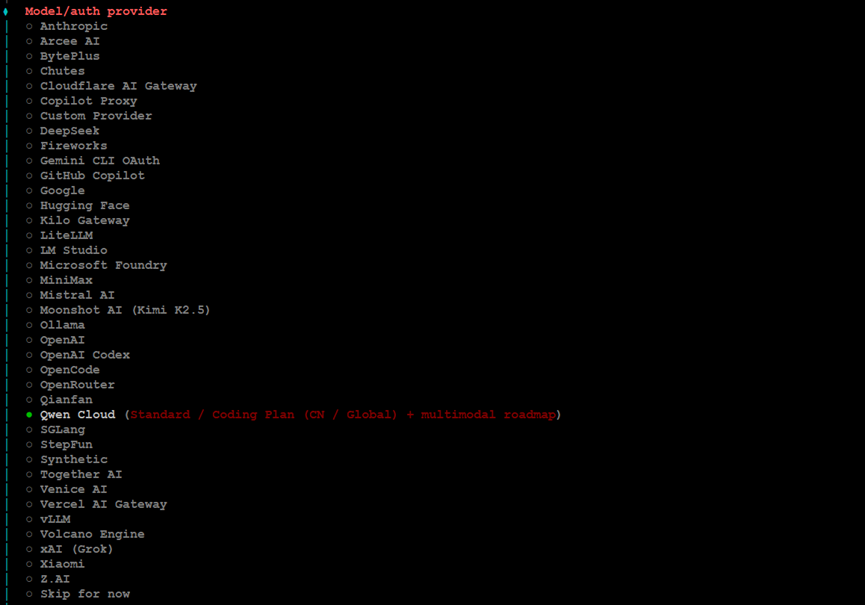

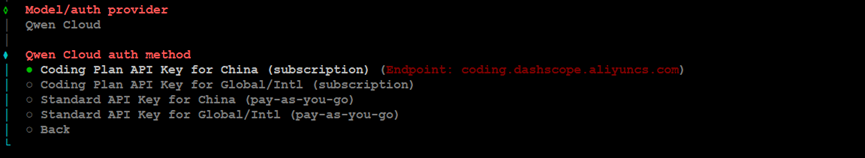

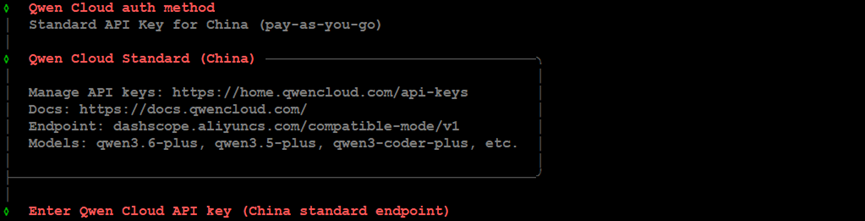

设置大模型提供商为阿里云千问:

设置阿里云千问大模型接口服务的API Key,用于OpenClaw对接远程接口服务:

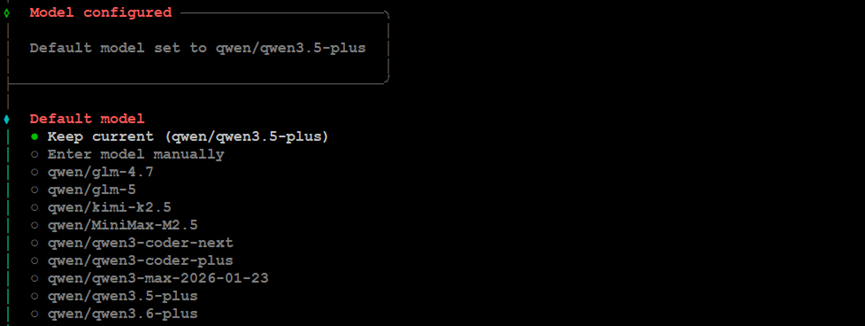

设置阿里云千问大模型的版本:

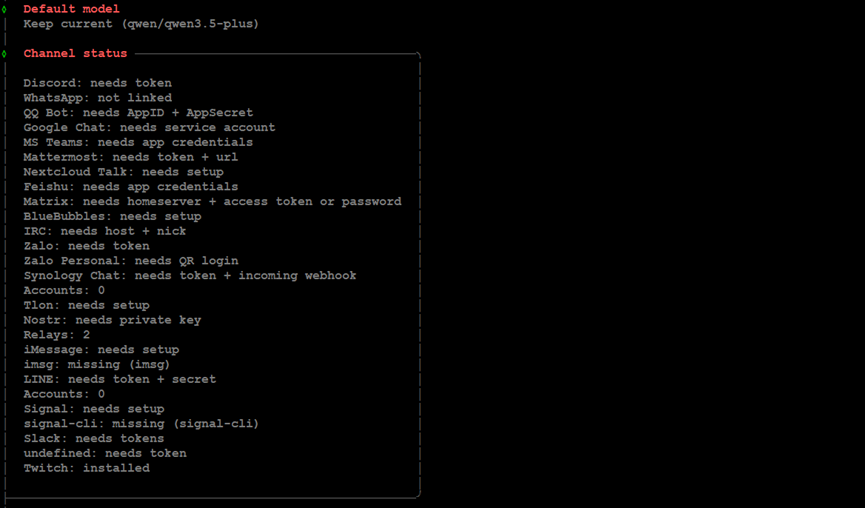

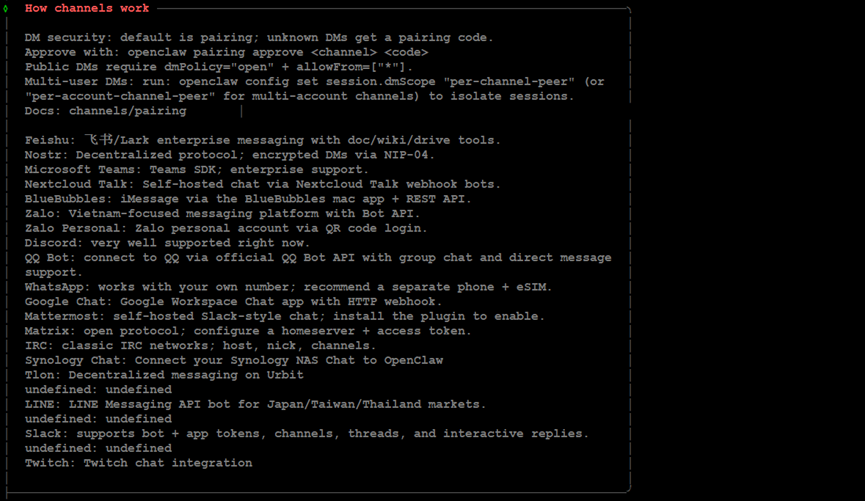

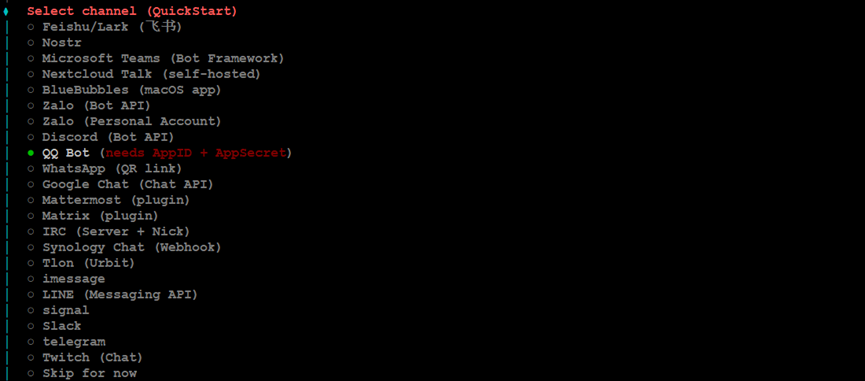

设置聊天应用提供商的直接对接的网络通道服务:

设置聊天应用提供商的直接对接的网络通道为QQ Bot机器人:

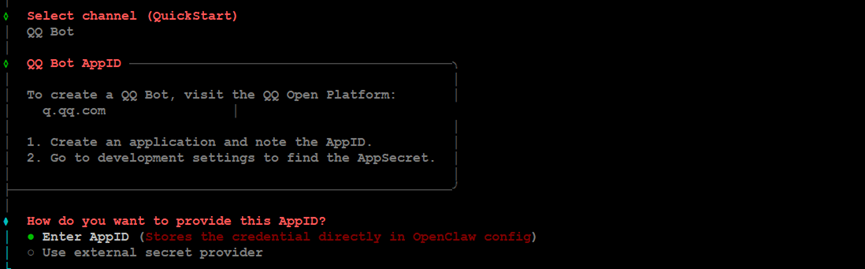

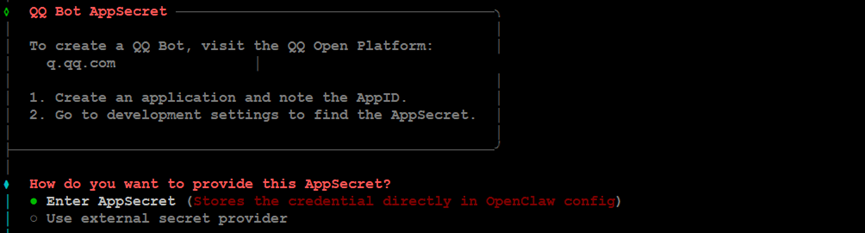

在QQ开放平台创建QQ Bot机器人,获取AppID以及AppSecret:

设置完成重启网关服务,即可在QQ Bot机器人中对接本地服务器提供的OpenClaw服务。