程序员破防现场:Codex 配置自定义 AI API 后,Token 为什么烧得这么快?我的血汗钱啊!

最近很多程序员开始玩 Codex CLI / Cursor / Claude Code / AI API 聚合平台。

我也是其中一个。

刚开始的时候我非常兴奋:

- 配置 API Key

- 接入自己的 AI API

- 启动 Codex

结果没想到。

真正启动之后,才是噩梦的开始。

打开后台统计:

Token 使用量:暴涨

余额:暴跌当时我的第一反应是:

"我也没问几句话啊?怎么钱就没了?"

后来研究了一晚上 Codex 的工作原理,终于明白了:

AI Agent 的 Token 消耗逻辑,和普通聊天完全不是一回事。

今天这篇文章,就给大家彻底讲清楚。

一、程序员第一次看到 Token 账单时的真实反应

很多开发者第一次接入 AI API 都会经历这个阶段:

第一天

token 消耗:几千

感觉还能接受

第三天

token 消耗:几十万

开始慌

一周后

余额:0钱包状态:

🔥 程序员血汗钱燃烧中原因其实很简单:

AI 编程工具的 Token 消耗,是指数级增长的。

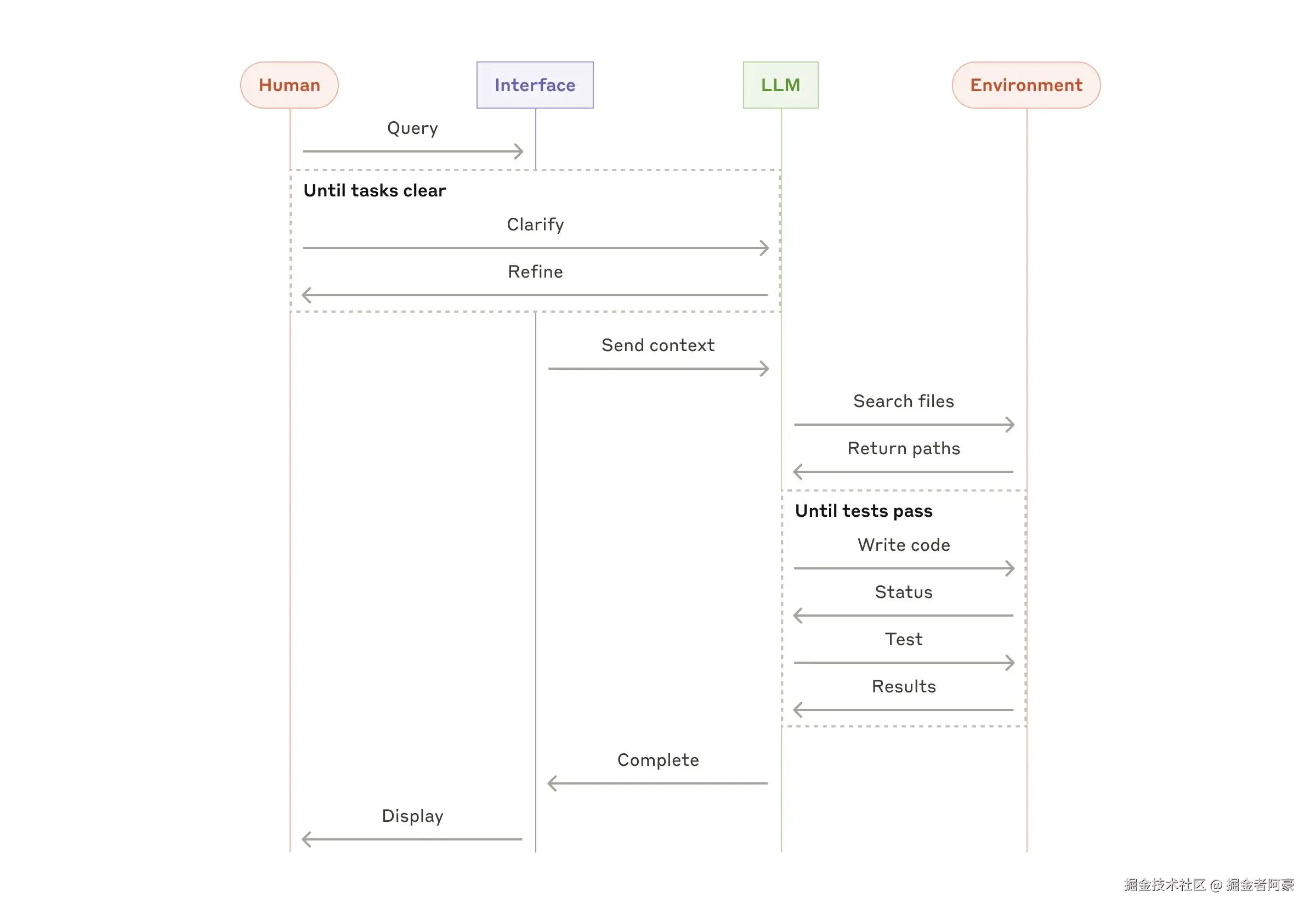

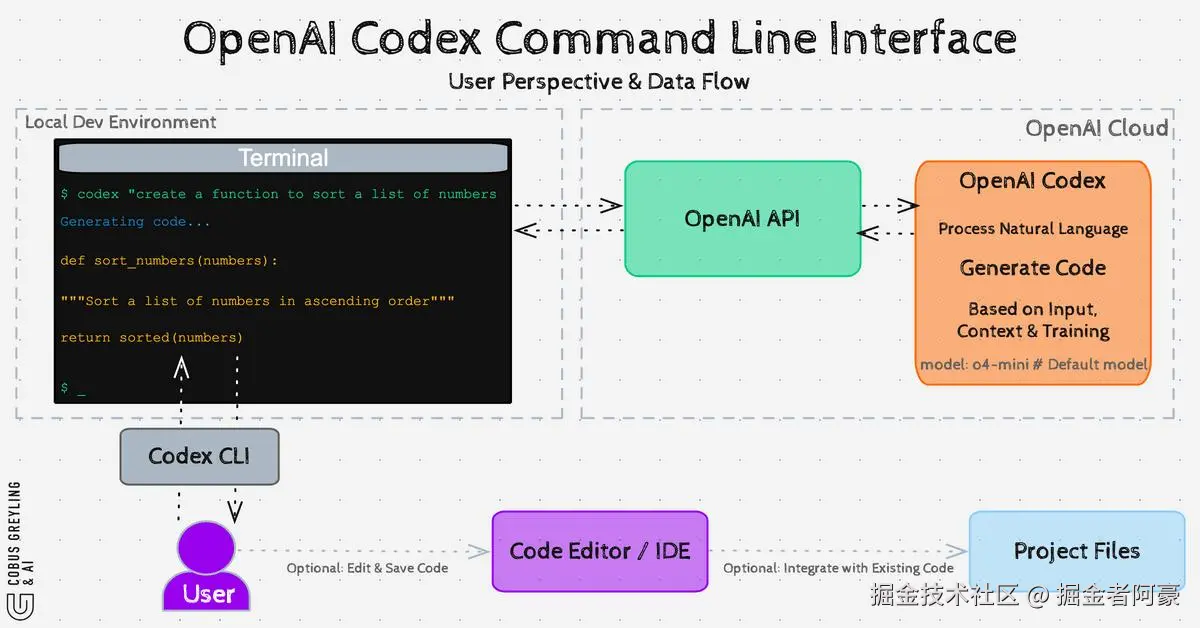

二、Codex 的真实工作流程

很多人以为 Codex 工作流程是:

提问 → AI回答实际上完全不是。

Codex 的真实流程是:

markdown

用户问题

│

▼

读取代码仓库

│

▼

构建上下文

│

▼

AI推理

│

▼

生成修改方案

│

▼

执行任务

│

▼

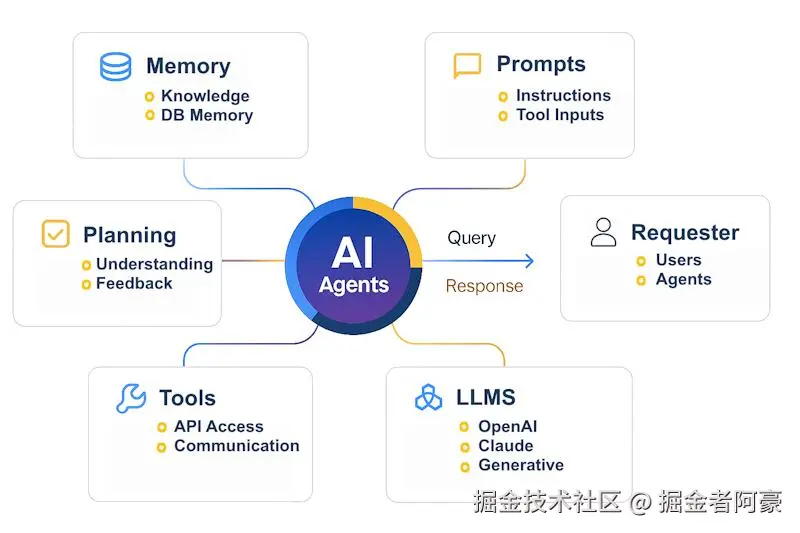

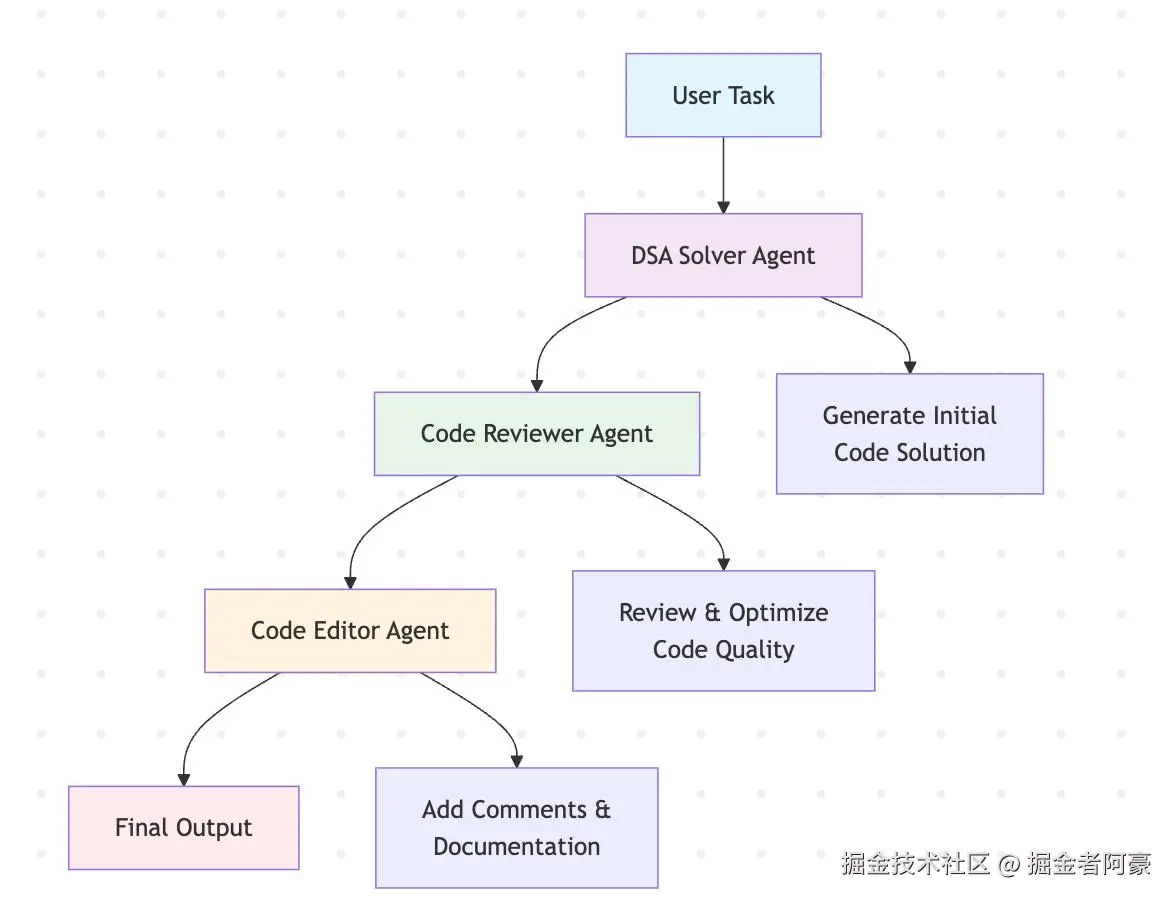

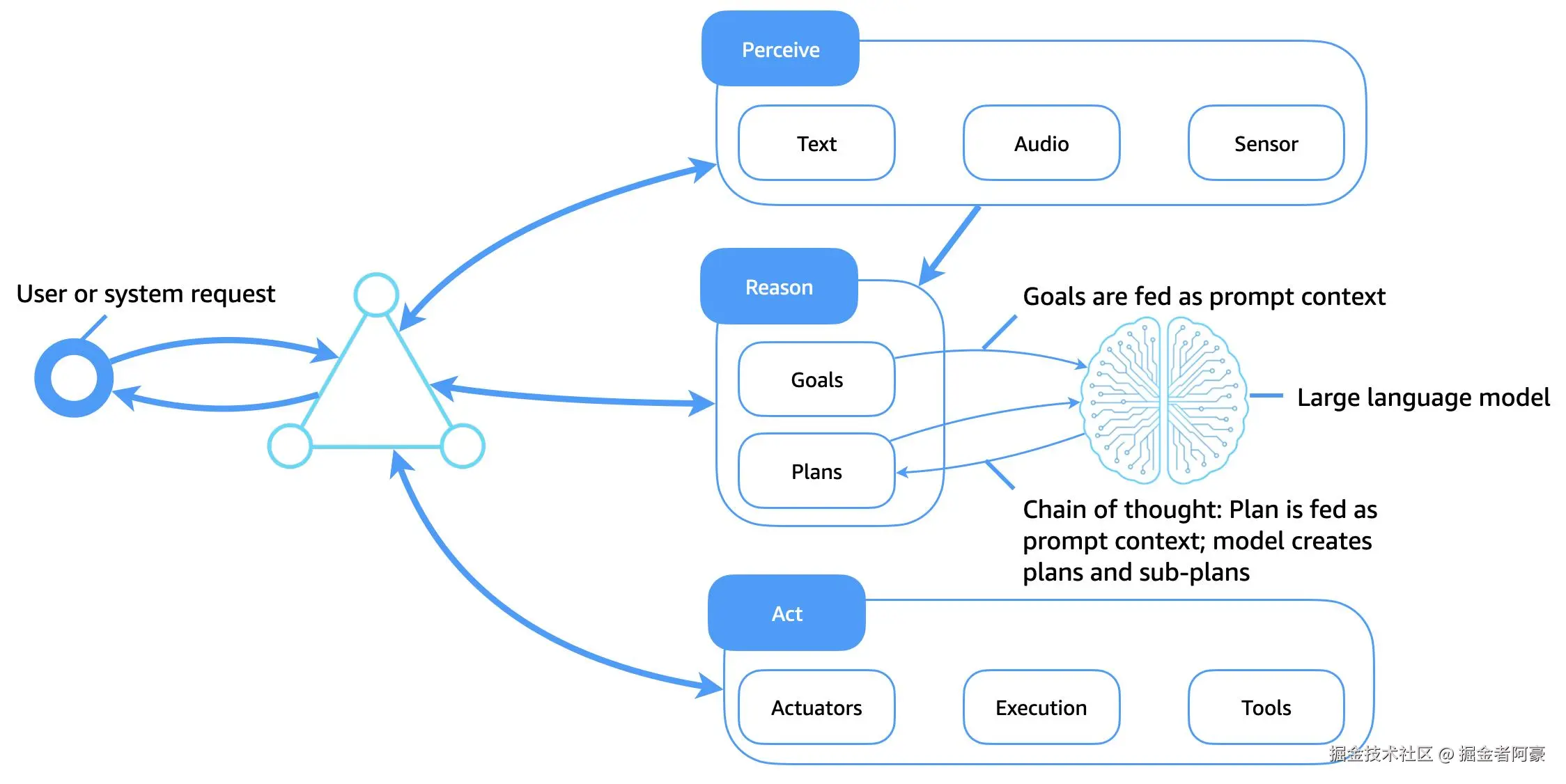

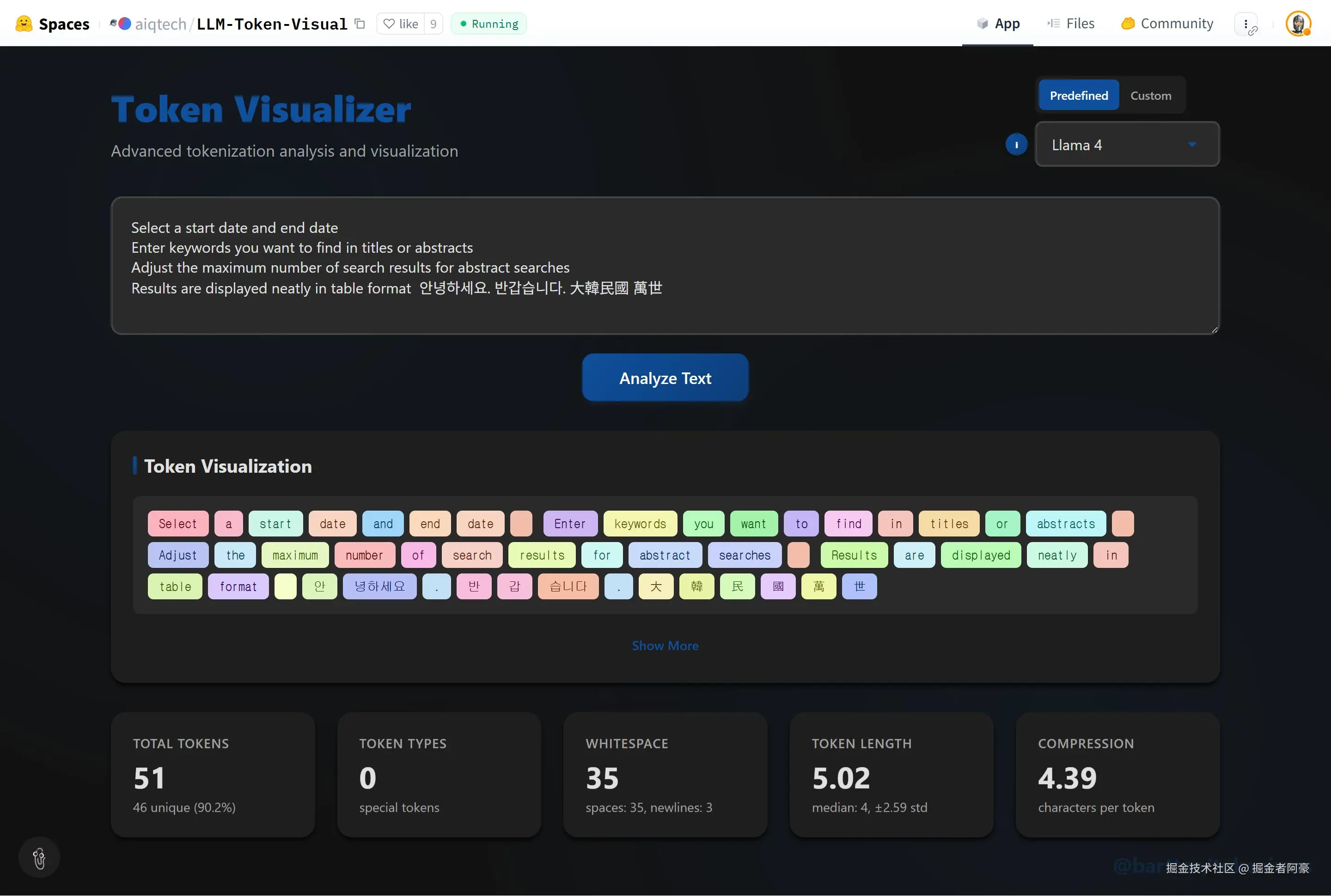

再次分析🧠 AI Agent 工作流程图

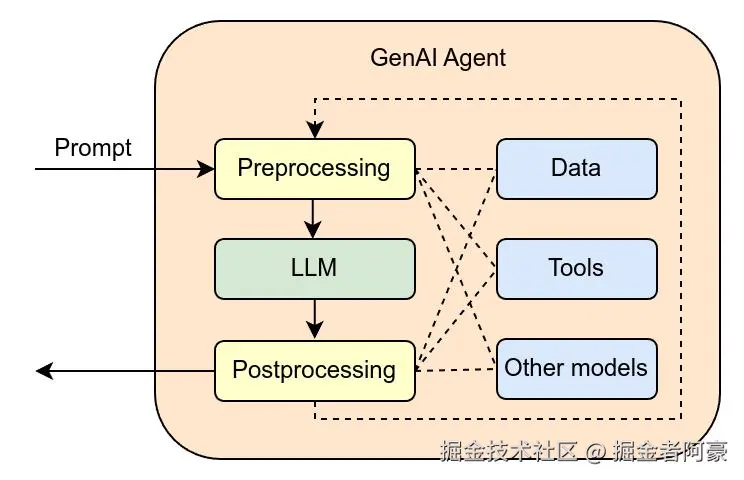

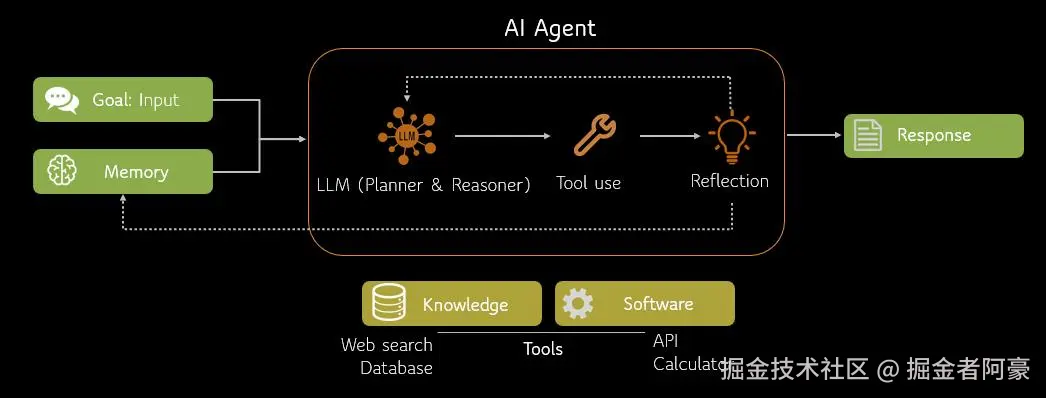

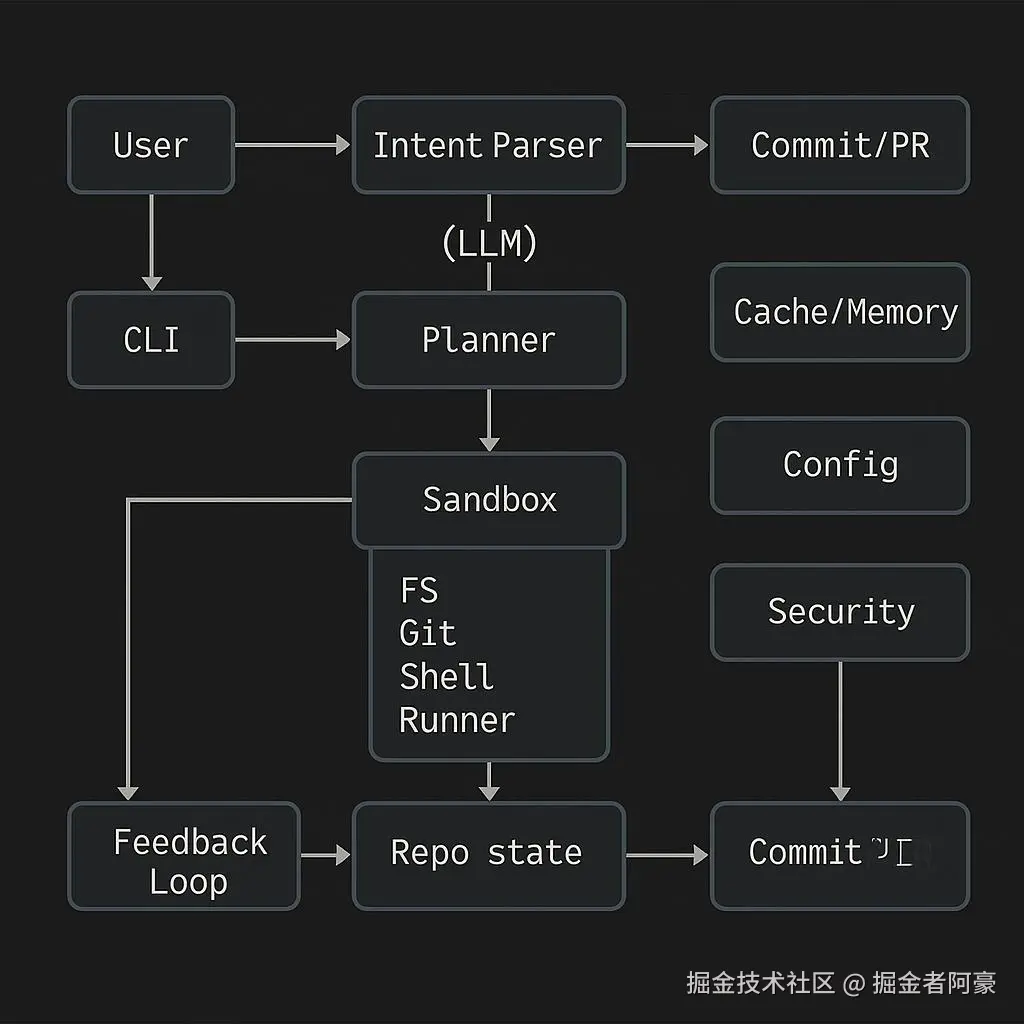

从架构角度看:

Codex 更像一个 AI Agent,而不是普通聊天机器人。

它会自动:

- 读取代码

- 分析项目

- 修改代码

- 再次测试

每一步:

都要调用模型。

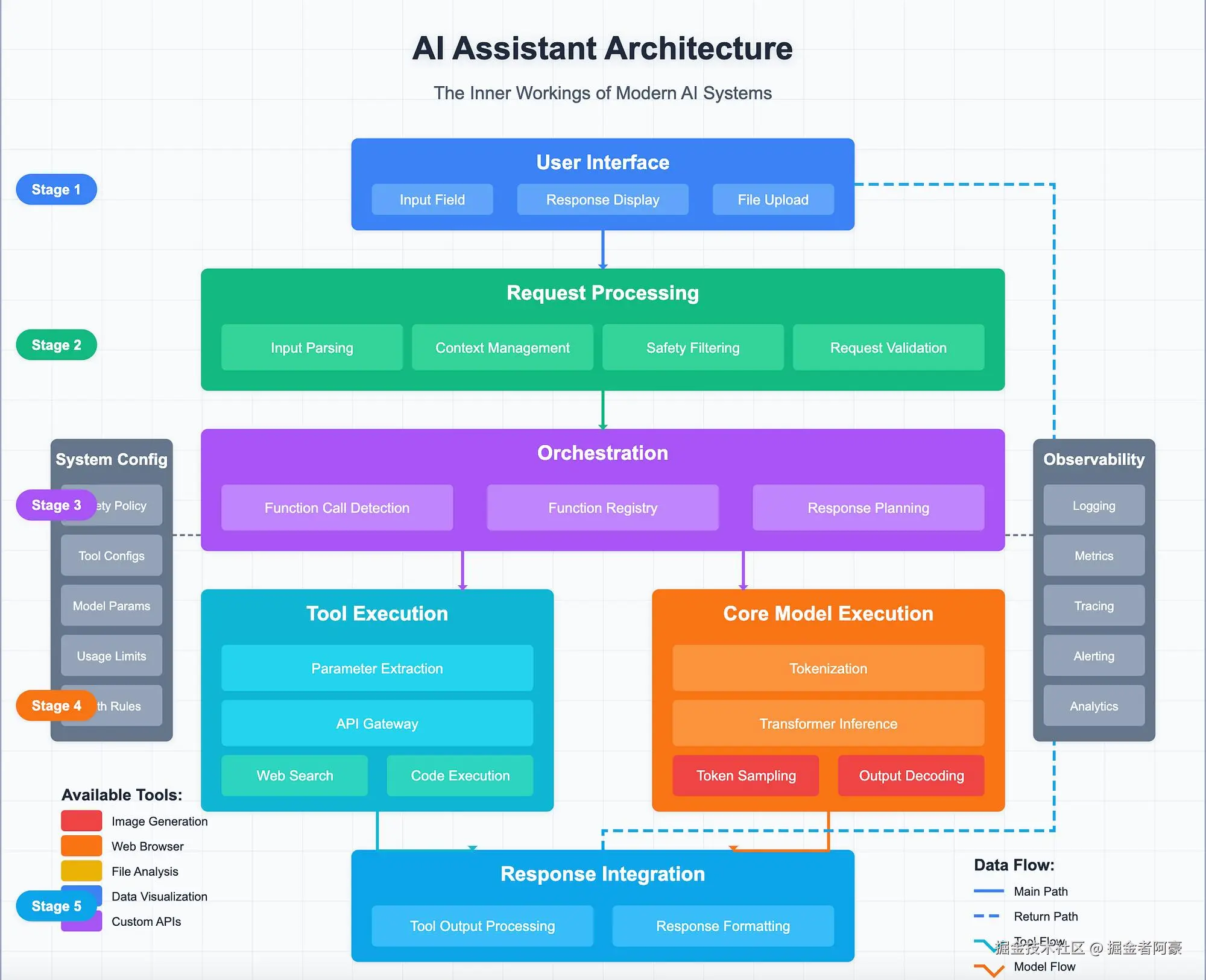

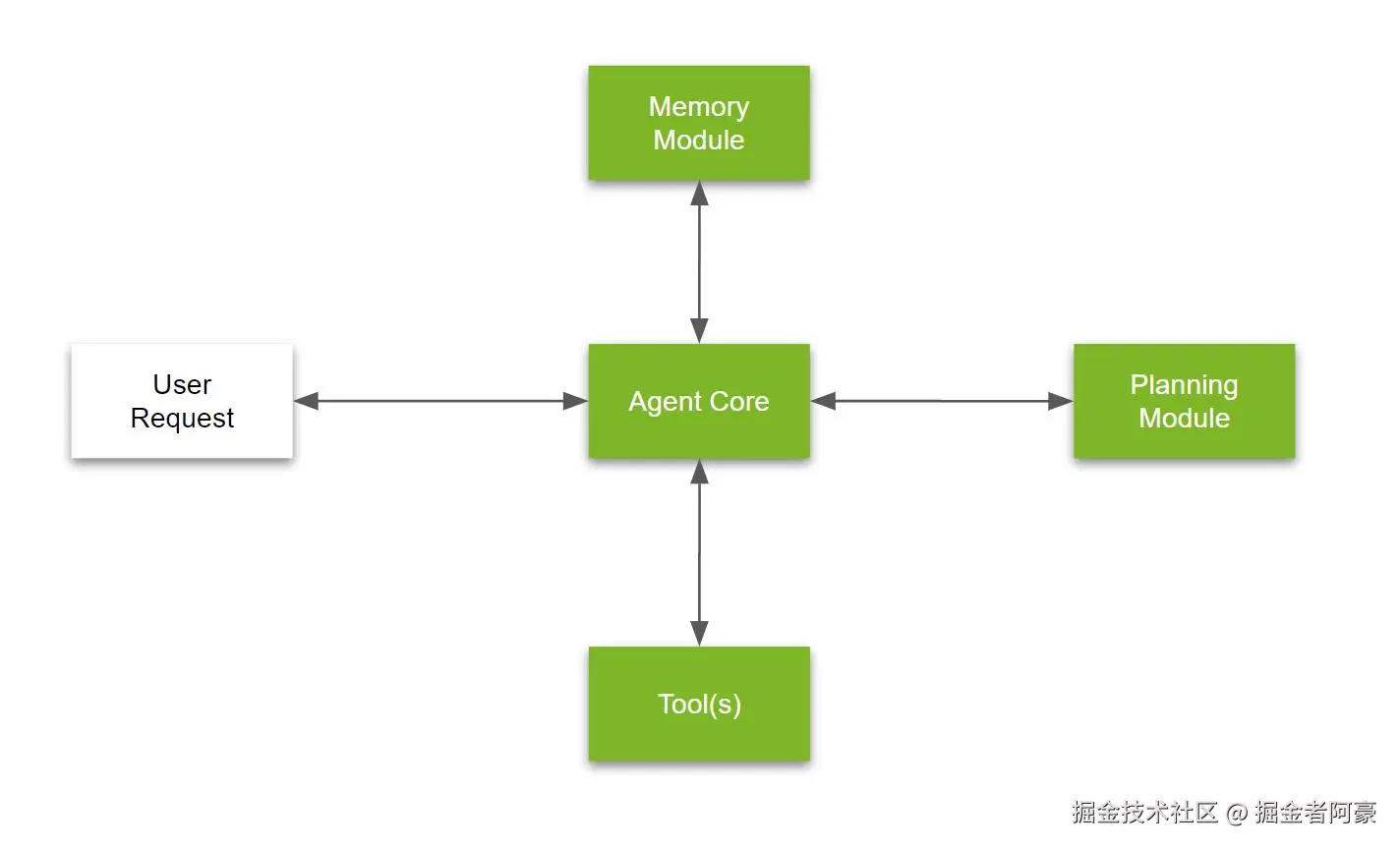

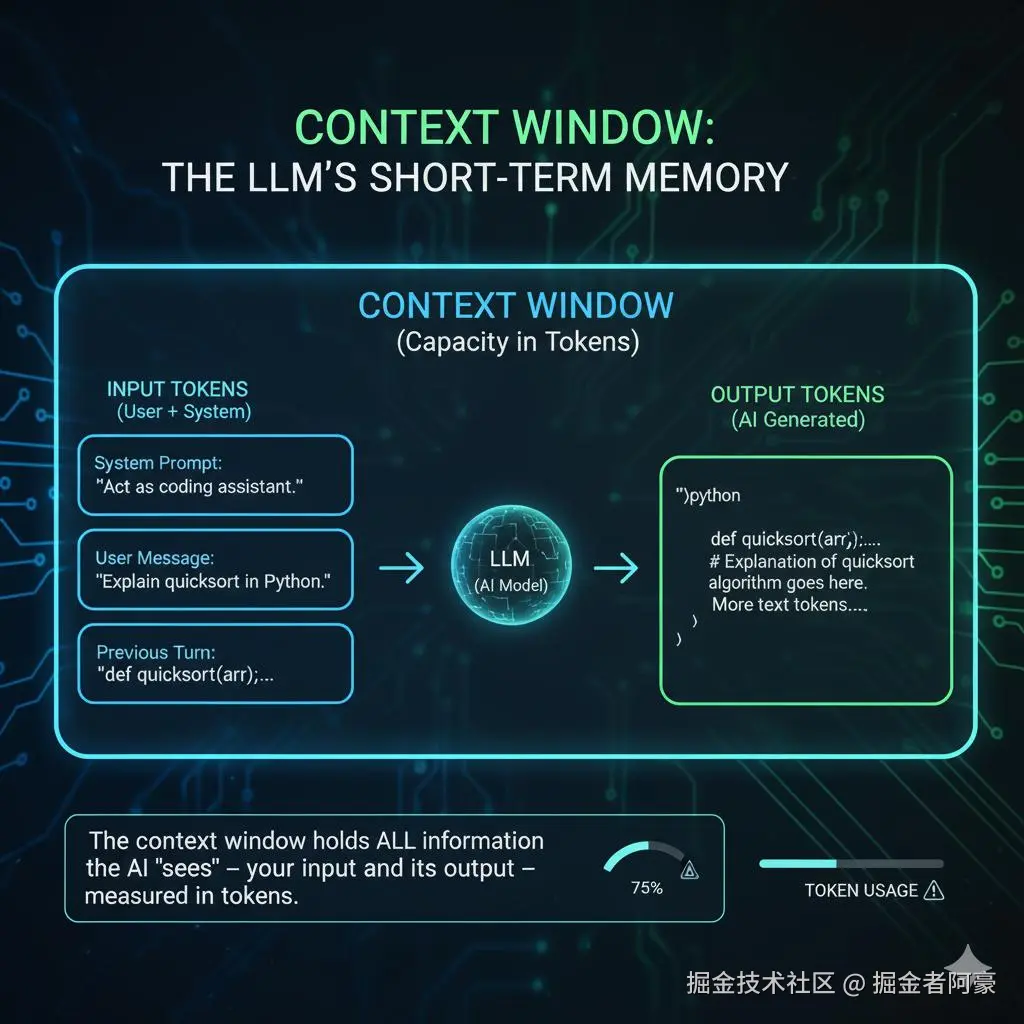

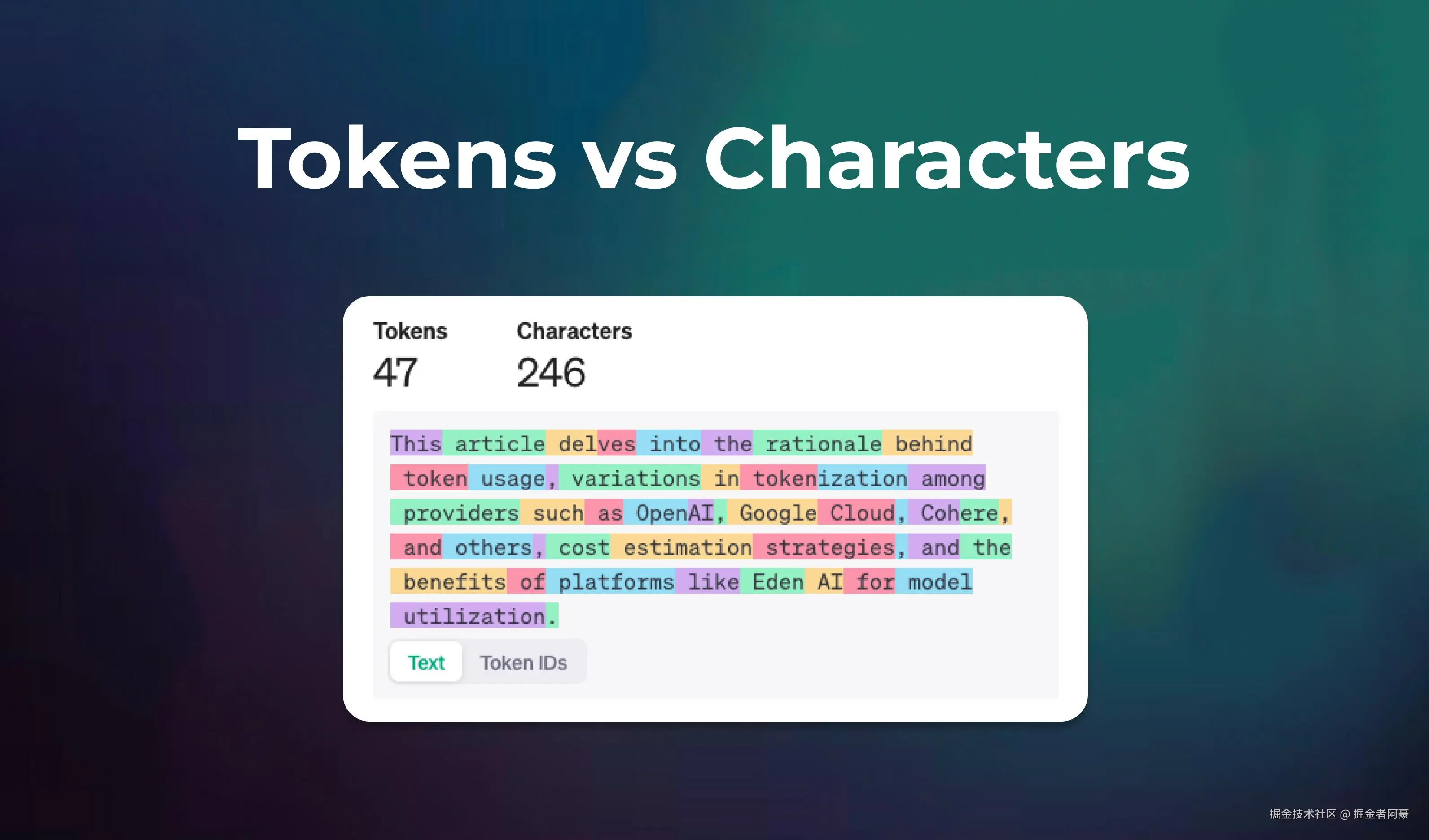

三、真正吃 Token 的不是回答,而是上下文

这是很多程序员误解最大的一点。

很多人觉得:

回答200字

token≈200但真实情况是:

diff

读取项目代码

+历史上下文

+AI推理

+回答一次请求可能是:

| 类型 | token |

|---|---|

| 问题 | 100 |

| 代码上下文 | 15000 |

| 历史对话 | 5000 |

| AI输出 | 1000 |

| 推理 | 4000 |

最终:

≈ 25000 tokens📊 Token 消耗结构图

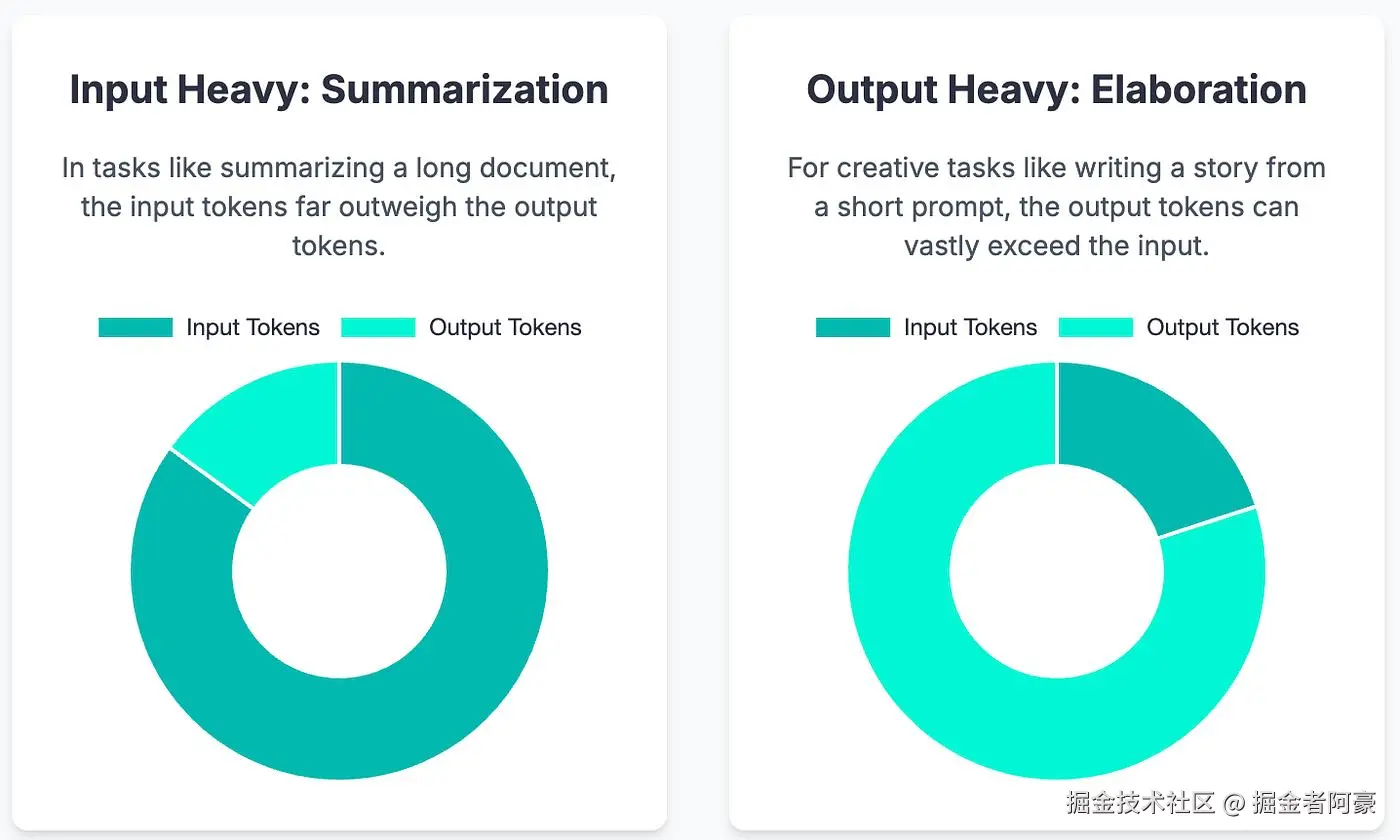

从统计上看:

真正占用 Token 的往往是:

上下文而不是 AI 回答。

四、为什么 AI 会读取整个项目?

AI 编程助手和普通 ChatGPT 最大区别就是:

需要理解代码例如你说:

帮我修复这个接口AI可能会读取:

- controller

- service

- repository

- config

- entity

一个普通 SpringBoot 项目:

10个文件就可能产生:

15000 tokens如果是微服务项目:

几十个文件Token 可能:

50000+五、AI 推理也要算 Token

很多模型现在支持:

Reasoning

Deep Thinking

Analysis这些 推理过程 也会消耗 Token。

例如:

yaml

输入 5000 token

输出 800 token实际消耗可能:

12000 token因为中间有:

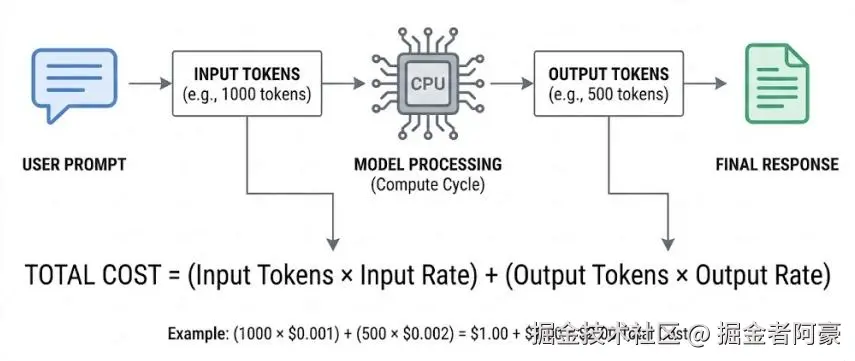

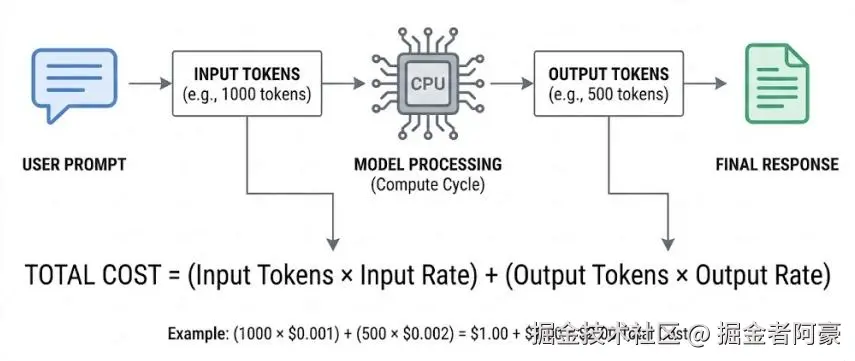

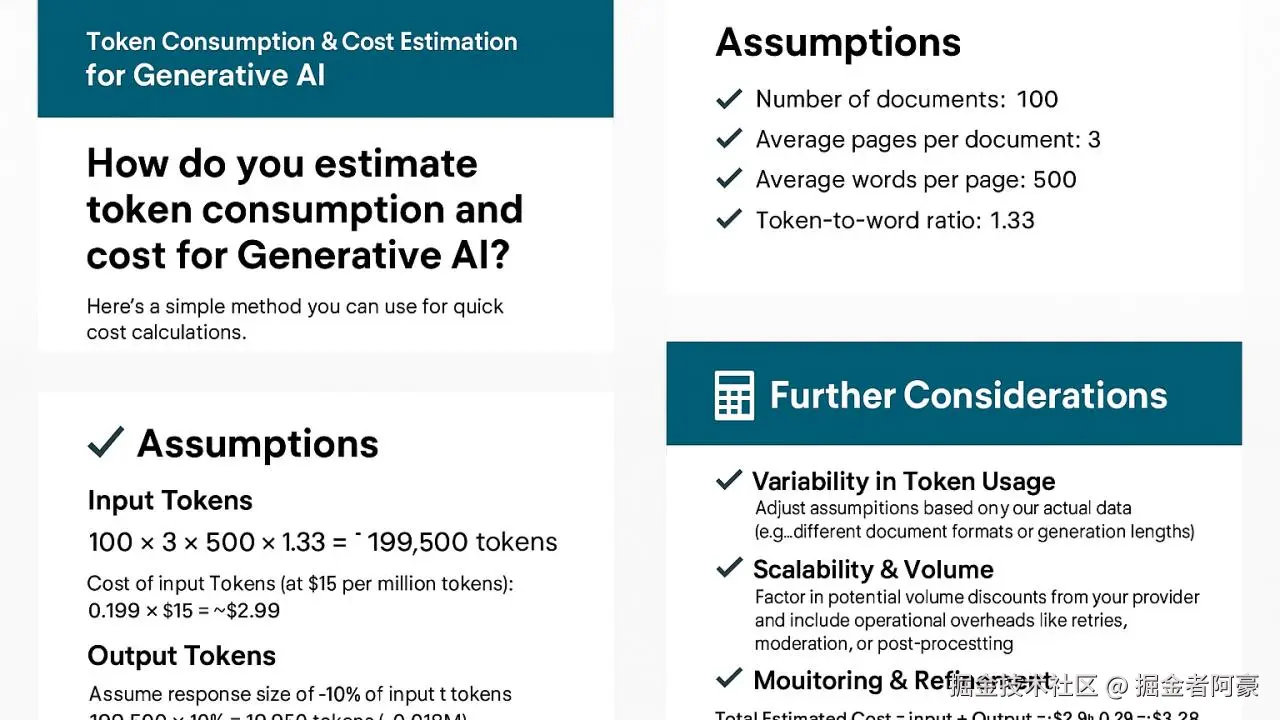

AI思考六、Token 成本到底是多少钱?

举个真实例子。

假设模型价格:

bash

输入

$2.5 / 1M tokens

bash

输出

$15 / 1M tokens💸 Token 成本计算图

如果一次请求:

25000 token成本:

bash

≈ $0.06听起来不多。

但如果一天:

yaml

1000次调用成本:

bash

$60

≈ 400 RMB一个月:

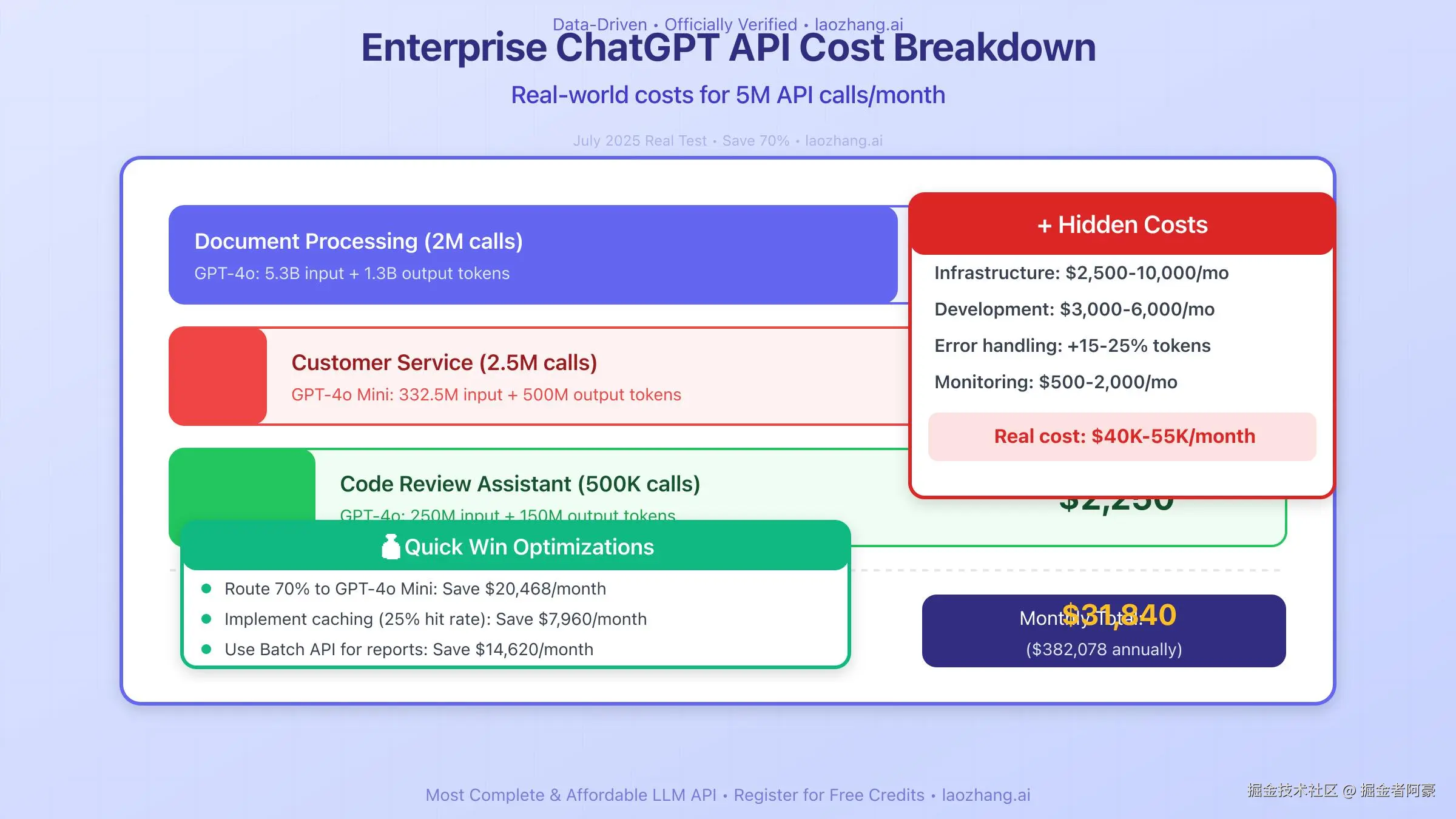

12000 RMB这就是很多公司做:

AI API 网关

的原因。

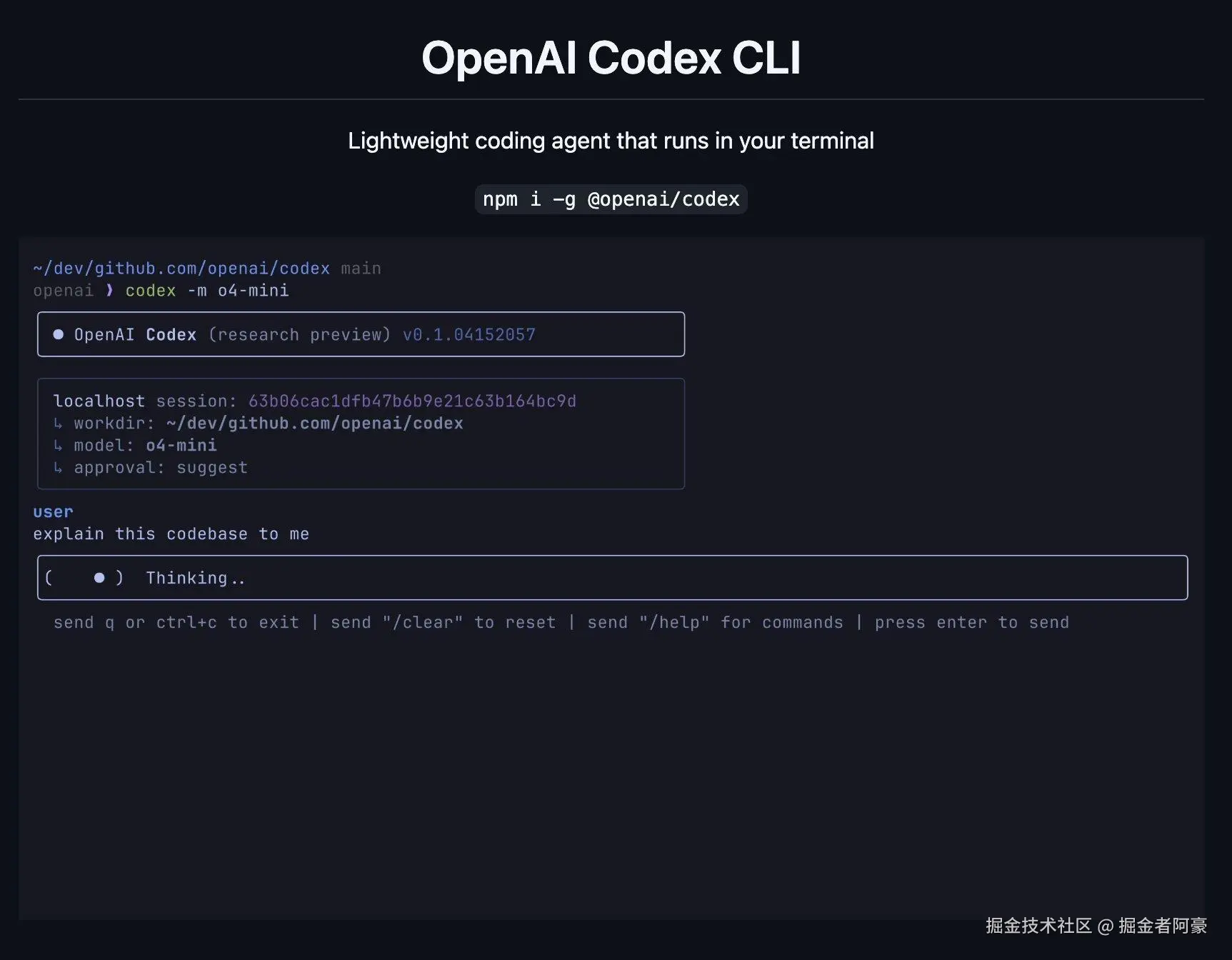

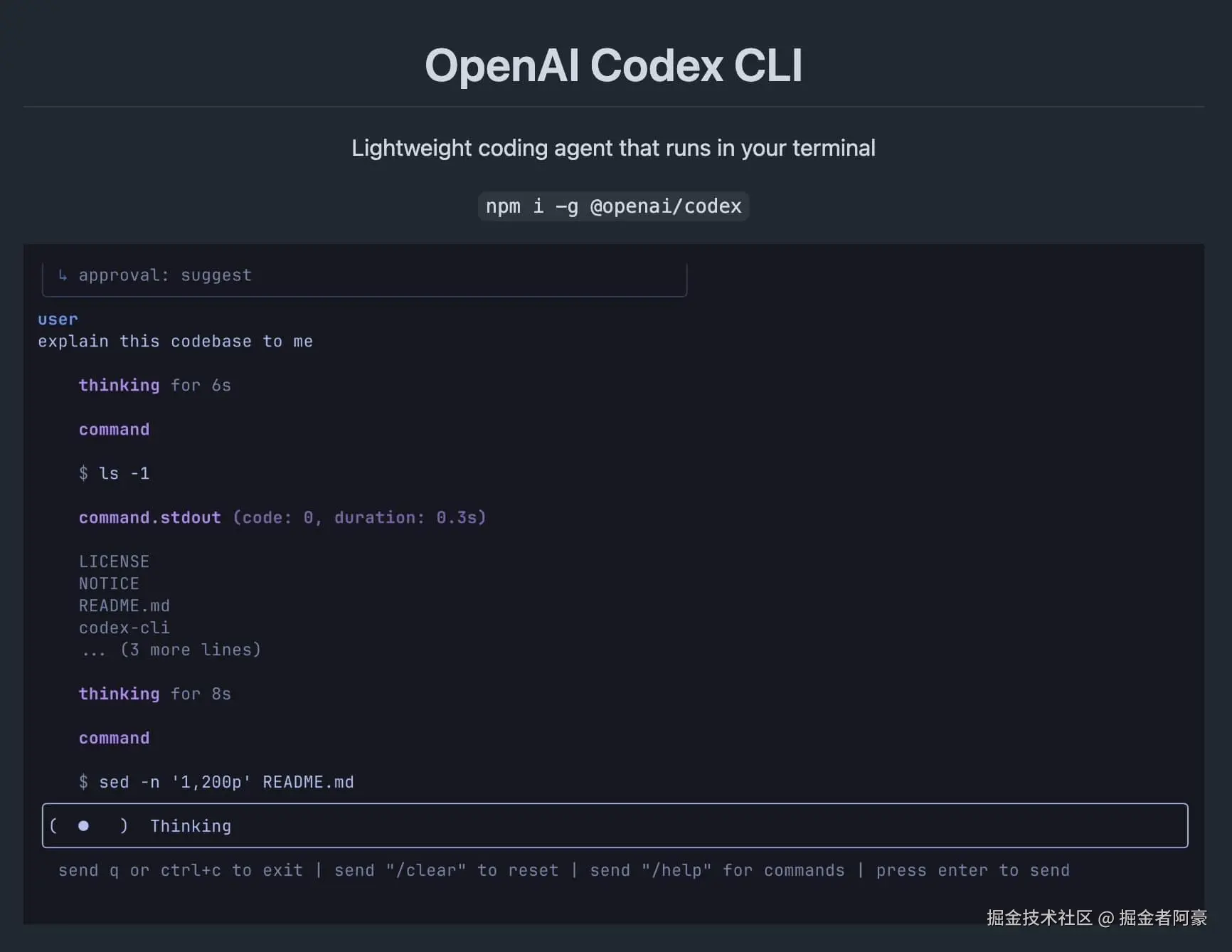

七、真实 Codex CLI 使用截图

很多开发者是通过 终端方式使用 Codex。

例如:

codex或者:

codex -m gpt-5.4🧾 Codex CLI 终端界面

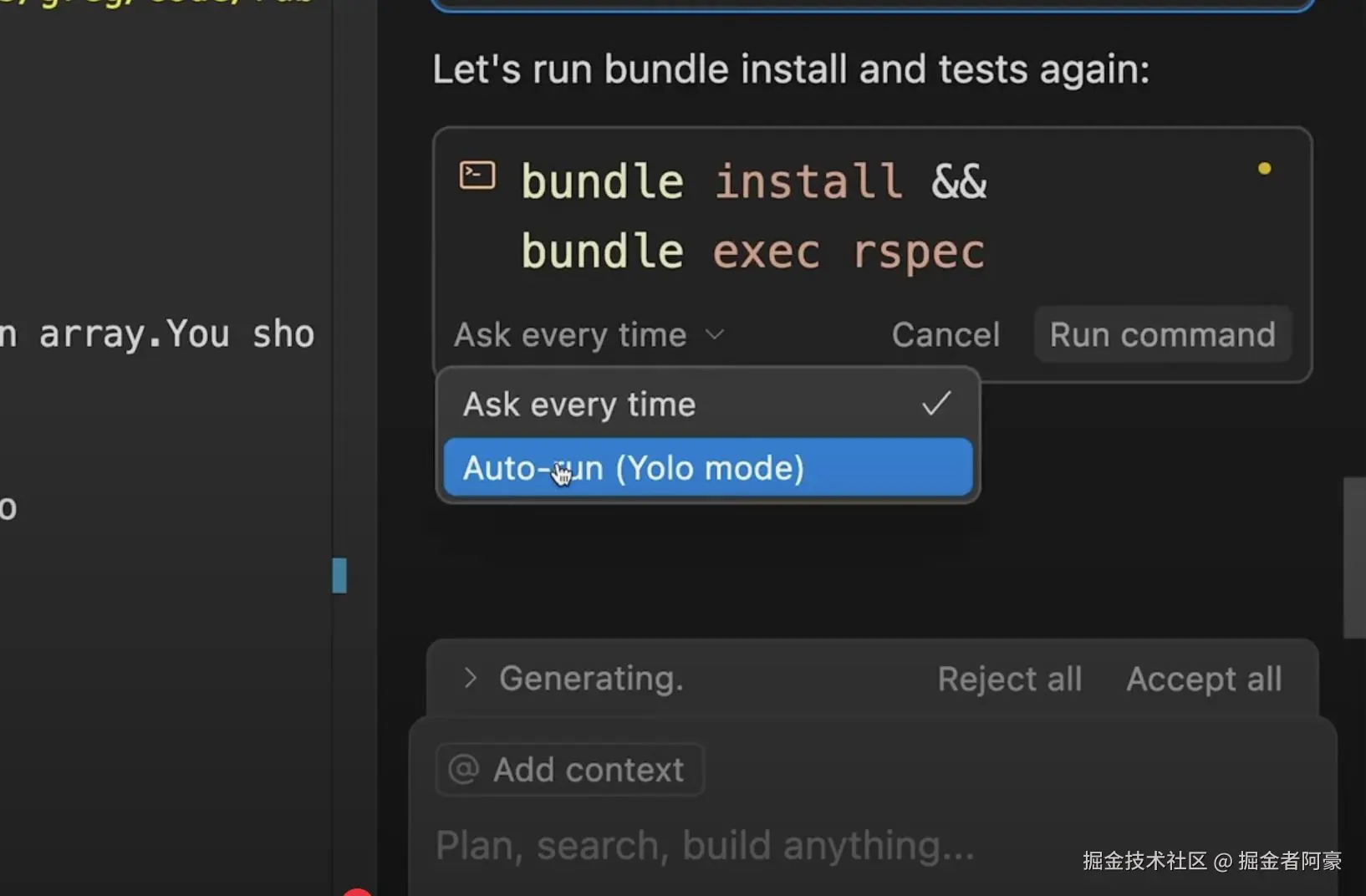

Codex CLI 的特点:

- 可以直接操作代码

- 自动读取 repo

- 自动执行任务

但同时也意味着:

Token消耗更快八、如何减少 Token 消耗?

这是很多开发者最关心的问题。

总结几个 非常有效的方法。

1 限制上下文

不要让 AI:

读取整个项目可以明确说:

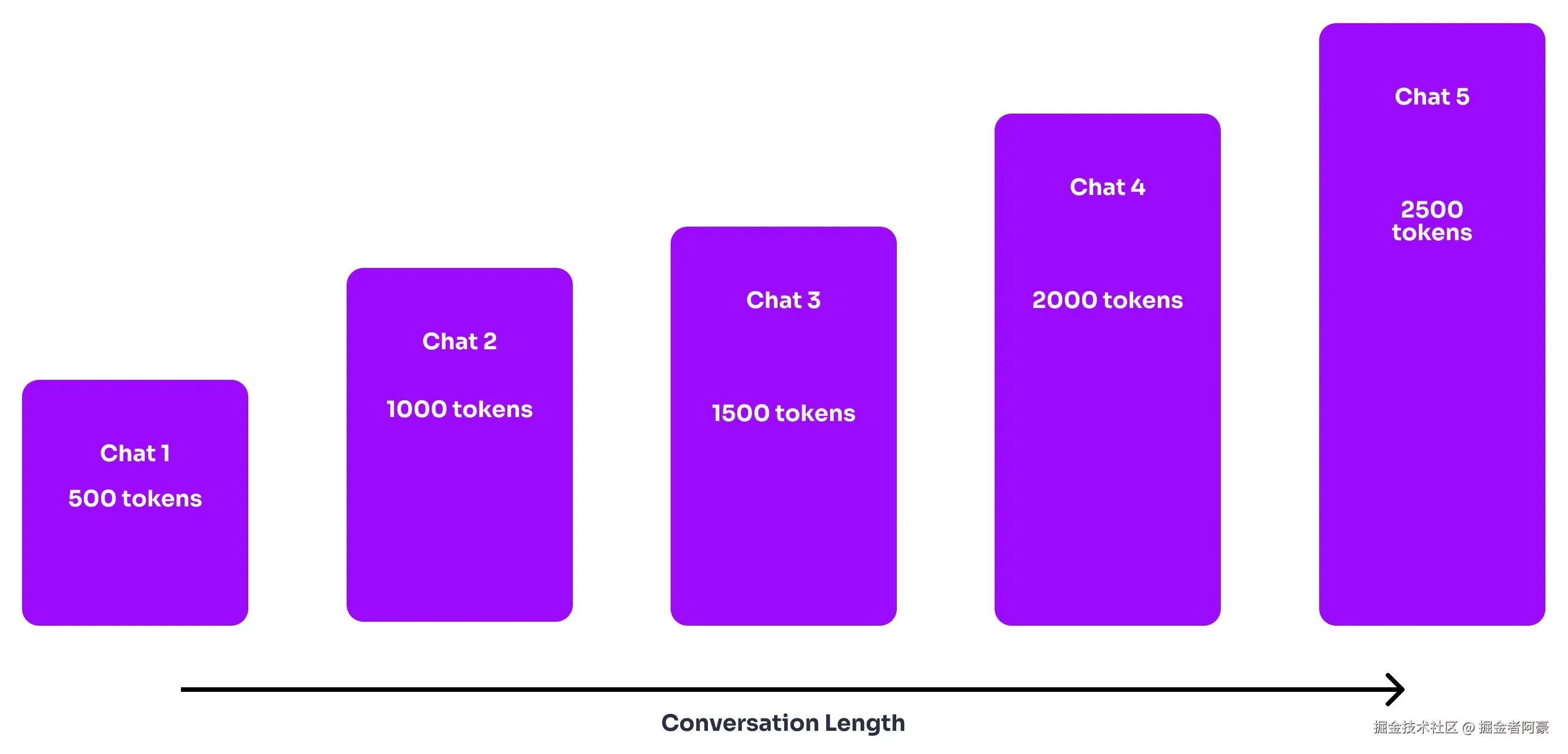

只修改这个函数2 控制对话长度

对话太长会导致:

上下文爆炸建议:

定期新建会话3 降低推理等级

很多 API 支持:

ini

reasoning = high建议:

scss

medium4 使用 Token Cache

很多平台支持:

cache tokens缓存 Token:

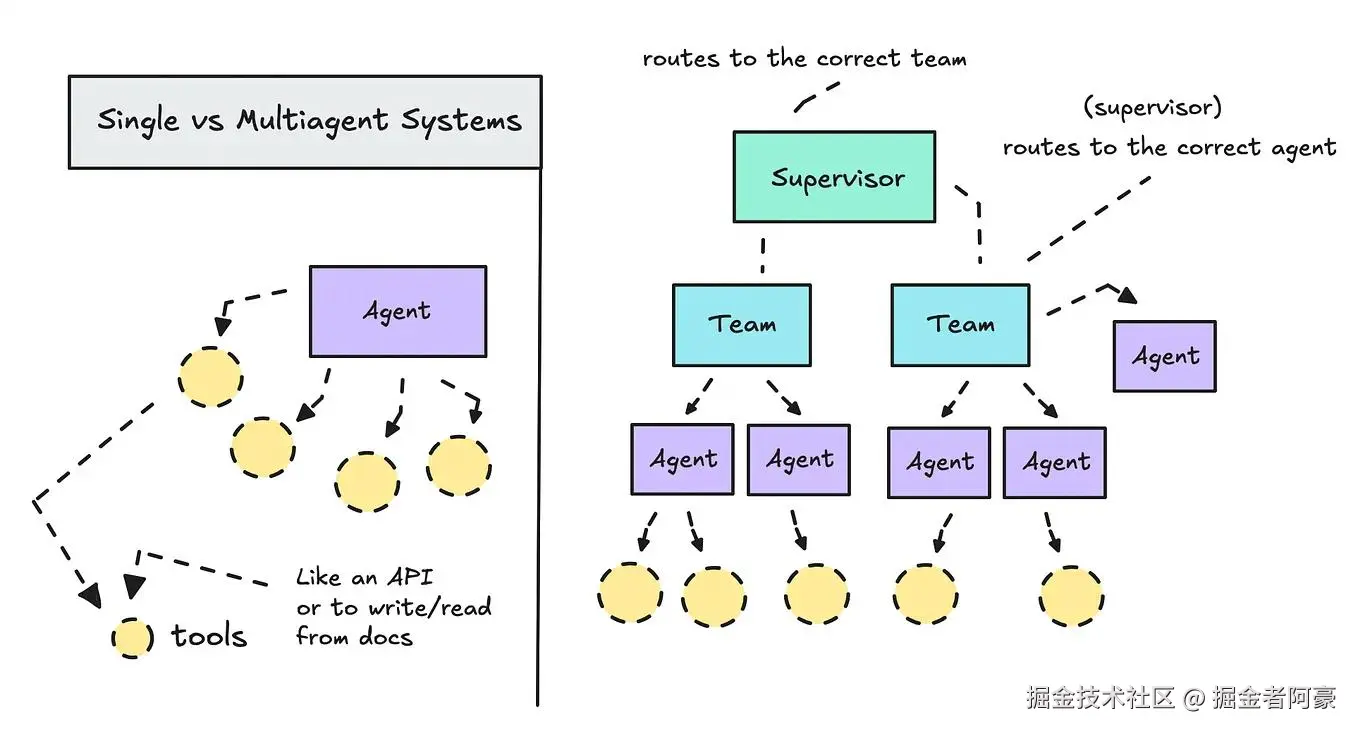

价格只有 1/105 做 AI API 网关

大型团队一般会做:

AI API Gateway功能:

- Token统计

- 成本控制

- 模型路由

- 限额管理

这也是我最近在做的:

AI API 聚合平台。

九、程序员必须接受的现实

AI 的本质其实是:

算力而不是软件。

Token 本质就是:

GPU时间所以:

ini

token = 钱是非常合理的。

结尾

当我第一次看到 Token 消耗统计的时候。

我的内心是这样的:

AI:帮你写代码

钱包:帮你流血但不得不承认。

AI 编程确实正在改变软件开发。

只是希望未来:

token再便宜一点否则程序员真的:

写代码写到破产。