引言

在当今互联网时代,用户对网络速度、安全性和可靠性的要求日益提高。一个网页的加载速度从几秒优化到几百毫秒,用户的留存率就能提升几十个百分点;一个 API 的响应时间从 100ms 优化到 50ms,系统的并发承载能力就能翻倍。这一切的背后,都离不开网络协议的持续优化。

本文将带你深入网络协议优化的世界,从传输层的 TCP 优化,到安全层的 TLS 加速,再到应用层的 HTTP/2 革命,最后探索基于 UDP 的 QUIC 协议这一未来方向。我们将通过大量的实际案例、详细的流程图和通俗易懂的比喻,让你彻底理解这些技术背后的原理与价值。

第一部分:传输层优化 ------TCP 协议的 "提速" 与 "控流"

1.1 传统 TCP 的痛点:为什么需要优化?

想象一下,你要和朋友打电话聊天:

传统场景:

- 拨号 → 等待对方接通(握手)

- "喂,听得到吗?"(确认)

- "听得到"(再确认)

- 开始说话(传输数据)

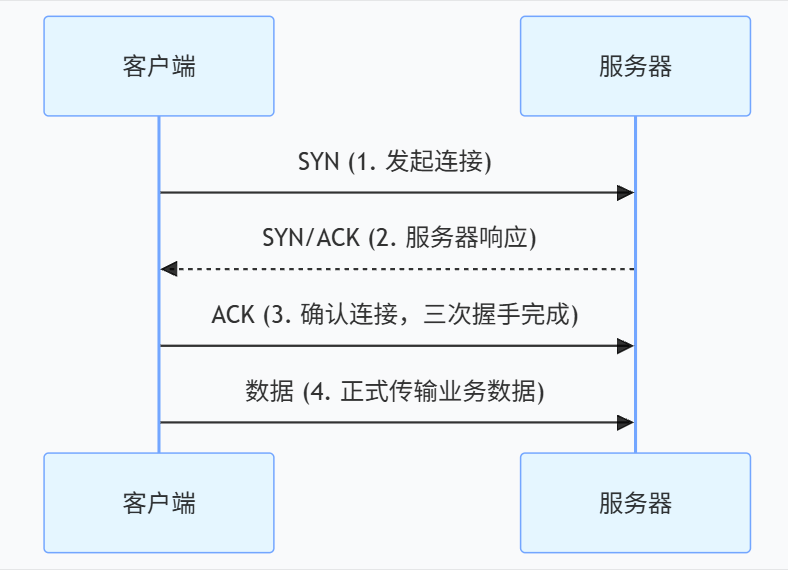

这个过程中的每一步都需要等待对方的回应,这就是 TCP 的 "三次握手"。在网络环境中,每次等待称为一个 "往返时延"(Round Trip Time, RTT)。

现实问题:

- 在光纤网络中,一个 RTT 可能只有 10ms

- 在移动 4G 网络中,一个 RTT 可能达到 50-100ms

- 在跨国网络中,一个 RTT 可能高达 200-500ms

如果每次建立连接都要等待 3 个 RTT,那么在移动网络下,仅仅建立连接就要花费 150-300ms,这对于追求 "秒开" 体验的用户来说是无法接受的。

1.2 TCP Fast Open (TFO):让连接建立快一步

痛点分析

传统的 TCP 连接建立流程:

时间成本:3 个 RTT(第 1、2、3 步各 1 个 RTT)

TFO 解决方案

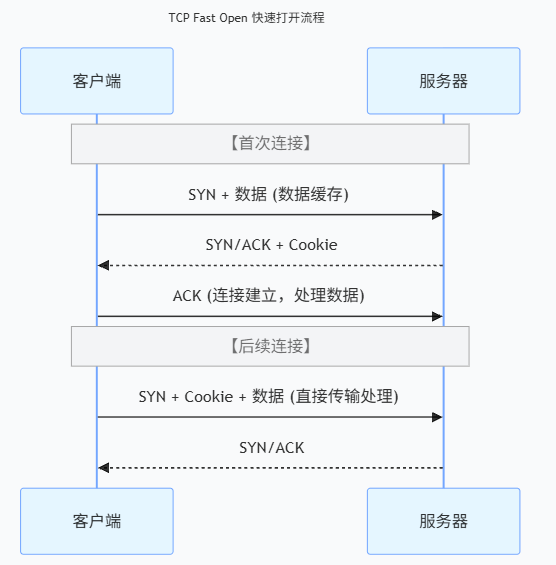

TCP Fast Open 允许在第一次握手时就携带数据:

关键技术点:

-

Cookie 机制:

- 首次连接时,服务器生成一个加密 Cookie 返回给客户端

- Cookie 包含:客户端 IP、时间戳、加密签名

- 服务器通过验证 Cookie 确保请求来源合法

-

数据提前发送:

- 客户端在 SYN 包中携带 HTTP 请求数据

- 服务器验证 Cookie 通过后,立即处理数据

- 不等待三次握手完成

性能提升:

- 首次连接:3 个 RTT(与传统相同)

- 后续连接:1 个 RTT(减少 2 个 RTT)

- 在移动网络下,可节省 100-200ms 的延迟

实际案例

场景:用户打开新闻 APP

优化前:

- TCP 握手:150ms

- TLS 握手:200ms

- 首屏加载:300ms

- 总计:650ms

优化后(使用 TFO):

- TCP+TLS 握手:150ms

- 首屏加载:300ms

- 总计:450ms

提升:30% 的加载时间减少

第二部分:安全层优化 ------TLS/HTTPS 的 "减负"

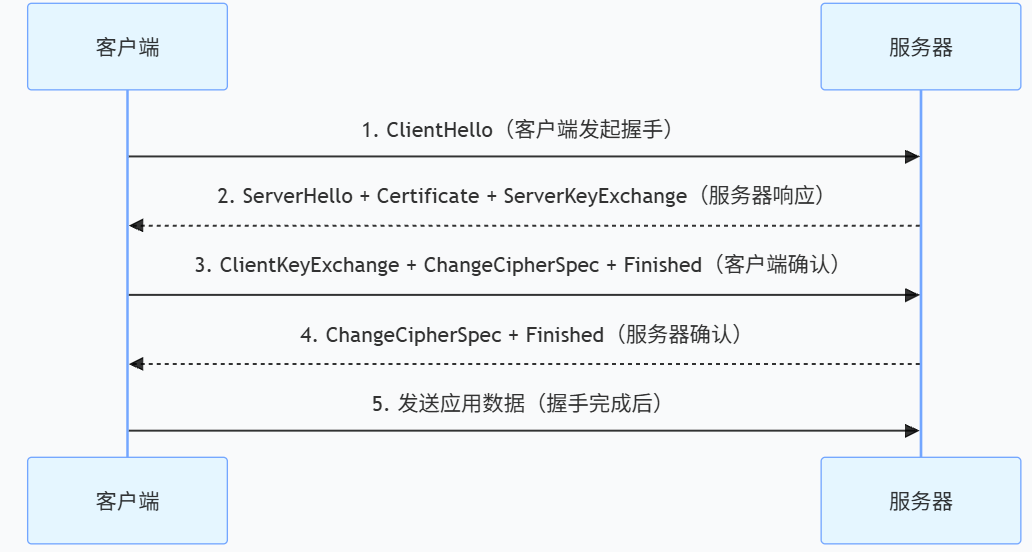

2.1 HTTPS 的痛点:安全但慢

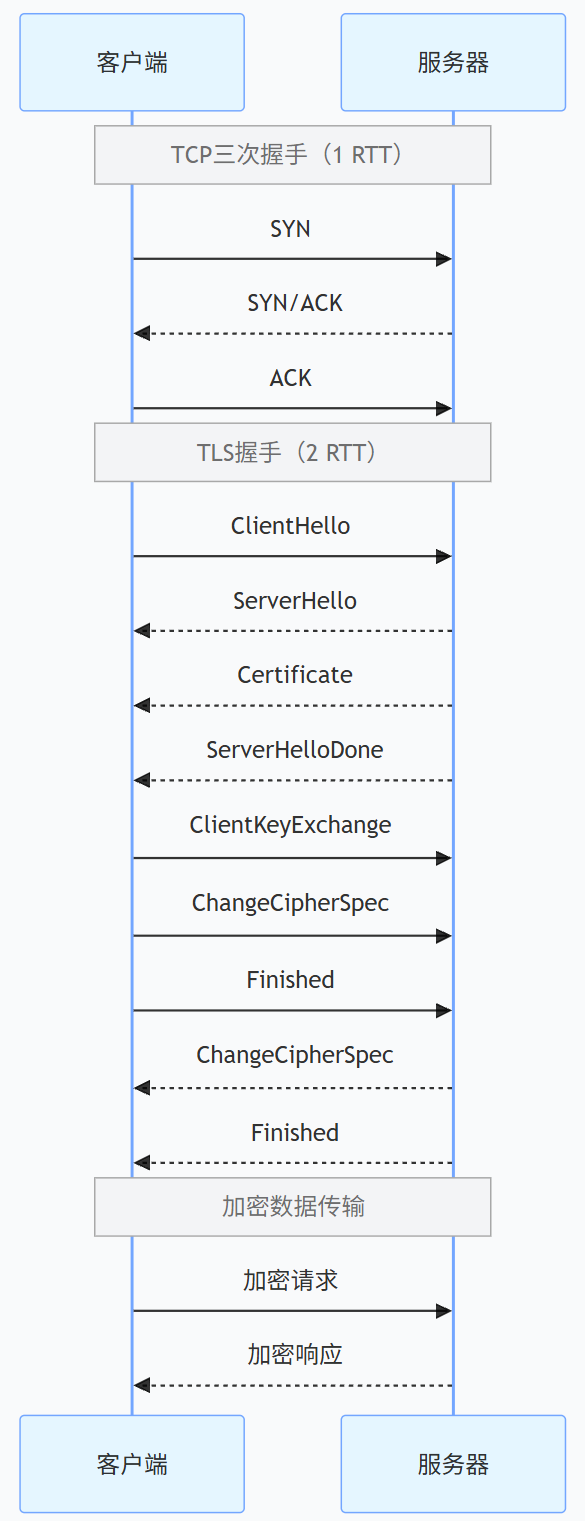

传统 HTTPS 连接流程

时间成本:

- TCP 握手:1 RTT

- TLS 握手:2 RTT

- 总计:3 RTT

在移动网络下的实际时间:

- 3 RTT × 100ms/RTT = 300ms

- 仅握手就要 300ms,用户等得焦急

为什么需要这么多 RTT?

- TCP 握手:建立可靠的传输通道

- TLS 握手 :

- 第 1 个 RTT:协商加密算法、交换证书

- 第 2 个 RTT:交换密钥、验证身份

类比 :

就像你要和一个陌生人谈生意:

- 先打电话建立联系(TCP 握手)

- 见面,交换名片(ClientHello/ServerHello)

- 验证对方身份(Certificate)

- 商定加密通话方式(密钥交换)

- 开始谈生意(数据传输)

每一步都要等对方回应,时间都花在 "等待" 上。

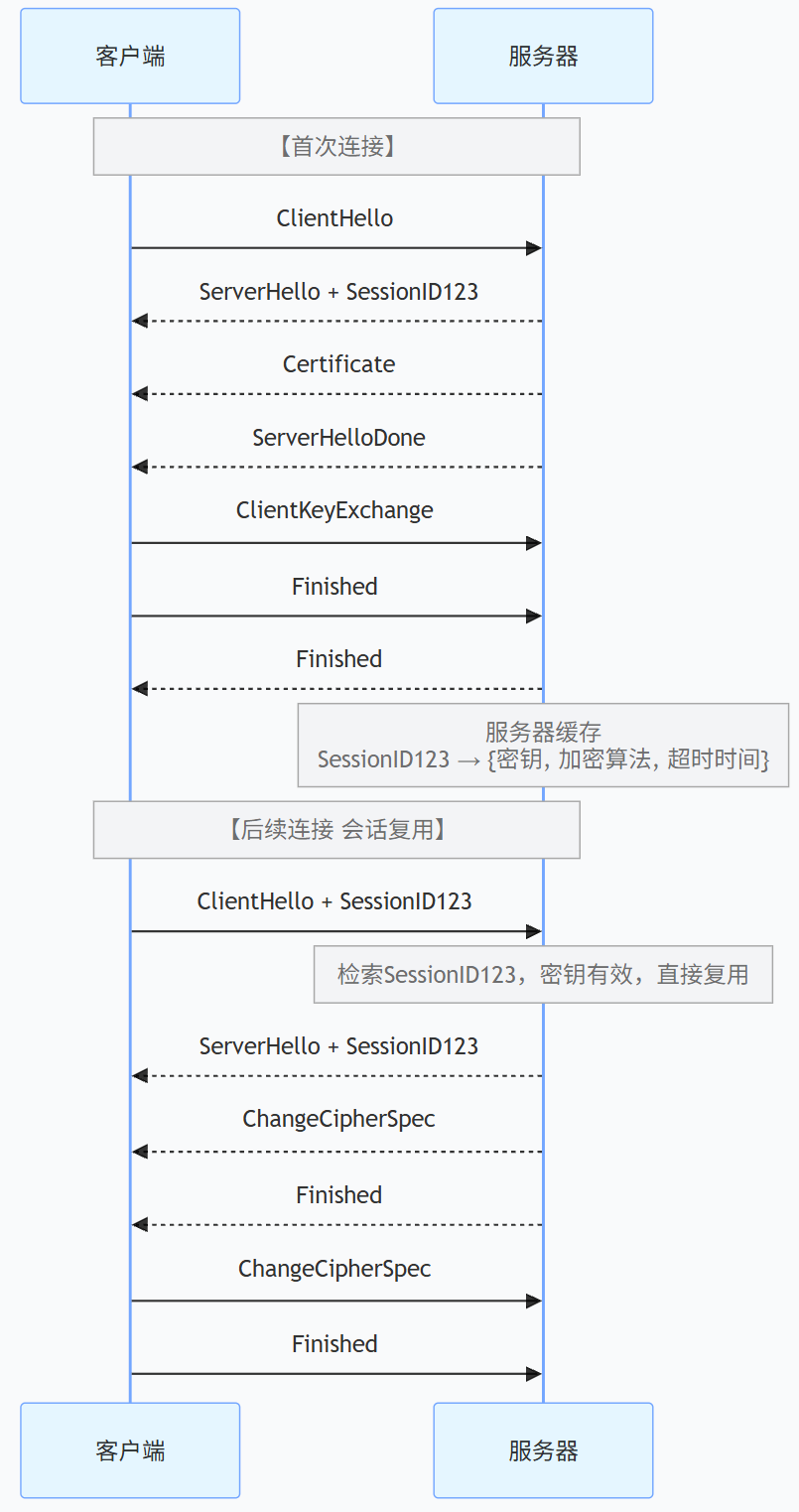

2.2 Session Resumption:会话复用

核心思想

问题:如果每次连接都要走完整的 TLS 握手,那也太慢了

解决方案:第一次建立连接后,记住双方商定的密钥,下次连接直接用

方案一:Session ID

性能提升:

- 减少 1 个 RTT

- 减少 CPU 计算(无需重新生成密钥)

- 减少网络流量(无需交换证书)

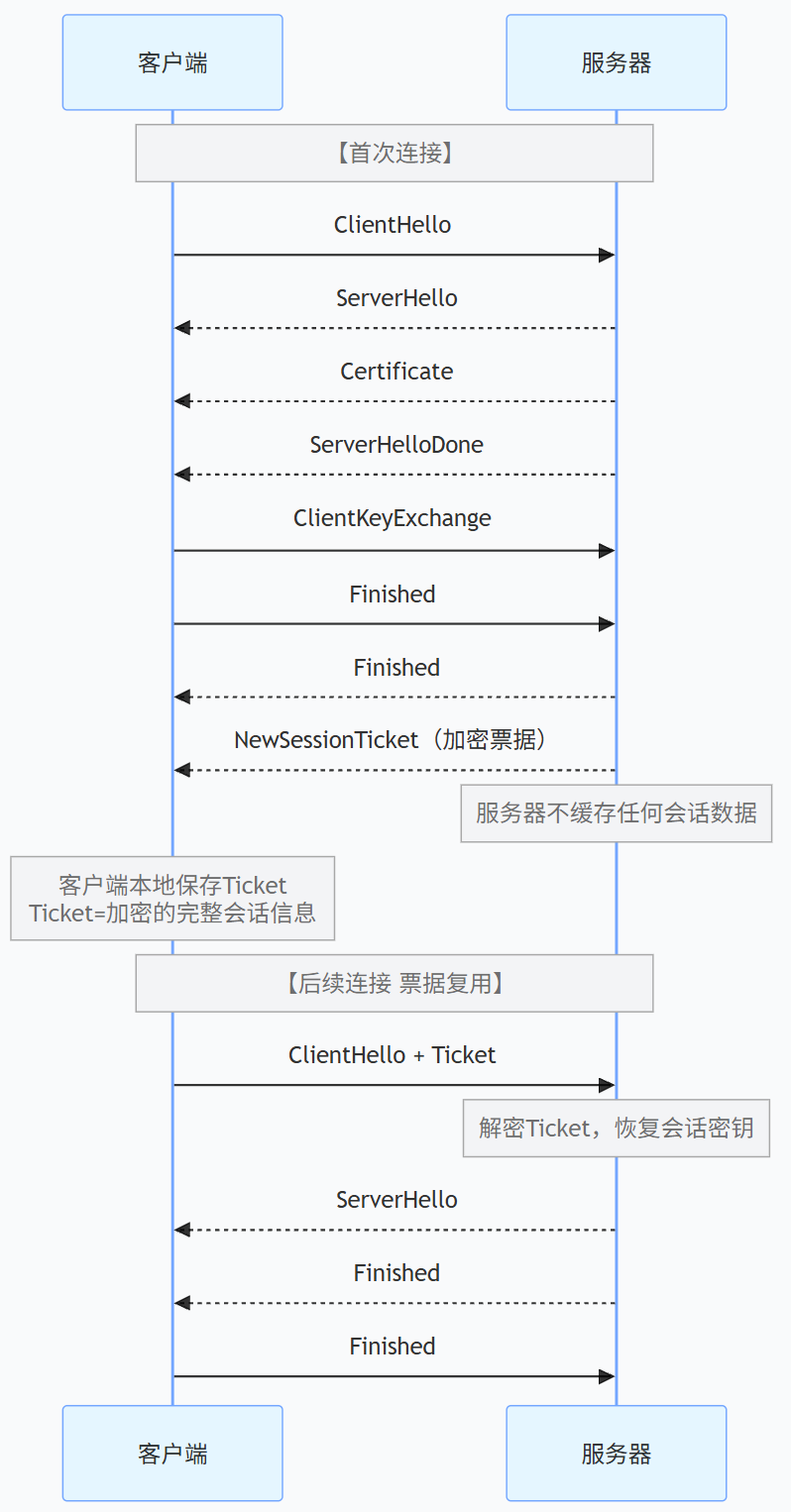

方案二:Session Ticket

Session ID 有一个问题:服务器需要在内存中保存所有会话信息。

问题场景:

- 10 万用户同时访问

- 每个用户保存 1KB 的会话信息

- 服务器需要 100MB 内存

- 如果服务器重启,所有会话信息丢失

Session Ticket 解决方案:

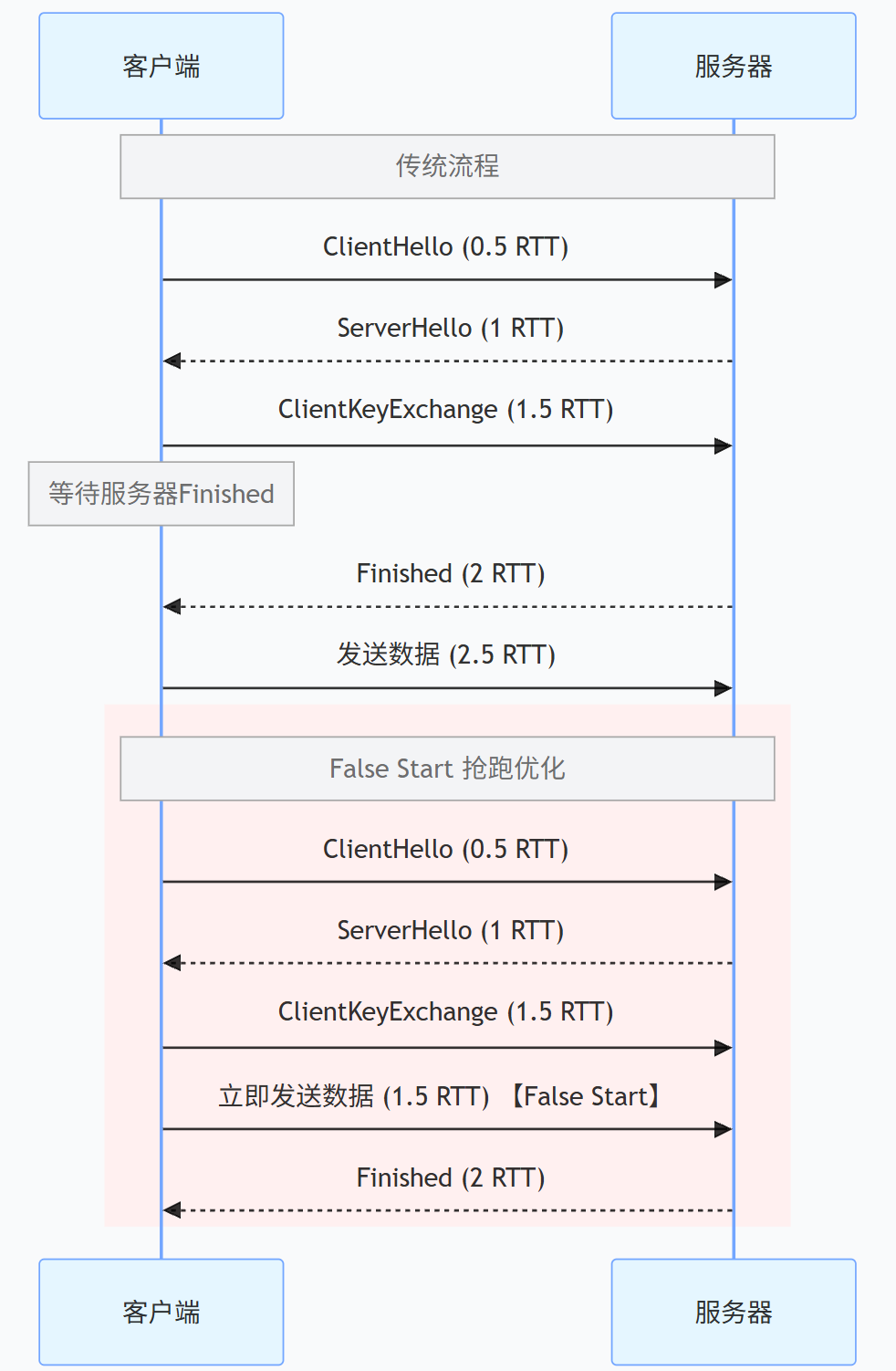

2.3 False Start:抢跑技术

核心思想

传统流程中,客户端必须等握手完全完成后才能发送数据。

False Start:客户端在发送完密钥交换消息后,不等服务器确认,就直接发送加密的应用数据。

节省时间:0.5 RTT

为什么可以抢跑?

- 客户端已经拿到了服务器证书

- 客户端已经生成了会话密钥

- 客户端可以开始加密数据

- 即使后续验证失败,也只是浪费了这次请求

风险:

- 如果服务器证书无效,客户端会收到错误

- 客户端发送的数据可能被丢弃

- 但这只是 "提前发送",不影响安全性

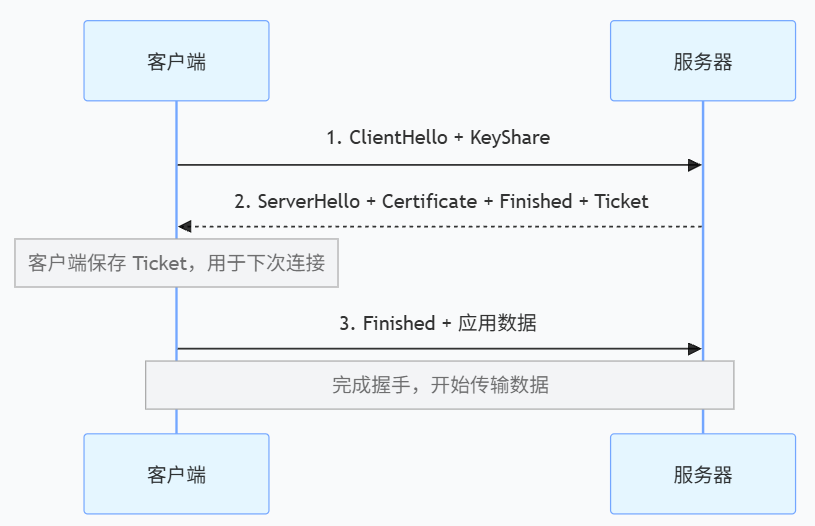

2.4 TLS 1.3:终极进化

TLS 1.3 是目前最安全、最快的 TLS 协议版本。

核心改进

1. 简化握手流程

改为:

关键改进:

- 删除了不安全的密钥交换算法

- 删除了 ChangeCipherSpec 消息

- 服务器在 ServerHello 中直接发送 Finished

- 只需要 1 个 RTT 完成握手

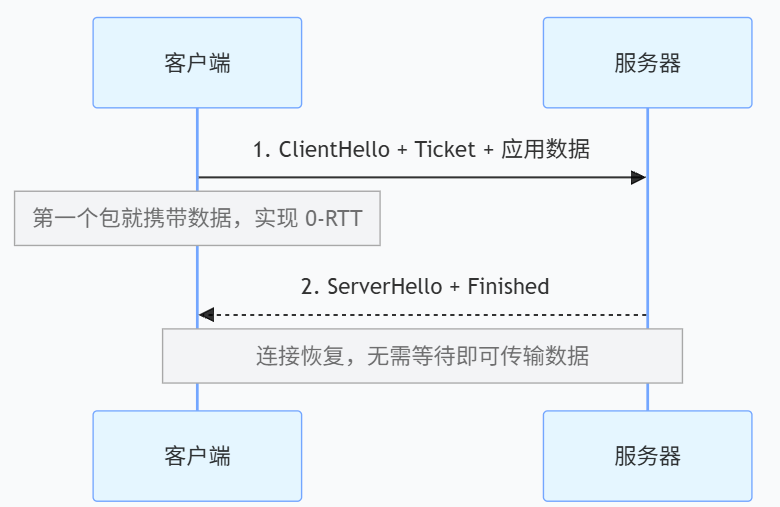

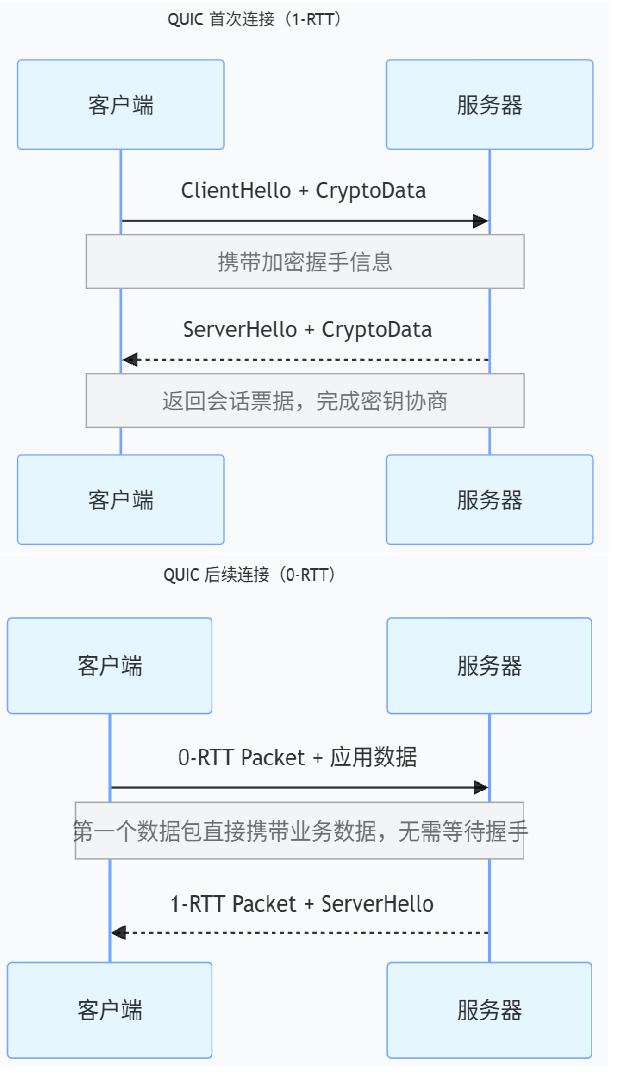

2. 0-RTT 连接恢复

如果之前建立过连接,可以实现 0-RTT:

服务器返回 Ticket:客户端保存 Ticket,下次连接时使用。

后续连接(0-RTT)

使用场景:

- 移动 APP 启动后立即请求数据

- 用户点击链接后立即跳转

- 需要极致首屏加载速度的场景

第三部分:应用层革命 ------HTTP/2.0

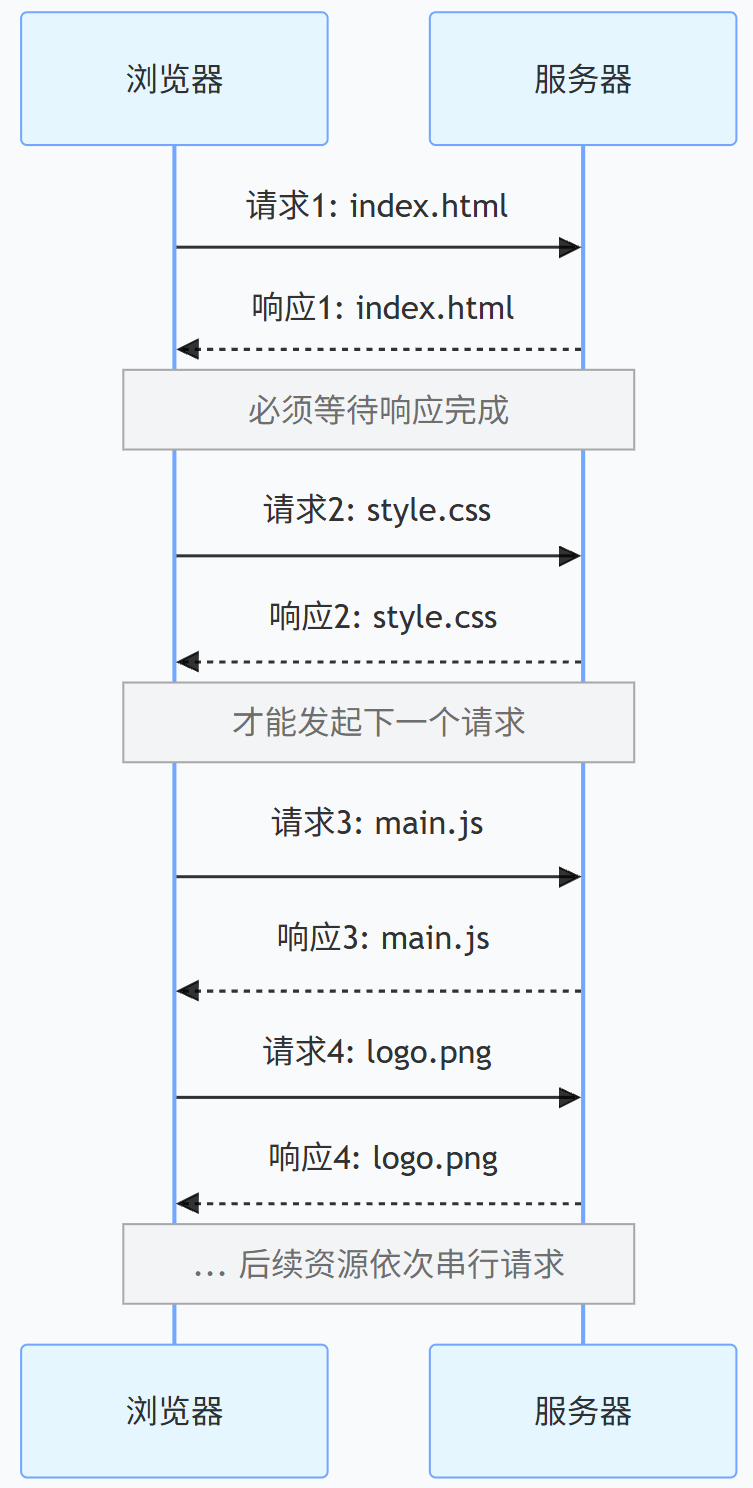

3.1 HTTP/1.1 的痛点:队头阻塞

痛点场景

用户访问一个网页,需要加载:

- 1 个 HTML 文件

- 3 个 CSS 文件

- 5 个 JavaScript 文件

- 10 张图片

- 总共 19 个资源

HTTP/1.1 的问题:

队头阻塞(Head-of-Line Blocking):

- 必须等前一个请求完成,才能发送下一个

- 如果 index.html 加载慢,后面的 CSS、JS 都要等

- 页面渲染延迟

早期解决方案:

- 开启多个 TCP 连接(如 6 个连接并发)

- 但这带来新问题:

- 每个连接都要 TCP 握手

- 占用服务器资源

- 拥塞控制更复杂

3.2 HTTP/2.0 的核心特性

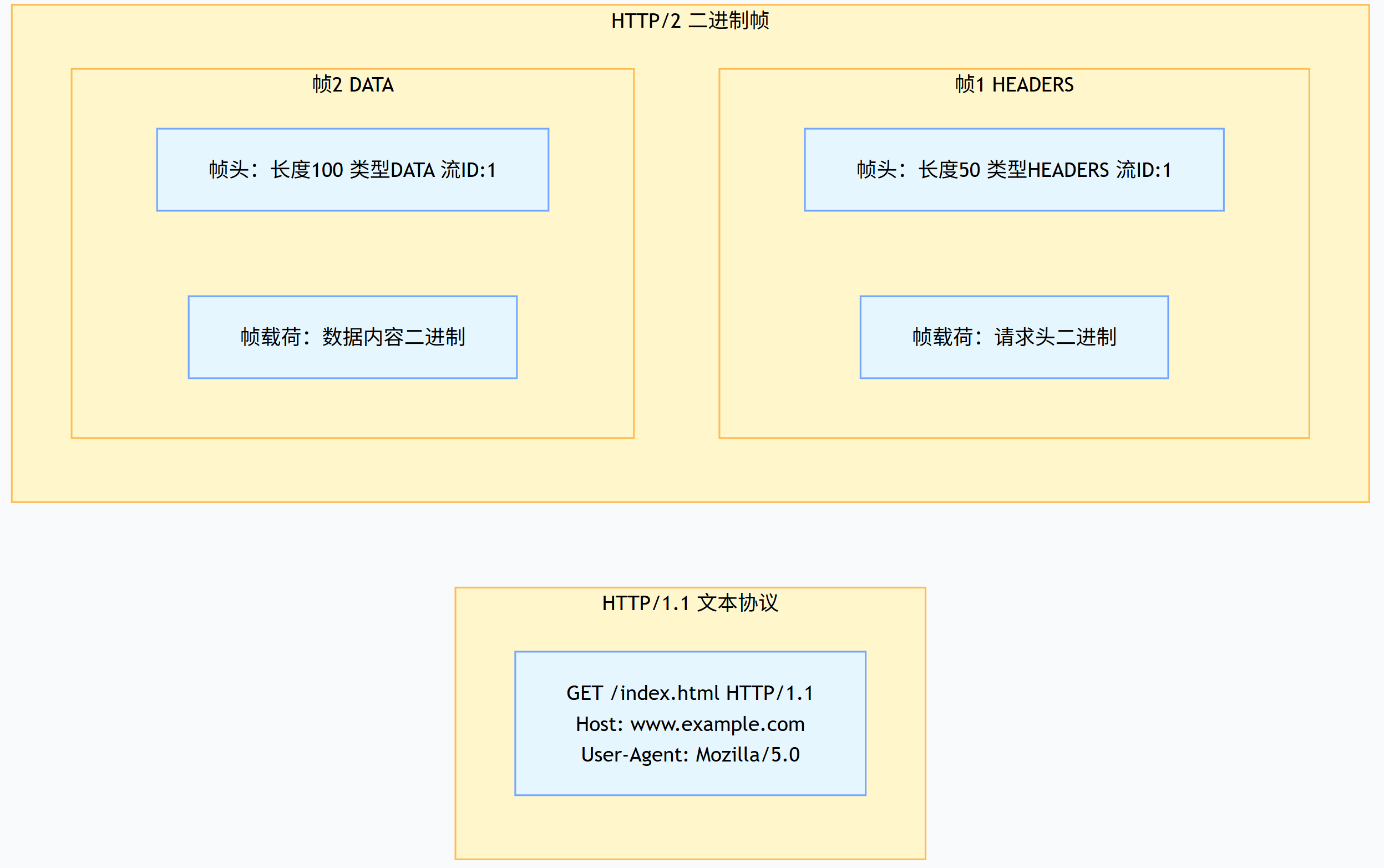

特性 1:二进制分帧(Binary Framing)

HTTP/1.1 使用纯文本传输,HTTP/2 使用二进制帧。

帧的类型:

- DATA:实际数据

- HEADERS:请求头 / 响应头

- PRIORITY:优先级

- RST_STREAM:流终止

- SETTINGS:连接设置

- PUSH_PROMISE:服务器推送承诺

为什么用二进制?

- 解析更快(无需处理文本)

- 更安全(不易混淆)

- 更紧凑(占空间小)

- 便于扩展(新增帧类型)

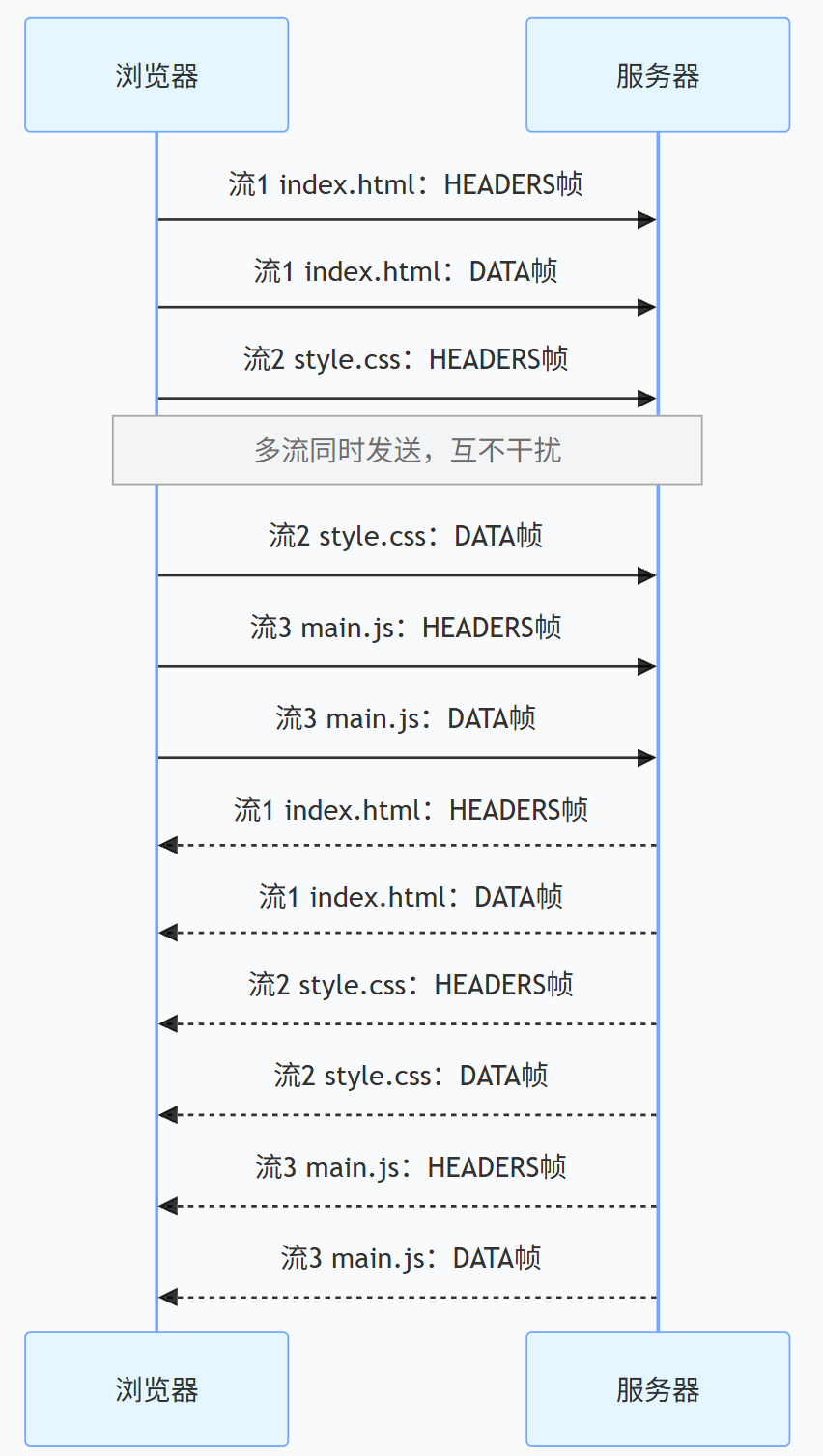

特性 2:多路复用(Multiplexing)

这是 HTTP/2 最重要的特性!

核心思想:

- 一个 TCP 连接可以承载多个流(Stream)

- 每个流用唯一的 Stream ID 标识

- 帧可以交错发送

- 接收端根据 Stream ID 重新组装

优势:

- 解决队头阻塞

- 减少 TCP 连接数(1 个连接就够了)

- 更好的资源利用率

- 服务器压力更小

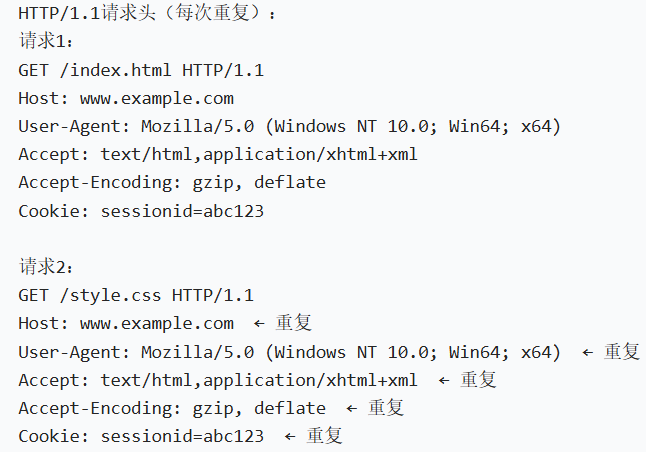

特性 3:首部压缩(HPACK)

HTTP 请求头往往包含大量重复信息:

问题:

- 每个请求都发送相同的头部

- 浪费带宽

- 增加延迟

HPACK 压缩方案:

压缩效果:

- 重复头部只发送一次索引

- 压缩率可达 80-90%

- 显著减少带宽消耗

Huffman 编码:

- 对头部值进行 Huffman 编码

- 进一步压缩数据量

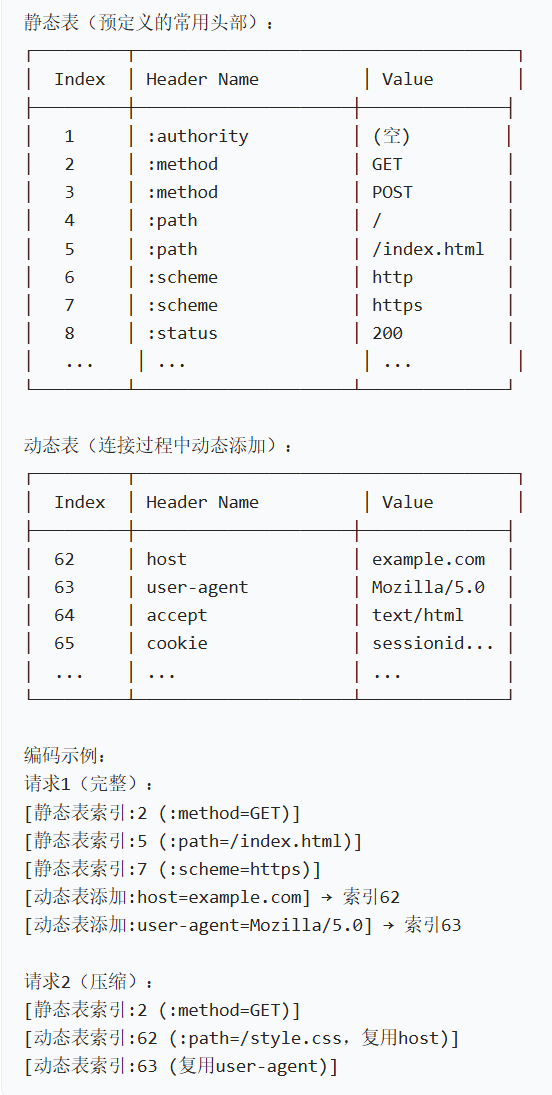

特性 4:服务器推送(Server Push)

服务器可以 "预判" 客户端需求,主动推送资源。

优势:

- 减少往返次数

- 提前加载资源

- 更快的首屏渲染

注意:

- 服务器不能随意推送,要预判客户端需求

- 客户端可以拒绝推送(RST_STREAM)

- 不是所有场景都适合(如大文件)

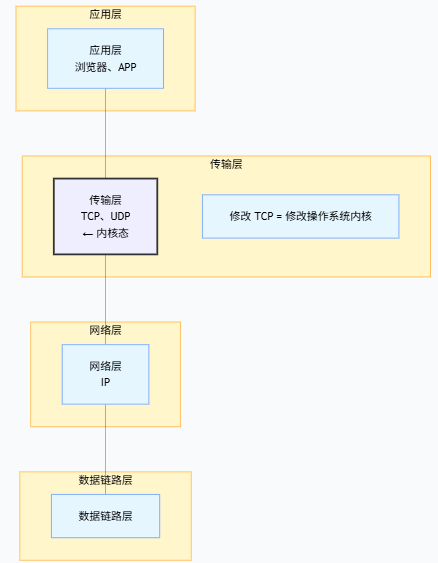

第四部分:未来传输协议 ------QUIC

4.1 为什么需要 QUIC?

TCP 的局限性

TCP 作为互联网基石,有很多优点,但也有难以克服的缺点:

问题 1:内核级别,升级困难

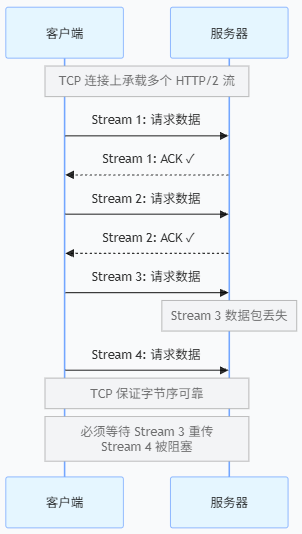

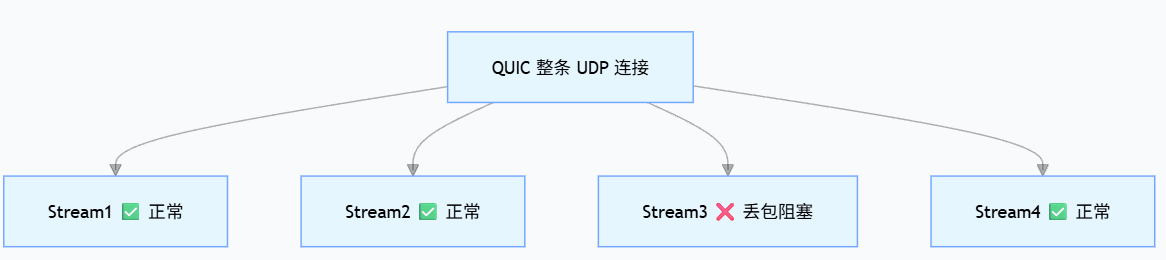

问题 2:TCP 队头阻塞

即使 HTTP/2 实现了应用层多路复用,TCP 层的丢包仍然会导致所有流被阻塞。

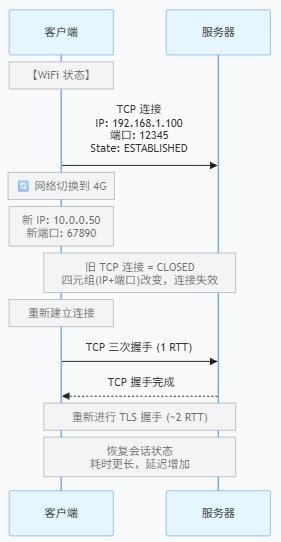

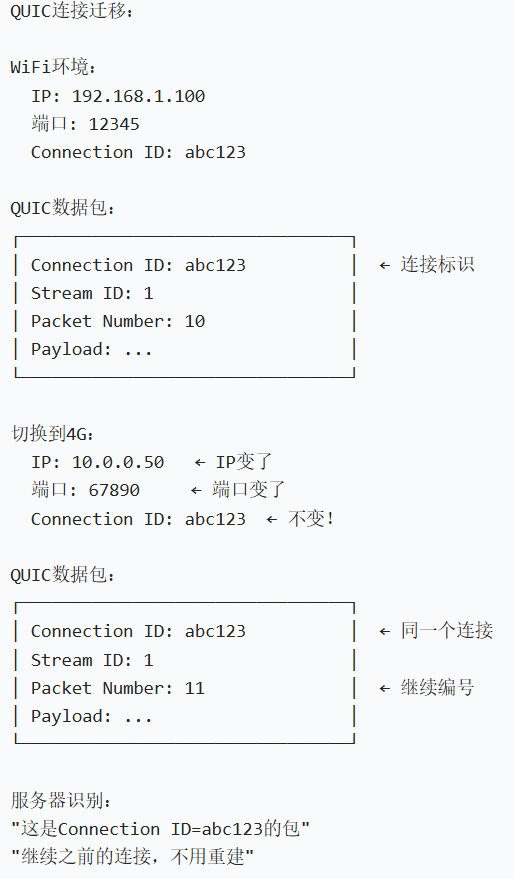

问题 3:连接迁移困难

问题 4:移动网络性能差

移动网络特点:

- 丢包率高(5-10%)

- 延迟波动大

- 带宽不稳定

TCP 在丢包场景下:

- 触发拥塞控制

- 窗口减半

- 吞吐量骤降

4.2 QUIC 的设计哲学

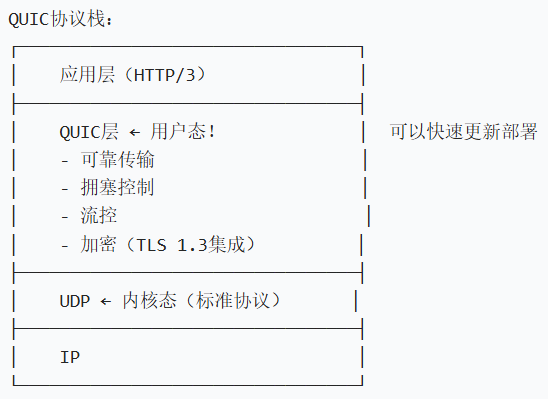

QUIC(Quick UDP Internet Connections)基于 UDP,在用户态实现了可靠的传输协议。

核心优势:

- 用户态实现,易于更新

- 无 TCP 队头阻塞

- 连接迁移友好

- 0-RTT 连接建立

- 集成 TLS 1.3

4.3 QUIC 的核心特性

特性 1:0-RTT 连接建立

优势:

- 真正的 0 延迟(第一个包就带数据)

- 比 HTTP/2 + TLS 1.2 快 2 个 RTT

- 比 TLS 1.3 的 0-RTT 更灵活

特性 2:无队头阻塞

QUIC 实现了类似 HTTP/2 的多路复用,但在 UDP 层面,避免了 TCP 的队头阻塞。

核心机制:

- 每个 Stream 有独立的序列号

- 丢包只影响对应的 Stream

- 其他 Stream 继续传输

特性 3:连接迁移

QUIC 使用 Connection ID 标识连接,而不是 IP 地址 + 端口。

优势:

- WiFi↔4G 切换无缝

- 移动网络中 IP 地址变化不影响

- NAT 超时也不影响

第五部分:Session 管理架构演进

5.1 问题背景

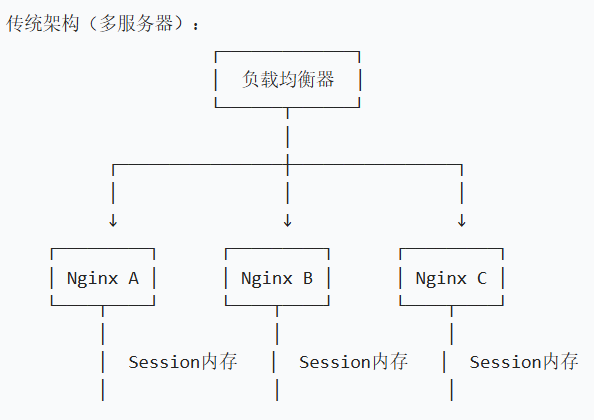

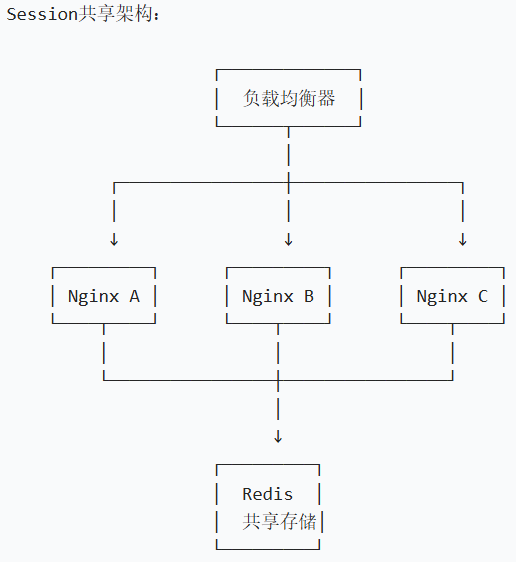

在 HTTPS 会话复用的章节中,我们介绍了 Session ID 和 Session Ticket。但在大规模集群环境中,如何实现 Session 复用?

问题:

- Nginx A、B、C 各自维护 Session

- 用户第一次访问 Nginx A,Session 存在 A 的内存

- 用户第二次访问被分发到 Nginx B,B 没有这个 Session

- 无法复用,需要重新握手

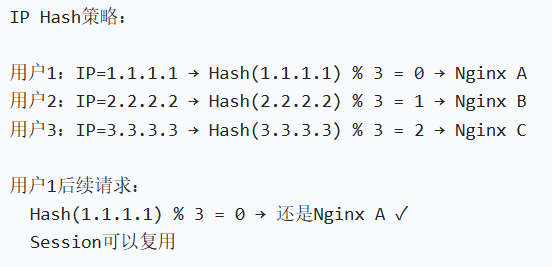

5.2 方案对比

方案一:IP Hash(固定分发)

优点:

- 实现简单

- Session 可以复用

缺点:

- 负载不均衡(如果某些 IP 访问频繁)

- NAT 环境下失效(多个用户同一个 IP)

- 服务器故障后,该 IP 的用户都无法访问

方案二:Session 共享(Redis)

第六部分:DNS 协议优化 ------ 互联网加速的 "第一公里"

6.1 DNS 解析的痛苦过程

DNS(Domain Name System)是互联网的 "电话簿",负责将域名解析为 IP 地址。

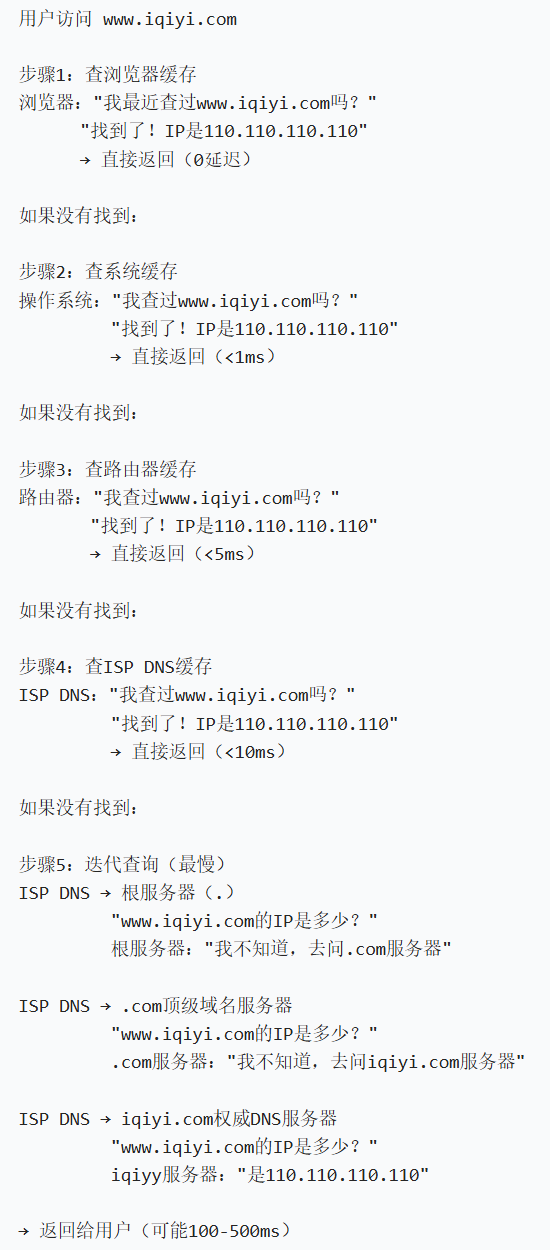

标准 DNS 解析流程

时间成本:

- 缓存命中:0-10ms

- 缓存未命中:100-500ms

6.2 通用 DNS 优化手段

优化 1:利用缓存

浏览器缓存:

DNS记录缓存策略:

TTL(Time To Live):

- 浏览器缓存:60-300秒

- 操作系统缓存:300-3600秒

- ISP DNS缓存:3600-86400秒

- 权威DNS:由管理员设置

为什么有TTL?

- DNS记录可能会变化(服务器IP变更)

- TTL过期后必须重新查询

- 平衡性能和时效性实际案例:

场景:用户浏览网页

9:00:00 - 访问 www.iqiyi.com

→ DNS解析,耗时200ms

→ 浏览器缓存IP,TTL=300秒

9:00:05 - 刷新页面

→ 浏览器命中缓存

→ 耗时0ms

9:02:00 - 再次访问

→ 缓存未过期(<300秒)

→ 耗时0ms

9:05:01 - 再次访问

→ 缓存已过期(>300秒)

→ 重新DNS解析,耗时200ms优化 2:DNS 预解析(Prefetch)

原理:浏览器在解析 HTML 时,提前解析页面中所有链接的域名。

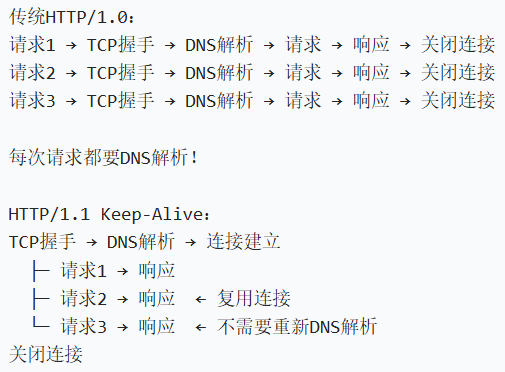

优化 3:长连接

HTTP/1.1 Keep-Alive:

优势:

- 减少 DNS 解析次数

- 减少 TCP 握手次数

- 提升性能

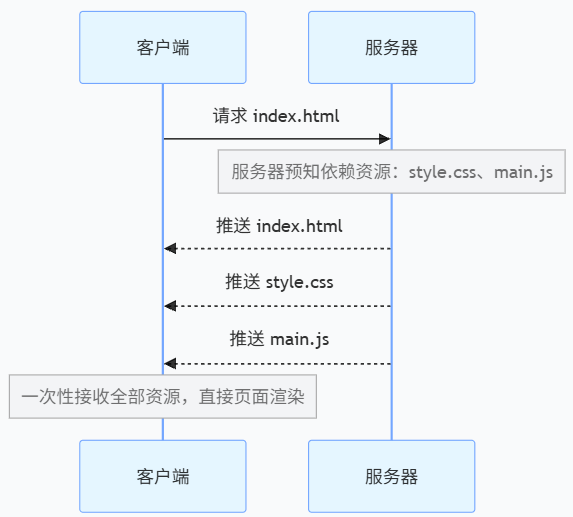

第七部分:内核态 vs 用户态 ------ 协议部署的哲学差异

7.1 操作系统的内存空间

内存空间划分:

┌─────────────────────────────────────┐

│ 用户空间(User Space) │

│ ├─ 应用程序(浏览器、Web服务器) │

│ ├─ 用户态协议栈(如QUIC) │

│ └─ 数据(堆、栈) │

├─────────────────────────────────────┤

│ 内核空间(Kernel Space) │

│ ├─ 操作系统内核 │

│ ├─ 内核协议栈(TCP、UDP) │

│ ├─ 设备驱动 │

│ └─ 硬件管理 │

├─────────────────────────────────────┤

│ 硬件(CPU、内存、网卡) │

└─────────────────────────────────────┘

关键区别:

- 用户空间:应用程序运行的地方,权限受限

- 内核空间:操作系统核心,拥有最高权限7.2 为什么 TCP 在内核态?

TCP 需要的特权操作

1. 直接访问硬件

网络数据包接收流程:

网卡收到数据包

↓

触发硬件中断

↓

中断处理程序(内核态)

↓

数据包复制到内核缓冲区

↓

TCP协议栈处理(内核态)

↓

数据复制到用户空间

↓

应用程序读取

用户态程序无法:

- 直接处理硬件中断

- 直接访问内核缓冲区

- 直接操作网卡2. 零拷贝优化

传统数据传输:

1. 网卡 → 内核缓冲区(DMA)

2. 内核缓冲区 → 用户缓冲区(CPU复制)

3. 用户缓冲区 → 内核缓冲区(CPU复制)

4. 内核缓冲区 → 网卡(DMA)

零拷贝优化:

1. 网卡 → 内核缓冲区(DMA)

2. 内核缓冲区 → 网卡(DMA,绕过用户空间)

零拷贝需要:

- 直接操作内存页表

- 修改内核数据结构

- 只有内核态能完成3. 系统资源管理

TCP需要管理:

- 文件描述符表

- 套接字缓冲区

- 网络路由表

- 防火墙规则

- 拥塞控制状态

这些都是内核数据结构,

用户态无法直接访问TCP 协议栈在内核中的位置

内核网络子系统:

┌────────────────────────────────────┐

│ 系统调用接口(socket, bind, ...)│ ← 用户程序通过系统调用访问

├────────────────────────────────────┤

│ 协议无关层(Socket Buffer) │

├────────────────────────────────────┤

│ 传输层 │

│ ├─ TCP协议栈 ← 在这里! │

│ ├─ UDP协议栈 │

│ └─ SCTP协议栈 │

├────────────────────────────────────┤

│ 网络层(IP协议栈) │

├────────────────────────────────────┤

│ 设备驱动层 │

├────────────────────────────────────┤

│ 硬件(网卡) │

└────────────────────────────────────┘7.3 QUIC 为什么可以在用户态?

QUIC 的 "借壳" 策略

QUIC的聪明之处:

┌────────────────────────────────────┐

│ 应用层(HTTP/3) │

├────────────────────────────────────┤

│ QUIC协议栈(用户态) │ ← 在用户态实现

│ ├─ 连接管理 │

│ ├─ 流控 │

│ ├─ 拥塞控制 │

│ └─ 加密(TLS 1.3) │

├────────────────────────────────────┤

│ UDP协议栈(内核态) │ ← "借壳"UDP

│ └─ 提供基本的不可靠传输 │

├────────────────────────────────────┤

│ IP协议栈(内核态) │

└────────────────────────────────────┘核心思想:

- UDP 是标准协议,内核已经实现

- QUIC 在 UDP 之上构建可靠性

- 只需要调用 UDP 的 send/recv 系统调用

- 不需要直接操作硬件

QUIC 的可靠性实现

QUIC在用户态实现TCP的可靠性:

QUIC数据包格式:

┌──────────────────────────────────┐

│ Connection ID │

├──────────────────────────────────┤

│ Packet Number │ ← 序列号

├──────────────────────────────────┤

│ Stream ID │

├──────────────────────────────────┤

│ Offset │ ← 偏移量

├──────────────────────────────────┤

│ Length │

├──────────────────────────────────┤

│ Data │

└──────────────────────────────────┘

可靠传输机制:

1. 发送数据时,记录Packet Number

2. 收到ACK时,标记已确认

3. 超时未收到ACK,触发重传

4. 拥塞控制(类似TCP的慢启动、拥塞避免)

所有逻辑在用户态实现!7.4 内核态 vs 用户态的权衡

TCP(内核态)的优势

1. 性能

零拷贝:

磁盘文件 → 网卡(绕过CPU)

系统调用:

sendfile()系统调用,一次系统调用完成

内存访问:

直接访问内核缓冲区,无需用户态/内核态切换2. 兼容性

所有操作系统都支持TCP:

- Linux

- Windows

- macOS

- FreeBSD

- ...

无需安装额外软件3. 成熟度

TCP已有40年历史:

- 经过充分测试

- 稳定可靠

- 性能优化充分TCP 的劣势

1. 升级困难

修改TCP协议需要:

1. 修改操作系统内核

2. 经过充分测试

3. 发布更新

4. 用户升级操作系统

周期:数年

例子:

- TCP Fast Open:2012年提出,2016年才广泛支持

- BBR拥塞控制:2016年提出,2018年才进入Linux内核2. 功能限制

TCP的设计约束:

- 基于字节流,不支持多路复用

- 有序传输,导致队头阻塞

- 连接由四元组标识,无法迁移QUIC(用户态)的优势

1. 快速迭代

QUIC升级流程:

1. 修改用户态库(如quiche、ngtcp2)

2. 重新编译应用程序

3. 部署

周期:几天甚至几小时

例子:

- QUIC不断推出新版本

- Chrome每6周更新一次QUIC实现

- 可以快速修复bug、添加新特性2. 灵活性

用户态可以:

- 自定义拥塞控制算法

- 实现多路复用

- 集成TLS加密

- 添加新特性(如连接迁移)3. 跨平台

QUIC库可以在任何平台编译:

- Linux

- Windows

- macOS

- 甚至嵌入式设备QUIC 的劣势

1. 性能开销

用户态协议栈的开销:

- 用户态/内核态切换(系统调用)

- 数据复制(用户态 ↔ 内核态)

- 无法使用零拷贝

性能损失:10-20%2. 复杂性

需要实现:

- 可靠传输

- 拥塞控制

- 流控

- 加密

- ...

相当于在用户态重新实现TCP!7.5 未来趋势

演进路线:

第一代:TCP(内核态)

优点:性能好、兼容性强

缺点:升级慢、功能受限

第二代:QUIC(用户态)

优点:快速迭代、功能灵活

缺点:性能开销

第三代:内核模块(eBPF)

优点:性能好、可编程

缺点:需要内核支持

eBPF(扩展伯克利包过滤器):

- 允许在内核中运行用户程序

- 无需修改内核

- 安全沙箱执行

- 可能成为未来的方向