一、最近我做了一个新的 Skill:MacOS Desktop Control

- 它的目标很简单:让 AI Agent 能够在 macOS 上更稳定、更可控地完成桌面操作,比如打开应用、识别屏幕内容、点击按钮、输入文字、拖拽元素,以及读取窗口状态。

- 这个 skill 已经发布在 ClawHub 上 :clawhub.ai/kd-oauth/de...

二、为什么要写这个Skill

- macOs兼容性:现有Skill都没有专门针对macOS做兼容性配置。比如很多MacBook是Retina屏,截图是像素坐标(pixels),但鼠标点击是逻辑坐标(point)。这里不做兼容的话,Agent就会"看得准,点不准"

- 中文兼容性:现有Skill没有对中文输入和识别的兼容。比如我要打字"你好",其他Skill会无法正确输入,因为它们默认是键盘一个一个敲英文字母

- macOs特性使用:现有Skill没有利用到macOS一些独有的特性。比如AppleScript很擅长打开app和读app标题,Apple自带的Apple Vision很适合读文字...等等

三、这个Skill能做什么?

这里我举两个简单的例子

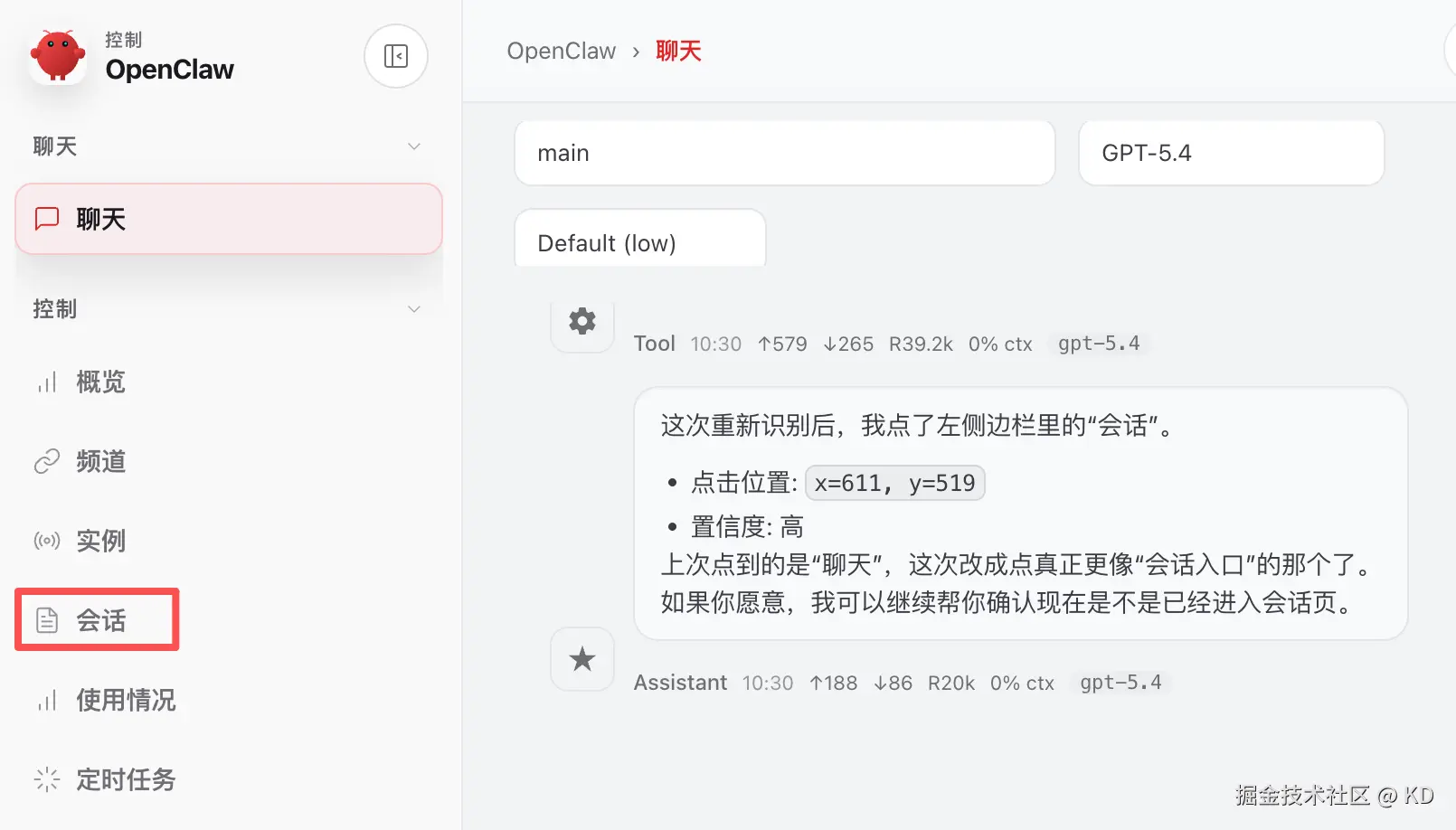

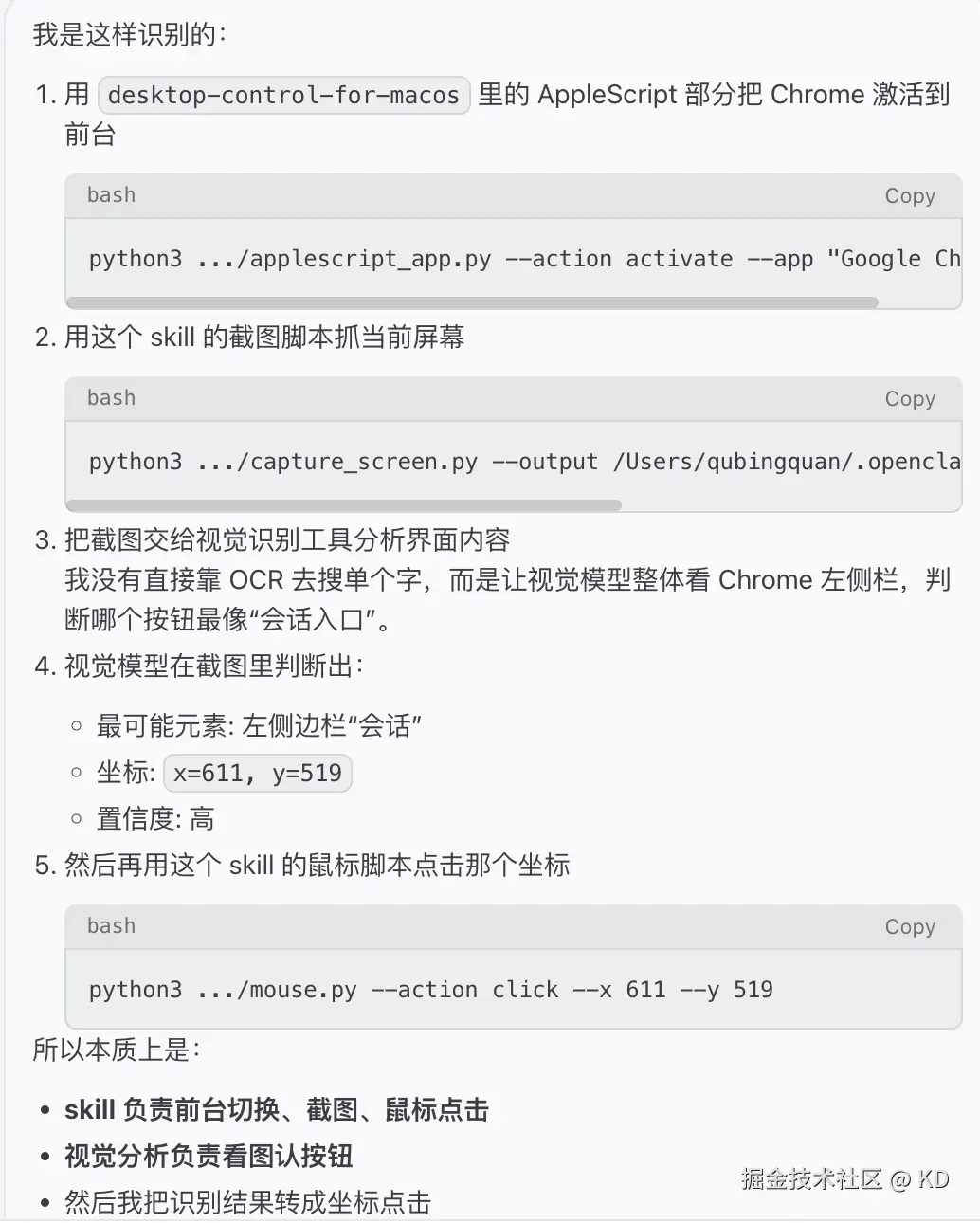

1.点击侧边栏会话按钮

执行效果

- OpenClaw识别到了会话栏,并且点击打开了会话

执行流程

- 可以看到OpenClaw用Skill的能力完成了整个流程

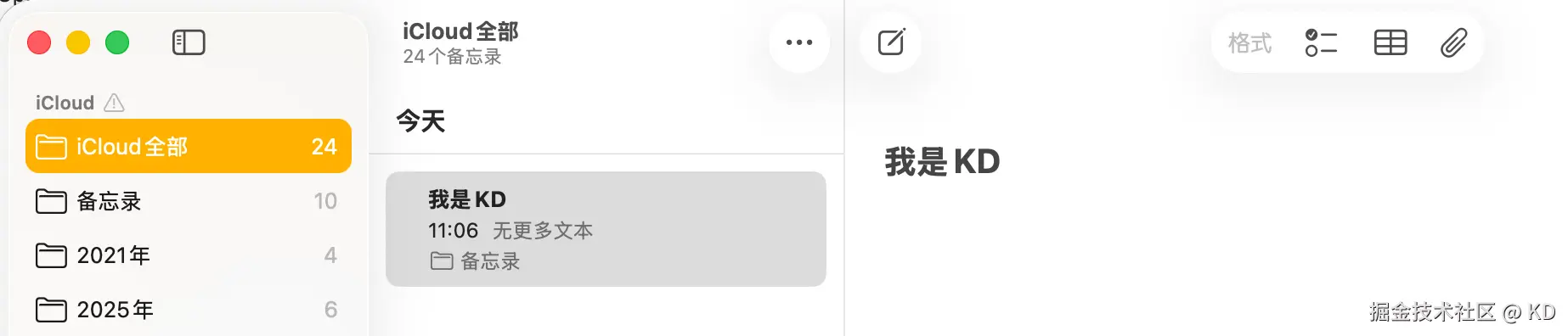

2.新建备忘录并输入"我是KD"

执行效果

- 直接打开并新建&输入,执行的很快,因为完全是本地操作

执行流程

- Applescript负责切备忘录到前台,keyboard负责快捷键和文件输入

四、目录结构

markdown

desktop-control-for-macos/

├── SKILL.md

├── _meta.json

├── requirements.txt

├── .DS_Store

└── scripts/

├── applescript_app.py

├── applescript_window.py

├── calibration.py

├── capture_screen.py

├── crop_image.py

├── init_coordinate_mapping.py

├── keyboard.py

├── locate_image_opencv.py

├── locate_text_ocr.py

└── mouse.py五、一个清晰的操作流水线

flowchart TD

A[用 AppleScript 激活 App<br/>或读取窗口状态]

B[初始化坐标映射]

C[截取屏幕]

D[用 OCR 或 OpenCV 找到目标]

E[用鼠标或键盘执行动作]

F[结束 / 验证结果]

A --> B --> C --> D --> E --> F

六、写在最后

欢迎大家下载使用!有意见或建议可以留言,我会持续完善这个Skill