1. 前言

当前人工智能人才培养进入规模化、精细化发展阶段,AIoT作为"AI+物联网"的核心融合方向,已成为院校计算机、物联网、嵌入式、人工智能等专业的核心实训内容,更是衔接校园教学与企业岗位的关键纽带。但实际教学中,多数院校面临着三大突出痛点:一是实训设备兼容性差,无法兼顾多专业教学需求,设备复用率低;二是算力资源不足,复杂模型训练卡顿、边缘部署困难,无法支撑高阶实训;三是实训内容与产业脱节,缺乏可落地的实操案例和代码,学生毕业后难以快速适配企业岗位需求。

2.产品简介

该款人工智能实训装置是一款面向人工智能、嵌入式系统、物联网与工业机器人应用领域的一体化AIoT综合教学实训平台,以标准化实验箱为载体,深度融合人工智能技术、嵌入式系统技术、工业机械臂应用技术、物联网技术四大核心技术,通过阶梯式基础实验与综合项目案例,构建从AI基础入门到工程应用落地的全流程实践教学体系。

装置采用模块化一体化集成设计,将10寸及以上高清多点电容触摸屏、QWERTY全键盘、高性能嵌入式AI运算单元、嵌入式AI实时控制单元、多类型传感器执行器、RFID识别模块高度整合于箱内,同时预留工业机械臂专用存放仓位,形成"显示交互---核心算力---实时控制---感知执行---工业应用"五位一体的硬件教学载体,为AI与嵌入式开发、物联网感知、工业机器人操作等多维度实训提供稳定可靠的物理支撑。

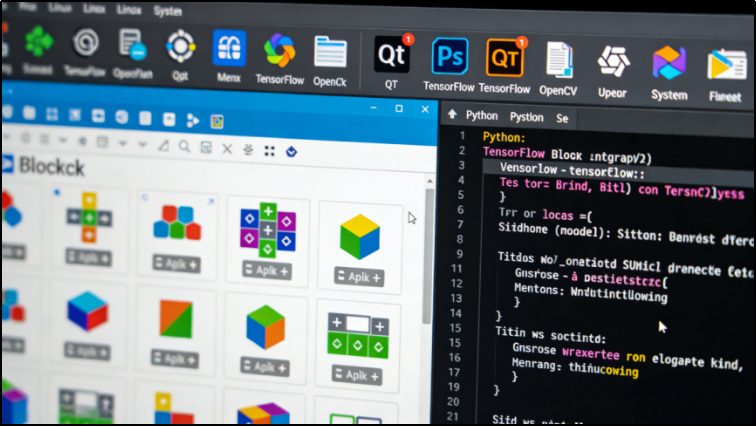

平台搭载64位Linux嵌入式操作系统,内置Qt、Python3、TensorFlow、OpenCV等完整AI开发环境,配套基于Blockly的可视化图形编程工具,支持拖拽编程与代码双向互转,大幅降低AI算法开发与硬件编程门槛,满足从基础编程到AI算法实践的全场景教学需求。

平台全面覆盖人工智能基础算法、主流深度学习框架应用、计算机视觉处理、物联网感知控制、工业机械臂视觉货物分拣等核心实训内容,配套完整系统镜像、项目源码与图文实训指导资源,可全面满足高校、职业院校在人工智能、物联网工程、机器人工程、嵌入式技术等相关专业的课程教学、综合实训、创新开发及竞赛备赛需求。

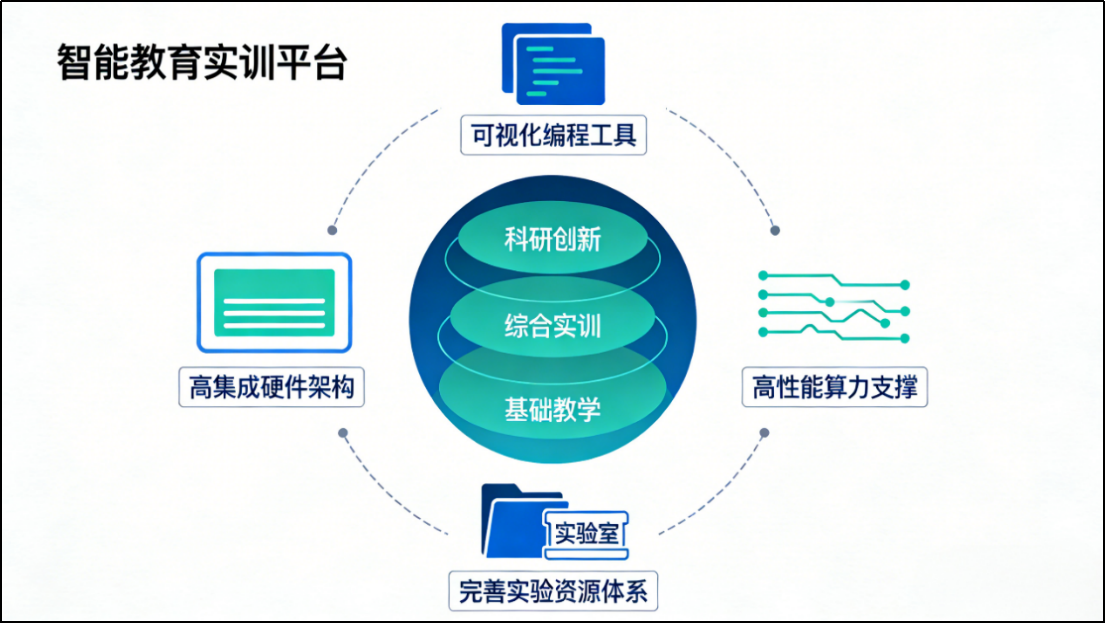

平台以一体化硬件、完善软件生态与系统化实验资源为支撑,实现教学、实训、开发、竞赛多场景覆盖,有效衔接理论教学与工程实践,全面培养学生的人工智能应用能力、嵌入式开发能力、物联网集成能力与工业机器人实操能力,是面向智能技术专业群的高品质综合教学实训装备。

3.产品架构

一款优质的AIoT实训平台,架构设计是核心,直接决定了实训的兼容性、扩展性和实操性。唯众这款实训装置摒弃了传统平台"技术堆砌"的弊端,聚焦教学实用性,采用云-边-端协同的分层架构 ,整体分为感知层、边缘计算层、云端管理层、应用层四层,各层职责清晰、协同联动,既解决了传统平台算力浪费、多环境适配难的问题,又能支撑从基础编程到企业级项目实战的全场景实训需求,完全贴合院校分层教学、循序渐进的教学规律。

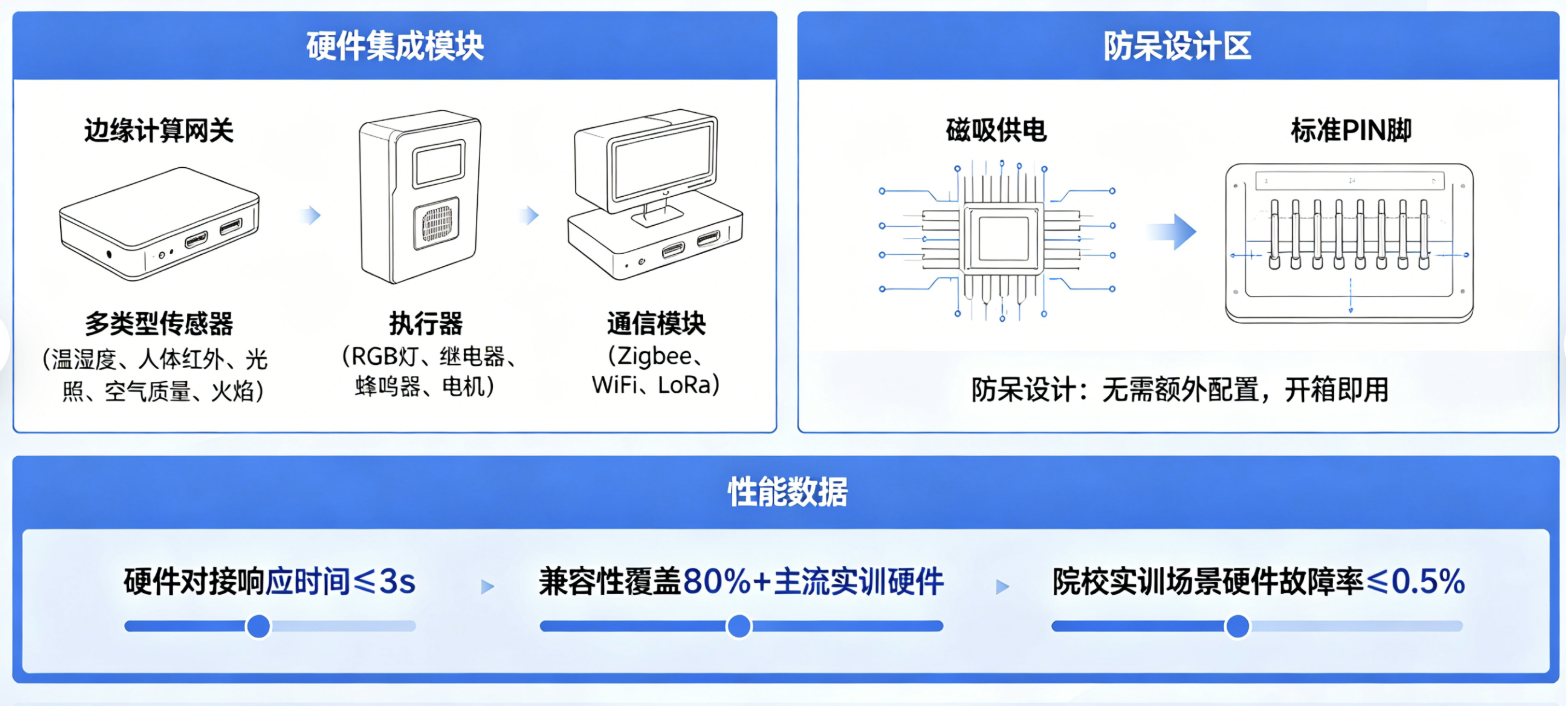

感知层作为实训数据采集与硬件交互的入口,集成了唯众标准化硬件生态,包括边缘计算网关、多类型传感器(温湿度、人体红外、光照、空气质量、火焰等)、执行器(RGB灯、继电器、蜂鸣器、电机等)及通信模块(Zigbee、WiFi、LoRa)。最贴心的是采用磁吸供电、标准PIN脚等防呆设计,无需额外配置,开箱即用,彻底解决了实训中硬件对接繁琐、兼容性差、易接错的痛点。实测数据显示,其硬件对接响应时间≤3s,兼容性覆盖80%+主流实训硬件,院校实训场景下,硬件故障率≤0.5%,完全适配中职、高职、本科不同学段的教学需求。

边缘计算层是整个平台的算力核心,搭载唯众专用边缘计算网关,采用Linux与Windows双系统深度融合设计,支持一键式系统切换,实现Windows工程化开发与Linux深度计算的数据互通与资源协同。这一点在教学实训中非常实用,传统方案中,Windows端编写的代码无法直接在Linux端运行,需手动修改适配,不仅增加了实训难度,还容易出现代码报错,而唯众的双系统融合设计,切换后数据不丢失、环境可复用,极大降低了学生的实训门槛,也减少了教师的教学负担。

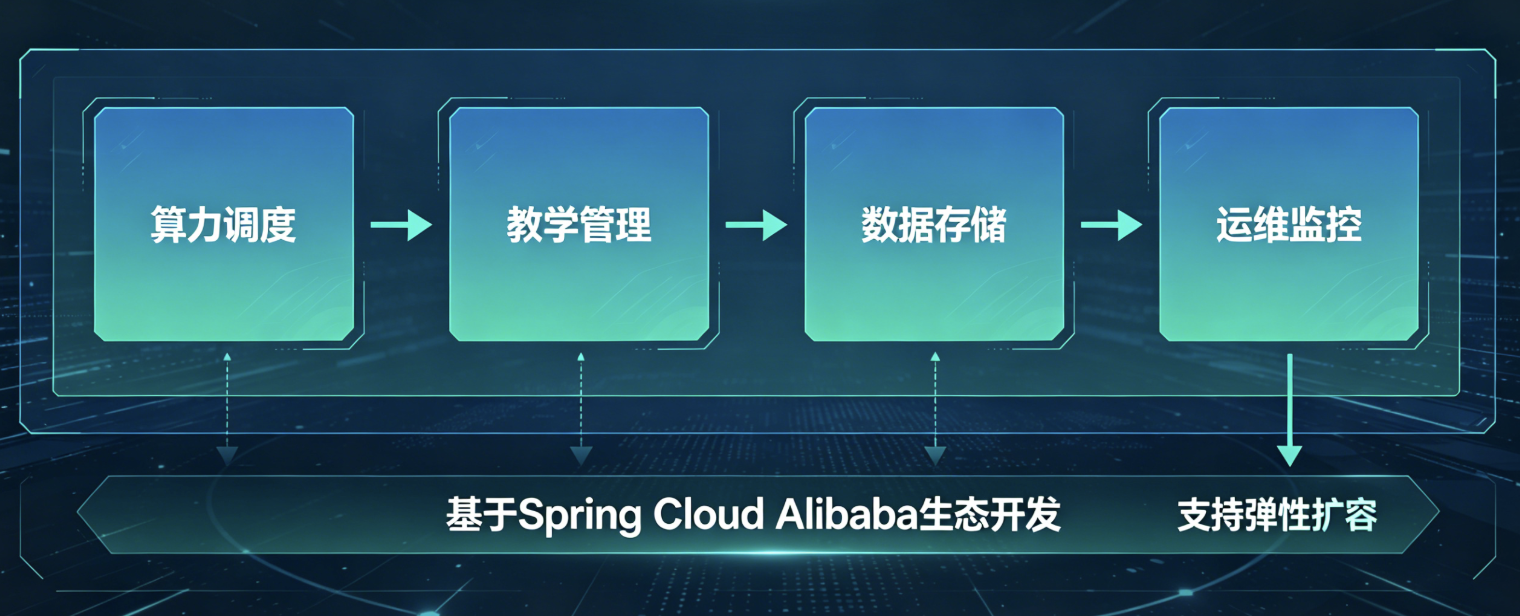

云端管理层采用微服务架构,拆分算力调度、教学管理、数据存储、运维监控4个核心模块,基于Spring Cloud Alibaba生态开发,支持弹性扩容。实测中,该层可支持1000+用户同时在线实训,页面响应时间≤1s,算力调度延迟≤10ms,数据存储吞吐量≥100MB/s,完全适配院校实训课的并发需求,即使多个班级同时开展实训,也不会出现卡顿、崩溃的情况。同时支持私有化部署与SaaS云服务两种模式,院校可根据自身信息化建设条件灵活选择,既能保护已有信息化投资,也能满足不同规模的实训需求。

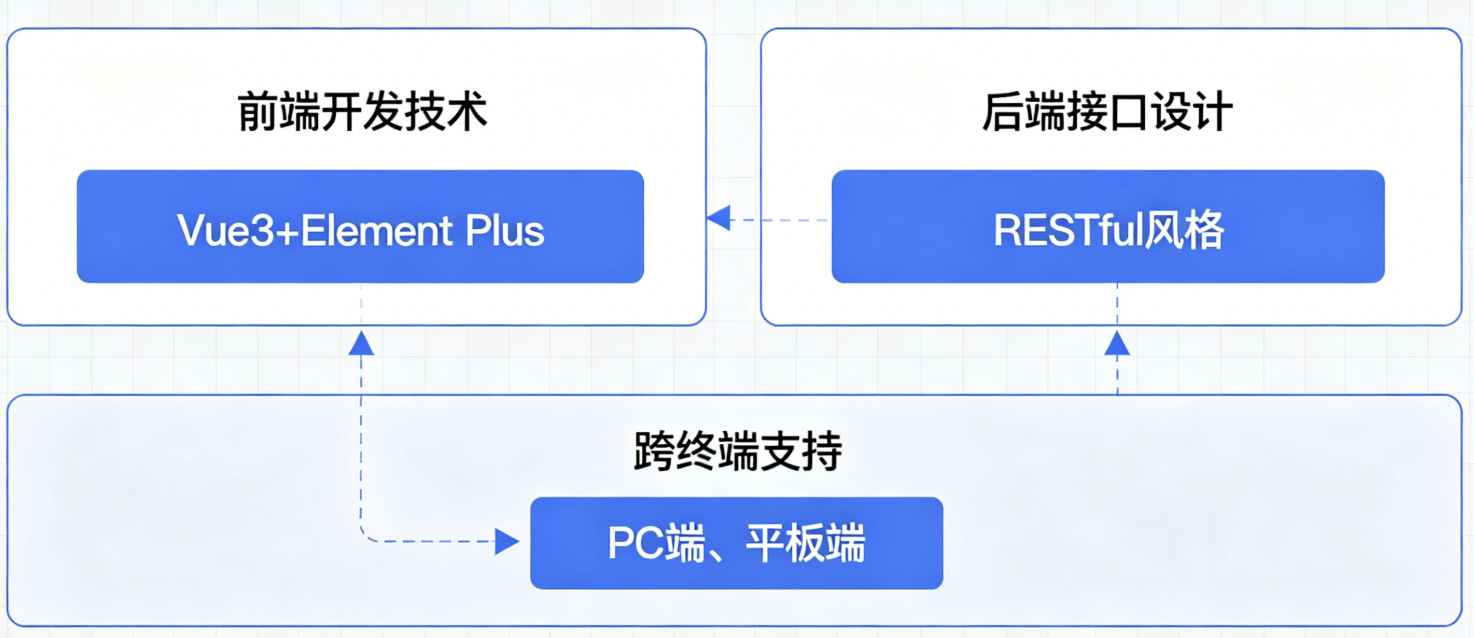

应用层采用轻量化设计,基于Vue3+Element Plus开发前端,后端接口采用RESTful风格,支持跨终端访问(PC端、平板端)。学生端可实现实训项目一键领取、代码在线编写、模型可视化训练、实训报告自动生成;教师端支持实训任务发布、进度监控、作业批改、错误统计,可直接查看学生代码报错详情,针对性指导,大幅提升教学效率;管理员端则负责硬件管理、算力监控、用户权限分配,能将运维成本降低60%,让院校更专注于教学本身。

4.产品特点

4.1多技术深度融合,构建全维度实训体系

平台创新性融合人工智能、嵌入式系统、工业机械臂、物联网四大核心技术,打破单一技术实训壁垒,打造覆盖AI基础学习---算法开发---硬件控制---工业应用的完整实践链,高度贴合新一代智能技术人才培养需求。

4.2一体化实验箱设计,硬件集成度高

平台采用多箱体单层实验箱结构,配套工业机械臂专用存放箱,将高性能AI运算单元、嵌入式实时控制单元、高清触控显示屏、多类型传感器模块及工业级机械臂等核心硬件高度集成,布局规整紧凑,兼具便携搬运性与教学实用性,系统整体性与稳定性优异,可同时满足课堂集中实训与课外创新开发的双重场景需求。

4.3高性能硬件配置,支撑AI算力需求

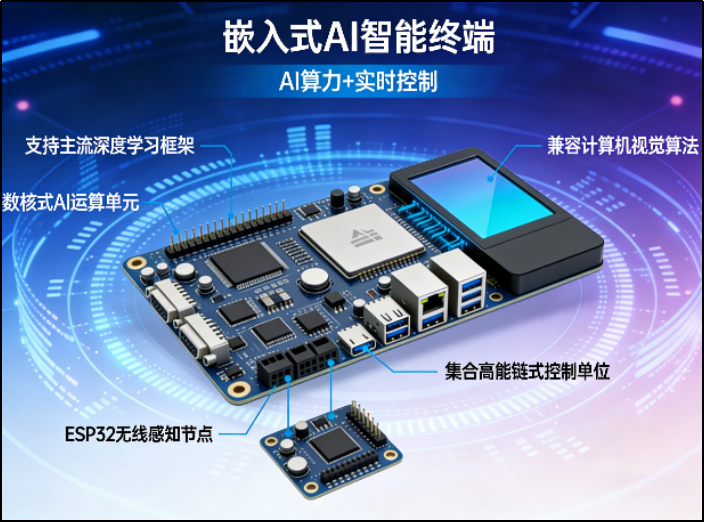

平台搭载多核高性能嵌入式AI运算单元,配备大内存与高速存储,支持高清显示与多种外设扩展;搭配高性能嵌入式控制单元与ESP32无线传感节点,兼顾AI算力与实时控制能力,可流畅运行主流深度学习框架与计算机视觉算法。

4.4图形化编程赋能,降低入门学习门槛

平台搭载基于Blockly的可视化图形化编程工具,支持拖拽式逻辑搭建与代码双向互转,内置丰富硬件驱动控件,可自动生成C、Python代码,支持代码联想、在线调试与多硬件程序下载,有效解决编程入门难、底层驱动开发复杂的教学痛点。

4.5丰富实验资源覆盖全学段,教学适用性强

平台提供基础验证实验、AI算法实验、计算机视觉实验、数据分析挖掘实验、工业机械臂应用实训等多层次实验资源,配套图文并茂的实训指导文档,满足基础教学、综合实训、科研创新等不同教学阶段需求。

4.6跨平台一键部署,软硬件兼容性优异

软件平台支持Windows、Linux单机一键运行,无需额外配置环境;硬件兼容Arduino、Micro:bit、ESP32、STM32 等多种主流硬件平台,支持多语言切换与固件烧录,拓展性与复用性强。

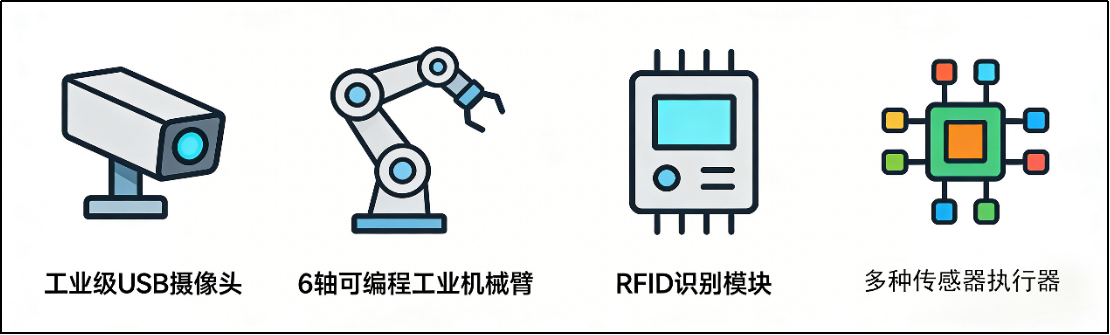

4.7工业级硬件选型,贴合工程应用实际

平台配备工业级USB摄像头、6轴可编程工业机械臂、RFID识别模块及多种传感器执行器,硬件设计贴近工业现场应用标准,助力学生掌握工程化开发流程与工业设备应用技能。

平台通过高集成的硬件架构、高性能算力支撑、可视化编程工具及完善的实验资源体系,有效降低技术学习门槛,保障跨平台兼容与工业级应用落地能力。无论是基础教学、综合实训还是科研创新,均可实现一站式交付,为院校、培训机构及创新团队提供高性价比、高扩展性、强实用性的智能教育实训底座。

5.产品组成

5.1硬件组成

1. 实验箱主体

平台采用多箱体单层一体化结构,专属配备工业机械臂防护存放箱。内部精准规划机械臂底座放置区及多仓位货物存储区,实现核心设备的规范化收纳、防尘防护与便捷取用,兼顾课堂集中实训与课外创新开发的便携性与实用性。

2.核心AI计算与接口单元

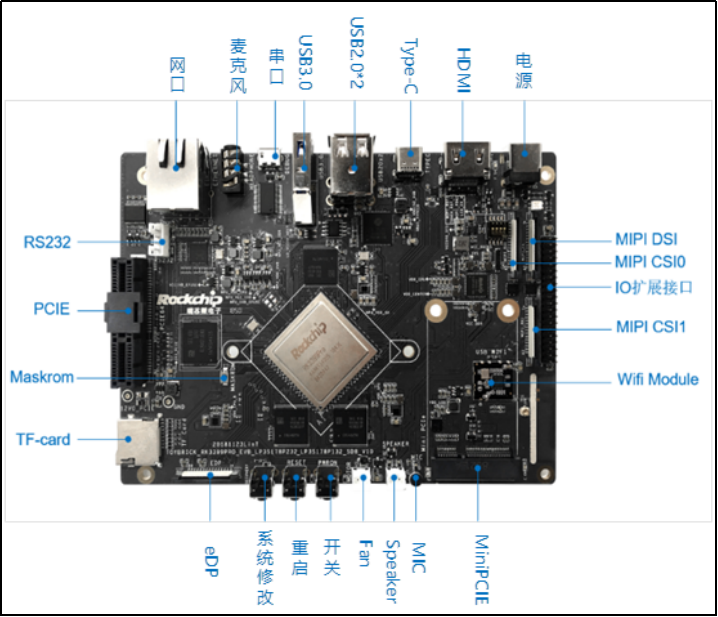

(1)运算核心:搭载高性能多核处理器(≥4 核 Cortex-A53+2 核 Cortex-A72),内置 Mali-T860MP4 显示加速引擎;标配≥6GB DDR3 内存、≥32GB eMMC 高速存储;配备 10 寸及以上 1920×1080 高清多点电容触摸屏,提供流畅人机交互界面。

(2)接口拓展:集成多路 USB2.0/USB3.0 HOST、TF 卡、TypeC、音频输入、HDMI、CSI 摄像头、千兆以太网、EDP、MIPI DSI(2 路,最高支持 4K)、PCIE 4G、SPI 等高速接口;拓展 9 路可扩展 GPIO、1 路 TTL 串口;支持 4G/5G/WiFi + 蓝牙 4.0 无线通信;配备≥2 路功能按键、用户自定义 LED 指示灯及≥1 路 3W 音频输出接口。

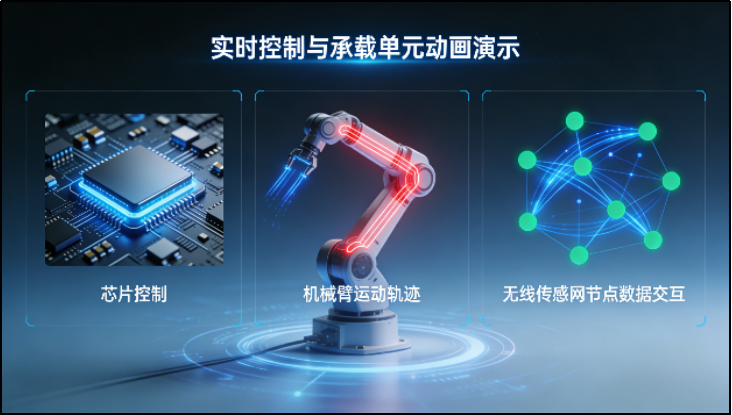

3.实时控制与承载单元

控制核心:主控芯片性能不低于 STM32F103,作为系统实时控制核心,负责工业机械臂运动控制、无线传感网络节点调度,保证高实时性与运行稳定。

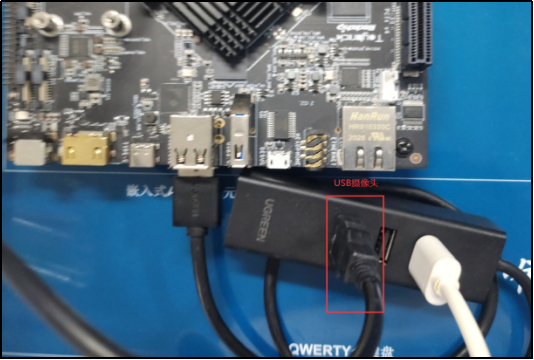

承载与接口:采用整块 PCB 一体化承载设计,稳固安装 AI 运算主板、高清显示屏、无线传感节点、RFID 模块,保证系统整体性与一体化结构;拓展≥3 路 USB、≥2 路专用串口(一路用于 AI 单元通信,一路用于机械臂控制)、RFID 专用接口、≥2 组无线传感网接口(每组带自动识别传感器接口);配备 SD 卡接口、调试接口与复位按键。

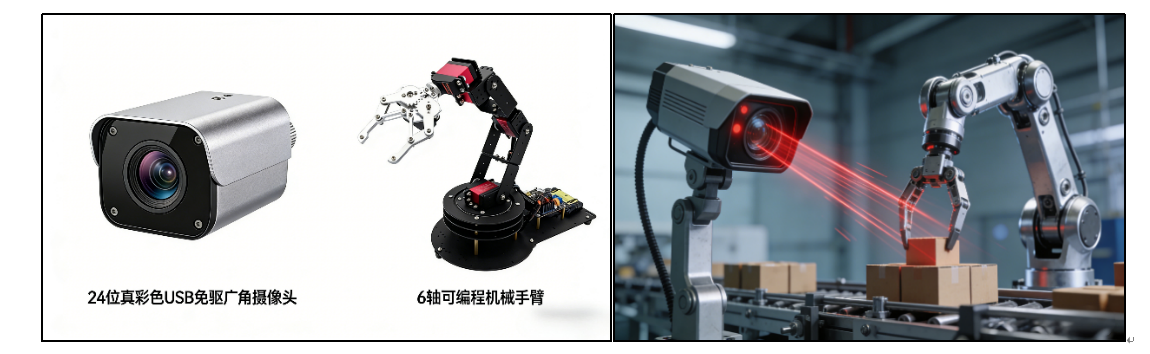

4. 工业级视觉与机械臂单元

视觉模块:搭载 24 位真彩色 USB 免驱摄像头,支持 1920×1080@30fps 高清动态成像,广角无畸变镜头,满足计算机视觉算法开发、图像识别及机械臂视觉联动分拣等实训需求。

机械臂模块:标配 6 轴可编程机械手臂,核心驱动采用高寿命串行总线舵机,支持多自由度精准运动控制,可与视觉模块无缝联动,实现目标抓取、分拣与搬运等工业级应用场景实训。

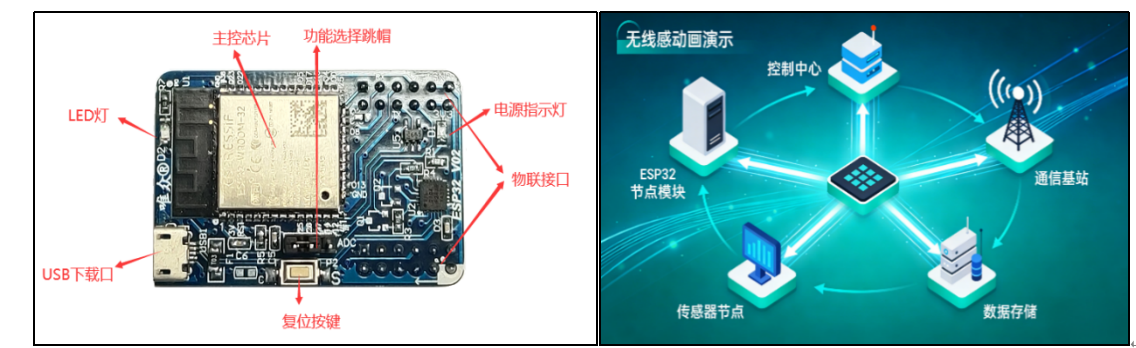

5. 无线传感网络单元

(1)节点模块(≥3 个):采用 ESP32-D0WDQ6 双核处理器(Xtensa 32-bit LX),时钟频率 80--240MHz;配置≥448KB ROM、≥520KB SRAM、8KB RTC SRAM、4MB SPI Flash;支持精细时钟门控、动态电压调频等多种低功耗模式;采用标准化 2×6×2PIN 直插接口,兼容 MicroPython 编程 + Blockly 图形化代码双向转换。

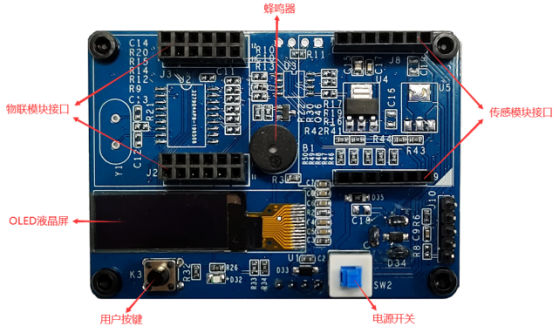

(2)扩展底板(≥2 个):集成 OLED 显示屏、用户按键、有源蜂鸣器、电源开关;配备无线节点直插接口(2×6×2PIN)与传感器执行器接口(1×7×2PIN),可即插即用连接传感节点与外设,实现硬件快速扩展。

6. 传感器执行器与识别单元

本单元为人工智能实训系统提供环境感知、执行控制、身份识别能力,支持多类型外设扩展,可完成典型物联网应用场景实训。

|--------------------------|-----------------|----------------------------------------------------------------------------|

| 分类名称 || 模块/配件 |

| 通信显示单元 ||  |

|

| 扩展底板 ||  |

|

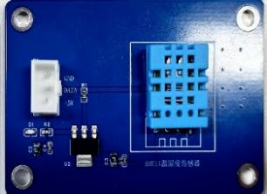

| 传感器 执行单元 | 温湿度传感器 |  |

|

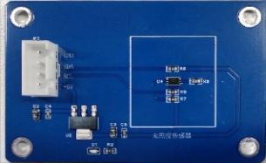

| 传感器 执行单元 | 光照度传感器 |  |

|

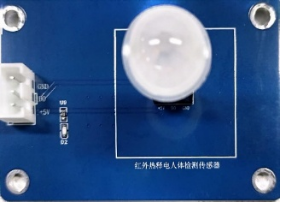

| 传感器 执行单元 | 人体红外传感器 |  |

|

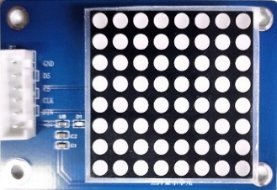

| 传感器 执行单元 | LED点阵单元 |  |

|

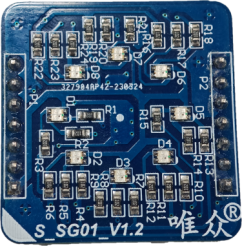

| 传感器 执行单元 | RGB彩灯 |  |

|

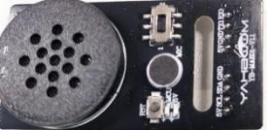

| 传感器 执行单元 | 智能语音播报 |  |

|

| 传感器 执行单元 | 人体红外传感器 |  |

|

| 传感器 执行单元 | 点阵显示单元 |  |

|

| RFID识别模块 ||  |

|

(1)传感器执行器模块:涵盖温湿度、光强、人体红外等环境感知单元,以及 LED 点阵、RGB 彩灯、语音播报等执行控制单元;支持接口电气兼容与光电传感扩展,可直接插接节点扩展底板使用,构建完整物联网感知体系。

(2)RFID 识别模块:采用 13.56MHz 高频 RFID 读写模组,板载 0.91 英寸 OLED 显示屏,集成独立功能按键、蜂鸣器及独立电源按钮;可完成物品身份识别、权限管理等典型人工智能应用实训。

7. 输入外设模块

平台配备 QWERTY 全键盘,支持嵌入式 AI 单元直接编程与代码输入操作,大幅提升代码编写与程序调试的开发便捷性。

5.2软件组成

1. 嵌入式操作系统

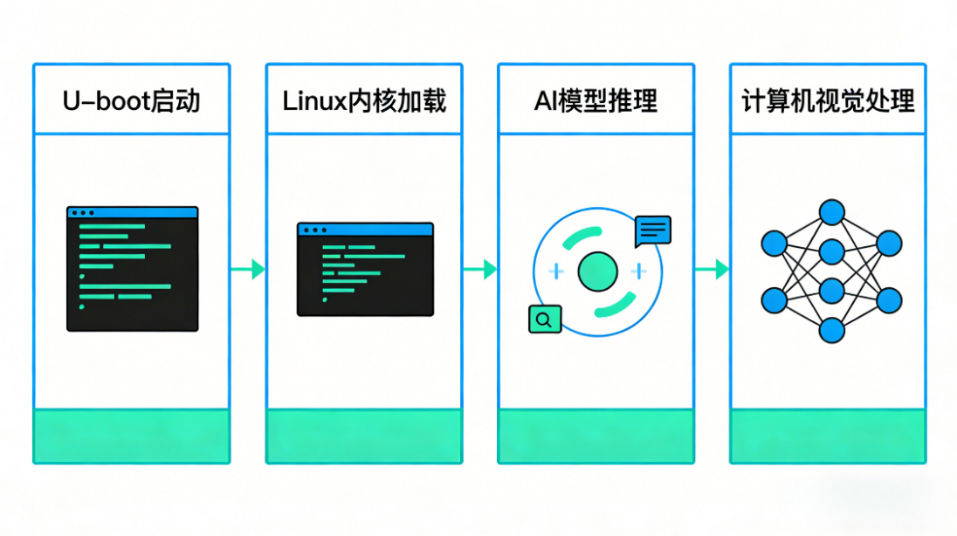

搭载64 位嵌入式 Linux 操作系统,提供完整的U-boot 引导程序、Linux 内核镜像与根文件系统,支持系统一键还原与固件升级。

内置Qt 开发框架、Python3 编译环境、TensorFlow Lite、OpenCV等 AI 开发工具链,预装机器学习库、数据处理库与视觉算法库,可直接运行深度学习模型推理、计算机视觉处理、物联网数据采集等应用,无需额外配置环境,开箱即用。

2. 图形化编程平台

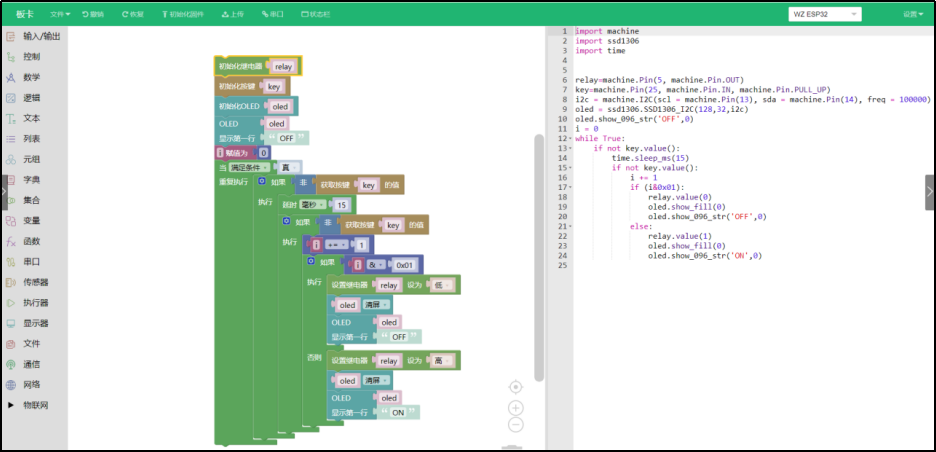

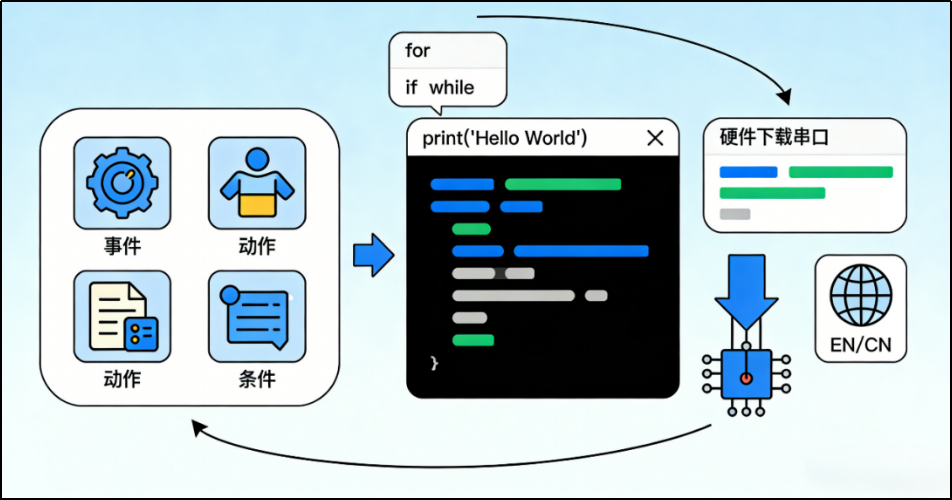

基于Blockly 可视化编程引擎深度开发,提供输入输出、逻辑控制、循环判断、数学运算、文本处理、列表字典、函数封装、硬件驱动、传感器采集、网络通信、云平台对接等全品类编程控件,支持自定义模块扩展与二次开发。

支持图形化拖拽编程 ↔ 高级代码双向自动转换,具备代码智能联想、语法高亮、错误提示、自动补全功能,可导出 C、Python、MicroPython 等多格式程序;兼容多品牌硬件平台,支持程序一键下载、固件烧录、串口调试、日志输出,支持简体中文、繁体中文、英文三种界面语言自由切换。

3. 实训教学资源

采用左屏实训指导 + 右屏编程画布双区联动界面,教学与实操同步展示。内置LED 闪烁、按键控制、温湿度采集、光照检测、人体感应、RGB 灯控、继电器控制、OLED 显示等 8 套标准化基础实训项目,每项均配套实验目的、原理讲解、硬件接线、步骤指引、现象分析、拓展思考全流程图文教程。

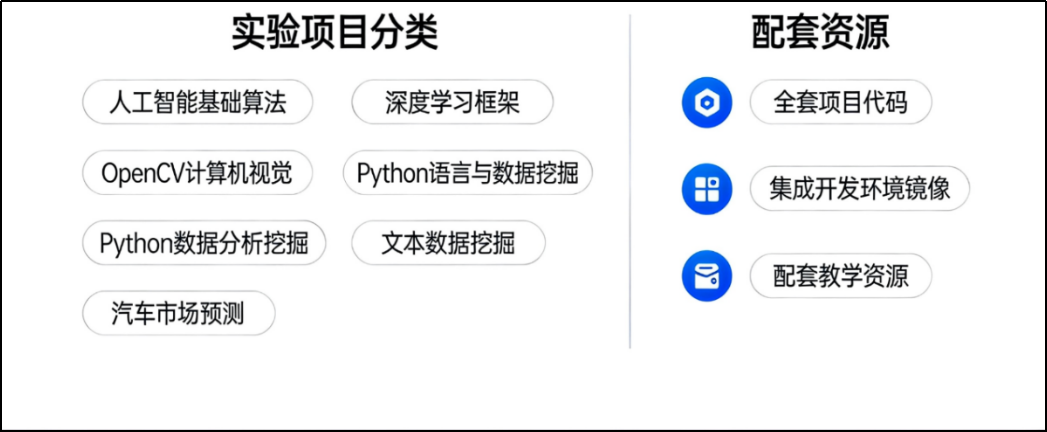

5.3实验资源

涵盖人工智能基础算法、深度学习框架、OpenCV 计算机视觉、Python 数据分析挖掘、文本数据挖掘、汽车市场预测等 11 大类完整实验项目,提供全套项目源码、集成开发环境镜像及配套教学资源。

6. 核心技术干货:硬件配置+软件生态+多场景实操代码

6.1 硬件核心配置

边缘网关作为整个平台的核心硬件,其配置直接决定了实训的流畅度和高阶实训的支撑能力,唯众这款实训装置的边缘网关,针对性优化了教学场景的算力需求,参数贴合实训、性价比极高:

-

处理器:六核ARM 64位处理器,由双核Cortex-A72+四核Cortex-A53组成,主频高达1.8GHz,兼顾算力与功耗,完美适配院校实验室供电场景(功耗≤15W)。

-

GPU:四核ARM Mali-T860 MP4,支持OpenGL ES1.1/2.0/3.0/3.1、OpenVG1.1、OpenCL、DX11等多种图形接口,可支撑图像渲染、模型可视化等实训需求。

-

NPU:高性能神经网络处理单元,支持8bit/16bit运算,运算性能高达3.2TOPs,可实现模型推理加速,解决复杂模型训练卡顿的问题,支撑YOLOv5等主流目标检测模型的实时推理。

-

内存与存储:6GB LPDDR3内存+32GB eMMC存储,足够支撑多任务并发实训和模型训练需求,同时预留扩展接口,可根据实训需求扩容。

-

通信与接口:支持TCP/IP、WIFI、蓝牙、MQTT、Socket、ssh、串口等多种通信协议,外设接口丰富,包含SPI、IIC、UART、GPIO等,可满足学生和老师不同的学习和开发需求,无论是基础的传感器数据采集,还是复杂的设备联动,都能轻松实现。

6.2 软件生态优势

软件生态是实训平台的"灵魂",唯众这款实训装置的软件生态,最大的优势是全场景适配与低门槛入门,同时兼顾进阶扩展性,完美贴合院校分层教学需求:

-

框架全覆盖:平台预装TensorFlow、Keras、Caffe、Mxnet、Pytorch等主流深度学习框架,同时预装了YOLO v3/v5、MNIST等常用模型的开发环境和依赖,学生无需手动搭建复杂的开发环境,开箱即可开展实训,避免了因环境搭建失败影响实训进度。

-

双编程模式:支持MicroPython代码开发+图形化拖拽编程,兼顾零基础学生和进阶学习者。零基础学生可通过图形化编程工具,无需了解任何底层知识,即可完成AIoT典型行业应用的小型模型开发;进阶学习者可通过代码编程,深入掌握AIoT核心技术。

-

完整工具链:提供模型转换工具,可将X86架构计算机中生成的hdf5、pb、onnx人工智能模型,转化为ARM64架构平台可运行的tflite模型,解决跨平台部署的核心痛点;同时提供模型量化工具,可将模型进行INT8量化,降低算力消耗,适配边缘网关的算力需求。

-

可视化工具:配备可视化界面设计工具和模型训练可视化工具,学生可通过拖拽控件完成页面设计,通过可视化图表查看模型训练过程中的损失值、准确率等参数,直观理解模型训练的核心逻辑。

6.3 多场景实操代码

6.3.1 基础场景:温湿度传感器数据采集与云端上传(MicroPython)

适配平台感知层的DHT11温湿度传感器,实现数据采集、滤波、实时打印,并同步上传至唯众云平台,适合零基础学生入门实训,掌握传感器数据采集的基本方法。

# 唯众AIoT实训平台 - 温湿度传感器数据采集与云端上传示例

from machine import Pin, I2C

import dht

import time

import urequests # 平台预装,用于云端通信

# 初始化I2C总线(对应平台GPIO接口,无需修改)

i2c = I2C(0, scl=Pin(22), sda=Pin(21), freq=400000)

# 初始化DHT11温湿度传感器(连接平台GPIO15,可根据实际接线调整)

dht_sensor = dht.DHT11(Pin(15))

# 唯众云平台接口地址(平台自带,无需修改)

cloud_url = "http://iot.weizhongedu.com/api/data/upload"

# 设备ID(从平台学生端获取,替换为自己的设备ID)

device_id = "your_device_id"

def upload_to_cloud(temp, humi):

"""将温湿度数据上传至唯众云平台"""

try:

data = {

"deviceId": device_id,

"temperature": temp,

"humidity": humi,

"time": time.strftime("%Y-%m-%d %H:%M:%S", time.localtime())

}

# 发送POST请求上传数据

response = urequests.post(cloud_url, json=data)

if response.status_code == 200:

print("数据上传成功!")

else:

print("数据上传失败,状态码:", response.status_code)

response.close()

except Exception as e:

print("云端上传异常:", e)

while True:

try:

# 读取传感器数据(避免频繁读取,间隔2秒)

dht_sensor.measure()

temp = dht_sensor.temperature() # 读取温度值(℃)

humi = dht_sensor.humidity() # 读取湿度值(%)

# 数据滤波(去除异常值,提升数据准确性)

if 0 < temp < 60 and 0 < humi < 100:

print(f"当前温度:{temp}℃,当前湿度:{humi}%")

# 上传数据至云端

upload_to_cloud(temp, humi)

else:

print("传感器数据异常,跳过上传")

# 间隔2秒采集一次数据

time.sleep(2)

except OSError as e:

print("传感器读取失败,检查硬件连接:", e)6.3.2 进阶场景:TensorFlow模型训练及ARM64边缘部署(Python)

适配平台边缘网关的算力,基于MNIST手写数字数据集训练简单图像分类模型,完成模型训练后,转换为ARM64架构可运行的tflite模型,部署至边缘网关,适合进阶学生掌握模型训练与边缘部署的核心流程。

# 唯众AIoT实训平台 - TensorFlow模型训练及ARM64边缘部署示例

import tensorflow as tf

from tensorflow.keras import layers, models

from tensorflow.lite.python.lite import TFLiteConverter

import numpy as np

# 1. 构建简单图像分类模型(适配平台NPU算力,简化模型结构,提升训练速度)

model = models.Sequential([

# 卷积层:32个3x3卷积核,激活函数relu,输入形状为(28,28,1)(MNIST数据集规格)

layers.Conv2D(32, (3, 3), activation='relu', input_shape=(28, 28, 1)),

# 池化层:2x2最大池化,降低维度,减少计算量

layers.MaxPooling2D((2, 2)),

# 扁平化层:将二维特征映射转为一维向量,连接全连接层

layers.Flatten(),

# 全连接层:10个输出单元,对应0-9数字,激活函数softmax

layers.Dense(10, activation='softmax')

])

# 2. 编译模型(适配平台训练环境,优化器、损失函数贴合教学场景)

model.compile(

optimizer='adam', # adam优化器,收敛速度快,适合教学

loss='sparse_categorical_crossentropy', # 稀疏分类交叉熵,无需对标签进行独热编码

metrics=['accuracy'] # 评估指标:准确率

)

# 3. 加载MNIST数据集(平台预装,无需额外下载,直接调用即可)

(x_train, y_train), (x_test, y_test) = tf.keras.datasets.mnist.load_data()

# 数据预处理:reshape调整维度(适配模型输入),归一化(提升训练效果)

x_train = x_train.reshape((60000, 28, 28, 1)).astype('float32') / 255.0

x_test = x_test.reshape((10000, 28, 28, 1)).astype('float32') / 255.0

# 4. 模型训练(适配平台边缘网关算力,设置合理的epochs和batch_size)

print("开始模型训练...")

history = model.fit(

x_train, y_train,

epochs=5, # 训练轮次,兼顾训练效果和速度,适合教学演示

batch_size=32, # 批次大小,适配边缘网关内存

validation_split=0.1 # 10%的数据作为验证集,评估模型泛化能力

)

# 5. 模型评估(查看模型在测试集上的表现)

test_loss, test_acc = model.evaluate(x_test, y_test)

print(f"模型测试准确率:{test_acc:.4f}")

# 6. 模型转换(转为ARM64架构可运行的tflite模型,适配唯众边缘网关)

converter = TFLiteConverter.from_keras_model(model)

# 开启INT8量化,降低模型体积和算力消耗,适配平台NPU

converter.optimizations = [tf.lite.Optimize.DEFAULT]

# 转换模型

tflite_model = converter.convert()

# 7. 保存模型(可直接上传至唯众边缘网关运行)

with open('mnist_model.tflite', 'wb') as f:

f.write(tflite_model)

print("模型转换完成,已保存为mnist_model.tflite,可上传至边缘网关部署")

# 8. 模型部署测试(边缘网关运行tflite模型,预测单张图片)

interpreter = tf.lite.Interpreter(model_content=tflite_model)

interpreter.allocate_tensors()

# 获取输入输出张量

input_details = interpreter.get_input_details()

output_details = interpreter.get_output_details()

# 随机选取一张测试集图片进行预测

test_image = x_test[0:1] # 取第一张图片,shape为(1,28,28,1)

interpreter.set_tensor(input_details[0]['index'], test_image)

interpreter.invoke() # 执行推理

output_data = interpreter.get_tensor(output_details[0]['index'])

predicted_label = np.argmax(output_data) # 获取预测结果(0-9)

true_label = y_test[0] # 真实标签

print(f"预测标签:{predicted_label},真实标签:{true_label},预测{'正确' if predicted_label == true_label else '错误'}")6.3.3 实战场景:智慧安防人体入侵检测(基于YOLOv5轻量化版本)

适配平台边缘网关、摄像头、人体红外传感器,开发人体入侵检测系统,实现异常情况报警、数据实时上传、画面实时预览,贴合产业实际场景,适合高阶学生开展项目实战,掌握AI与IoT融合应用的核心技能。

# 唯众AIoT实训平台 - 智慧安防人体入侵检测示例(基于YOLOv5s-edu)

import cv2

import torch

import time

from machine import Pin

import urequests

# 初始化硬件设备(适配唯众实训平台,无需修改接口)

# 报警灯(连接GPIO18,高电平点亮)

alarm_light = Pin(18, Pin.OUT)

alarm_light.value(0) # 初始状态:关闭报警灯

# 蜂鸣器(连接GPIO19,高电平触发)

buzzer = Pin(19, Pin.OUT)

buzzer.value(0) # 初始状态:关闭蜂鸣器

# 人体红外传感器(连接GPIO20,高电平检测到人体)

pir_sensor = Pin(20, Pin.IN)

# 加载平台预装的YOLOv5s-edu轻量化模型(体积小、算力需求低,适配边缘网关)

# 模型路径为平台默认路径,无需修改

model = torch.hub.load('ultralytics/yolov5', 'custom', path='/home/weizhong/yolov5s_edu.pt')

# 配置模型参数(适配平台边缘网关算力,优化推理速度)

model.conf = 0.5 # 置信度阈值,过滤低置信度检测结果

model.iou = 0.45 # IOU阈值,解决目标重叠检测问题

model.classes = [0] # 只检测人体(类别0,YOLOv5默认类别)

model.agnostic_nms = True # 开启agnostic NMS,提升检测速度

# 初始化摄像头(平台自带摄像头,无需额外配置,参数适配实训场景)

cap = cv2.VideoCapture(0)

cap.set(cv2.CAP_PROP_FRAME_WIDTH, 640) # 画面宽度:640px

cap.set(cv2.CAP_PROP_FRAME_HEIGHT, 480) # 画面高度:480px

cap.set(cv2.CAP_PROP_FPS, 20) # 帧率:20fps,适配边缘网关算力

# 唯众云平台接口地址(用于上传报警信息)

cloud_alarm_url = "http://iot.weizhongedu.com/api/alarm/upload"

device_id = "your_device_id" # 替换为自己的设备ID

def trigger_alarm():

"""触发报警(点亮报警灯、启动蜂鸣器)"""

alarm_light.value(1)

buzzer.value(1)

time.sleep(0.5)

buzzer.value(0)

time.sleep(0.5)

# 上传报警信息至云端

try:

alarm_data = {

"deviceId": device_id,

"alarmType": "人体入侵",

"alarmTime": time.strftime("%Y-%m-%d %H:%M:%S", time.localtime()),

"status": "未处理"

}

response = urequests.post(cloud_alarm_url, json=alarm_data)

if response.status_code == 200:

print("报警信息上传成功!")

response.close()

except Exception as e:

print("报警信息上传异常:", e)

def stop_alarm():

"""停止报警"""

alarm_light.value(0)

buzzer.value(0)

print("人体入侵检测系统启动,按q退出...")

while cap.isOpened():

ret, frame = cap.read()

if not ret:

print("摄像头读取失败,检查硬件连接")

break

# 模型推理(平台边缘网关实时运行,推理延迟≤50ms)

results = model(frame)

# 解析检测结果(获取检测到的人体数量和位置)

detections = results.pandas().xyxy[0] # 检测结果DataFrame

human_count = len(detections) # 检测到的人体数量

# 结合人体红外传感器,双重验证(提升检测准确性,避免误报)

pir_status = pir_sensor.value() # 1:检测到人体,0:未检测到

# 判断是否触发入侵报警

if human_count > 0 and pir_status == 1:

print(f"检测到{human_count}人入侵,触发报警!")

trigger_alarm()

# 在画面上绘制检测框和提示信息

frame = np.squeeze(results.render()) # 绘制检测框

cv2.putText(frame, "Human Intrusion!", (50, 50), cv2.FONT_HERSHEY_SIMPLEX, 1, (0, 0, 255), 2)

else:

stop_alarm()

# 在画面上显示正常状态

cv2.putText(frame, "Normal", (50, 50), cv2.FONT_HERSHEY_SIMPLEX, 1, (0, 255, 0), 2)

# 实时预览检测画面(平台支持实时显示,可在学生端查看)

cv2.imshow('Human Intrusion Detection (Weizhong AIoT)', frame)

# 按q退出系统

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# 释放资源

cap.release()

cv2.destroyAllWindows()

stop_alarm()

print("人体入侵检测系统已退出")6.3.4 拓展场景:设备联动(智能灯控)代码示例(MicroPython)

适配平台的光照传感器和RGB灯,实现基于光照强度的智能灯控,当光照强度低于阈值时,自动点亮RGB灯,调节亮度,掌握设备联动的核心逻辑,适合基础进阶实训。

# 唯众AIoT实训平台 - 智慧安防人体入侵检测示例(基于YOLOv5s-edu)

import cv2

import torch

import time

from machine import Pin

import urequests

# 初始化硬件设备(适配唯众实训平台,无需修改接口)

# 报警灯(连接GPIO18,高电平点亮)

alarm_light = Pin(18, Pin.OUT)

alarm_light.value(0) # 初始状态:关闭报警灯

# 蜂鸣器(连接GPIO19,高电平触发)

buzzer = Pin(19, Pin.OUT)

buzzer.value(0) # 初始状态:关闭蜂鸣器

# 人体红外传感器(连接GPIO20,高电平检测到人体)

pir_sensor = Pin(20, Pin.IN)

# 加载平台预装的YOLOv5s-edu轻量化模型(体积小、算力需求低,适配边缘网关)

# 模型路径为平台默认路径,无需修改

model = torch.hub.load('ultralytics/yolov5', 'custom', path='/home/weizhong/yolov5s_edu.pt')

# 配置模型参数(适配平台边缘网关算力,优化推理速度)

model.conf = 0.5 # 置信度阈值,过滤低置信度检测结果

model.iou = 0.45 # IOU阈值,解决目标重叠检测问题

model.classes = [0] # 只检测人体(类别0,YOLOv5默认类别)

model.agnostic_nms = True # 开启agnostic NMS,提升检测速度

# 初始化摄像头(平台自带摄像头,无需额外配置,参数适配实训场景)

cap = cv2.VideoCapture(0)

cap.set(cv2.CAP_PROP_FRAME_WIDTH, 640) # 画面宽度:640px

cap.set(cv2.CAP_PROP_FRAME_HEIGHT, 480) # 画面高度:480px

cap.set(cv2.CAP_PROP_FPS, 20) # 帧率:20fps,适配边缘网关算力

# 唯众云平台接口地址(用于上传报警信息)

cloud_alarm_url = "http://iot.weizhongedu.com/api/alarm/upload"

device_id = "your_device_id" # 替换为自己的设备ID

def trigger_alarm():

"""触发报警(点亮报警灯、启动蜂鸣器)"""

alarm_light.value(1)

buzzer.value(1)

time.sleep(0.5)

buzzer.value(0)

time.sleep(0.5)

# 上传报警信息至云端

try:

alarm_data = {

"deviceId": device_id,

"alarmType": "人体入侵",

"alarmTime": time.strftime("%Y-%m-%d %H:%M:%S", time.localtime()),

"status": "未处理"

}

response = urequests.post(cloud_alarm_url, json=alarm_data)

if response.status_code == 200:

print("报警信息上传成功!")

response.close()

except Exception as e:

print("报警信息上传异常:", e)

def stop_alarm():

"""停止报警"""

alarm_light.value(0)

buzzer.value(0)

print("人体入侵检测系统启动,按q退出...")

while cap.isOpened():

ret, frame = cap.read()

if not ret:

print("摄像头读取失败,检查硬件连接")

break

# 模型推理(平台边缘网关实时运行,推理延迟≤50ms)

results = model(frame)

# 解析检测结果(获取检测到的人体数量和位置)

detections = results.pandas().xyxy[0] # 检测结果DataFrame

human_count = len(detections) # 检测到的人体数量

# 结合人体红外传感器,双重验证(提升检测准确性,避免误报)

pir_status = pir_sensor.value() # 1:检测到人体,0:未检测到

# 判断是否触发入侵报警

if human_count > 0 and pir_status == 1:

print(f"检测到{human_count}人入侵,触发报警!")

trigger_alarm()

# 在画面上绘制检测框和提示信息

frame = np.squeeze(results.render()) # 绘制检测框

cv2.putText(frame, "Human Intrusion!", (50, 50), cv2.FONT_HERSHEY_SIMPLEX, 1, (0, 0, 255), 2)

else:

stop_alarm()

# 在画面上显示正常状态

cv2.putText(frame, "Normal", (50, 50), cv2.FONT_HERSHEY_SIMPLEX, 1, (0, 255, 0), 2)

# 实时预览检测画面(平台支持实时显示,可在学生端查看)

cv2.imshow('Human Intrusion Detection (Weizhong AIoT)', frame)

# 按q退出系统

if cv2.waitKey(1) & 0xFF == ord('q'):

break

# 释放资源

cap.release()

cv2.destroyAllWindows()

stop_alarm()

print("人体入侵检测系统已退出")7. 实训场景落地:从基础操作到企业级实战全覆盖

7.1 基础实训场景(面向零基础学生)

重点培养学生的硬件操作和基础编程能力,奠定AIoT技术基础,主要包括:

-

硬件实操:传感器、执行器、边缘网关的连接与调试,掌握磁吸防呆设计的使用方法,熟悉平台硬件接口的作用。

-

基础编程:MicroPython基础语法、GPIO控制、传感器数据采集与滤波,掌握前面提到的温湿度采集、智能灯控等基础代码的编写与运行。

-

环境搭建:熟悉平台Windows/Linux双系统切换、开发环境的使用,掌握基础的代码调试方法。

7.2 进阶实训场景(面向有一定基础的学生)

聚焦AI与物联网的融合应用,培养学生的项目开发与问题解决能力,主要包括:

-

AI模型训练:基于TensorFlow、PyTorch等框架,开展MNIST手写数字识别、图像分类、人脸检测等实训,掌握模型训练、评估、优化的核心流程。

-

边缘部署:掌握模型转换、量化的方法,将训练好的模型部署至边缘网关,实现实时推理,解决跨平台部署的核心痛点。

-

设备联动:基于多传感器、执行器,开发简单的AIoT联动项目,如智慧环境监测、智能安防、智能灯控等,掌握设备联动的核心逻辑。

7.3 实战项目场景(面向高阶学生/竞赛)

完全贴合产业实际,平台提供了智慧医疗、智慧农业、工业物联网、智慧社区等多个行业的实训案例,同时支持学生自主开发项目,主要包括:

-

智慧安防:基于YOLOv5的人体入侵检测、人脸考勤、异常行为检测等项目,贴合校园、社区安防场景。

-

智慧农业:多传感器联动,实现温湿度、光照、土壤湿度的实时监测与自动灌溉,适配农业物联网场景。

-

智慧医疗:与怀化启航卫校等院校合作的医工融合实训项目,开展医疗设备联动、数据采集与分析实训,贴合医疗行业需求。

8. 教学适配优势:精准解决院校实训核心痛点

8.1 多专业兼容,提高设备复用率

平台采用平台化、模块化设计,结合通用化、标准化设计的人工智能实训工位,除了可完成人工智能实训内容,还能满足物联网、嵌入式两个专业的实训需求。这一设计大大提高了实训设备的复用率,有效解决了院校实训室场地不足、建设多个实训室资金不足的问题,尤其适合中小型院校。

8.2 教学资源完善,降低教学难度

平台除了完整的软硬件系统外,还配备了针对设备的完整人工智能实训指导书、丰富的教学实训素材资源、教学PPT、考核题库,以及基于设备系统的人工智能教学视频光盘。同时,唯众提供免费的安装部署服务和设备实训培训服务,帮助教师快速熟悉设备操作和教学方法,降低教学准备成本。

8.3 产教协同,衔接产业需求

唯众联合华为、麒麟等2000余家企业构建全链条产教协同生态,案例覆盖全国31个省级行政区,连续16年为各级技能竞赛提供技术保障。平台的实训内容紧密贴合企业实际需求,实训项目均来自真实产业场景,学生毕业后可快速适配企业岗位,解决了"教学与产业脱节"的痛点。

8.4 可扩展性强,适配教学升级

平台采用模块化设计,支持外接、扩展更多的技术或业务,随着院校教学需求的升级,可灵活添加新的硬件模块和实训内容,无需整体更换设备,有效降低了院校的长期投入成本。同时,唯众的人工智能技术团队会不定期对开发环境进行扩展,适配新的业务场景和框架版本,确保实训内容的时效性。