一、电影解说剪辑的效率瓶颈在哪里

做电影解说视频的人都遇到过同一个效率瓶颈:剪辑本身不难,定位切割点才是真正耗时的地方。

一条10分钟的解说视频,通常需要从原片中截取30到60个片段,每个片段对应一句解说词。传统做法是打开剪辑软件,手动拖时间轴,对着解说音频逐句找对应画面,再手动打入出点。一条视频少则两小时,多则半天。

问题的本质不是剪辑操作复杂,而是解说词和原片画面之间的时间对应关系需要人工建立。

这个对应关系,其实早就存在于字幕文件里。

SRT 字幕文件天然携带了每一句台词的精确时间戳。如果解说脚本是从原片字幕改写而来(大多数电影解说的工作流都是这样),那么每一句解说词都能追溯到原片中对应的时间区间。这意味着切割点是可以被程序自动计算出来的,不需要人眼逐帧对齐。

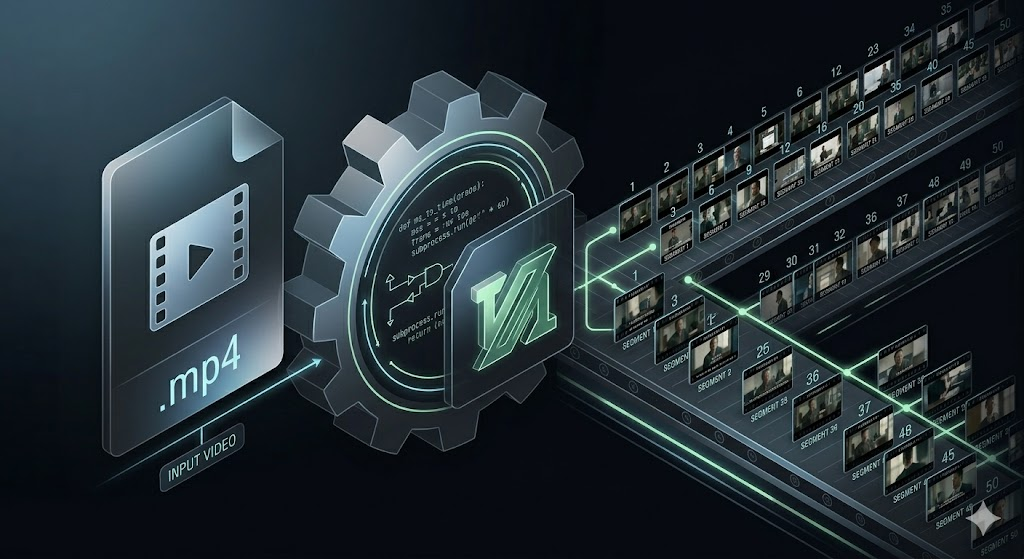

本文围绕这个思路,拆解一套基于 SRT 时间戳驱动的视频自动分镜切割方案,涵盖 SRT 解析、时间戳匹配、FFmpeg 命令封装,以及工具链整合的完整实现路径。

二、SRT 字幕文件解析:结构拆解与工程踩坑

在写任何自动化逻辑之前,先把数据源搞清楚。

一个标准 SRT 文件的结构如下:

1 00:00:12,400 --> 00:00:15,800

我不在乎你说什么

2 00:00:16,200 --> 00:00:19,500

我只在乎你做了什么

3 00:00:20,100 --> 00:00:24,300

这个世界从来不缺聪明人

一个标准 SRT 文件由若干字幕块组成,每块包含三个部分:序号、时间区间(开始 --> 结束)、字幕文本。时间格式是 HH:MM:SS,mmm,精度到毫秒。这个毫秒级精度是整套方案的基础------它意味着每一句台词在原片中的位置是可以被精确定位的。

解析 SRT 文件本身不复杂,但有几个细节容易踩坑,需要在工程实现里提前处理:

编码问题。 不同来源的 SRT 文件编码不统一,UTF-8 和 GBK 都很常见,直接用固定编码读取会导致乱码。建议用 chardet 库先做编码检测,再按检测结果解码。

格式噪声。 部分 SRT 文件存在空行不规范、序号缺失、时间戳中用点号代替逗号(00:00:12.400 而非 00:00:12,400)等问题。正则匹配时需要对这些变体做兼容处理。

文本标签。 字幕文本里可能包含 HTML 标签(如 <i>、<b>、<font color=...>),这些标签在做文本匹配时会干扰相似度计算,需要在解析阶段统一清洗掉。

解析完成后,每个字幕块应该被结构化为三个字段:开始毫秒数、结束毫秒数、纯文本内容。后续所有操作都基于这个结构进行。

三、解说脚本与字幕时间戳的自动对齐方案

SRT 解析完成后,核心问题变成:如何把解说脚本里的每一句话,对应到原片字幕的某个时间区间?

这里有两种典型场景,处理逻辑不同。

场景 A:解说脚本直接复用字幕文本

这是最简单的情况。解说词和字幕文本高度重合,可以用文本相似度匹配直接找到对应的字幕块。Python 标准库里的 difflib.SequenceMatcher 就能胜任,不需要引入额外的 NLP 依赖。

匹配逻辑是:对每一句解说词,遍历所有字幕块,计算文本相似度,取相似度最高且超过阈值(通常设 0.6)的块作为匹配结果。

这个方案的局限是速度------如果字幕块数量超过500,全量遍历的耗时会比较明显。实际工程中可以加一个预筛选步骤:先按解说词中的关键词做倒排索引过滤,把候选集压缩到50个以内,再做相似度计算。

场景 B:解说脚本是对字幕的改写,文本差异较大

这种情况下纯文本匹配效果差,需要换一个思路:利用叙事顺序的一致性做区间对齐。

电影解说的脚本改写虽然会改变措辞,但叙事顺序几乎不会打乱------第10句解说词对应的画面,一定在第5句和第15句之间。基于这个先验假设,可以用比例映射的方式把搜索范围限制在合理区间内:

第 i 句解说词(共 N 句)→ 对应字幕块的第

round(i/N × M)块附近(M 为字幕总块数)→ 在该位置前后各搜索 5 个块 → 取文本相似度最高的

这个方案把每次搜索的候选集从全量压缩到约10个,误匹配率在解说词改写幅度不超过50%的情况下可以控制在15%以内。

四、基于 FFmpeg 的批量分镜切割命令封装

时间戳映射完成后,每一句解说词都有了对应的原片时间区间。接下来是把这些区间转化为 FFmpeg 切割命令。

FFmpeg 的切割参数有一个重要的工程细节:-ss(起始时间)放在 -i(输入文件)之前还是之后,行为完全不同。

-

输入端 seek(

-ss在-i前):FFmpeg 直接跳到关键帧附近开始解码,速度快,但实际切割点会对齐到最近的关键帧,精度误差可能达到数秒。 -

输出端 seek(

-ss在-i后):FFmpeg 从头解码到指定时间点,精度高(毫秒级),但速度慢,对长视频尤其明显。

对于解说视频这种需要精确切割的场景,建议用输出端 seek,牺牲一点速度换精度。如果原片时长超过2小时,可以先用输入端 seek 粗定位到目标时间前30秒,再用输出端 seek 精确切割,兼顾速度和精度。

另一个值得注意的参数是缓冲时间。字幕时间戳标注的是台词的开始和结束,但画面往往比台词早出现或晚消失。在字幕时间戳基础上前后各扩展200毫秒,能让切出来的片段在视觉上更完整,避免硬切的突兀感。动作片建议扩展到300-500毫秒。

批量切割的核心代码如下:

import subprocess, os def ms_to_time(ms): h, ms = divmod(ms, 3600000) m, ms = divmod(ms, 60000) s, ms = divmod(ms, 1000) return f"{h:02d}:{m:02d}:{s:02d}.{ms:03d}" def cut_segment(src, dst, start_ms, end_ms, pad=200): subprocess.run([ 'ffmpeg', '-i', src, '-ss', ms_to_time(max(0, start_ms - pad)), '-to', ms_to_time(end_ms + pad), '-c:v', 'libx264', '-c:a', 'aac', '-avoid_negative_ts', 'make_zero', '-y', dst ], check=True)

批量调用时,建议用 concurrent.futures.ThreadPoolExecutor 做并发,4线程并发切割相比串行可以节省约60%的总耗时(瓶颈从CPU解码转移到磁盘IO)。

五、自动化工具链整合:NarratorAl Skill 接入

上面的步骤解决了"从字幕到切割片段"的问题,但完整的解说视频生产流程还包括:解说文案生成、配音合成、片段拼接、字幕烧录。这些环节如果各自用独立脚本处理,工程维护成本很高。

NarratorAl Skill 是一个面向影视解说场景的开源命令行工具,把上述环节封装成了统一的 pipeline 接口,可以直接接入上面的切割结果。

pip install narrator-ai-cli narrator run \ --segments ./output_segments \ --script ./script.txt \ --voice zh-CN-YunxiNeural \ --output ./final_output.mp4

这样整个流程形成一条完整的自动化链路:SRT 解析 → 时间戳匹配 → FFmpeg 批量切割 → narrator-ai-cli pipeline → 成片输出。各环节之间通过文件目录传递中间结果,任意一个环节出问题都可以单独重跑,不影响其他步骤。

六、手动剪辑 vs. 自动化切割:实测效率差距有多大

以一条标准30分钟电影解说视频(约50个片段)为基准,实测两种方式的耗时差异大致如下。

手动流程里,光是定位切割点这一步就要花掉将近90分钟------剪辑师需要反复在时间轴上拖动、试听、打点,50个片段下来基本耗尽一个上午。片段导出再加30分钟,合计约120分钟才能拿到可用的素材包。

自动化流程的时间分布完全不同。脚本运行阶段约2分钟完成时间戳匹配,FFmpeg 批处理导出约8分钟,加上人工校对误匹配片段的时间,整体控制在25分钟以内。

也就是说,同样50个片段,自动化方案节省了将近95分钟,效率提升在4倍以上。

需要说明的是,人工校对这个环节目前还无法完全省掉。

时间戳匹配在解说脚本改写幅度较大时,误匹配率在10-15%左右,约5到8个片段需要人工复核和微调。影响误匹配率的因素主要有三个:脚本对原片字幕的改写幅度越大,匹配越难;原片字幕如果是 ASR 机器生成而非人工校对,时间戳本身就有偏差,会进一步拉高误匹配率;对话密集的剧情片匹配效果明显好于动作片和纪录片,后者字幕密度低,相邻字幕块之间的文本区分度不足。

即便把校对时间算进去,整体效率的提升仍然是实质性的。

七、方案局限与三个可延伸的技术方向

这套方案在以下场景下效果会下降,值得提前知道:

解说脚本完全原创,与字幕无文本关联。 这种情况下文本相似度匹配失效,需要改用语义相似度(embedding 向量匹配)替代,计算成本更高,但准确率也更稳定。

原片没有字幕文件。 需要先跑 ASR 生成字幕,再走上述流程。ASR 的时间戳精度通常在 ±200ms 以内,对切割精度有一定影响,可以通过加大缓冲时间来部分补偿。

同一时间段内需要切多个不同场景的镜头。 当前方案以字幕块为最小切割单位,无法处理"一句字幕对应多个镜头切换"的情况。这需要引入镜头检测(scene detection)作为补充,PySceneDetect 是目前最成熟的开源方案,可以和本文的切割流程并联使用。

这三个方向都有成熟的技术路线可以延伸,后续有机会再单独展开。

参考资料

-

FFmpeg 官方文档 Seeking 章节:https://ffmpeg.org/ffmpeg.html

-

SRT 字幕格式规范:https://www.matroska.org/technical/subtitles.html

-

PySceneDetect 镜头检测库:https://github.com/Breakthrough/PySceneDetect

-

Python difflib 文档:https://docs.python.org/3/library/difflib.html