目录

在云原生架构的宏大叙事中,弹性伸缩无疑是保障系统高可用与成本效益的核心乐章。当我们谈论Kubernetes的HorizontalPodAutoscaler(HPA)时,我们实际上是在探讨如何赋予静态的应用程序以动态的生命力。本次实践以autoscale命名空间下的apache-server为例,记录了一次从基础部署到精细化弹性配置的全过程。这不仅是一次技术操作的堆叠,更是一场关于资源调度策略的深度对话,展示了如何通过声明式API精准掌控集群的脉搏。

构建弹性体系的基石,在于对目标资源的精准定位与基准设定。在autoscale这一特定的隔离环境中,我们首先确立了apache-server这一Deployment作为核心管控对象。HPA的创建并非简单的命令行执行,而是对应用负载特性的预先研判。我们将CPU利用率的目标阈值设定为50%,这一数值的选取颇具深意:它既避免了资源闲置带来的浪费,又为突发流量预留了充足的缓冲空间,防止在扩容完成前就触及性能瓶颈。与此同时,我们将副本数的下限锁定为1,上限约束为4,这不仅定义了服务的最小生存空间,也划定了成本控制的安全红线,确保集群资源不会被无限制地消耗。

如果说副本数的设定是弹性的骨架,那么"缩小稳定窗口"的配置则是赋予系统的智慧神经。在自动化的浪潮中,我们往往关注如何快速扩容以应对洪峰,却容易忽视流量退潮时的"冷启动"效应。通过将缩小稳定窗口设置为30秒,我们实际上是为系统引入了一种"犹豫机制"。这种机制能够有效过滤掉网络抖动或瞬时负载下降带来的噪音,防止Pod在临界值附近频繁地创建与销毁,即所谓的"抖动"现象。这30秒的等待,是系统对稳定性的一种坚守,它确保了每一次缩容决策都是基于持续、稳定的低负载趋势,从而保护了服务的连续性与用户体验。

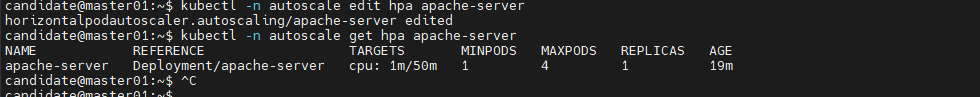

当kubectlapply命令执行完毕,屏幕上的反馈不仅是资源的创建成功,更标志着一套自动化运维逻辑的闭环。通过kubectlgethpa与describepod等指令的验证,我们看到的不仅仅是CPU指标从1m到50m的数值映射,而是一个具备自我感知、自我调节能力的智能体正在运行。apache-server不再是一个僵死的进程集合,而是一个能够根据环境变化呼吸吐纳的有机体。这次实践深刻地揭示了Kubernetes的魅力所在:它通过抽象层的配置,将复杂的运维经验固化为代码,让弹性伸缩从一种高深的理论,变成了触手可及的工程现实。

核心操作复盘

以下是实现上述架构的关键命令流,记录了从创建到调优的完整路径:

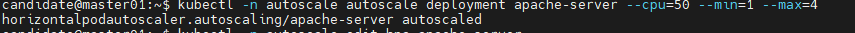

初始化HPA资源 首先,我们需要通过命令行快速定义HPA的基本边界。这里使用了新的--cpu参数替代旧版的--cpu-percent,以符合Kubernetes v2 API的标准。

kubectl -n autoscale autoscale deployment apache-server --cpu=50% --min=1 --max=4

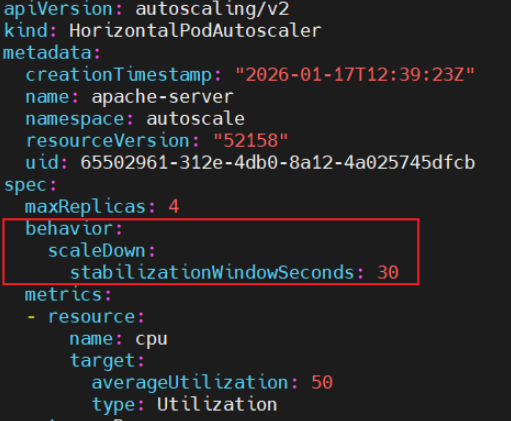

精细化调优(注入稳定窗口) 基础配置完成后,我们需要引入行为策略。通过编辑资源定义,我们在spec层级下植入了behavior配置,专门针对缩容场景设置了30秒的 stabilizationWindowSeconds。

kubectl -n autoscale edit hpa apache-server编辑器内需补充的YAML片段:

spec:

# ... 其他配置 ...

behavior:

scaleDown:

stabilizationWindowSeconds: 30

状态验证 最后,通过查看资源状态,确认各项指标(TARGETS, MINPODS, MAXPODS)均已按预期生效,且系统处于监控状态。

kubectl -n autoscale get hpa apache-server

配置参数深度解析

为了更清晰地理解上述操作背后的逻辑,以下是对题目中三个关键配置要求的详细拆解:

1、CPU使用率旨在50%( --cpu=50%****)

这是触发扩容的"红线"。HPA会实时计算所有Pod的平均CPU使用率。一旦该数值超过50%(即Pod的请求资源的一半被占用),HPA就会判定当前资源不足,开始计算需要增加多少个Pod才能将使用率拉回50%以下。

2、至少有1个Pod,且不超过4个Pod( --min=1 --max=4**)**

这是弹性伸缩的"安全围栏"。

- 最小值1:保证服务永远在线,即使没有流量,也保留一个"守夜人"处理请求,避免缩容到0导致的冷启动延迟。

- 最大值4:防止资源失控。即使流量再大,系统最多只扩展到4个Pod,防止因配置错误或异常流量耗尽整个集群的资源。

3、缩小稳定窗口设置为30秒( stabilizationWindowSeconds: 30**)**

这是防止"由于过度敏感导致的震荡"。如果没有这个设置,当CPU使用率在50%上下反复横跳时,Pod数量也会随之疯狂增减。设置30秒意味着:即使CPU使用率瞬间掉下来,HPA也会"观察"30秒。只有在这30秒内指标持续维持低位,它才会真正执行缩容操作。这就像是给系统装了一个阻尼器,让运行更加平滑

HorizontalPod自动比例器攻略

查看官方文档:https://kubernetes.io/docs/tasks/run-application/horizontal-pod-autoscale-walkthrough/