一、为什么要用 deepseek‑v4‑pro

DeepSeek‑V4‑Pro 支持百万级上下文 ,并且在代码理解/大项目检索场景表现很稳;通过 Cursor 的 OpenAI Compatible 方式即可接入,不需要等官方内置 Provider。

二、前置准备

-

安装/升级到较新版本 Cursor(Settings → About 可查看)。

-

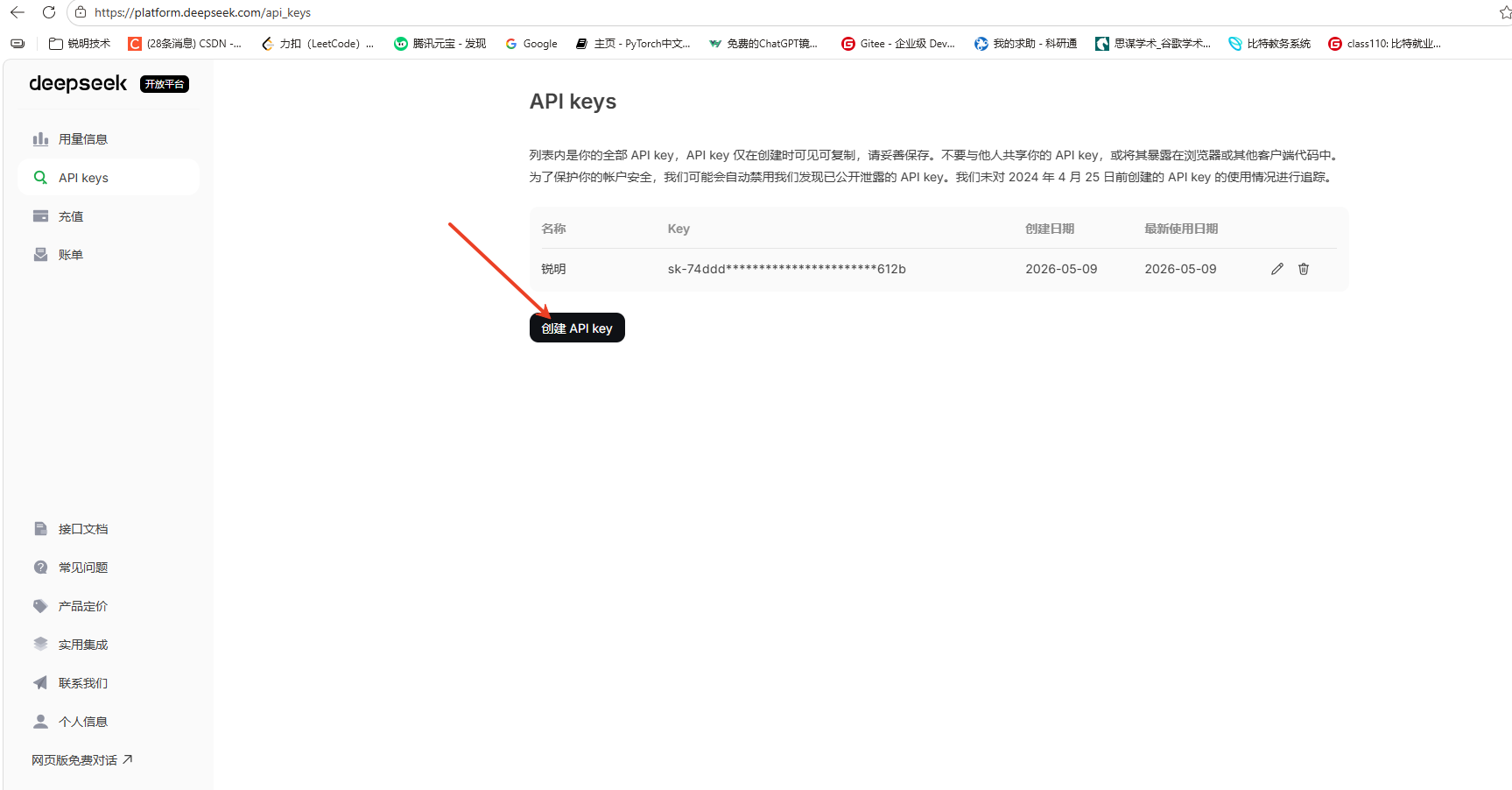

准备一个能调用

deepseek-v4-pro的 API Key(DeepSeek 官方 / 聚合网关 /硅基流动等均可,只要兼容 OpenAI 协议)。

-

确认网络可访问你填写的 Base URL(官方地址在国外时可能需要稳定网络)。

三、接入方式一:Cursor Settings UI(最快)

-

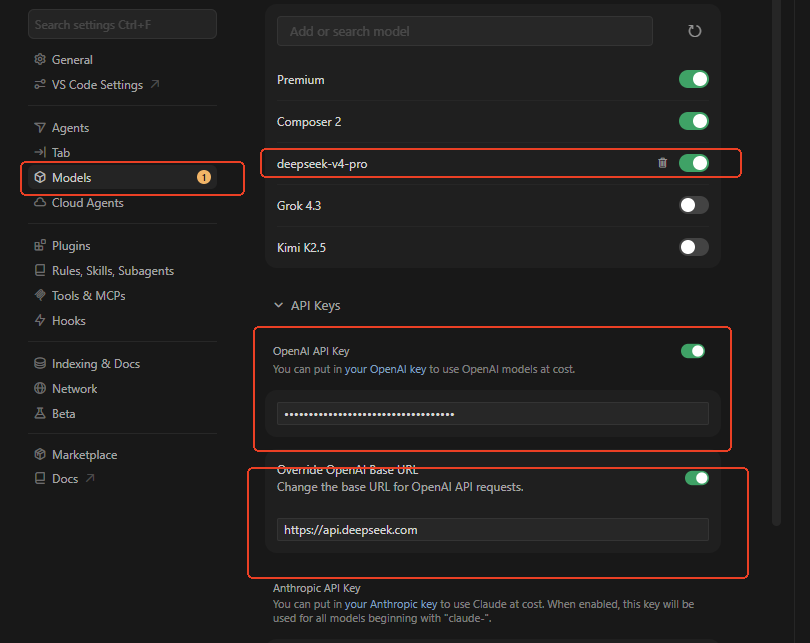

打开 Cursor Settings → Models。

-

页面底部找到 "Add model":

-

Model name :

deepseek-v4-pro -

勾选/选择 OpenAI Compatible

-

-

填写:

-

Override OpenAI Base URL :例如 DeepSeek 官方

https://api.deepseek.com(若用聚合/中转,填对应/v1地址) -

API Key :你的 DeepSeek API Key

-

-

保存后,在 Cursor 的模型选择器里即可切换到

deepseek-v4-pro。

说明:DeepSeek 官方文档给出的 OpenAI 兼容

base_url为https://api.deepseek.com,模型名用deepseek-v4-pro。

四、接入方式二:直接改 settings.json(更稳,不易被重置)

-

Cmd/Ctrl + Shift + P→ Open User Settings (JSON)。 -

加入自定义模型配置(示例):

{

"cursor.aiModels": [

{

"name": "deepseek-v4-pro",

"provider": "openai-compatible",

"apiKey": "sk-your-api-key-here",

"baseUrl": "https://api.deepseek.com",

"model": "deepseek-v4-pro",

"contextLength": 1000000,

"maxTokens": 8192,

"temperature": 0.3

}

],

"cursor.defaultModel": "deepseek-v4-pro",

"cursor.chat.contextLength": "long"

}

要点:

-

contextLength: 1000000用于告诉 Cursor 该模型支持大上下文; -

maxTokens可按需调整(V4‑Pro 输出长度上限更高,但建议先保守); -

保存后重启 Cursor,聊天窗口左上角切换模型即可。

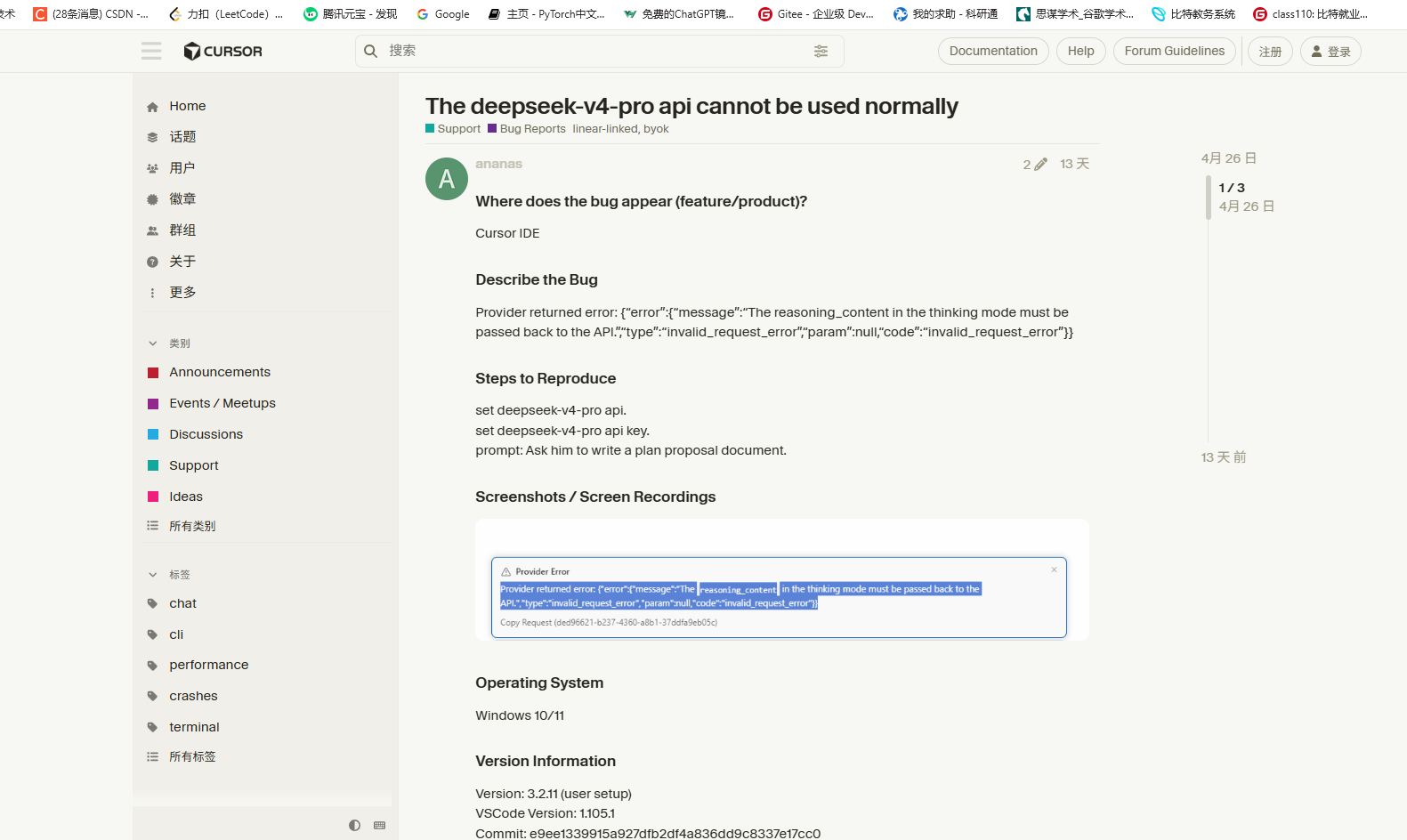

五、必须知道的坑:reasoning_content报错

你如果遇到类似报错:

Provider returned error: {"error":{"message":"The reasoning_content in the thinking mode must be passed back to the API.","type":"invalid_request_error",...}}这通常是因为:DeepSeek V4‑Pro 的思考(thinking/reasoning)模式在多轮/工具调用时,要求回传 reasoning_content,而 Cursor 当前 BYOK 路径有时会未携带该字段,从而触发校验失败。

常见应对思路(也是博客里建议读者做的):

目前的解决/规避方案

-

使用社区代理(目前最稳妥的临时方案)

有开发者做了一个中间代理层,放在 Cursor 和 DeepSeek API 之间,自动补全 Cursor 漏传的

reasoning_content字段。你可以在 Cursor 的 API Base URL 里填这个代理地址:- 项目地址:yxlao/deepseek-cursor-proxy (GitHub)

-

等待 Cursor 官方修复

Cursor 论坛已确认这是已知问题(BYOK 路径下未存储该字段),官方修复前暂时只能通过代理规避。

-

临时规避:避免触发 Tool Call 的长多轮链路

如果是简单问答、不涉及复杂 Agent 工具调用链,有时可能不会立刻触发这个错误,但无法根治。

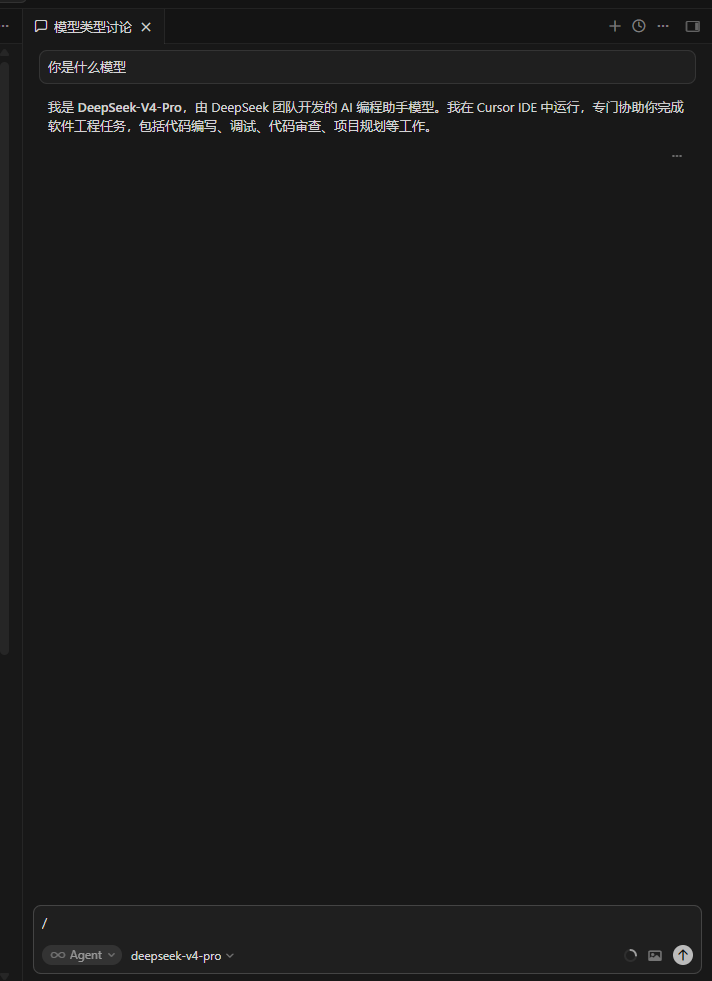

六、简单验证

在 Cursor 聊天里问一句:「用一句话介绍当前文件的作用」,能正常回复即说明模型通路 OK。