作为人工智能专业的学习者/开发者,你是否曾陷入"理论懂一堆,实操无从下手"的困境?想买散件搭建无人驾驶实验平台,却被硬件接线、驱动适配、算法部署搞到崩溃?今天给大家安利一款"开箱即用"的宝藏实训装备------唯众无人驾驶智能小车实训平台,不仅能跳过繁琐的环境搭建,更能从基础硬件调试到高阶算法开发,手把手带你打通无人驾驶全链路技术。

先给大家划重点,这款平台绝非"玩具级"小车,而是工业级标准的一体化教学实训装备。它深度融合环境感知、嵌入式智能控制、ROS机器人系统、线控底盘驱动四大核心技术,覆盖从入门到工程落地的全流程实训,高校教学、竞赛备赛、个人开发者练手、科研项目验证,都能完美适配。

一、产品简介

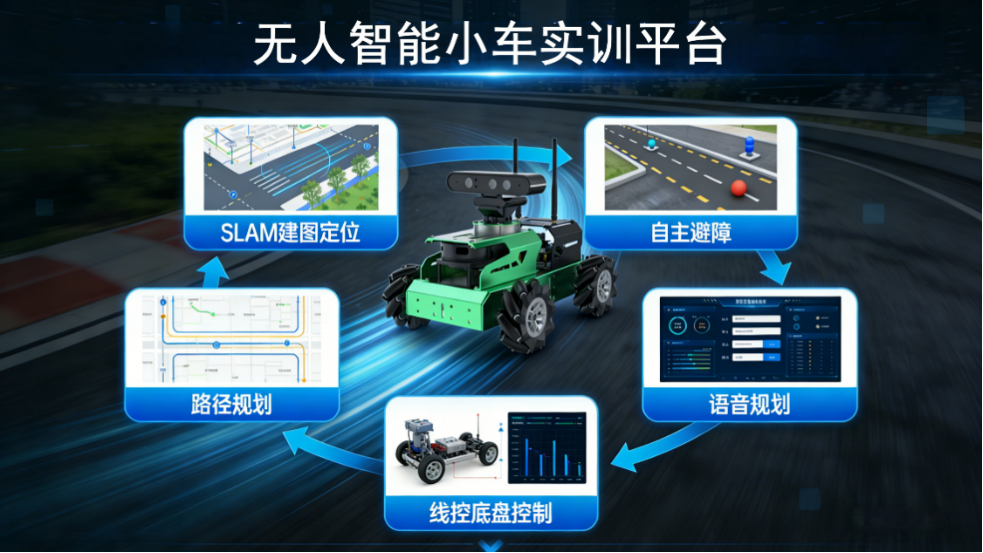

该款无人驾驶智能小车实训平台是一款面向智能网联汽车、人工智能、机器人工程、自动化等领域的一体化无人驾驶综合教学实训装备,以标准化智能小车为载体,深度融合环境感知技术、嵌入式智能控制技术、ROS 机器人系统技术、线控底盘驱动技术四大核心技术,通过阶梯式基础实验与综合项目案例,构建从无人驾驶基础入门到工程应用落地的全流程实践教学体系。

该款无人驾驶智能小车实训平台是一款面向智能网联汽车、人工智能、机器人工程、自动化等领域的一体化无人驾驶综合教学实训装备,以标准化智能小车为载体,深度融合环境感知技术、嵌入式智能控制技术、ROS 机器人系统技术、线控底盘驱动技术四大核心技术,通过阶梯式基础实验与综合项目案例,构建从无人驾驶基础入门到工程应用落地的全流程实践教学体系。

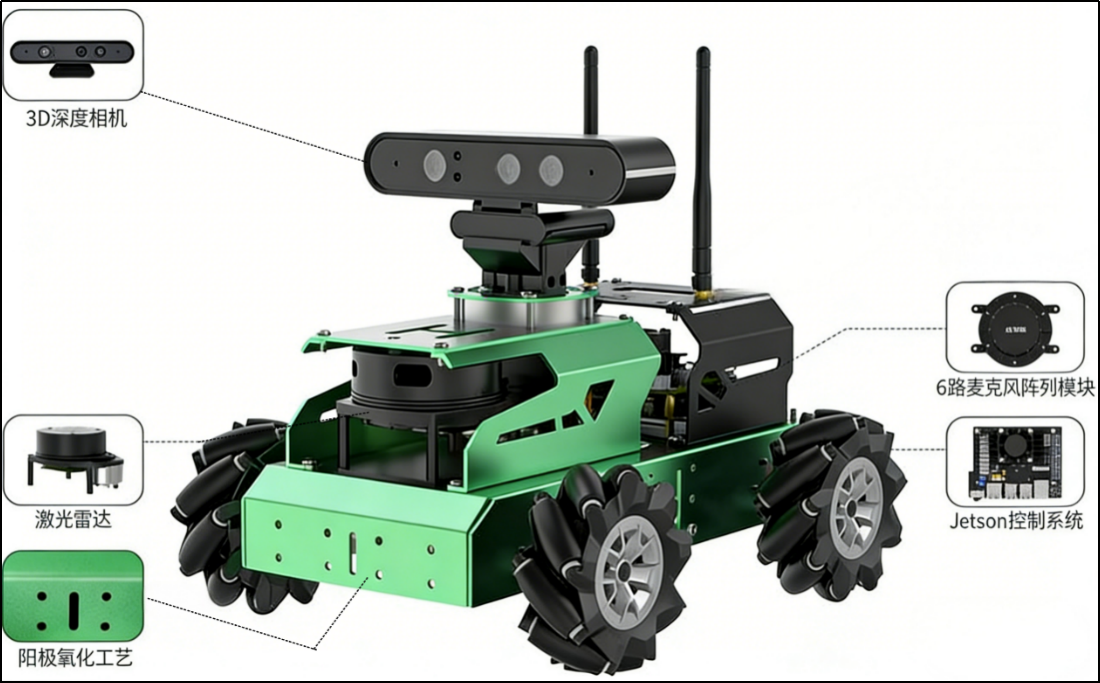

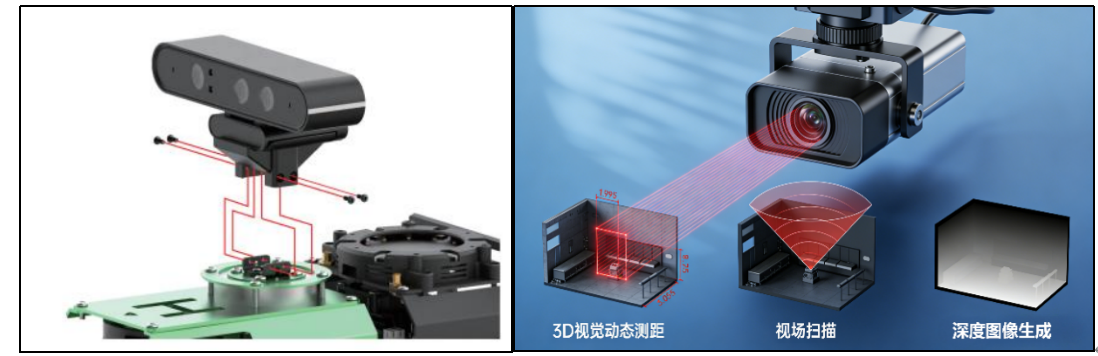

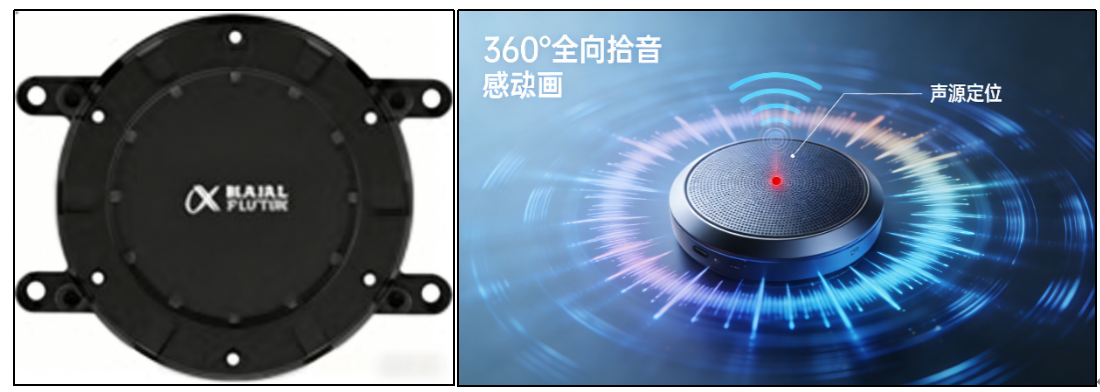

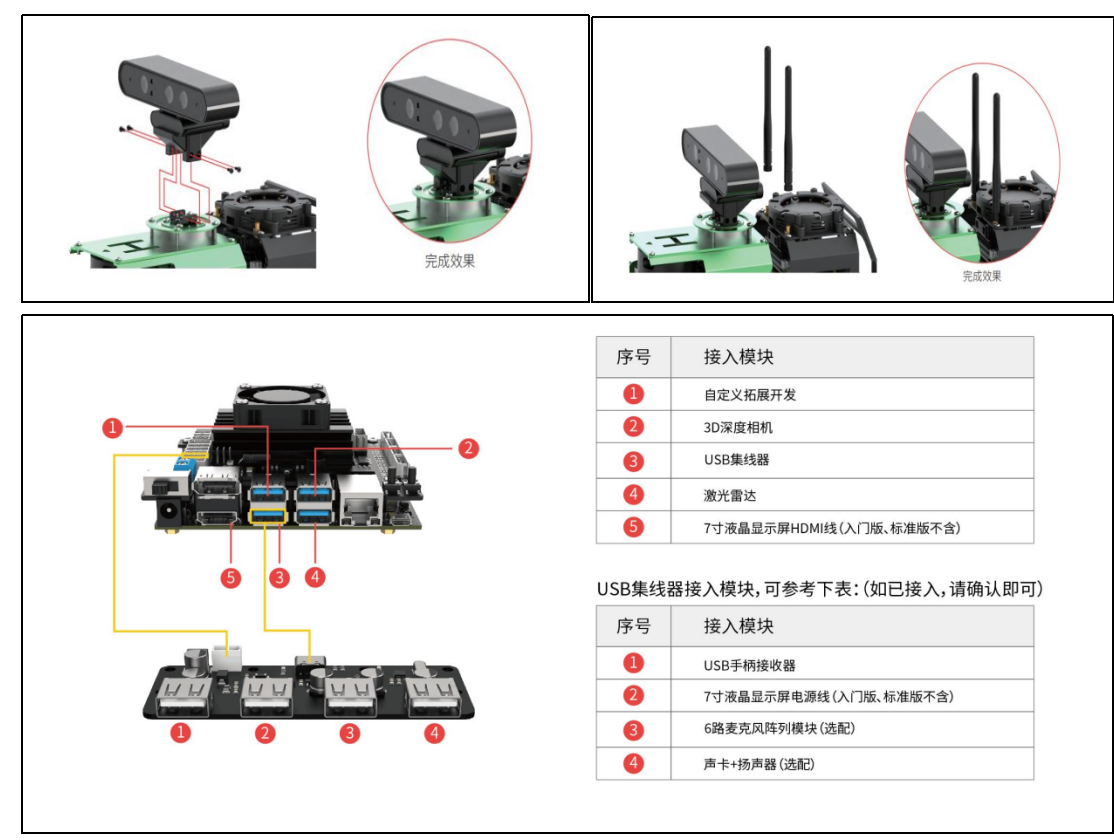

平台采用模块化一体化集成设计,将高精度激光雷达、实感深度相机、高算力机控服务器、6麦全向麦克风阵列、线控开发汽车底盘高度整合,形成环境感知---智能决策---运动控制---人机交互四位一体的硬件教学载体,为无人驾驶传感器标定、算法开发、底盘控制、智能交互等多维度实训提供稳定可靠的物理支撑。

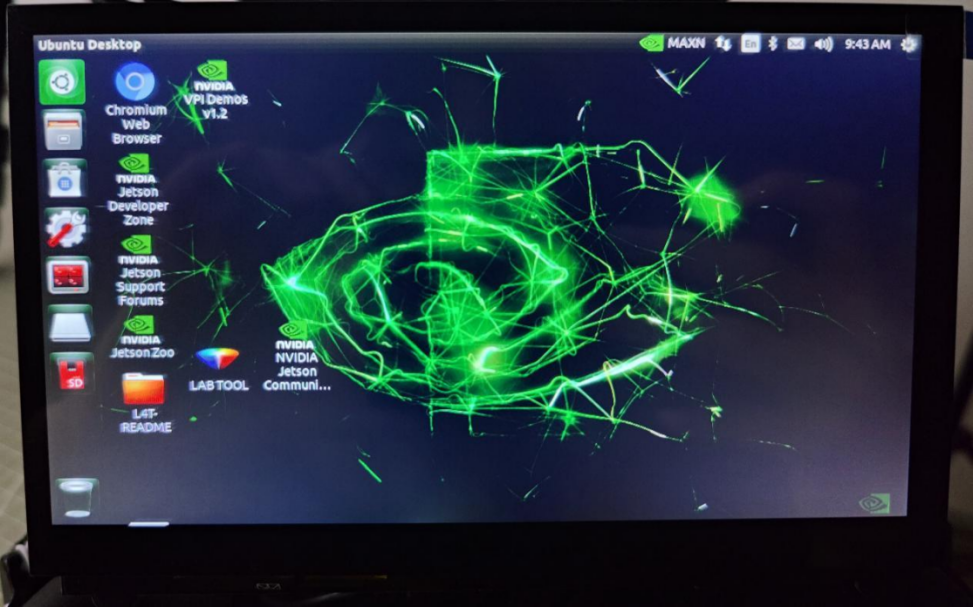

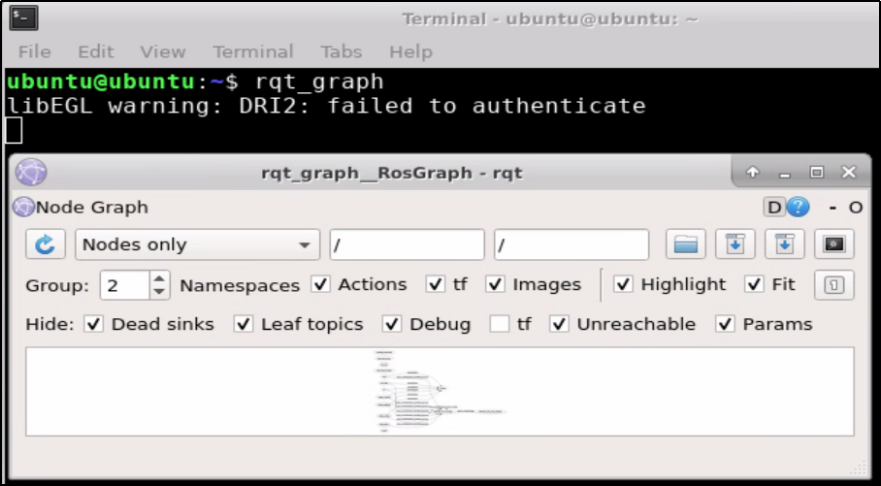

平台搭载 Ubuntu 18.04 嵌入式开发环境,内置完整的 ROS 机器人系统框架,配套激光雷达、实感深度相机、麦克风阵列、线控底盘专属 ROS 驱动程序,支持传感器数据可视化、节点通信、算法联合调试,大幅降低无人驾驶开发与硬件对接门槛,满足从基础硬件调试到高阶算法实践的全场景教学需求。

平台全面覆盖无人驾驶传感器应用、ROS 系统开发、SLAM 建图定位、路径规划、自主避障、语音交互、线控底盘控制等核心实训内容,配套完整系统镜像、驱动源码与图文实训指导资源,可全面满足高校、职业院校在智能网联汽车、人工智能、机器人工程等相关专业的课程教学、综合实训、创新开发及竞赛备赛需求。

平台以一体化硬件、完善的 ROS 软件生态与系统化实验资源为支撑,实现教学、实训、开发、竞赛多场景覆盖,有效衔接理论教学与工程实践,全面培养学生的无人驾驶感知应用能力、嵌入式开发能力、智能决策算法设计能力与线控底盘控制能力,是面向智能交通与机器人专业群的高品质综合教学实训装备。

二、产品特点

1.多技术深度融合,构建无人驾驶全链路实训体系

平台创新性融合环境感知、嵌入式智能控制、ROS 机器人系统、线控底盘驱动四大核心技术,打破单一技术实训壁垒,打造覆盖无人驾驶基础学习---传感器标定---算法开发---底盘控制---综合应用的完整实践链,高度贴合新一代智能网联汽车与无人驾驶技术人才培养需求。

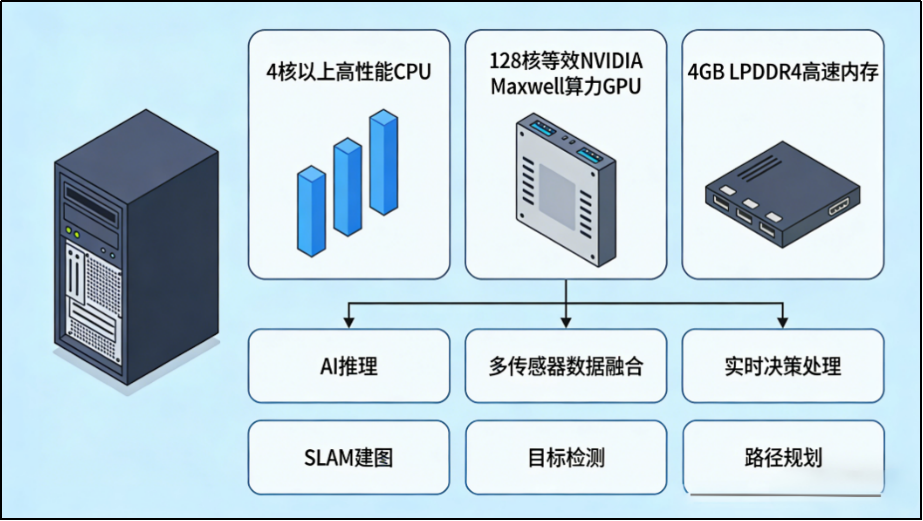

2.高性能算力配置,支撑无人驾驶多任务处理

机控服务器搭载4核以上高性能CPU、128核等效 NVIDIA Maxwell 算力 GPU 与 4GB LPDDR4 高速内存,具备充足的 AI 推理、多传感器数据融合与实时决策处理能力,可流畅运行 SLAM 建图、目标检测、路径规划等主流无人驾驶算法,满足复杂场景下的算力需求。

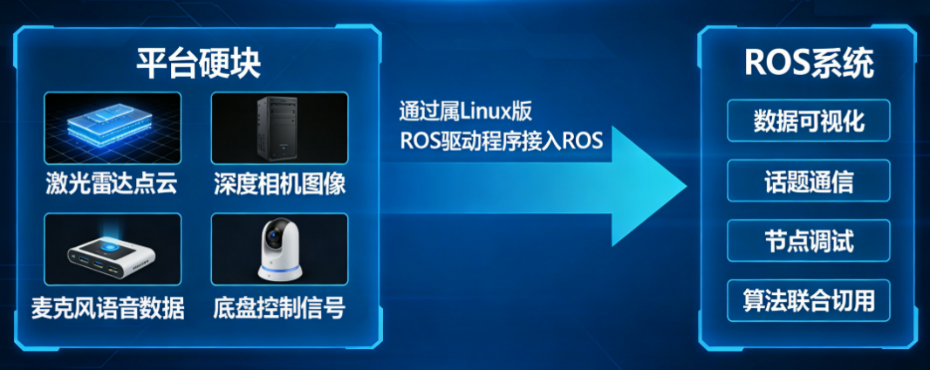

3.全生态ROS适配,降低开发与调试门槛

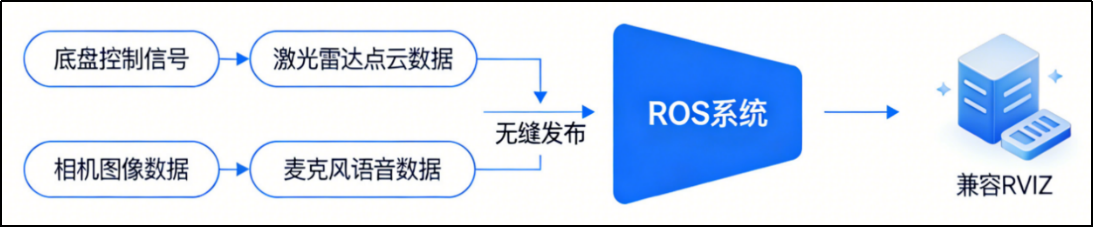

平台所有硬件均配套专属 Linux 版 ROS 驱动程序,可将激光雷达点云、深度相机图像、麦克风语音数据、底盘运动控制信号无缝接入 ROS 系统,实现数据可视化、话题通信、节点调试与算法联合调用,无需复杂的底层协议开发,大幅降低无人驾驶开发入门门槛。

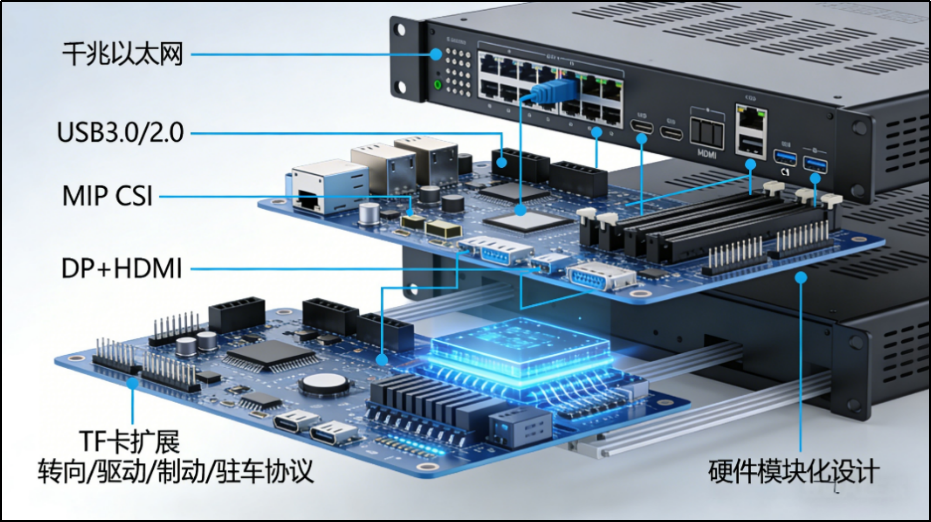

4.丰富接口与扩展能力,适配二次开发需求

机控服务器配备千兆以太网、多路 USB3.0/2.0、双路 MIPI CSI、DP+HDMI 等丰富 I/O 接口,支持 TF 卡外部存储扩展,线控底盘开放转向、驱动、制动、驻车全协议对接,硬件模块化设计便于拆装、调试与功能升级,可满足个性化创新开发与科研项目需求。

5.工业级安全设计,保障实训稳定运行

各硬件单元均设定合规工作温度区间,深度相机采用 Class 1 激光安全等级,激光雷达、底盘等核心部件供电与功耗参数匹配实训场景长期运行需求,兼顾设备运行稳定性与教学使用安全性,适配实验室与户外实训多环境使用。

6. 跨系统多端兼容,适配多元开发场景

实感深度相机、麦克风阵列兼容 Windows、Linux、MacOS、Android 等多操作系统,机控服务器预装 Ubuntu 18.04 并支持与上位机跨系统通信,可满足不同开发习惯的实训需求,拓展性与复用性强。

三、产品组成

1.硬件(工业级配置,拒绝"入门阉割")

平台采用模块化智能小车结构,将激光雷达、实感深度相机、机控服务器、麦克风阵列、线控底盘等核心硬件高度集成,各模块接口标准化设计,布局规整紧凑,兼具便携性与教学实用性,可同时满足课堂集中实训、户外场地测试与课外创新开发的双重场景需求。

|-----------------|----------------------------------------------------------------------------|--------------------------------------------------|

| 名称 | 图片 | 功能 |

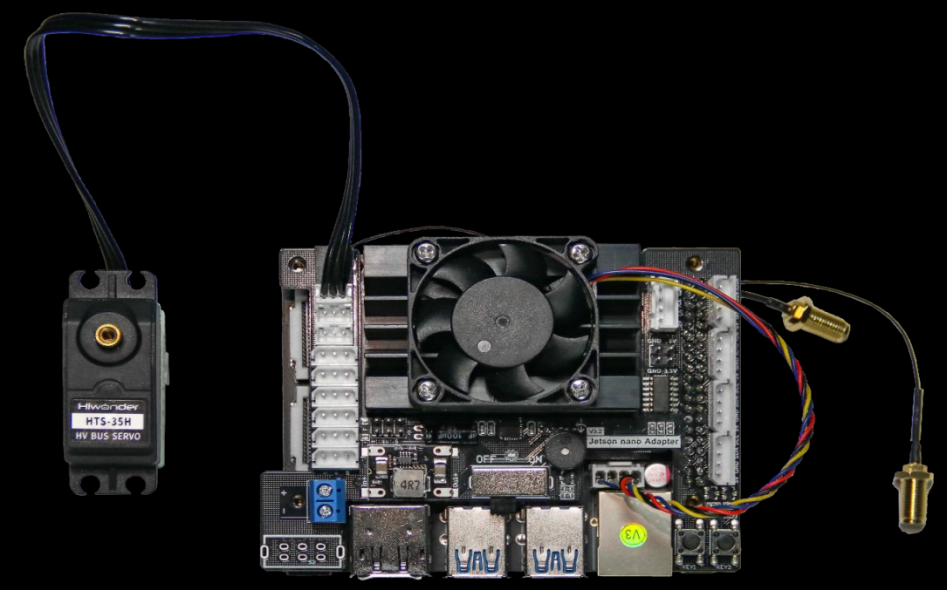

| Jetson Nano控制系统 |  | 包括扩展板和开发板,可将实时计算机视觉应用到各种复杂的深度神经网络模型,创建全新的AI项目平台。 |

| 包括扩展板和开发板,可将实时计算机视觉应用到各种复杂的深度神经网络模型,创建全新的AI项目平台。 |

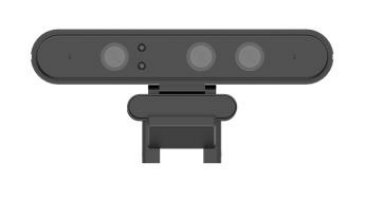

| 3D深度相机 |  | 高清摄像,深度图像数据处理,实现多场景、高精度的AI识别。 |

| 高清摄像,深度图像数据处理,实现多场景、高精度的AI识别。 |

| 激光雷达 |  | 全方位精确测量,实现测距、避障、多种建图等功能。 |

| 全方位精确测量,实现测距、避障、多种建图等功能。 |

| 六路麦克风阵列模块 |  | 可实现声源定位、语音控制、语音导航功能。 |

| 可实现声源定位、语音控制、语音导航功能。 |

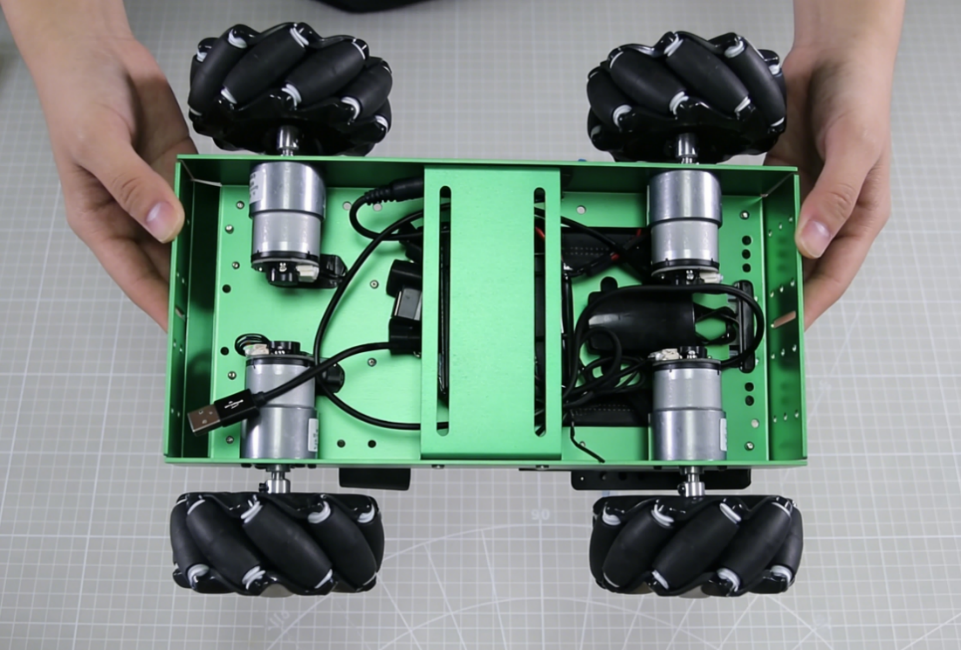

1. 线控开发汽车底盘单元

作为平台的运动控制载体,开放转向、驱动、制动、驻车全信号协议,适配 Linux 操作系统与 ROS 机器人系统框架,可通过专属 ROS 驱动实现与智能操控系统的无缝通信,完成底盘运动状态的精准控制,为无人驾驶运动控制实训提供核心硬件支撑。

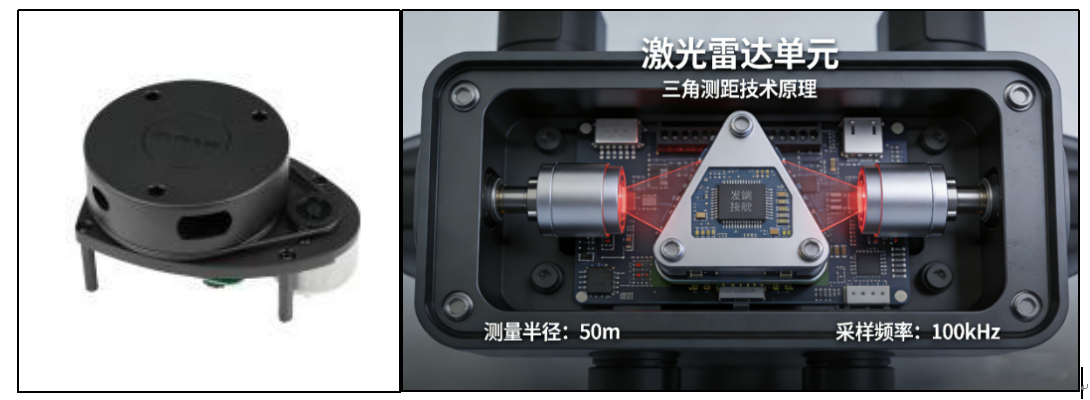

2. 激光雷达单元

支持三角测距技术,测量半径覆盖 0.12m-16m,采样频率不低于 9000 次 / 秒,实现 360°全向扫描,扫描频率 5Hz-12Hz、角度分辨率 0.2-0.48°,通信速率 230400bps,采用 UART 串口(3.3V 电平)输出,5V/1000mA 供电,尺寸 727141mm,0℃-50℃稳定工作,相对误差 2.0%(1m <测距≤8m)、2cm (测距≤1m),为环境测距与建图提供高精度点云数据。

具体数据表格如下:

|--------|----------------------------|

| 项目 | 参数 |

| 测距技术 | 支持三角测距 |

| 测量半径 | 0.12m-16m |

| 测量频率 | 9000次/秒 |

| 扫描频率 | 5Hz-12Hz |

| 扫描角度范围 | 0-360° |

| 角度分辨率 | 0.2-0.48° |

| 采样频率 | 不低于9000 |

| 通讯速率 | 230400bps |

| 尺寸 | 72×71×41mm |

| 供电电流 | 1000mA |

| 供电电压 | 5V |

| 输出接口 | UART串口(3.3V电平) |

| 工作温度 | 0℃-50℃ |

| 相对误差 | 2.0%(1m<测距≤8m)、2cm(测距≤1m) |

3. 实感深度相机单元

搭载 3D 视觉技术,深度工作范围 0.6-8m,1m 处测距精度 ±3mm,深度相机视场角不低于 H58.4°×V45.8°,分辨率 @帧率不低于 640×480@30fps,配备算力不低于 MX6000 的深度处理芯片;RGB 相机支持多分辨率帧率输出,视场角适配19201080/1280720/640*480 多种规格,支持近距离保护,采用 Class 1 安全级激光,USB2.0 及以上数据接口,功耗<2.5W,10℃-40℃工作温度,为计算机视觉识别、障碍物检测提供高清深度与视觉图像。

具体数据表格如下:

|--------------|-------------------------------------------------------------------------|

| 项目 | 参数 |

| 3D技术 | 支持3D技术 |

| 深度摄像头工作范围 | 0.6-8m |

| 深度摄像头精度 | 1m处±3mm |

| 深度摄像头视场角 | 不低于H58.4°×V45.8° |

| 深度摄像头分辨率@帧率 | 不低于640×480@30fps |

| 深度处理芯片 | 算力不低于MX6000 |

| 近距离保护 | 支持近距离保护 |

| RGB摄像头视场角 | H66.73°V40.19°@1920×1080、H66.99°V40.37°@1280×720、H60.60°V46.81°@640×480 |

| RGB摄像头分辨率@帧率 | 1920×1080@30fps、1280×720@30fps、640×480@30fps |

| 操作系统 | 支持Windows XP/7/10 32/64bits、Linux 32/64bits以及MacOS 64bits |

| 数据接口 | 支持USB2.0及以上 |

| 功耗 | <2.5W |

| 工作温度 | 10℃-40℃ |

| 安全性 | Class 1激光 |

4. 机控服务器单元

作为平台的智能决策核心,CPU 不低于 4 核心且最大频率 1.43GHz,配备 4GB 64 位 LPDDR4 内存(传输速率 25.6GB/s),支持外部 TF 卡存储扩展,GPU 不低于 128 核 NVIDIA Maxwell 同等算力;集成 1×SDIO/2×SPI/4×I2C 等 I/O 接口,DP+HDMI 显示接口,不少于 1 个 USB3.0(5Gbps)+3 个 USB2.0 接口,双路 MIPI CSI 摄像头接口,1× 千兆以太网;功率 5W-10W。

预装 Ubuntu 18.04 开发环境,兼顾 AI 算力与实时控制能力,支撑多算法同时运行与多设备协同控制。

具体数据表格如下:

|--------|---------------------------------|

| 项目 | 参数 |

| CPU | 不低于4核心,最大频率为1.43GHz |

| 内存 | 4GB 64位LPDDR4 25.6GB/s |

| 存储 | 支持外部TF卡 |

| GPU | 不低于128核NVIDIA Maxwell同等算力 |

| I/O接口 | 1×SDIO/2×SPI/4×I2C/2×I2S/GPIO |

| 功率 | 5W-10W |

| 预装开发环境 | Ubuntu系统版本18.04 |

| 显示接口 | DP+HDMI |

| USB | 不少于1个USB3.0接口(5Gbps)和3个USB2.0接口 |

| 摄像头接口 | 不少于两路MIPI CSI摄像头接口 |

| 网络 | 支持1×千兆以太网 |

5. 麦克风阵列单元

板载6个数字麦克风,实现360°全向拾音,拾音距离3.5m,声源定位角度精度不高于1°;支持音频降噪、回声消除、声源定位与语音播报功能,兼容 Windows XP/7/10 32/64bits、Linux 32/64bits 及 Android 操作系统,支持普通话与英语双语言识别,为无人驾驶语音交互、声源定位实训提供硬件支撑。

具体数据表格如下:

|----------|------------------------------------------------------|

| 项目 | 参数 |

| 麦克风数量 | 板载6个数字麦克风 |

| 声源定位角度精度 | 不高于1° |

| 拾音距离 | 3.5m |

| 角度范围 | 360° |

| 功能 | 支持音频降噪、回声消除、声源定位与语音播报 |

| 操作系统 | 支持Windows XP/7/10 32/64bits、Linux 32/64bits以及Android |

| 语言 | 普通话与英语 |

2.软件生态(ROS全适配,开箱即用,跳过繁琐环境搭建)

1. 嵌入式开发操作系统

搭载 Ubuntu 18.04 64 位嵌入式 Linux 操作系统,提供完整的系统运行环境与驱动支撑,兼容 ROS 机器人系统框架全功能模块,支持系统镜像备份、一键还原与固件升级,无需额外配置开发环境,开箱即可开展无人驾驶算法开发与硬件调试实训。

内置 Python3、C/C++ 等主流编程环境,以及 OpenCV、PCL(点云库)等无人驾驶常用工具库,可直接运行点云处理、图像识别、路径规划等算法,实现从代码编写到算法部署的全流程开发。

2. ROS 专属驱动程序

为平台所有硬件配备定制化 Linux 版 ROS 驱动程序,实现硬件与 ROS 系统的深度适配,包含线控底盘 ROS 驱动、激光雷达 ROS 驱动、实感深度相机 ROS 驱动、麦克风阵列 ROS 驱动四大核心驱动模块,可将底盘控制信号、激光雷达点云数据、相机图像数据、麦克风语音数据无缝发布到 ROS 系统中,完成多设备数据的统一调度与通信。

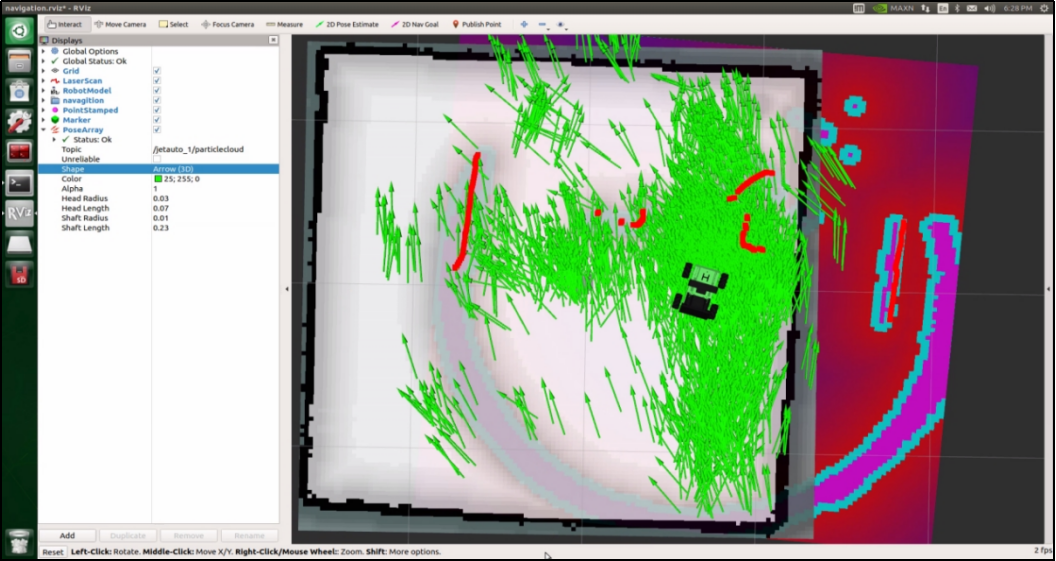

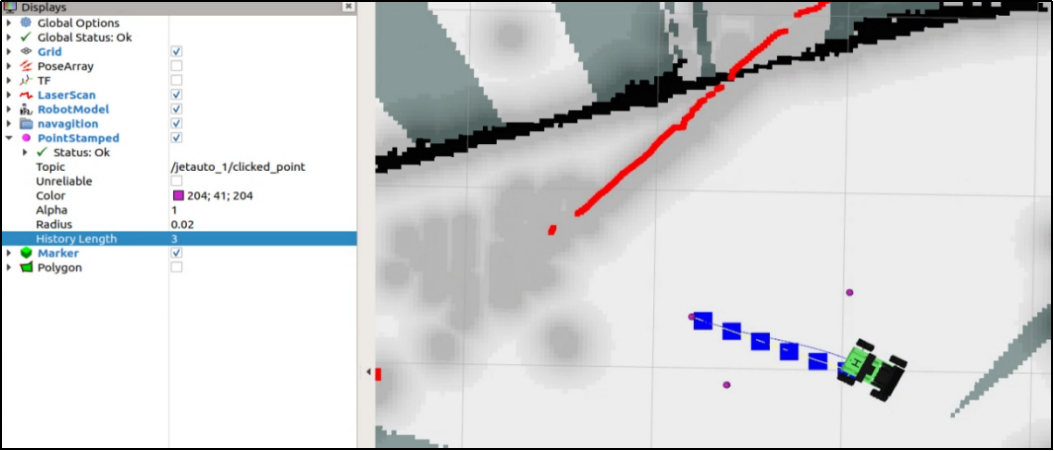

驱动程序支持 ROS 节点可视化调试、数据话题订阅与发布、参数实时调整,兼容 RVIZ、Gazebo 等 ROS 主流可视化与仿真工具,实现实训过程的可视化监控与调试。

3. 实训教学资源(从基础到高阶,覆盖全流程)

平台配套标准化实训指导文档,内容涵盖实验目的、原理讲解、硬件接线、驱动部署、代码编写、现象分析、拓展思考等全流程。同时提供完整的项目开发源码与注释,包含SLAM建图、路径规划、语音控制等典型案例,即便是新手也能快速上手。

四、核心技术实训:从基础到高阶,打通无人驾驶全链路

这款平台的核心价值在于"实训落地",覆盖无人驾驶核心技术的全流程实训。下面重点拆解3个高频实训场景,同步分享实操要点与技巧。

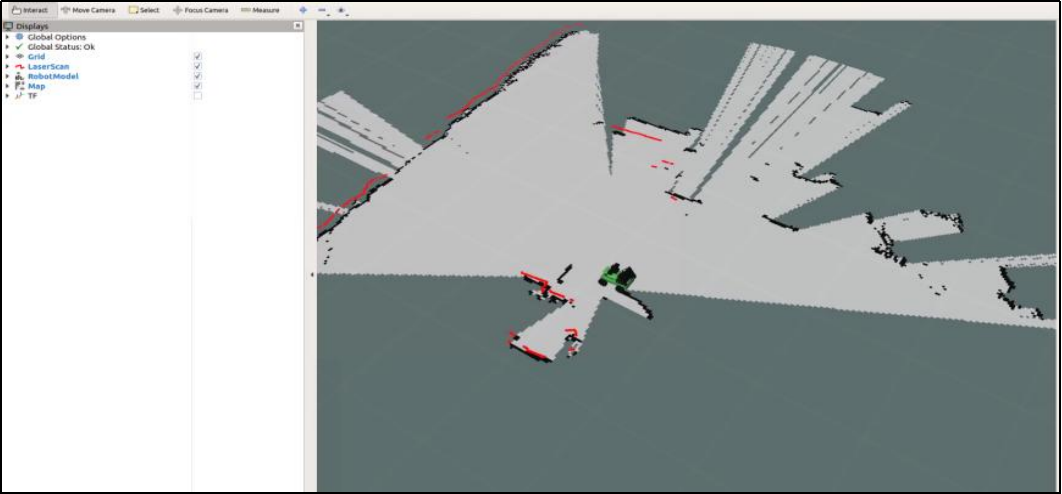

1. 激光雷达+SLAM建图实训(入门必练)

SLAM建图是无人驾驶的基础,也是各类竞赛的高频考点。这款平台支持GMapping(二维建图)、Cartographer(三维建图)两种主流算法,实操步骤与技术要点如下。

-

实操步骤清晰易懂,先启动ROS核心节点,再启动激光雷达驱动,随后启动SLAM算法节点,控制小车移动完成建图,最后保存地图(map文件)即可。

-

实操过程中需注意一些技术细节,合理优化参数才能提升实训效果。

-

GMapping算法可通过调整sigma、kernel_size等参数减少地图噪声,提升建图精度,经过实测,sigma=0.05、kernel_size=3时效果最佳。

-

Cartographer算法可借助平台充足的GPU算力开启GPU加速,修改配置文件中的use_gpu=true,就能让建图速度提升30%以上。

-

地图保存可使用rosrun map_server map_saver -f ~/map命令,将地图保存为pgm和yaml文件,后续可直接用于AMCL定位实训。

-

激光雷达的采样频率与扫描频率需要合理匹配,建议将扫描频率设置为10Hz,采样频率保持9000次/秒,这样能避免因数据采集不及时导致建图出现断层。

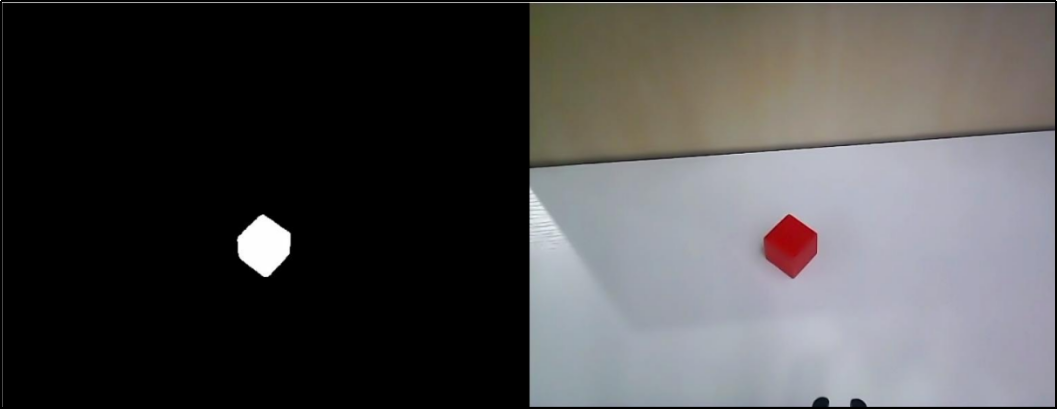

2. 计算机视觉实训(OpenCV+目标检测)

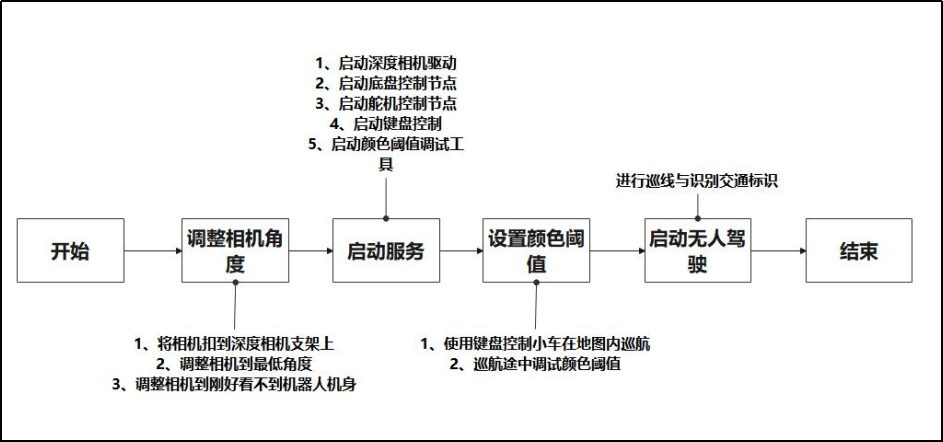

依托实感深度相机,可开展图像预处理、颜色识别、目标检测等各类实训。这里以"交通标志检测"为例,分享具体实操思路。

-

图像预处理可通过OpenCV完成,核心操作包括灰度化、高斯滤波、边缘检测,相关代码片段如下:

import cv2

import numpy as np读取相机图像(ROS话题订阅获取,此处简化为本地读取)

img = cv2.imread("traffic_sign.jpg")

灰度化

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

高斯滤波去噪

blur = cv2.GaussianBlur(gray, (5,5), 0)

边缘检测

canny = cv2.Canny(blur, 50, 150)

显示处理后的图像

cv2.imshow("canny", canny)

cv2.waitKey(0)

cv2.destroyAllWindows() -

目标检测可基于YOLOv5训练交通标志数据集,将其部署到平台的机控服务器。借助平台充足的GPU算力,检测帧率可稳定在20fps以上,同时结合深度相机的距离数据,能实现"检测+测距"一体化,精准判断交通标志的距离与类型。

3. ROS节点通信+底盘控制实训(核心实操)

掌握ROS节点通信,是实现无人驾驶智能决策的基础。本次实操目标是通过Python代码控制小车前进、后退、转向,同时获取激光雷达数据,实现简单避障功能。

#!/usr/bin/env python3

import rospy

from geometry_msgs.msg import Twist

from sensor_msgs.msg import LaserScan

class CarControl:

def __init__(self):

self.pub = rospy.Publisher("/cmd_vel", Twist, queue_size=10) # 发布底盘控制指令

self.sub = rospy.Subscriber("/laser/scan", LaserScan, self.laser_callback) # 订阅激光雷达数据

self.twist = Twist()

self.obstacle_distance = 1.0 # 避障阈值,小于1m则避障

def laser_callback(self, msg):

# 获取正前方(角度0°)的距离

front_distance = msg.ranges[180] # 假设180对应正前方,根据平台配置调整

rospy.loginfo(f"正前方距离:{front_distance:.2f}m")

# 避障逻辑

if front_distance < self.obstacle_distance:

# 遇到障碍物,停止前进,转向

self.twist.linear.x = 0.0 # 停止前进

self.twist.angular.z = 0.5 # 向右转向

else:

# 无障碍物,匀速前进

self.twist.linear.x = 0.2 # 前进速度0.2m/s

self.twist.angular.z = 0.0 # 不转向

self.pub.publish(self.twist)

if __name__ == "__main__":

rospy.init_node("car_control")

car = CarControl()

rospy.spin()底盘控制有几个关键细节需要注意,其话题名称为/cmd_vel,消息类型为Twist。linear.x用于控制前进/后退速度,正值为前进,负值为后退;angular.z用于控制转向,正值为向右,负值为向左。速度值需结合底盘性能合理调整,避免速度过快导致小车失控。

五、功能应用

1.基础教学实训应用

无人驾驶硬件基础实训

基于平台模块化硬件架构,完成激光雷达、深度相机、麦克风阵列、机控服务器、线控底盘的拆装、接线、供电测试与通信链路验证,掌握无人驾驶核心硬件的工作原理、参数特性与接口规范;开展传感器标定实验,完成激光雷达点云校正、深度相机内外参标定,掌握工程化硬件调试方法。

ROS 机器人系统实训

基于 Ubuntu 18.04 与 ROS 框架,完成开发环境搭建、节点创建、话题与服务通信、参数服务器配置、RVIZ 数据可视化、Gazebo 虚拟场景搭建等基础实验,掌握 ROS 系统的核心操作流程;开展多设备 ROS 驱动部署与调试,实现激光雷达、相机、底盘的协同通信,理解无人驾驶系统的数据流传输逻辑。

嵌入式开发基础实训

依托机控服务器的嵌入式 Linux 环境,完成 C/C++、Python3 编程入门、串口通信、GPIO 控制、外设驱动开发等实验,掌握嵌入式系统开发流程;开展硬件与软件的联合调试,实现通过代码控制底盘运动、传感器数据采集,培养嵌入式开发与硬件控制能力。

2.无人驾驶感知实训应用

激光雷达应用实训

围绕平台360°全向激光雷达开展全流程应用实训,核心包含点云数据处理、SLAM 建图与定位两大模块。通过数据采集、滤波、分割实验掌握点云预处理技能;依托 GMapping、Cartographer 等主流算法,完成室内外二维 / 三维建图及定位调优,实现从硬件数据感知到智能导航应用的闭环训练。

(1)点云数据处理实训:

完成激光雷达点云数据采集,开展滤波去噪、地面分割、目标特征提取实验,掌握 PCL 等点云处理库的基础应用方法。

(2)SLAM 建图实训:

基于 GMapping 算法完成二维栅格地图构建,基于 Cartographer 算法实现三维场景建模,验证不同场景下的建图精度与适应性。

(3)定位与导航实训:

结合建图结果完成 AMCL 定位实验,调试算法参数优化定位效果,实现基于激光雷达的自主避障、路径规划导航功能。

计算机视觉应用实训

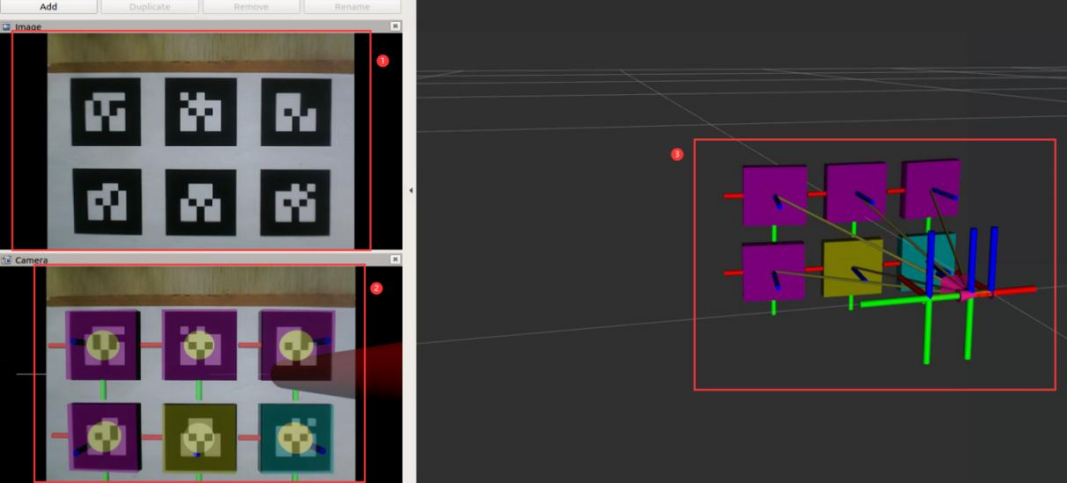

依托平台搭载的 Class 1 安全级实感深度相机,结合 OpenCV 视觉开发框架,开展图像预处理、颜色识别、二维码 / AprilTag 标签检测与 AR 视觉实训。通过阶梯式实验掌握计算机视觉基础开发流程,理解视觉感知在无人驾驶场景中的应用逻辑,为智能感知系统开发奠定基础。

(1)视觉基础与目标识别实训:

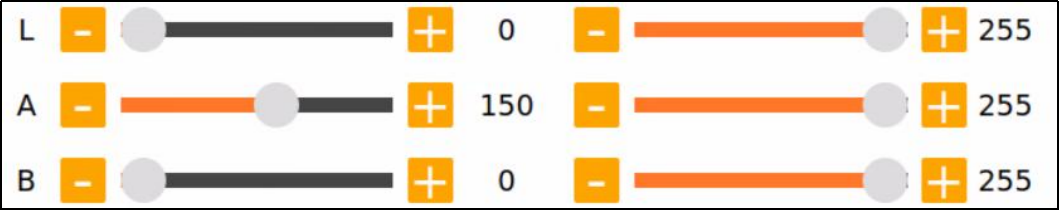

完成图像灰度化、滤波去噪、边缘检测等预处理操作;开展颜色阈值调节、颜色识别、二维码 / AprilTag 标签识别实验,掌握 OpenCV 视觉库的基础应用与目标检测方法。

将颜色物体放置在摄像头的视野范围内,拖动 L、A、B 分量滑杆调整阈值,直至画面显示区左侧画面内的颜色物体区域变为白色,其它区域变为黑色。

(2)标签识别与 AR 视觉实训:

完成二维码的创建与识别实验,掌握视觉码类目标的检测与解码方法;开展 AprilTag 标签识别实验,实现视觉定位与姿态估计;完成 AR 视觉实训,将虚拟信息与真实场景叠加,验证视觉增强技术在环境交互中的应用。

直观呈现视觉处理与 AR 交互的抽象流程,辅助理解实训操作逻辑,符合"实训指导 + 实操调试"的教学模式。

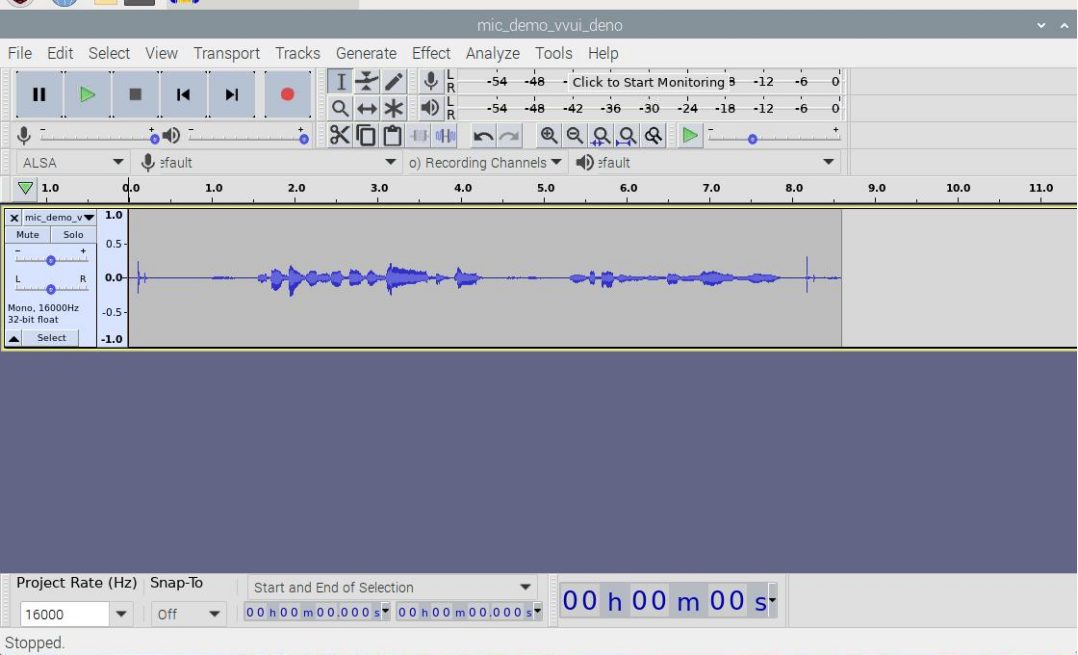

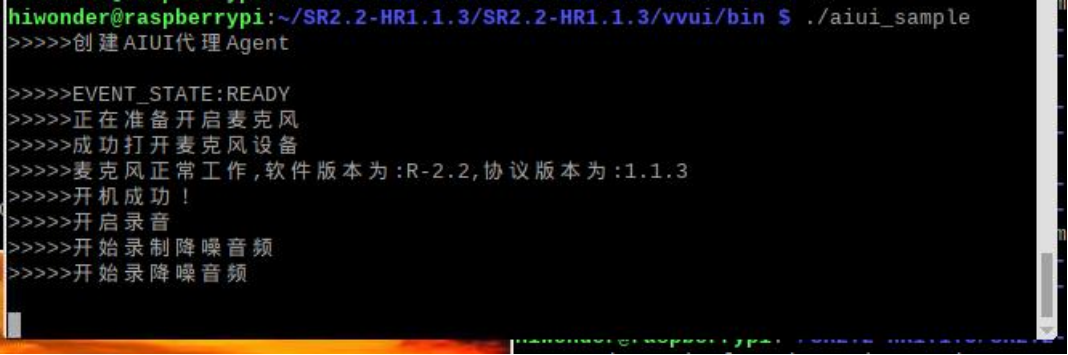

语音交互应用实训

依托平台 6 麦 360° 声源定位阵列,开展语音信号处理与智能交互实训。通过音频降噪、回声消除、声源定位实验掌握语音信号预处理基础方法;完成语音指令识别与小车控制、颜色追踪、多点导航等功能开发,实现无人驾驶场景下的自然语音交互,提升人机交互系统开发能力。

(1)语音信号基础处理实训

开展音频降噪、回声消除实验,优化语音采集质量,完成360°声源定位实验,掌握语音信号方向识别与空间定位方法。

(2)语音指令控制实训

完成"语音控制小车移动"实验,实现前进、后退、转向等基础运动指令的语音触发;开展"语音控制颜色识别/颜色追踪"实验,将语音指令与视觉感知功能联动;实现"语音控制多点导航"实训,通过语音指令下发导航目标点,完成自主导航任务。

(3)语音交互闭环实训

实现设备状态语音播报功能,将小车运动状态、感知结果以语音形式反馈;构建完整语音交互链路,验证"语音指令→逻辑解析→动作执行→状态反馈"的闭环流程。

3.算法开发与 无人驾驶 综合应用实训

无人驾驶核心算法实训

支持基于 TensorFlow、PyTorch 等深度学习框架的目标检测、语义分割算法开发与部署,实现交通标志、行人、障碍物的精准识别;开展Dijkstra、RRT等路径规划算法的实训与优化,实现不同场景下的最优路径规划,培养算法设计与优化能力。

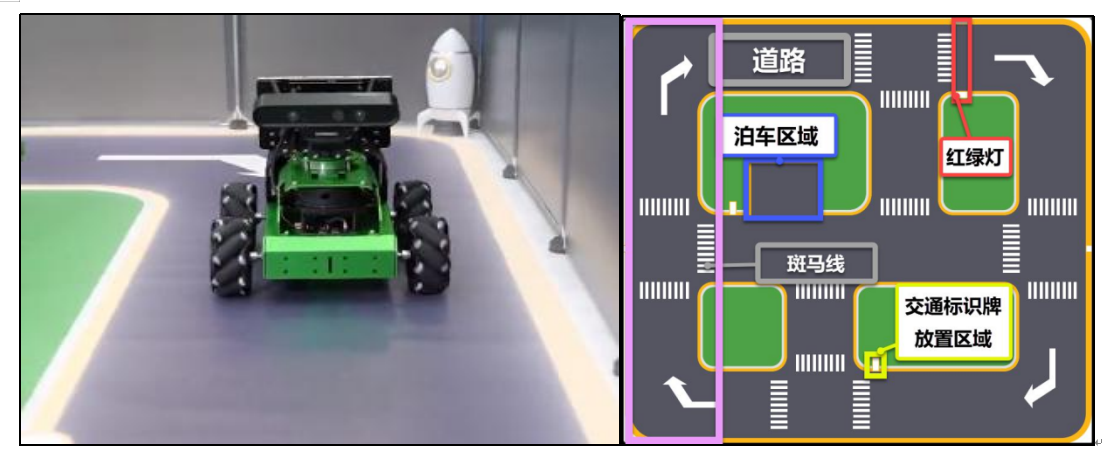

无人驾驶综合系统实训

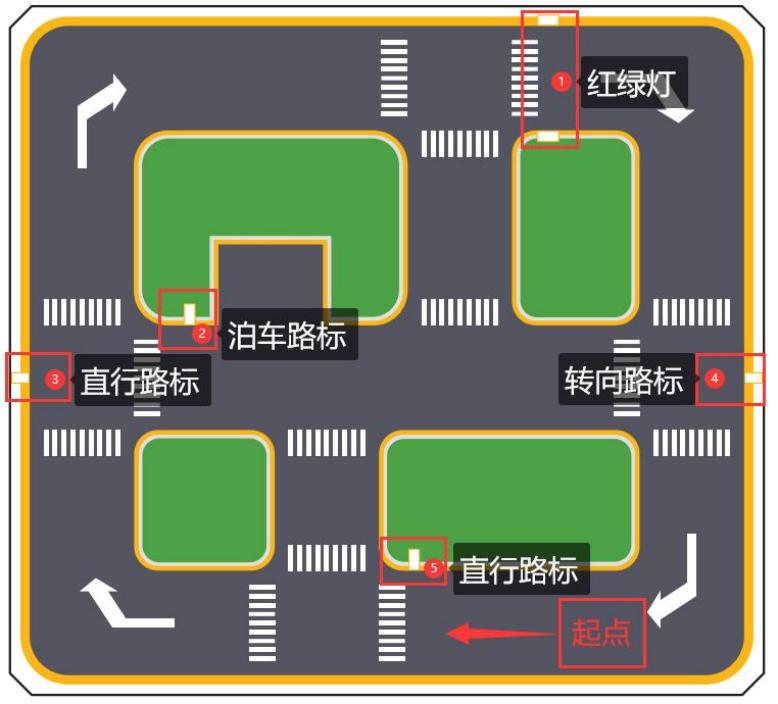

整合环境感知、智能决策、运动控制、人机交互四大核心模块,完成无人驾驶全流程系统开发与调试。依托车道保持、路标检测、红绿灯识别等场景化实训,实现从环境感知、建图定位到路径规划、自主导航的闭环功能;通过多场景综合测试与优化,提升系统稳定性与鲁棒性,培养无人驾驶系统级开发与集成能力。

(1)场景化感知与决策实训

车道保持与转向实训:基于视觉感知实现车道线识别与车辆居中控制,结合感知信息完成路口转向、避障等决策逻辑开发。

开展路标检测与红绿灯识别实训:完成交通标志、信号灯的视觉检测与规则解析。

(2)自主导航与泊车实训

基于环境感知与路径规划实现自动泊入/泊出车位。

(3)综合系统集成与测试

打通感知→决策→控制→交互全链路,验证系统闭环功能;在多场景(实验室/户外场地)下进行稳定性与鲁棒性测试,优化参数与异常处理逻辑。

4.创新开发与竞赛应用

学科竞赛备赛

可作为智能网联汽车竞赛、机器人竞赛、人工智能创新竞赛等赛事的实训与备赛平台,满足赛事所需的无人驾驶技术开发、系统调试、场景测试等需求,助力学生在竞赛中完成作品开发与优化。

科研与毕业设计应用

可作为高校智能网联汽车、人工智能、机器人工程等专业的毕业设计、课程设计与科研创新平台,支撑无人驾驶相关算法优化、多传感器融合、智能决策系统开发等科研课题研究,实现从理论研究到工程落地的转化。