深度解析 Hermes Agent GEPA 自我进化引擎:让 AI Agent 学会"自我迭代"

如果 AI Agent 不只是被使用,而是能在使用中越变越强------它会变成什么样?

Nous Research 给出了一个答案:GEPA(Genetic-Pareto Prompt Evolution),一个让 Agent 自动进化自身技能、工具描述和系统提示的引擎。不调权重、不用 GPU,每次进化成本仅 $2-10。

前言

2026 年初,Nous Research 开源了 Hermes Agent------一个宣称"The agent that grows with you"的自进化 AI 智能体框架。

在过去,AI Agent 的能力被锁死在开发者写下的那套 Prompt 和工具描述里。用得再好,Agent 自己也不会变强。要改进?得靠开发者手动调。

GEPA 打破了这一切。

它让 Agent 基于真实使用数据,自动发现自己的不足,生成改进方案,验证效果,然后部署新版本------整个过程像是一个永不停歇的 DevOps 流水线,只不过优化的是"文本智能"而非代码。

本文从技术原理层面,完整拆解 GEPA 这套引擎。

一、GEPA 是什么?

全称:Genetic-Pareto Prompt Evolution(遗传-帕累托提示进化)

出处 :ICLR 2026 Oral 论文,集成于 DSPy 框架中作为进化式优化器(dspy.GEPA)

定位:Hermes Agent 自我进化能力的核心技术引擎

关键特征速览:

| 特性 | 说明 |

|---|---|

| 核心能力 | 读取执行追踪,理解失败根因,针对性优化 |

| 数据效率 | 仅需 3 个示例即可启动优化 |

| 运行成本 | 每次优化运行 $2-10(纯 API 调用,无需 GPU) |

| 学术认证 | ICLR 2026 Oral(顶级会议口头报告) |

| 对比优势 | 性能优于传统强化学习方法及早期 DSPy 优化器 |

| 改进对象 | 提示文本/指令/示例(非模型权重) |

一句话:GEPA 是一个不需要 GPU、仅需 3 个样例、每次花费 $2-10,就能让 AI Agent 自动变强的进化引擎。

二、最核心的创新:反射性分析(Reflective Analysis)

这是 GEPA 区别于所有传统优化器的核心差异。

传统优化器(如贝叶斯优化、网格搜索)只能看到"正确/错误"这个二元结果,然后盲目地参数调优。GEPA 不一样------它会读取 Agent 完整的执行追踪(execution traces) ,分析每一步的决策链路,找出失败的根本原因。

一个具体的例子

假设一个 Agent 在某个任务上总是选错工具:

| 方法 | 做法 |

|---|---|

| 传统优化器 | 记录"工具选择错误率 65%" → 尝试调整参数 |

| GEPA | 读取执行追踪 → 发现工具 A 描述里的"文件搜索"和工具 B 描述里的"文档检索"语义重叠 → 修改工具描述以消除歧义 |

GEPA 不只是统计"失败了",它理解为什么失败。

评分机制:LLM-as-Judge with Rubrics

由于大部分技能没有标准答案(不像 "1+1=2" 有唯一正确输出),GEPA 使用 LLM 评分器 + 评分标准来评估:

| 评分维度 | 范围 | 含义 |

|---|---|---|

| 过程遵循度 | 0-1 | Agent 是否遵循技能规定的步骤和流程 |

| 输出正确性 | 0-1 | 输出是否正确、有用、相关 |

| 简洁性 | 0-1 | 是否在 token 预算内完成,无冗余输出 |

每个技能都有自己的评分标准,以行为描述而非精确匹配来评判。

三、进化算法:遗传 + 帕累托多目标优化

GEPA 的工作流程可以概括为一个四步循环:

初始化(加载当前版本作为基线)

↓

变异(生成多个有针对性的文本变体)

↓

评估(batch_runner 并行运行所有变体)

↓

选择(帕累托最优 --- 兼顾准确率 × 成本 × 延迟)

↓

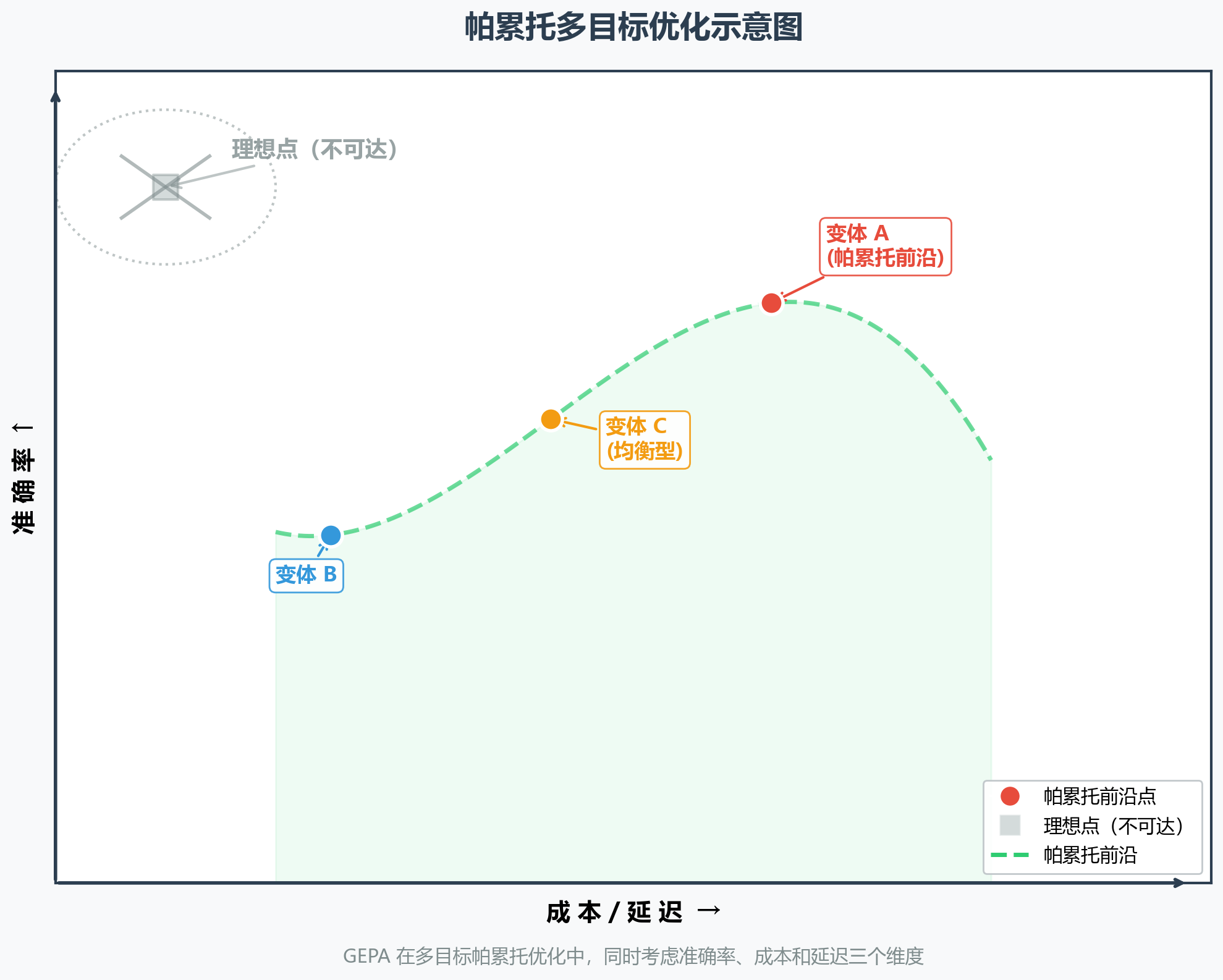

迭代(回到变异步骤,保留最优个体继续进化)帕累托优化:不只盯着准确率

GEPA 在以下三个维度之间寻找帕累托最优:

- 变体 A:准确率最高,但成本高

- 变体 B:成本最低,准确率小幅下降

- 变体 C:均衡型,最优解

GEPA 不是在单一指标上内卷,而是在多个约束下找最优平衡。

四、六步端到端进化流水线

GEPA 的完整运行流程如下:

Step 1:选择优化目标

当前支持的优化对象:

| 阶段 | 优化对象 | 实现状态 |

|---|---|---|

| Phase 1 | 技能文件(SKILL.md)指令 | ✅ 已实现 |

| Phase 2 | 工具描述(description 字段) | 计划中 |

| Phase 3 | 系统提示(人格/策略/格式) | 计划中 |

Step 2:构建评估数据集

GEPA 支持四种数据来源:

| 来源 | 类型 | 说明 |

|---|---|---|

| A:合成生成 | 主要,引导 | 用强模型为技能生成 15-30 个测试用例 |

| B:SessionDB 挖掘 | 真实使用 | 从历史对话提取真实用户任务 |

| C:手工黄金集 | 可选,高价值 | 手工编写的 JSONL 测试用例 |

| D:自动评估 | 适用时 | 植入 bug 测试 debug 能力 |

数据效率极高:仅需 3 个示例即可启动。

Step 3:包装为 DSPy 模块

不同类型的优化目标对应不同的 DSPy 模块:

技能文本 → dspy.Signature(输入/输出签名)

Agent 工作流 → dspy.ReAct(推理-行动循环)

工具选择 → dspy.Predict(分类预测)Step 4:运行优化器

- 主引擎 :

dspy.GEPA(反射性进化) - 备用引擎 :

dspy.MIPROv2(贝叶斯优化,用于少量样本场景) - 代码优化:Darwinian Evolver(外部 CLI)

Step 5:评估与比较

在保留测试集上对比优化前后的指标:准确性、成本、延迟,并进行统计显著性检验。

Step 6:部署(人工审批)

Git 分支(包含 diff + 评估指标 + 前后对比)

↓

Pull Request

↓

人工审查与合并

↓

可选 A/B 测试

↓

支持回滚(git revert)五、安全护栏系统

每次 GEPA 生成的变体必须通过以下约束验证------不满足则被拒绝:

| 约束 | 具体要求 |

|---|---|

| 测试套件 | pytest tests/ -q 必须 100% 通过 |

| 技能大小 | 技能文件 ≤ 15KB |

| 工具描述长度 | 描述 ≤ 500 字符,参数描述 ≤ 200 字符 |

| 缓存兼容性 | 只能在离线场景下优化为新版本,不可在对话中途更改 |

| 语义保持 | 不得偏离原始目的和功能 |

| Schema 冻结 | 参数名称、类型、必填字段不可变------仅文本可进化 |

| 事实准确性 | 不能声称工具做了它做不到的事 |

| PR 审查 | 所有更改必须通过 Pull Request 人工审查,永不直接提交 |

这套护栏系统确保了 GEPA 的进化是安全、可控、可追溯的------Agent 不会"变异"成一个完全不同的东西。

六、与传统方法的对比

| 维度 | GEPA(进化式) | 传统 RL(强化学习) | 手动调优 |

|---|---|---|---|

| 是否需要 GPU | ❌ 不需要 | ✅ 需要 | ❌ 不需要 |

| 每次成本 | $2-10 | $100-1000+ | 人工成本高 |

| 数据需求 | 仅 3 个示例 | 需要大量样本 | 靠经验 |

| 自动化程度 | 高度自动 | 高度自动 | 纯手动 |

| 可解释性 | 高(文本改进,改了什么一目了然) | 低(权重变化,黑盒) | 高 |

| 安全性 | 高(PR 审查 + 多重护栏) | 中等 | 高 |

GEPA 的核心价值在于------以极低成本,在安全可控的前提下,让 AI Agent 能够基于真实使用数据进行持续、自动化的自我改进。

七、GEPA 与 WorkBuddy 的隐式联系

如果你在用 WorkBuddy,其实会发现一些有趣的对应关系:

| Hermes Agent / GEPA | WorkBuddy 体系 |

|---|---|

| 技能文件(SKILL.md)优化 | 你的 Skill 体系(req-to-prd / detailed-design / outline-design) |

| 执行追踪(execution traces) | 工作日志与记忆系统(MEMORY.md) |

| SessionDB 挖掘 | 历史对话检索 |

| 自我进化 | Skill 积累与修正机制 |

GEPA 的思路------从实践中学习,自动优化 Agent 的行为指令------和我们一直在打磨的 AI 研发三阶 Skill 体系有着异曲同工之妙。只不过 GEPA 把"手动积累 Skill"这件事变成了自动化的进化流水线。

写在最后

GEPA 的出现标志着 AI Agent 开发进入了一个新阶段------

从 "开发者写死的指令" 到 "Agent 在使用中自我进化" ,从 "手动调 Prompt 的艺术" 到 "自动化优化的工程"。

它证明了一个趋势:未来的 AI Agent 不会是一个静态的工具,而是一个不断成长的数字伙伴。每一次交互,每一次失败与纠正,都成为它变强的养料。

而这一切的核心引擎 GEPA,成本仅 $2-10,无需 GPU,仅需 3 个示例。

本文基于 Nous Research 官方博客、ICLR 2026 Oral 论文及技术社区分析整理而成。