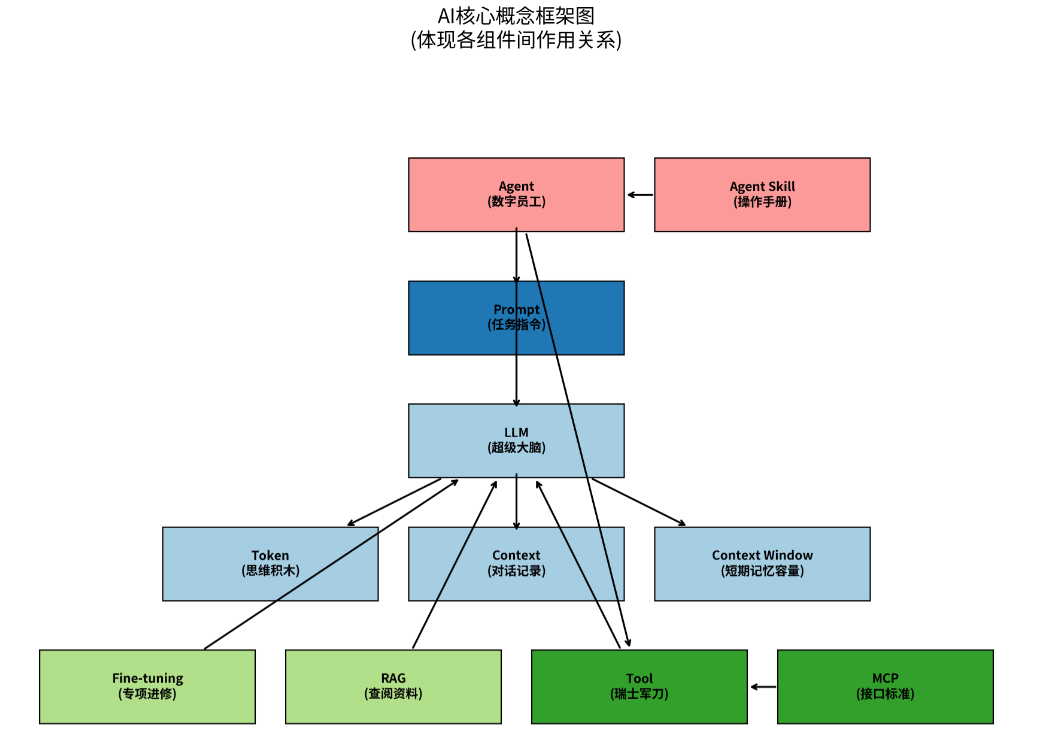

导读:这篇文章系统梳理了人工智能领域的核心概念。它以"大语言模型"(LLM)为"超级大脑",围绕如何与它交互、如何增强其能力、如何扩展其功能,并最终构建自主工作的智能体进行了阐述。核心观点是,AI技术栈可视为一个从底层认知到顶层应用的、层层递进的完整生态。

目录

[1. LLM(大语言模型)](#1. LLM(大语言模型))

[2. Token(词元)](#2. Token(词元))

[3. Context(上下文)与 Context Window(上下文窗口)](#3. Context(上下文)与 Context Window(上下文窗口))

[4. Prompt(提示词)](#4. Prompt(提示词))

[5. Fine-tuning(微调)与 RAG(检索增强生成)](#5. Fine-tuning(微调)与 RAG(检索增强生成))

[6. Tool(工具)与 MCP(模型上下文协议)](#6. Tool(工具)与 MCP(模型上下文协议))

[7. Agent(智能体)与 Agent Skill(智能体技能)](#7. Agent(智能体)与 Agent Skill(智能体技能))

1、核心基础组件(LLM、Token、Context等)

2、交互接口(Prompt)

3、能力增强技术(Fine-tuning、RAG)

4、外部集成(Tool、MCP)

5、高级应用形态(Agent、Agent Skill)

1. LLM(大语言模型)

术语定义

大语言模型(Large Language Model, LLM)本质上是一个基于海量文本数据训练的深度学习模型。它的核心任务是"下一个Token预测",即根据已输入的文本序列,预测下一个最可能出现的文本单元(Token)。常见的代表性LLM包括OpenAI的GPT系列、Anthropic的Claude、Google的Gemini等。

通俗举例

可以把LLM想象成一个博览群书的超级大脑。你问它任何问题,它都能基于"读过"的所有书籍、文章和资料,组织语言来回答你、与你对话,甚至帮你写邮件、写代码、做翻译。

应用举例

-

智能客服:在电商平台,基于LLM的客服机器人能够理解用户的自然语言提问,并提供准确的商品咨询、退换货指引。

-

代码助手:如GitHub Copilot,它能在IDE中根据程序员的注释或已有代码,自动补全整段函数或算法。

2. Token(词元)

术语定义

Token是LLM理解和生成文本时使用的基本单位。它不是一个完整的字或词,而是经过分词器处理后得到的文本片段。例如,英文单词"apple"可能是一个Token,而中文"苹果"可能被拆分为"苹"和"果"两个Token。模型内部处理的是每个Token对应的数字ID。

关键影响:Token的数量直接决定了模型的计算成本、API调用费用和生成速度。

通俗举例

Token就像是超级大脑思考时使用的思维积木。比如理解"我喜欢苹果"这句话,它可能会将其拆成"我"、"喜欢"、"苹果"三块积木来处理。文本越长,需要的"积木"就越多。

应用举例

- 成本控制:在使用GPT API时,系统会统计输入和输出内容的总Token数来计费。因此,优化Prompt,减少冗余信息,是控制成本的有效手段。

3. Context(上下文)与 Context Window(上下文窗口)

术语定义

-

Context:在一次对话或任务中,提供给模型的所有相关背景信息的总和,包括之前的对话历史和当前输入。

-

Context Window:模型单次能够处理和记忆的Token总数上限。它决定了单次交互的信息容量。如果新信息导致总Token数超出窗口限制,最早输入的信息会被"遗忘"。

通俗举例

Context就像你和朋友聊天的当前对话记录 。你刚说"我明天要去爬山",接着问"该穿什么?",朋友就能根据"爬山"这个背景给出建议。而Context Window就像你朋友的短期记忆容量,他只能记住最近聊的约4000个"思维积木",更早的内容就会被挤出记忆。

应用举例

- 长文档分析:在分析一篇长论文时,如果论文长度超过了模型的Context Window,就需要采用分段处理、摘要提炼或使用具备更长上下文窗口的模型(如GPT-4 Turbo 128K)来避免信息丢失。

4. Prompt(提示词)

术语定义

Prompt是用户输入给模型的指令或问题,旨在引导模型产生特定的输出。高质量的Prompt应清晰包含背景、任务、输出格式和约束条件,其质量直接决定AI输出结果的好坏。

通俗举例

Prompt就像你给那个超级大脑下达的精准任务指令。比如,你说"用一句话向小学生解释地球为什么是圆的",这个包含对象、形式和长度的指令就是Prompt。

应用举例

- Prompt工程:要生成一份周报,低效的Prompt是"写周报"。高效的Prompt是:"请以项目负责人的身份,总结本周'智能客服系统'的开发进展。需包含:1. 已完成功能;2. 遇到的问题;3. 下周计划。要求用分点列表,语言正式、简洁。"

5. Fine-tuning(微调)与 RAG(检索增强生成)

术语定义

-

Fine-tuning:在预训练好的通用大模型基础上,使用特定领域(如法律、医疗、金融)的标注数据对其进行额外训练,使其在该领域的表现更专业、更准确。

-

RAG:当模型需要回答涉及最新动态或特定知识库的问题时,先从一个外部知识源(如数据库、文档、互联网)中检索相关信息,再将这些信息作为上下文提供给模型,并生成最终答案。

通俗举例

-

Fine-tuning :让那位博览群书的通才,去法学院进行专项进修。进修后,他回答法律问题就更精准、更专业,但可能对时尚话题的反应会变慢。

-

RAG :当被问到"今天悉尼的天气如何?"时,超级大脑发现自己没有实时数据,于是立刻去查天气预报网站,然后把查到的结果用自己的话组织好告诉你。

应用举例

-

Fine-tuning:一家律师事务所可以微调一个通用LLM,使用大量法律文书和案例,打造一个专精于合同审查的AI助手。

-

RAG:构建一个智能客服系统,当用户问及某款产品的具体参数时,系统先从最新的产品数据库中检索出规格表,再基于此生成回答,确保信息准确、及时。

6. Tool(工具)与 MCP(模型上下文协议)

术语定义

-

Tool:由于纯LLM只能生成文本,Tool赋予了它"动手"的能力。Tool是预留给模型调用的外部函数或API接口,例如搜索网络、执行计算、查询数据库、操作文件等。

-

MCP:由Anthropic推出的模型上下文协议,旨在标准化LLM与外部数据源、工具之间的通信方式,如同AI界的"USB-C标准",让工具接入和调用变得统一、安全、便捷。

通俗举例

-

Tool :给超级大脑配一个多功能瑞士军刀,上面有计算器、搜索引擎、绘图软件等工具。当需要时,它就能调用工具来完成任务。

-

MCP :就像为所有"瑞士军刀工具"制定了一个统一的USB-C接口标准。任何符合MCP标准的工具都能即插即用,大脑调用工具变得非常简单、安全。

应用举例

-

Tool:AI助手在回答"北京和纽约的时差是多少?"时,可以调用一个时间计算函数,而不是依赖可能过时的训练数据来猜测。

-

MCP:开发者可以按照MCP标准,轻松地将公司的内部数据库、CRM系统封装成工具,让公司内部的AI应用能够安全、规范地访问这些资源,打破"数据孤岛"。

7. Agent(智能体)与 Agent Skill(智能体技能)

术语定义

-

Agent:Agent是能够自主规划、决策并执行复杂任务的AI系统。它不再是简单的问答机器人,而是整合了LLM(大脑)、记忆、指令和工具的"数字员工"。给定一个高级目标,Agent能自主拆解任务、调用工具、管理过程直至完成。

-

Agent Skill:是Agent所具备的模块化、专业化的能力包。例如,"数据可视化"、"邮件撰写"、"竞品分析"都可以是独立的Skill。一个Skill通常封装了特定的工作流程、工具调用逻辑和Prompt模板。

通俗举例

-

Agent :一个拥有超级大脑的智能私人助理。你只需要说"帮我策划并预订一次三亚家庭旅行",它就会自己规划步骤:查机票、比酒店、做预算、订门票,全程自主完成。

-

Agent Skill :就像给一个聪明的实习生(AI)写一份标准操作手册。比如,你创建一个"用D3.js生成销售图表"的Skill,下次它需要画图时,就会自动按这份手册操作,调用正确的工具库和代码模板。

应用举例

-

Agent:在运维领域,可以构建一个"故障自愈Agent"。当监控到服务器异常,它能自动:1. 分析日志(调用分析工具);2. 定位问题根因;3. 执行预设修复脚本(调用运维工具);4. 生成事故报告。

-

Agent Skill:在电商公司,可以将"生成小红书风格产品文案"封装成一个Skill。任何营销Agent在需要时,都能调用此Skill,快速产出符合特定平台调性的内容。

总结

人工智能的技术栈可以形象地理解为一个不断进化的"数字生命体":

-

LLM 是它的超级大脑,负责最核心的认知与推理。

-

我们通过Prompt 与它交流,它用Token 来思考,并在有限的Context Window 内记住Context。

-

通过Fine-tuning ,我们可以让它成为某个垂直领域的专家;通过RAG,它可以随时查阅最新资料,弥补知识盲区。

-

给它配上Tool ,它就能"动手"操作现实世界。而MCP协议,则让调用工具变得像使用USB接口一样标准、便捷。

-

最终,一个整合了大脑、记忆、指令和工具的完整系统,就是一个能够自主工作的Agent (数字员工)。而其专业效率,则来源于一个个可复用、可组合的Agent Skill(专业技能包)。