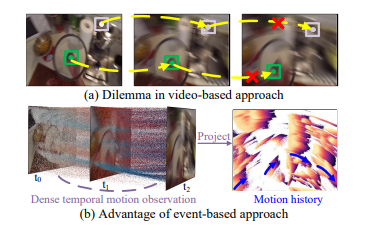

一、 第一视角下的"眩晕":高角速度与运动模糊引发的感知断裂

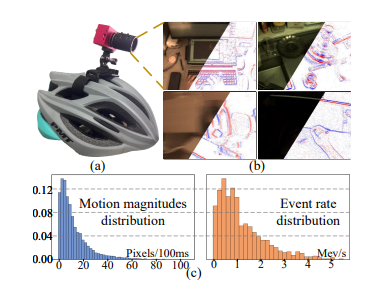

在具身智能或 VR/AR 场景中,第一视角相机(Egocentric Camera)会随着头部的转动产生剧烈、频繁的突发旋转。传统基于 RGB 帧的追踪算法(如 TAPIR 等)在这里会遇到物理级的"降维打击":超高的角速度导致严重的运动模糊,且相邻帧位移过大导致特征匹配彻底失效。

最致命的工程死结在于:剧烈运动打破了局部平滑假设(Local Smoothness),导致传统算力在"补帧"和"纠偏"上浪费了大量功耗,却依然无法解决追踪点丢失后的"重定位"问题。

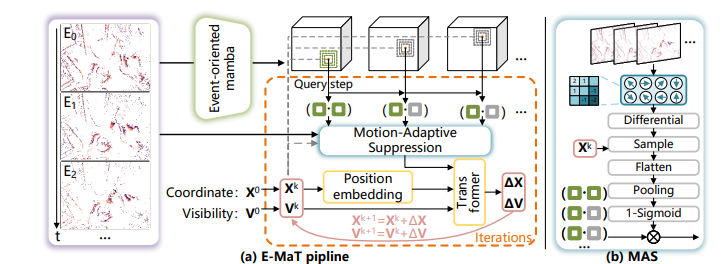

二、 核心逻辑:Event-Oriented Mamba (E-MaT) 的时空序列建模

中科大团队敏锐地发现,事件相机的高时间分辨率天然能弥补 RGB 的运动空隙,而 Mamba(SSM) 架构在处理长序列、高频数据时比 Transformer 更具优势:

-

事件引导的轨迹建模(Event-guided Trajectory Modeling): 算法利用事件流捕获的连续位移,为追踪点建立了一个"全局运动趋势场"。即便 RGB 帧完全模糊,事件流提供的微秒级动态也能引导模型维持追踪的连贯性。

-

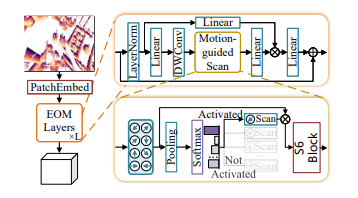

Mamba 状态空间模型(SSM)的引入:

-

相比于 Transformer 的二次方复杂度,E-MaT 采用 Mamba 架构实现了对长程事件序列的线性级处理。它通过选择性扫描机制(Selective Scan),能从杂乱的事件流中精准提取出与追踪点相关的运动分量,大大降低了系统的计算时延。

-

时空特征流交互: E-MaT 并不是单纯依赖事件,而是利用事件流的动态去"校准"RGB 的空间特征。这种深度融合确保了系统既有 RGB 的语义精度,又有事件视觉的动态鲁棒性。

三、 为什么"低延迟链路"与"高动态范围"是 Mamba 算法跑通的前提?

复现 E-Motion 这种 SOTA 级别的点追踪精度,硬件端的两个物理指标直接决定了算法的生死:

-

端到端数据传输的确定性: Mamba 架构对时序极其敏感。如果事件数据在传输过程中存在抖动(Jitter),会导致 Mamba 的状态更新(State Update)发生偏差,进而引发轨迹预测的严重漂移。Eiger 系列模组的 MIPI 原生直连技术,确保了脉冲数据以亚毫秒级时延触达算力核心,为 E-MaT 提供了确定性的时间基准。

-

极端光照下的特征一致性: 第一视角经常涉及室内外大光比切换。如果传感器在高动态环境下产生大量噪点或过曝,事件流就会"断流"。CF-NRS1 凭借其 100dB+ 的硬件级 HDR 性能,确保了在光影剧变中依然能输出稳定的结构脉冲,让 E-MaT 的全局运动趋势场不至于因硬件"致盲"而崩塌。

四、 落地底座方案:为第一视角追踪提供"物理级"稳定底座

方案 A:ShiMeta Pi 【事件相机(EVS)模组系列】(轻量化机载/佩戴首选)针对 VR/AR 头显及轻型机器人。其 31g 的极轻重量 极大降低了头戴设备的惯性负担。最重要的是,其 原生低时延链路 与 E-MaT 这种基于 Mamba 的高频控制逻辑完美契合,是复现"零感追踪"的首选硬件。

方案 B:ShiMeta Pi 【灵光一号】(高精度研发基准)对于需要极高点追踪精度的工业场景(如手部细微动作捕捉),CF-NRS1 的高分辨率与高敏感度能捕捉到更细微的边缘跳变,为中科大算法提供更细腻的原始输入,榨干 E-MaT 的性能上限。

五、 总结:从算法突破到硬件闭环,开启具身智能新赛道

中科大的 E-MaT 表明,Mamba + Event 可能是解决第一视角感知难题的最优解。而底层硬件(如 shimetapi 系列)提供的物理一致性,则是这些顶尖算法能够从实验室 PDF 落地到实际穿戴设备上的唯一物理桥梁。

【原文链接】:https://ojs.aaai.org/index.php/AAAI/article/view/42454

【声明】: 本文仅作为学术前沿动态分享与工程复现逻辑探讨。文中涉及的硬件工程方案旨在为科研落地提供物理底座参考,不代表原论文作者及机构的立场。

#事件相机#中科大#Mamba架构#点追踪#AAAI2026#shimetapi