作者:来自 Elastic jina.ai/

一个模型,四种模态:文本、图像、音频、视频。1.6B 和 0.9B 参数规模的业界领先 omni embeddings。

huggingface.co/collections...

huggingface.co/collections...  arxiv.org/abs/2605.08...

arxiv.org/abs/2605.08...

我们发布了 jina-embeddings-v5-omni ,将我们的 v5-text embedding 模型扩展到了图像、音频和视频。两个模型都共享与 v5-text 相同的冻结文本骨干网络,这意味着文本 embeddings 完全一致 ------ 无需重建索引。

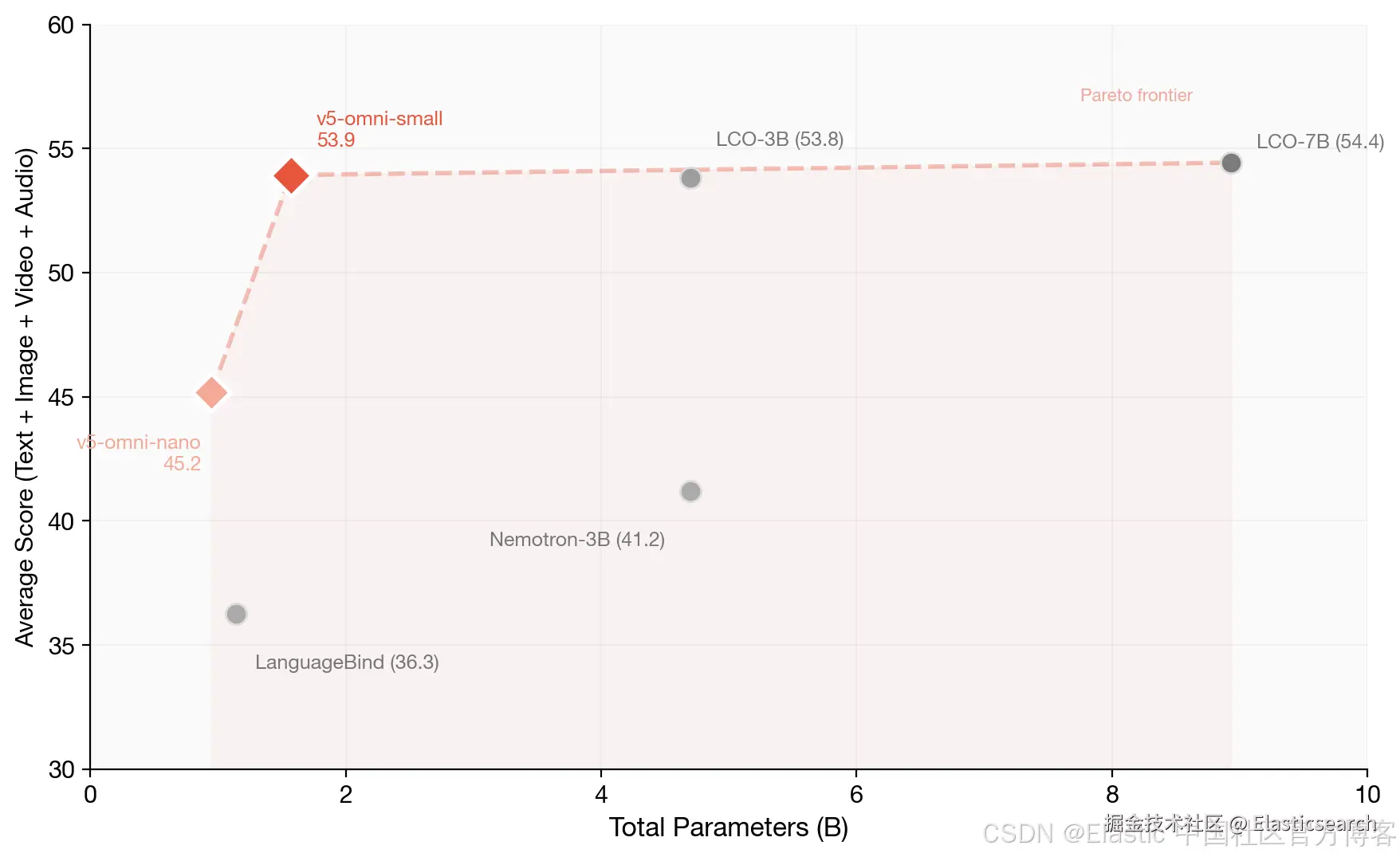

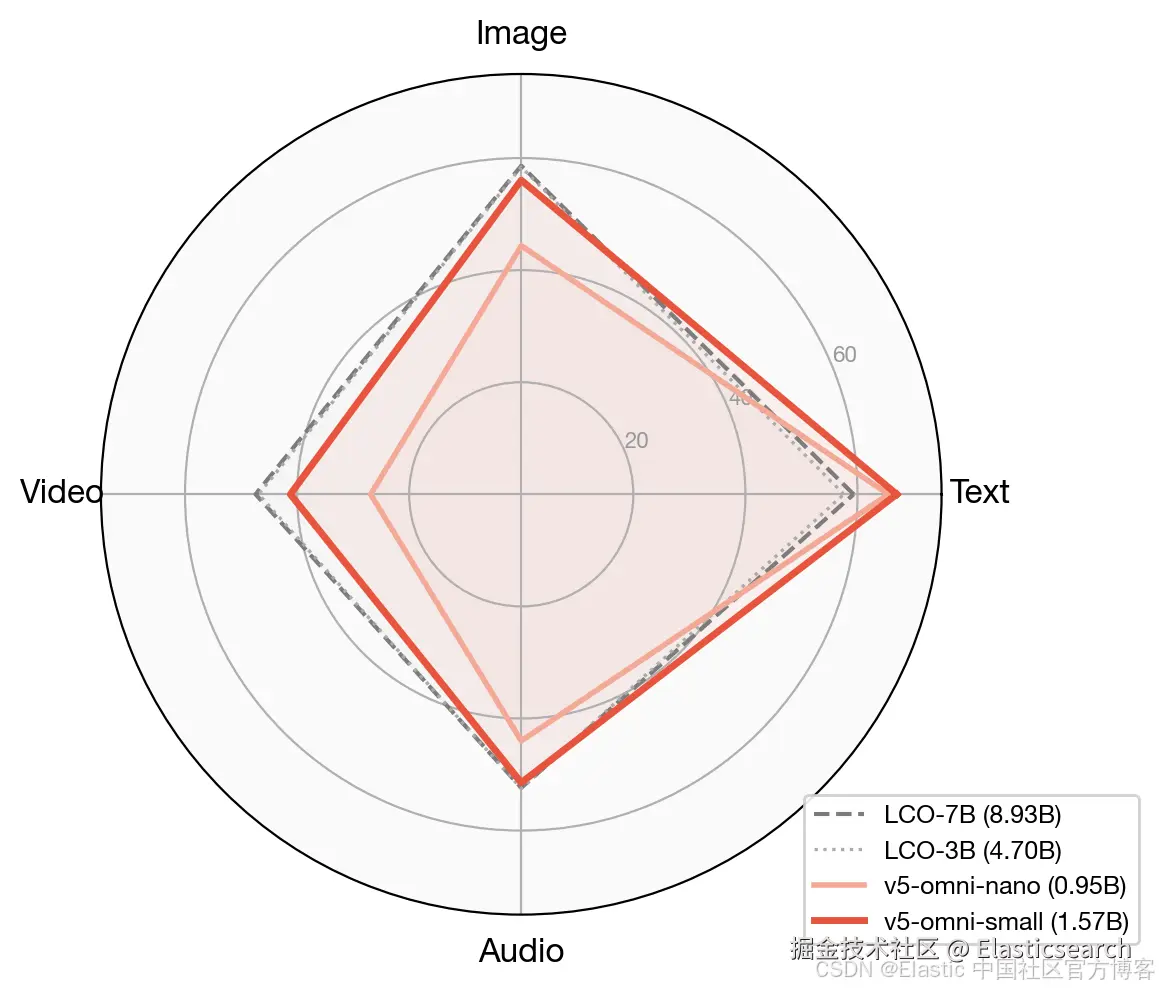

jina-embeddings-v5-omni-small 在四种模态上的平均得分达到 53.93 ,在参数量少 5.7 倍的情况下,接近 LCO-7B(54.43);而 jina-embeddings-v5-omni-nano 则仅使用 0.95B 参数,就提供了具有竞争力的文档检索能力。

所有开源权重 omni embedding 模型(支持文本、图像、音频和视频)的 Pareto 前沿图。jina-embeddings-v5-omni-small(1.57B)在参数量少 5.7 倍的情况下,达到了 LCO-7B(8.93B)的平均得分。jina-embeddings-v5-omni-nano(0.95B)相比 LanguageBind(1.14B)高出 +8.9 分。

所有开源权重 omni embedding 模型(支持文本、图像、音频和视频)的 Pareto 前沿图。jina-embeddings-v5-omni-small(1.57B)在参数量少 5.7 倍的情况下,达到了 LCO-7B(8.93B)的平均得分。jina-embeddings-v5-omni-nano(0.95B)相比 LanguageBind(1.14B)高出 +8.9 分。

基线模型包括:LanguageBind、Omni-Embed-Nemotron-3B、LCO-Embedding-Omni-3B、LCO-Embedding-Omni-7B。

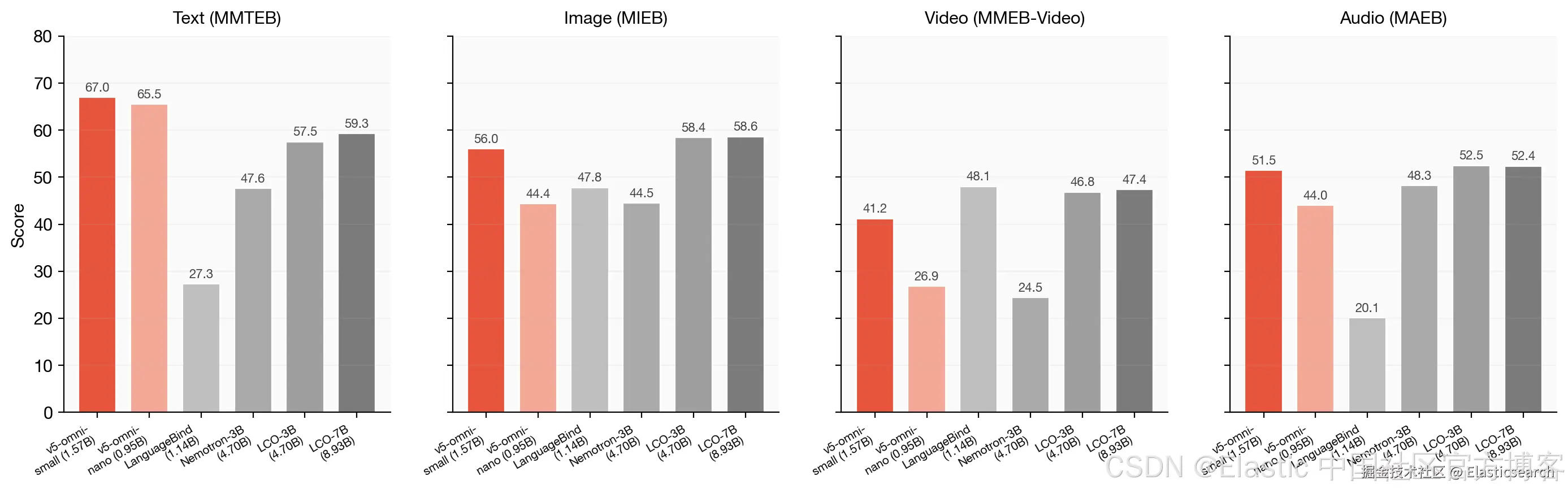

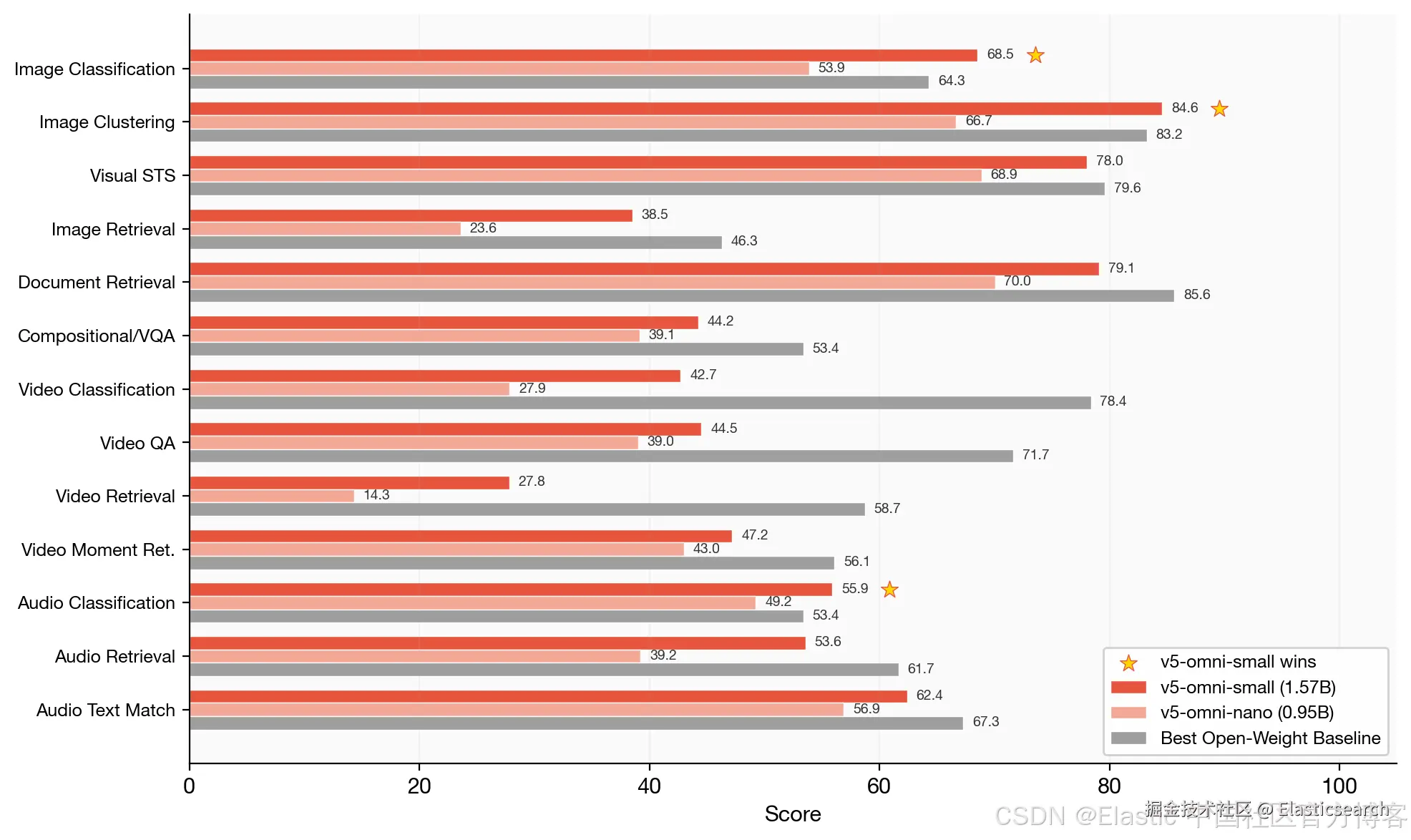

在文本(MMTEB)、图像(MIEB)、视频(MMEB-Video)和音频(MAEB)上的分模态结果。

在文本(MMTEB)、图像(MIEB)、视频(MMEB-Video)和音频(MAEB)上的分模态结果。

jina-embeddings-v5-omni-small 在文本任务上以 67.0 领先所有 omni 模型,继承了 jina-embeddings-v5-text-small 的完整质量。在图像任务上(56.05),它在分类(68.55)和聚类(84.57,在所有模型中最佳)方面表现出色。

跨 13 种任务类型的分任务性能。金色星标表示 jina-embeddings-v5-omni-small 在这些任务上超过了最佳开源权重基线模型(后者参数规模大 3--9 倍)。

跨 13 种任务类型的分任务性能。金色星标表示 jina-embeddings-v5-omni-small 在这些任务上超过了最佳开源权重基线模型(后者参数规模大 3--9 倍)。

领先项目:

图像分类(68.55 vs 64.30)

图像聚类(84.57 vs 83.24)

音频分类(55.89 vs 53.39)

主要差距:

视频检索(27.82 vs 58.73)

组合式推理 / VQA(44.23 vs 53.40)

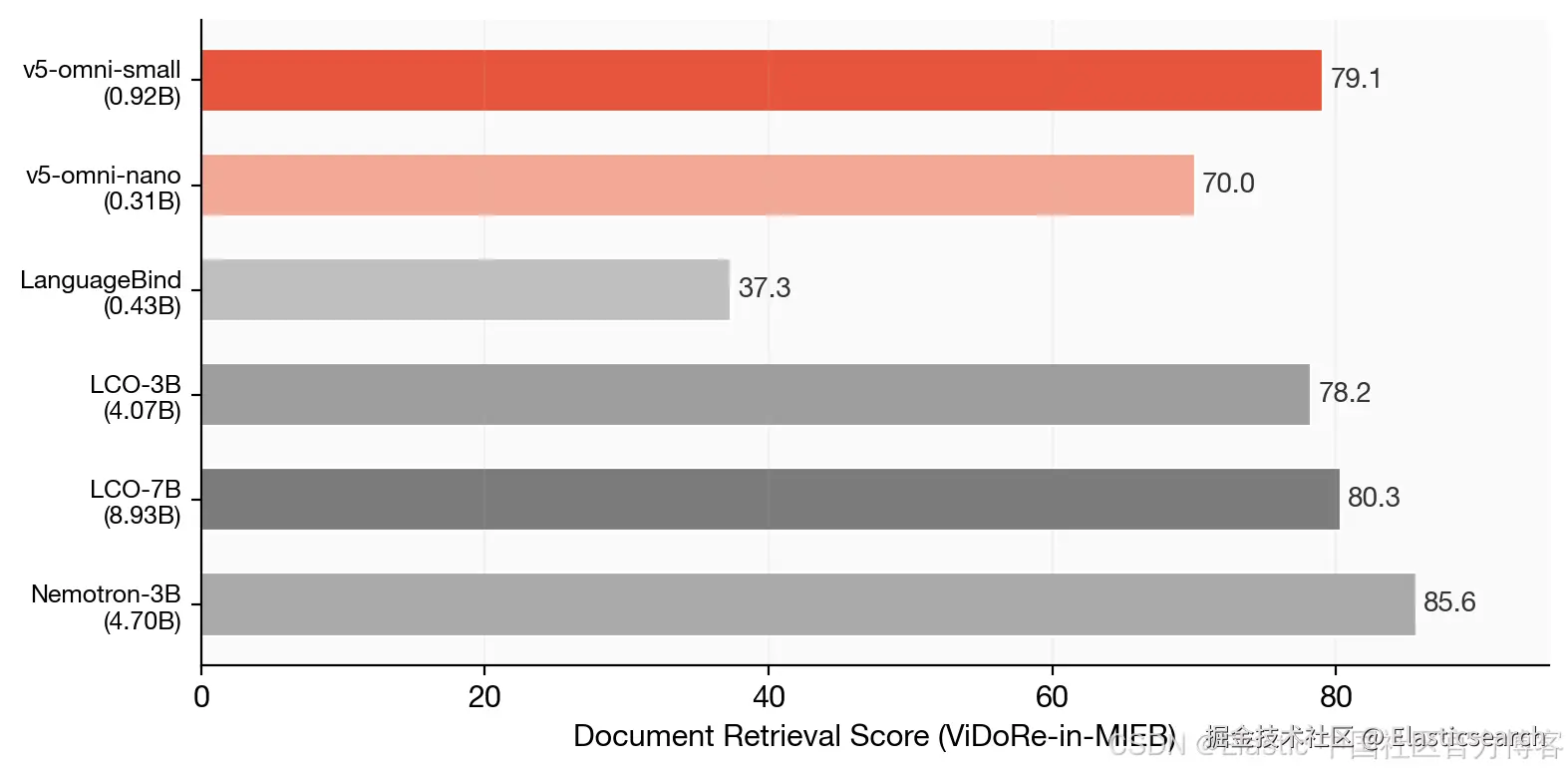

文档检索(ViDoRe-in-MIEB)。jina-embeddings-v5-omni-small 使用 0.92B 激活文本 + 图像参数,取得了 79.08 的得分,超过了 LCO-3B(4.07B 参数下为 78.24)。jina-embeddings-v5-omni-nano 仅使用 0.31B 激活参数就取得了 70.05 的得分,远高于 LanguageBind(37.33)。Nemotron-3B 以 85.64 领先,但使用了高出 5.1 倍的参数量。

文档检索(ViDoRe-in-MIEB)。jina-embeddings-v5-omni-small 使用 0.92B 激活文本 + 图像参数,取得了 79.08 的得分,超过了 LCO-3B(4.07B 参数下为 78.24)。jina-embeddings-v5-omni-nano 仅使用 0.31B 激活参数就取得了 70.05 的得分,远高于 LanguageBind(37.33)。Nemotron-3B 以 85.64 领先,但使用了高出 5.1 倍的参数量。

架构

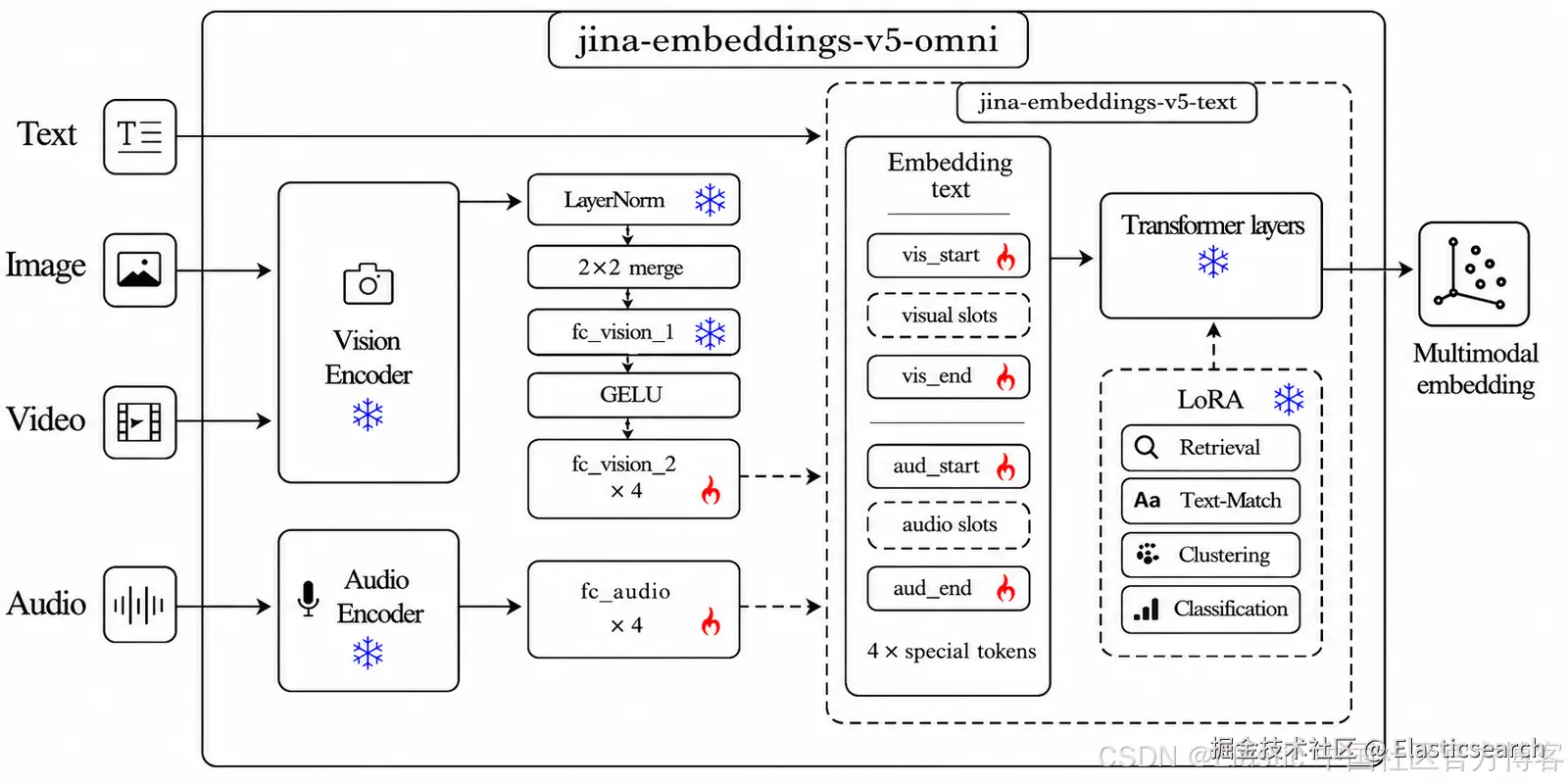

v5-omni 完全保留冻结的 v5-text 骨干网络,并新增了预训练视觉与音频编码器,通过小型可训练 projector 进行连接:

- 视觉 :

- Qwen3.5 视觉编码器(基于 SigLIP2 改造),采用 2x2 空间 merge(token 数减少 4 倍)。除最终 projection layer(fc_vision_2)之外,其余部分全部冻结。我们将该层替换为随机初始化的新层,用于映射到文本骨干网络的 hidden dimension。

- 音频 :

- Qwen2.5-Omni 编码器(基于 Whisper-large-v3 改造)。一个随机初始化的 fc_audio 层将 1280 维输出映射到文本骨干网络。

- 视频 :

- 作为视觉帧序列处理,可选地在前面添加提取出的音频片段。

该模型继承了 v5-text 的四个任务专用 LoRA adapters(retrieval、text-matching、classification、clustering),并为每个任务变体训练独立 projector 权重。

整个架构完全模块化:

- 仅文本部署时不会加载视觉或音频权重(与 v5-text footprint 完全一致)

- 仅图像模式会跳过音频模块

- 完整 omni 模式则加载全部组件

v5-omni 架构。冻结的视觉和音频编码器通过可训练的 projector 输入到冻结的文本骨干网络中。只有 projectors(占总权重的 0.35%)参与训练。任务专用的 LoRA adapters 负责处理检索、分类、聚类和文本匹配。

v5-omni 架构。冻结的视觉和音频编码器通过可训练的 projector 输入到冻结的文本骨干网络中。只有 projectors(占总权重的 0.35%)参与训练。任务专用的 LoRA adapters 负责处理检索、分类、聚类和文本匹配。

| Feature | jina-embeddings-v5-omni-small | jina-embeddings-v5-omni-nano |

|---|---|---|

| Base Text Model | jina-embeddings-v5-text-small (Qwen3-0.6B) | jina-embeddings-v5-text-nano (EuroBERT-210m) |

| Total Parameters | ~1.56B | ~1.04B |

| Modalities | Text, Image, Audio, Video, PDF | Text, Image, Audio, Video, PDF |

| Embedding Dimensions | 1024 | 768 |

| Matryoshka Dimensions | 32, 64, 128, 256, 512, 768, 1024 | 32, 64, 128, 256, 512, 768 |

| Max Sequence Length | 32768 tokens | 8192 tokens |

| Vision Encoder | Qwen3.5-2B ViT (SigLIP2) | SigLIP2 Base |

| Audio Encoder | Whisper-large-v3 | Whisper-large-v3 |

| Tasks | retrieval, text-matching, classification, clustering | retrieval, text-matching, classification, clustering |

| Text Compatibility | Identical to jina-embeddings-v5-text-small | Identical to jina-embeddings-v5-text-nano |

| Trainable Parameters | ~18M projectors (0.35%) | ~7M projectors (0.35%) |

| Pooling | Last-token | Last-token |

| License | CC BY-NC 4.0 | CC BY-NC 4.0 |

入门指南

Elasticsearch(Elastic 推理服务)

如果你已经在 Elasticsearch 中使用 jina-embeddings-v5-text,那么你现有的文本索引可以直接与 v5-omni 开箱即用地工作。omni 模型对文本输入生成的 embeddings 与 v5-text 完全一致 ------ 相同输入、相同向量、逐字节一致(byte-for-byte)。你不需要重新生成 embedding 或重建任何文本索引。

要开始在现有文本数据旁边搜索图像、音频和视频,只需要用 v5-omni 创建一个新的索引,并将你的多模态内容写入其中。

创建一个 semantic_text 索引,并将 v5-omni 作为 inference endpoint。EIS 会自动选择正确的 LoRA adapter 用于索引和检索:

markdown

`

1. PUT multimodal-semantic-index

2. {

3. "mappings": {

4. "properties": {

5. "content": {

6. "type": "semantic_text",

7. "inference_id": ".jina-embeddings-v5-omni-small"

8. }

9. }

10. }

11. }

`AI写代码将文本、图像(作为 base64 data URI)、音频和视频摄入到同一个字段、同一个索引中:

bash

`

1. // Ingest text

2. POST multimodal-semantic-index/_doc

3. {

4. "content": "'Kraft Dinner' is what Canadians call macaroni and cheese when prepared from a kit."

5. }

7. // Ingest an image (base64)

8. POST multimodal-semantic-index/_doc

9. {

10. "content": "data:image/png;base64,iVBORw0KGgoAAAAN..."

11. }

`AI写代码用一个文本查询跨所有模态进行搜索:

bash

`

1. GET multimodal-semantic-index/_search

2. {

3. "query": {

4. "semantic": {

5. "field": "content",

6. "query": "Was bedeutet 'Kraft Dinner' für Kanadier?"

7. }

8. }

9. }

`AI写代码Jina Embedding API

arduino

`

1. curl https://api.jina.ai/v1/embeddings \

2. -H "Content-Type: application/json" \

3. -H "Authorization: Bearer YOUR_API_KEY" \

4. -d '{

5. "model": "jina-embeddings-v5-omni-small",

6. "task": "retrieval.query",

7. "dimensions": 1024,

8. "input": ["What does this image show?"],

9. "images": ["data:image/png;base64,..."]

10. }'

`AI写代码Hugging Face

ini

`

1. from sentence_transformers import SentenceTransformer

2. import torch

4. model = SentenceTransformer(

5. "jinaai/jina-embeddings-v5-omni-small-retrieval",

6. model_kwargs={"dtype": torch.bfloat16},

7. )

9. # Text embedding (identical to v5-text)

10. text_emb = model.encode("What is knowledge distillation?", prompt_)

12. # Image embedding

13. from PIL import Image

14. img = Image.open("photo.jpg")

15. img_emb = model.encode(img)

17. # Cross-modal similarity

18. similarity = model.similarity(text_emb, img_emb)

`AI写代码训练

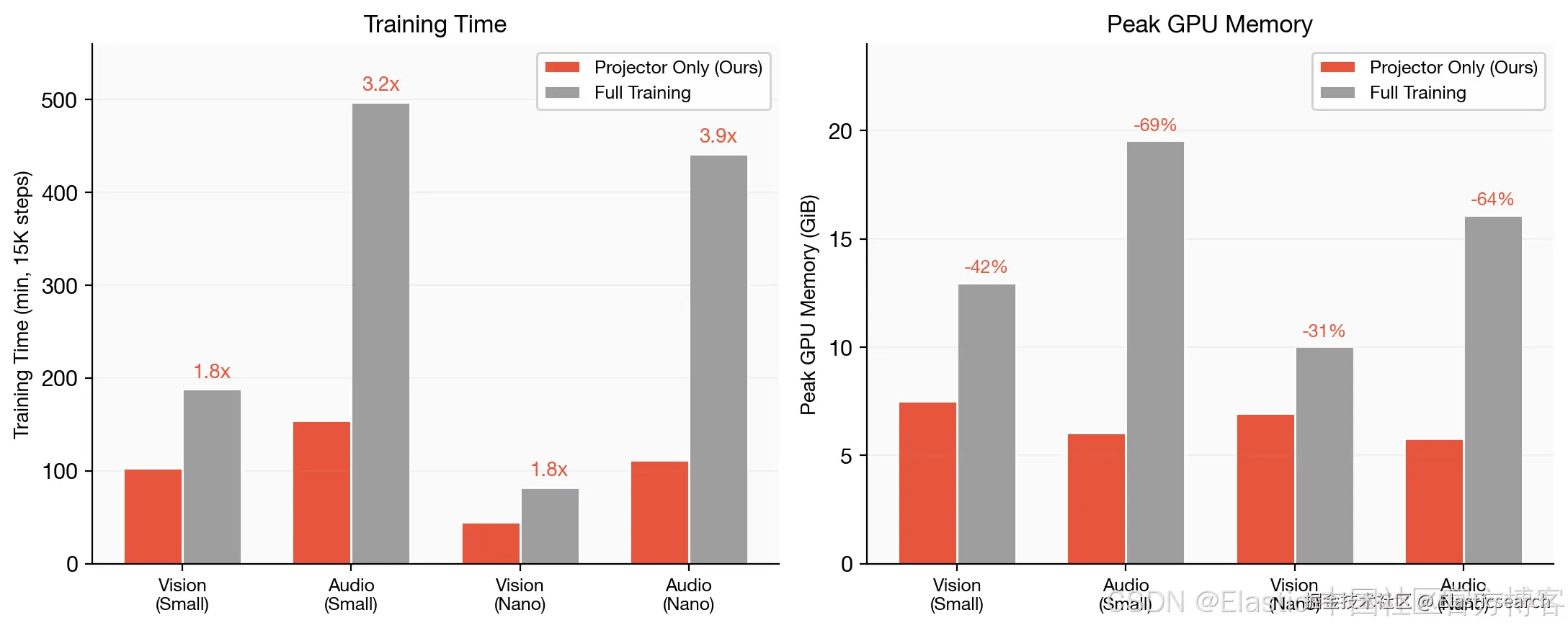

核心思想是冻结编码器的模型组合:取一个强文本 embedding 模型,加入预训练的视觉和音频编码器,通过小型可训练 projector 将它们连接起来,并冻结除这些 projector 之外的所有部分。只有 0.35% 的总权重参与训练,这带来了三个特性:(1)文本一致性保持 ------ backbone 未被修改,相同输入产生相同输出;(2)训练效率 ------ 仅 projector 训练使训练速度提升 1.8-3.9 倍,并减少 42-64% 的 GPU 内存占用;(3)模块化 ------ 各个 tower 可以独立加载。

仅训练 projector vs 全量训练(4x H100 GPU,对比,batch size 256,15K steps)。音频 projector 训练尤其高效:small 模型快 3.2 倍(154 分钟 vs 497 分钟),nano 模型快 3.9 倍(112 分钟 vs 441 分钟)。42--64% 的显存节省来自于不为冻结的编码器存储梯度和优化器状态。

仅训练 projector vs 全量训练(4x H100 GPU,对比,batch size 256,15K steps)。音频 projector 训练尤其高效:small 模型快 3.2 倍(154 分钟 vs 497 分钟),nano 模型快 3.9 倍(112 分钟 vs 441 分钟)。42--64% 的显存节省来自于不为冻结的编码器存储梯度和优化器状态。

v5-omni 继承了 v5-text 的 Matryoshka 维度支持。图像和音频 embeddings 在截断后仍能保持大部分质量,而视频在较小维度下性能下降更明显。

总结:v5-omni 与最强基线模型的分模态表现对比。jina-embeddings-v5-omni-small(1.57B)在文本、图像和音频上具有竞争力,视频仍是需要进一步补齐的主要差距。

总结:v5-omni 与最强基线模型的分模态表现对比。jina-embeddings-v5-omni-small(1.57B)在文本、图像和音频上具有竞争力,视频仍是需要进一步补齐的主要差距。

结论

传统观点认为,多模态 embeddings 需要端到端训练整个模型。我们不同意这一点。v5-omni 冻结文本 backbone,仅训练 0.35% 的权重,并且性能匹配体积大 5--7 倍的模型。这个经验表明:模型组合优于重新训练(composition beats retraining)。一个强大的文本 encoder 是最难的部分 ------ 一旦拥有它,通过轻量级 projector 叠加视觉和音频几乎是 "零成本" 的。

这一点对生产环境非常重要。你现有的 v5-text 索引完全不受影响。相同 query,相同 vector,byte-for-byte 一致。你只是在没有重新 embedding 任何文档的情况下,获得了图像、音频和视频搜索能力。这才是真正的突破:多模态检索作为即插即用升级,而不是迁移工程。

jina-embeddings-v5-omni-small 是 2B 参数以下表现最好的开源 omni embedding 模型。jina-embeddings-v5-omni-nano 在 0.9B 参数规模下同样可用。两者现已在 Hugging Face、Jina Search Foundation API,以及 Elasticsearch 原生 inference endpoint 中提供。