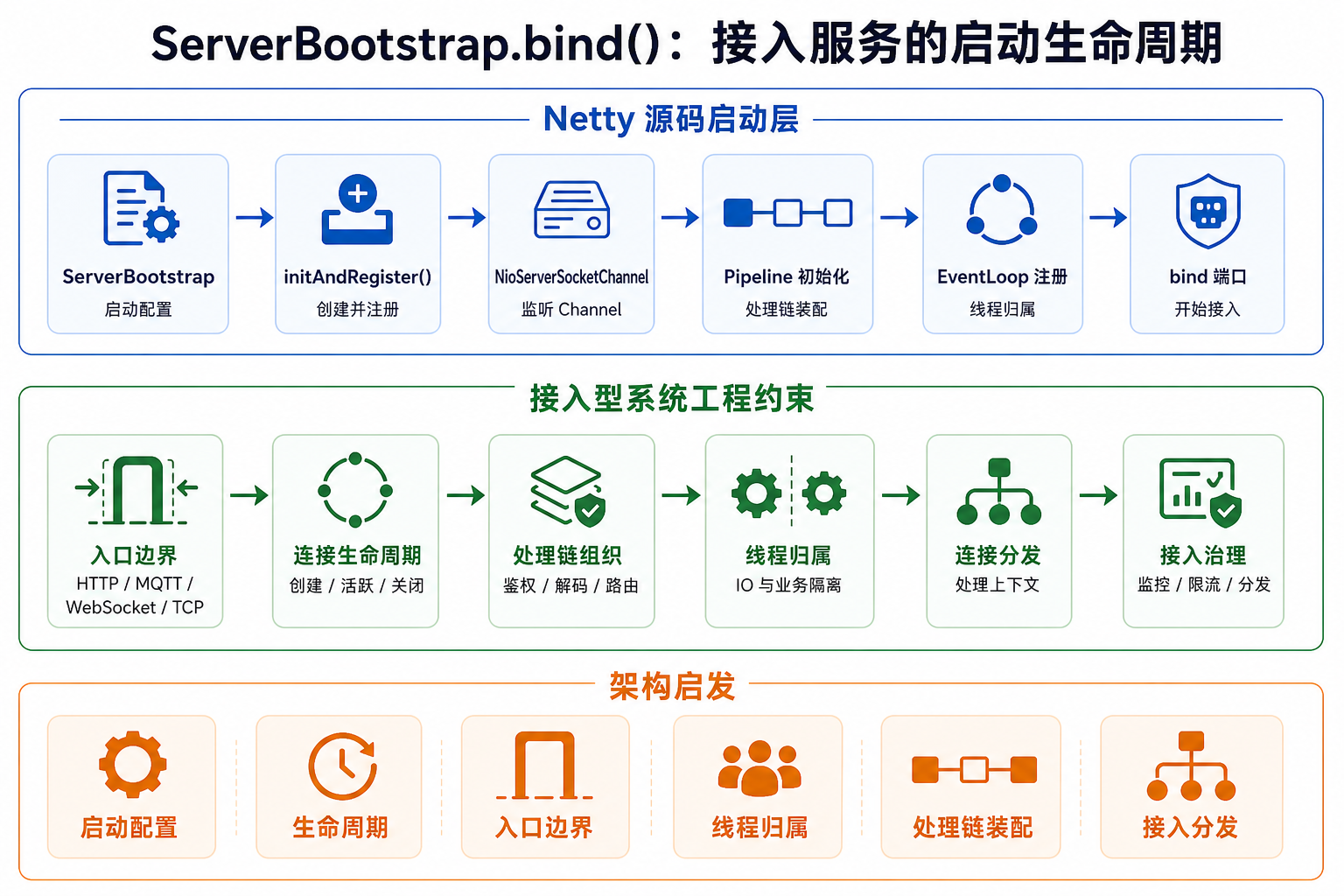

Netty 服务端是怎么启动的:从 ServerBootstrap.bind() 看源码主线

上一篇我们说过,Netty 的核心不是某一个 API,而是一套工程模型:

EventLoopChannelPipelineByteBuf

这一篇虽然讲的是 ServerBootstrap.bind(),但真正想补的不是"Netty 端口怎么启动"这个细节。

对我来说,它更像是在回答一个接入型系统的底层问题:

一个服务在真正接入外部连接之前,需要先把哪些责任边界建立起来?

在云边协同这类系统里,边缘侧 Spring Boot 应用当前更多是作为:

MQTT clientHTTP / Feign client- MinIO 大文件上传客户端

它不一定自己暴露 Netty 长连接服务端。

但只要以后系统里出现设备接入、WebSocket 推送、网关转发、自定义 TCP 协议或边缘侧消息入口,本质上都会遇到同一类问题:

- 监听入口在哪里?

- 连接生命周期由谁管理?

- 新连接进来后交给哪条处理链?

- IO 线程和业务线程如何隔离?

- 后续读写事件归哪个执行上下文处理?

所以这一篇不是为了背 bind() 源码,而是通过 Netty 启动流程,建立"接入型服务启动时如何组织连接入口"的判断框架。

这一篇正式进入源码主线,从最常见的服务端启动代码开始:

java

new ServerBootstrap()

.group(bossGroup, workerGroup)

.channel(NioServerSocketChannel.class)

.childHandler(new ChannelInitializer<SocketChannel>() {

@Override

protected void initChannel(SocketChannel ch) {

ch.pipeline().addLast(new EchoServerHandler());

}

})

.bind(8080);这几行代码背后发生了什么?

核心问题有四个:

- Channel 是什么时候创建的?

- Pipeline 是什么时候初始化的?

- Channel 是怎么注册到 EventLoop 的?

- 端口 bind 最终发生在哪里?

本文以 Netty 4.1 的核心流程为主,抓主线,不陷进每个分支细节。

一、ServerBootstrap 配置了什么?

ServerBootstrap 是 Netty 服务端启动入口。

它本身不直接处理 IO,而是保存启动服务端所需的配置:

bossGroupworkerGroup- Channel 类型

- Channel 参数

- Server Channel 的 Handler

- Child Channel 的 Handler

其中最重要的是:

java

.group(bossGroup, workerGroup)

.channel(NioServerSocketChannel.class)

.childHandler(...)bossGroup 负责服务端监听 socket 上的新连接接入。

workerGroup 负责已经接入的客户端连接上的读写事件。

channel(NioServerSocketChannel.class) 指定服务端监听 Channel 的类型。

childHandler(...) 指定每个客户端连接创建后,如何初始化它的 Pipeline。

所以 ServerBootstrap 不是网络线程,也不是监听 socket。

它更像是:

服务端启动配置器。

真正启动发生在:

java

bind(8080)二、bind() 是启动流程入口

bind() 方法在 AbstractBootstrap 中。

源码主线大致是:

AbstractBootstrap.bind()

doBind()

initAndRegister()

doBind0()

可以理解为三步:

-

- 创建并初始化 Channel

-

- 把 Channel 注册到 EventLoop

-

- 在 EventLoop 线程中执行端口绑定

这三步非常关键。

因为 Netty 的设计原则是:

Channel 的 IO 操作尽量在它绑定的 EventLoop 线程里执行。

所以服务端启动不是简单地在当前线程里创建 socket 然后 bind。

它会先创建 Channel,再注册到 EventLoop,最后由 EventLoop 执行真正的 bind。

三、initAndRegister():创建 Channel 并注册

initAndRegister() 是启动流程第一条关键源码。

主线类似:

channelFactory.newChannel()

init(channel)

config().group().register(channel)

第一步:

java

channelFactory.newChannel()根据前面配置的:

java

NioServerSocketChannel.class反射创建一个服务端 Channel。

也就是:

NioServerSocketChannel

它底层包装的是 JDK 的:

ServerSocketChannel

第二步:

java

init(channel)对这个服务端 Channel 做初始化。

这里会把一些配置和 Handler 放到服务端 Channel 的 Pipeline 里。

第三步:

java

group().register(channel)把服务端 Channel 注册到 bossGroup 中的某个 EventLoop。

这一步以后,这个 NioServerSocketChannel 就归某个 boss EventLoop 管理。

四、NioServerSocketChannel 是什么?

NioServerSocketChannel 表示服务端监听 Channel。

它不是客户端连接。

它对应的是:

ServerSocketChannel

也就是服务端用于监听端口、接收新连接的 Channel。

它关心的主要事件是:

OP_ACCEPT

客户端连接进来时,boss EventLoop 会从这个 ServerSocketChannel 上 accept 出新的客户端 socket。

然后新客户端连接会被包装成:

NioSocketChannel

再交给 workerGroup 中的某个 EventLoop 管理。

所以服务端启动时先创建的是:

NioServerSocketChannel

真正客户端接入后创建的是:

NioSocketChannel

这两个不要混淆。

五、init(channel):服务端 Pipeline 初始化

ServerBootstrap 的 init(channel) 会对服务端 Channel 做初始化。

它主要做几类事情:

- 设置 ChannelOption

- 设置 Attribute

- 添加服务端 Handler

- 添加 ServerBootstrapAcceptor

其中最关键的是:

ServerBootstrapAcceptor

它是服务端接受新连接后的处理器。

当 boss EventLoop accept 到一个新的客户端 Channel 后,ServerBootstrapAcceptor 会负责:

- 给客户端 Channel 设置 childHandler

- 设置 childOptions

- 设置 childAttrs

- 把客户端 Channel 注册到 workerGroup

也就是说:

- bossGroup 只负责接收连接;

- workerGroup 才负责客户端连接后续的 read/write。

这个责任分离就是 Netty 服务端线程模型的基础。

六、register(channel):注册到 EventLoop

创建并初始化 Channel 后,下一步是注册:

bossGroup.register(channel)

这背后会选择一个 EventLoop。

大致逻辑是:

EventLoopGroup

选择一个 EventLoop

EventLoop.register(channel)

注册的最终目标是:

把 Channel 底层的 Java NIO Channel 注册到 Selector 上。

也就是类似:

java

javaChannel().register(selector, interestOps, attachment)注册以后,这个 EventLoop 就可以通过 Selector 监听这个 Channel 的 IO 事件。

对于服务端 Channel 来说,关心的是:

OP_ACCEPT

更严谨一点说,Channel 注册到 Selector 后,具体关注哪些 interestOps 还会受到 autoRead、beginRead 等流程影响;服务端 Channel 真正开始读时,核心关注的就是新连接接入事件,也就是 OP_ACCEPT。

对于客户端 Channel 来说,关心的是:

OP_READOP_WRITE

其中 OP_READ 是常见读事件;OP_WRITE 通常不是一直关注,而是在 socket 暂时写不动、写队列还有数据时才会关注,等可写后继续 flush。

七、doBind0():真正 bind 在 EventLoop 中执行

initAndRegister() 完成后,doBind() 会继续执行真正的端口绑定。

源码主线中有一个关键点:

doBind0()

doBind0() 会把 bind 操作提交到 Channel 所属的 EventLoop 中执行。

大致意思是:

eventLoop.execute(() -> channel.bind(localAddress, promise))

为什么要这样?

因为 Netty 希望一个 Channel 的操作尽量在它绑定的 EventLoop 线程中串行执行。

这样可以减少多线程并发修改 Channel 状态带来的复杂度。

所以真正 bind 的动作最终会走到:

ChannelPipeline.bind()

HeadContext.bind()

Unsafe.bind()

NioServerSocketChannel.doBind()

最终调用 JDK 底层:

ServerSocketChannel.bind(...)

八、服务端启动完整主线

现在把完整流程串起来:

ServerBootstrap.bind(8080)

AbstractBootstrap.doBind()

initAndRegister()

channelFactory.newChannel()

创建 NioServerSocketChannel

ServerBootstrap.init(channel)

初始化服务端 Pipeline

bossGroup.register(channel)

选择一个 boss EventLoop

注册 ServerSocketChannel 到 Selector

doBind0()

在 EventLoop 线程中执行 bind

ServerSocketChannel 监听 8080

这条链路看懂以后,Netty 服务端启动就不再神秘。

九、新连接是怎么交给 workerGroup 的?

服务端监听成功后,客户端连接到来。

流程大致是:

boss EventLoop 监听到 OP_ACCEPT

NioServerSocketChannel.doReadMessages()

ServerSocketChannel.accept()

创建 NioSocketChannel

Pipeline 触发 channelRead

ServerBootstrapAcceptor.channelRead()

workerGroup.register(childChannel)

这就是:

boss 接连接,worker 管读写。

注意,boss 接收到客户端连接后,不会自己长期处理这个客户端连接。

它会把客户端 Channel 注册到 workerGroup。

之后这个客户端连接上的 read/write 事件就由某个 worker EventLoop 负责。

十、为什么这种启动设计重要?

Netty 启动流程看似绕了一些,但背后有几个重要设计:

- Channel 创建和初始化分离

- 服务端 Channel 和客户端 Channel 分离

- bossGroup 和 workerGroup 分工明确

- Channel 注册到 EventLoop 后由单线程串行处理

- bind 操作也放到 EventLoop 中执行

这些设计都是为了一个目标:

让复杂网络状态在清晰的线程模型下运行。

如果一个 Channel 可以被多个线程随意读写,状态管理会非常复杂。

Netty 的做法是:

- 一个 Channel 绑定一个 EventLoop;

- 一个 EventLoop 用一个线程串行处理多个 Channel 的事件。

这就把并发问题收敛了。

十一、架构师视角:这篇对我有什么用?

学完 ServerBootstrap.bind(),我以后看一个接入型服务时,不会只看:

端口是否启动成功。

而会继续追问:

- 服务启动时,监听入口、处理链和线程模型是否已经建立清楚?

- 新连接接入后,是谁负责 accept,谁负责后续 read/write?

- 连接初始化时,协议处理、鉴权、日志、异常处理这些节点放在哪里?

- 一个连接注册到某个执行上下文后,后续状态是否能被串行管理?

- 如果未来扩展到 MQTT 接入、WebSocket 推送、设备 TCP 协议或网关转发,这个入口模型是否还能承载?

这也是 Netty 启动源码对业务架构师的启发:它不是告诉我们业务系统必须照着 Netty 启动,而是提醒我们接入型服务要先把入口、处理链、线程归属和生命周期说清楚。

它把"服务启动"从一个简单的端口绑定动作,拆成了:

- 创建入口对象

- 初始化处理链

- 注册执行上下文

- 绑定监听端口

- 接收外部连接

- 分发后续读写

这套视角可以用来审视很多接入型业务系统。

即使当前某个边缘侧 Spring Boot 应用主要是 MQTT / HTTP / 对象存储客户端,也可以借这套模型反向审视:

- 外部系统的入口在哪里?

- 消息进入应用后的第一条处理链在哪里?

- 慢调用和 IO 事件有没有隔离?

- 大文件上传、接口调用、消息处理是否会互相拖慢?

十二、结论

ServerBootstrap.bind() 不是简单地绑定端口。

它背后完成了:

- 创建 NioServerSocketChannel

- 初始化服务端 Pipeline

- 注册到 boss EventLoop

- 注册到底层 Selector

- 在 EventLoop 中执行 bind

- 准备接受客户端连接

服务端启动主线可以记成:

创建 Channel

初始化 Pipeline

注册 EventLoop

绑定端口

接受连接

交给 workerGroup

理解这条主线,后面再看 EventLoop、Pipeline、read/write 流程就有了入口。

下一篇我们继续往下看:

BossGroup、WorkerGroup 和 EventLoop 到底是什么关系?