在制造业的流水线上,产品质检是个再熟悉不过的环节。传统做法是靠质检员逐件检查,从手机外壳到汽车零部件,从金属板材到塑料制品,工人们用肉眼识别划痕、凹陷、气泡这类缺陷。这种方式不仅效率低,而且人的注意力会随时间推移而下降,长时间重复劳动后漏检率会明显上升。

近年来,机器视觉技术在工业检测领域快速普及,基于深度学习的缺陷检测算法已经能够实现相当高的准确率。但这些传统方案通常需要针对每种缺陷类型单独训练模型,泛化能力有限,一旦产品外观稍有变化,往往需要重新采集数据、重新训练。随着视觉大模型能力的不断突破,用一个模型理解多种缺陷类型、甚至用自然语言描述检测需求,正在成为可能。

今天我们来聊聊怎么用阿里通义千问团队开源的Qwen3-VL-8B-Instruct模型,通过LoRA微调的方式,快速适配到产品质量检查这个具体场景。整个过程会覆盖从数据准备、训练配置到模型部署的完整流程,适合有一定深度学习基础、想了解多模态大模型实际应用场景的朋友参考。

为什么选择Qwen3-VL-8B-Instruct

Qwen3-VL系列是通义千问在2025年9月发布的第三代视觉语言模型。相比前代产品,这个版本有几个关键的技术升级值得关注。

首先是交错MRoPE位置编码的引入。之前的视觉语言模型在处理视频时,时间维度信息集中在高频区域,导致模型对长时间跨度的理解能力受限。Qwen3-VL把时间、高度、宽度三个维度的位置信息交错分布,让模型在各种频率上都能获取到完整的时空信息。这一改进直接提升了模型处理长视频和连续图像序列的能力,对于质检场景中需要分析产品多个角度的场景很有帮助。

其次是DeepStack深度堆叠技术。传统多模态模型通常只在语言模型的底层输入一次视觉特征,而DeepStack把视觉编码器在不同层次提取的特征都收集起来使用。低层次的轮廓、纹理信息和高层次的物体结构信息能够同时参与最终决策,这让模型对缺陷细节的感知更加敏锐。

8B参数规模是另一个重要考量。太小的模型往往泛化能力不足,面对复杂缺陷时容易出现误判;但参数规模太大又会带来沉重的部署成本。一张消费级显卡比如RTX 4090的24GB显存,就能够完整加载这个模型并完成推理,这给实际落地带来了很大便利。

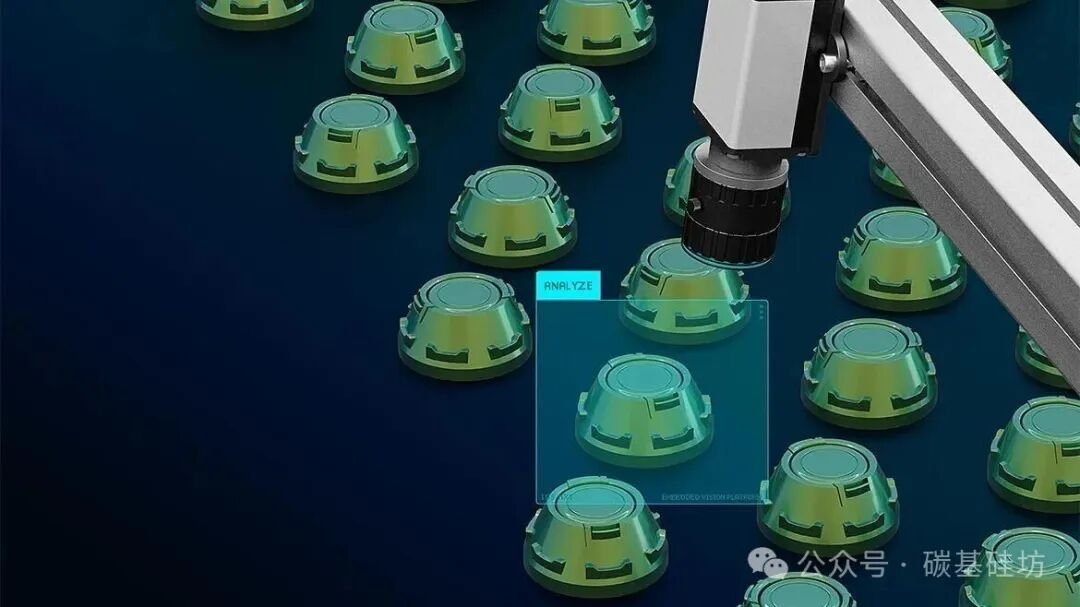

现代工厂中的AI视觉检测系统正在替代传统人工质检

Instruct版本经过了指令微调,能够更准确地理解用户的检测意图。质检场景中经常需要根据具体的检测标准输出判断结果,比如"检测这个金属零件表面是否有长度超过2毫米的划痕",Instruct版本对这类指令的执行能力明显更强。

LoRA微调的核心原理

全参数微调大模型需要消耗大量计算资源。以Qwen3-VL-8B为例,模型包含80亿参数,如果对所有权重进行更新,每次梯度下降需要存储梯度、动量、优化器状态等大量中间数据,单次更新可能需要上百GB的显存。这对于大多数企业来说都是难以承受的成本。

LoRA(Low-Rank Adaptation)的核心思想是:与其修改所有参数,不如只在模型的关键位置添加少量可训练的低秩矩阵。打个比方,如果把模型权重理解为一个大型图书馆,传统的全参数微调相当于重写整个图书馆的每一本书,而LoRA相当于在图书索引系统上做标记,通过调整索引规则来优化检索效率。

具体实现上,LoRA会在模型的Query和Value投影层引入两个低秩矩阵A和B。在训练时,原始权重W保持冻结,只更新A和B的参数。前向传播时,实际使用的权重变为W + BA(其中B和A的维度远小于W),梯度信息只需要在低秩空间计算,这大大减少了显存占用。

LoRA的几个关键优势

- 显存效率高:相比全参数微调,LoRA通常只需要十分之一甚至更少的显存

- 训练速度快:因为参与更新的参数数量大幅减少,收敛周期明显缩短

- 部署灵活:训练完成后的适配器权重文件通常只有几十MB,方便切换和分发

- 不遗忘知识:冻结原始权重的做法保证了预训练知识不会在微调过程中丢失

对于Qwen3-VL这样的视觉语言模型,LoRA特别适合作用于视觉编码器和语言解码器的注意力层。通过实验发现,聚焦于q_proj和v_proj层的LoRA配置能够在模型容量和训练效率之间取得较好的平衡。

实战:数据准备与处理

质检场景的数据特点

工业质检的数据有自己的特点。和通用视觉任务不同,质检场景中缺陷样本往往稀缺,而正常样本相对容易获取。以MVTec AD数据集为例,它是工业异常检测领域最常用的基准数据集,涵盖了塑料、皮革、纺织品、金属零件等多种产品类型。正常样本通常有几百张,而每种缺陷类型的异常样本可能只有几十张。

对于实际工业场景,数据往往来自工厂的真实产线。某家做手机中框加工的企业,积累了数十万张加工完成品的图片,质检员标注出其中存在缺陷的产品。这种标注数据虽然不够精细,但胜在真实。如果要训练一个能识别"划痕"和"凹陷"的分类模型,我们需要构造包含这两类缺陷以及正常样本的训练集。

数据格式上,Qwen3-VL使用ChatML格式组织多模态对话数据。每条样本包含图像路径和对应的文本描述,文本中需要明确指出产品是否存在缺陷、缺陷的类型和位置信息。

[

{

"image": "train_images/batch001/img_001.jpg",

"conversations": [

{"from": "human", "value": "请检查这个手机中框是否存在表面缺陷。"},

{"from": "gpt", "value": "该产品表面存在一处划痕缺陷,位于左上角区域,划痕长度约3毫米,深度较浅,属于轻微表面损伤。建议返工处理。"}

]

},

{

"image": "train_images/batch001/img_002.jpg",

"conversations": [

{"from": "human", "value": "请检查这个手机中框是否存在表面缺陷。"},

{"from": "gpt", "value": "该产品表面无明显缺陷,符合出厂质量标准。"}

]

}

]标注数据的构造策略

质检数据的标注需要一定的专业知识。理想的标注应该包含缺陷的精确位置、大小、类型以及对产品功能的影响程度。但在实际操作中,我们可以根据实际需求灵活调整。

一种做法是让质检员只标注"是否存在缺陷"以及"缺陷的大致类型",而不要求精确的像素级标注。这种粗粒度标注的成本低、速度快,适合快速建立初版模型。之后再根据实际误判情况,针对性地补充更精细的标注。

另一种做法是借助已有的缺陷检测模型做预标注,人工只负责校验和修正。这能大幅提升标注效率,但需要确保预标注模型本身的质量足够可靠。

在实际项目中,我更倾向于先用粗粒度标注训练一个基础版本,验证整个流程是否跑通,再逐步补充精细标注。这种迭代方式能够在早期快速看到效果,也更容易获得业务方的认可。

训练配置与实操细节

硬件配置

LoRA微调Qwen3-VL-8B的显存需求相比全参数微调大幅降低。实测中,在RTX 4090 24GB显存的显卡上,使用batch_size=1、开启梯度检查点的情况下,模型能够正常加载并训练。如果使用A100 40GB或H100这样的专业计算卡,可以适当增大batch_size来提升训练吞吐量。

| 配置项 | 推荐值 | 说明 |

|---|---|---|

| batch_size | 1-4 | 根据显存大小调整,24GB建议1-2 |

| learning_rate | 1e-4 到 3e-4 | LoRA层可以适当提高学习率 |

| LoRA rank | 8-32 | 越大表达能力越强,但参数量也增加 |

| LoRA alpha | rank的2倍 | 控制LoRA层的影响力 |

| 训练轮数 | 3-10 | 监控验证集loss避免过拟合 |

关键参数说明

LoRA rank的选择需要在模型容量和训练效率之间做权衡。rank=8时,LoRA参数量约为几十MB,训练速度快但表达能力有限;rank=32时参数量增加到上百MB,能够学习更复杂的任务模式,但对于简单的质检任务来说可能过犹不及。实际项目中可以从rank=16开始尝试,根据效果再做调整。

学习率的选择也有讲究。预训练模型的主要权重层使用较低的学习率(比如1e-5),而LoRA新增的适配层可以使用稍高的学习率(比如1e-4)。这种差异化设置能够避免破坏预训练知识,同时让新任务快速收敛。

训练监控与早停

训练过程中需要密切关注验证集的表现。质检任务通常使用准确率和召回率作为主要指标,但如果数据存在类别不平衡(比如正常样本远多于缺陷样本),还需要关注F1分数和AUC这类综合指标。

建议设置早停机制:当验证集指标连续多个epoch没有提升时自动停止训练,避免过拟合。对于质检场景,3-5个epoch的patience通常是合理的。

模型推理与部署

推理流程

微调完成后,LoRA适配器需要和原始模型合并才能进行推理。合并过程是把LoRA层的权重融合回原始权重矩阵,合并后的模型在使用上与原始模型没有区别。

质检场景的推理通常需要追求低延迟。一张工业相机拍摄的零件图片,检测系统需要在几百毫秒内给出判断结果,以便和产线的节拍时间匹配。Qwen3-VL-8B在RTX 4090上单张图片的推理时间约200-400毫秒,基本能够满足中速产线的需求。如果使用INT4量化,推理速度还能再提升30%左右。

结果解析

Qwen3-VL的输出是自然语言形式的判断结果,我们需要从中提取结构化的质检结论。典型的输出格式可能是这样的:

该手机中框存在以下质量问题:

`

- 表面划痕:位于顶部边缘,长度约4mm

- 无凹陷或气泡

综合判定:不合格,建议返工`

后处理程序需要从这段文本中提取出缺陷类型、位置、尺寸等信息,生成标准化的质检报告。在实际系统中,这些数据还会被汇总到MES(制造执行系统)中,用于质量追溯和工艺改进分析。

边缘部署的考量

考虑到工厂的网络安全和响应延迟要求,质检模型最好能部署在产线附近的边缘服务器上。Qwen3-VL-8B经过INT4量化后,模型大小可以压缩到约6GB,部署在一台普通工控机上完全可行。工控机通常配备Intel i5或i7处理器,配合一张入门级显卡,就能支撑起基本的质检推理任务。

质检系统的典型架构

工业相机采集产品图像 → 图像预处理(亮度调整、去噪) → Qwen3-VL推理 → 结果解析与质检判定 → 不合格品自动分流 → 质检数据上报MES

效果评估与持续优化

模型上线后,需要持续跟踪质检效果。最直接的指标是漏检率和误检率:漏检率高的产品流入市场会引发质量投诉,误检率高则会导致大量合格品被误判为不良,增加返工成本。

建议建立一套反馈机制:产线工人对自动质检结果有异议时,可以标记并提交给人工复检,复检结果反馈到系统中用于后续优化。这种闭环能够确保模型在实际使用中不断提升。

定期用新采集的数据对模型进行增量训练也很重要。产品外观可能会随着模具磨损、原材料批次变化而发生微妙改变,模型需要及时适应这些变化。建议至少每个月用最新的样本数据更新一次模型。

实践心得

用视觉语言模型做质检,本质上是把大模型的通用能力迁移到具体的工业场景。Qwen3-VL-8B凭借其良好的多模态理解能力和相对亲民的资源需求,为这件事提供了一个性价比不错的选择。LoRA微调让整个流程变得足够轻量,不需要昂贵的GPU集群,在普通的研究环境里就能完成训练。

当然,这套方案并非完美。质检场景对实时性和稳定性要求很高,生产环境中的网络波动、相机故障、异常光照等问题都可能影响系统表现。把模型跑起来只是第一步,后续的工程化优化、异常处理、持续运维才是真正考验人的地方。