Restormer:高分辨率图像修复的高效Transformer (CVPR 2022 - 口头报告)

摘要

X-Restormer++ 是 CVPR 2026 UG2+ 全天候图像恢复赛(Track 1)的第一名方案,建立在 Restormer 转置注意力架构之上,新增了三项工程改进:空间自适应输入缩放 (不同区域差异化增强)、梯度引导边缘感知损失 (保留几何结构而非只追求视觉清洁)、以及 24,500 对额外的 FoundIR+WeatherBench 数据。它的目标场景覆盖暴雨、大雪、浓雾、沙尘/雾霾等全谱系低能见度天气。对 SLAM/VIO 工程师而言,这类模型的正确定位不是"替代 SLAM 主干",而是可选前处理模块------何时开、何时关、开了是否真能提升 tracking stability,必须以 ATE/RPE 而非 PSNR 为指标实验验证。

一、X-Restormer++ 的三项核心创新

1.1 空间自适应输入缩放(Spatially-Adaptive Input Scaling)

传统图像恢复模型对全图使用统一的增强强度,这对多区域退化不均匀的天气图像是次优的:图像角落可能积雪严重而中心区域仍可见。X-Restormer++ 在输入阶段引入逐区域(patch-wise)自适应缩放系数 λ ( x , y ) \lambda(x, y) λ(x,y),使不同空间位置获得与局部退化程度匹配的恢复力度:

I ^ scale ( x , y ) = λ ( x , y ) ⋅ I in ( x , y ) \hat{I}{\text{scale}}(x, y) = \lambda(x, y) \cdot I{\text{in}}(x, y) I^scale(x,y)=λ(x,y)⋅Iin(x,y)

其中 λ ( x , y ) ∈ λ min , λ max \lambda(x, y) \in \\lambda_{\\min}, \\lambda_{\\max} λ(x,y)∈λmin,λmax 由轻量子网络根据局部梯度/频率特征预测。这避免了统一增强导致的欠恢复(低退化区域)和过平滑(严重退化区域)问题。

1.2 梯度引导边缘感知损失(Gradient-Guided Edge-Aware Loss)

标准 ℓ 1 / ℓ 2 \ell_1/\ell_2 ℓ1/ℓ2 损失只关注像素强度误差,容易让模型优化出视觉平滑但边缘模糊的输出。对 SLAM 的特征提取而言,边缘和角点质量远比整体亮度精度重要。X-Restormer++ 在损失函数中加入梯度项:

L total = L rec + α ⋅ L edge \mathcal{L}{\text{total}} = \mathcal{L}{\text{rec}} + \alpha \cdot \mathcal{L}_{\text{edge}} Ltotal=Lrec+α⋅Ledge

L edge = ∥ ∇ I ^ − ∇ I gt ∥ 1 \mathcal{L}{\text{edge}} = \left\| \nabla \hat{I} - \nabla I{\text{gt}} \right\|_1 Ledge= ∇I^−∇Igt 1

其中 ∇ \nabla ∇ 为 Sobel/Laplacian 算子, I ^ \hat{I} I^ 为模型输出, I gt I_{\text{gt}} Igt 为清晰参考图。该损失显式惩罚边缘偏移,使恢复后图像的轮廓与干净参考对齐------这对后续 ORB 特征点、LK 光流、SIFT 匹配的稳定性是关键。

1.3 额外 24,500 对退化-清晰训练数据

| 数据集 | 来源 | 数据量 | 退化类型 |

|---|---|---|---|

| FoundIR | 百万级合成退化 | ~20K 对 | 雨/雾/噪声/模糊综合 |

| WeatherBench | 真实天气采集系统(AWAS) | ~4.5K 对 | 真实雨/雪/霾对齐图像对 |

WeatherBench 数据用专用的 All-in-One Weather Acquisition System(含雾/雨/雪发生器)采集,提供精确对齐的退化-清晰图像对,是当前少有的真实天气退化基准(对比大多数方案依赖合成数据)。

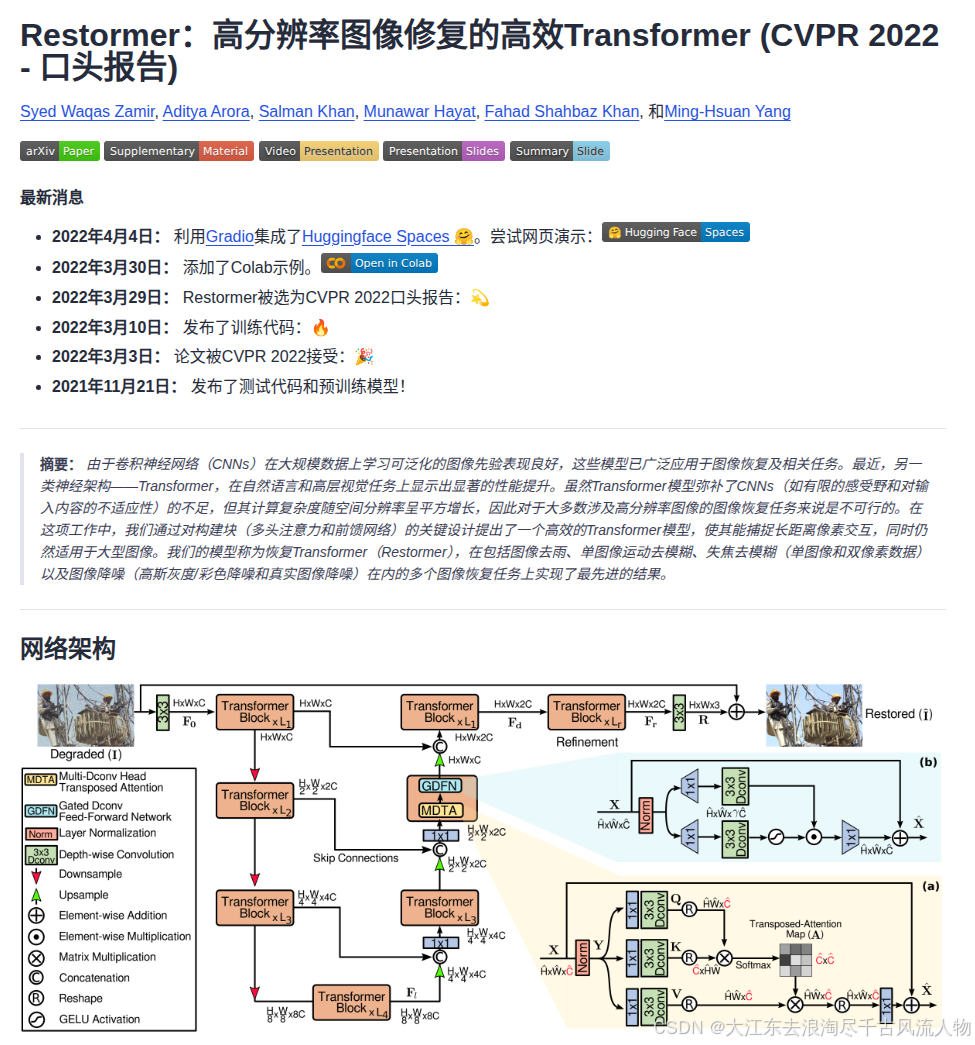

二、Restormer 基础架构回顾

X-Restormer++ 继承了 Restormer(CVPR 2022 Oral)的主干架构,理解基础有助于判断改动的价值。

2.1 多头转置注意力(MDTA)

Restormer 的核心创新:将 Attention 计算从空间维 转到通道维 ,将复杂度从 O ( H 2 W 2 ) O(H^2W^2) O(H2W2) 降至 O ( H W ) O(HW) O(HW):

X ^ = W p ⋅ Attention ( Q ^ , K ^ , V ^ ) + X \hat{\mathbf{X}} = \mathbf{W}_p \cdot \text{Attention}(\hat{\mathbf{Q}}, \hat{\mathbf{K}}, \hat{\mathbf{V}}) + \mathbf{X} X^=Wp⋅Attention(Q^,K^,V^)+X

Attention ( Q ^ , K ^ , V ^ ) = V ^ ⋅ Softmax ( K ^ ⋅ Q ^ α ) \text{Attention}(\hat{\mathbf{Q}}, \hat{\mathbf{K}}, \hat{\mathbf{V}}) = \hat{\mathbf{V}} \cdot \text{Softmax}\!\left(\frac{\hat{\mathbf{K}} \cdot \hat{\mathbf{Q}}}{\alpha}\right) Attention(Q^,K^,V^)=V^⋅Softmax(αK^⋅Q^)

其中 Q ^ , K ^ , V ^ \hat{\mathbf{Q}}, \hat{\mathbf{K}}, \hat{\mathbf{V}} Q^,K^,V^ 由 1×1 卷积(跨通道聚合)+ 3×3 深度可分离卷积(局部上下文)生成。注意力矩阵维度为 C × C C \times C C×C(通道数)而非 H W × H W HW \times HW HW×HW(像素数),对高分辨率图像的推理效率显著提升。

2.2 门控深度可分离前馈网络(GDFN)

X ^ = W p 0 ⋅ Gating ( X ) + X \hat{\mathbf{X}} = \mathbf{W}_p^0 \cdot \text{Gating}(\mathbf{X}) + \mathbf{X} X^=Wp0⋅Gating(X)+X

Gating ( X ) = ϕ ( W d 1 W p 1 LN ( X ) ) ⊙ W d 2 W p 2 LN ( X ) \text{Gating}(\mathbf{X}) = \phi\!\left(\mathbf{W}_d^1 \mathbf{W}_p^1 \text{LN}(\mathbf{X})\right) \odot \mathbf{W}_d^2 \mathbf{W}_p^2 \text{LN}(\mathbf{X}) Gating(X)=ϕ(Wd1Wp1LN(X))⊙Wd2Wp2LN(X)

⊙ \odot ⊙ 为逐元素乘积, ϕ \phi ϕ 为 GELU 激活。门控机制让网络学会抑制噪声特征、只传播有效信息,相比标准 FFN 在去噪任务中更稳健。

2.3 整体结构

Transformer Block

MDTA

通道注意力 O-HW

GDFN

门控深度可分离FFN

退化图像输入

浅层特征提取

3×3 Conv

4级编码器

Transformer Block: 4-6-6-8

瓶颈层

8 Transformer Blocks

4级解码器

对称结构 + Skip Connection

残差输出

+输入图像

恢复图像

三、对 VIO/SLAM 系统的价值评估

3.1 正确定位:前处理模块,不是 SLAM 主干

X-Restormer++ 在 VIO/SLAM 系统中的作用位置:

退化严重

质量正常

原始相机图像

雨/雪/雾/沙尘

图像质量评估

IQA

X-Restormer++

全天候恢复

直接输入

特征提取

ORB / SuperPoint

光流/深度

RAFT / Depth Pro

VIO/SLAM 后端

OpenVINS / ORB-SLAM3

位姿 / 地图

自适应开关(图像质量正常时跳过恢复模块)是工程实用性的关键,可以避免在好天气下引入不必要的延迟和 hallucination 风险。

3.2 潜在收益

| 场景 | 机制 | 预期收益 |

|---|---|---|

| 暴雨/大雪 | 去除雨线/雪点噪声 | 提升可跟踪特征点数量 |

| 浓雾/雾霾 | 对比度增强、去雾 | 改善光流估计的纹理可见性 |

| 低光照 | 动态范围扩展 | 减少暗区角点丢失 |

| 沙尘 | 频率滤波 | 降低随机噪声对匹配的干扰 |

3.3 工程风险(不可忽视)

| 风险 | 具体表现 | 影响 |

|---|---|---|

| 细节幻觉(Hallucination) | 恢复出的细节不对应真实物理结构 | 破坏特征匹配一致性 |

| 几何一致性破坏 | 像素值分布被改变,极线约束不再精确成立 | 误匹配率上升 |

| 推理延迟 | 高分辨率图像推理 20-100ms | 实时 VIO 帧率下降 |

| 嵌入式部署压力 | Transformer 架构量化损失较大 | 边缘设备部署困难 |

⚠️ 核心结论:恢复后的图像不一定更适合 SLAM。视觉上干净的图像,对下游任务的实际帮助必须用 ATE/RPE/tracking loss 实验验证,不能用 PSNR、SSIM 或视觉效果代替。

四、推荐实验框架

验证图像恢复前处理是否真正提升 SLAM tracking 的最小实验设计:

| 版本 | 输入处理 | SLAM 前端 | 评估指标 |

|---|---|---|---|

| Baseline | 原始雨/雾/低光图像 | ORB-SLAM3 / OpenVINS | tracking loss 率、ATE、FPS |

| Enhancement v1 | CLAHE / Gamma / Retinex(轻量经典算法) | 同上 | 与 Baseline 对比 |

| Enhancement v2 | X-Restormer / Restormer 类模型(全量) | 同上 | 精度提升 vs 延迟代价 |

| Enhancement v3 | 轻量蒸馏版(INT8/FP16 量化) | 同上 | 嵌入式可行性验证 |

| Hybrid | IQA 驱动自适应开关(退化分数 > 阈值才开启) | 同上 | 综合稳定性 |

关键评估维度:

- Tracking Loss 率:连续 N 帧内特征丢失导致重定位的次数

- ATE RMSE(Absolute Trajectory Error):端到端轨迹精度

- 端到端 FPS:含图像恢复的总推理延迟

五、产品定位建议

对长续航可穿戴 AR/VR 或户外机器人产品,不建议以"AI 解决了所有恶劣天气 SLAM"作为卖点。更落地的技术路线:

低光

雨/雾/雪

清晰

Camera Input

Image Quality Assessment

轻量 IQA 模块

退化类型判断

Retinex/CLAHE

低延迟轻量方案

X-Restormer++ 子模型

按退化类型专用化

直接通过

Feature / Optical Flow / Depth

VIO Backend

grslam / OpenVINS

Pose / Map / Spatial Understanding

这比单纯说"AI SLAM"更落地,也是当前工业界(大疆、百度、Waymo)普遍采用的分层鲁棒化策略。

小结

三点个人判断:

-

边缘感知损失是最有价值的改动:它将图像恢复的优化目标从"看起来干净"转向"特征可提取",与 SLAM 前端的实际需求对齐。若用 LoFTR/SuperPoint 替代 ORB,这个损失对匹配精度的影响值得专项实验。

-

WeatherBench 真实数据是竞赛取胜关键:大多数恢复模型在合成雨/雾上效果好、真实场景泛化差。真实采集的配对数据对部署到户外设备具有更直接的迁移价值。

-

不要跳过 v1(CLAHE/Retinex):在嵌入式场景下,计算量小两个数量级的经典算法在中等退化条件下可能已经足够,神经网络前处理的边际价值要在实验中证明。

论文/资源链接:

- X-Restormer++ 技术报告:CVPR 2026 UG2+ 竞赛(Track 1 第一名,待公开)

- Restormer 基础架构:arXiv 2111.09881 | GitHub

- WeatherBench 数据集:arXiv 2509.11642

- UG2+ Challenge 2026:官方主页