本文介绍了在Windows环境下,通过Ollama来本地部署DeepSeek R1。该问包含了Ollama的下载、安装、安装目录迁移、大模型存储位置修改、下载DeepSeek以及通过Web UI来对话等相关内容。

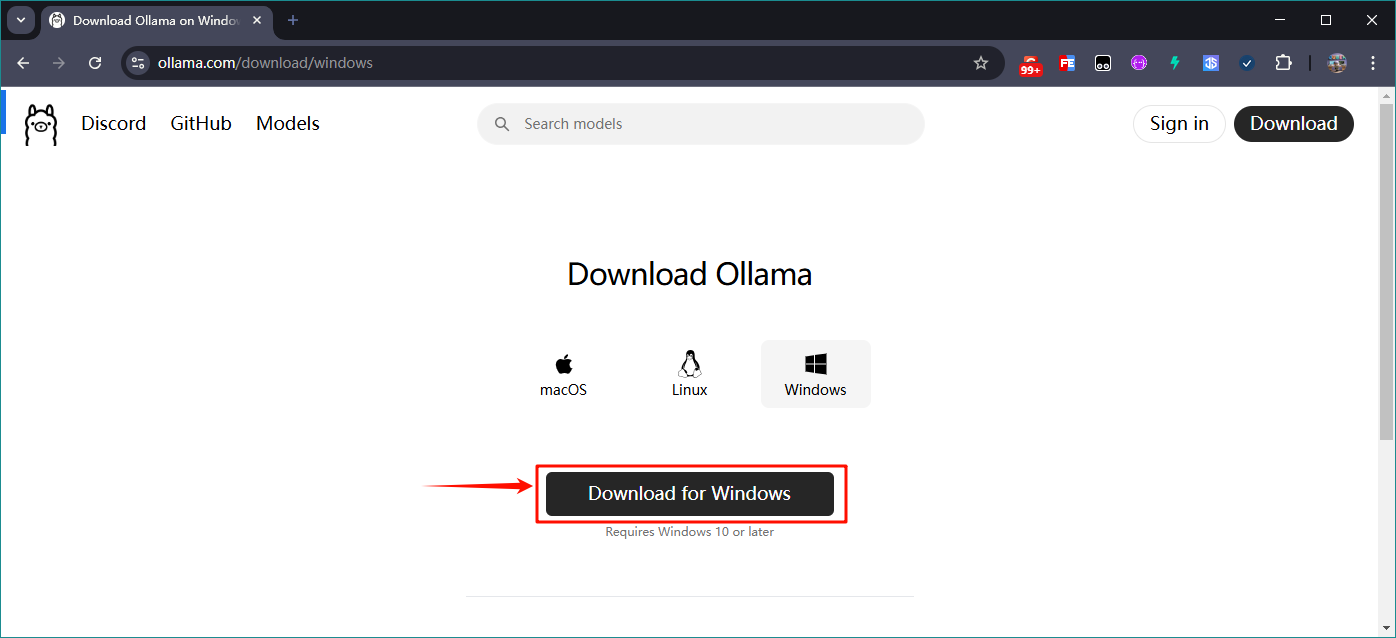

1、下载Ollama

首先我们到Ollama官网去下载安装包,此处我们下载的是Windows版本的安装包,如下图所示:

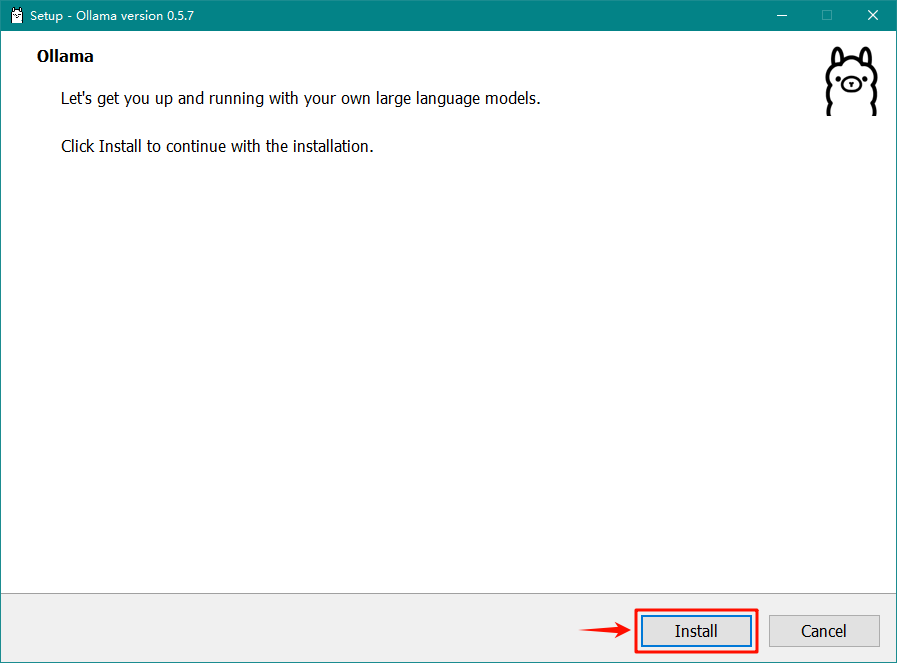

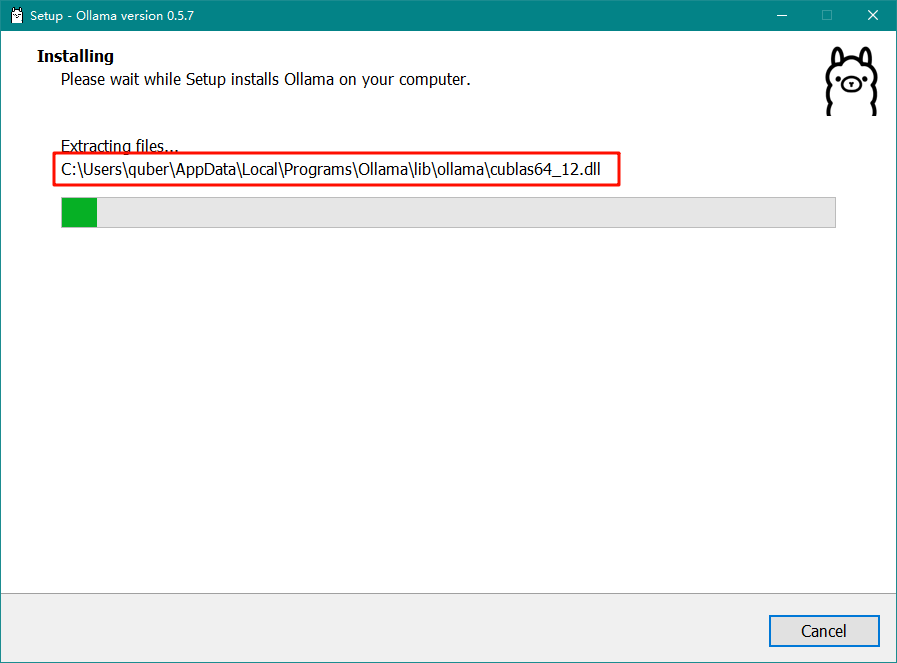

2、安装Ollama

Windows安装包下载完成后,我们直接双击安装包,然后点击Install按钮等待安装完成即可,如下图所示:

**注意:**安装完成后,Ollama默认为打开状态,此时我们先退出Ollama(鼠标右键点击任务栏的Ollama图标然后选择退出即可)。

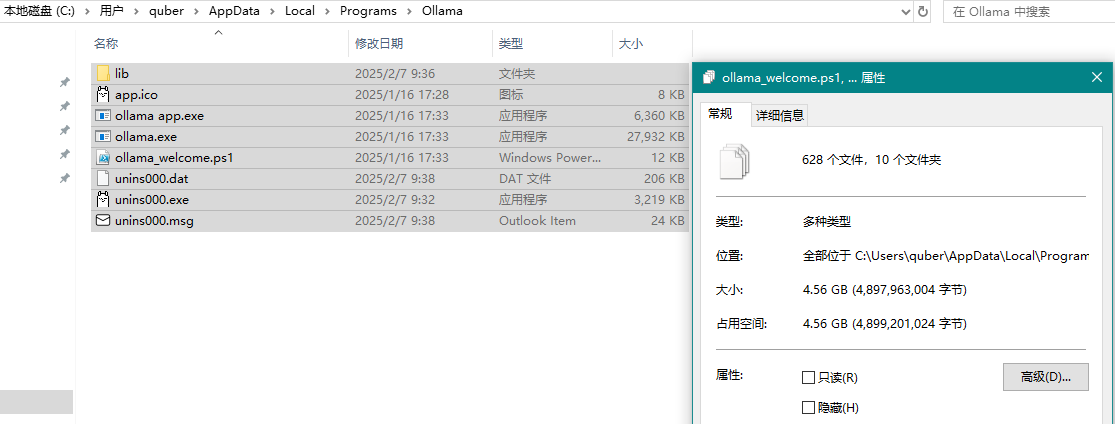

如上图所示,Ollama默认安装在C盘的C:\Users\quber\AppData\Local\Programs\Ollama目录下,如下图所示为默认安装的文件,大小大概有4.56GB:

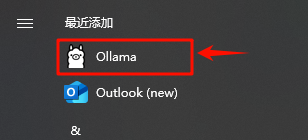

Ollama安装完成后,在桌面上是没有快捷启动图标的,我们可以在开始菜单中查找或在搜索框中搜索,如下图所示:

3、转移Ollama安装目录

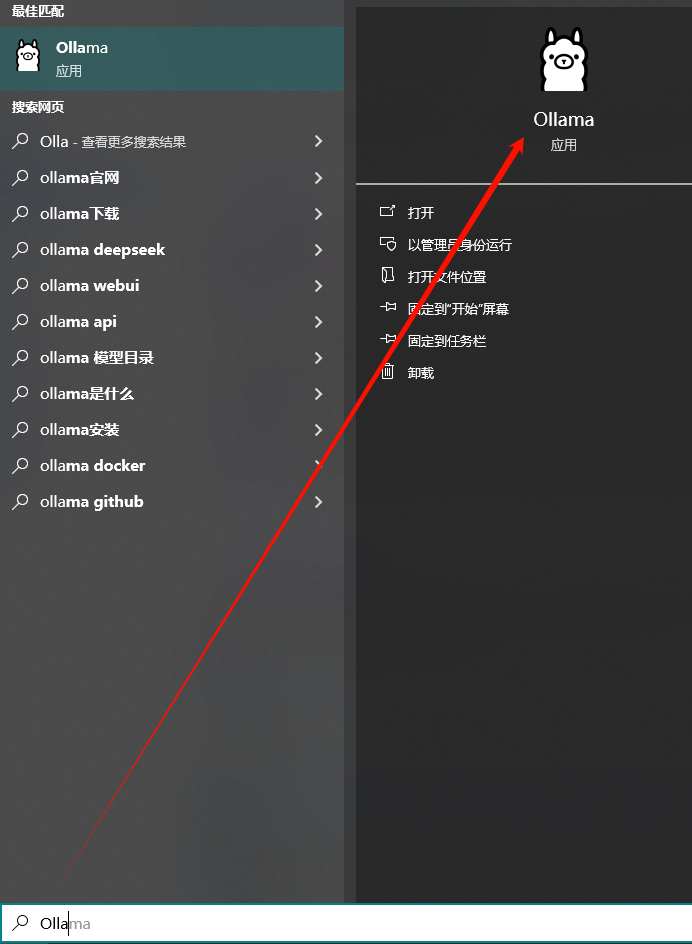

如果不想将Ollama安装到C盘,可以将安装的所有文件全部剪切到其他盘的目录内,如转移到D盘的D:\Net_Program\Net_Ollama目录下,这样可以节约C盘的空间,如下图所示:

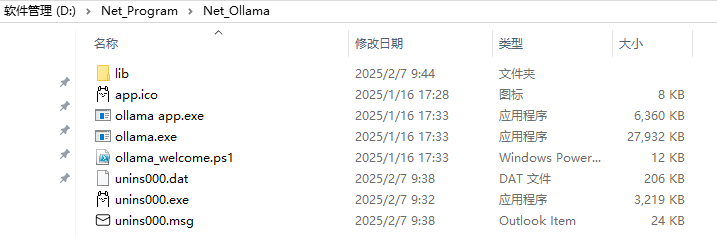

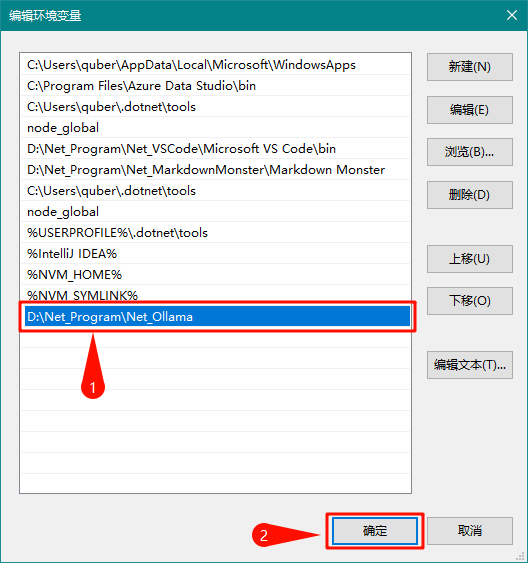

转移后,我们还需要修改Ollama的环境变量。

打开环境变量,双击用户变量中的Path,我们会看到最后一条信息就是Ollama安装完成后默认添加进来的,如下图所示:

我们双击最后一条信息进入编辑状态,修改为我们转移的目录D:\Net_Program\Net_Ollama,然后点击确定按钮关闭所有窗体即可,如下图所示:

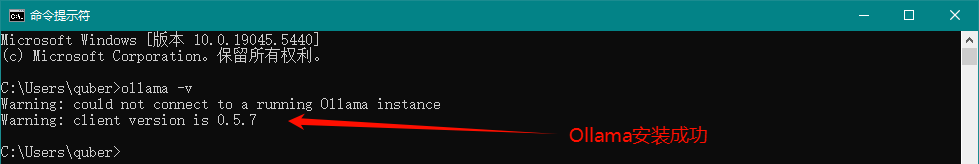

4、验证Ollama

上述步骤完成后,我们可以打开CMD,输入ollama -v命令,如果出现如下图所示的内容就代表Ollama安装成功了:

同样我们输入ollama -h命令可以查看Ollama其他操作命令,如下图所示:

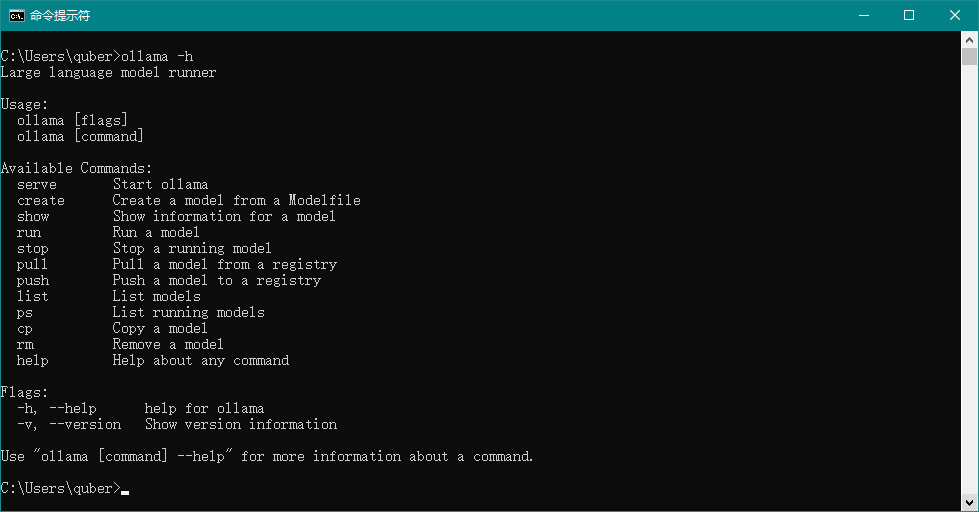

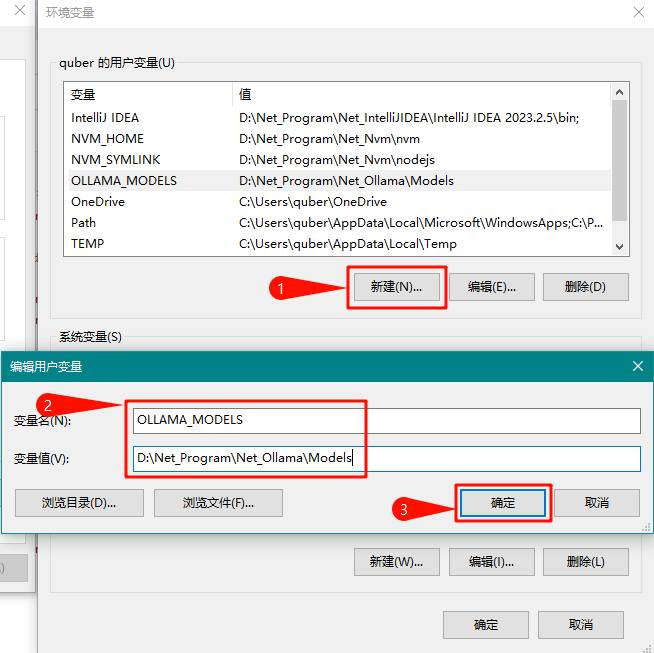

5、修改大模型存储位置

接下来我们需要配置大模型下载存储的目录位置(默认存储在C盘的C:\Users\quber\.ollama\models目录下)。

同样我们打开环境变量,然后在用户变量中点击新建按钮,变量名为OLLAMA_MODELS,变量值为D:\Net_Program\Net_Ollama\Models,其中的变量值就是大模型下载存储的目录位置,最后点击确定即可,如下图所示:

6、下载DeepSeek

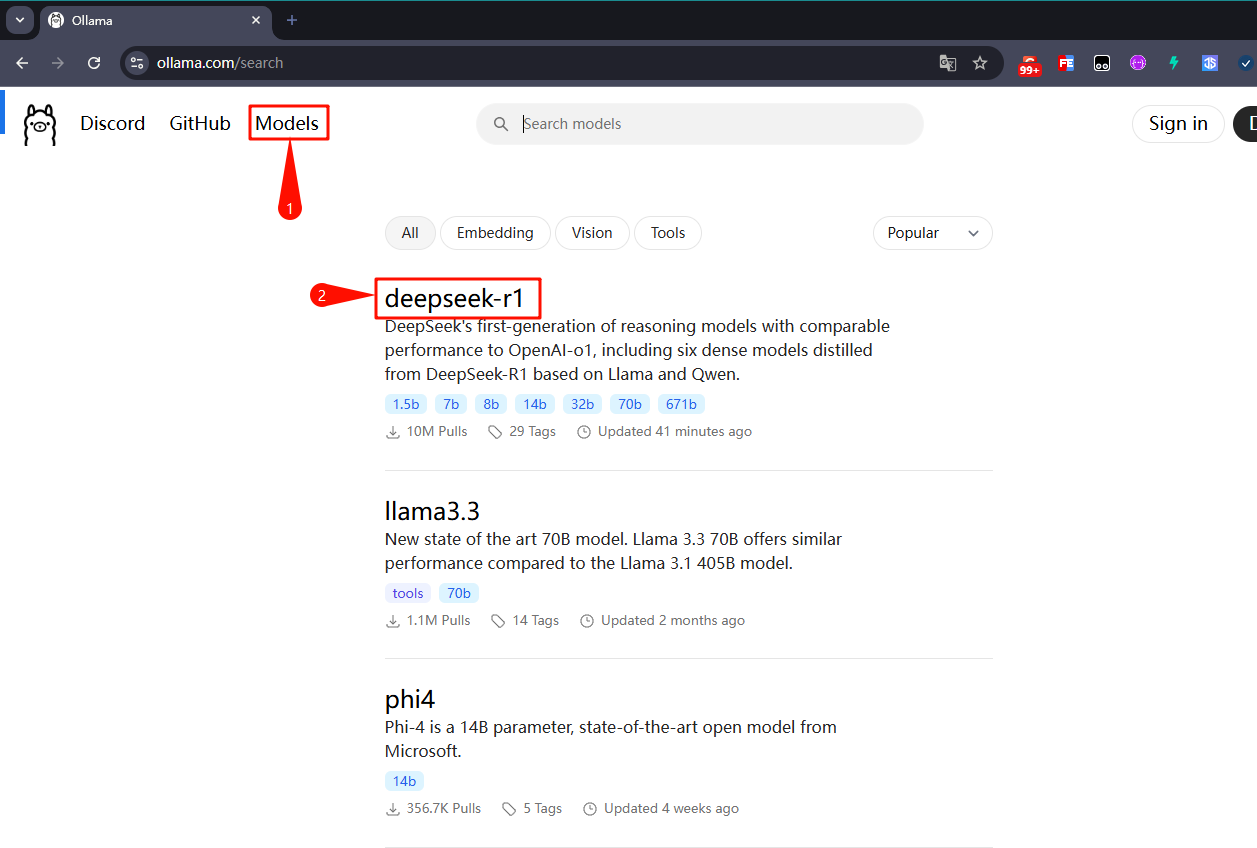

同样我们打开Ollama官网,点击顶部的Models链接,此时我们就会看到deepseek-r1模型排在第一位,如下图所示:

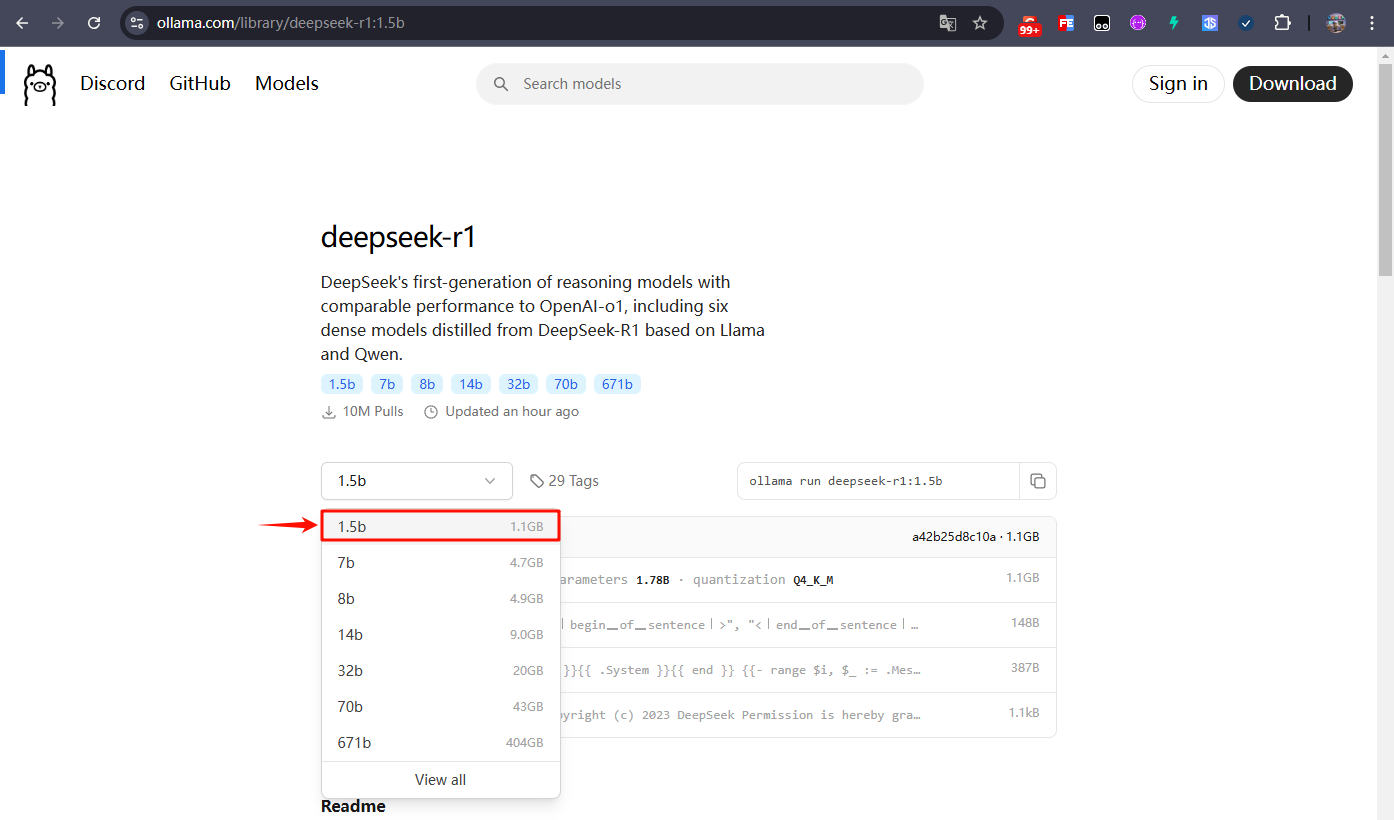

点击deepseek-r1链接进去,此时我们会看到下拉框中有各个版本的大模型,越往后对电脑硬件的要求越高,此处为了演示效果,我们选择1.5b进行下载(具体可根据自己的电脑和需求有选择性的下载),如下图所示:

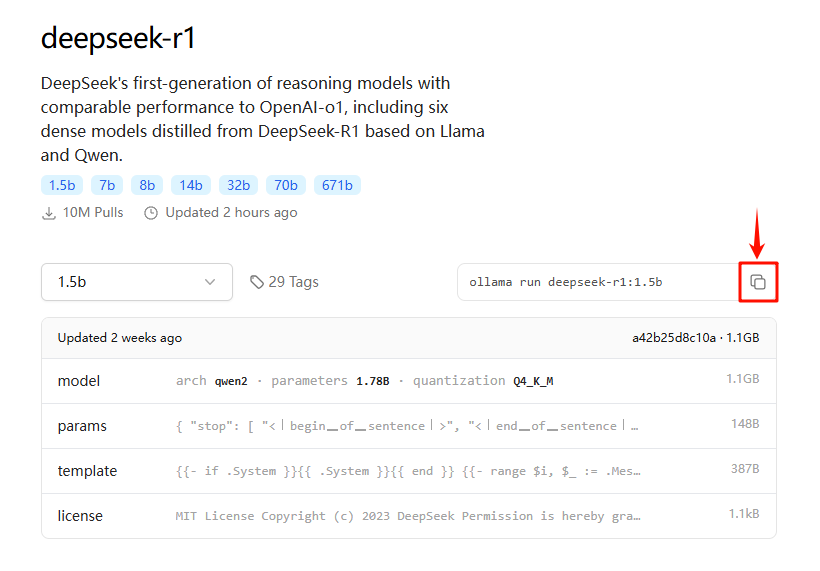

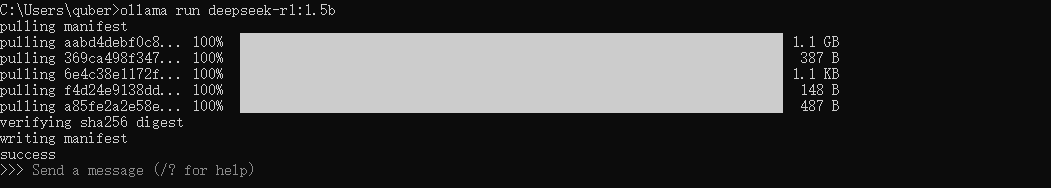

随后我们复制下拉框后面的命令ollama run deepseek-r1:1.5b,粘贴到新打开的CMD窗口 中回车执行(耐心等待下载完成),如下图所示:

注意: 上述下载命令需要在新打开的CMD窗口中执行,否则下载的文件存储在C:\Users\quber\.ollama位置,就不是我们修改的D:\Net_Program\Net_Ollama\Models这个位置了。

温馨提示:

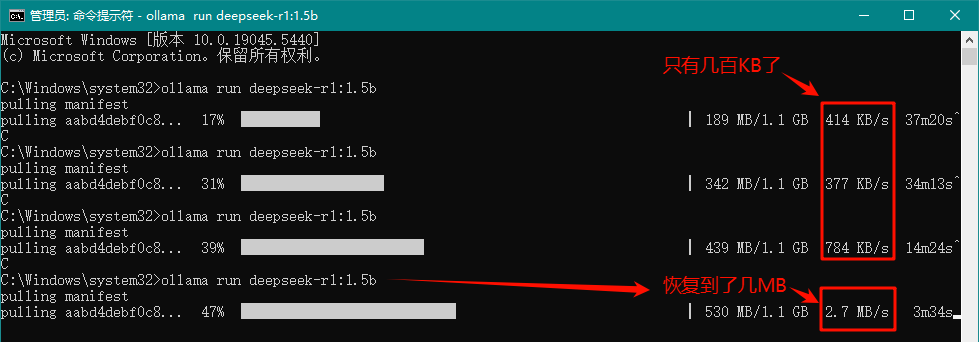

下载过程中,最开始下载速度可能要快一些,下载到后面可能就几百KB了,此时我们可以按Ctrl+C停止下载,然后再重新复制命令执行下载,此时的下载速度又恢复到了几MB了(此操作可能会遇到重新下载的情况),如此往复操作即可,如下图所示:

如出现如下图所示的效果就代表下载完成了:

7、验证DeepSeek

在DeepSeek下载完成后,我们就可以在CMD中输入内容进行对话了,如输入:你好,如下图所示:

到此,DeepSeek R1的部署就基本告一段落。

8、Web UI对话

虽然我们可以通过CMD窗口进行对话,但是相对不那么直观,于是我们可以通过第三方Web UI来实现对话效果。

8.1、Chrome插件-Page Assist

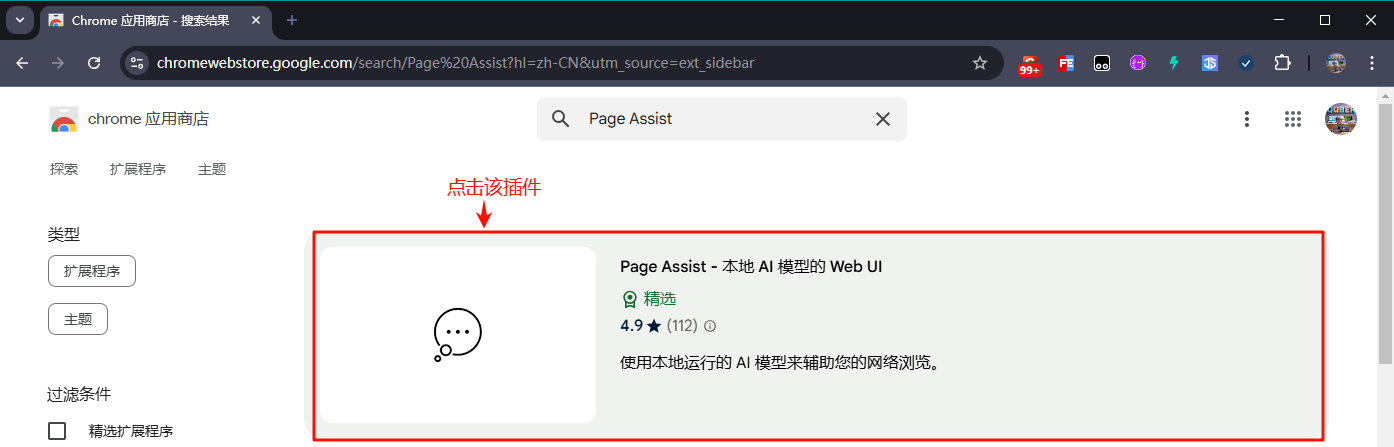

首先我们通过谷歌浏览器官方插件地址搜索Page Assist,点击Page Assist - 本地 AI 模型的 Web UI,如下图所示:

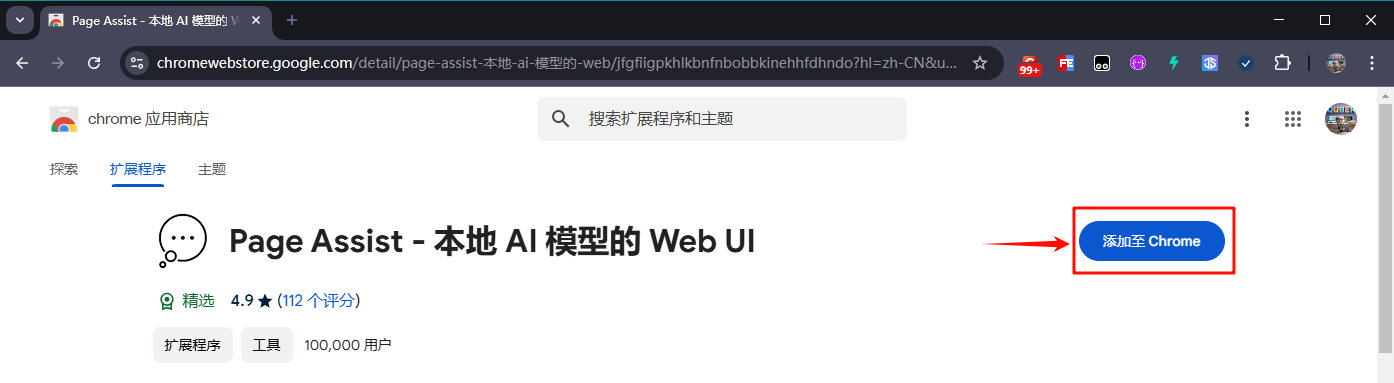

然后添加到Chrome:

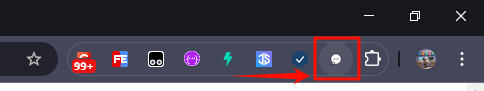

安装完成后,我们可以将该插件固定(钉)到浏览器顶部,方便使用,如下图所示:

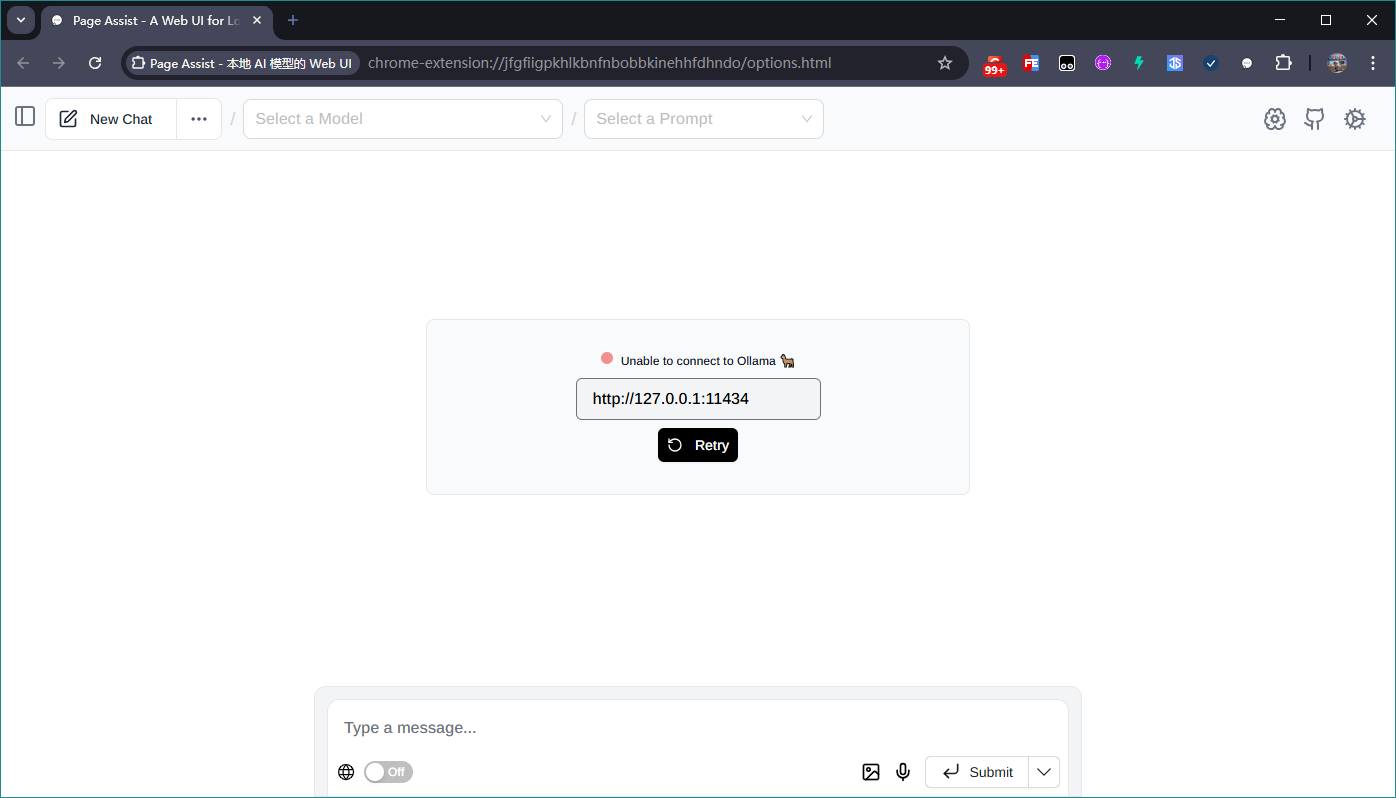

随后我们点击该插件,就会出现如下图所示的界面:

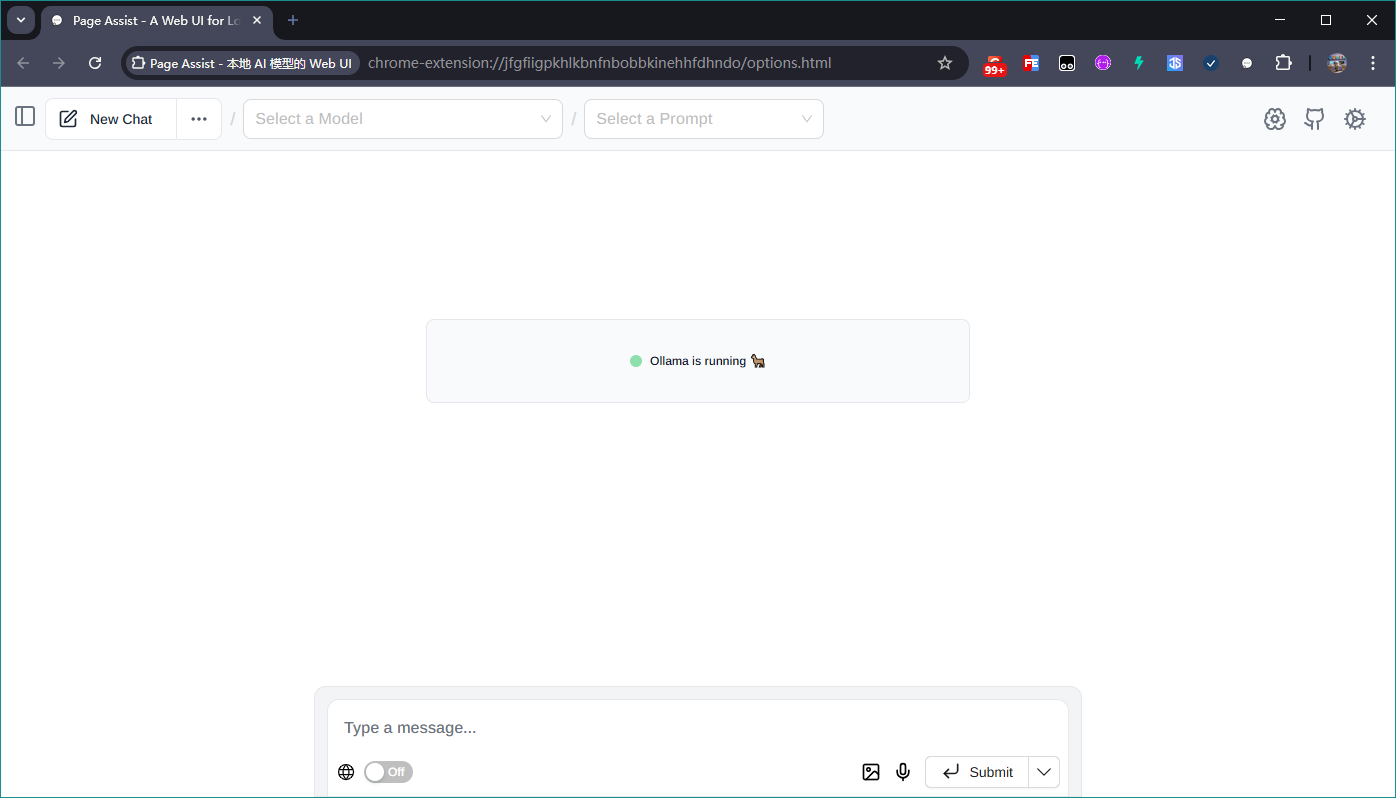

在界面中出现了Unable to connect to Ollama的提示,是因为我们安装的Ollama没有启动,此时我们只需要启动Ollama软件即可,启动后的界面效果如下图所示:

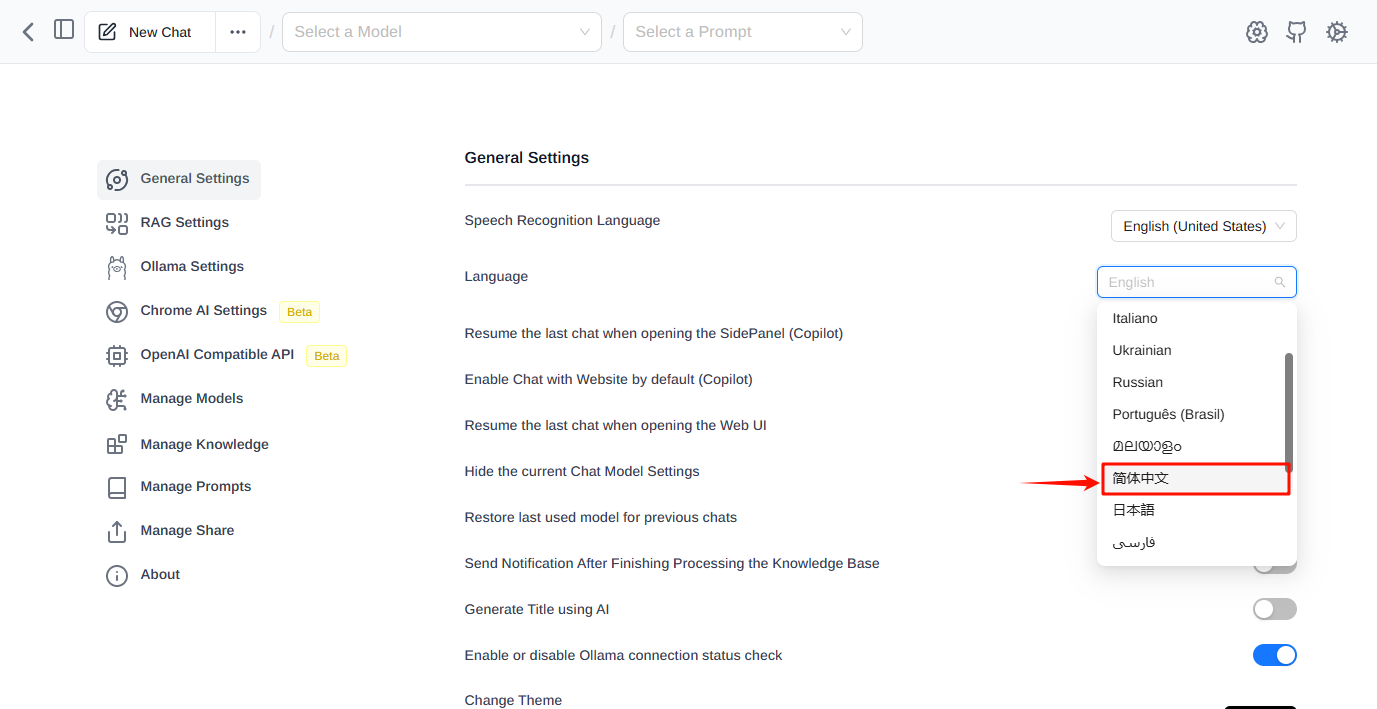

设置中文:

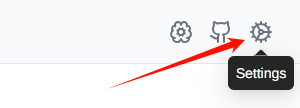

点击界面右上角的Settings按钮,将预览设置为简体中文,如下图所示:

设置完成后返回主界面,此时就是中文界面了。

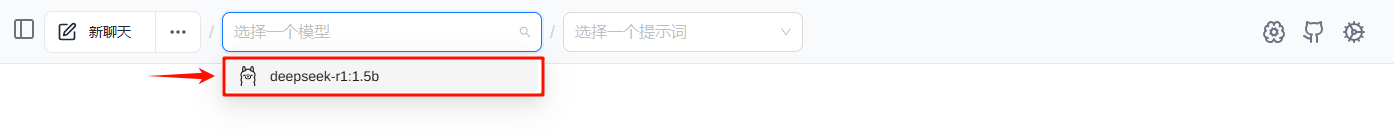

选择模型:

点击主界面中的第一个下拉框,选择我们刚才下载的模型deepseek-r1:1.5b,如下图所示:

到此,配制就完成了。

对话演示:

接下来我们就可以愉快的对话了,效果图下图所示:

温馨提示:

上述演示效果,和电脑的配置有一定的关系,仅供参考。

8.2、chatboxai在线对话

我们也可以通过在线Web UI https://web.chatboxai.app/ 进行对话。

首先我们打开https://web.chatboxai.app/,打开后界面中间会有一个弹出框,我们点击阴影处即可取消该弹框的显示。

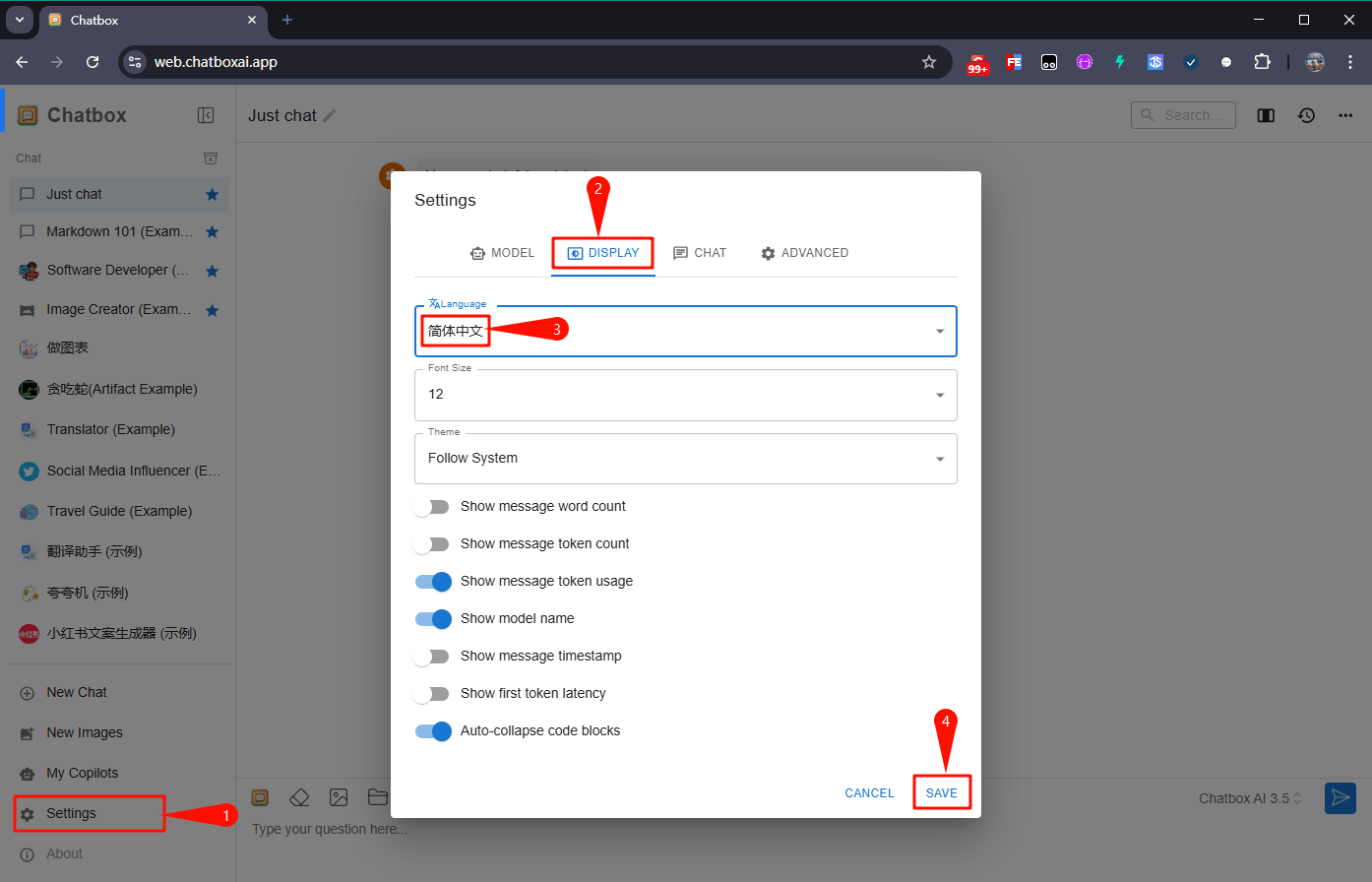

设置中文:

我们点击左下角的Settings,在弹出框中点击DISPLAY,在第一个下拉框中选择简体中文,随后点击右下角的SAVE即可显示为中文了,如下图所示:

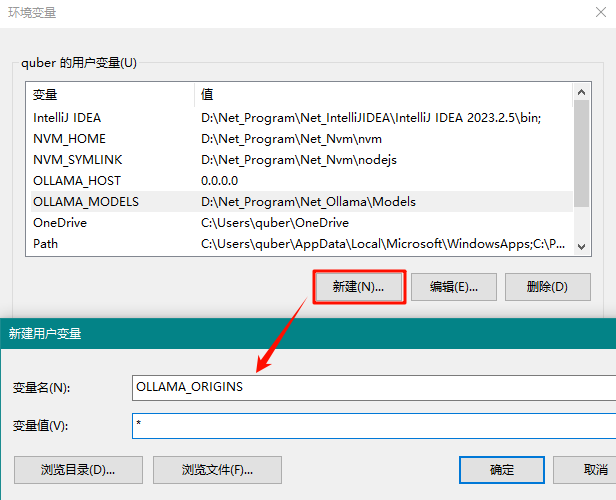

配置环境变量:

在用户环境变量中,我们点击新建,分别新建下面两组变量,如下所示:

ruby

OLLAMA_HOST 0.0.0.0 --任何IP都可以访问

OLLAMA_ORIGINS *

重启Ollama:

配置好环境变量后,我们重启下Ollama,目的是让https://web.chatboxai.app/能自动识别连接到Ollama服务,然后刷新下https://web.chatboxai.app/。

设置模型提供方和模型:

点击左下角的设置按钮,然后在模型选项卡中选择模型提供方为OLLAMA API ,模型选择deepseek-r1:1.5b ,然后点击保存,如下图所示:

对话演示:

接下来我们就可以愉快的对话了,效果图下图所示:

到此,DeepSeek R1模型的本地部署以及简单对话应用就完成了!!!